基于自動確定特征點數的鏡頭分割方法

李國和, 劉佃興, 臧金曉, 吳衛江

(中國石油大學(北京)地球物理與信息工程學院,北京 102249;中國石油大學(北京)油氣數據挖掘北京市重點實驗室,北京 102249;

石大兆信數字身份管理與物聯網技術研究院,北京 100029)

基于自動確定特征點數的鏡頭分割方法

李國和, 劉佃興, 臧金曉, 吳衛江

(中國石油大學(北京)地球物理與信息工程學院,北京 102249;中國石油大學(北京)油氣數據挖掘北京市重點實驗室,北京 102249;

石大兆信數字身份管理與物聯網技術研究院,北京 100029)

鏡頭分割對實現基于圖像內容的視頻檢索具有重要作用。為了提高視頻鏡頭分割的效果,采用Harris算子進行像素點的能量評估,并抑制偽特征點。通過圖像幀分塊和邊緣檢測,獲取最小化特征點集,并使特征點分布相對均勻合理,然后根據特征點計算圖像幀統計量,進一步形成圖像幀的特征向量。在此基礎上,結合圖像幀漸變檢測和閃光檢測實現鏡頭分割方法,取得很好鏡頭分割效果。

Harris算子;特征提取;閃光檢測;漸變檢測;鏡頭分割

視頻鏡頭分割是基于鏡頭變化的分割方法,也是關鍵幀提取、場景聚類和基于內容檢索等的基礎之一[1]。鏡頭變化檢測方法可分為鏡頭突變(切變)檢測和鏡頭漸變檢測[2]。鏡頭突變主要是攝像機的停機或鏡頭的切換。鏡頭漸變主要在兩個鏡頭之間加入淡入淡出等編輯效果。

目前已有的鏡頭分割算法包括像素比較方法、似然比較方法[3]、基于直方圖比較方法等基礎算法[3],以及在基礎算法上改進的算法,這些鏡頭分割算法主要是選取圖像幀的底層特征并構成特征向量,用相鄰兩幀的特征向量差與固定閾值比較,從而判斷是否發生了鏡頭變化。由于視頻中編輯方法多變,固定閾值無法完全界定視頻內容的復雜變換,底層特征提取復雜程度不僅導致鏡頭分割算法中計算復雜度大,而且不易適應表示圖像幀變化[2]。

無論視頻如何編輯,當視頻發生鏡頭變化時,相鄰圖像幀中對應的像素點會發生較明顯的變化,用少量具有代表性的像素點構成特征向量不僅保留了圖像幀重要特征信息,而且有效地減少了數據量和運算量,同時又反映不同鏡頭的變化。本文結合像素點之間變化構成自動調整的閾值,同時引入鏡頭漸變檢測和閃光燈檢測,實現了一種自動確定特征點和鏡頭檢測閾值的鏡頭分割方法,有效增強了抗干擾和提高了鏡頭分割的準確率。

1 基于Harris的像素點評估

圖像中對象邊沿彎曲度最大的點或者圖像亮度變化劇烈的點(即特征點),對圖像的識別具有重要作用。由于Harris特征點對圖像旋轉、圖像亮度線性變換及噪聲具有不變的特性[4],所以,通過Harris算子對圖像中像素點進行評估,以便進一步確定特征點。

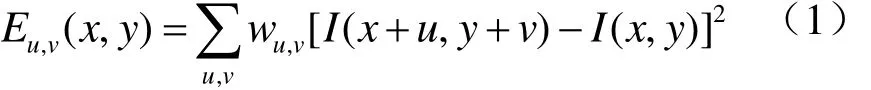

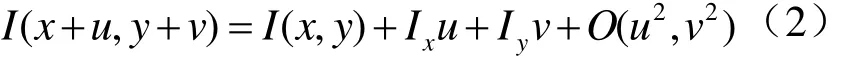

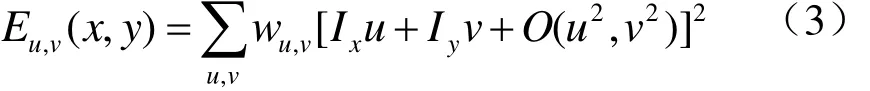

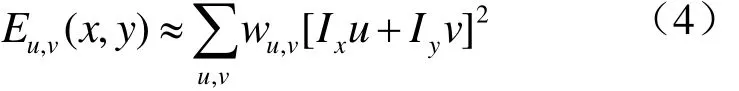

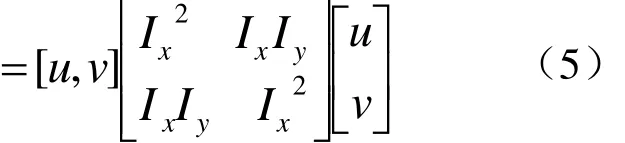

選取高斯窗為檢測窗口,計算窗口平均能量(即像素灰度值)變化。采用Harris算子進行像素點平均能量的評估。Harris算子的表達式:

其中,pix(x, y)為窗口中心坐標,u , v為偏移量,為高斯窗口函數,I (x , y)為像素點pix(x, y)的灰度,I(x+u, y +v)為像素點pix(x+u, y+v)的灰度。

由泰勒公式展開:

其中,Ix和Iy為灰度函數I對x和y的一階灰度偏導數。

由式(1)和式(2)可得:

對于局部微小的移動量[u , v],得到近似表達式:

而[Ixu+Iyv]2=Ixu +Iyv +2IxIyuv

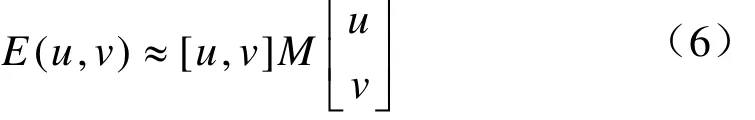

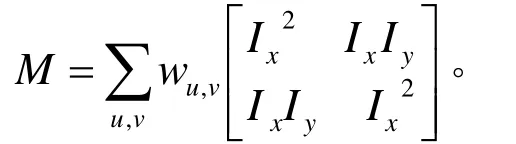

得到:

其中,

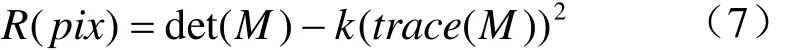

由M的特征值λ1和λ2定義特征點的響應函數為:

其中, det( M )=λ1λ2, trace (M )=λ1+λ2。

一般情況,k∈[0.04,0.06]。以R(pix) 為像素點pix(x, y)的評估灰度值,反映像素點成為特征點的可能性。

2 鏡頭分割方法

數字視頻中,時間連續、內容相似的圖像幀構成鏡頭,由一個或多個鏡頭構成一個完整的視頻。視頻文檔為有序圖像幀的集合 Video= {Framei|i=1, 2, …, n},其中n為視頻圖像幀的總數。

2.1 統計量計算

第i幀Framei可由灰度直方圖Hi標識,即Hi=<>為特征向量,其中hk為灰度值為k的特征點數(k=0, 1,…, 255),其特征點集大小mi。以下為有關圖像幀的統計量:

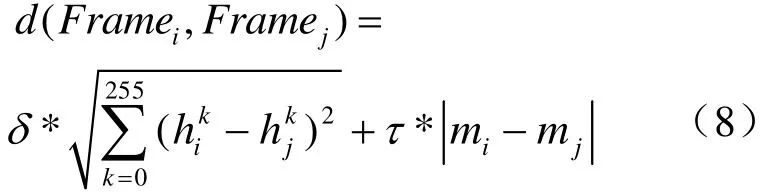

1) 幀間差

其中,δ 和τ 為比例系數。

2) 灰度直方圖平均變化率

其中,s為鏡頭的起始幀位置。

3) 特征點集規模平均變化率

其中,s為鏡頭的起始幀位置。

2.2 特征點集的提取

通過圖像分割策略,避免圖像不同而直方圖一樣的情況,又可避免特征點積聚[5],并以圖像幀中對象邊緣數作為確定特征點數量的重要參數,實現特征點的自動提取,具體算法如下:

1) 圖像分塊:設圖像Frame,圖像塊Blocki(i=1,2,…m, m 為圖像分塊數),且?i , j ,i ≠j ,Blocki∈, Blockj∈,

Frame.L/Blocki.li=Frame.W/Blocki.w(i即圖像和分塊成長寬都比例);

2) 對象邊緣數量確定:Canny[6]邊緣檢測確定Blocki的邊緣數

2.3 閃光檢測[7]

視頻中常有閃光出現。含有閃光的圖像幀其前后幀相差都不大。當圖像幀含有閃光時,特征點數趨近于零。對當前圖像幀Framei進行閃光檢測:

當|Framei|≈0,并且其他情況,FlashTest(Framei, l)=False。其中,s為當前鏡頭的起始位置,l=1,2,…, n-i。

FlashTest(Framei,l)為True(真)時,Framei到為含閃光的視頻幀。

2.4 鏡頭漸變檢測

淡入、淡出和溶解等鏡頭漸變都存在一個畫面中物體的輪廓和對比等變淡或消失的過程,該過程中所有幀的特征點數和特征點的灰度值變化緩慢。對當前幀 Framei進行鏡頭漸變檢測GradientTest(Framei):

當|mi-1-mi|≈0,并且時,GradientTest(Framei)=True;當其他情況時,GradientTest(Framei)=False。其中,n為直方圖維數。GradientTest(Framei)為 True(真)時,表明Framei處于當前鏡頭的漸變過程中。

2.5 鏡頭分割過程

根據提取的圖像幀特征點進行統計量計算,并對圖像幀進行閃光檢測和漸變檢測,濾除閃光幀和漸變幀,確定潛在的鏡頭突變位置,實現鏡頭分割,具體過程如下:

Divide(Video, δ, τ) //輸入視頻文檔和參數

{j=1; //第1個鏡頭

i=2; //第2幀

For each Framei∈Video //每一圖像幀

{if(FlashTes(tFramei,k)==True)i=i+k;//跳過閃光視頻

if (i>=n) { ShotEdge[j]=n; break;} //視頻結束

if(GradualTest(Framei) ==True)

//閾值計算

ShotEdge[j++]=i;//鏡頭結束幀位置

}

Return ShotEdge;//鏡頭所有分割位置

}

3 實驗結果分析

下面通過實驗及其對比,說明本文鏡頭分割方法的有效性。

3.1 實驗條件

實驗條件為Pentium Dual E2180 2.00GHZ的CPU、1.0Gbit RAM的微機,采用OpenCV實現鏡頭分割算法。試驗參數≤ 1.16,α =2.5,δ =4.1,τ =0.075,圖像分塊取2*2。

圖1 Harris特征點提取

圖2 本文特征點提取

3.2 特征點提取效果

在鏡頭分割中,對視頻每一幀都要進行特征點集的提取。如圖1采用Harris算法提取的特征點;圖2 采用本文的特征提取方法提取的特征點。從圖中可以看出,本文特征提取方法獲取較少特征點,并使特征點分布更加均勻。

3.3 鏡頭分割效果度量

鏡頭分割的效果度量標準有查全率和查準率:

1) 查全率=正確檢測數/(正確檢測數+漏檢數);

2) 查準率=正確檢測數/(正確檢測數+誤檢數)。

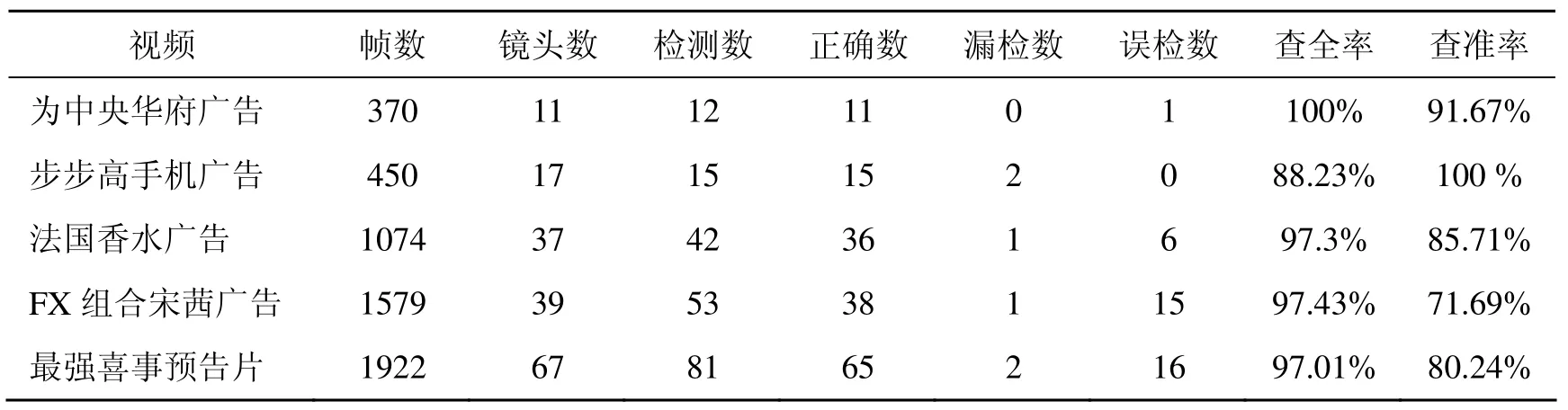

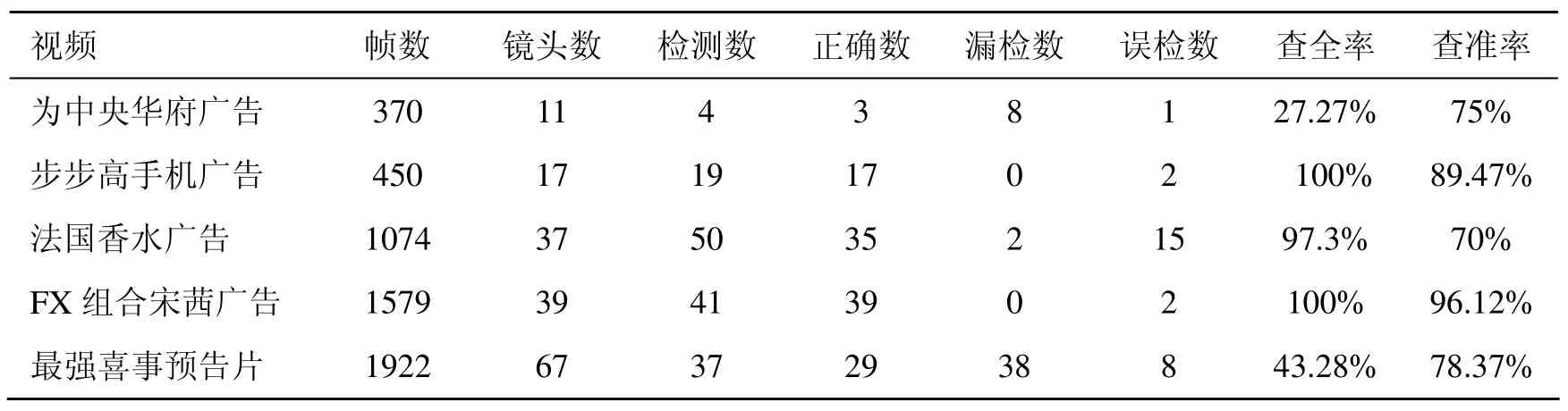

3.4 鏡頭分割效果對比

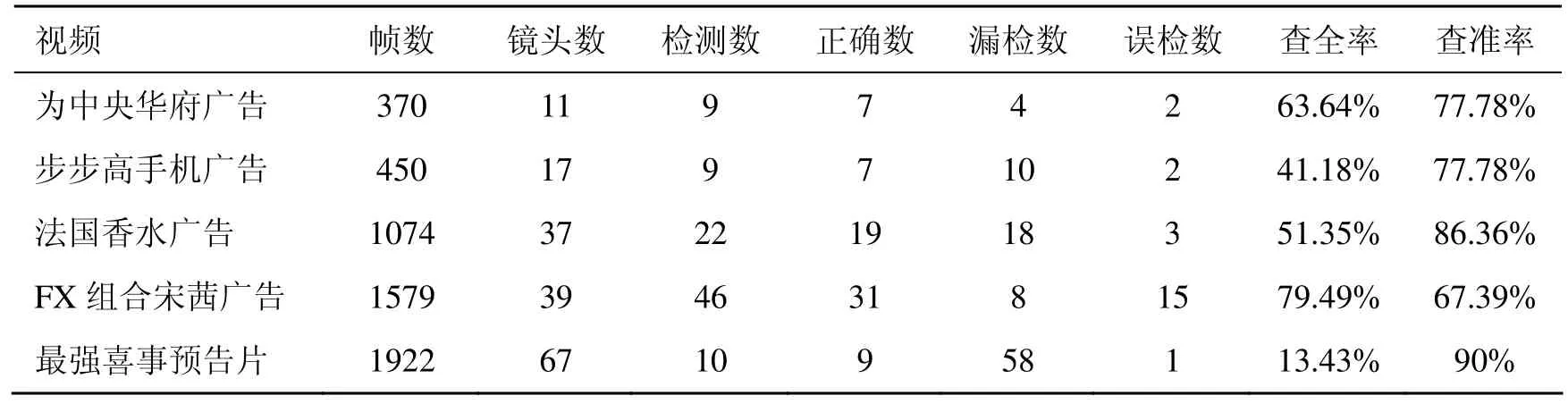

本文鏡頭分割的實驗數據均從優酷網上下載視頻文檔。本實驗視頻是隨機抽取各種視頻進行實驗。為了驗證本文算法的有效性,選用文獻[8]和文獻[9]作為實驗對比。本文實驗的結果如表1所示,文獻[8]的實驗結果如表2所示,文獻[9]的實驗結果如表3所示。

表1 基于自動確定特征點數的鏡頭分割

表2 規范化灰度分布幀差算法

表3 一種基于直方圖的切變鏡頭自動檢測算法

從表1、表2及表3中可以看出,本文的方法具有較好的查全率,對于不同類型的視頻有較好的穩定性。“法國香水廣告”中有一定數量的閃光燈,并有鏡頭移動的現象,使其檢測過程中有一些誤檢。“FX組合宋茜廣告”是一個黑白視頻,檢測過程中,特征點的變化較劇烈,對鏡頭檢測造成很大干擾。總體來說,本文鏡頭分割方法對網絡視頻可以進行有效的鏡頭分割。

4 結 論

為了提高視頻文檔進行鏡頭分割效果,通過Harris函數對像素點進行能量評估,有效利用其高斯特性,對像素點進行平滑降噪,從而確保特征點大多數分布在對象邊緣位置,并且過濾多數偽特征點。為了避免特征點選取在圖像幀中分布不均,進一步采用圖像分塊,使得提取的特征點分布更加均勻有效。通過邊沿檢測算法確定對象的邊緣數,決定所有圖像塊的特征點數,達到提取的特征點集最小化,并使得圖像幀特征點數及其各種統計量更加真實表示圖像幀,從而充分保留原始圖像內容信息。在鏡頭分割算法中,增加圖像幀漸變檢測和閃光燈檢測,提高鏡頭分割的效果。本文鏡頭分割算法只采用特征點及其統計信息,下一步研究多特征融合技術,以提高鏡頭的查準率和查全率。

[1] 劉政凱, 湯曉鷗. 視頻檢索中鏡頭分割方法綜述[J].計算機工程與應用, 2002, 38(23): 84-87.

[2] 孫利濤, 楊 雷. 視頻鏡頭分割技術綜述[J]. 山東輕工業學院學報, 2007, (3): 36-39.

[3] 劉 群, 江 偉, 吳 渝. 采用多特征融合的鏡頭邊界檢測方法[J]. 計算機工程與應用, 2010, 46(13): 171-174.

[4] 王旭光, 王志衡, 吳福朝. Harris相關與特征匹配[J].模式識別與人工智能, 2009, (4): 505-513.

[5] 卜慶凱, 胡愛群. 一種新的鏡頭邊界檢測和靜態視頻摘要提取方法[J]. 東南大學形學報, 2007, 37(4): 559-564.

[6] 段瑞玲, 李慶祥, 李玉和. 圖像邊緣檢測方法研究綜述[J]. 光學技術, 2005, 31(3): 415-419.

[7] 孫季豐, 李穎雄. 視頻鏡頭自動分割的若干方法[J].華南理工大學學報, 2003, 31(8): 10-14.

[8] 沈博超, 周 軍. 視頻突變檢測的規范化灰度分布幀差方法[J]. 計算機工程, 2009, 35(3): 242-244.

[9] 劉 典, 劉文萍. 一種基于直方圖的切變鏡頭自動檢測算法[J]. 北方工業大學學報, 2007, 19(3): 16-20.

Approach to Shot Segmentation Based on Automatic Decision of Feature-Point Number

Li Guohe, Liu Dianxing, Zang Jinxiao, Wu Weijiang

( 1. College of Geophysics and Information Engineering, China University of Petroleum, Beijing 102249, China; 2. Beijing Key Lab of Data Mining for Petroleum Data, China University of Petroleum, Beijing 102249, China; 3. PanPass Institute of Digital Identification Management and Internet of Things, Beijing 100029, China )

Shot segmentation is very important for video retrieval based on image content. In order to improve the performance of shot segmentation, Harris operator is adopted to evaluate the energy of image pix, and exclude pseudo feature points. By means of partition of frame in the video into blocks and edge detection of the blocks, the minimal feature-point set is obtained and the feature points are made relatively well-distributed. And then according to the feature points, statistical quantity of frame in video is computed to construct feature vector to express the frame. Based on above, along with gradual transition detection and flash detection of frame, a method of shot segmentation is presented. Experiments of shot segmentation are efficient.

Harris operator; feature extraction; flash detection; gradual transition detection; shot segmentation

TP 391.41

A

2095-302X (2013)03-0095-05

2012-09-02;定稿日期:2012-10-28

國家高新技術研究發展計劃資助項目(2009AA062802);國家自然科學基金資助項目(60473125);中國石油(CNPC)石油科技中青年創新基金資助項目(05E7013);國家重大專項子課題資助項目(G5800-08-ZS-WX)

李國和(1965-),男,福建平和人,教授,博士,博士生導師,主要研究方向為人工智能,知識發現,數據可視化。E-mail:ligh@cup.edu.cn

劉佃興(1985-),男,河南濮陽人,碩士研究生,主要研究方向為知識發現。E-mail:rtying@163.com臧金曉(1986-),男,山東泰安人,碩士研究生,主要研究方向為知識發現。E-mail:zangjinxiao@126.com吳衛江(1971-),男,河北唐山人,副教授,博士生,主要研究領域為人工智能,知識發現。E-mail:allan1226@163.com