一種適合于監控視頻內容檢索的關鍵幀提取新方法

周 兵,郝偉偉,袁社鋒

(1.鄭州大學 信息工程學院,河南 鄭州450001;2.河南農業職業學院 電子信息工程系,河南 鄭州451450)

0 引言

監控產生的視頻具有數據量大而有用信息少的特點,因此如何在海量的監控視頻信息中快速有效地存儲和瀏覽信息,對現今監控視頻的進一步分析處理有著重要的意義. 而關鍵幀技術的提出,為其提供了良好的方法.

關鍵幀被定義為一個有限的視頻幀子集,其代表了視頻序列的主要內容.早幾年,針對不同的應用目的,關鍵幀提取已有了一定的研究. Mona Omidyeganeh 等人[1]使用廣義高斯密度特征向量之間的相對熵(KLD)進行鏡頭聚類邊界的選取,進而基于相似性和相異性標準提取關鍵幀. Jiang Peng 等人[2]介紹了一種基于視覺注意模型的視覺注意度(AVI)描述來提取關鍵幀.Liu Gentao 等人[3]提出了鏡頭邊界檢測與在鏡頭內提取關鍵幀的統一架構. Gwo-Cheng Chao 等人[4]提出“增強三維關鍵幀”來濃縮監控視頻片斷有意義的內容信息,但算法實現復雜、計算量大.以上文獻都是針對視頻中所有幀序列進行計算來提取關鍵幀,現實監控視頻中多數含有大量的純背景幀,而僅包含運動目標的視頻片斷才是人們想要查看的關鍵序列.

根據以往方法的總結以及自己工作的實驗結果,本文結合具體應用,針對視頻監控提出一種基于運動目標檢測的關鍵幀提取方法.首先,設計一種穩健而且快速的背景差分算法檢測監控視頻中的運動物體,記錄進入和離開視頻畫面的起始幀和結束幀;然后,基于聯合直方圖的對稱性來判定圖像的相似程度,對含有運動對象的關鍵視頻段進行初步的關鍵幀提取;最后,為防止數據的冗余,對關鍵幀集合基于圖像的信息熵進一步進行提煉.

1 關鍵幀提取方法

1.1 運動目標檢測

運動目標的檢測過程,實際是對運動目標在視頻序列中定位以及跟蹤的過程. 目前運動目標的檢測主要有光流法、幀間差分法和背景差分法[5-7].其中背景差分法又被稱為背景減,通過背景模型檢測當前幀與背景差異來檢測運動目標,該方法在速度和穩健性上都較有優勢. 經典的高斯混合背景模型[8],當背景更新時需要排序運算,計算量很大,不利于高清視頻處理.本文簡化高斯混合背景模型,背景模型數固定為兩個,在變化像素檢測時增加鄰域像素模型符合性檢測,兼顧速度和穩健性兩個方面.

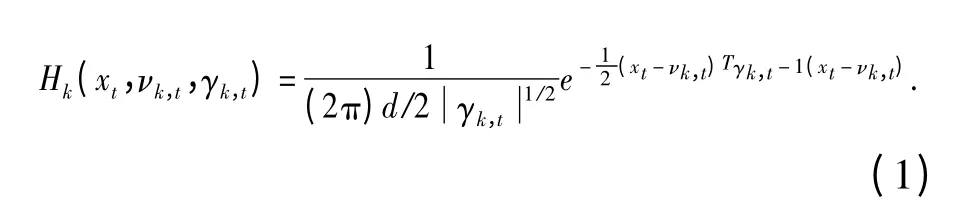

若某一象素當前強度值為xt,則該象素屬于兩個背景模型的概率計算公式如下式:

式中:k∈(1,2)分別表示兩個高斯模型公式;H服從d 維高斯分布;T 表示確定高斯分量個數的閾值;γk,t和νk,t分別是在t 時刻高斯模型的協方差和均值.

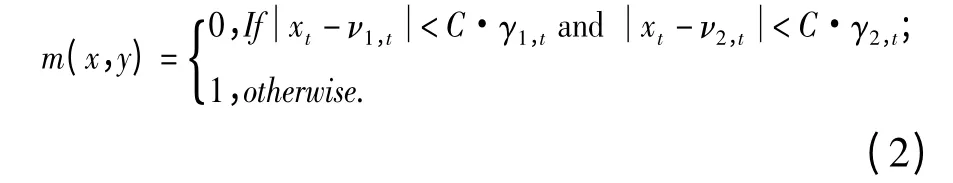

使用背景差分法將每幀像素強度值與其對應的背景像素強度值做差處理,其處理結果大于設定閾值的像素即判定為變化像素,模型mk(k∈(1,2))中當前像素是否是變化像素的計算公式如下:

其中,C∈[2.5,3]為系數常量.

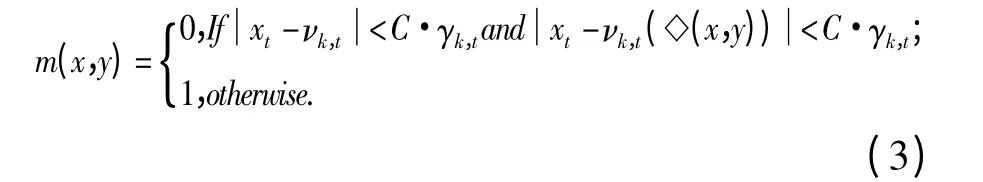

為了消除背景中雜亂的虛假變化像素,在判定當前像素是否為變化像素時,除了檢查背景中像素(x,y)之外,還同時檢查其鄰域象素,即使用背景差分法將每幀像素強度值與其對應的背景像素強度值和相鄰的背景像素強度值分別做差處理,只有當前像素與背景中的這些像素差值結果均大于閾值時,才認為是運動象素.

使用◇(x,y)表示點(x,y)的鄰域像素坐標,則變化像素檢測公式修改為:

另外,因背景變化產生的前景大多數表現為小尺寸的象素塊,本文通過尺寸濾波加以消除,以降低監控系統背景的錯誤.

1.2 關鍵幀提取

根據背景差分法確定含有運動物體視頻片段的定位信息,即起始幀及結束幀,在該關鍵視頻段內進行關鍵幀提取. 筆者基于聯合直方圖的關鍵幀提取方法,使用其對稱性來判定圖像的相似程度.

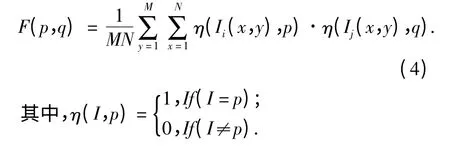

聯合直方圖表示兩幅大小相同的圖像Ii和Ij間其對應位置上像素對的灰度組合出現的頻率.對于同為M×N 的圖像Ii(x,y)、Ij(x,y),對應的像素值對(p,q)的聯合概率表示為:

根據上式可知,對所有可能的像素值對(p,q)求F(p,q)值,可得到圖像Ii(x,y)和Ij(x,y)的聯合直方圖.聯合直方圖對稱性定義為

式中:α 是聯合直方圖對角線上的權值,在此為小于1 的正常量;而β=(p-q)n則表示遠離對角線元素的權重;公式中n 為整數;ε 更直觀地表示出了兩幀之間的相似性,當ε 越趨近于1,則表示聯合直方圖越對稱,即說明兩圖像相似越大.當目標快速出現、亮度等視頻內容發生較為明顯變化時,幀間相似性也發生相應變化,一般相鄰幀間的相似性ε∈(0,1]. 為避免關鍵幀的遺漏,文中設閾值T' =0.9.

根據監控視頻連續的特性,在一段連續變化的視頻序列中,連續的前后視頻幀存在的特征值是漸變的,即相鄰幀的圖像信息值變化不大.圖像的熵信息體現了圖像包含的信息量,而關鍵幀則是一段視頻主要內容的代表,因此關鍵幀所含的信息量也相對較大.為減少數據的冗余,本文提出在間隔較近的視頻序列中選取圖像的信息熵值最大的一幀作為關鍵幀.圖像信息嫡的計算公式為

式中:N 指圖像的灰度級數;xi表示像素(x,y)的灰度值;p(xi)為各灰度級出現的概率. 為防止提取的關鍵幀中由于光照變化等原因造成關鍵幀存在冗余,筆者在相鄰較近的候選幀中選取信息熵最大的一幀作為關鍵幀.實驗表明,在一段連續的監控視頻段中,相鄰幀間的差異較小,幀間熵差很難區分出來,而間隔20 幀的非相鄰幀間熵差則可明顯地區分出來.因此,文中關鍵候選幀序列間隔小于20 時,選取信息熵最大的一幀作為關鍵幀.這樣得到的關鍵幀即可有效地反映連續視頻序列的主要內容,又減少了數據的冗余.

關鍵幀的提取具體步驟如下:

(1)對視頻I,基于背景差分法監測視頻中含有運動物體的關鍵視頻段,記錄關鍵視頻段的起始幀I1與結束幀In;

(2)解析視頻得到關鍵視頻序列(I1,I2,I3,…,I(n-1),In),I1作為當前關鍵幀Knew,即Knew=I1,加入到關鍵幀的集合K 中,i=1;

(3)i=i+1,計算Ii與Knew間的相似性ε,若大于閾值T'(T' =0.9),則Ii為新的關鍵幀,將該關鍵幀記錄進關鍵幀集合K 中,并標記為當前關鍵幀,即Knew=Ii,否則不處理;

(4)檢測是否是幀序列最后一幀,若是則轉(5),否則轉(3)繼續處理;

(5)檢測初步提取的關鍵幀集合K,若相鄰關鍵幀之間Ii、Ij,<20,則選取信息熵最大的值作為關鍵幀;

(6)檢測是否是集合K 中最后一幀,若不是,則轉(5),否則結束.

2 實驗結果

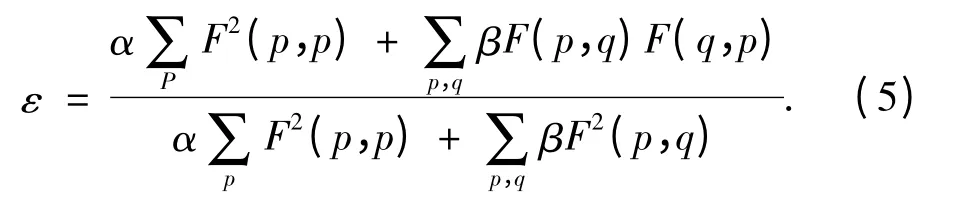

本實驗使用一個普通像素的攝像頭檢測室外一小時中含有運動目標的關鍵視頻段. 每個關鍵視頻段可提取若干個關鍵幀,實驗結果中只顯示各個關鍵視頻段中中間一幀,結果如圖1 所示.

圖1 各個關鍵視頻段中代表性關鍵幀Fig.1 Representative key frame of each key video segment

例如第一個關鍵視頻段有進入視頻畫面和離開畫面組成,該視頻段共180 幀,程序解析該過程的部分連續視頻幀序列如圖2 所示.

圖2 第一個關鍵視頻段中的部分幀序列Fig.2 Part of the frame sequence of the first key video segment

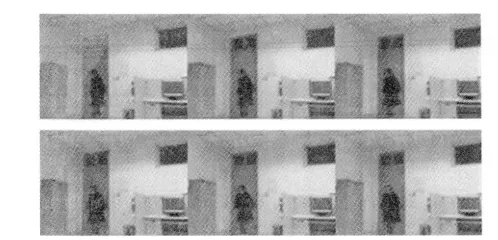

該關鍵視頻段通過關鍵幀的提取,可得關鍵幀序列如下:在系統用戶查看的頁面中顯示關鍵幀集合中的中間一幀,既第二關鍵幀. 如圖3 所示.監控得到的視頻信息為:幀寬640、幀高480、數據速率為302 kbps,總比特率為350 kbps,幀速率為30 幀/s.1 h 錄像大小為150 MB,經過視頻數據的處理,提取含有運動目標的關鍵視頻段,對相應視頻進行關鍵幀提取. 第一個視頻段提取關鍵幀數據存儲大小為80 kB,該1 h 錄像提取關鍵幀后,共保存數據大小為756 kB,其數據的存儲量,遠小于原監控視頻的數據量,且涵蓋了主要的有效信息,便于用戶迅速查看.

圖3 第一個關鍵視頻段的關鍵幀Fig.3 The key frames of the first key video segment

3 結論

提出一種在監控視頻中提取關鍵幀的方法,該方法提取的關鍵幀很少存在冗余數據,大大減少了視頻數據的存儲量,且系統顯示出每段關鍵視頻段的主要內容,便于用戶瀏覽關鍵信息.上述提取的關鍵幀可能不是人的正面圖像,而人的正面信息才更有效直觀的顯示運動目標,因此下一步將引入人臉檢測算法,解決這一問題.

[1] OMIDYEGANEH M,GHAEMMAGHAMI S,SHIRMOHAMMADI S. Video keyframe analysis using a segment-based statistical metric in a visually sensitive parametric space[J]. IEEE Transactions on Image Processing,2011,20(10):2730 -2737.

[2] JIANG Peng,QIN Xiao-lin.Keyframe-based video summary using visual attention clues[J].IEEE MultiMedia,2010,17(2):64 -73.

[3] LIU Gen-tao,WEN Xiang-ming,ZHENG Wei,et al.Shot boundary detection and keyframe extraction based on scale invariant feature transform[C]//2009 Eighth IEEE/ACIS International Conference on Computer and Information Science,Shanghai:IEEE Computer Society2009:1126 -1130.

[4] CHAO G C,TSAI Y P,JENG S K. Augmented 3 -D Keyframe extraction for surveillance videos[J]. IEEE Transactions on Circuits and Systems for Video Technology,2010,20(11):1395 -1408.

[5] 譚鑫,肖南峰. 運動人體的檢測跟蹤方法的研究與實現[J].計算機應用與軟件,2010,27(4):30 -31.

[6] BARNICH O,VAN DROOGENBROECK M. ViBe:A Universal background subtraction algorithm for video sequences[J]. IEEE Transactions on Image Processing,2011,20(6):1709 -1724.

[7] 李毅,孫正興,遠博,等.一種改進的幀差和背景減相結合的運動檢測方法[J]. 中國圖象圖形學報,2009,14(6):1163 -1168.

[8] LI Ying-hong,TIAN Hong-fang,ZHANG Yan. An improved Gaussian mixture background model with realtime adjustment of learning rate[C]//2010 International Conference on Information Networking and Automation (ICINA),Kunming:IEEE 10. 1109/ICINA.2010.5636758,2010(1):512 -515.