采用深度圖像信息和SLVW的手語識別

楊全,彭進業

西北大學信息科學與技術學院,西安 710127

采用深度圖像信息和SLVW的手語識別

楊全,彭進業

西北大學信息科學與技術學院,西安 710127

1 引言

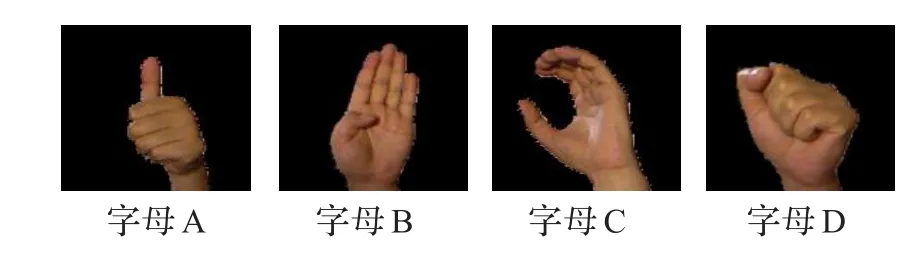

聾人使用的手語,是一種進行信息交流、傳遞思想的自然方法,在聾校教學和聾人交流方面起著非常重要的作用。手語是由手的形狀、手腕和手臂的運動,與之對應的人臉表情、嘴唇讀音形狀,以及其他身體姿態相結合的人體語言。中國手語包括手指語和手勢語兩類:手指語由30個手指字母構成基本單位,是用手指的變化和動作代表一個漢語拼音字母,并按照漢語拼音規則和順序依次拼出詞語構成的語言;手勢語是通過指示性的形象手指姿態模擬事物形狀和動作的自然手勢。由于漢字本身包含的字詞較多,所以使用手勢很難全面準確地將其表述完整。而手指語與拼音的拼寫方式一致,可以表達很多專業術語以及抽象概念,具有簡明易學、手勢較少的特點。因此,手語字母的識別是手語識別中非常重要的一部分。根據教育部及中國文字改革委員會等單位公布的現行中國手語實施方案,中國手語中包括30個手語字母:26個單字母(A~Z)和4個雙字母(ZH、CH、SH、NG),如圖1所示。

手語識別研究包括兩類:(1)基于計算機視覺的手語識別[1];(2)基于佩戴式設備的手語識別。由于佩戴式位置跟蹤器與數據手套的價格較高,并且穿戴方式復雜,所以很難推廣到實際應用中。隨著視頻采集設備的普及和應用,基于計算機視覺的手語識別以其自然便捷的交互方式受到越來越多的關注,尤其是在硬件成本方面,該方式所需設備成本很低,因此非常適于普及應用,是目前手語識別的研究重點[2-3]。

哈爾濱工業大學的楊筱林、姚鴻勛利用圓形的軸對稱和中心對稱的幾何特點,采用基于多尺度形狀描述子的方法對靜態中國手指語字母進行識別,識別率為94.6%[4];中國科學院計算技術研究所的張國良等人,采用CHMM對439個孤立手語詞的平均識別率為92.5%[5];哈爾濱工業大學的姜峰等人采用合成數據驅動算法對離線中國手語詞進行識別,平均識別率為71.6%[6];Deng[7]等人借助顏色手套簡化手勢分割,運用并行HMM識別192個美國手語詞的識別率為93.3%。使用Harr特征并以AdaBoost作為識別分類器,文獻[8]進行了24個英文手語的識別研究;Silanon等人提出了根據手勢運動分析識別泰文字母的方法[9];Ong等人采用基于Sequential Pattern Trees的多級分類器方法對大詞匯量單手語者手勢序列和多手語者Kinect數據集進行識別[10]。

圖1 手語字母表

本文采用Kinect作為手語視頻采集設備,在獲取彩色手語視頻的同時得到相應的手語深度圖像信息,在此基礎上對傳統的CamShift算法和Ostu算法進行了改進。通過提取手語手勢的SLVW特征,構建其詞包模型對手語字母進行識別,并通過實驗驗證了算法的準確性。

2 SLVW特征表示

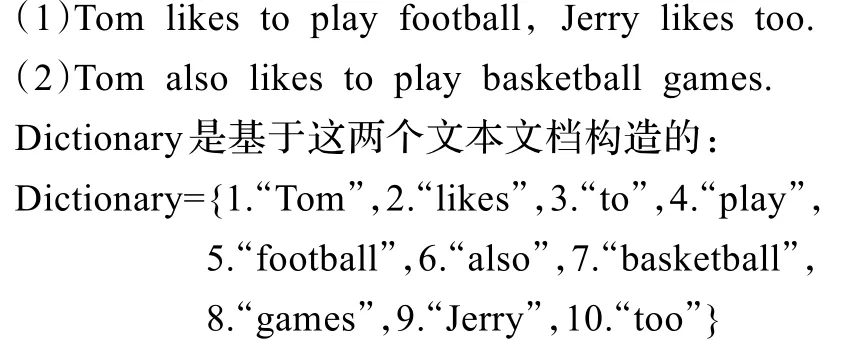

BoW(Bag of Words)模型是信息檢索領域常用的文檔表示方法。在信息檢索的時候,對于任何一個文檔,BoW模型都采取忽略它的單詞前后順序、語法和上下文等要素的方法,只是將其看做詞匯的集合,文檔中所有單詞都被看做是獨立而不依賴于其他任何單詞的。也就是說,文檔中任意一個位置出現的任何單詞,都不受該文檔語義的影響,是隨機的。

以如下兩個文檔進行說明:

Dictionary一共包含10個不同的單詞,給每個單詞加索引號,以上兩個文檔分別用一個10維向量表示(某個單詞在文檔中出現的次數用整數數字0~n表示)。

向量中每個元素表示詞典中相關元素在文檔中出現的次數,且未表達單詞在原來句子中出現的次序。由此可知,如果存在一個巨大的文檔集合D,其中一共存儲M個文檔,提取出文檔里面的所有單詞,然后由這N個單詞構成詞典。假設用BoW模型描述文檔,則每個文檔都可以用一個N維向量來表示。

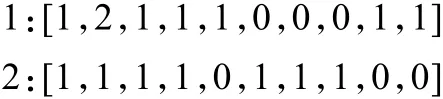

將BoW模型應用于手語識別,為了表征一幅手語圖像,可以將該圖像看做是一個文檔,是若干個手語視覺詞匯的集合,且不同視覺詞之間不存在次序關系。由于手語圖像中的手語視覺詞匯不像文本文檔那樣直接顯式存在,所以需要從圖像中提取出相互獨立的手語視覺詞,對手語圖像構造視覺詞包。該過程主要有4個步驟,如圖2所示。

圖2 構造詞包模型的4個步驟

(1)特征檢測:通過手語圖像分割的方式獲取手語手勢的興趣點;

(2)特征表示:采用圖像的局部特征描述子來表示圖像內容;

(3)生成視覺單詞:把局部特征描述子表示的圖像小區域量化生成手語視覺單詞(SLVW);

(4)生成BoW:統計一幅手語圖像中的視覺單詞頻率,生成視覺單詞頻率直方圖,用BoW模型來表示手語圖像。

生成SLVW詞包后,通過使用K-means聚類算法,訓練圖像集上的所有特征,每一個聚類中心被定義為一個視覺單詞,從而生成由N個視覺單詞所組成的視覺單詞詞匯表。計算訓練圖像中圖像塊的特征與詞匯表中的每個視覺單詞所對應的歐式距離,與其中某個視覺單詞距離最近的則被記錄下來,不斷重復以上過程,最終形成一組視覺單詞頻率統計直方圖,生成視覺單詞詞包,用這組統計直方圖代表該幅圖像的特征[11-12]。SLVW特征表示方式能夠很好地解決圖像局部特征點個數不同的問題,具有簡單和只需要少量監督的優勢。這種圖像表示模型將二維的圖像信息映射成視覺關鍵詞集合,既保存了圖像的局部特征又有效地壓縮了圖像的描述,使得自然語言處理的各種技術和方法能十分有效地應用于物體識別領域[13]。

本文首先提取手語圖像的SIFT特征作為圖像中的手語視覺詞匯,將所有的視覺詞匯集合在一起,則每幅手語圖像都由一個128維的特征向量集合描述。然后采用K-means聚類算法構造手語視覺詞匯表。SIFT提取的視覺詞匯向量之間根據距離的遠近,利用K-means算法將詞義相近的詞匯合并,得到K個聚類中心作為視覺單詞,即單詞表中的基礎詞匯,再由視覺單詞構成視覺詞匯表;進而利用手語單詞表中的詞匯表示手語圖像。利用SIFT算法,可以從每幅圖像中提取128個特征點,這些特征點都可以用單詞表中的單詞近似代替,通過統計單詞表中每個單詞在圖像中出現的次數,可以將圖像表示成為一個K維數值向量。

參考文檔分類的啟發,對每幅手語圖像中的每個向量計算N個最近鄰視覺單詞,然后度量第k個SLVW的質量:

其中,Mi表示與視覺單詞tk第i接近的特征向量數,s(fj,tk)表示特征向量fj與視覺單詞tk之間的相似度,本文采用歐式距離平方進行度量。對每個視覺單詞計算其質量,如果滿足

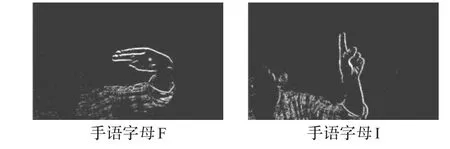

則保留,否則舍去。式(2)中,h為視覺單詞的質量閾值。手語字母的SIFT特征及SIFT詞包特征如圖3所示。

圖3 手語字母的SIFT與SIFT詞包特征

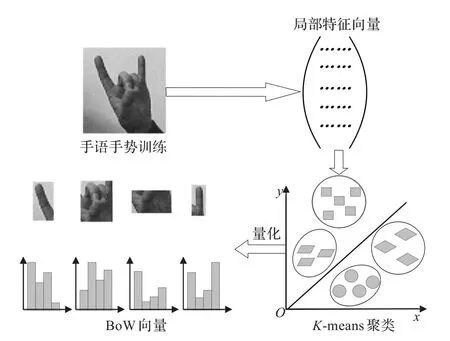

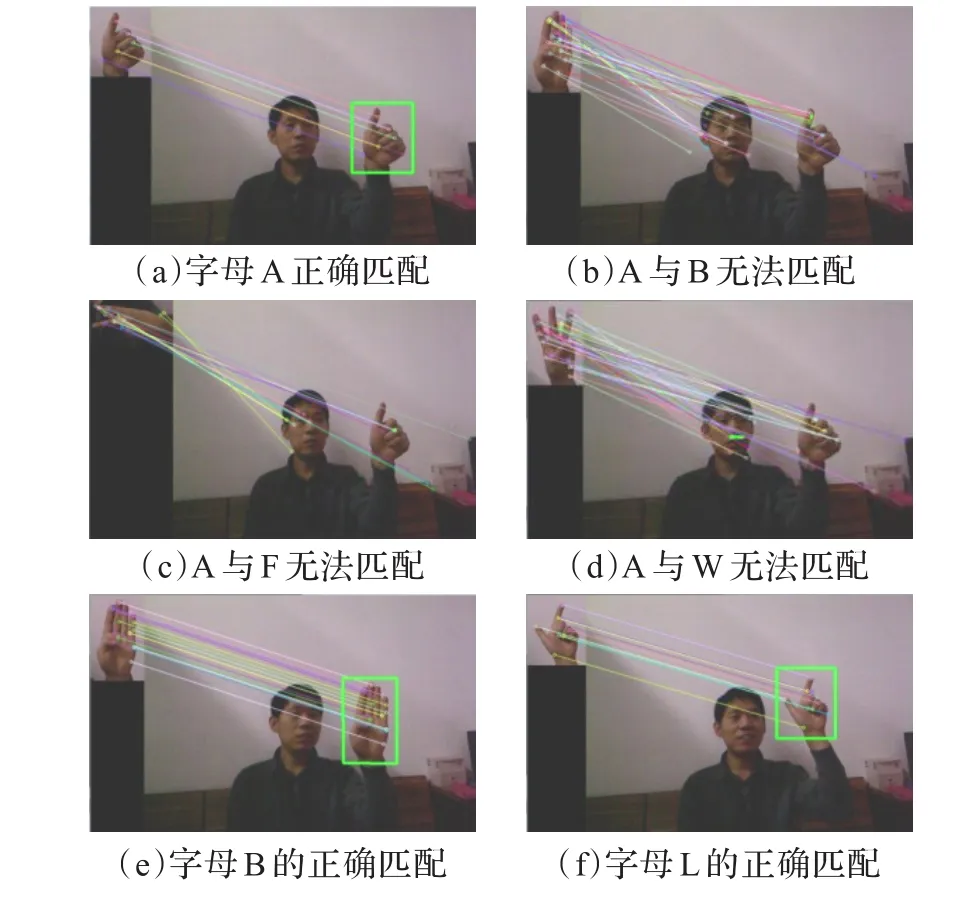

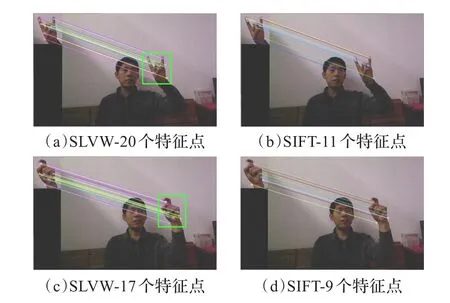

圖4為基于SIFT詞包的手語字母匹配實驗,采用Squared Euclidean Distance進行計算。圖4(a)為生成手語字母A的SLVW詞包(基于SIFT的手語詞包特征,簡稱為SLVW特征)后,從手語庫中隨機選取的靜態手語字母A的圖像與手語視頻幀中的字母A手勢的匹配成功,識別出了該視頻中的手勢為手語字母A。圖4(b)、(c)、(d)為當視頻中出現的手勢是字母A時,依次選取靜態手語字母B、F、W的SLVW詞包與之匹配失敗。圖4(e)、(f)依次為手語字母B、L的正確匹配與識別。

SLVW與SIFT特征點提取匹配實驗比較如圖5所示。其中,圖5(a)為手語視頻中出現字母T時生成其SLVW特征并與手語庫中字母T手勢的特征匹配,共有20個特征點能夠對應。圖5(b)為相同幀提取SIFT特征的匹配,僅有11個特征點能夠對應。圖5(c)為手語字母J的SLVW特征提取匹配,共有17個對應的特征點。圖5(d)為相同幀情況下SIFT只有9個對應特征的匹配。

圖4 基于SLVW詞包的手語匹配

圖5 SLVW與SIFT特征點匹配比較

圖6為相似手語手勢的兩種特征匹配識別比較。手語字母M與N的手勢非常相似,圖6(a)為提取字母M的SLVW特征,可在視頻幀與手語庫手勢匹配時計算得到4個對應的特征點。圖6(b)為提取相同視頻幀的SIFT特征,僅有1個特征點對應,不能達到匹配識別要求。圖6(c)為視頻中的手勢是M時,計算手語庫中字母N的SLVW詞包與之匹配失敗,字母N手部的特征點部分匹配在打手語者的眼部和頸部。圖6(d)為與(c)相同的視頻幀,字母M與N的SIFT特征匹配誤識別,共有4個特征點匹配且都對應在手部,無法區分其為兩個不同的字母手勢。圖6(e)、(f)分別為字母V的SLVW和SIFT特征提取匹配,相同情況下SLVW比SIFT特征多識別出了5個相匹配的特征點。圖6(g)為選取手語庫中W手勢與V匹配時,W的SLVW特征點對應到了打手語者的臉上,匹配失敗。圖6(h)是提取SIFT特征計算,W和V僅有1個特征點相對應,無法達到判斷其異同的要求。

通過實驗結果比對分析,可以發現SLVW詞包是一種非常有效的手語特征。

圖6 SLVW與SIFT特征匹配識別比較

3 基于SLVW的手語識別

手語識別過程需經過以下5個階段:手語手勢檢測、跟蹤;手勢分割提取;SLVW構建;SVM訓練學習;使用SVM識別手語。

3.1 基于DI_CamShift的手勢跟蹤

幀差法就是背景減圖法中的一種,因為其背景模型就是上一幀的圖,所以使用幀差法進行運動手勢檢測不需要建模,速度較快。由于手語視頻所處場景光照情況比較穩定,所以本文選用對緩慢變換光照不敏感的幀差法進行手語手勢檢測可以獲得較好的效果,如圖7所示。

圖7 手勢檢測

由于傳統CamShift算法在彩色空間轉換和運動手勢跟蹤方面存在不足,所以本文使用圖像的深度信息改進Cam-Shift算法,即Depth Image CamShift(DI_CamShift)算法。

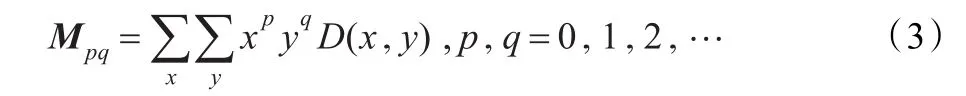

對于深度圖像D(x,y),它的(p+q)階二維原點矩Mpq的定義為:

其中,D(x,y)為深度圖像中(x,y)位置處像素的深度值。

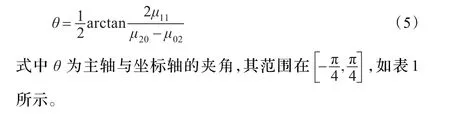

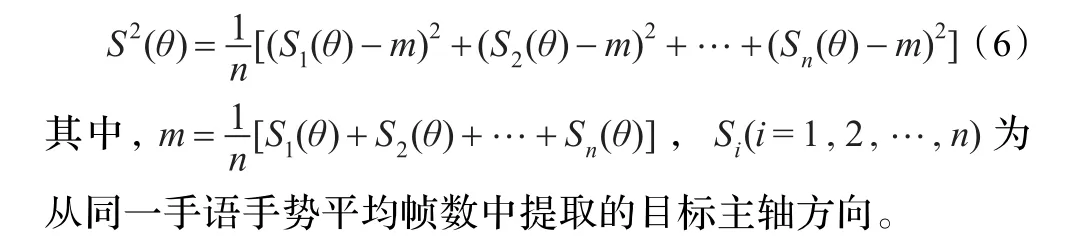

定義D(x,y)的(p+q)階中心矩μpq為:則其二階中心矩可以作為手語圖像中手勢的主軸。最大二階矩和最小二階矩的方向可用來確定手語手勢的主軸,即長軸和短軸。手勢主軸方向角θ可根據矩理論按下述公式求取:

表1 手勢主軸與坐標軸的夾角

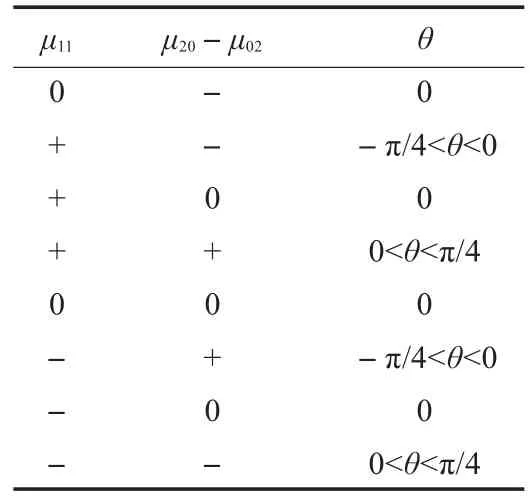

令手語手勢S的主軸方向為θ,則

DI_CamShift算法具體步驟為:

(1)將整個深度圖像設為搜索區域。

(2)采用幀差法檢測視頻中的運動人手區域,對Search Window進行初始化,定位其尺寸和位置。

(3)對Search Window區域內的部分,計算其深度直方圖的概率分布。

(4)分別計算深度圖像中手勢的長軸和短軸的方向θ1、θ2。

(5)使用MeanShift算法計算窗口內深度手勢圖像的質心位置,根據質心位置和主軸方向θ1、θ2調整Search Window的尺寸。

(6)對于下一幀手語視頻圖像,用步驟(5)的Search Window的質心和尺寸,跳轉至(3)繼續運行。

(7)如果檢測到多個運動目標,則真實手勢為HandGesture= min{M00(Obj1),M00(Obj2),…,M00(Objn)}。因為距離攝像機遠的物體具有較大的深度值,而手語識別中認為待識別手語手勢是在打手語者身體之前,距離Kinect攝像機最近的目標物體,所以選取具有最小0階矩值的Search Window,該窗口內的手勢像素具有最小的深度信息值的和,可確定為最前景目標手勢區域。

如圖8(a)所示,視頻中出現了一本黃色封面的書,由于黃色較接近手語手勢的膚色,所以在人手靠近黃色封皮的書時,CamShift將跟蹤窗口轉移到了書的區域,將書誤判為運動跟蹤目標。并且,在人手運動遠離書時,跟蹤窗口始終停留在原處,未能對運動著的手部區域進行正確跟蹤(彩色圖像為手語視頻中由Kinect彩色攝像頭獲取的彩色視頻幀,下方對應的是Kinect深度攝像頭同步拍攝獲取的深度視頻幀)。圖8(b)為相同場景情況下,DI_CamShift對運動手勢的正確跟蹤。雖然受光線和拍攝角度影響,書皮的顏色在彩色視頻幀中有時表現為深黃色,有時表現為淺黃色,但是在人手靠近、遠離書的運動過程中,DI_CamShift始終將跟蹤窗口定位于運動的人手區域,實現了準確的運動手勢跟蹤。

圖8 類膚色物體干擾信息下DI_CamShift與CamShift手勢跟蹤比較

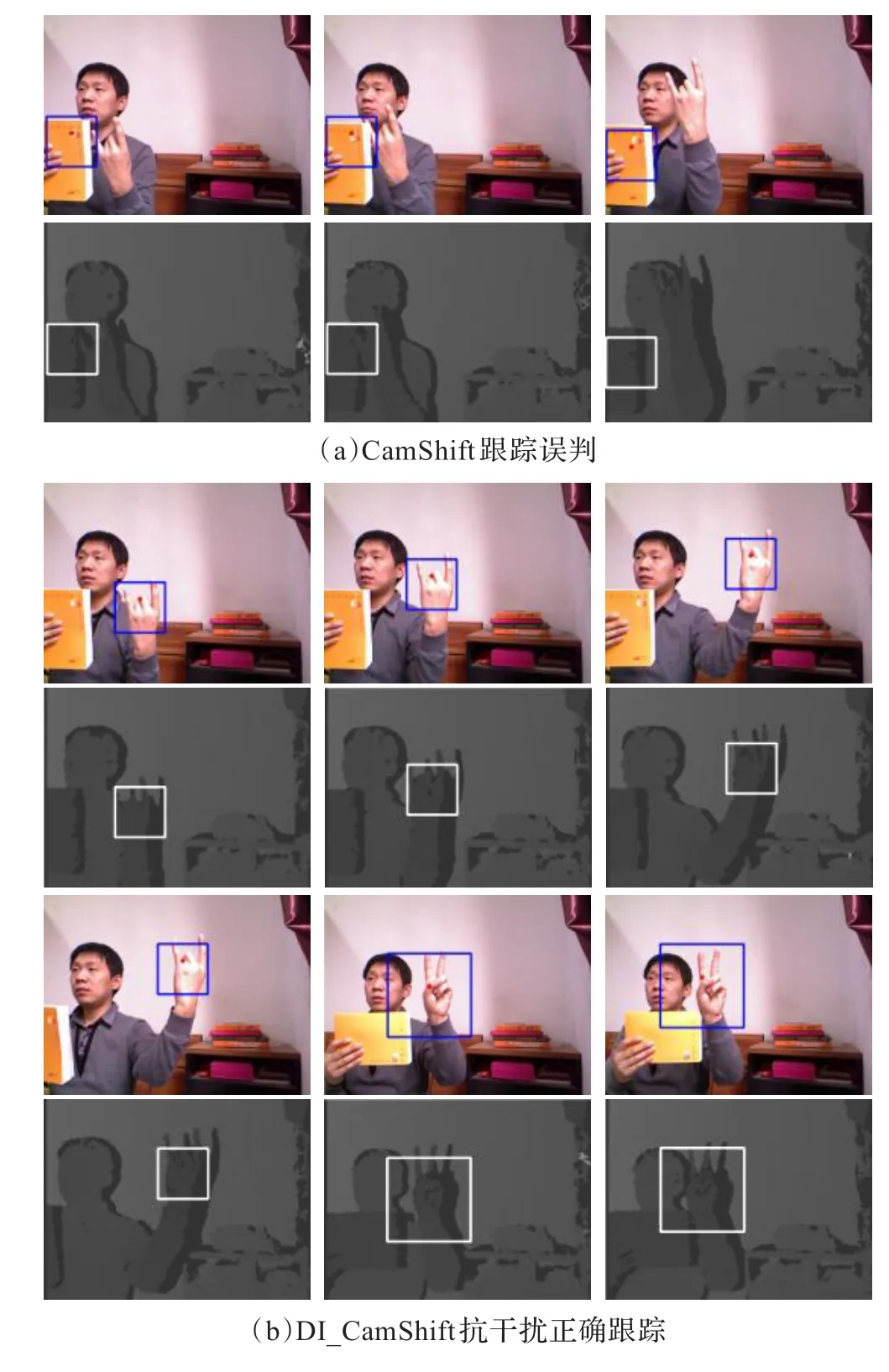

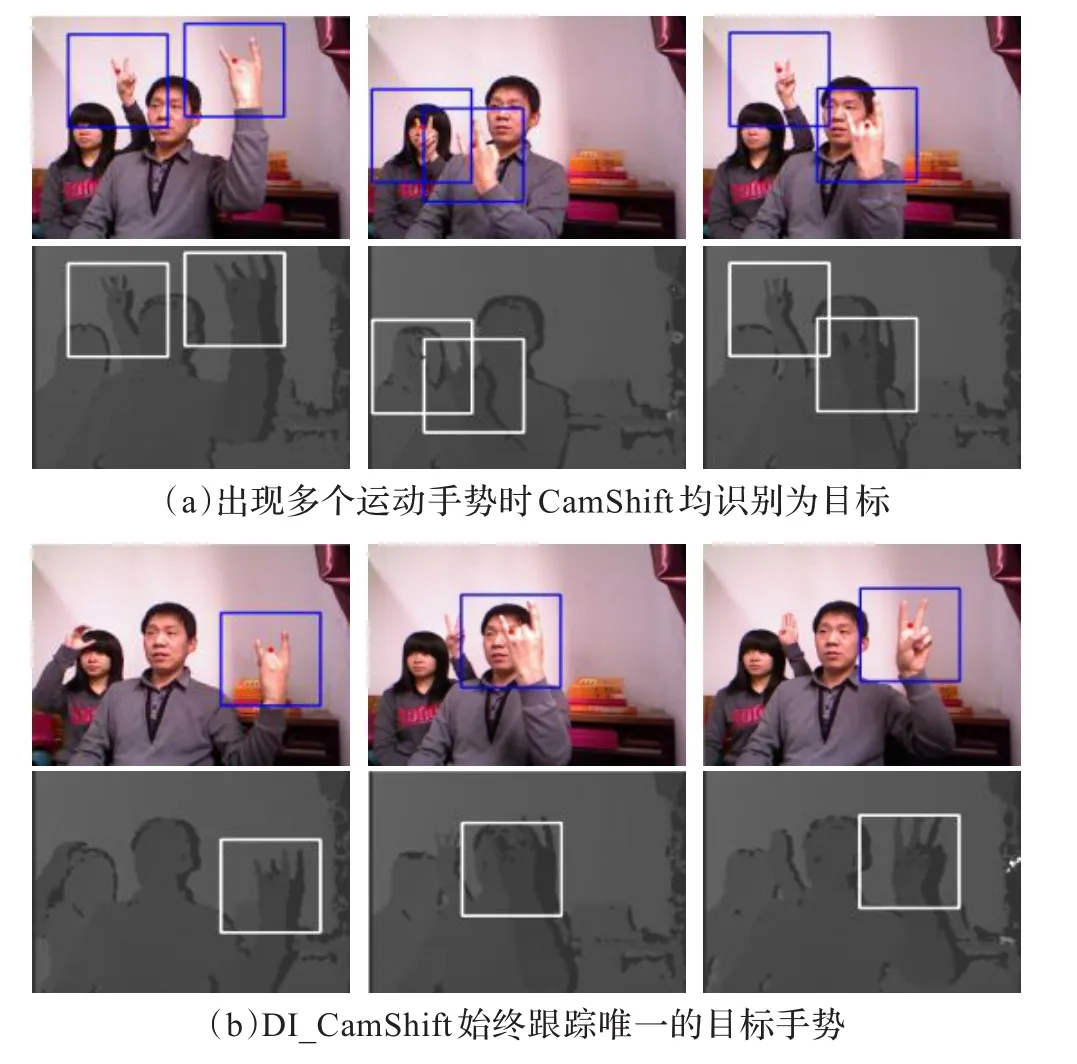

在進行手語手勢跟蹤時,認為手語手勢位于人體的最前方,即當視頻中出現多個運動著的人手的時候,只有處于人的身體前端且距離攝像機最近的人手為跟蹤目標。圖9(a)為視頻中同時出現兩個運動手勢時CamShift的跟蹤結果,雖然兩個手勢距離攝像頭的前后位置不同,而且后方的人手為干擾因素,只有距離攝像頭最近的打手語者的右手為待跟蹤目標,但是由于它們都在運動,所以Cam-Shift將兩個運動手勢同時定位且進行了跟蹤。如圖9(b),是DI_CamShift在基于手勢深度信息基礎上正確識別跟蹤的目標手勢。

圖9 視頻中出現多個運動手勢時兩種算法跟蹤比較

一旦在深度手勢視頻中確定了跟蹤窗口,就同步地將該窗口繪制到彩色視頻中對應的位置處,實現彩色視頻中手勢的跟蹤。相同場景下,DI_CamShift算法具有更好的跟蹤效果,不會出現跟蹤中丟失手勢目標的情況,也去除了距離攝像頭較遠的具有相同顏色信息的人手區域的誤判跟蹤。

3.2 手勢分割

為了加快手勢圖像的分割計算速度,可將深度圖像的積分圖像用于以類間方差作為準則函數的二維Ostu算法[14-15],結合橢圓邊界膚色模型,得出一種改進的基于深度積分圖像的Ostu算法:

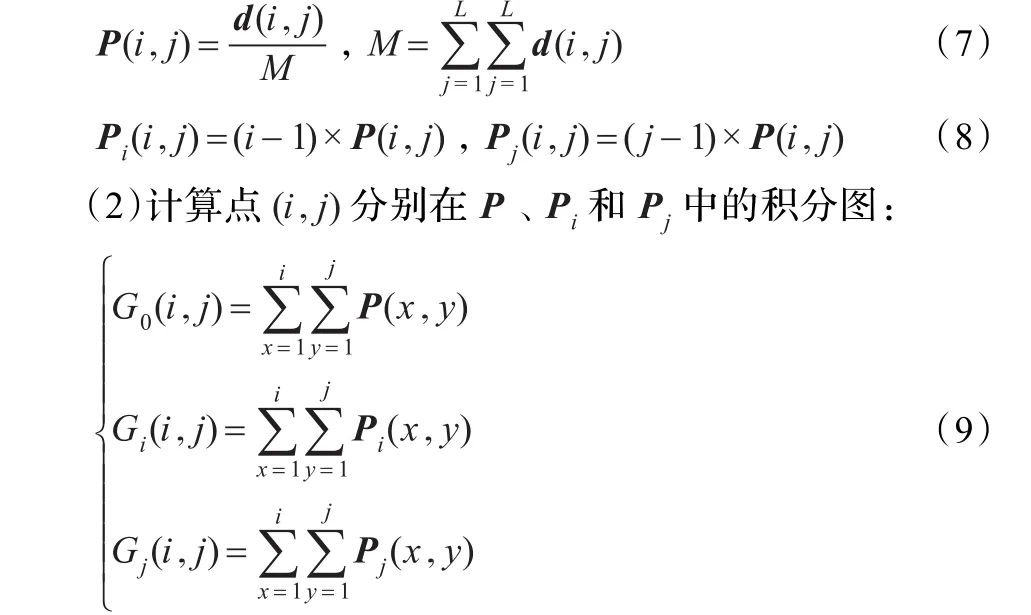

(1)g為橢圓邊界手勢膚色概率分布深度圖,采用3×3的均值濾波算子對g進行濾波,可以得到其鄰域平滑圖像f;通過遍歷g、f,尋找對應的像素并進行統計,其結果生成矩陣d;最后計算P(二維直方圖矩陣)和它所對應的變換矩陣Pi、Pj:

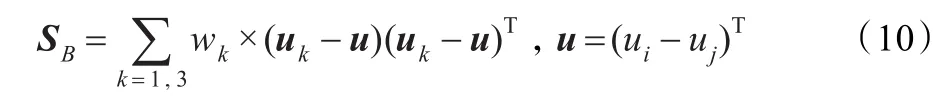

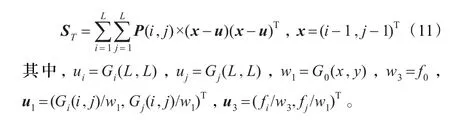

(3)計算SB和ST,它們分別為點(i,j)對應的類間離差矩陣和總離差矩陣:

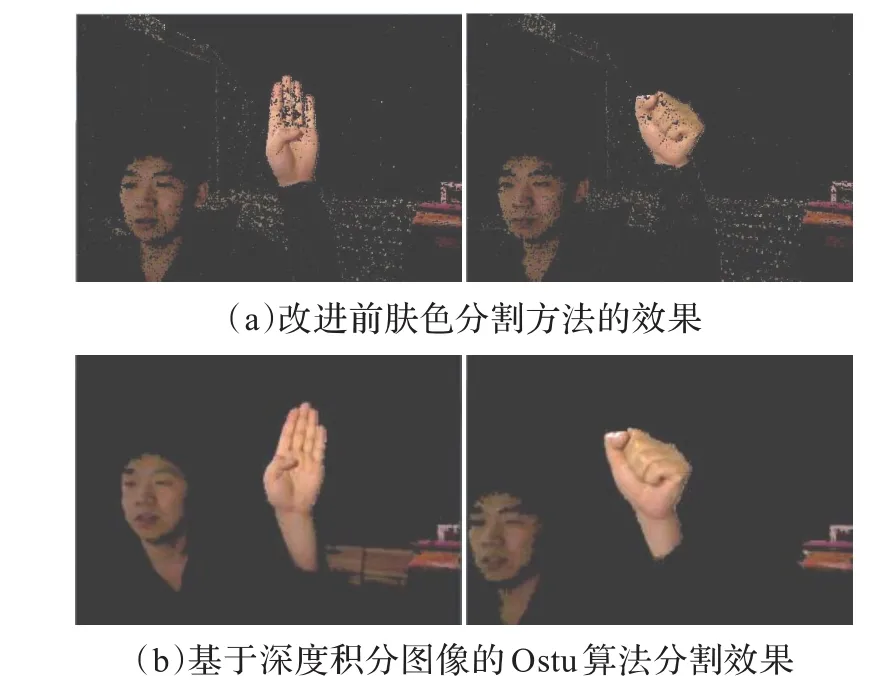

(4)計算ST-SB,獲得類內離差矩陣,計算min{|ST-SB|}((i,j)對應的準則函數值),然后查尋所有數據點,獲取最佳分割閾值。圖10為改進前后兩種分割算法的效果比較。

圖10 手勢分割方法改進前后的效果比較

圖11為在DI_CamShift跟蹤窗口內進行的基于改進膚色分割算法的手勢提取效果,作為深度距離最小的膚色物體,人手被較好地從背景中提取出來,未受視頻中其他膚色物體或類膚色物體的影響。

圖11 復雜背景視頻中手勢的分割

4 手語識別實驗

實驗運行環境:CPU為Intel Core i5-2300(雙核2.8 GHz),內存4 GB;操作系統:Win7 x64,安裝NET Framework 4.5,Kinect for Xbox 360 Sensor和Xbox 360 Kinect AC Adapter/ Power Supply;開發環境:vs2010 x64,Kinect SDK v1.7,OpenCV 2.4.4,OpenNI2.2 64 bit。

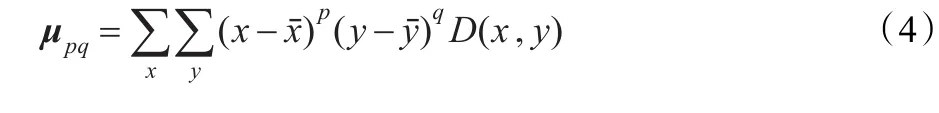

手語字母視頻由Kinect采集,在白天自然光照,復雜背景下錄制。由兩位打手語者面向Kinect打出30個手語字母,視頻包括打手語者的上半身區域和周圍復雜環境場景。每個手語字母錄制時長為3 min,分別采集彩色視頻和深度視頻,兩類視頻的30個分段視頻,共計360 min,如圖12所示。

本文實驗首先使用Kinect采集手語視頻圖像,然后用幀差法進行手語手勢的檢測和初步定位,并應用DI_Cam-Shift算法進行手勢跟蹤。在手勢分割提取時,用改進的膚色分割方法提取目標手勢,并進行特征提取和SLVW詞包構建,最后采用徑向基核函數(Radical Basis Function,RBF)SVM分類器進行訓練[16]:

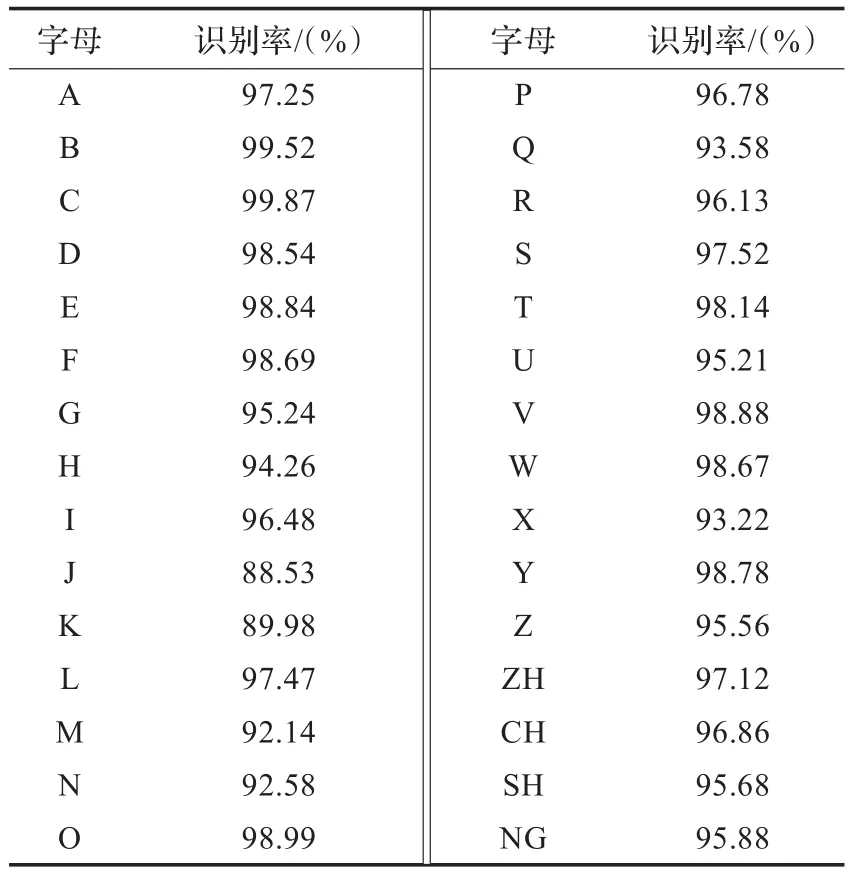

圖12 手語視頻

實驗中,從360 min自然光照復雜背景手語視頻中間隔采樣,針對每位打手語者,每個手語字母手勢分別提取50幅彩色圖像和50幅深度圖像,共計6 000幅手語圖像作為訓練樣本。從手語視頻中的非訓練樣本部分,選取30個手語字母中的各50幅彩色圖像和50幅深度圖像作為測試對象,基于RBF的SVM分類器識別結果如表2所示,平均識別率為96.21%。

表2 手語字母識別結果

5 結束語

本文提出了一種基于SLVW的手語字母識別方法,使用改進后的DI_CamShift算法,通過計算深度圖像中手語手勢的主軸方向和質心位置調整Search Window的尺寸,實現了對手語手勢的持續穩定跟蹤;將深度積分圖像應用于Ostu算法對手語手勢進行分割提取;通過提取手語SIFT特征,將手語圖像小區域量化生成其SLVW特征,然后使用K-means聚類算法得到視覺單詞頻率統計直方圖,最終生成SLVW詞包。由于引入了手語的深度圖像信息特征,使得識別過程不受顏色、光照和陰影的干擾。實驗采用基于RBF的SVM分類器對Kinect采集的中國手語30個字母手勢進行識別,獲得了較高的識別率。

[1]Wachs J P,Kolsch M,Stern H,et al.Vision-based hand-gesture applications[J].Communications of the ACM,2011,54(2):60-72.

[2]Ren Zhou,Yuan Junsong,Zhang Zhengyou.Robust hand gesture recognition based on finger-earth mover’s distance with a commodity depth camera[C]//Proceedings of the 19th ACM International Conference on Multimedia(MM’11),Scottsdale,Arizona,USA,November 28-December 1,2011:1093-1096.

[3]Doliotis P,Stefan A,McMurrough C,et al.Comparing gesture recognition accuracy using color and depth information[C]// Proceedings of the Conference on Pervasive Technologies Related to Assistive Environments(PETRA),Crete,Greece,May 2011:1-7.

[4]楊筱林,姚鴻勛.基于多尺度形狀描述子的手勢識別[J].計算機工程與應用,2004,40(32):76-78.

[5]張良國,高文,陳熙霖,等.面向中等詞匯量的中國手語視覺識別系統[J].計算機研究與發展,2006,43(3):476-482.

[6]姜峰,高文,姚鴻勛,等.非特定人手語識別問題中的合成數據驅動方法[J].計算機研究與發展,2007,44(5):873-881.

[7]Deng J W,Tsui H T.A two-step approach based on HMM for the recognition of ASL[C]//Proceedings of the 5th Asian Conference on Computer Vision,Melbourne,Australia,Jan 23-25,2002:1-6.

[8]Chen Qing,Georganas N D,Petriu E M.Real-time vision-based handgesturerecognitionusingHaar-likefeatures[C]//ProceedingsofInstrumentationandMeasurementTechnology Conference,1-3 May,2007:1-6.

[9]Silanon K,Suvonvorn N.Hand motion analysis for Thai alphabet recognition using HMM[J].International Journal of Information and Electronics Engineering,2011(1):65-71.

[10]Ong E J,Cooper H,Pugeault N,et al.Sign language recognition using sequential pattern trees[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR),Providence,Rhode Island,16-21 June,2012:2200-2207.

[11]王宇石,高文.用基于視覺單詞上下文的核函數對圖像分類[J].中國圖象圖形學報,2010,15(4):607-616.

[12]劉揚聞,霍宏,方濤.詞包模型中視覺單詞奇異性分析[J].計算機工程,2011,34(19):204-209.

[13]張秋余,王道東,張墨逸,等.基于特征包支持向量機的手勢識別[J].計算機應用,2012,32(12):3392-3396.

[14]朱志亮,劉富國,陶向陽,等.基于積分圖和粒子群優化的膚色分割[J/OL].(2013-01)[2013-03].http://www.cnki.net/kcms/ detail/11.2127.TP.20130129.1543.016.html.

[15]郎咸朋,朱楓,都穎明,等.基于積分圖像的快速二維Otsu算法[J].儀器儀表學報,2009,30(1):39-43.

[16]Lin C J.LibSVM:a library for Support Vector Machines[EB/OL].(2012)[2013-03].http://www.csie.ntu.edu.tw/~cjlin/libsvm.

YANG Quan,PENG Jinye

School of Information Science and Technology,Northwest University,Xi’an 710127,China

In order to realize the accurate recognition of manual alphabets in the sign language video,this paper presents an improved algorithm based on DI_CamShift(Depth Image CamShift)and SLVW(Sign Language Visual Word).It uses Kinect as the sign language video capture device to obtain both of the color video and depth image information of sign language gestures. The paper calculates spindle direction angle and mass center position of the depth images to adjust the search window and for gesture tracking.An Ostu algorithm based on depth integral image is used to gesture segmentation,and the SIFT features are extracted.It builds the SLVW bag of words as the feature of sign language and uses SVM for recognition.The best recognition rate of single manual alphabet can reach 99.87%,and the average recognition rate is 96.21%.

manual alphabets recognition;Depth Image CamShift(DI_CamShift);Sign Language Visual Word(SLVW);Kinect; depth image

為了實現手語視頻中手語字母的準確識別,提出了一種基于DI_CamShift和SLVW的算法。該方法將Kinect作為手語視頻采集設備,在獲取彩色視頻的同時得到其深度信息;計算深度圖像中手語手勢的主軸方向角和質心位置,通過調整搜索窗口對手勢進行準確跟蹤;使用基于深度積分圖像的Ostu算法分割手勢,并提取其SIFT特征;構建了SLVW詞包作為手語特征,并用SVM進行識別。通過實驗驗證該算法,其單個手語字母最好識別率為99.87%,平均識別率96.21%。

手語字母識別;深度圖像CamShift;手語視覺單詞(SLVW);Kinect;深度圖像

A

TP311.52

10.3778/j.issn.1002-8331.1304-0279

YANG Quan,PENG Jinye.Improved sign language recognition research using depth image information and SLVW. Computer Engineering and Applications,2013,49(19):5-10.

國家自然科學基金(No.61075014);高等學校博士學科點專項科研基金資助課題(No.20116102110027)。

楊全(1980—),女,博士研究生,講師,研究領域為模式識別,數字圖像處理;彭進業(1964—),男,博士生導師,教授,研究領域為數字圖像處理。E-mail:yangquan1110@yeah.net

2013-04-19

2013-06-14

1002-8331(2013)19-0005-06

CNKI出版日期:2013-06-18http://www.cnki.net/kcms/detail/11.2127.TP.20130618.1559.007.html