基于列質(zhì)量向量和SVM的步態(tài)識(shí)別

王開杰,楊天奇

暨南大學(xué) 信息科學(xué)技術(shù)學(xué)院,廣州 510632

1 引言

步態(tài)識(shí)別是一種新穎的生物特征識(shí)別技術(shù),利用人類行走的方式識(shí)別每個(gè)個(gè)體。與指紋識(shí)別、人臉識(shí)別、虹膜識(shí)別等生物識(shí)別特征相比,具有遠(yuǎn)距離、非接觸、難偽裝、難隱藏[1]的特點(diǎn),并且對(duì)視頻質(zhì)量要求不高,近些年來(lái)引起了國(guó)內(nèi)外越來(lái)越多學(xué)者的關(guān)注。它在視覺監(jiān)控、門禁系統(tǒng)、醫(yī)療診斷等方面有廣泛的應(yīng)用前景和經(jīng)濟(jì)價(jià)值。

步態(tài)識(shí)別最早來(lái)自于醫(yī)學(xué)、心理學(xué)方面的研究。伴隨著生物識(shí)別技術(shù)的興起和計(jì)算機(jī)運(yùn)算的發(fā)展,步態(tài)識(shí)別在生物識(shí)別領(lǐng)域逐步得到發(fā)展和認(rèn)可。1994年,Niyogi和Adelson[2]等提出利用步態(tài)特征進(jìn)行識(shí)別身份的方法。隨后步態(tài)識(shí)別得到快速的發(fā)展,提出大量的研究步態(tài)的方法,取得了一系列研究成果。步態(tài)識(shí)別的算法大致非為兩類:基于模型和非模型的方法。基于模型的方法依據(jù)人體的生理特征對(duì)人體進(jìn)行建模,將這些特征作為步態(tài)特征進(jìn)行分類,如Cunado[3]等的鐘擺模型、Lee[4]等的橢圓模型、Yoo[5]等的擺角模型、HaipingLu[6]等的全身分層可變形模型、Urtasun[7]等的3D人體運(yùn)動(dòng)模型。基于非模型的方法主要是根據(jù)人體目標(biāo)移動(dòng)時(shí),所產(chǎn)生時(shí)空模式的各類統(tǒng)計(jì)值來(lái)提取特征,如Kale[8]等人以體輪廓寬度作為特征,Yang[9]等提出步態(tài)能量圖算法,Sarkar[10]等利用側(cè)影序列作為特征。

本文主要進(jìn)行了以下研究工作:選擇列質(zhì)量向量作為步態(tài)特征、基于支持向量機(jī)(SVM)識(shí)別方法。

其優(yōu)點(diǎn)主要有:

(1)橫向量[11]雖然考慮到人體每個(gè)部分周期性的變化,但步態(tài)是人體各個(gè)部分協(xié)調(diào)運(yùn)作的結(jié)果。橫向量沒有考慮各個(gè)部分協(xié)調(diào)關(guān)系,而列質(zhì)量向量通過對(duì)人體區(qū)域進(jìn)行縱向分割,使得在行走過程中各個(gè)部分的協(xié)調(diào)運(yùn)動(dòng)反映在列向量周期變化之中。

(2)充分考慮手臂擺動(dòng)的信息,使特征具有更強(qiáng)的區(qū)分能力。

(3)通過平均的方法可減少因背景減除等預(yù)處理方法而引起的偶然誤差,而且保留了本質(zhì)的步態(tài)特征。

(4)列向量可對(duì)背包類攜帶物引起的人體區(qū)域的擴(kuò)展具有很強(qiáng)的區(qū)分能力,該類攜帶物的列向量不會(huì)隨行走過程產(chǎn)生周期改變,更易于提取和識(shí)別。

2 特征提取和識(shí)別

步態(tài)識(shí)別就是對(duì)人體運(yùn)動(dòng)系列進(jìn)行分析處理識(shí)別,主要包括預(yù)處理、步態(tài)周期檢測(cè)、特征提取和分類識(shí)別4個(gè)過程。

2.1 預(yù)處理

提取步態(tài)特征之前需要做一些預(yù)處理工作,方便提取步態(tài)特征。通常對(duì)步態(tài)圖像序列使用背景分離、空洞檢測(cè)和去除噪聲等預(yù)處理動(dòng)作。預(yù)處理結(jié)果的好壞直接影響到識(shí)別效果,因此需要選擇合適的預(yù)處理方法。

常見的步態(tài)輪廓提取方法有幀間差分法、背景減除法、光流法等。由于步態(tài)數(shù)據(jù)庫(kù)背景通常是靜止的,背景減除法可以獲得很好的分割效果,因此采用此方法。背景減除法的關(guān)鍵是背景建模,常用的背景建模有中值濾波法、均值濾波法、鄰幀差法、最小方差均值法等。創(chuàng)建背景圖像之后,使用當(dāng)前圖像與背景圖像相減,根據(jù)選定的方法即可提取人體輪廓,得到人體輪廓圖像。提取步態(tài)輪廓的過程,基本的方法參照文獻(xiàn)[12]使用的背景減除法來(lái)提取人體步態(tài)側(cè)影。

得到步態(tài)輪廓提取之后,在輪廓圖片中會(huì)出現(xiàn)一些陰影。常見的陰影檢測(cè)與消除方法:通過像素點(diǎn)的顏色屬性或建立模型來(lái)檢測(cè)和消除陰影;然后利用形態(tài)學(xué)算法消除小噪聲;最后對(duì)圖像作連通性分析,選擇像素點(diǎn)最多的連通域作為人體目標(biāo)區(qū)域。

2.2 步態(tài)周期

步態(tài)的視頻往往包括人體的多個(gè)走路,并且分析可知具有一定的周期性。若能發(fā)現(xiàn)和識(shí)別,就能減少運(yùn)算量和時(shí)間的開銷,也能減少一些誤差。通常一個(gè)步態(tài)周期由兩步構(gòu)成,可以定義為一條腿向前跨出最遠(yuǎn)的位置到下次一條腿向前跨出最遠(yuǎn)的位置所需要的時(shí)間。常見的周期檢測(cè)方法有:Kale等人[8]使用人體寬度向量的泛數(shù)的變化曲線;Sarkar等人[10]使用人體的下半身部分像素點(diǎn)的數(shù)目大小隨時(shí)間變化的曲線;Wang Liang等人[12]使用大腿角度的變化提取周期。

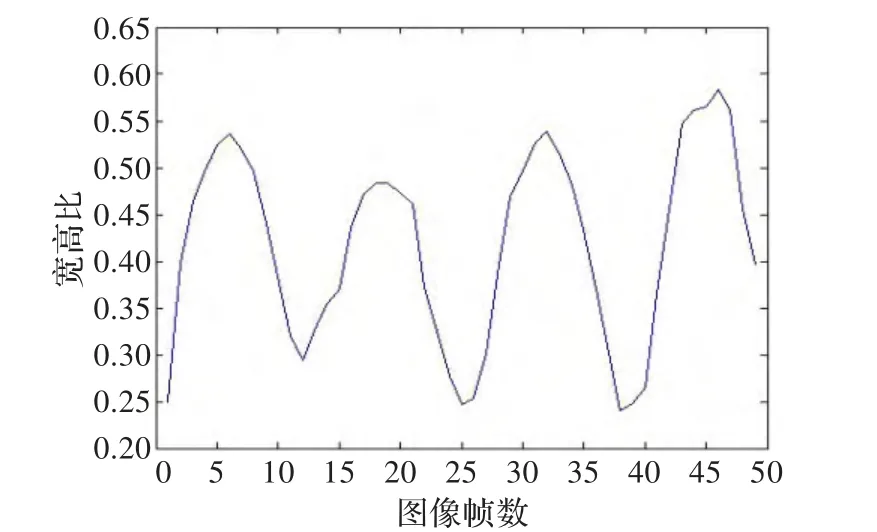

通過分析人體運(yùn)動(dòng)輪廓的高度和寬度信息來(lái)實(shí)現(xiàn)步態(tài)周期檢測(cè)。從人體側(cè)面步態(tài)序列看出,人在走路過程中,人的走路方式呈現(xiàn)一定的周期規(guī)律,即輪廓寬度從最大值變成最小值再到最大值這樣的周期變化,同時(shí)人體的高度變化不明顯。對(duì)人體輪廓進(jìn)行分析容易識(shí)別人體最小外接矩陣。從中提取出人體的寬度和高度,得到寬高比如公式(1)所示,利用寬高比的周期變化分析人體運(yùn)動(dòng)中的步態(tài)周期。

然后在步態(tài)序列中根據(jù)寬高比提取輪廓周期,如圖1所示。由于左腳在前和右腳在前對(duì)稱,實(shí)際中只需要計(jì)算半個(gè)周期,即從一個(gè)最大值到下一個(gè)最大值,記為一個(gè)周期。根據(jù)圖1,所得周期范圍為(ti,tj),步態(tài)的周期T=tj-ti。

圖1 步態(tài)周期

2.3 列質(zhì)量向量特征提取

識(shí)別的關(guān)鍵在于提取有效描述步態(tài)的特征。步態(tài)特征提取與識(shí)別方法可以分為基于模型的方法與無(wú)模型方法兩種,前面引言部分已經(jīng)對(duì)基于這兩大類方法的國(guó)內(nèi)外研究成果作了簡(jiǎn)單的介紹。對(duì)于無(wú)模型方法,步態(tài)特征提取與識(shí)別方法,并不需要建立模型,只需要通過對(duì)圖像序列中運(yùn)動(dòng)人體生成的時(shí)空模式做統(tǒng)計(jì)分析,從中觀察到步態(tài)特性并從中對(duì)步態(tài)進(jìn)行特征提取和識(shí)別。基于無(wú)模型的步態(tài)特征提取與識(shí)別的方法有很多。

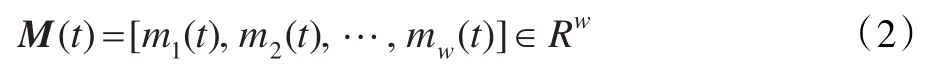

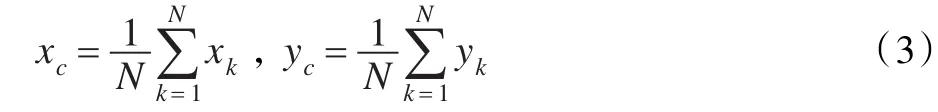

本文提出一種新的使用人體輪廓列質(zhì)量向量作為步態(tài)特征的步態(tài)識(shí)別方法。其中質(zhì)量列向量可以表示為:

對(duì)步態(tài)圖片序列提取人體輪廓列質(zhì)量向量步驟過程如下:

(1)首先從圖像序列中求出步態(tài)周期,假設(shè)Im(m=1,2,…,n)表示一個(gè)含有n幀圖像的序列,根據(jù)上節(jié)所說(shuō)的寬高比求出周期,從中選取一個(gè)周期范圍(I1,I2),步態(tài)的周期T=I2-I1。

(2)然后從圖像序列中求出人體質(zhì)心,質(zhì)心公式如式(3):

式中(xc,yc)為質(zhì)心坐標(biāo),N為輪廓的像素點(diǎn)總和,xk、yk分別為第k個(gè)點(diǎn)的橫、縱坐標(biāo)。

(3)其次依次求出周期內(nèi)第i張序列圖片的列質(zhì)量向量,公示如式(4):

(4)最后求出周期內(nèi)列質(zhì)量向量的平均值:

2.4 SVM分類識(shí)別

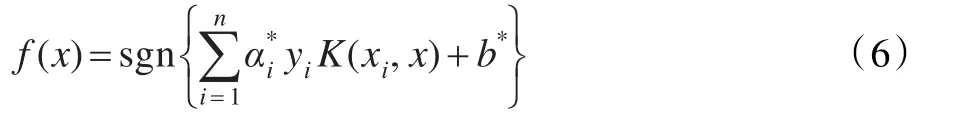

支持向量機(jī)是以統(tǒng)計(jì)學(xué)習(xí)理論為基礎(chǔ)的一種新型機(jī)器學(xué)習(xí)方法,具備很強(qiáng)的泛化能力,在模式識(shí)別領(lǐng)域取得大量的研究成果[13-14]。對(duì)于非線性問題,將低維輸入空間中的數(shù)據(jù)通過非線性函數(shù)映射到高維屬性空間(也稱為特征空間),將分類問題轉(zhuǎn)化到特征空間進(jìn)行。SVM進(jìn)行模式分類的計(jì)算如公式(6)所示,最后由得出的結(jié)果(+1或 -1)來(lái)決定類別分類。

但在低維輸人空間向高維屬性空間映射的過程中,由于空間維數(shù)急速增長(zhǎng),可能導(dǎo)致“維數(shù)災(zāi)難”問題,使得大部分情況下難以直接在屬性空間上直接計(jì)算最優(yōu)分類面。SVM通過定義輸入空間的核函數(shù)(Kernel Function),核函數(shù)計(jì)算高維空間中的公式:

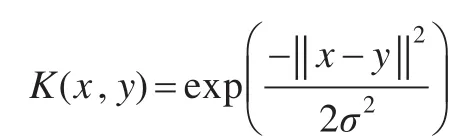

本文用到的SVM核函數(shù)公式主要有線性、多項(xiàng)式和徑向基3類。

(1)線性核函數(shù)(Linear Kernel):K(x,y)=x·y。

(2)多項(xiàng)式核函數(shù)(Polynomial Kernel):K(x,y)=(x·y+1)d,d=1,2,…。

SVM主要是解決二類別模式識(shí)別問題,但步態(tài)識(shí)別是一個(gè)多類模式識(shí)別,如何將二類識(shí)別擴(kuò)展到多類識(shí)別是SVM的技術(shù)難點(diǎn)之一。本文采用“一對(duì)多”方法,構(gòu)造K個(gè)SVM模型,對(duì)于第i個(gè)SVM模型,將第i類模型的樣本作為一類(正類),輸出結(jié)果為+1,其余k-1類樣本作為另一類(負(fù)類),輸出結(jié)果為-1。

3 步態(tài)識(shí)別實(shí)驗(yàn)

3.1 仿真實(shí)驗(yàn)

本文采用了中國(guó)科學(xué)學(xué)院自動(dòng)化(CASIA)步態(tài)數(shù)據(jù)庫(kù)的兩個(gè)數(shù)據(jù)集:Dataset A(小規(guī)模庫(kù))、Dataset B(多視角庫(kù))。實(shí)驗(yàn)都是在Matlab 7.0的條件下完成。

Dataset B是一個(gè)大規(guī)模、多視角的步態(tài)庫(kù),共有124 個(gè)人,每個(gè)人有 11 個(gè)視角 (0°,18°,36°,…,180°),分別在3種行走條件下(普通條件、穿大衣、挎包條件)采集,在相同視角下,每個(gè)人在普通條件下有6個(gè)圖像序列,其他條件下各兩個(gè)序列,每個(gè)視頻序列包含2~3個(gè)步態(tài)周期,這些彩色視頻序列的幀率是25幀/s,圖像像素為320×240,長(zhǎng)度也都在100幀左右。

3.1.1 步態(tài)列質(zhì)量向量提取

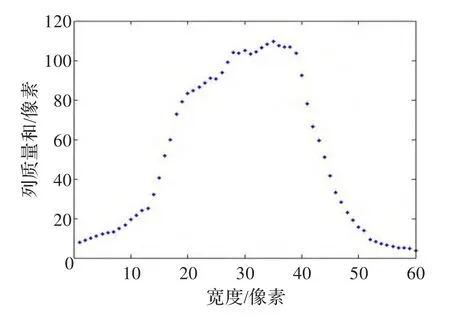

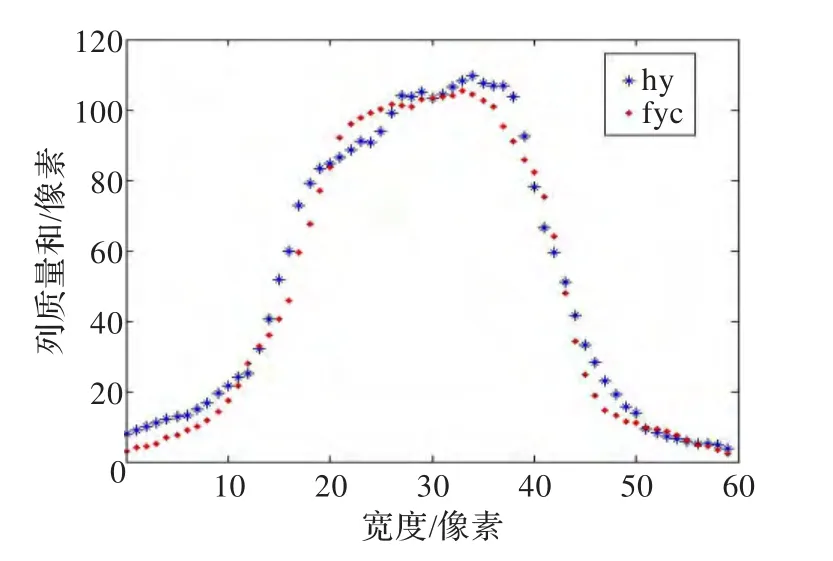

提取測(cè)試樣本中人體輪廓的列質(zhì)量向量。如圖2所示為預(yù)處理之后的人體輪廓圖像,按照提出人體輪廓列質(zhì)量向量的步驟,提取列質(zhì)量向量。如圖3是提取Dataset A下的hy對(duì)應(yīng)的列質(zhì)量向量點(diǎn)圖。如圖4是Dataset A下的fyc和hy的列質(zhì)量向量特征對(duì)比圖,fyc列質(zhì)量向量的特征如紅點(diǎn)所示,是hy的列質(zhì)量向量如藍(lán)色星型所示。

圖2 人體輪廓圖像

圖3 列質(zhì)量向量圖

圖4 列質(zhì)量向量對(duì)比

3.1.2 SVM的分類識(shí)別

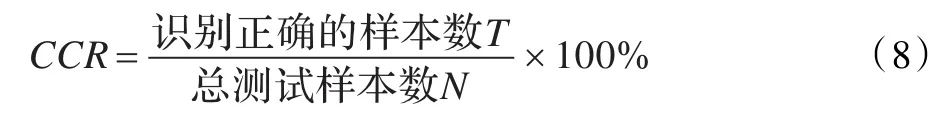

為了評(píng)價(jià)分類結(jié)果引入正確分類率CCR(Correct Classification Rate)作為評(píng)價(jià)指標(biāo)。測(cè)試樣本中,將測(cè)試樣本Ti輸入到經(jīng)過訓(xùn)練得到的k個(gè)分類器,如果Ci輸出+1且唯一,其他全輸出為-1,本次識(shí)別出Ci,正確分類率CCR定義如下:

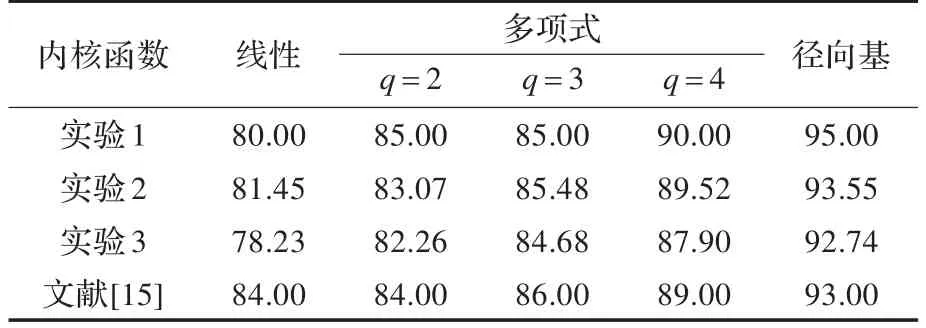

實(shí)驗(yàn)1采用CASIA步態(tài)數(shù)據(jù)庫(kù)中的A庫(kù),庫(kù)中有20人,在側(cè)面即90°視角下,每個(gè)測(cè)試者選取兩個(gè)步態(tài)周期,得到40個(gè)步態(tài)數(shù)據(jù)樣本訓(xùn)練和測(cè)試。從每個(gè)測(cè)試者的兩個(gè)步態(tài)周期隨機(jī)選取其中的一個(gè)作為訓(xùn)練樣本,另一個(gè)樣本用于測(cè)試,訓(xùn)練集和測(cè)試集共有20個(gè)人。按照前面的方法分別提取樣本中人體輪廓的列質(zhì)量向量,可得訓(xùn)練樣本有20類,記為M1,M2,…,M20,測(cè)試樣本20類,記為M1',M2',…,M20'。分別采取線性核函數(shù)、多項(xiàng)式核函數(shù)和徑向基核函數(shù),并設(shè)計(jì)相對(duì)應(yīng)的分類器。首先設(shè)計(jì)20個(gè)以線性核函數(shù)的分類器Ci(i=1,2,…,20),每個(gè)Ci用其中的一類樣本Mi作為正樣本進(jìn)行訓(xùn)練,輸出結(jié)果為+1,其他Ci作負(fù)樣本進(jìn)行訓(xùn)練,輸出結(jié)果為-1。這樣就把20個(gè)分類器Ci設(shè)計(jì)成功。可以取20個(gè)測(cè)試樣本,通過設(shè)計(jì)好的分類器對(duì)步態(tài)樣本M1',M2',…,M20'進(jìn)行模式識(shí)別。計(jì)算測(cè)試樣本通過SVM分類器Ci的輸出,判斷該測(cè)試樣本屬于哪一類,從而識(shí)別出步態(tài)。同理設(shè)計(jì)以多項(xiàng)式核函數(shù)和徑向基核函數(shù)分類器,然后進(jìn)行識(shí)別。最后統(tǒng)計(jì)測(cè)試樣本的正確分類率,如表1所示。

實(shí)驗(yàn)2采用CASIA步態(tài)數(shù)據(jù)庫(kù)中的B庫(kù),該庫(kù)總共124人,采用90°視角下,選取普通條件下每個(gè)視角選取一個(gè)圖像序列作為訓(xùn)練樣本,采用另一個(gè)圖像序列作為測(cè)試集,分別通過3種內(nèi)核函數(shù)(也包含參數(shù)的變化)的SVM對(duì)步態(tài)樣本M1,M2,…,M124進(jìn)行模式識(shí)別,最后統(tǒng)計(jì)測(cè)試樣本的正確分類率,如表1所示。

實(shí)驗(yàn)3選用CASIA步態(tài)數(shù)據(jù)庫(kù)中的B庫(kù),測(cè)試集為90°視角,挎包條件下每個(gè)視角選取一個(gè)圖像序列作為訓(xùn)練樣本,參照實(shí)驗(yàn)1的過程,分別通過3種內(nèi)核函數(shù)(也包含參數(shù)的變化)的SVM對(duì)步態(tài)樣本M1,M2,…,M124進(jìn)行識(shí)別,最后統(tǒng)計(jì)正確分類率,如表1所示。

表1 SVM算法正確識(shí)別率 %

3.2 實(shí)驗(yàn)結(jié)果及分析

從表1中可知,實(shí)驗(yàn)1的正確分類率在80%~95%之間,實(shí)驗(yàn)結(jié)果說(shuō)明識(shí)別率比較高。采用線性內(nèi)核識(shí)別率最低,采用徑向基內(nèi)核時(shí)SVM的正確識(shí)別率最高。實(shí)驗(yàn)2的正確分類率在81.45%~93.55%之間,實(shí)驗(yàn)結(jié)果表明識(shí)別率比較高。采用線性內(nèi)核識(shí)別率最低,采用徑向基內(nèi)核時(shí)SVM的正確識(shí)別率最高。實(shí)驗(yàn)3的結(jié)果所示,正確分類率在78.23%~92.74%之間,實(shí)驗(yàn)結(jié)果表明識(shí)別率還是比較高,并且對(duì)挎包不敏感,魯棒性比較好。

3.3 與其他方法的對(duì)比

現(xiàn)在有很多技術(shù)研究人體的步態(tài)識(shí)別。薛召軍等人[15]采用基本類似的方法來(lái)根據(jù)人們的運(yùn)動(dòng)識(shí)別個(gè)體,雖然也使用了CASIA步態(tài)數(shù)據(jù)庫(kù)中的A庫(kù),運(yùn)用到相同的拍攝環(huán)境和圖片序列,將實(shí)驗(yàn)結(jié)果與薛召君等人的方法進(jìn)行對(duì)比,文獻(xiàn)[15]的實(shí)驗(yàn)結(jié)果見表1。

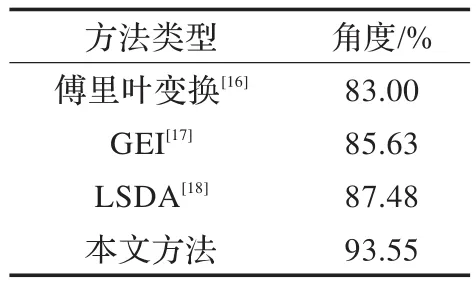

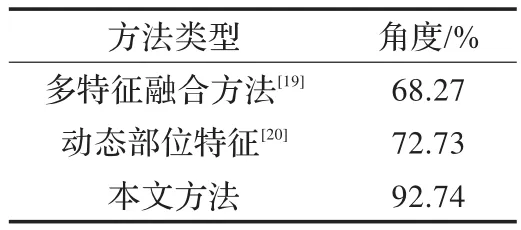

將本文方法與文獻(xiàn)[16-18]中提及的識(shí)別方法進(jìn)行對(duì)比,如表2所示,可以看出本文提出的方法在識(shí)別率上有了較大幅度的提高。原因在于基于列質(zhì)量向量反映了人的整體信息,而每個(gè)人的信息都具有獨(dú)特性。將挎包情形與文獻(xiàn)[19-20]的識(shí)別方法進(jìn)行對(duì)比,如表3中所示,識(shí)別率仍然比較高。原因在于基于列質(zhì)量向量的步態(tài)特征對(duì)背包類攜帶物引起的人體區(qū)域的擴(kuò)展具有很強(qiáng)的區(qū)分能力,該類攜帶物的列向量不會(huì)隨行走過程產(chǎn)生周期改變,更易于提取和識(shí)別。

表2 在CASIA-B庫(kù)的步態(tài)識(shí)別正確分類率(與文獻(xiàn)[16-18]對(duì)比)

表3 在CASIA-B庫(kù)的步態(tài)識(shí)別正確分類率(與文獻(xiàn)[19-20]對(duì)比)

4 結(jié)束語(yǔ)

提出了一種利用人體輪廓列質(zhì)量向量來(lái)表征人的步態(tài)特征信息,其創(chuàng)新點(diǎn):

(1)提出了基于列質(zhì)量向量的步態(tài)識(shí)別方法,該方法體現(xiàn)步態(tài)整體特性,反映本質(zhì)特征,對(duì)背包類攜帶物引起的人體區(qū)域的擴(kuò)展具有很強(qiáng)的區(qū)分能力。

(2)將列質(zhì)量向量特征提取與SVM識(shí)別結(jié)合在一起,利用SVM使用一對(duì)其余的方法來(lái)模式識(shí)別不同樣本。在中科院自動(dòng)化研究所的CASIA步態(tài)數(shù)據(jù)庫(kù)上進(jìn)行了大量的實(shí)驗(yàn)。實(shí)驗(yàn)結(jié)果表明,列質(zhì)量向量特征提取和SVM識(shí)別結(jié)合取得了較高的識(shí)別率。

[1]Yang Xiaochao,Zhou Yue.Gait recognition based on dynamic region analysis[J].Signal Processing,2008,88(9):2350-2356.

[2]Niyogi S A,Adelsone H.Analyzing and recognizing walking figures in XYT[C]//Proc of IEEE Conference on Computer Vision and Pattern Recognition,Seattle,USA,1994:469-474.

[3]Cunado D,Nixon M,Cater J.Using gait as a biometric,via phase weighted magnitude spectra[C]//Proc of International Conference on Audio and Video-based Biometric Person Authentication,Crans-Montana,Switzerland,1997:95-102.

[4]LeeL,Grimson W.Gaitanalysisforrecognition and classification[C]//Proceedings of the 5th IEEE International Conference on Automatic Face and Gesture Recognition,Washington,DC,USA,2002:148-155.

[5]Yoo J H,Nixon M,Harrisc J.Extracting human gait signatures by body segment properties[C]//IEEE Southwest Symposium on Image Analysis and Interpretation,Sante Fe,NM,2002:35-39.

[6]Yang X,Zhou Y,Zhang T,et al.Gabor phase based gait recognition[J].Electronics Letters,2008,44(10):620-621.

[7]Lu Haiping.A full-body layered deformable model for automatic model-based gait recognition[C]//Proceedings of the 7th International Conference on Automatic Face and Gesture Recgnition,2-6 April,2006:249-254.

[8]Urtasun R.3D tracking for gait characterization and recognition[C]//Proceedingsofthe 6th IEEE International Conference on Automatic Face and Gesture Recognition,Seoul,Korea,2004:17-22.

[9]Kale A,Sundaresan A,Rajagopalan A N,et al.Identification of humans using gait[J].IEEE Transactions on Image Processing,2004,13(9):1163-1173.

[10]Sarkar S,Phillips P J,Liu Z,et al.Human ID gait challenge problem:Data sets,performance,and analysis[J].IEEE TransactionsonPattern Analysisand Machine Intelligence,2005,27(2):162-177.

[11]Xiao Degui,Wang Lei.Gait recognition method based on weighted row mass vector[J].Computer Engineering,2011,37(11):215-217.

[12]Wang Liang,Tan Tieniu,Ning Huazhong,et al.Silhouette analysis-based gait recognition for human identification[J].IEEE Transactionson Pattern AnalysisandMachine Intelligence,2003,25(12):1505-2528.

[13]許國(guó)根,賈瑛.模式識(shí)別與智能計(jì)算在Matlab實(shí)驗(yàn)[M].北京:北京航空航天大學(xué)出版社,2012:125-136.

[14]李文書,趙悅.數(shù)字圖像處理算法及應(yīng)用[M].北京:北京大學(xué)出版社,2012:314-337.

[15]薛召軍,李佳.基于支持向量機(jī)的步態(tài)識(shí)別新方法[J].天津大學(xué)學(xué)報(bào),2007,40(1):78-82.

[16]Liu Yanqiu,Wang Xu,Wang Yumei,et al.Multi-view gait recognition using Fourier transform[J].Computer Engineering and Applications,2012,48(6):169-170.

[17]顧磊.基于圖像序列的人體步態(tài)識(shí)別方法研究[D].南京:南京理工大學(xué),2007.

[18]Cai D,He X,Zhou K,et al.Locality sensitive discriminant analysis[C]//Proceedings of the Twentieth International Joint Conference on Artificial Intelligence,2007:708-713.

[19]胡帥.復(fù)雜場(chǎng)景下步態(tài)識(shí)別技術(shù)研究[D].哈爾濱:哈爾濱工程大學(xué),2012.

[20]車轔轔,孔英會(huì).基于動(dòng)態(tài)部位特征的步態(tài)識(shí)別方法[J].計(jì)算機(jī)應(yīng)用,2012,32(12):3418-3421.