模板匹配優化耦合圖像校正的旋轉工件目標定位算法*

胡明星,王小蘭2

(1.華中師范大學武漢傳媒學院,武漢 430205;2.華中科技大學 計算機科學與技術學院,武漢 430074)

模板匹配優化耦合圖像校正的旋轉工件目標定位算法*

胡明星1,王小蘭2

(1.華中師范大學武漢傳媒學院,武漢430205;2.華中科技大學 計算機科學與技術學院,武漢430074)

摘要:為了解決當前工件定位算法難以有效識別帶有旋轉角度的目標,且計算復雜度大等不足,文章設計了基于Canny檢測與SIFT特征的旋轉工件目標識別算法。首先,對采集工件圖像的RGB三通道完成權重分配,獲取灰度化圖像;并利用Canny邊緣檢測和霍夫直線檢測處理灰度圖像,計算出工件旋轉角度;并基于幾何變換,定義圖像校正模型,消除工件旋轉角度,對其完成復位處理,并采用模板匹配在圖像中定位工件。最后分別提取模板工件與待識別工件的SIFT特征,計算歐式距離,以度量相似性,完成工件目標識別。實驗數據顯示:與當前識別算法相比,在面對帶有旋轉角度工件時,文中工件目標識別算法具備更高的準確性和魯棒性。

關鍵詞:霍夫變換;幾何變換;SIFT;模板匹配;目標識別

0引言

近幾年來,計算機視覺,這個以圖像處理算法與軟件編程為基礎的多學科技術,越來越多的應用于工業領域中的目標定位。而在工業領域中離不開各種工件的制造、傳送、組裝,在這些過程中,都需要用到工件目標定位,能否對工件進行準確定位,直接影響制造質量[1-2]。以往采用人眼定位工件位置,操作設備作業工件,此種方法不但效率低下,而且成本較高。對此,研究人員于提出了計算機視覺技術,代替人眼定位工件,把數據傳輸給設備,不僅精度高,而且效率也明顯提高[3-4]。

目前有一些基于圖像處理算法的視覺技術用于工件目標定位,并取得了一定成果。如楊萌等[5]先基于目標模板遍歷圖像查找目標位置,然后分別提取目標特征與模板特征,進行距離比較,最后確定目標位置。如趙君愛等[6]先基于灰度圖像分割得到二值圖像,然后逐個提取輪廓的幾何特征,最后與先驗標準進行對比,從而確定目標位置。

雖然上述工件定位技術用于不帶有旋轉的工件時,具有良好的識別質量;但是在實際情況中,待定位的工件往往是帶有旋轉角度的,而上述方法對于角度沒有很好的耦合性,使其定位精度欠佳。

對此,有學者對模板定位方法進行了改進,如余旺盛等人[7]為了解決旋轉目標跟蹤問題,提出了基于旋轉不變直方圖的快速匹配窮搜索,并通過基于雙圓定位的旋轉不變直方圖對目標進行了準確的定位和旋轉校正,從而提高了工件定位精度,但是該算法需要依賴雙圓形定位,其圓的半徑、雙圓位置的確定是比較局限的,且容易丟失部分細節特征,使其直方圖存在失真,繼而使其精度有待進一步提高。

對此,本文以提高對旋轉工件定位的精度與效率為目標,提出了基于Canny檢測與SIFT特征的旋轉工件目標識別算法。并測試了本文算法的工件定位精度。

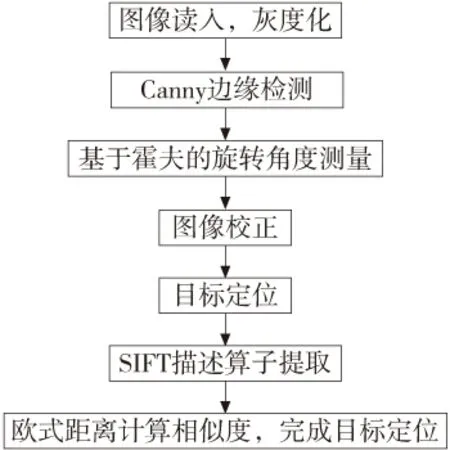

1本文旋轉工件定位算法設計

本文對帶有旋轉角度的工件目標完成定位,主要分為角度測量、圖像校正、目標定位、特征匹配。因工件旋轉角度為工件邊緣與圖像寬邊夾角,而邊緣與圖像寬邊都為直線。因此,基于Canny邊緣檢測與霍夫變換查找直線,計算旋轉角度。再獲取旋轉角度后,采用圖像幾何變換算法,對圖像進行校正,使工件目標無角度旋轉。然后基于模板,遍歷圖像,定位出疑似工件目標的位置,并提取出SIFT描述算子,計算出疑似工件與模板的SIFT描述算子歐式距離,測量出相似度,進行定性判斷,從而完成帶旋轉角度的工件目標定位。本文算法的流程見圖1。

圖1 系統架構圖

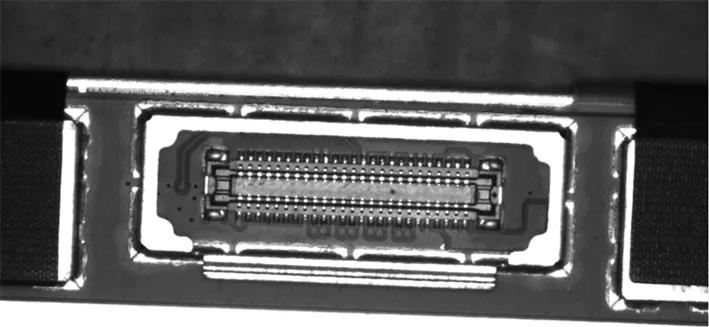

1.1旋轉角度計算與圖像校正

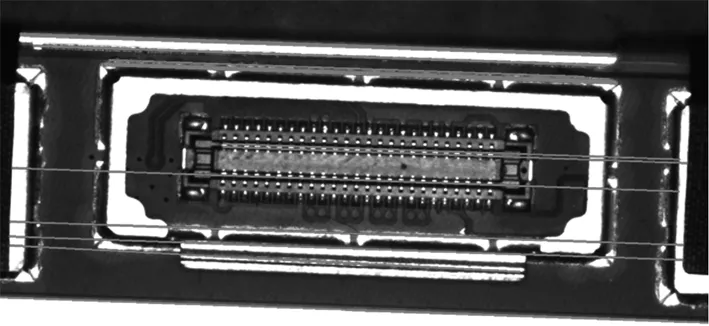

由于采集到的工件圖像往往存在一定的旋轉,見圖2。為此,本文采用先對其完成圖像校正,再定位目標。首先將圖像灰度化,為邊緣檢測做好準備。本文采用黑白相機取像,由于其數據通道為RGB三通道,計算量大,故對其完成灰度處理,轉換成單通道,提高系統效率。為了更好地符合人眼特性,本文對采集圖像RGB三通道的權重進行分配,得到加權灰度化模型:

gray(x,y)=0.299R(x,y)+0.587G(x,y)+

0.114B(x,y)

(1)

其中,gray(x,y)為圖像坐標(x,y)處的灰度值;R(x,y)為紅色通道(x,y)處的亮度值;G(x,y)為綠色通道(x,y)處的亮度值;B(x,y)為藍色通道(x,y)處的亮度值。

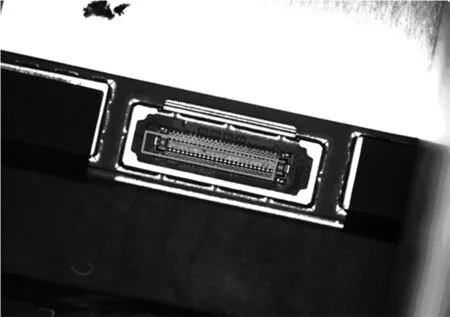

經模型(1)處理后的灰度圖像,見圖2,其工件目標帶有明顯的旋轉角度。

圖2 灰度化工件圖像

隨后,采用Canny邊緣檢測處理灰度圖像。首先,進行二維高斯濾波去噪:

(2)

式中K為高斯濾波,δ為高斯核。

完成濾波后,用X、Y方向Canny算子進行一階有限差分處理,求灰度值梯度。其中X與Y方向的Canny算子為:

(3)

(4)

計算X,Y一階偏導矩陣,如式(5)、(6)所示。

(5)

(6)

式中P為X方向一階偏導矩陣,Q為X方向一階偏導矩陣,f為圖像矩陣。

(7)

θ[i,j]=arctan(Q(i,j)/P(i,j))

(8)

式中M為幅值矩陣,θ為方向矩陣。

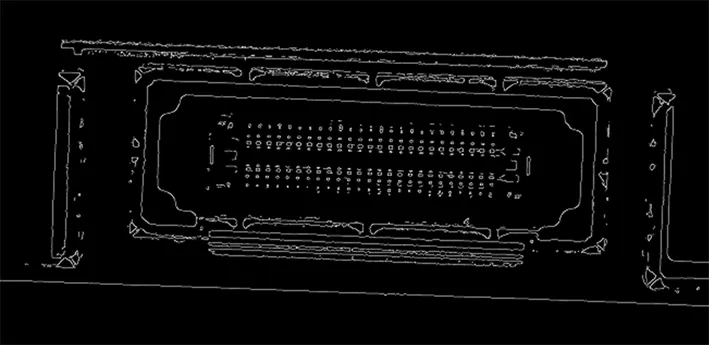

圖3 邊緣檢測圖像

經過邊緣檢測處理得到二值圖輪廓后,再引入霍夫變換[8],查找直線,以計算出直線與水平面的夾角,即工件目標旋轉角度。本文基于OpenCV圖像庫函數cvHoughLines2實現基于霍夫的直線檢測,結果見圖4。從下圖中可知,圖像中的直線北精確檢測出來,所有直線與工件目標水平線平行。

圖4 霍夫直線檢測圖像

得到目標旋轉角度后,再進行圖像幾何變換,即圖像校正。校正模型為:

(9)

式中W0、H0為原圖寬高;Wn、Hn為新圖寬高;a為旋轉角度;x,y為新圖坐標;x0,y0為原圖坐標。

經模型(5)校正后的圖像見圖5。從圖中可知,經過模型(5)處理后,有效消除了旋轉角度,為后續圖像定位提供良好的基礎。

圖5 校正后的工件圖像

部分關鍵代碼:

IplImage*gray=cvCreateImage(cvGetSize(image),8,1);

cvCvtColor(image,gray,CV_BGR2GRAY);

cvCanny(gray,gray,200,250,3);

CvMemStorage*storage=cvCreateMemStorage(0);

CvSeq*Lines=NULL;

int max=0;

double angle=0.0;

for(int i=0;i

{

CvPoint*line=(CvPoint*)cvGetSeqElem(Lines,i);

if((line(0).x-line(1).x)*(line(0).x-line(1).x)+(line(0).y-line(1).y)*(line(0).y-line(1).y)>max){

max=(line(0).x-line(1).x)*(line(0).x-line(1).x)+(line(0).y-line(1).y)*(line(0).y-line(1).y);

angle=atan((double)(line(0).y-line(1).y)/(double)(line(0).x-line(1).x))*180/3.14;}

cvLine(image,line(0),line(1),CV_RGB(255,0,0),3,8);

}

rotateImage(image,image,angle);

void rotateImage(IplImage*img,IplImage*img_rotate,int degree){

CvPoint2D32f center;

center.x=float(img->width/2.0+0.5);

center.y=float(img->height/2.0+0.5);

float m(6);

CvMat M=cvMat(2,3,CV_32F,m);

cv2DRotationMatrix(center,degree,1,&M);

cvWarpAffine(img,img_rotate,&M,CV_INTER_LINEAR+CV_WARP_FILL_OUTLIERS,cvScalar(0));}

1.2目標定位與特征分析

得到校正圖像后,使得目標不帶旋轉角度。接下來,本文利用模板匹配定位(9)的方法查找目標。本文同樣基于OpenCV函數cvMatchTemplate實現,以比較圖像目標與模板圖像的平方差。該值越小,表明檢測到的目標與模板越接近。大致步驟為:

(1)是先截取一個標準工件目標圖像作為模板;

(2)然后在待處理圖像中,以模板圖像大小,進行逐個像素遍歷,計算平方差,并記錄;

(3)遍歷完成后,以平方差最小處的坐標定位工件位置,從而完成目標定位。

為了進一步提高定位精度,本文引入SIFT特征描述算子[10],確認目標是否準確。SIFT特征描述算子具有方向、大小、對比度無關性,即不敏感性。基于多維空間變換下的高斯濾波[11],分別提取模板圖像與檢測目標的SIFT特征描述算子,以計算歐式距離,取相似度最高處坐標為檢測定位結果。SIFT特征描述算子由位置特征因子、方向特征因子組成:

m(x,y)=

(10)

(11)

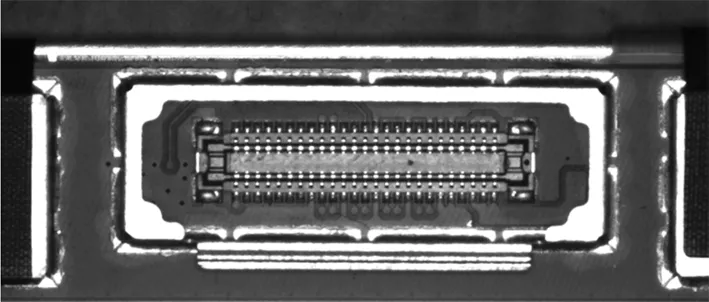

其中,m為位置特征因子;θ為方向特征因子。最后的定位質量見圖6。依圖可知,精確定位出了圖像中間的矩形工件目標。

圖6 定位圖像

部分關鍵代碼:

IplImage*src2,*temp1,*ftmp,*ROI;

src2=cvCreateImage(cvGetSize(image),8,3);

cvCopy(image,src2,NULL);

cvResetImageROI(image);

temp1=cvLoadImage("D:match.bmp");

int iwidth=src2->width-temp1->width+1;

int iheight=src2->height-temp1->height+1;

ftmp=cvCreateImage(cvSize(iwidth,iheight),32,1);

double min_val;

double max_val;

CvPoint min_loc;

CvPoint max_loc;

cvMatchTemplate(src2,temp1,ftmp,0);

cvMinMaxLoc(ftmp,&min_val,&max_val,&min_loc,&max_loc,NULL);

cvSetImageROI(image,cvRect(image->width/8+min_loc.x,image->height/8+min_loc.y,temp1->width,temp1->height));

ROI=cvCreateImage(cvGetSize(image),8,3);

cvCopy(image,ROI,NULL);

cvResetImageROI(image);

m_CvvImage.CopyOf(image,1);

m_CvvImage.DrawToHDC(hDC,&rect);

2實驗與討論

為了直觀體現本文算法的旋轉工件定位效果,在VS2013平臺上基于C++語言編程實現。仿真條件為Windows7系統。部分關鍵實驗參數:Canny高閾值為200,低閾值為50,霍夫線段長為200。同時,為了體現所提技術的先進性,將當前定位性能較好地算法視為對照組:文獻[5]與文獻[7]。

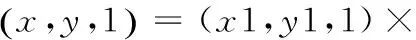

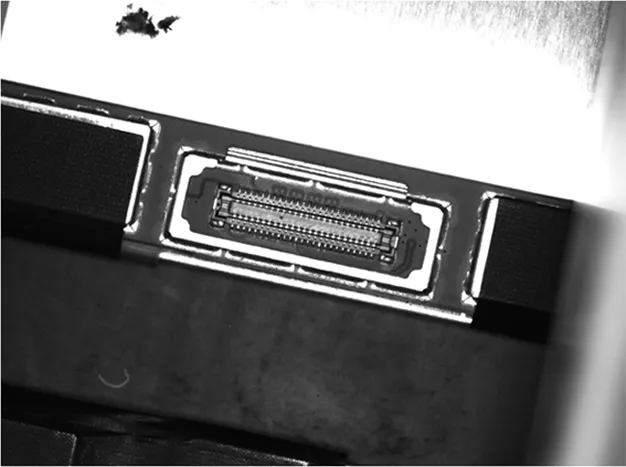

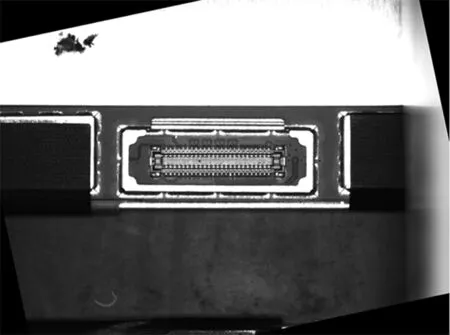

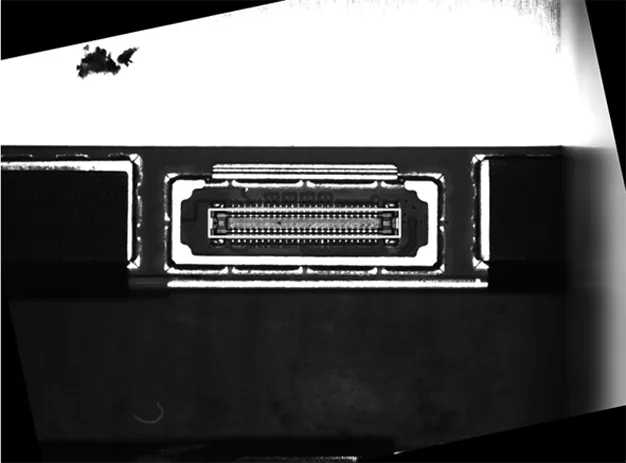

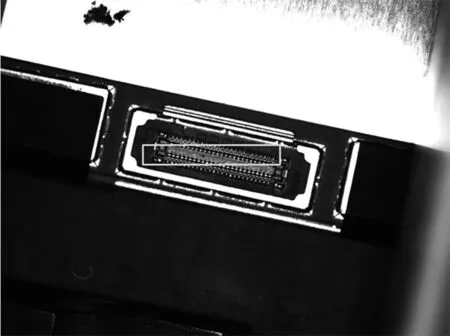

取一張旋轉角度較明顯的工件圖像,見圖7。再利用所提算法與對照組技術對其完成定位,結果見圖8~圖11。依圖可知,本文算法消除了旋轉角度,見圖8,精確定位出了目標,見圖9;文獻[7]雖然能識別目標,但其定位精度不高,沒有準確識別目標位置,存在誤差,見圖11。而文獻[5]的精度最差,定位失敗,無法精確識別目標,見圖10。原因是本文算法對旋轉工件進行了幾何變換校正,有效消除角度,并在模板匹配定位中引入SIFT特征描述子,優化定位結果。而文獻[7]算法是通過雙圓定位,在確定其圓半徑與雙圓位置時,丟失了諸多細節特征,使其精度不高。而文獻[5]算法沒有對旋轉工件完成校正,使其定位失敗。

圖7 具有旋轉角度的工件圖像

圖8 本文算法的校正圖像

圖9 本文算法的定位結果

圖10 文獻[5]的定位結果

圖11 文獻[7]的定位效果

為了比較兩種算法的效率,挑選了100圖像進行處理,由于本文先校正后定位,只需一次圖像遍歷即可完成定位搜索,而文獻[5]采用較多角度的模板圖像,故必須逐一模板進行遍歷,文獻[7]需要對目標模板的全局最優窮搜索,其復雜度仍然較高。故對照組的運算效率遠遠不如本文算法。最終統計以時間為標準,本文算法消耗時間為26s;而文獻[7]、文獻[5]的算法消耗時間分別為66s、149s。

3結論

為了解決工件旋轉目標定位的精度與效率問題,本文提出并實現了一個Canny檢測與SIFT特征的旋轉工件目標識別算法。本文算法徹底避開了當前的定位思想:先定位后校正分析的方式。而所提技術是先測量旋轉角度并校正圖像,后定位分析的方式,不但提高了精度,也改善了效率。實驗驗證結果表明:在面對帶有旋轉角度工件定位時,本文算法擁有更好的自適應性,且具有更高的定位精度與效率。

[參考文獻]

[1] 沈霞.工件裝配基準端的形狀識別研究[J].現代制造工程,2015,37(2):117-120.

[2] Trinidad Pérez-Palacios,Daniel Caballero,Andrés Caro.Applying data mining and Computer Vision Techniques to MRI to estimate quality traits in Iberian hams[J].Journal of Food Engineering, 2014,131(7);82-88.

[3] 張亞榮,裴志利.OpenCV耦合三目視覺的標準件目標定位研究與應用[J].組合機床與自動化加工技術,2015(1):67-70.

[4] 張智豐,張亞榮,裴志利.OpenCV 耦合人機交互的手機表面目標檢測定位研究[J].組合機床與自動化加工技術,2015(3):67-70.

[5] 楊萌.基于機器視覺的工件特征識別與分類方法研究[J].無線互聯科技,2014,23(17):96-99.

[6] 趙君愛.工件表面微小缺陷的檢測與識別方法[J].東南大學學報(自然科學版),2014,73(2):371-376.

[7] 余旺盛,侯志強,田孝華.基于旋轉不變直方圖的快速匹配窮搜索[J].電子學報,2012,40(11):2177-2182.

[8] 魏弦.基于3D視覺識別的工件姿態研究[J].煤礦機械,2013,13(21):31-36.

[9] Jisung Yoo,Sung Soo Hwang, Seong Dae Kim.Scale-Invariant Template Matching using Histogram of Dominant Gradients[J].Pattern Recognition,2014,47(9):3006-3018.

[10] Jing-neng Liu,Gui-hua Zeng.Improved global context descriptor for describing interest regions[J].Journal of Shanghai Jiaotong University (Science), 2012,17(2):147-152.

[11] Roaldje Nadjiasngar,Michael Inggs.Gauss-Newton filtering incorporating Levenberg-Marquardt methods for tracking[J].Digital Signal Processing,2013,23(5):1662-1667.

(編輯趙蓉)

The Research and Application on the Rotary Workpiece Recognition Based on Canny Detect and SIFT Features

HU Ming-xing1,WANG Xiao-lan2

(1.Wuhan Media and Communications College of Huazhong Normal University, Wuhan 430205,China;2.College of Computer Science and Technology,Huazhong University of Science and Technology,Wuhan 430205,China)

Abstract:Industry in the field of vision,it is necessary to identify all kinds of artifacts with rotation Angle,and at present most there is larger error recognition algorithm.With rotation Angle in order to improve the recognition rate of work piece,this paper puts forward a set of based on hough transform and the rotation of the SIFT features of target recognition system, and the program implementation.First using Canny edge detection and Hough straight line detection, the gray image processing, calculation work a rotation Angle.Then based on the geometric transform correction work piece Angle,and USES the template matching positioning the work piece in the image.Finally respectively extracted template SIFT features of work piece and to identify the artifacts,calculate the Euclidean distance,similarity measure,complete work piece target recognition.Verified by the experiment,this article artifacts the accuracy and robustness of target recognition algorithm is superior to the common algorithm,and meet the requirements of practical engineering.

Key words:hough transform; geometric transformation; SIFT; template matching; target recognition

文章編號:1001-2265(2016)06-0035-04

DOI:10.13462/j.cnki.mmtamt.2016.06.009

收稿日期:2015-10-21

*基金項目:國家自然科學基金項目(60673010);湖北省教育廳項目(D201118007)

作者簡介:胡明星(1980—),女,武漢人,華中師范大學武漢傳媒學院講師,碩士,研究方向為計算機應用、目標識別,(E-mail)humxing02580@sina.com。

中圖分類號:TH161;TG506

文獻標識碼:A