基于深度卷積網絡的SAR圖像目標檢測識別

李君寶,楊文慧,許劍清,彭 宇

(哈爾濱工業大學自動化測試與控制系, 哈爾濱 150001)

基于深度卷積網絡的SAR圖像目標檢測識別

李君寶,楊文慧,許劍清,彭 宇

(哈爾濱工業大學自動化測試與控制系, 哈爾濱 150001)

在SAR圖像解譯應用領域,目標的自動檢測與識別一直是該領域的研究重點和熱點,也是該領域的研究難點。針對SAR圖像的目標檢測與識別方法一般由濾波、分割、特征提取和目標識別等多個相互獨立的步驟組成。復雜的流程不僅限制了SAR圖像目標檢測識別的效率,多步驟處理也使模型的整體優化難以進行,進而制約了目標檢測識別的精度。采用近幾年在計算機視覺領域表現突出的深度學習方法來處理SAR圖像的目標檢測識別問題,通過使用CNN、Fast RCNN以及Faster RCNN等模型對MSTAR SAR公開數據集進行目標識別及目標檢測實驗,驗證了卷積神經網絡在SAR圖像目標識別領域的有效性及高效性,為后續該領域的進一步研究應用奠定了基礎。

SAR;目標檢測識別;CNN;Fast RCNN; Faster RCNN

0 引言

近年來,合成孔徑雷達(Synthetic Aperture Radar,SAR)在軍事及民用領域的廣泛應用使得對高性能的SAR圖像處理及解譯技術的需要更加迫切[1],其中SAR圖像的自動目標識別技術是眾多技術中的關鍵,也是科研攻堅的難點。SAR圖像與普通光學圖像在成像機理、幾何特征、輻射特征等方面有較大的不同。SAR所成圖像對地物回波的強弱不敏感,層次感較差;雷達波反射的不均勻造成圖像的分辨率較低,目標邊緣模糊;此外,SAR圖像中噪聲較多,對目標檢測的影響較大。鑒于SAR圖像的上述特點,通常來說,SAR圖像的自動目標識別一般由圖像濾波預處理、提取感興趣區域、特征提取及目標識別等步驟組成。在上述各步驟中,特征提取是重中之重,能否提取到具有較高識別力特征是后續整個識別過程的關鍵。一般來說,SAR圖像的特征提取由主成分分析及其改進算法等機器學習方法實現[2]。

在傳統的機器學習算法中,特征的提取規則往往是由人工設計的,或者當數據量較大時由計算機總結出來。實際應用中,當數據量過大且數據較復雜時,這種方式提取到的特征往往并不具有代表性,無法表示不同類別數據間的獨特性,因此也就限制了識別精度。相較于傳統的機器學習算法,深度學習在特征提取方面具有無可比擬的優越性。深層網絡結構通過逐層的非線性變換,能夠實現復雜函數的逼近,由低層到高層,特征的表示越來越抽象,越能對原始數據進行更本質地刻畫。優秀的特征自學習能力使深度學習受到了學術界及工業界的廣泛關注,在短短不到10年的時間里,深度神經網絡已在圖像、語音、自然語言處理等方面顯示出了優越的性能,引發了諸多領域的革命性變革。在圖像識別及目標檢測領域,卷積神經網絡(Convolutional Neural Network,CNN)表現出色,在世界各大計算機視覺挑戰賽中取得了優異的成績。

2006年,Geoffrey Hinton在科學雜志上發表的一篇論文給出了訓練深度神經網絡的一種可行性解決方案,由此開啟了深度學習的熱潮[3]。在短短幾年時間里,無論是深度網絡的架構還是深度網絡在人工智能(語音識別、圖像識別等)領域的應用都取得了突破性的進展。2012年,Hinton領導的研究小組在ImageNet[4]圖像分類比賽中拔得頭籌。在這個包含1000類圖像的分類挑戰中,該小組的深度卷積網絡模型的分類精度較之傳統圖像識別方法超出10%之多[5]。Hinton小組的成功是計算機視覺領域里程碑式的一步。自2012年之后,各挑戰小組紛紛采用深度卷積神經網絡來處理圖像識別及目標檢測問題,在此過程中,卷積神經網絡的架構不斷得到改進,分類精度也在逐步提高。

本文將卷積神經網絡應用到SAR圖像的目標檢測識別任務中,針對MSTAR SAR公開數據集,使用CNN網絡進行了目標識別實驗,在此基礎上,分別使用RCNN網絡的擴展模型Fast RCNN和Faster RCNN進行了SAR圖像目標檢測實驗。根據實驗結果,分析了卷積神經網絡應用于SAR圖像目標檢測識別的可行性,為后續該領域的相關研究提供了思路。

1 卷積神經網絡(CNN)

卷積神經網絡由Yann LeCun發明并首次應用于手寫數字的識別[6],在該項任務中,CNN在20世紀90年代就達到了商用的程度。近幾年,在計算機視覺領域,CNN也發揮了出色的性能,這主要得益于其適用于圖像數據的特殊網絡結構。在處理圖像數據時,通常將圖像表示為一維的像素向量,以手寫數字識別為例,假設原始圖像的大小為32×32,圖1所示為使用傳統神經網絡處理時的示意圖。

圖1 普通神經網絡用于手寫數字識別Fig.1 Ordinary neural network for handwritten digit recognition

如圖1所示,網絡輸入為32×32的一維像素向量,輸出為從0到9共10類數字編號,中間隱含層的層數和每層的節點數可調整,神經網絡各個網絡層的神經元相互之間是全連接的。使用這種全連接網絡來處理手寫數字識別問題雖然可行但識別效果較差,主要原因在于對圖像數據來說,圖像的相鄰像素之間是存在相關關系的,而這種全連接網絡的處理方式無法捕捉像素之間的空間關系,也就丟失了圖像中隱含的很重要的一部分特征。其次,同一類目標的大小、形狀以及紋理信息在不同樣本中表現不同,而這種普通的全連接網絡對目標的形體變化或圖像的場景變化不具備魯棒性。

與傳統的神經網絡結構不同,卷積神經網絡在處理圖像數據方面具有獨特的優勢,圖2所示為Yann LeCun發明的用于手寫數字識別的卷積神經網絡結構[6]示意圖。如圖2所示,卷積神經網絡一般由卷積層、下采樣層和全連接層組成。

圖2 卷積神經網絡用于手寫數字識別Fig.2 Convolutional neural network for handwritten digit recognition

卷積神經網絡的輸入為原始圖像,卷積層的卷積核以一定的大小和步幅對原始圖像進行卷積運算得到特征圖,下采樣層對特征圖進行采樣處理,抽取特征圖一定區域內的最大值或平均值,經過多層卷積和下采樣處理后,由全連接層整合特征并交由分類器進行分類處理。相較于傳統的神經網絡,卷積神經網絡具有以下幾方面特點:

1)局部感知:針對圖像數據像素的局部聯系較為緊密的特點,卷積神經網絡的卷積層設置成局部連接的形式,如圖3中右半部分所示,卷積核模擬生物的視覺感受野,每一次卷積只提取圖像固定大小區域內的局部信息;

2)權值共享:局部感知使每一次卷積只提取到圖像局部區域內的信息,因此,要想提取整幅圖像的某類特征需要該類卷積核按照一定的步幅對整幅圖像中所有局部區域進行特征提取,在整個過程中卷積核進行卷積計算時的權值系數不會因為這些區域在圖像中的位置不同而發生變化,這是因為特征的提取方式與提取位置無關;

3)多核卷積:每一種卷積核只能提取到圖像的某一類特征,因此,需要在卷積層設置多種卷積核,從而提取到更加全面的圖像特征信息,如圖3中局部連接部分所示,不同的顏色代表不同種類的卷積核,分別提取圖像的不同特征;

圖3 局部感知示意圖Fig.3 Local sensing

4)下采樣:在某些卷積層后通常會添加一個下采樣層,抽取卷積得到的特征圖中一定范圍內的局部平均值或最大值,這樣既降低了數據量,也提升了網絡對輸入圖像中目標形變和場景變化的魯棒性;

5)多層卷積:在一定范圍內,網絡層數越高,學習到的特征越抽象,越能表示圖像的全局化信息,但在全連接網絡中,網絡層數的加深也帶來了參數數量的指數型增長,這使得網絡的學習過程非常困難,而在卷積神經網絡中,得益于權值共享,深層網絡的優勢得到發揮,能夠學習到更具辨識力的抽象特征。

綜上所述,卷積神經網絡的網絡結構非常適用于圖像數據的識別處理,自2012年卷積神經網絡初次應用于ImageNet挑戰賽以來,其出色的性能得到了學術界和工業界廣泛的關注及認可,不斷被應用于計算機視覺、語音識別等人工智能領域,在此過程中,卷積神經網絡的架構不斷得到改進,其性能也在逐步提高。

2 CNN及RCNN擴展模型

2.1 CNN模型

本文用于SAR圖像目標識別的卷積神經網絡參考AlexNet[5]模型,該模型來源于ImageNet挑戰賽,由多倫多大學的Alex Krizhevsky等設計實現。2012年,AlexNet模型在圖像分類任務中的首次應用便達到了85%的準確率。ImageNet數據集中包含1000類圖像,所以AlexNet模型的輸出層中包含1000個輸出節點。根據本文所用數據集的類別數,將輸出層的輸出節點改為8,網絡的整體架構如圖4所示。

圖4 卷積神經網絡架構Fig.4 Convolutional neural network used in this paper

如圖4所示,模型包含5個卷積層和3個全連接層(包括輸出層),在第1、2、5個卷積計算后添加了下采樣(Max-pooling)操作。網絡的主要執行流程及具體參數信息如下。

1)輸入層:原始圖像,大小為3×224×224;

·卷積操作:96種大小為11×11的卷積核,卷積步幅為4;

2)卷積層1:96個大小為55×55的特征圖;

·下采樣操作:采樣范圍3×3,步幅為2;

·卷積操作:256種大小為5×5的卷積核,卷積步幅為1;

3)卷積層2:256個大小為27×27的特征圖;

·下采樣操作:采樣范圍3×3,步幅為2;

·卷積操作:384種大小為3×3的卷積核,卷積步幅為1;

4)卷積層3:384個大小為13×13的特征圖;

·卷積操作:384種大小為3×3的卷積核,卷積步幅為1;

5)卷積層4:384個大小為13×13的特征圖;

·卷積操作:256種大小為3×3的卷積核,卷積步幅為1;

6)卷積層5:256個大小為13×13的特征圖;

·下采樣操作:采樣范圍3×3,步幅為2;

7)全連接層6:4096個神經元節點;

8)全連接層7:4096個神經元節點;

9)輸出層(全連接層8):8個神經元節點。

2.2 RCNN擴展模型

圖像目標識別的結果給出了圖像中可能存在的目標類別,而目標檢測的結果則進一步明確指出了可能存在的目標類別在圖像中的具體坐標位置。深度學習技術應用于目標檢測領域以來,體系架構不斷發展完善,從RCNN到Faster RCNN,檢測準確率和檢測效率都有了一定提升。目標檢測由目標的定位和識別兩部分組成,目標的識別由卷積神經網絡實現,但對于目標的位置定位來說,有多種實現方式。RCNN(Regions with CNN features)[7]的檢測算法是基于圖像分割方法(如Selective Search[8])來找出一些可能是物體的區域;再把這些區域的尺寸縮放成卷積神經網絡的輸入尺寸,由卷積神經網絡的識別結果判斷該區域到底是不是物體,是哪個物體;最后對是物體的區域位置進行進一步的回歸微調,使得目標的位置定位更加準確。RCNN雖然能夠達到目標檢測的目的,但是眾多的可能區域都要經過卷積神經網絡進行類別劃分,如此大的計算量嚴重限制了目標檢測的效率。此外,RCNN的整個檢測識別流程過于復雜,很難進行整體優化。

RCNN的擴展模型Fast RCNN和Faster RCNN對RCNN的結構進行了優化改進,大幅度提高了目標檢測效率。本文選取了MSTAR SAR數據集中的一類軍事目標圖像2S1,使用標注工具創建目標檢測數據集,分別訓練了Fast RCNN和Faster RCNN兩種目標檢測模型,驗證兩種模型針對SAR圖像數據的有效性。

Fast RCNN[9]依然使用圖像分割方法(Selective Search)提取感興趣區域(Region of Interesting,RoI),不過與RCNN不同的是,Fast RCNN不再單獨把每個RoI區域輸入卷積神經網絡,而是將原始圖像輸入卷積神經網絡,只進行一次特征提取,從而有效地提高了計算效率,Fast RCNN的網絡結構如圖5所示。網絡的輸入為原始圖像和RoI的坐標,原始圖像經過多層卷積后得到最終的特征圖,根據網絡的計算規則將RoI的坐標映射到特征圖上,得到卷積后的RoI區域,如圖5中特征圖內的紅色框所示。由于每個RoI區域大小不一,而神經網絡全連接層要求固定大小的輸入,因此,坐標映射之后將RoI采樣到固定尺度(6×6)。之后,通過全連接層將RoI連接成特征向量,交由分類器進行類別劃分。由于圖像分割方法給出的RoI的位置坐標與目標的真實坐標之間并不完全重合,所以當分類器判定RoI內包含目標時,還需進一步對RoI的坐標進行微調,使其更加接近目標的真實位置坐標。如圖5所示,Fast RCNN架構將輸出層分成了兩部分,把目標分類和坐標回歸的訓練聯合在了一起,對檢測識別流程進行了整合。

圖5 Fast RCNN結構示意圖Fig.5 Schematic diagram of Fast RCNN

Faster RCNN[10]的基本結構仍然是卷積神經網絡,但是它省去了圖像分割方法提取圖像內目標可能區域的步驟,通過在卷積神經網絡最后一層特征圖后添加一個叫做RPN(Region Proposal Network)的網絡來實現該部分功能,RPN結構如圖6所示。

圖6 RPN結構圖Fig.6 Diagram of Region Proposal Network

RPN網絡以特征圖上的每個點為中心,使用不同面積和長寬比的滑動窗口來采集特征圖特定區域內的特征。Faster RCNN預設了9種滑動窗口,分別對應三種窗口面積1282、2562、5122和三種窗口長寬比1∶1、1∶2、2∶1的自由組合。為了解決網絡的固定輸入問題,將不同類型的窗口采集到的特征降維到固定維度。根據降維后的特征,分類層給出滑動窗口內包含目標的得分,得分高的窗口作為正樣本,得分低的就認為沒有物體,會被過濾掉。當分類層給出的結果認為窗口內有目標時,需要對目標的位置進行進一步的回歸校正。此時,將特征圖窗口內的區域映射回輸入圖像,如果輸入圖像內對應的區域與圖像中目標的真實區域的重疊率大于某一設定值(預設值為0.7)時,則該區域的標簽為1;若重疊率小于另一設定值(預設值為0.3)時,則該區域的標簽為0;介于兩個設定值之間的區域不參與訓練。對于標簽為1的區域,尋找映射回輸入圖像的坐標與圖像中真實的目標坐標之間的映射關系,完成回歸定位過程。

Faster RCNN的整體模型結構如圖7所示,通過調整網絡結構,經過分階段的訓練,Faster RCNN把整個目標檢測識別流程全部整合到了神經網絡中。模型的輸入為原始圖像,經過多層卷積得到特征圖后,由RPN網絡和全連接網絡分別完成目標的檢測和識別功能。模型的訓練過程分為4步:

1)使用預訓練的CNN模型初始化網絡參數,訓練RPN網絡;

2)使用第一步中產生的RoI區域訓練Fast RCNN分類網絡;

3)固定卷積層參數,調整RPN參數;

4)固定卷積層參數,調整全連接層參數。

圖7 Faster RCNN結構示意圖Fig.7 Schematic diagram of Faster RCNN

3 SAR圖像目標識別及目標檢測實驗結果

3.1 目標識別實驗結果

本實驗在MSTAR數據庫上進行,MSTAR SAR是美國國防高級研究計劃局和空間實驗室的MSTAR項目提供的實測SAR地面靜止軍用目標數據集,目前國內外對SAR圖像目標識別進行的研究也大多以該數據集作為實驗數據。該數據集內的圖像由X波段、HH極化方式、0.3m×0.3m高分辨率聚束式合成孔徑雷達分別在1996年和1997年采集得到。經過前期處理,從原始SAR圖像數據中提取出像素大小約為158×158的目標切片圖像,這些目標切片圖像數據大多是不同型號的坦克、裝甲車在0~360°不同方位角下的靜止切片圖像。本文中SAR圖像目標識別實驗所用數據來自該數據集中8類軍事目標圖像,分別為2S1、BRDM_2、BTR60、D7、T62、T72、ZIL131、ZSU_23_4。圖8所示為這些軍事目標的SAR圖像及其對應的真實場景下的可見光圖像。

圖8 8類SAR目標圖像Fig.8 Eight targets of SAR image

本文中SAR圖像目標識別實驗的訓練樣本和驗證樣本是8類軍事目標在俯仰角為15°時的成像數據,測試樣本是各類軍事目標在俯仰角為17°時的成像數據。對于常規方法來說,SAR圖像實現自動目標識別需要經過4個步驟:圖像預處理、特征提取、特征選擇和目標分類,這4個步驟分別需要設計不同的算法來實現。本文利用卷積神經網絡實現SAR圖像的目標識別,無需人為設計上述各步驟,只需將原始圖像去均值處理后縮放到固定大小輸入神經網絡即可,特征提取、特征選擇和目標分類都由卷積神經網絡一次性實現。本文中各類目標實驗數據集的組成及識別結果如表1所示。

表1 實驗數據集組成及識別結果

表1中的識別率是指對測試集樣本的識別準確率。由表1可得,使用8層卷積神經網絡對8類SAR軍事目標圖像的總體識別準確率為99.0%,就每一類的單項識別準確率來說,2S1類目標的準確率最低,BTR60類目標的準確率最高,達到了100%。與常規的SAR圖像目標識別方法相比,使用卷積神經網絡不僅簡化了目標識別流程,大大提高了識別效率,就識別準確率來說也達到了當前最佳水平。

3.2 目標檢測實驗結果

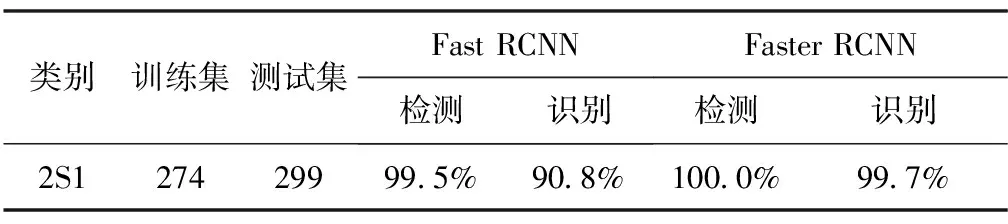

本文選取了MSTAR SAR數據集中的一類軍事目標圖像2S1進行目標檢測實驗,首先需要使用目標標注工具創建目標檢測數據集。實驗數據集構成及實驗結果如表2所示。

表2 數據集構成及實驗結果

由實驗結果可知,目標檢測的準確率過高,這是因為實驗所用數據集中的SAR圖像場景過于單一,所有目標的位置坐標差別不大,網絡存在嚴重的過擬合問題。該問題的解決需要國內外相關研究部門的協助,公開更多場景更加復雜的SAR圖像數據集,以供研究所用。雖然實驗結果缺乏通用性,但對于SAR圖像的自動目標檢測識別領域來說,本文所用的深度學習相關技術是一次有益的嘗試,圖9給出了Fast RCNN和Faster RCNN目標檢測識別的圖形化結果,相較于常規的SAR圖像目標檢測識別方法,本文所用方法簡化了流程的同時也提高了識別準確率。

圖9 實驗結果Fig.9 The results of experiments

4 結論

本文研究了卷積神經網絡在SAR圖像目標檢測識別中的應用,使用卷積神經網絡及其拓展模型對MSTAR SAR圖像數據分別進行了目標識別和目標檢測實驗。實驗結果表明,卷積神經網絡在SAR圖像目標識別方面具有廣闊的應用前景,對于目標檢測任務,卷積神經網絡的兩種擴展模型Fast RCNN和Faster RCNN都能實現比較好的檢測效果。在檢測效率方面,由于整合了整個流程,Faster RCNN模型要遠遠優于Fast RCNN,具體的檢測用時因硬件平臺的不同而有所差異。雖然由于缺乏復雜場景的SAR圖像數據集,本文所用實驗數據過于單一,實驗結果缺乏一定的通用性,但是本文內容為卷積神經網絡在SAR圖像目標檢測識別領域的應用提供了思路,為后續該方向的進一步研究奠定了基礎。

[1] 楊桄, 陳克雄, 周脈魚, 等. SAR圖像中目標的檢測和識別研究進展[J]. 地球物理學進展, 2007, 22(2):617-621.

[2] 韓萍, 吳仁彪, 王兆華, 等. 基于KPCA準則的SAR目標特征提取與識別[J]. 電子與信息學報, 2003, 25(10):1297-1301.

[3] Hinton G E , Salakhutdinov R R . Reducing the dimensionality of data with neural networks [J]. Science (New York, N.Y.), 2006, 313 (5786) : 504-507.

[4] Deng J, Dong W, Socher R, et al. Imagenet: A large-scale hierarchical image database[C]//Computer Vision and Pattern Recognition, 2009. CVPR 2009. IEEE Conference on. IEEE, 2009: 248-255.

[5] Krizhevsky A, Sutskever I, Hinton G E. Imagenet classification with deep convolutional neural networks[C]//Advances in Neural Information Processing Systems, 2012: 1097-1105.

[6] Lécun Y, Bottou L, Bengio Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11):2278-2324.

[7] Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). IEEE, 2014:580-587.

[8] Uijlings J R R, Sande K E, Gevers T, et al. Selective search for object recognition[J]. International Journal of Computer Vision, 2013, 104(2):154-171.

[9] Girshick R. Fast R-CNN[C]// IEEE International Conference on Computer Vision. IEEE, 2015:1440-1448.

[10] Ren S, He K, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[C]//Advances in Neural Information Processing Systems, 2015: 91-99.

Deep Convolutional Network Based SAR Image Object Detection and Recognition

LI Jun-bao, YANG Wen-hui, XU Jian-qing, PENG Yu

(Automatic Test and Control Institute, Harbin Institute of Technology, Harbin 150001, China)

Automatic target detection and recognition has been the focus in SAR image interpretation field. Generally, the target detection and recognition method of SAR image is divide into independent 4 steps, filtering, segmentation, feature extraction and target recognition. Complex process limits the efficiency of SAR image target detection and recognition. Too many steps make it difficult to optimize the whole model, so the accuracy of method is restricted. In recent years, deep learning has been the famous method in many important computer vision challenges. Deep learning has led to a revolutionary change in the field of computer vision. In this paper, we apply deep learning to SAR image automatic target detection and recognition task. And we verify the feasibility and efficiency of deep learning method through experiments on MSTAR SAR image sets.

SAR; Target detection and recognition; CNN; Fast RCNN; Faster RCNN

10.19306/j.cnki.2095-8110.2017.01.011

2016-04-24;

2016-07-16。

教育部新世紀人才計劃(NCET-13-0168);國家自然基金(61371178)。

李君寶(1978-),男,博士,副教授,主要從事圖像處理及模式識別方面的研究。E-mail:lijunbao@hit.edu.cn

V448.2

A

2095-8110(2017)01-0060-07