基于語譜圖提取瓶頸特征的情感識別算法研究

李 姍,徐瓏婷

(南京郵電大學 通信與信息工程學院,江蘇 南京 210003)

基于語譜圖提取瓶頸特征的情感識別算法研究

李 姍,徐瓏婷

(南京郵電大學 通信與信息工程學院,江蘇 南京 210003)

傳統的譜特征(諸如MFCC)來源于對語譜圖特征的再加工提取,但存在著因分幀處理引起相鄰幀譜特征之間相關性被忽略的問題和所提取的譜特征與目標標簽不相關的問題。這導致了從語譜圖中提取的特征丟失了很多有用信息。為此,提出了獲取深度譜特征(Deep Spectral Feature,DSF)的算法。DSF的特征是把直接從語譜圖中提取的譜特征用于深度置信網絡(DBN)訓練,進而從隱層節點數較少的瓶頸層提取到瓶頸特征。為了解決傳統譜特征的第一種缺陷,采用相鄰多幀語音信號中提取的特征參數構成DSF特征。而深度置信網絡所具有的強大自學習能力以及與目標標簽密切相關的性能,使得經過微調的DSF特征能夠解決傳統譜特征的第二個缺陷。大量的仿真實驗結果表明,相對于傳統MFCC特征,經過微調的DSF特征在語音情感識別領域的識別率比傳統MFCC高3.97%。

瓶頸特征;深度置信網絡;譜特征;語譜圖;情感識別

1 概 述

在現今的大數據時代背景下,機器學習已成為人工智能領域中一個十分重要的研究方向。如今,越來越多的研究者考慮運用機器學習的相關知識來實現語音信息識別。實際上,提取合適而準確的語音特征參數是語音信息識別研究中的關鍵步驟。但是,語音特征參數的提取有兩個難點:無法找到與識別目標明確相關的特征;語音信息復雜多變,過分依賴于環境、說話人、情感等因素。

目前,用于語音信息識別的特征參數主要分為三類:韻律特征、音質特征以及譜特征[1-2]。其中,譜特征的研究受到了廣泛關注。并且梅爾頻率倒譜系數(MFCC)在相當長的一段時間內,在語音信息識別領域占據主導地位。Sun Yaxin[3]指出了MFCC譜特征存在的兩個缺陷:忽略了每個語音幀內及相鄰幀之間的系數關系;忽略了語音標簽信息,沒有提取到與目標標簽相關的特征。因此,從語譜圖中提取的MFCC特征會導致有用信息的丟失。文獻[4]詳細介紹了采用由深度置信網絡產生的堆疊瓶頸特征[5-6]作為語音識別中分類模型的輸入,能夠提高系統識別率。可見,BN特征能充分挖掘特征參數相鄰幀之間的相關性,有助于系統性能的改善。Liu Yuan等[7]運用深度學習強大的自學習能力,提高了說話人確認的識別率。深度置信網絡[8]是深度學習的一種結構,采用了預訓練以及微調兩種方式改善參數收斂效果,使得特征參數與目標標簽相匹配。它具有非常強大的自學習能力,能夠獲得與目標密切相關的區分性特征,濾除無關干擾,從而解決了傳統譜特征的第二個缺陷。

情感識別[9]是通過計算機處理并分析獲取的語音信號,進而判斷出語音的情感類型的技術,它能使計算機有更加擬人化的能力。Zhang W等[10]研究了運用DBN網絡進行性別相關的和無關的情感分類,說明了基于DBN的方法具有情感識別的優秀潛能。王一等[11-13]提出了魯棒性較強的、層次稀疏的BN特征提取方法,分別用于語音識別和語種識別,均取得了不錯的研究進展。

為了挖掘相鄰幀之間的相關信息以及結合監督訓練的優勢,首次提出了采用深度置信網絡直接從語譜圖中提取瓶頸特征的算法,并將該特征稱作深度譜特征(DSF)。其不同于目前用MFCC特征作為訓練DBN網絡的輸入參數,直接把語譜圖作為輸入特征的方法能夠顯著減少有用信息的缺失,進而提高識別率。為了驗證目標標簽與語音樣本之間的相關性是否有助于提高系統性能,仿真實驗比較了未經微調的目標無關的DSF特征和微調后的目標有關的DSF特征。結果表明,該算法能利用標簽信息和相鄰幀之間的相關信息,有效提高系統識別率,解決傳統譜特征的兩個缺陷。

2 相關研究

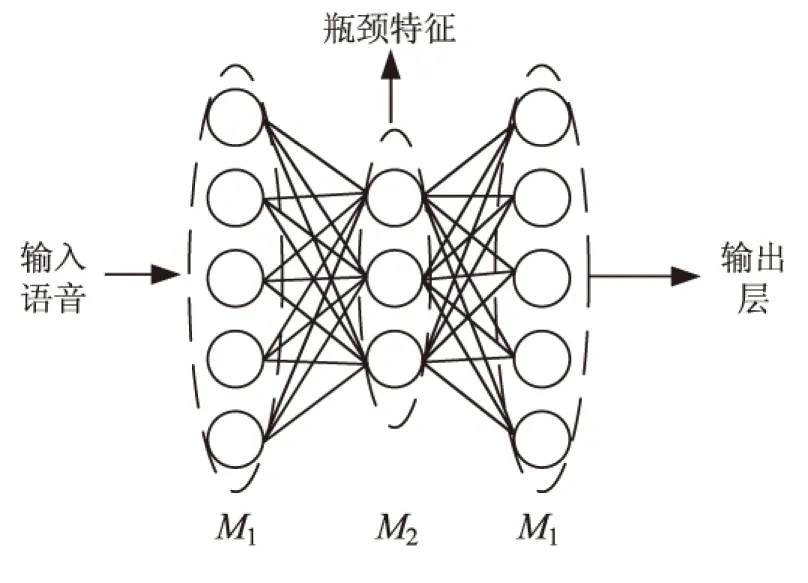

2.1 瓶頸特征

瓶頸特征產生于多層感知器(MLP)模型,最早由Greal[14]提出。當MLP中間層的隱節點數相對于其他隱層較少時,該模型將在該層學習到一個訓練向量的低維表述,即瓶頸特征是一種非線性降維方式。圖1是一個三層MLP提取瓶頸特征的示意圖[15]。

2.2 深度置信網絡

深度學習的預訓練機制有效地改進了神經網絡的收斂效果,為了更好地實現對輸入數據的低維表示,提出使用深度置信網絡來提取瓶頸特征。深度置信網絡是一種能量模型,擁有強大的自學習能力,且可以采用監督訓練提取目標相關特征。

圖1 提取瓶頸特征的結構圖

2.2.1 限制玻爾茲曼機(RBM)

限制玻爾茲曼機[16]要求可見層只和隱含層連接。可見層和隱含層之間的分布滿足指數分布,伯努利和高斯分布是最常用的分布形式。

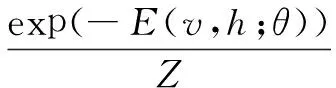

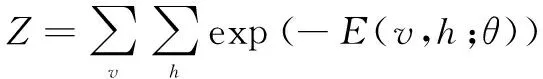

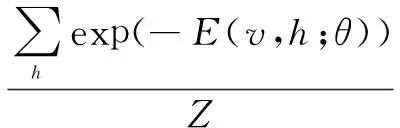

設RBM模型參數為θ,可見層v以及隱含層h,則聯合分布為p(v,h;θ),定義為:

(1)

可見,層向量邊緣概率分布如式(2)所示:

(2)

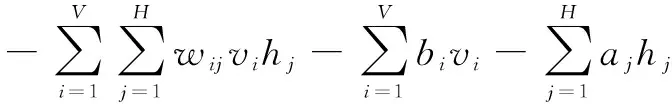

對于伯努利-伯努利分布和高斯-伯努利分布的限制玻爾茲曼機,其能量函數分別如式(3)和式(4)所示[11]:

(3)

(4)

其中,wi,j為可見單元vi以及隱單元hj之間的連接權重;bi和aj為相應的偏置項。

RBM的訓練需要計算條件分布,伯努利-伯努利RBM條件分布如式(5)和式(6)所示:

(5)

(6)

而高斯-伯努利RBM條件分布如式(7)和式(8)所示:

(7)

(8)

其中,σ(x)=1/exp(x)為sigmoid函數。

最大化對數似然函數logp(v;θ)可以優化RBM的參數集,更新式定義為:

Δwij=〈vihj〉data-〈vihj〉model

(9)

其中,〈vihj〉data為訓練樣本中vi和hj發生的概率;〈vihj〉model為該模型中vi和hj發生的概率。由于〈vihj〉model計算困難,常用Gibbs采樣來替代〈vihj〉model[17]。

2.2.2 訓練深度置信網絡

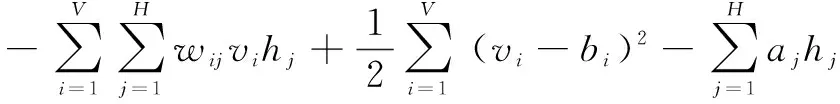

將RBM棧式連接就組成了深度置信網絡,對DBN每一層的RBM網絡逐層訓練,便可以得到預訓練的DBN網絡。預訓練DBN網絡的最后一層RBM輸出到softmax分類器即達到分類的目的。Softmax函數如式(10)所示[8]:

(10)

其中,l=k表示輸入被分為類別k;λik表示最后一層隱單元hi和類別k之間的權重;ak表示相應的偏置;Z(h)表示歸一化項。

通過以上分類方法,采用監督訓練可以對整個預訓練后的網絡進行微調(fine-tune)。即整個網絡結構的訓練分為兩步:先逐層預訓練;再微調整體結構。

3 深度譜特征(DSF)算法

3.1 語譜圖

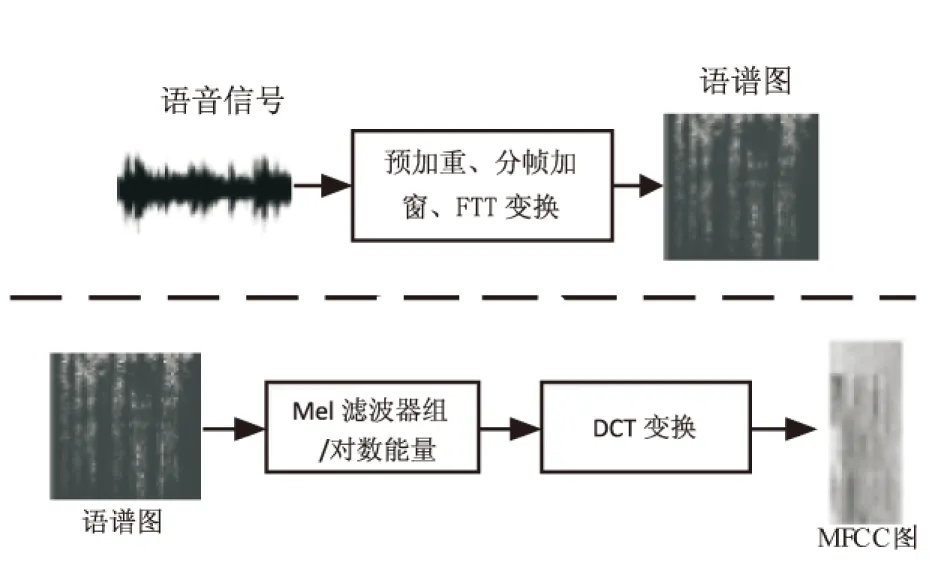

語譜圖是語音能量時頻分布的二維平面圖,橫坐標是時間,縱坐標是頻率,具有連通時頻兩域的特點。而MFCC特征產生于語譜圖,其提取流程為:將每幀的語譜經過Mel頻率濾波器組濾波后,再進行對數能量計算,然后經過DCT變換即可獲得一幀的MFCC,而整幅語譜圖則可獲得一條語音的MFCC系數矩陣。

圖2為語譜圖和MFCC提取流程圖[18],下半部分為基于語譜圖提取MFCC特征參數的流程圖。

圖2 語譜圖和MFCC提取流程圖

由此可見,對語譜圖特征進行再加工提取可獲得傳統的譜特征,這一步會導致部分有用信息的丟失,造成MFCC的兩個缺陷。

3.2 深度譜特征模型

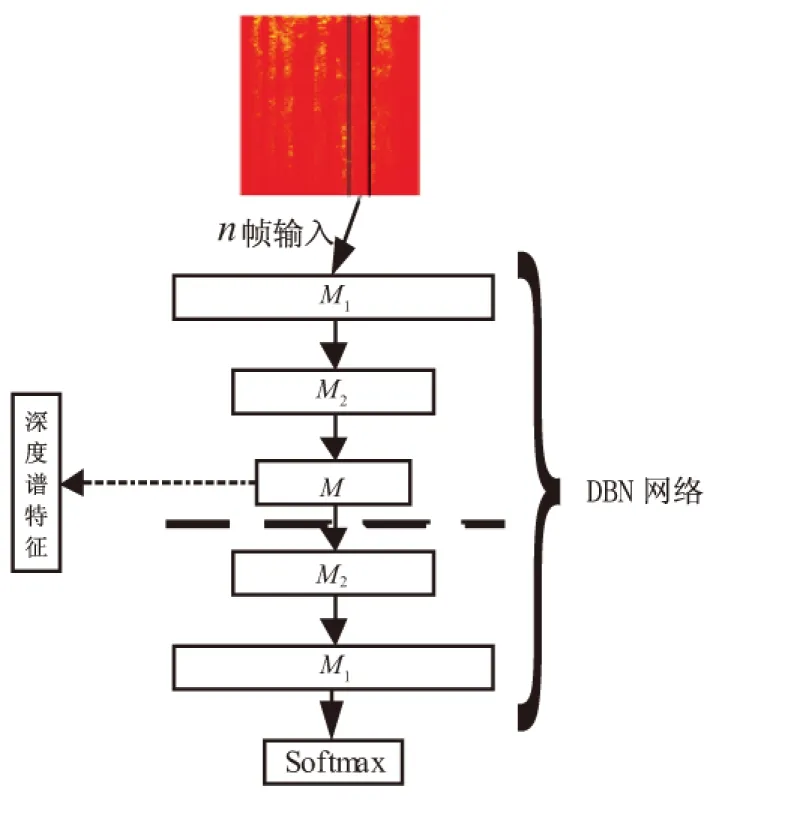

從語譜圖中提取相鄰幀譜特征用于深度置信網絡訓練,進而從隱層節點數最少的瓶頸層獲得瓶頸特征,得到深度譜特征(DSF),DSF特征提取流程見圖3。

圖3 深度譜特征提取模型

另外,DSF特征被分為兩類,分別為未經微調的DSF特征(即第2步中不采用微調步驟)和微調后的DSF特征。下面分別將這兩種特征命名為目標無關DSF特征和目標相關DSF特征。

該模型提取DSF特征算法如下所示:

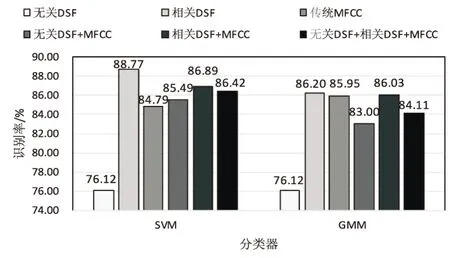

(2)使用分割后數據訓練結構參數為[M1,M2,M,M2,M1]的DBN網絡,滿足M (3)去掉包括分類器在內的下三層網絡,得到瓶頸特征提取結構。 輸出:DSF特征Dtrain和Dtest,其中若第2步有微調,得到目標相關DSF,否則為目標無關DSF。 旨在從語譜圖中提取比傳統譜特征MFCC更有表達力的DSF特征,證明DSF特征能夠克服MFCC特征的兩個缺陷。為此,分別設計了兩組實驗來證明:DSF特征在語音情感識別上比MFCC特征具有更強的區分能力。 4.1 實驗語音庫及實驗設計 為了驗證上述算法的有效性,基于柏林庫(EMO-DB)[19]進行仿真。柏林庫由10個不同的人(5男5女)錄制而成,包含7種不同的情感。挑選其中四種情感,分別是害怕、快樂、平靜以及生氣,共427條語句構成實驗語音庫。 為了保證仿真是性別和說話人無關的,首先對語音庫進行隨機打亂,再采用四折交叉驗證,最后多次實驗求平均。支持向量機(Support Vector Machine,SVM)[16]和高斯混合模型(GMM)[20]是實驗中用到的分類器。 采用三層DBN,隱層節點數為1 288,瓶頸層節點數為36。參數設置[21]依據實驗結果調整得到,其中權重衰減系數0.005,沖量0.9,批大小5,迭代次數50。 4.2 基于DSF特征的情感識別 語音情感識別在人機交互領域發揮著重要作用,其目的是讓計算機像人一樣識別出人類情感,賦予機器更人性化的能力[22]。設計了兩個實驗來證實DSF能解決MFCC的兩個缺陷,提高語音情感識別率。第一個實驗分別比較了目標相關DSF、目標無關DSF、傳統MFCC特征的情感識別率,分別采用線性SVM和32階的GMM分類器,進而驗證了提取DSF特征算法的可行性。另外,實驗也比較了上述兩種特征與MFCC串聯、三種特征串聯組成融合特征的情感識別率。實驗結果如圖4所示。 由圖4可知,目標相關DSF特征能利用標簽相關性和相鄰幀之間的聯系,使SVM系統的平均識別率比目標無關DSF、MFCC特征分別高12.65%、3.97%;GMM分類器趨勢一樣,但是性能提高不明顯。另外,基于SVM的目標無關DSF特征識別結果較差,比傳統MFCC特征的識別率低8.68%,可見依據標簽信息訓練DBN網絡這一步十分關鍵。但是,當把各個特征融合后,發現識別率并沒有比傳統MFCC特征提高太多。可見,融合可以補充一些相關信息,但是也會造成冗余,反而導致識別率下降。 圖4 各種特征的情感識別結果對比 第二個實驗選用目標相關DSF特征作為特征參數,用SVM分類器獲得每種情感識別率的矩陣,實驗結果如圖5所示。 害怕/%快樂/%平靜/%生氣/%害怕/%75.367.2514.492.90快樂/%11.7666.180.0022.06平靜/%2.450.0097.550.00生氣/%1.577.870.0090.55 圖5 目標相關DSF特征的情感識別矩陣 由圖5可知,平均識別率可達88.77%。其中,快樂的識別率最低,因為快樂的發音特性與害怕、生氣都很相似,三者的情感激活度都很高[23],所以僅僅深度譜特征不能很好地區分這三種類別的情感。但是該特征對平靜和生氣的識別性能很好。因為這兩種情感的效價維和激活維差異較大。 為了解決傳統譜特征存在的缺陷,提出了深度譜特征的算法。它把相鄰幀的語譜圖特征串聯起來,再直接用來訓練深度置信網絡,最后從中間的瓶頸層獲得瓶頸特征,即為深度譜特征。實驗結果表明:提出的目標相關DSF特征能充分利用標簽相關性,相對于SVM分類器的MFCC特征,系統平均識別率提高了3.97%。另外,該特征還考慮了相鄰幀間的關系,進一步提高了識別率。今后,還要進一步研究合適的網絡參數設置和網絡結構,比較不同的分類器性能。并且把該DSF特征運用于多維說話人信息識別中。 [1] Kinnunen T,Li H.An overview of text-independent speaker recognition:from features to supervectors[J].Speech Communication,2010,52(1):12-40. [2] Samantaray A K, Mahapatra K,Kabi B, et al.A novel approach of speech emotion recognition with prosody, quality and derived features using SVM classifier for a class of north-eastern languages[C]//2nd international conference on recent trends in information systems.[s.l.]:IEEE,2015:372-377. [3] Sun Y,Wen G,Wang J.Weighted spectral features based on local Hu moments for speech emotion recognition[J].Biomedical Signal Processing and Control,2015,18:80-90. [4] Tuerxun M,Zhang S,Bao Y,et al.Improvements on bottleneck feature for large vocabulary continuous speech recognition[C]//12th international conference on signal processing.[s.l.]:IEEE,2014:516-520. [6] Zhang Y,Chuangsuwanich E,Glass J R.Extracting deep neural network bottleneck features using low-rank matrix factorization[C]//ICASSP.[s.l.]:[s.n.],2014:185-189. [7] Liu Y,Qian Y,Chen N,et al.Deep feature for text-dependent speaker verification[J].Speech Communication,2015,73:1-13. [8] Safari P,Ghahabi O, Hernando J. Feature classification by means of deep belief networks for speaker recognition[C]//23rd European signal processing conference.[s.l.]:IEEE,2015:2117-2121. [9] Pal A,Baskar S.Speech emotion recognition using deep dropout autoencoders[C]//International conference on engineering and technology.[s.l.]:IEEE,2015:1-6. [10] Zhang W,Zhao D,Chen X,et al.Deep learning based emotion recognition from Chinese speech[M]//Inclusive smart cities and digital health.[s.l.]:International Publishing,2016:49-58. [11] 王 一,楊俊安,劉 輝,等.基于層次稀疏 DBN 的瓶頸特征提取方法[J].模式識別與人工智能,2015,28(2):173-180. [12] 李晉徽,楊俊安,王 一.一種新的基于瓶頸深度信念網絡的特征提取方法及其在語種識別中的應用[J].計算機科學,2014,41(3):263-266. [13] 陳 雷,楊俊安,王 一,等.LVCSR系統中一種基于區分性和自適應瓶頸深度置信網絡的特征提取方法[J].信號處理,2015,31(3):290-298. [14] Grézl F,Karafiát M,Kontr S,et al.Probabilistic and bottle-neck features for LVCSR of meetings[C]//Proceedings of the IEEE international conference on acoustics,speech,and signal processing.Honolulu,USA:IEEE,2007:757-760. [15] Gehring J,Miao Y,Metze F,et al.Extracting deep bottleneck features using stacked auto-encoders[C]//IEEE international conference on acoustics, speech and signal processing.[s.l.]:IEEE,2013:3377-3381. [16] 張春霞,姬楠楠,王冠偉.受限波爾茲曼機[J].工程數學學報,2015,32(2):159-173. [17] You Y,Qian Y,He T,et al.An investigation on DNN-derived bottleneck features for GMM-HMM based robust speech recognition[C]//China summit and international conference on signal and information processing.[s.l.]:IEEE,2015:30-34. [18] 陶華偉,査 誠,梁瑞宇,等.面向語音情感識別的語譜圖特征提取算法[J].東南大學學報:自然科學版,2015,45(5):817-821. [19] Burkhardt F,Paeschke A,Rolfes M,et al.A database of German emotional speech[C]//Proceedings of Interspeech.[s.l.]:[s.n.],2005:1517-1520. [20] Anagnostopoulos C N,Iliou T,Giannoukos I.Features and classifiers for emotion recognition from speech: a survey from 2000 to 2011[J].Artificial Intelligence Review,2015,43(2):155-177. [21] Hinton G E.A practical guide to training restricted Boltzmann machines[J].Momentum,2010,9(1):599-616. [22] Mariooryad S,Busso C.Compensating for speaker or lexical variabilities in speech for emotion recognition[J].Speech Communication,2014,57:1-12. [23] Koolagudi S G,Rao K S.Emotion recognition from speech:a review[J].International Journal of Speech Technology,2012,15(2):99-117. Research on Emotion Recognition Algorithm Based on Spectrogram Feature Extraction of Bottleneck Feature LI Shan,XU Long-ting (College of Communication and Information Engineering,Nanjing University of Posts and Telecommunications,Nanjing 210003,China) Traditional spectral features (such as MFCC) can be extracted from spectrogram features.However,the relation between spectral features of adjacent frames has been ignored owing to frames division.What’s worse,the extracted spectral features are uncorrelated with the labels of corresponding targets,which lead to useful feature information lost.Therefore,a new Deep Spectral Feature (DSF) algorithm has been proposed,in which DSF features have been gained by applying spectral feature directly extracted from spectrogram for Deep Belief Network (DBN) and a kind of bottleneck (BN) feature from the bottleneck layer has been obtained with least hidden layer nodes number.To deal with the first drawback,a method is proposed to extract characteristic parameters from adjacent frames that consist of DSF features.What is more,owing to strong self-learning ability and substantial relationship with target labels in deep belief network,the proposed DSF feature can supply a better solution to the second drawback of conventional spectral features.Experimental results show that the accuracy of DSF feature with proper fine-tuning outperforms traditional MFCC about 3.97% in speech emotion recognition. bottleneck feature;deep belief network;spectral feature;spectrogram;emotion recognition 2016-06-18 2016-09-22 網絡出版時間:2017-03-13 國家自然科學基金資助項目(61271335);國家“863”高技術發展計劃項目(2006AA010102) 李 姍(1992-),女,碩士研究生,研究方向為情感識別、多維說話人信息識別技術。 http://kns.cnki.net/kcms/detail/61.1450.tp.20170313.1547.074.html TP301.6 A 1673-629X(2017)05-0082-05 10.3969/j.issn.1673-629X.2017.05.018

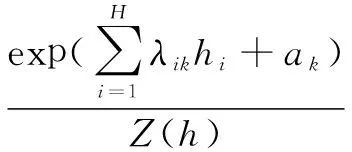

4 實驗結果與分析

5 結束語