一種深度生成模型的超參數自適應優化法

姚誠偉, 陳根才

(浙江大學 計算機科學與技術學院,杭州 310027)

0 引 言

深度生成模型(Deep Generative Model, DGM)[1]作為深度學習模型的重要分支之一,不僅在各類監督學習領域取得優異的效果[2-4],而且在很多非監督學習領域領中有著獨特的優勢,如降維分析[5]、信息檢索[6]、特征提取[7]等。DGM包括兩種經典模型:深度置信網絡(Deep Belief Network, DBN)[7]和深度玻耳茲曼機(Deep Boltzmann Machine, DBM)[8]。該類深度模型的共同特點是它們都由一種稱為受限玻耳茲曼機(Restricted Boltzmann Machine, RBM)[7]的基本構件層層堆疊而構成的,因此DGM也是一種多層圖概率模型。利用這種基于圖概率模型的逐層訓練策略,DGM可以非常好地對大量數據進行非監督方式的多層次特征提取[1],大大提升其在大數據分析和人工智能中應用效果。

盡管DGM在各類機器學習任務中取得極大成功,然而如其他深度模型一樣,在面對實際數據和應用時,DGM的部署和訓練是一件非常困難的事。主要原因是DGM有著眾多的超參數,在利用實際數據對模型進行訓練之前必須為這些超參數設置合適的值,否則在訓練中深度模型的參數很容易崩潰或無法學到有用的特征[9]。這些超參數包括:學習速度、動量系數、參數懲罰系數、丟棄比例、batch的大小,以及定義網絡結構的超參數等等。由于深度模型的訓練需要巨大的計算資源,人工多次嘗試選擇合適的超參數不僅需要豐富的經驗,而且非常費時費力。

為此,近年來面向機器學習的超參數自動優化方法越來越得到學術界的重視。目前,比較主流的方法是基于黑盒的貝葉斯優化方法,其中具有代表性的有基于時序模型的算法配置(Sequential Model-based Algorithm Configuration, SMAC)[10]、Parzen樹估測(Tree Parzen Estimator, TPE)[11]和Spearmint算法[12]。由于這些方法需要重復多次運行被優化模型,以獲取優化所必需的驗證誤差,所以在優化深度模型時它們的效率很低。另一種思路是自適應的優化方法,目前比較主流的方法有AdaGrad[14]、AdaDelta[15]、 RMSProp[16]、Adam[17]等。但這些方法大多只對學習速度進行優化,無法同時綜合優化多個超參數。

本文利用DGM逐層訓練的特點,提出一種以神經元激活的稀疏度(sparsity of Hidden Units, SHU)為目標值,利用高斯過程(Gaussian Process, GP)[18]動態對多個超參數進行同時優化的方法。神經元激活狀態往往被領域專家用于監控DGM的訓練過程是否處于理想狀態。在訓練的中間階段,每一隱藏層的神經元被激活太多或太少都會降低特征的提取效果。因此,本文利用當前迭代時神經元激活狀態,通過比較不同超參數組合下,神經元激活狀態的變化,利用GP預測其中最合適組合,進行下一迭代的訓練。該方法的優勢在于通過自適應的策略同時優化多個超參數,毋需象傳統貝葉斯方法那樣重復訓練整個模型,同時自適應的策略也大大提升DGM的特征提取的性能指標,以及對不同網絡結構的穩定性。

1 深度生成模型

圖1受限玻耳茲曼機(RBM)示意圖

深度生成模型是一種垂直多層的圖概率模型,它的基本構件是RBM[7],如圖1所示,其中雙線圓圈代表輸入神經元,細線圓圈代表隱藏層神經元。RBM最大的特點是各層內部神經元之間沒有鏈接,這大大加快了層與層之間的隨機采樣效率。輸入層可以接受各種類型的數據,包括:二進制、實數和k組(k-array)數據。以二進制為例,假設v∈{0,1}D為輸入層,h∈{0,1}F為隱藏層,則RBM的能量公式定義如下[1]:

E(v,h;θ)=

(1)

式中:W為單元之間的連接參數;a,b為偏離項。為簡化表達,設θ={W,a,b},則模型的聯合概率定義如下[1]:

(2)

(3)

(4)

式中,g(x)=1/(1+e-x)。RBM訓練的目的是獲得優化的參數W,為此,Hinton和他的小組提出了對比散度(Contrastive Divergence)的算法[1]:

ΔW=α(EPdata[vhT]-EPT[vhT])

(5)

式中:α為學習速度,EPdata[·]為數據依賴期望值,EPT是利用Gibbs鏈近似所得的模型依賴期望值。

利用RBM堆疊,根據結構和訓練策略的差異,DGM又分為兩大經典模型:DBN和DBM,如圖2所示。其中,DBN是混合概率圖模型,除了頂層為無向圖以外,其他各層均為有向圖;DBM則是完全無向圖,它們的訓練方法詳見文獻[1]。

圖2深度置信網絡(DBN)與深度玻耳茲曼機(DBM)

圖中hi代表第i層隱藏層神經元所組成的向量;Wi代表各層間的連接參數。

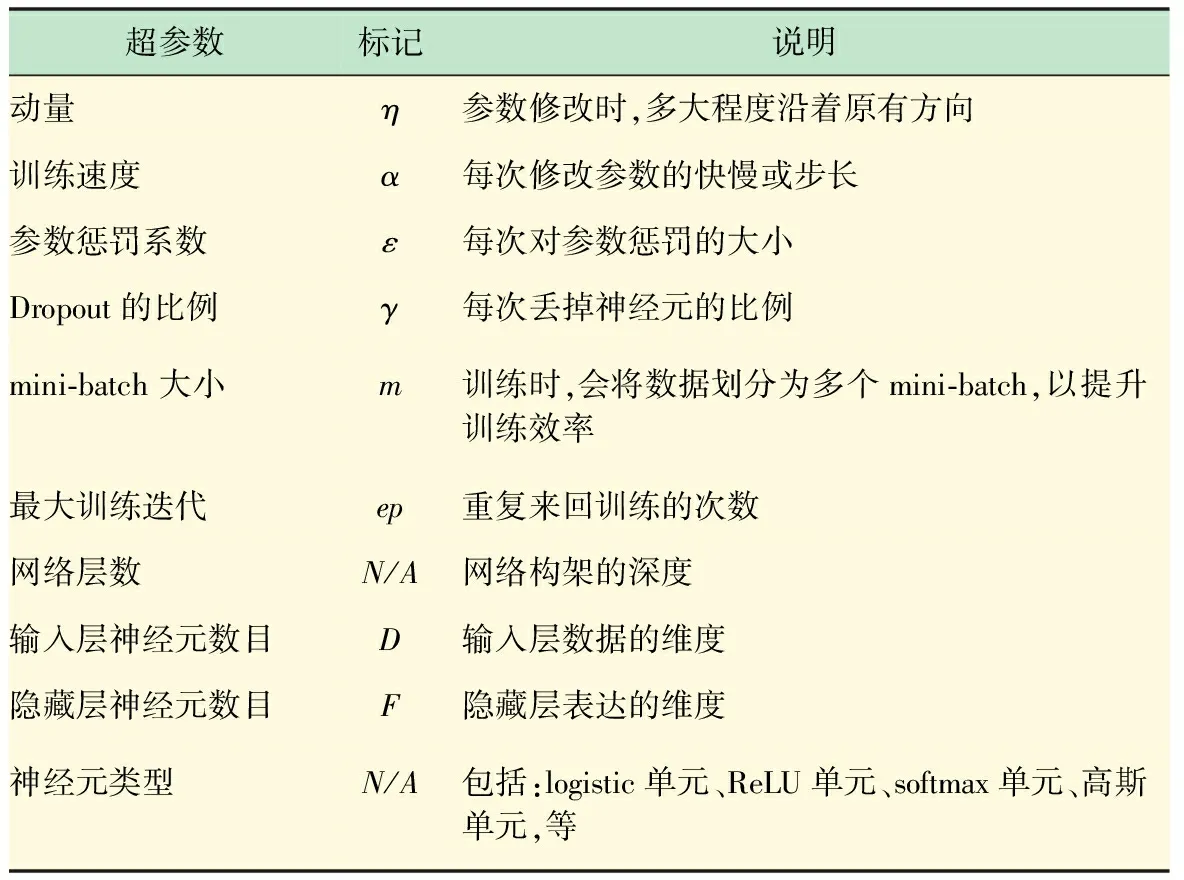

就像其他很多深度模型一樣,訓練DGM最大的挑戰就是防止模型的過度擬合和參數崩潰。為此很多輔助機制被提了出來[9],如:利用動量原理防止參數的巨烈波動;利用參數懲罰機制防止參數崩潰;利用丟棄部分神經元或它們的鏈接方式防止過度擬合;以及根據訓練集合理設計網絡結構等等。這些輔助機制大大提升DGM的性能,然而為了調整和控制這些輔助機制,眾多的超參數也被發明出來,其中最為常用如表1所示。針對新的訓練任務時,即使領域專家也很難一蹴而就找到的這么多超參數的優化組合配置。

表1 深度生成模型的常用超參數的說明

2 超參數優化算法

在訓練DGM時,大量的實踐經驗表明:在少數情況下被激活的神經元比大多數情況下被激活的神經元更加有價值[9]。因為對于一個有效的DGM來講,當特點神經元被激活時,表示模型從特定數據中探測到了特定的特征。圖3顯示了訓練RBM時的4個模擬例子,其中3個是不理想的狀態,一個為理想狀態。在此模擬例子中,數據的類別順序是被打亂的。其中,圖3(a)顯示隱藏層中大部分的神經元被激活,很可能模型的參數W變得過大導致無法識別有效特征;圖3(b)則是圖3(a)反面,大部分神經元都無法被激活,很可能參數變得過小而失去探測特征的能力;圖3(c)是一個有趣的例子,表示不管給任何數據,其中部分神經元總是被激活,導致神經元的利用率不高;圖3(d)是相對比較理想的狀態,當某一數據到來時只會激活其中部分神經元。

為在訓練過程中得到較好的神經元激活狀態,提出了一種神經元稀疏度的懲罰項,利用交叉熵的方法實現實際激活比例與目標激活比例之間的調和[9]。與此同時,一個新的超參數——稀疏度懲罰系數被發明了出來。該方法無法把多個超參數之間相互微妙的影響關系考慮進去。因此,本文提出一種新的以神經元激活的稀疏度為目標值,利用GP對稀疏度進行預測,并選出可能使神經元激活狀態較優的超參數組合的方法。

圖34個模擬RBM訓練中隱藏層神經元激活狀態圖,其中橫坐標表示隱藏層的神經元序號,縱坐標表示min-batch的大小

該方法的優化法策略是在每次迭代時,先固定當前的超參數,通過前一節描述的訓練過程學習模型的參數W;然后固定W,利用GP學習并預測超參數。

(6)

μy*=m(λ*)+K*K-1(y-mλ(i))

(7)

(8)

式中:y*為預測的稀疏度;K是利用GP的協方差函數[18]從λ(i)計算的協方差矩陣,K*=k(λ*,λ(i)),K**=k(λ*,λ*);mλ(i)為由GP的均值函數[18]對λ(i)計算所得。利用式(6)得出的后驗分布,可以快速從眾多超參數候選中選出最佳超參數的組合。

算法1基于高斯過程超參數優化算法(在epoch:t)

輸入A(Vtrain),被優化的模型;

Vtrain為訓練集;

λbest上次迭代的最佳超參數配置;

Mtrials用來建立GP模型的樣本數量;

Mpredict預測最佳超參數的嘗試樣本數量;

interval采樣樣本的定義域范圍;

輸出λbest預測的最佳超參數配置;

1.fori=1 toMtrialsdo

2.在λbest±interval范圍內隨機產生一個隨機配置λ(i);

3.λ(i)用訓練模型A(Vtrain),計算yh(t)(i);

4.end for

5.forj=1 toMpredictdo

6.在λbest±interval范圍內隨機產生一個隨機配置λ(j);

8.利用公式(9)選擇新的λbest;

9.end for

10.returnλbest。

(9)

式中,λbest為上一epoch的最佳組合。

3 實驗分析

在實驗分析中,為驗證本方法在以下3個方面的性能表現:

(1) 優化效率對比。與目前主流的超參數優化方法(SMAC和TPE)進行對比,驗證本方法對DGM的超參數優化效率。

(2) 針對不同DGM網絡結構時性能的穩定性分析。

(3) 在實際文本聚類的學習任務中,驗證本超參數優化方法在非監督學習中的優越表現。

3.1 超參數優化效率的分析

這里對比包括本方法(SHU)在內的不同的超參數優化方法,比較它們對DGM的優化速度。在DGM中選取其中兩種最經典的模型:DBN[7]和DBM[8](見圖2)。

對比的超參數優化方法包括兩種目前最主流的優化器*http://www.automl.org/HPOLIB:SMAC[10]和TPE[11],具體采用了它們針對深度模型的改進型*https://github.com/automl/pylearningcurve predictor。測試數據選擇MNIST手寫體數字,其中包括60 000個訓練樣本和10 000個測試樣本,每個樣本為28×28像素的手寫體1~9的阿拉伯數字。

在針對MNIST分類任務中訓練DBN和DBM一般劃分兩個階段:預訓練和精調。本方法主要針對預訓練階段。預訓練階段,SHU和SMAC、TPE針對模型的初始化設置詳見表2、3。此外目標稀疏度選擇為0.05。本方法在用到GP時,length-scale參數和noise參數分別設為1和0.1。在精調過程中同樣集成SMAC和TPE作為優化器,并給予相同的設置。整個訓練過程的epochs設為100。測試指標為分類精度。

圖4、5分別給出了在DBN和DBM上優化速度的對比,結果顯示SHU比SMAC和TPE收斂速度更快,同時訓練過程中的大部分時間內SHU可以取得對比方法約一半的錯誤。因此,該自適應的方法不僅可以明顯提升優化速度,并且幫助DBN和DBM提升分類精度。

表2 本方法針對模型的超參數初始化設置

表3 SMAC和TPE針對模型的超參數初始化設置

圖4 DBN在MNIST上分類實驗中學習曲線的對比

3.2 針對不同網絡結構的穩定性分析

初次使用DGM的人員由于經驗不足,往往會為選擇什么樣的網絡結構而困擾。本文提出的自適應超參數優化方法,最大的優勢之一在于可以很大程度減輕由于網絡結構設置的差異而帶來的性能的巨大變動。本小節的實驗重點驗證不同網絡結構下,自適應超參數優化方法的穩定性。為了顯示本方法的優勢,我們與手工超參數設置進行比較。

圖5 DBM在MNIST上分類實驗中學習曲線的對比

這里選擇深度模型為DBN,測試數據集仍是MNIST,驗證標準也是錯誤率。根據多次嘗試,手工選擇一個較為優化的超參數組合:[η,α,ε]=[0.5,1.0,0.000 1],其中η為動量系數,α為學習速度,ε為參數懲罰系數。針對自適應方法,目標稀疏度同樣選擇0.05,[η,α,ε]的初始化與表2相同。實驗中選擇4種不同的網絡結構,分別為[784, 100]、[784, 200, 200]、[784, 500, 100]、[784, 400, 200, 100],如圖6所示。GP的length-scale參數和noise參數分別設為1和0.1。

圖6 不同DBN網絡結構下的性能比較

圖6展示的實驗結果顯示,不同DBN的網絡結構下自適應超參數優化方法取得的錯誤率明顯低于手工設置超參數方法的錯誤率,并且性能相對較為穩定。從比較結果可得,本方法可以幫助提升DBN在實際應用中的穩定性。

3.3 針對文本聚類的實驗分析

DGM最大的優勢在于能夠利用非監督學習較好地提取數據的特征。本小節選取文本聚類這一典型的非監督學習任務,利用自適應的超參數優化對DBN進行優化,并將結果與目前主流的文本聚類算法,以及手工選取超參數的DBN做對比,驗證本方法的優越性。

這里選用的數據集是Reuters-21578數據集,它是由路透社提供并被Lewis*http://www.daviddlewis.com/resources/test collections/reuters21578/優化過的數據集。選取30個類別,其中包括8 293篇文章和18 933個詞匯。當去掉詞綴、詞根以及停用詞后,選取其中出現頻率最高的3 000個詞作為字典。

對比的方法包括:PLSA[19]、LDA[20]、NCut[21]、NMF[22]、lapGMM、Auto-encoder、DBN(手工調整超參數)[7]。由于本方法是面相超參數優化的,為公平起見,為對比方法也選擇了目前主流的超參數優化器:SMAC。但是SMAC優化器需要根據訓練效果的某個目標值,才能進行優化,這里采用了Perplexity[20]:

(10)

式中:M是文檔集D的大小;P(wi)是文檔中各個詞的概率,可以在各自算法的推理過程中得到;li是第i篇文檔的長度。為SMAC選取最大迭代預算為50。

采用DBN的網絡結構是[4 000, 900, 400, 400, 30],相應超參數初始化:[η,α,ε]=[0.5,1.0,0.000 1],目標稀疏度仍設為0.05,GP的length-scale參數和noise參數分別設為1和0.1。實驗的評價指標為最終聚類的精度。

表4給出了Reuters-21578上文本聚類的實驗結果。結果顯示基于神經元激活稀疏度(SHU)的自適應超參數優化方法,不僅明顯提升DBN在文本聚類的性能效果,而且在聚類精度上優于目前主流的文本聚類算法。圖7進一步展示針對整個文本集,DBN最后一層神經元激活的狀態,顯示當文本屬于某個類別時,總是有特定的神經元會被激活,表明了基于自適應優化方法的DBN在特征提取的有效性。

表4 Reuters-21578上文本聚類的實驗結果

圖7 Reuters-21578上DBN最后一層神經元激活狀態

4 結 語

本文提出了一種針對DGM的超參數自適應優化方法。該方法可以在每一epoch的訓練過程中,根據各隱藏層神經元激活度的變化,利用GP對最合適的超參數組合進行預測,并將預測所得超參數用于下一epoch的訓練。該方法能夠在實驗研究和實際應用中,明顯提升DGM優化效率。并且,由于該方法對不同網絡結構的穩定性較好,因此可以幫助缺乏DGM實驗和應用經驗的人員快速上手。進一步實驗也顯示在文本聚類的學習任務中,該方法能夠獲得比主流方法更好的性能。

參考文獻(References):

[1]Salakhutdinov R. Learning deep generative models[J].The Annual Review of Statistics and Its Application at Statistics. Annualreviews.org, 2015, 2(1):361-385.

[2]Lecun Y, Bengio Y, Hinton G. Deep learning[J]. Nature, 2015, 521(7553):436-444.

[3]Bengio Y, Lamblin P, Popovici D,etal. Greedy layer-wise training of deep networks[C]// International Conference on Neural Information Processing Systems. MIT Press, 2006:153-160.

[4]Larochelle H, Bengio Y, Louradour J,etal. Exploring strategies for training deep neural networks[J]. Journal of Machine Learning Research, 2009, 1(10):1-40.

[5]Hinton G E, Salakhutdinov R R. Reducing the dimensionality of data with neural networks[J]. Science, 2006, 313(5786):504.

[6]Salakhutdinov R, Hinton G. Semantic hashing[J]. International Journal of Approximate Reasoning, 2009, 50(7).

[7]Hinton G E, Osindero S, Teh Y W. A fast learning algorithm for deep belief nets[J]. Neural Computation, 2006, 18(7):1527.

[8]Salakhutdinov R, Hinton G. An efficient learning procedure for deep Boltzmann machines[J]. Neural Computation, 2012, 24(8):1967.

[9]Hinton G E. A Practical Guide to Training Restricted Boltzmann Machines[M]// Neural Networks: Tricks of the Trade. Springer Berlin Heidelberg, 2012:599-619.

[10]Hutter F, Hoos H H, Leyton-Brown K. Sequential Model-Based Optimization for General Algorithm Configuration[M]// Learning and Intelligent Optimization. Springer Berlin Heidelberg, 2011:507-523.

[11]Bergstra J, Bardenet R, Kégl B,etal. Algorithms for Hyper-Parameter Optimization[C]// Advances in Neural Information Processing Systems, 2011:2546-2554.

[12]Snoek J, Larochelle H, Adams R P. Practical bayesian optimization of machine learning algorithms[J]. Advances in Neural Information Processing Systems, 2012, 4:2951.

[13]Domhan T, Springenberg J T, Hutter F. Speeding up automatic hyperparameter optimization of deep neural networks by extrapolation of learning curves[C]//AAAI Press, 2015.

[14]Duchi J, Hazan E, Singer Y. Adaptive subgradient methods for online learning and stochastic optimization[J]. Journal of Machine Learning Research, 2011, 12(7):2121-2159.

[15]Dauphin Y N, Vries H D, Bengio Y. Equilibrated adaptive learning rates for non-convex optimization[J]. Computer Science, 2015, 35(3):1504-1512.

[16]Rasmussen C E, Williams C K I. Gaussian process for machine learning[M]// Gaussian processes for machine learning. MIT Press, 2006:69-106.

[17]Hofmann T. Unsupervised learning by probabilistic latent semantic analysis[J]. Machine Learning, 2001, 42(1):177-196.

[18]Blei D M, Ng A Y, Jordan M I. Latent dirichlet allocation[J]. Journal of Machine Learning Research, 2003, 3:993-1022.

[19]Ng A Y, Jordan M I, Weiss Y. On spectral clustering: Analysis and an algorithm[J]. Proceedings of Advances in Neural Information Processing Systems, 2002, 14:849-856.

[20]Bao L, Tang S, Li J,etal. Document clustering based on spectral clustering and non-negative matrix factorization[C]// International Conference on Industrial, Engineering and Other Applications of Applied Intelligent Systems, 2008.

[21]He X, Cai D, Shao Y,etal. Laplacian regularized gaussian mixture model for data clustering[J]. Knowledge & Data Engineering IEEE Transactions on, 2011, 23(9):1406-1418.

[22]Vincent P, Larochelle H, Bengio Y,etal. Extracting and composing robust features with denoisingautoencoders[C]// ICML, 2008:1096-1103.

·名人名言·

想像力比知識更重要,因為知識是有限的,而想像力概括著世界上的一切,推動著進步,并且是知識進化的源泉。嚴肅地說,想像力是科學研究中的實在因素。

——愛因斯坦