基于ORB特征的復(fù)雜場(chǎng)景下的增強(qiáng)現(xiàn)實(shí)

王愛(ài)麗 胡長(zhǎng)雨 韓闖

摘 要:針對(duì)增強(qiáng)現(xiàn)實(shí)開(kāi)發(fā)工具ARtoolkit利用特定編碼的卡片來(lái)獲取目標(biāo),并且利用標(biāo)記卡片角點(diǎn)來(lái)推算出相機(jī)的空間位置,準(zhǔn)確率不高,有嚴(yán)格的觀測(cè)角度限制,且不能在復(fù)雜場(chǎng)景使用的問(wèn)題。在采用即時(shí)定位與地圖構(gòu)建和隨機(jī)抽樣一致算法的基礎(chǔ)上,研究了如何將利用即時(shí)空間定位算法準(zhǔn)確的計(jì)算出相機(jī)的外參和圖像序列ORB特征點(diǎn)的空間坐標(biāo)集,并利用隨機(jī)抽樣一致和poster幀得到二維感興趣區(qū)域特征點(diǎn)坐標(biāo)集,實(shí)現(xiàn)了感興趣區(qū)域的空間坐標(biāo)定位。實(shí)驗(yàn)結(jié)果表明,該算法解決了標(biāo)記卡片以及觀測(cè)角度限制,提高了相機(jī)位置的準(zhǔn)確率,提高程度達(dá)90%。為后期渲染3D目標(biāo)實(shí)現(xiàn)增強(qiáng)現(xiàn)實(shí)提供了有力的保障。

關(guān)鍵詞:增強(qiáng)現(xiàn)實(shí);即時(shí)定位與建圖;隨機(jī)抽樣一致

DOI:10.15938/j.jhust.2018.02.005

中圖分類(lèi)號(hào): TP391.9

文獻(xiàn)標(biāo)志碼: A

文章編號(hào): 1007-2683(2018)02-0023-06

Abstract:Aiming to the development tools for Augmented Reality, ARtoolkit, and to obtain a particular coding region of interest, Marker Cards and the corner feature are used to calculate the position of the camera. But the accuracy rate is low, and viewing angle and scenes are stirctly limited. Based on the simultaneous localization and mapping and random sample consensus algorithm, this paper studies how to use instant space location algorithm to accurately calculate the spatial coordinates of camera external parameters and image sequence ORB(oriented fast and rotated brief)feature point set. Then random sampling and poster frame are used to obtain two dimensional coordinates of region of interest to locate. For these restrictions, a new method is proposed in this paper by integrating SLAM and RANSAC to obtain a particular coding region of interest and calculate the position of the camera. Experiments show that the method can solve the limitation of viewing angle and scenes and improve the accuracy of calculate the position of the camera. The degree of improvement is up to 90%, providing a strong guarantee render 3D augmented reality.

Keywords:augmented reality; simultaneous localization and mapping; random sample consensus

0 引 言

在互聯(lián)網(wǎng)時(shí)代,計(jì)算機(jī)已經(jīng)在生活當(dāng)中越來(lái)越普及,從幾人共享一臺(tái)計(jì)算機(jī)到一個(gè)人擁有幾臺(tái)計(jì)算機(jī)。計(jì)算機(jī)生成的數(shù)據(jù)對(duì)人們的生活來(lái)說(shuō)越來(lái)越重要。然而,目前計(jì)算機(jī)仍處于智能化的初級(jí)階段,可以模仿人類(lèi)進(jìn)行邏輯思維,但還無(wú)法完全進(jìn)行形象思維,如果要計(jì)算機(jī)成為人類(lèi)的可靠助手,進(jìn)行形象思維,則要求計(jì)算機(jī)能夠適應(yīng)人們所習(xí)慣的信息獲取方式和思維過(guò)程,與真實(shí)環(huán)境進(jìn)行自然融合。增強(qiáng)現(xiàn)實(shí)系統(tǒng)可以將計(jì)算機(jī)生成的信息(包括文字、圖像、三維物體等)以視覺(jué)融合的方式疊加至真實(shí)場(chǎng)景中,與周?chē)恼鎸?shí)環(huán)境完美地融為一體。在用戶(hù)眼前呈現(xiàn)出“增強(qiáng)”了的世界。在理想情況下,用戶(hù)無(wú)法辨別哪個(gè)是虛擬物體,哪個(gè)是真實(shí)物體,看到的將是完整的融合顯示場(chǎng)景。增強(qiáng)現(xiàn)實(shí)借助顯示技術(shù)、交互技術(shù)、傳感技術(shù)和計(jì)算機(jī)圖形技術(shù)將計(jì)算機(jī)生成的虛擬目標(biāo)與用戶(hù)周?chē)默F(xiàn)實(shí)環(huán)境融為一體[1-4]。

常用的增強(qiáng)現(xiàn)實(shí)開(kāi)發(fā)工具ARtoolkit[5]存在諸多限制,定位需要特定編碼的標(biāo)示(Marker)圖片來(lái)標(biāo)示出目標(biāo)位置,計(jì)算相機(jī)的位置方式單一,觀測(cè)的傾斜角度有限制。針對(duì)這些問(wèn)題,本文采用SLAM[6-7]結(jié)合二維平面定位的RANSAC[8-9]算法,可以準(zhǔn)確的獲得相機(jī)空間位置,并且定位目標(biāo)的空間位置,來(lái)渲染三維目標(biāo),實(shí)現(xiàn)增強(qiáng)現(xiàn)實(shí)。本文結(jié)構(gòu)如下:第一部分介紹ARtoolkit的開(kāi)發(fā)框架,第二部分介紹ARtoolkit定位目標(biāo)和計(jì)算相機(jī)位置的方法。第三部分介紹SLAM和二維圖像配準(zhǔn)的RANSAC算法,并進(jìn)行結(jié)合以實(shí)現(xiàn)三維空間的目標(biāo)定位。第四、五部分給出對(duì)比分析的實(shí)驗(yàn)結(jié)果和結(jié)論。

1 ARtoolkit簡(jiǎn)介

增強(qiáng)現(xiàn)實(shí)是把原本在現(xiàn)實(shí)世界的一定時(shí)間空間范圍內(nèi)很難體驗(yàn)到的實(shí)體信息(視覺(jué)信息、聲音、觸覺(jué)等),利用科學(xué)技術(shù)進(jìn)行仿生后再融合到現(xiàn)實(shí)世界,人類(lèi)通過(guò)感官來(lái)感知。ARtoolkit是由C/C++語(yǔ)言編寫(xiě)的庫(kù),通過(guò)它可以實(shí)現(xiàn)現(xiàn)實(shí)增強(qiáng)。ARToolkit的開(kāi)發(fā)流程基于人工標(biāo)志的注冊(cè)方法來(lái)進(jìn)行,包括以下幾個(gè)部分:相機(jī)標(biāo)定、初始化攝像頭并捕獲視頻幀、搜索標(biāo)示以及識(shí)別、計(jì)算Marker的位置和方向、計(jì)算相機(jī)的位置、渲染虛擬物體、屏幕顯示和關(guān)閉視頻捕捉,開(kāi)發(fā)流程如圖1所示。

圖1中相機(jī)標(biāo)定是一個(gè)單獨(dú)的過(guò)程,用來(lái)獲得相機(jī)的內(nèi)參,從Marker搜索開(kāi)始,表示實(shí)現(xiàn)AR過(guò)程,在得到Marker的位置和角度以后,找到相機(jī)位置,最后利用opengl在真實(shí)場(chǎng)景中渲染3D目標(biāo)。

2 ARtoolkit中Marker定位

圖2中(a)表示的是一種Marker,利用了漢明碼變種的編碼方式來(lái)表示一個(gè)Marker圖片[9-10]。Marker的最外圍是黑色邊框,內(nèi)部的是編碼信息,白色為1,黑色為0。如果每一行看作一個(gè)字,則每一位為5bit,其中1、3、5位是校驗(yàn)位,2、4位是信息位,所以整個(gè)Marker的信息位有10bit。圖2中(b)表示定位了Marker在空間的位置、相機(jī)的位置,并在Marker上渲染出3D的模型。

在ARtoolkit[5]中,利用Marker來(lái)定位目標(biāo),通過(guò)對(duì)圖像二值化,利用約束條件找到Marker的四條邊,定位四個(gè)頂點(diǎn),然后在Marker四個(gè)頂點(diǎn)建立空間坐標(biāo)系,但是要求目標(biāo)周邊的紋理不能過(guò)于復(fù)雜否則無(wú)法利用約束條件準(zhǔn)確的定位四條邊,難以定位Marker的四個(gè)頂點(diǎn)。同時(shí)在計(jì)算外參的時(shí)候,使用Opencv中的solvepnp方法計(jì)算。由于solvepnp是通過(guò)單個(gè)Marker上的4個(gè)點(diǎn)來(lái)確定相機(jī)的旋轉(zhuǎn)矩陣和平移向量從而來(lái)計(jì)算相機(jī)在下一幀的位置,算法在物體深度相對(duì)于物體到相機(jī)的距離比較大的時(shí)候可能不收斂,進(jìn)而不能得到精確的相機(jī)外參。

在觀測(cè)角度不同時(shí),得到的投影矩陣不一樣,從而使得錐形體視角投影中容易出現(xiàn)偏差,難以準(zhǔn)確得到目標(biāo)的正視圖位置,影響后期渲染的準(zhǔn)確性。本文利用SLAM[11]可以得到每一幀圖像特征點(diǎn)空間坐標(biāo)和準(zhǔn)確的相機(jī)位置,同時(shí)利用RANSAC算法來(lái)精確的查找目標(biāo)二維坐標(biāo)集。利用二維特征點(diǎn)和空間特征點(diǎn)一一對(duì)應(yīng)的關(guān)系,不受場(chǎng)景和角度的約束,能夠在復(fù)雜場(chǎng)景和任意角度準(zhǔn)確的定位目標(biāo)。

3 改進(jìn)后的目標(biāo)定位

與傳統(tǒng)的方法不同,本文將ORB[16]特征作為SLAM建圖和定位空間特征點(diǎn)的特征,同時(shí)也是RANSAC定位目標(biāo)的特征。首先利用SLAM計(jì)算攝像頭獲取的幀的ORB特征點(diǎn)空間位置和當(dāng)前幀相機(jī)的空間位置,并保存結(jié)果。然后利用含有目標(biāo)的一幀圖像,稱(chēng)之為poster幀,對(duì)攝像頭獲取的幀定位目標(biāo)區(qū)域。由于SLAM處理特征點(diǎn)和RANSAC處理的特征點(diǎn)是同一特征點(diǎn),所以特征點(diǎn)的空間坐標(biāo)和二維坐標(biāo)一一對(duì)應(yīng)。當(dāng)poster幀在視流中定位到了目標(biāo)位置,那么只需要查詢(xún)?cè)撃繕?biāo)區(qū)域二維特征點(diǎn)集對(duì)應(yīng)的空間特征點(diǎn)集的坐標(biāo),并記錄下來(lái)。然后對(duì)記錄下的空間坐標(biāo)點(diǎn)集求均值,就可以找到目標(biāo)區(qū)域中心的空間特征點(diǎn)坐標(biāo)。同時(shí)SLAM計(jì)算還得到了當(dāng)前幀相機(jī)的位置。

3.1 空間特征點(diǎn)定位

這一步采用的是基于ORB特征的SLAM方法,實(shí)現(xiàn)對(duì)相機(jī)實(shí)時(shí)采集的圖像序列幀進(jìn)行特征檢測(cè)、跟蹤,得到幀間特征點(diǎn)的匹配關(guān)系,然后建立世界坐標(biāo)系,利用特征點(diǎn)三角化計(jì)算出特征點(diǎn)的空間坐標(biāo),利用初始化的運(yùn)動(dòng)模型和相機(jī)外參,得到相機(jī)在當(dāng)前幀的位置。由于ORB特征本質(zhì)上是FAST-10特征,具有重復(fù)性,所以保證了SLAM和RANSAC處理的特征是同一特征,分四個(gè)步驟實(shí)現(xiàn):

1)ORB特征提取。提取的ORB特征是在8個(gè)不同尺度的圖像金字塔中進(jìn)行的。在每個(gè)尺度層劃分cell,在每個(gè)cell中提取5個(gè)特征點(diǎn),總共一幀圖像提取2000個(gè)特征點(diǎn)。如果提取的特征點(diǎn)沒(méi)有達(dá)到2000這個(gè)閾值,則對(duì)當(dāng)前幀調(diào)整特征點(diǎn)數(shù)量閾值。

2)對(duì)于初始的兩幀,利用五點(diǎn)法[16]可以求出相機(jī)的姿態(tài),從而確定相機(jī)的運(yùn)動(dòng)模型,再利用三角測(cè)量原理,計(jì)算出匹配正確的二維特征點(diǎn)所對(duì)應(yīng)的空間坐標(biāo)。

3)得到特征點(diǎn)空間坐標(biāo)后,再將空間坐標(biāo)值從世界坐標(biāo)系投影到當(dāng)前幀中,從而可以得到相機(jī)的外參,求出相機(jī)在當(dāng)前幀的位置。

首先要將世界坐標(biāo)系中的空間投影到相機(jī)坐標(biāo)系,得到相機(jī)坐標(biāo)系中,這可以通過(guò)左乘一個(gè)4×4的矩陣來(lái)實(shí)現(xiàn),即:

將空間特征點(diǎn)投影到得到當(dāng)前幀后,還要找到它在當(dāng)前幀中的對(duì)應(yīng)匹配的特征點(diǎn),本文采用的方法是基于塊匹配[4]的方法來(lái)定位當(dāng)前幀上成功匹配的特征點(diǎn)坐標(biāo)。

4)更新相機(jī)位置。給定重投影點(diǎn)的對(duì)應(yīng)匹配點(diǎn)的集合S,若該集合足夠大的時(shí)候,則得到相機(jī)的新位置。通過(guò)最小化重投影誤差,可以更新相機(jī)姿態(tài)。重投影誤差為特征點(diǎn)空間坐標(biāo)在當(dāng)前幀的投影點(diǎn)與其在當(dāng)前幀的匹配點(diǎn)的差異,可以用式(3)來(lái)表示:

通過(guò)最小化投影誤差,可以得到相機(jī)的運(yùn)動(dòng)模型,利用相機(jī)的運(yùn)動(dòng)模型和相機(jī)外參可以估計(jì)出相機(jī)在下一幀圖像的位置。這樣就完成了相機(jī)位置和特征點(diǎn)的空間坐標(biāo)的計(jì)算。

3.2 基于RANSAC的目標(biāo)定位

計(jì)算目標(biāo)二維位置,其實(shí)就是利用poster幀特征點(diǎn)去和當(dāng)前幀特征點(diǎn)進(jìn)行匹配,找到匹配最好的幀和目標(biāo)位置,分五步來(lái)完成這一環(huán)節(jié):

1)提取poster幀的ORB特征和當(dāng)前幀的ORB特征,并進(jìn)行暴力匹配。

2)對(duì)暴力匹配成功的特征點(diǎn)進(jìn)行RANSAC,得到最優(yōu)單應(yīng)射矩陣H[17]。

3)對(duì)poster幀利用H進(jìn)行透視變換,投影到當(dāng)前幀,進(jìn)一步刪除配準(zhǔn)錯(cuò)誤的特征點(diǎn),實(shí)現(xiàn)特征點(diǎn)的精準(zhǔn)匹配。

4)判斷精準(zhǔn)匹配的點(diǎn)的數(shù)量和poster幀特征點(diǎn)總數(shù)量的比值是否達(dá)到0.15,如果小于0.15,則認(rèn)為匹配不準(zhǔn)確,放棄匹配結(jié)果,繼續(xù)執(zhí)行第二步。否則保存匹配結(jié)果執(zhí)行第五步。

5)獲得當(dāng)前幀中目標(biāo)的二維坐標(biāo)集,并記錄下來(lái)這些特征點(diǎn)的序列號(hào),匹配過(guò)程結(jié)束。求解最優(yōu)的單映射矩陣H是對(duì)ORB特征點(diǎn)進(jìn)行RANSAC得到的。

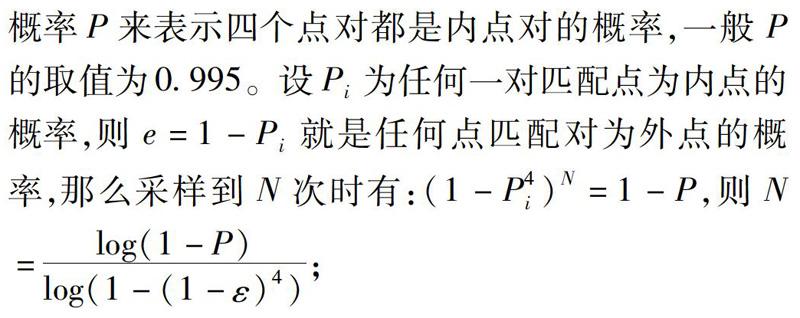

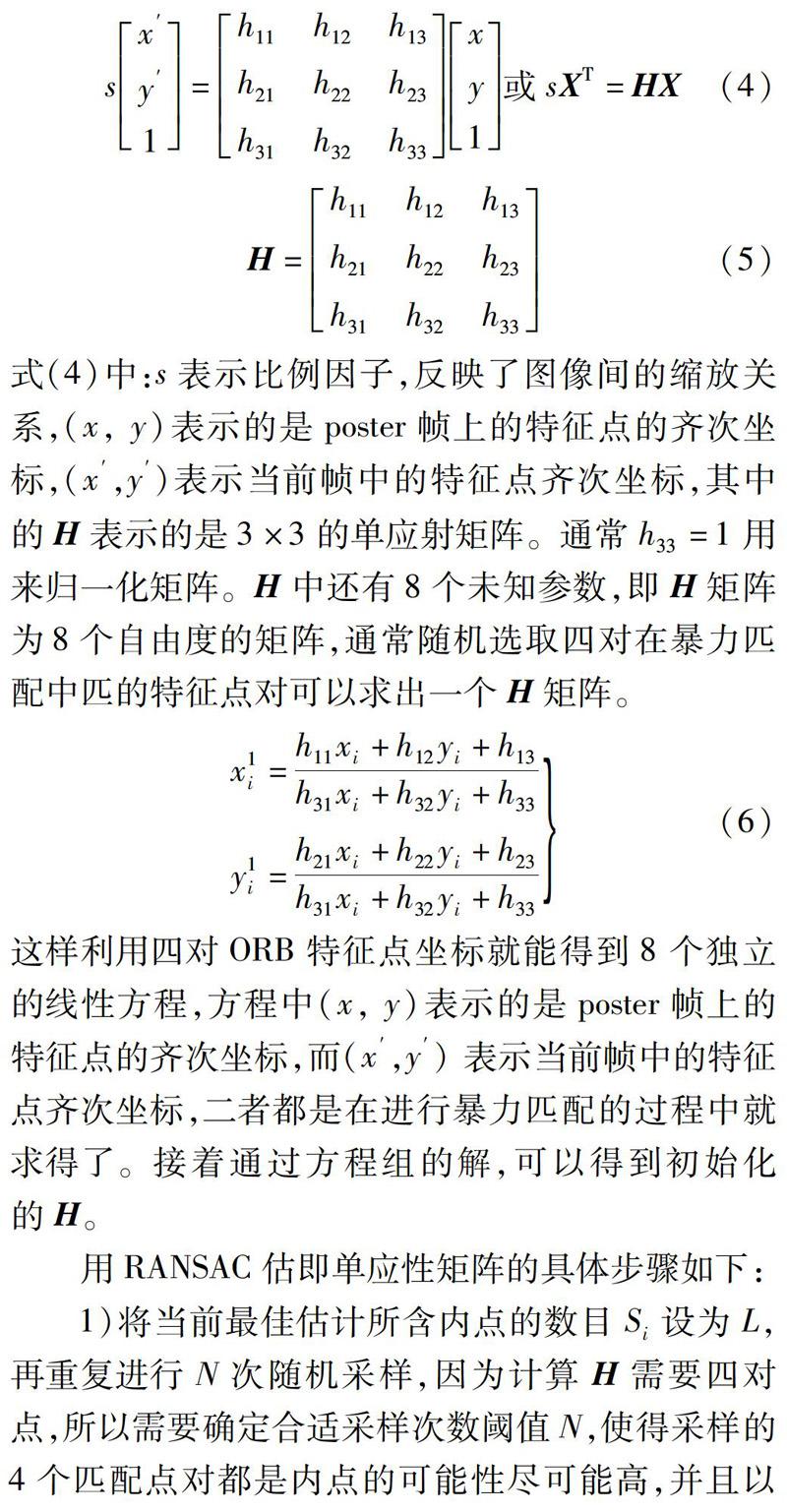

在得到了暴力匹配成功的特征點(diǎn)對(duì)后,存在許多誤匹配,此時(shí)需要利用RANSAC算法,求出最優(yōu)的單應(yīng)射矩陣H [15]。式(4)說(shuō)明了單應(yīng)射矩陣的形式。

這樣利用四對(duì)ORB特征點(diǎn)坐標(biāo)就能得到8個(gè)獨(dú)立的線性方程,方程中(x, y)表示的是poster幀上的特征點(diǎn)的齊次坐標(biāo),而(x′,y′)表示當(dāng)前幀中的特征點(diǎn)齊次坐標(biāo),二者都是在進(jìn)行暴力匹配的過(guò)程中就求得了。接著通過(guò)方程組的解,可以得到初始化的H。

用RANSAC估即單應(yīng)性矩陣的具體步驟如下:

2)根據(jù)4對(duì)隨機(jī)的匹配點(diǎn)對(duì)算出矩陣H;

3)利用H對(duì)poster幀上匹配點(diǎn)進(jìn)行矩陣變換,計(jì)算匹配點(diǎn)對(duì)的漢明距離d,設(shè)定漢明距離的閾值為T(mén),如果匹配點(diǎn)滿足條件d 4)比較當(dāng)前內(nèi)點(diǎn)數(shù)量與L,如果大于L則將H和當(dāng)前的內(nèi)點(diǎn)集作為當(dāng)前最佳估即,更新L;如果等于L,則選擇配準(zhǔn)較低的作為當(dāng)前最佳估計(jì),同時(shí)動(dòng)態(tài)估計(jì)剩余所需迭代次數(shù)。如果當(dāng)前迭代次數(shù)等于N,則保留H和當(dāng)前的內(nèi)點(diǎn)集并停止迭代;否則繼續(xù)迭代知道N此為止; 5)對(duì)當(dāng)前內(nèi)點(diǎn)集的所有匹配點(diǎn)采用DLT算法重新估計(jì)H。 在獲得了最優(yōu)的單應(yīng)矩陣H之后,還要進(jìn)一步來(lái)通過(guò)透視變換剔除誤匹配的點(diǎn)。在暴力匹配的過(guò)程中記錄下了poster幀和當(dāng)前幀的特征點(diǎn)匹配對(duì)的序號(hào),所以在這一步就是通過(guò)H將poster幀中的特征點(diǎn)投影到當(dāng)前幀上,并且計(jì)算和當(dāng)前幀中同一序號(hào)的特征點(diǎn)的漢明距離,同時(shí)利用閾值T來(lái)刪除誤匹配點(diǎn)。如果漢明距離小于閾值T,則認(rèn)為匹配成功,重新記錄下配對(duì)成功的特征點(diǎn)序號(hào),否則不記錄。 通過(guò)上面的兩步處理就可以得到二維的準(zhǔn)確的特征點(diǎn)對(duì),并且保存了特征點(diǎn)對(duì)的序號(hào),記錄了poster幀中的特征點(diǎn)序號(hào)和當(dāng)前幀中的目標(biāo)的特征點(diǎn)序號(hào)。在得到了當(dāng)前幀目標(biāo)二維特征點(diǎn)集后,只需要把含有標(biāo)記的二維特征點(diǎn)對(duì)應(yīng)的相同序號(hào)的空間特征點(diǎn)找出來(lái),進(jìn)行求和再平均運(yùn)算[18],就能得到目標(biāo)中心位置的空間坐標(biāo)。同時(shí)又獲得了準(zhǔn)確的相機(jī)位置信息,所以能夠準(zhǔn)確的將3D地球儀渲染到目標(biāo),并且準(zhǔn)確的通過(guò)投影矩陣投影到鏡頭。 4 實(shí)驗(yàn)結(jié)果和分析 本文的實(shí)驗(yàn)在配置有2.1Ghz雙核Intel Core CPU和windows7系統(tǒng)的acer 4750G型號(hào)電腦上進(jìn)行的,開(kāi)發(fā)環(huán)境是Vsiual Studio 2015。所有的計(jì)算是在3個(gè)線程上完成的。本節(jié)給出了兩組實(shí)驗(yàn)結(jié)果,分別是在筆記本上渲染地球儀和在小猴子身上渲染地球儀。本節(jié)給出了三組對(duì)比實(shí)驗(yàn)圖,還給出了在不同角度和距離條件下ARtoolkit和本文的SLAM定位[19-21]的誤差對(duì)比圖。可以明顯看到,定位誤差也大大減小。 圖3中,(a1)表示的是Marker標(biāo)示,(a2)表示將Marker 放入復(fù)雜場(chǎng)景中,并且檢測(cè)出特征點(diǎn),(a3)表示是利用Marker在復(fù)雜場(chǎng)景下的錯(cuò)誤定位導(dǎo)致渲染的地球儀位置錯(cuò)了。(b1)和(c1)表示poster幀,一個(gè)是筆記本,一個(gè)是小猴子玩偶,可以看到,兩個(gè)poster幀的拍攝角度是垂直關(guān)系,成90°。(b2)和(c2)表示場(chǎng)景,其中的綠色方格表示的是二維特征點(diǎn)在當(dāng)前幀中的位置,(b3)和(c3)分別表示兩種場(chǎng)景中,渲染立體地球儀。 進(jìn)一步分析,圖4中(a)表示的5個(gè)不同的角度,在離目標(biāo)區(qū)域不同距離的情況下的誤差情況。橫坐標(biāo)表示的是距離,縱坐標(biāo)表示的視角和目標(biāo)區(qū)域所在平面的傾角,分別是0°、30°、45°、60°、80°。每種傾角分別記錄在不同的距離取值情況下的定位誤差,1號(hào)線表示的是ARtoolkit工程,2號(hào)線表示的是改進(jìn)后的定位方法的定位結(jié)果,稱(chēng)為SLAM工程。從圖中可以看出,在100~400mm距離之間ARtoolkit工程和SLAM工程的差距較小,這是因?yàn)锳Rtoolkit中在短距離情況下,視角范圍較小,可以盡量減少視角范圍內(nèi)的干擾紋理,同時(shí)由于Opencv中的solvepnp在物體深度相對(duì)于物體到相機(jī)距離較小時(shí),收斂效果較好。在大于400mm的距離之后可以看出SLAM工程效果明顯優(yōu)于ARtoolkit工程的效果,因?yàn)榫嚯x越遠(yuǎn),視角越大,干擾紋理越多,通過(guò)簡(jiǎn)單的二值化加約束條件確定的Marker邊界變得不準(zhǔn)確,從而得到有誤差的Marker頂點(diǎn),同時(shí)由于相機(jī)距離和物體距離較遠(yuǎn),solvepnp方法變得不收斂,在有誤差的Marker頂點(diǎn)上計(jì)算相機(jī)誤差,使得整個(gè)過(guò)程的誤差累積,從而導(dǎo)致了最后的效果要比SLAM工程的效果差 圖4(b)中表示的是兩種工程因角度和距離產(chǎn)生的誤差的對(duì)比圖,其中將五種不同角度ARtoolkit工程的誤差繪制在同一坐標(biāo)軸下,縱坐標(biāo)表示的誤差大小,橫坐標(biāo)表示的觀察距離,SLAM線表示的是SLAM的誤差,其余的線段表示ARtoolkit工程的誤差線段。由于每種觀察角度SLAM誤差大小幾乎相等,所以就只用一條平均線來(lái)表示SLAM定位誤差,可以看出最高誤差值為2mm, 其余5條線分別表示ARtoolkit產(chǎn)生的誤差,當(dāng)傾角為0°時(shí),誤差最大,達(dá)到了18mm。所以誤差減少程度最高達(dá)90%。 5 結(jié) 論 本文介紹了一種基于SLAM和RANSAC定位目標(biāo)在空間位置的方法。通過(guò)SLAM可以準(zhǔn)確的定位當(dāng)前每一幀相機(jī)的位置,同時(shí)利用極限幾何可以準(zhǔn)確的實(shí)現(xiàn)兩幀圖像特征點(diǎn)配對(duì),再對(duì)配對(duì)的特征點(diǎn)三角化可以得到特征點(diǎn)在空間的位置。再通過(guò)RANSAC對(duì)每一幀圖像匹配目標(biāo)區(qū)域,根據(jù)二維特征點(diǎn)和空間特征點(diǎn)一一對(duì)應(yīng)的關(guān)系,可以準(zhǔn)確的查找到目標(biāo)區(qū)域在空間的位置。通過(guò)SLAM和RANSAC的結(jié)合,使得ARtoolkit不再受Marker和場(chǎng)景的限制,可以在復(fù)雜場(chǎng)景中使用,得到準(zhǔn)確的相機(jī)位置,為后期渲染3D目標(biāo)提供了保障。 參 考 文 獻(xiàn): [1]周忠,周頤,肖江劍.虛擬現(xiàn)實(shí)增強(qiáng)技術(shù)綜述[J].中國(guó)科學(xué), 2015, 45(3):157-180. [2]虞錦東.基于Android的增強(qiáng)現(xiàn)實(shí)系統(tǒng)研究與應(yīng)用[J]. 數(shù)字通信世界, 2016(5):110-115. [3]CHATZIMICHALI A, GIJSELARS W. Bridging the Multiple Reality Gap: Application of Augmented Reality in New Product Development[J]. IEEE International Conference on Systems Man and Cybernetics Conference Proceedings, 2011, 89(12): 1914-1919.

[4]MOHAMED N,YUSOFF F,ISMAIL M, et al. The Potential Use of Augmented Reality in Gamification[J]. International Conference on Computing & Informatics, 2015, 36(12):159-167.

[5]ARtoolkit[DB/OL]:http://www.hitl.washington.edu/artoolkit/.

[6]MUR-ARTALR, MONTIEL J, TARDOS J. ORB-SLAM: A Versatile and Accurate Monocular SLAM System[J].IEEE Transactions on Robotics, 2015,5(31): 1147-1163.

[7]KLEING, MURRAY D. Parallel Tracking and Mapping for Small AR Workspaces[J]. IEEE International Symposium on Mixed and Augmented Reality (ISMAR), 2007, 18(34):225-234.

[8]EL-MELEGY M.Model-wise and Point-wise Random Sample Consensus for Robust Regression and Outlier Detection[J]. Neural Networks, 2014, 59(11):23-35.

[9]HAST A, NYSJO J, MARCHETTI A. Optimal RANSAC-Towards a Repeatable Algorithm for Finding the Optimal Set[J]. Journal of WSCG, 2013, 21 (1): 21-30.

[10]GRAHAM M,ZOOK M, BOULTON A. Augmented Reality in Urban Places: Contested Content and the Duplicity of Code[J]. Transactions of the Institute of British Geographers, 2013, 38(3):464-479.

[11]ZHOU Shuo, CHEN Zongxing, LIU Xiaoyang, et al. An Elder Mode of New Generation Phone Using Augment Reality[J]. Procedia Environmental Sciences, 2011, 10(10):936-942.

[12]桂振文,王涌天,劉越. 二維碼在移動(dòng)增強(qiáng)現(xiàn)實(shí)中的應(yīng)用研究[J]. 計(jì)算機(jī)輔助設(shè)計(jì)與圖形學(xué)學(xué)報(bào), 2014, 26(1):34-39。

[13]張鈺,陳靖,王涌天.增強(qiáng)現(xiàn)實(shí)瀏覽器的密集熱點(diǎn)定位與顯示[J].計(jì)算機(jī)應(yīng)用, 2014, 34(5):1435-1438.

[14]RABBI I, ULLAH S, RAHMAN S, et al. Extending the Functionality of ARToolKit to Semi-controlled / Uncontrolled Environment[J]. International Journal on Information , 2014, 17(6):2823-2832.

[15]RUBLEE E, RABAUD V, KONOLIGE K, et al. ORB: An Effcient Alternative to SIFT or SURF[J]. IEEE International Conference on Computer Vision , 2011, 58(11):2564-2571.

[16]NISTER D. An Efficient Solution to the Five-point Relative Pose Problem[J]. In Proc IEEE CVPR, 2007, 26(6):756-777.

[17]BASTA T. Is the Fundamental Matrix Really Independent of the Scene Structure[J]. International Journal of Computer Vision , 2014, 7(5):149-167.

[18]MEDINA M,RONCHETTI E.Robust Statistics: A Selective Overview and New Directions[J].Wiley Interdisciplinary Reviews Computational Statistics, 2015, 7(6):372-393.

[19]FLECK S,SIMON G. An Augmented Reality Environment for Astronomy Learning in Elementary Grades: An Exploratory Study[J]. Ieme Conference Francophone on Interaction Homme-machine, 2013, 35(14):14-22.

[20]MYUNG H,LEE B,KIM H,et al. A Study on Effective Visual Communication Method with the Pictomation Contents in Augmented Reality Environment[J]. 2014, 23(44):156-164.

[21]MEOLA A,CUTOLO F,CARBONE M. Augmented Reality in Neurosurgery: A Systematic Review. Neurosurgical Review, 2016, 25(33):1-12.

(編輯:關(guān) 毅)