基于深度卷積神經網絡的多任務細粒度車型識別

王海瑤,唐 娟,沈振輝

?

基于深度卷積神經網絡的多任務細粒度車型識別

王海瑤1,唐 娟2,沈振輝1

(1. 福建江夏學院工程學院,福建 福州 350108;2. 安徽工程大學管理工程學院,安徽 蕪湖 241000;)

車型識別,尤其是細粒度車型識別是現代智能交通系統的重要組成部分。針對傳統車型識別方法難以進行有效的細粒度車型識別的問題,以AlexNet、GoogleNet及ResNet等3種經典深度卷積神經網絡架構作為基礎網絡,引入了車輛的類型分類作為輔助任務,從而與細粒度車型識別任務一起構成了一個多任務聯合學習的模型。通過在一個包含281個車型類別的公開數據集上對模型進行訓練及測試,在無需任何車輛的部件位置標注及額外的3D信息的情況下,驗證了該模型在在細粒度車型識別任務上表現出的優異性能,同時多任務學習策略的引入可使得模型性能相比任一單任務學習時的性能均有所提高,最終實現了一個簡潔高效的細粒度車型識別模型,基本滿足實際應用需求。

智能交通;細粒度車型識別;深度學習;神經網絡

隨著社會生活的不斷發展,人均可支配收入穩步提升,人均擁有汽車數逐漸增多,交通承載狀況和日益增長的汽車數量之間的沖突不斷提升,并因此產生了交通擁擠、道路環境惡化等一系列社會問題,對于城市的正常運行造成了不小的壓力。車型識別作為現代智能交通系統的重要組成部分,對于高效監控交通情況,及時處理突發交通意外,以及判定相關交通事故責任都有著不可估量的作用。

傳統的車型識別方法主要關注的是車輛制造商識別(vehicle make recognition),或是識別廣義上的車型(轎車、貨車、越野車等)[1-2]。其主要流程一般包括:①采用人工設計的特征提取方法(如SIFT[3]、LBP[4]、HOG[5]等)將輸入的車輛圖片轉換為一組特征向量;②再基于該特征向量和機器學習中的分類算法(如SVM、Adaboost、隨機森林等)來訓練模型。然而,在細粒度車型識別問題上,不同車型類別間的差別往往很細微,而人工設計的特征提取方法在應對此問題時對強辨識信息的提取能力很有限,為了彌補手工特征在提取強辨識信息能力方面的不足,也有一系列文獻[6-7]嘗試引入車輛的3D信息來建立模型,從而改善識別的性能。但這些方法加大了整體模型的復雜度,計算耗時也更大,不利于實際的應用,且仍然受到了人工特征在對強辨識信息提取的能力弱、對特定問題適應性差等方面的限制。

近年來,得益于大數據、硬件計算能力的提升以及算法的改進,深度學習在語音處理和計算機視覺領域等諸多領域都取得了巨大的成功,顯著提升了語音識別、圖像分類、物體檢測、視頻分析、人臉識別、行人檢測、語義分割、機器翻譯等眾多智能處理任務的性能[8]。如在圖像分類領域的ILSVRC挑戰賽上,基于深度學習的方法AlexNet[9]、GoogleNet[10]及ResNet[11]等均在性能上相比傳統方法取得了很大的突破。相較于傳統方法,深度學習最大的優勢就在于其可以通過層級連接的方式進行對原始輸入信號到期望輸出信息的復雜非線性建模,從而獲取數據更抽象、更本質的表征,實現了一種“端到端(end-to-end)”的學習,完全是數據驅動,而不依賴于專家知識來針對特定領域設計人工特征,普適性更強。

在細粒度圖像識別領域,也有許多基于深度學習的方法開始被廣泛采用,并在性能上遠遠超過了傳統基于人工特征的方法[12-14]。這些方法大多從如何對待識別圖像的局部判別區域進行定位與對齊的角度出發,通過將深度卷積神經網絡所提取到的全局特征與局部特征相結合來改善細粒度識別的性能。而在更具體的細粒度車型識別領域,也有不少基于深度學習的研究成果。如文獻[15]建立了一個大規模的車輛數據庫“CompCars”,并在此數據集上使用深度網絡進行訓練,并將結果用于車型分類、車型驗證和車輛屬性研究。文獻[16]將全局特征和局部特征結合起來進入卷積神經網絡反復訓練,輸出的特征顯示出對子類別有更強的判別能力。文獻[17]將監控視頻中獲取的車輛3D信息送入卷積神經網絡作為一個額外的信息,結果顯示得到了更好的分類效果,尤其是在車型的驗證上尤為顯著。為減少復雜背景信息對識別結果的干擾,文獻[18]首先結合視覺顯著性及車輛的位置信息來對圖片中的車輛進行精確定位,然后再對車型識別及車輛的視角分類這兩個任務進行聯合優化,從而引入更多信息來應對場景中車輛視角變化的問題。文獻[19]引入了車輛各部件位置的標注信息來設計了對車輛的關鍵部件進行檢測的模型,并通過一個投票機制來結合車輛的全局特征與局部部件的特征以提高細粒度車型識別的準確率。

與以上工作不同的是,本文將從實際應用的角度出發,旨在開發一套簡潔高效的細粒度車型識別方法,在無需部件位置標注及車輛3D信息的情況下仍能準確地對交通監控場景下的車輛前臉圖片進行有效識別。由于所針對的細粒度車型識別任務中車輛的視角變化并不大,該方法并未把車輛的視角信息引入到網絡的學習中,而是引入了車輛的類型信息來構建多任務學習的網絡。實驗證明,車輛的型號及類型間在語義級別上存在著一定的關聯,通過對二者進行多任務的聯合學習,在保持較高識別效率的同時,可實現最終的識別準確率相比各自單任務學習時均有提高。

1 方法

1.1 深度網絡簡介

本文分別采用AlexNet、GoogLeNet、ResNet等3種深度卷積神經網絡模型來進行車型細粒度識別任務,并對比分析其各自性能的優劣。這些模型都是深度學習在視覺領域發展史上的里程碑,基本反映了深度神經網絡中層數越深,性能越佳的規律(圖1)。

圖1 ILSVRC 歷年的 Top-5 錯誤率

1.1.1 AlexNet

AlexNet是由Hinton及其學生Alex Krizhevsky等在2012年提出的一個深度學習網絡架構,并摘得視覺領域競賽 ILSVRC 2012 的桂冠,在百萬量級的ImageNet 數據集合上,其錯誤率比使用傳統方法的第2名參賽隊低了約10%。該網絡結構圖如圖2所示,包含5個卷積層和3個全連接層。相比于之前的神經網絡,其主要有以下幾個創新點:

(1) 引入新的非飽和型激活函數ReLU替代了之前普遍采用的飽和型激活函數(如Sigmoid、tanh等),實踐表明ReLU可以有效緩解訓練過程中的梯度消失現象,有利于更快速地收斂,減少訓練時間。

(2) 通過dropout技術在訓練過程中將中間層的一些神經元隨機置零,提高模型的泛化性能、減輕過擬合。

(3) AlexNet在多個GPU上訓練,往往單個GPU的內存不足以支撐在其上訓練網絡的最大規模,多個GPU并行計算使得深度網絡的訓練成為可能。

(4) 通過隨機裁剪、平移變換、水平翻轉、灰度值擾動等方式擴充訓練樣本集,減輕過擬合。這些數據增擴的方式也在之后許多深度卷積神經網絡的實踐中廣為使用。

圖2 簡化版的AlexNet

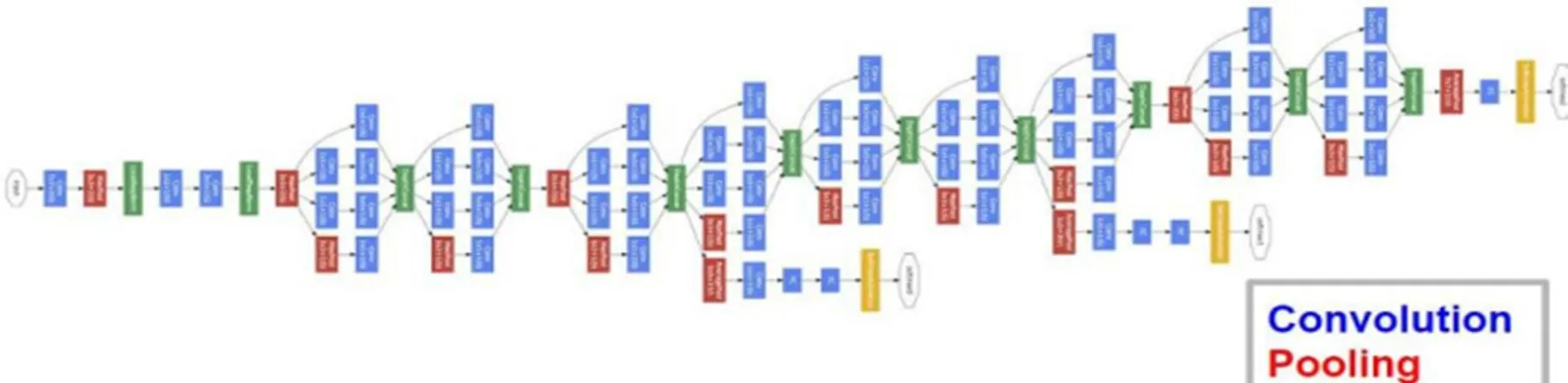

1.1.2 GoogleNet

GoogLeNet (圖3)是Google公司的Christian Szegedy等人于2014年提出的卷積神經網絡,網絡層數達到22層,其中提出了很多新穎的結構和想法,并在ILSVRC 2014中獲得了分類和檢測第一的成績。相比于AlexNet,該網絡在設計上受到了Hebbian學習規則的啟發,同時基于多尺度的處理方法對卷積神經網絡進行了改進。一般而言,加深網絡層數將增加網絡所需要學習的參數量,從而加大了過擬合的風險,同時也增加了模型的計算復雜度,為此,GoogLeNet采用了以下幾個解決方法:

(1) 引入了Inception結構(圖4),此結構擁有多個不同尺度的卷積核,可通過多尺度的卷積操作提取響應圖中的多尺度信息并進行融合,從而增強卷積模塊對目標多尺度變化的處理能力。但是多尺度卷積核會帶來計算復雜度的增加,為此,網絡采用了1×1卷積核來先對輸入的特征圖進行降維,然后再用多尺度卷積核來分別處理降維后的特征圖,最后再通過拼接操作來對不同尺度的特征進行融合,成倍地降低了參數數量,從而減輕了過擬合。

(2) 將傳統神經網絡在最后分類時常采用的全連接層替換為了全局平均層。在傳統以全連接層作為最終的全局特征聚合及分類的網絡中,超過80%的參數都是位于全連接層,然而通過全局平均層即可極大地降低這一部分參數的消耗,且同樣可實現全局特征聚合及分類的功能,最終也減輕了過擬合的風險。

(3) 在網絡中加入了兩個輔助分類器,從而在網絡的中間部分也為模型提供梯度反饋。深層網絡最大的弊病就是當網絡變深時會產生梯度消散,而一旦在淺層加入了輔助分類器,就會一定程度上對梯度進行彌補,讓網絡的訓練更有效。

圖3 GoogleNet模型結構圖

圖4 Inception結構

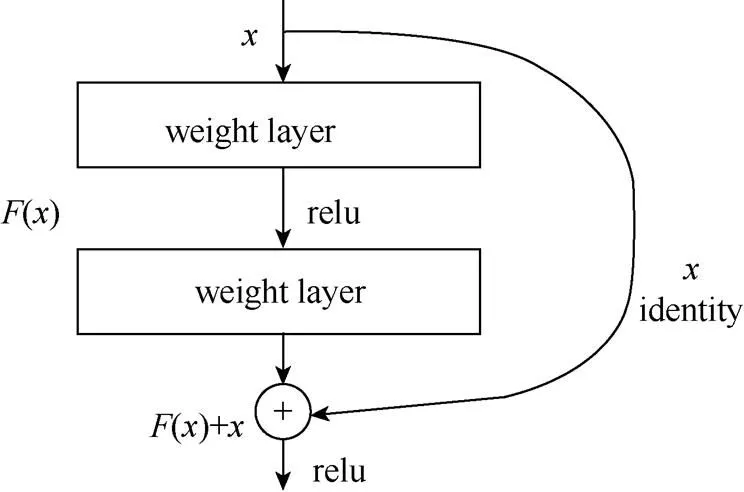

1.1.3 ResNet

ResNet (deep residual network)的全稱是深度殘差網絡,是何愷明等人于ILSVRC 2015競賽上提出的深達152層的深度卷積神經網絡架構,并以絕對優勢獲得圖像分類、圖像定位、圖像檢測3個項目的冠軍,其中在圖像分類的數據集上取得了3.57%的錯誤率。該網絡基于殘差學習的思想,在傳統卷機模塊的基礎上引入了一條shortcut,從而構成了一個殘差模塊,解決了在直接增加網絡深度時會出現的模型“退化”問題(圖5)。

該殘差模塊的輸出為輸入信號與卷積層輸出結果()的疊加,即卷積層僅需要去學習網絡最終輸出結果與其輸入信號之間的殘差值。其好處主要在于:使得網絡的反向梯度傳導過程更加順暢,減輕了在對深層網絡訓練時常出現的梯度消失或是梯度爆炸問題。在簡單堆疊傳統卷積模塊所構成的深度網絡中,梯度的反向傳導是以乘法的方式進行的,隨著層數的加深,傳遞到網絡淺層的梯度信號都會難以避免地受到更大的衰減或是擴張,從而導致了對網絡淺層的訓練失效或是不穩定的問題。而通過堆疊殘差模塊來構成深度網絡即可將梯度的反向傳導轉換為以加法的方式進行,存在有多條路徑可將網絡的梯度信號傳遞到淺層,且其中一條路徑是完全直通的,使得在訓練深度網絡時梯度的傳遞更順暢、更穩定,從而使性能得到了進一步的改善。

圖5 ResNet中的殘差模塊示意圖

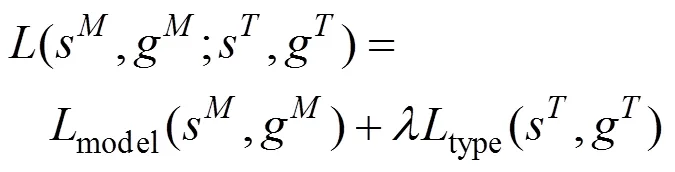

1.2 多任務細粒度車型識別網絡

本文所提出的多任務細粒度車型識別網絡主要包含:①分別以AlexNet、GoogleNet或ResNet等深度卷積神經網絡所構成的特征提取模塊;②結合了細粒度車型識別以及車輛種類分類所構成的多任務損失函數模塊,其中雖然車輛種類分類任務主要是作為一個輔助任務來為細粒度車型識別任務提供更多信息,從而達到正則化的效果,但任務本身也具有不錯的應用前景,且細粒度車型識別任務同樣可為其提供更多信息,即兩個任務之間相互促進,共同為其共享的特征部分提供梯度信息。其多任務損失函數為

2 實驗

2.1 實驗數據集

為了能更好地與之前的工作進行對比,本文所采用的數據集來自于CompCars數據集中“suveillance- nature”部分的數據。圖6展示了從該數據集中隨機取出的一部分圖片,均直接采集自高速公路上的監控攝像頭,因為光照、天氣等因素,圖片質量受到了很大的影響,使得細粒度車型識別任務更具挑戰性,并且也更具有現實意義。

本次實驗使用了該數據集中所有的44 481張車輛前臉圖片,并將其按7:3的比例劃分為了訓練集(31 148張圖片)和測試集(13 333張圖片),訓練集和測試集包含有同樣的281個類別的細粒度車型以及6個類別的車輛種類,且數據類別的分布都是一致的。為了更便于網絡的訓練,將所有圖片的分辨率都調整為了256×256大小。

圖6 CompCars數據集樣例圖片

2.2 實驗細節說明

在訓練多任務細粒度車型識別網絡時,采用了在ILSVRC2012的分類數據集上預訓練好的caffe[20]模型作為網絡的初始化值,然后再針對特定數據集對模型進行微調,原因是ILSVRC2012數據集是一個種類繁多、變化復雜的大規模圖像分類數據集,通過在該數據集上進行預訓練,可使模型學到一些泛化性強、適用于多種任務的通用特征,通常可幫助加速模型在其他特定任務上的訓練進程,且提高模型的性能,尤其是當特定任務的數據量比較少時。通過采用這樣一個預訓練策略,最終測得一個網絡的訓練時間僅需要約2 h,其中GPU配置為GeForce GTX TITANX,CPU配置為Intel? Xeon? CPU E5-2683 v3。

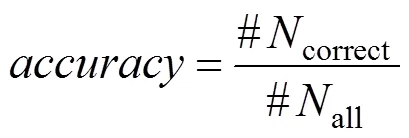

在對預訓練完畢的模型進行微調時,將分類層原先的1 000路輸出改為了并行的281路輸出及6路輸出,分別代表281個類別的細粒度車型及6個類別的車輛種類,并從均值為0、方差為0.001的高斯分布中采樣來對新的分類層進行初始化。在學習率方面,將初始全局學習率設置為了0.001,并將其應用于新加入的分類層,對預訓練的模型部分,則是采取衰減10倍后的學習率,且每訓練10個epochs,將全局學習率衰減10倍。權重衰減系數設置為0.000 1。在評價指標方面則采取了top-1準確率,即以模型對測試集預測正確的樣本數來除以測試集的總數,即

2.3 實驗結果分析

本部分將首先對不同網絡結構下的多任務細粒度車型識別網絡的識別性能進行對比,接著再比較多任務的學習機制相比單任務學習之間的性能差異,最后分別在細粒度車型及車輛類型分類這兩個任務上,將本文方法與近幾年的一些相關工作進行性能對比分析。

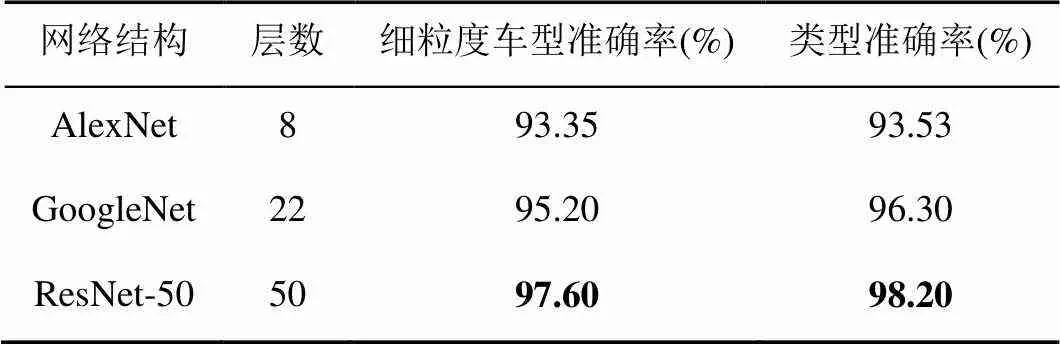

表1定量展示了分別基于AlexNet,GoogleNet及ResNet等3種網絡結構的多任務細粒度車型識別網絡間的性能對比,數據結果表明,隨著網絡層數的增加,模型在細粒度車型識別以及車輛類型分類上的性能也在逐步改善,尤其是50層的ResNet相比8層的AlexNet,其在兩個任務上的識別準確率都提高了約5個百分點。說明在有效緩解了過擬合及梯度消失等諸多問題后,更深的模型在細粒度車型識別及車輛類型分類方面具有更強的非線性建模能力及特征表達能力,因而也更適于應對這類問題。

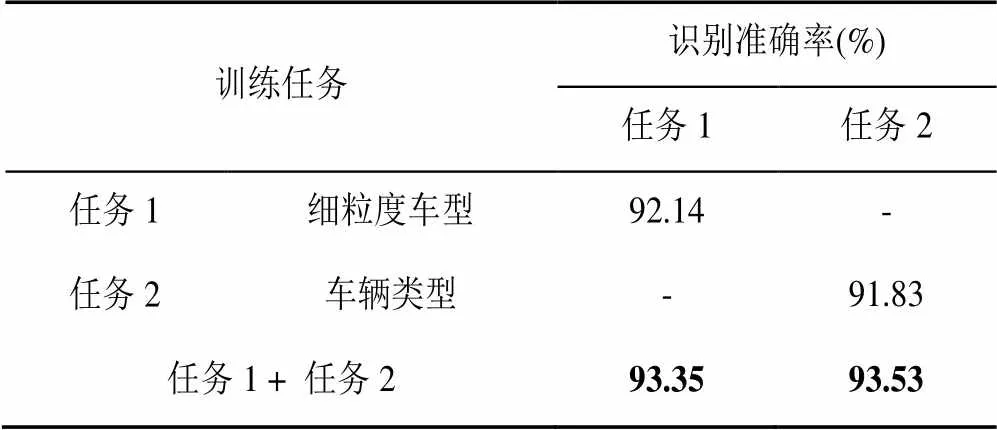

為了進一步探究多任務學習的性能,本文還以AlexNet為基礎網絡架構,比較了細粒度車型識別與車輛類型分類的不同組合下所訓練得到的模型性能(表2)。由表2中數據可知,通過多任務的聯合學習,可使模型進一步挖掘不同任務間隱藏的共有數據特征,從而使得完成每個任務上的準確率都能提升1至2個百分點,結果表明在引入多任務機制在解決上述兩個特定問題上是有效的,主要在于細粒度車型識別與車輛分類任務之間存在有一定的相關性,如寶馬X系列一般都為運動型轎車、而奧迪A系列則一般為轎車。

表1 基于不同網絡結構的模型的識別準確率對比

表2 單任務模型與多任務模型的識別準確率對比

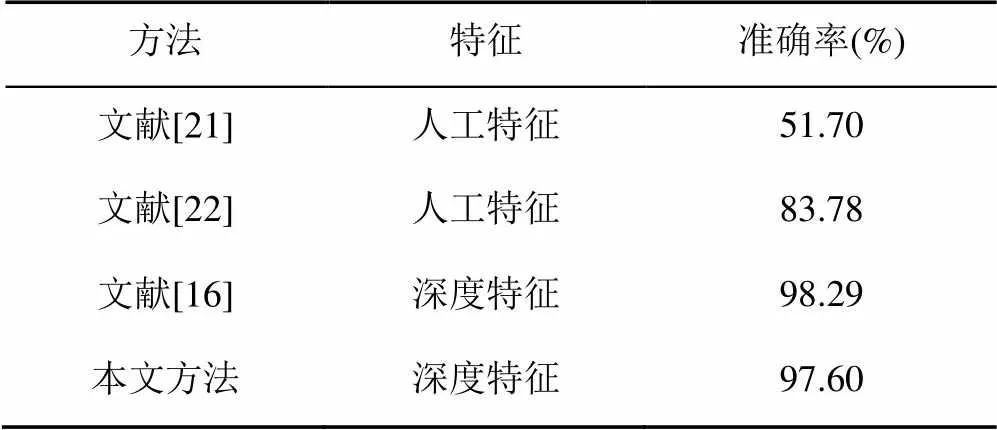

表3則將本文所提出的方法與近幾年在細粒度車型識別任務上取得state-of-the-art的方法做了對比,所有方法的準確率均是在CompCar數據集中的“survelliance-nature”上評估得出的,以保證對比結果的公平及合理。其中,文獻[21-22]等都是基于人工特征的方法,可見受到人工特征對辨識信息提取能力弱、對特定問題適應性差等方面的限制,這些方法在應對類別數較多(281類)、變化因素較復雜的細粒度車型識別任務時,性能與基于深度特征的方法間還有很大差距。文獻[16]的方法雖然在性能上比本文方法略優一些,但采取的是一個多階段的評估流程,即需要分別對車輛全身與車輛部件進行處理才能得到最終結果,而本文方法則僅需要對車輛全身進行處理即可得到一個較優的結果,因而更加簡潔高效。

表3 不同方法在細粒度車型識別任務上的對比

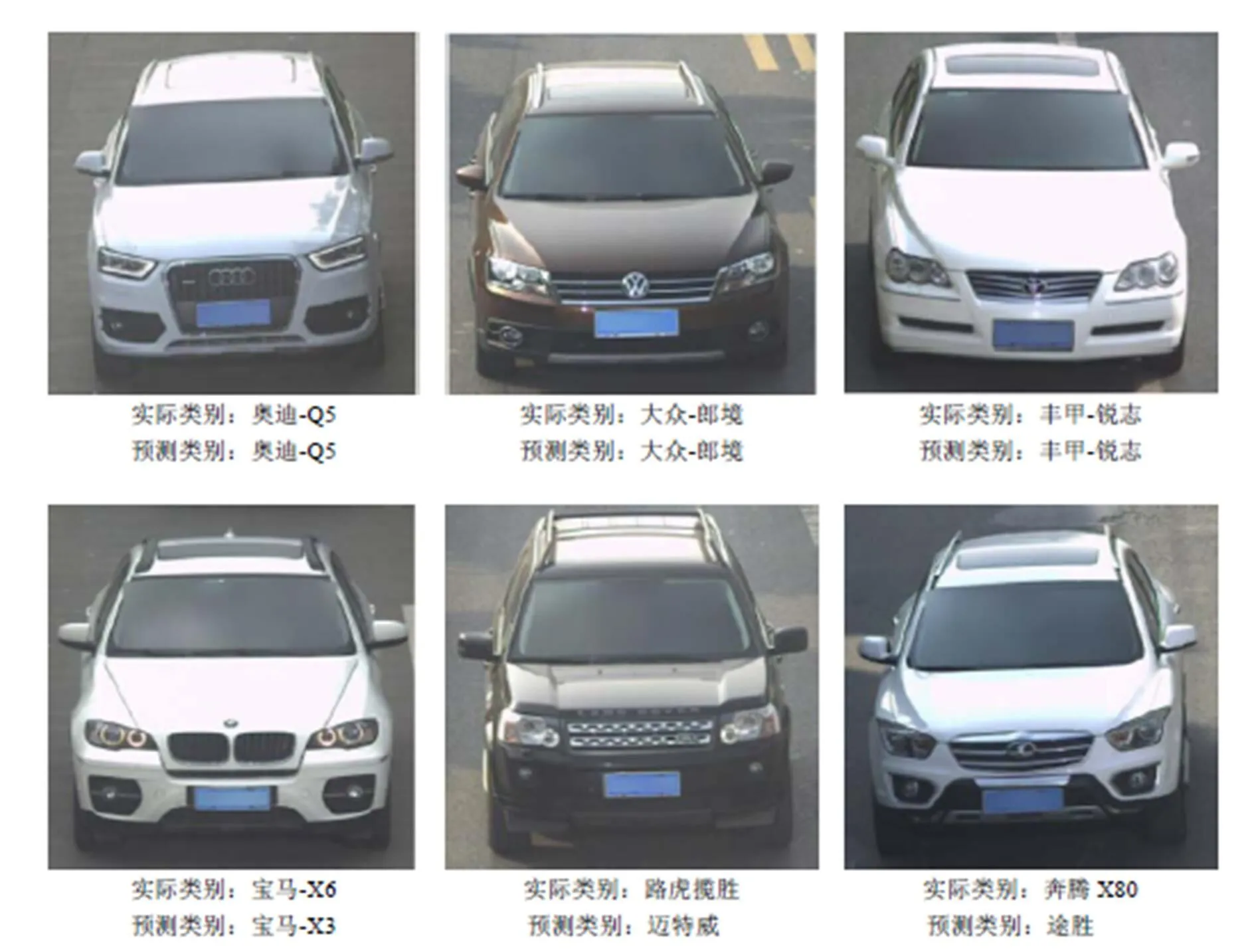

圖7展示的是本文模型的一些定性識別結果。第一行是識別正確的圖片,第二行是識別錯誤的一些例子,通過分析,可以看出識別錯誤主要集中在幾種情況:①同一品牌同一系列的不同年款的車型如寶馬X系列;②外觀極其相近的車型,此類情況更多地發生在SUV這一種車輛類別中;③一些訓練圖片較少的小眾車型容易識別為其他類別,此類情況可以通過加大樣本量來提高識別率。

圖7 部分細粒度車型定性識別結果

3 結束語

本文將經典的幾種深度卷積神經網絡引入到了細粒度車型識別的應用中,并結合多任務學習的思想引入了車輛類型分類的輔助任務來進一步提高模型的性能。通過在一個包含281種細粒度車型的公開數據集上進行實驗,驗證了深度特征相比人工特征具有更強的辨識信息抽取能力,更適用于細粒度車型識別等較為復雜的分類問題,且隨著深度卷積神經網絡的容量及非線性建模能力的增加,模型性能也能得到進一步改善。輔助任務車輛類型分類的引入,可幫助模型挖掘到不同任務間的關聯信息,提高了其在任一單任務上的性能,且仍然保持了很高的效率。最終所實現的方法簡潔高效,日后將這一技術應用于道路監控設備對道路車輛進行實時識別具有一定的指導意義。

[1] ZHANG B. Reliable classification of vehicle types based on cascade classifier ensembles [J]. IEEE Transactions on Intelligent Transportation Systems, 2013, 14(1): 322-332.

[2] PENG Y, JIN J S, LUO S H, et al. Vehicle type classification using data mining techniques [C]//The Era of Interactive Media. New York: : Springer-Verlag, 2013: 325–335.

[3] 汪宇雷, 畢樹生, 孫明磊, 等. 基于SIFT, K-Means和LDA的圖像檢索算法[J]. 北京航空航天大學學報, 2014, 40(9): 1317-1322.

[4] LIU, L X, ZHANG H G, FENG A P, et al. Simplified local binary pattern descriptor for character recognition of vehicle license plate [C]//2010 Seventh International Conference on Computer Graphics, Imaging and Visualization (CGIV). New York: IEEE Press, 2010: 157-161.

[5] DALAL N, TRIGGS B. Histograms of oriented gradients for human detection [C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2005.New York: IEEE Press, 2005: 886-893.

[6] PROKAJ J, MEDIONT G. 3-D model based vehicle recognition [C]//2009 Workshop on Applications of Computer Vision (WACV). New York: IEEE Press, 2009: 1-7.

[7] RAMNATH K, SINHA S N, SZELISKI R, et al. Car make and model recognition using 3d curve alignment [C]//2014 IEEE Winter Conference on Applications of Computer Vision (WACV). Los Alamitos: IEEE Computer Society, 2014: 285-292.

[8] 山世光, 闞美娜, 劉昕, 等. 深度學習: 多層神經網絡的復興與變革[J].科技導報, 2016, 34(14): 60-70.

[9] KRIZHEVSKY, A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks [J]. Communi Cations of the ACM, 2017, 60(6): 84-90.

[10] SZEGEDY C, LIU W, JIA Y Q, et al. Going Deeper With Convolutions [C]//The IEEE Conference on Computer Vision and Pattern Recogntion. New York: IEEE Press, 2015: 1-9.

[11] HE K M, ZHANG X G, REN S Q. Deep residual learning for image recognition [C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2016: 770-778.

[12] ZHANG N, DONAHUE J, GIRSHICK R, et al. Part-based R-CNNs for finegrained category detection [C]// European Conference on Computer Vision.Cham: Springer, 2014. 834-849

[13] GUILLAUMIN M, KüTTEL D, FERRARI V. ImageNet auto-annotation with segmentation propagation [J]. International Journal of Computer Vision, 2014, 110(3): 328-348

[14] LIN D, SHEN X Y, Lu C W, et al. Deep LAC: deep localization, alignment and classification for fine-grained recognition [C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2015. 1666-1674

[15] YANG L J, LUO P, LOY C C, et al. A large-scale car dataset for fine-grained categorization and verification [C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2015: 3973-3981.

[16] FANG, J, ZHOU Y, YU Y, et al. Fine-Grained vehicle model recognition using a coarse-to-fine convolutional neural network architecture [J]. IEEE Transactions on Intelligent Transportation Systems 2016, 18(7): 1782-1792.

[17] SOCHOR J, HEROUR A, HAVEL J. BoxCars: 3D boxes as cnn input for improved fine-grained vehicle recognition [C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2016: 3006-3015.

[18] HU B, LAI J H, GUO C C. Location-aware fine-grained vehicle type recognition using multi-task deep networks [J]. Neurocomputing, 2017, 243: 60-68.

[19] WANG Q, WANG Z, XIAO J, et al. Fine-grained vehicle recognition in traffic surveillance [C]//PCM 2016 17thPaeific-Rim Conference on Advances in Multimedia Information. New York: Springer-Verlag. 2016: 285-295.

[20] JIA Y Q, SHELHAMER E, DONAHUE J, et al. Caffe: convolutional architecture for fast feature embedding [C]// Proceedings of the 22ndACM International Conference on Multimedia. New York: ACM Press. 2014:675-678

[21] HSIEH J W, CHEN L C, CHEN D Y. Symmetrical SURF and its applications to vehicle detection and vehicle make and model recognition [J] IEEE Transactions on Intellingent Transportation Systems, 2014, 15(1): 6-20.

[22] ZHANG B L. Reliable classification of vehicle types based on cascade classifier ensembles [J] IEEE Transactions on Intelligent Transportation Systems, 2013, 14(1):322-332.

Multitask Fine-Grained Vehicle Identification Based on Deep Convolutional Neural Networks

Wang Haiyao1, Tang Juan2, Shen Zhenhui1

(1. School of Engineering, Fujian Jiangxia University, Fuzhou Fujian 350108, China; 2. School of Management Engineering,Anhui Polytechnic University, Wuhu Anhui 241000, China)

Vehicle identification, especially fine-grained vehicle identification, is an important part of modern intelligent transportation system. Aiming at the problem that it is difficult to effectively recognize fine-grained vehicle using traditional vehicle identification methods, we take three classic deep convolutional neural networks (such as AlexNet, GoogleNet and ResNet) as the basic networks, and introduce the classification of vehicle types as the auxiliary task, together with fine-grained vehicle identification task to constitute a multitask joint-learning model. By training and evaluating our model on a public data set which contains 281 vehicle types, we have demonstrated the excellent performance of this model in fine-grained vehicle identification task with no need of annotations about vehicle parts’ location and additional 3D information. Besides, with the introduction of multitask learning strategy, the performance of this model can be improved, compared with that of any single-task learning model. Our model is simple and efficient, and can basically meet the demand of practical applications.

intelligent transportation;fine-grained vehicle identification; deep learning; neural networks

TP 391

10.11996/JG.j.2095-302X.2018030485

A

2095-302X(2018)03-0485-08

2017-08-27;

2017-09-28

福建省中青年教師教育科研項目(JAS160616)

王海瑤(1976-),女,安徽固鎮人,講師,碩士。主要研究方向為智能調度、流程優化等。E-mail:723570259@qq.com