深度神經網絡在無源定位中的應用研究

, ,

(北京無線電測量研究所, 北京 100854)

0 引言

對于無源定位系統,常見的定位算法有測向時差定位、時差定位、時差頻差定位等,大多數定位系統僅僅利用了不多于兩種的測量信息,同時由于測量噪聲的統計特性不準確,導致定位精度受到不同程度的影響[1]。

為了加強多源信息融合和定位系統的魯棒性,文獻[2-3]運用神經網絡將接收到的信號強度與接收距離之間的非線性關系進行擬合,然后利用接收距離和位置坐標的方程關系進行求解。另外,文獻[4]則將測量得到的時差和方向信息輸入到神經網絡中進行修正,然后利用定位算法進行求解。這些方法大多被運用在室內的無線定位中,空間范圍較小,所使用的神經網絡的層數也較少。與采用全連接神經網絡不同的是,文獻[5]使用的是徑向基函數(Radial Basis Function, RBF)神經網絡,場景和測量參數也比較簡單,然而在較為復雜的環境中徑向基函數神經網絡這種淺層結構的建模能力有限,其擬合效果就明顯不如深層的神經網絡[6]。同時,上述幾乎所有的文獻都沒有使用相應的泛化方法,僅僅用訓練時的樣本點作為測試,得到的結果不具有說服力。

本文將使用深度神經網絡,將樣本點的多種測量信息輸入到神經網絡中,通過改變輸入參數的個數和神經網絡的層數,并且運用正則化方法進行泛化,找到了最佳的超參數組合,并且與單層的全連接神經網絡和RBF神經網絡的定位精度進行了對比,仿真實驗證明該深度神經網絡模型可以提高定位精度和魯棒性。

1 時差定位系統

1.1 模型建立

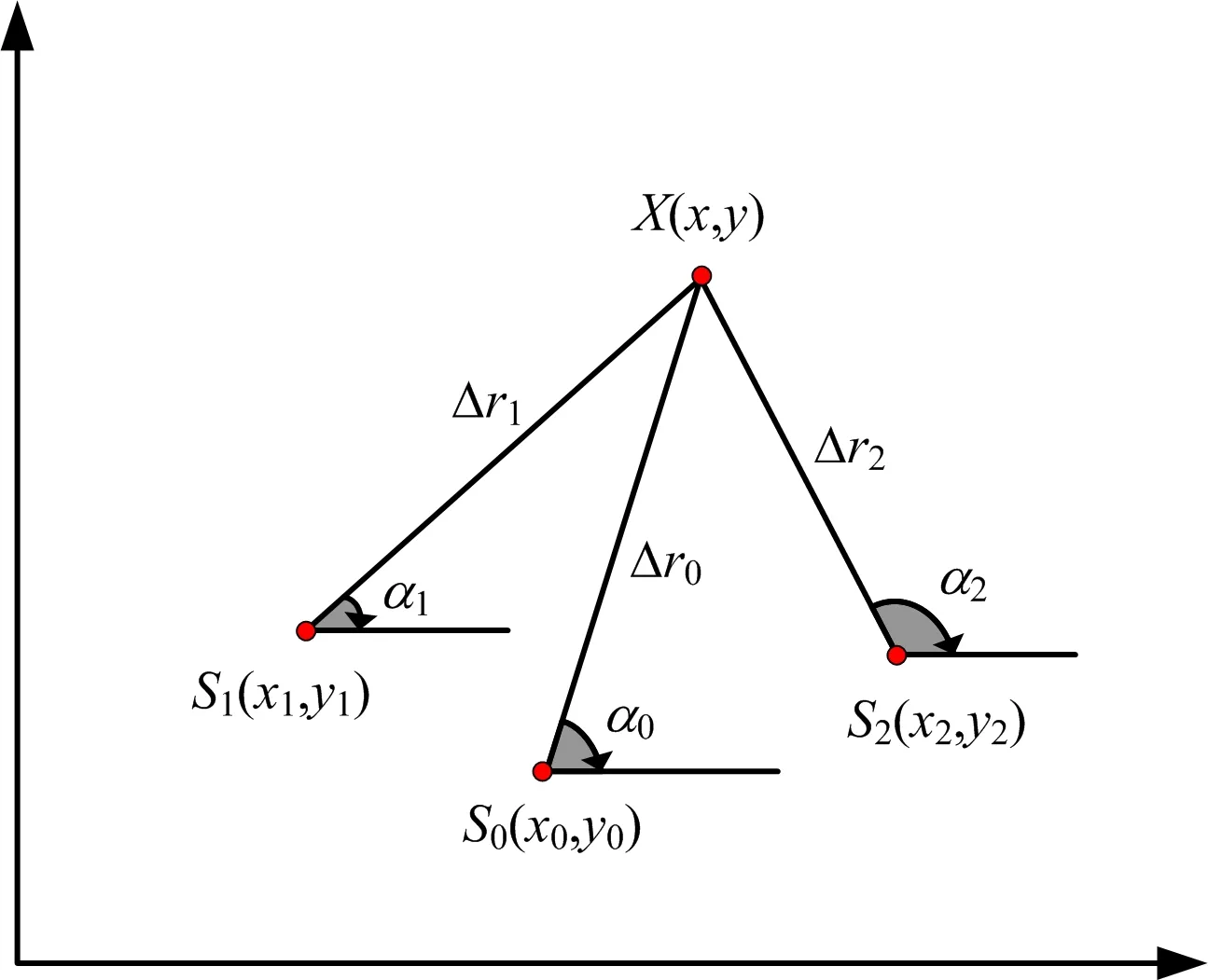

假設有3個雷達接收站,如圖1所示,每個雷達接收站的坐標為Si(xi,yi) (i=0, 1, 2),輻射源的坐標為X(x,y),設輻射源到每個雷達接收站的距離為

Δri=||X-Si||,i=0,1,2

(1)

圖1 三站時差定位示意圖

每個雷達接收站到原點的距離為ri,以算出輻射源到任意兩個接收站的距離差為

Δrij=Δri-Δrj,i,j=0,1,2,i≠j

(2)

為了便于分析并且不失一般性,以第一個接收站作為參考,可以得到兩個互不相關的距離差:

Δrm0=Δrm-Δr0,m=1,2

(3)

將這些距離差公式組成一個方程組并進行化簡,可以得到

(x0-xm)x+(y0-ym)y-Δrm0Δr0-

(4)

解方程得到輻射源的位置估計為

X=(ATA)-1ATF

(5)

式中,

利用式(5),得到x,y關于Δr0的等式。

進一步根據式(6)即可算出輻射源的位置:

(6)

1.2 定位精度分析

定位精度一般用GDOP來表示,也就是定位精度的幾何稀釋度,其表達式為

(7)

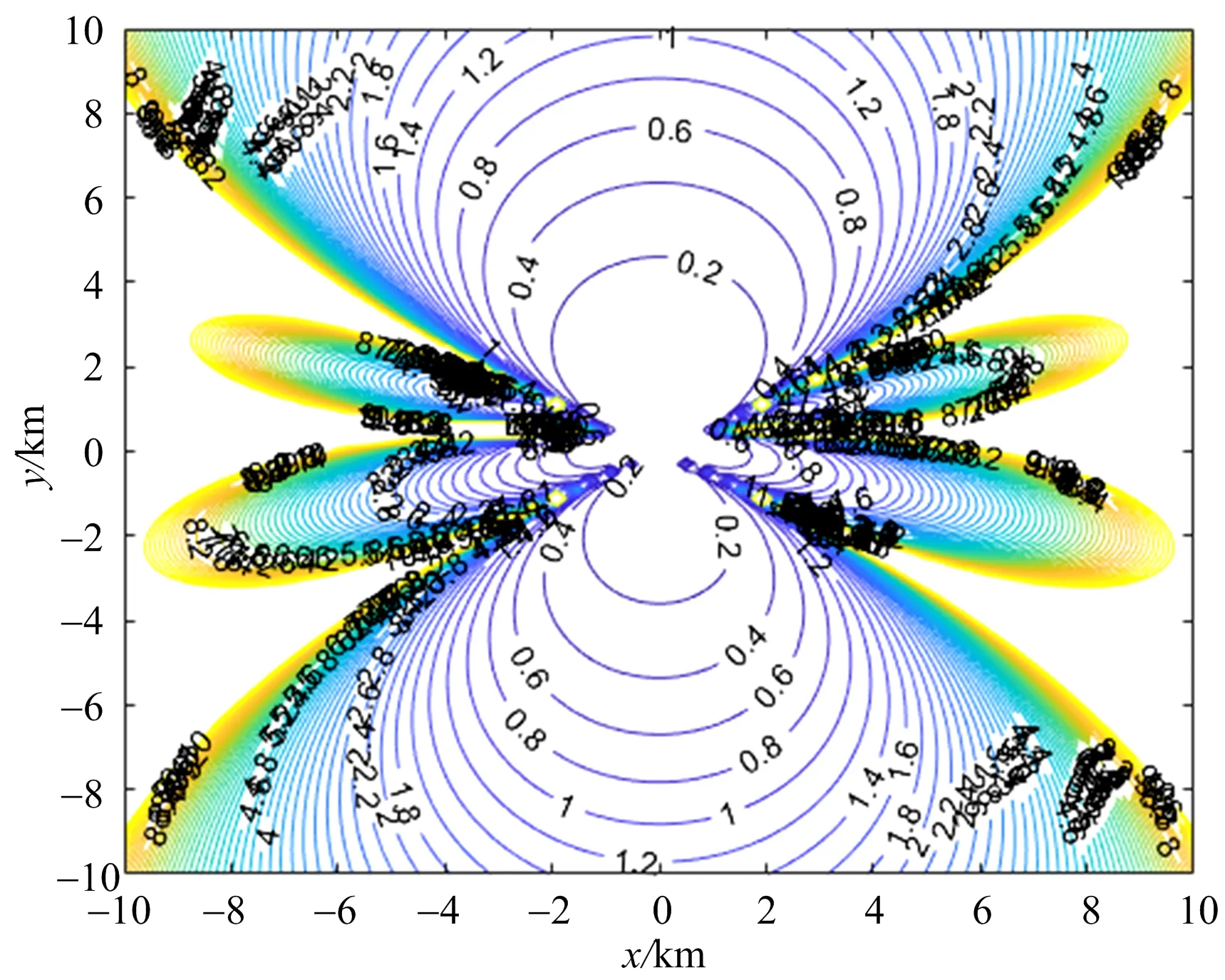

仿真設置:3個基站的坐標分別為S0(0,0) km,S1(0.5×1.732,0.5) km,S2(-0.5×1.732,0.5) km,時差均方根誤差為20 ns,基站坐標均方根誤差為0.5 m。

GDOP等值線圖如圖2所示。

圖2 GDOP分布圖

2 深度神經網絡定位

2.1 模型提出

神經網絡是在20世紀提出來的一種模仿動物神經網絡行為特征來進行分布式并行信息處理的算法數學模型。應用主要涵蓋在圖像處理、信號處理、模式識別、機器人控制等方面,其主要優點有:1)信息分布存儲在網絡內的神經元中,具有很強的魯棒性和容錯性;2)自學習、自組織、自適應性使得網絡可以處理不確定或未知的系統;3)具有很強的信息綜合能力,能同時處理定量和定性的信息,能很好地協調多種輸入信息關系,適用于多信息融合和多媒體技術。

圖3是一個含有1個輸入層、1個隱藏層和1個輸出層的神經網絡示意圖。其中輸入層的神經元有3個,依次將其編號為1,2,3;隱藏層的神經元有4個,依次將其編號為4,5,6,7;輸出層的神經元有2個,依次將其編號為8,9。另外在輸入層和隱藏層的每一層都有一個偏置單元,圖中用+1表示。這個神經網絡為一個全連接的神經網絡,每個節點都和上一層的所有節點有連接。比如隱藏層的節點4和輸入層的3個節點1,2,3都有連接,其連接上的權重分別為w41,w42,w43。節點4的輸出值a4的計算公式為

a4=f(w41x1+w42x2+w43x3+w4b)

(8)

圖3 神經網絡示意圖

式(8)中的w4b為節點4的偏置項,f為神經網絡的激活函數,選取在深度神經網絡中最常用的修正線性單元(Rectified Linear Unit, ReLU)函數。

同樣,通過計算出節點5,6,7的輸出值a5,a6,a7,節點8的輸出值y1的計算公式為

y1=f(w84a4+w85a5+w86a6+w87a7+w8b)

(9)

圖3所示僅為單隱層的神經網絡,由于其擬合能力有限,因此可以通過增加隱藏層的個數,使其具有更好的表達能力。

2.2 模型訓練

在-10~10 km的方形區域內以均勻分布的概率隨機選取1 000個點的坐標值(x,y),然后算出時差值和方向正切值作為測量參數。為了模擬噪聲環境并與圖2形成對比;參考1.2節中的仿真設置,對時差加上均值為0、均方根誤差為20 ns的高斯分布隨機數,在方向角度值上加上均值為0、均方根誤差為3 mrad的高斯分布隨機數。最后得到無噪聲和有噪聲各1 000個樣本點以及其對應的測量參數。

運用式(10)對輸入的參數包括時差和方向角正切值進行歸一化處理:

(10)

式中,μ為樣本均值,σ為樣本數據的標準差。

然后將這1 000個樣本隨機分為3組:訓練樣本組(600個)、交叉驗證樣本組(200個)、測試樣本組(200個)。

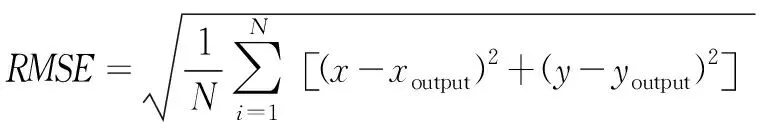

損失函數設置為均方根誤差(RMSE):

(11)

式中,x和y分別是樣本中的真實坐標,xoutput和youtput分別是神經網絡的輸出坐標值。

然后將經過歸一化處理的測量參數輸入到神經網絡中,參數個數依次為5(Δt10,Δt20, tanα0, tanα1, tanα2),4(Δt10, Δt20, tanα0, tanα1),3(Δt10,Δt20, tanα0),2(Δt10, Δt20)。

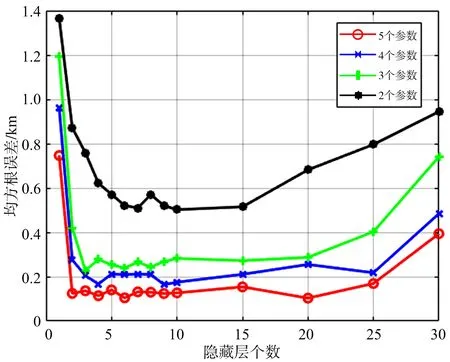

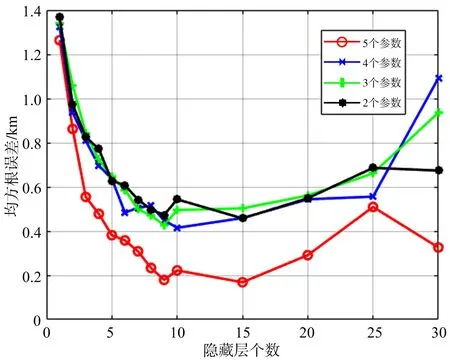

每個隱藏層的神經元個數為100個,得到訓練結果如圖4和圖5所示。

圖4 無噪聲訓練組RMSE與隱藏層個數的關系

圖5 有噪聲訓練組RMSE與隱藏層個數的關系

圖4為無噪聲訓練組樣本的隱藏層個數的增多與RMSE的變化關系曲線,從圖4可以看出,隨著隱藏層個數的增多,每條曲線的整體趨勢是先下降后趨于變化緩慢最后又上升的趨勢。在無噪聲的情況下,當隱藏層的個數過多時,神經網絡已經學習不到樣本的特征,甚至會出現性能下降的情況。并且隨著輸入參數的增多RMSE值在逐漸減小,證明了神經網絡對多源信息的綜合利用。

圖5為有噪聲訓練組樣本的隱藏層個數的增多與RMSE的變化關系曲線,從圖5可以看出,隨著隱藏層個數的增多,每條曲線呈現出先下降后趨于變化緩慢最后又上升的趨勢。說明在有噪聲的情況下,當隱藏層的個數過多時,神經網絡已經學習不到樣本的特征,甚至會出現性能下降的情況。當輸入參數個數由2個增加到3個和4個的時候擬合效果沒有明顯提高,但當增加到5個參數的時候,RMSE值有了明顯的下降。

2.3 模型泛化

機器學習中的一個核心問題是設計不僅在訓練數據上表現好,而且能在新輸入上泛化好的算法。在機器學習中,有許多減少測試誤差的策略,這些策略被統稱為正則化,其以偏差的增加換取方差的減小。深度學習中正則化方法主要包括有范數正則化、提前終止、集成方法和隨機失活(Dropout)[7]等,其中隨機失活提供了正則化一大類模型的方法,計算方便但功能強大,是大量深度神經網絡的實用集成方法,如文獻[8]集成了6個神經網絡贏得了ImageNet大規模視覺識別挑戰賽(ImageNet Large Scale Visual Recognition Challenge, ILSVRC)。

針對以上幾種正則化方法進行分析。提前終止是通過觀測訓練集和測試集數據的學習曲線進行手動操作的方法,使用簡單但是需要大量人為干預,效果提升有限。文獻[7]顯示,Dropout比范數正則化方法更有效,它的另一個優點是計算方便,訓練過程中產生n個隨機二進制數與狀態相乘,每個樣本每次更新只需O(n)的計算復雜度,n代表模型中的神經元總個數。另外,文獻[9]中將Dropout與其他的集成方法進行對比并得出結論:相比獨立模型集成獲得泛化誤差,Dropout會帶來額外的改進,是對集成方法的一種近似,計算復雜度也較小。

Dropout的另一個顯著優點是具有廣泛的適用性,幾乎在所有分布式表示且可以用隨機梯度下降訓練的模型以及各種場景中都表現很好。例如文獻[10]將其運用在貝葉斯神經網絡中,文獻[11]討論了在循環神經網絡中的使用情況,文獻[12]研究了Dropout在長短期記憶網絡中的應用。

無源定位通過對測量參數的運算得到目標的位置,其實質是一個在特定場景下將參數作為輸入、將位置坐標作為輸出的一個映射系統,又因為上文中提到的Dropout的各種優勢,因此本文選擇Dropout作為正則化方法來提高深度神經網絡的泛化性能。

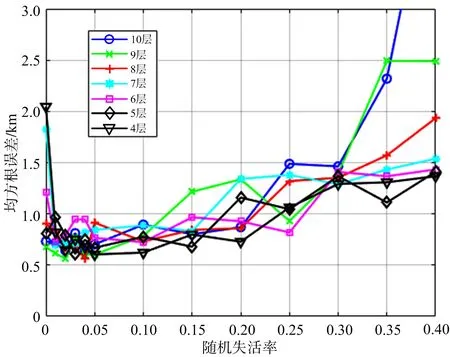

根據圖4無噪聲訓練組中輸入參數為5個的情況,當隱藏層個數在1~4時,RMSE的值都在減小,而在4~10個隱藏層時,RMSE的值存在波動,因此將4~10作為隱藏層個數的備選值。另一方面,隨機失活率是一個0~1的概率數字,過大或過小都會反而令測試集的誤差升高,嘗試將0~0.4作為隨機失活率這一維度的備選值,得到的驗證組(200個)的RMSE變化曲線如圖6所示。

圖6 驗證組RMSE與Dropout值的關系

從圖6可以看出,采用隨機失活減少了驗證組的RMSE,各曲線的變化趨勢為先下降后波動最后上升,圖中波動部分的最低處即為最優的參數選擇,即當隱藏層數為9層、Dropout值為0.02時,驗證組的RMSE數值最小,為0.6 km。

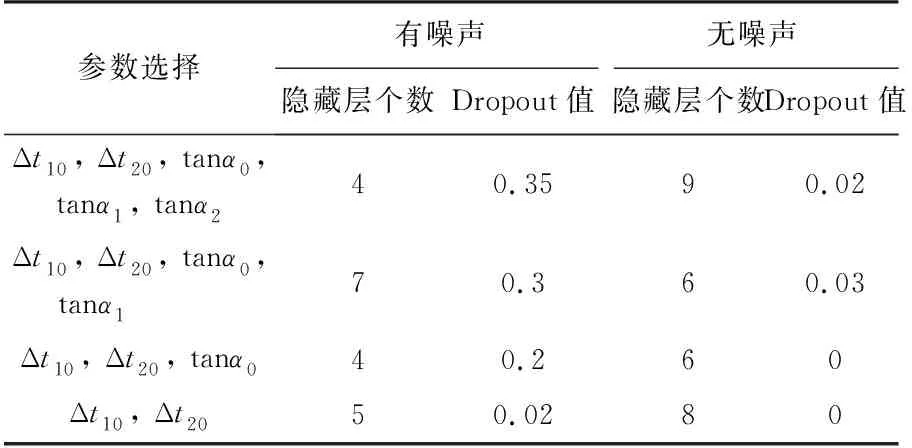

同理,對于有噪聲和無噪聲情況下不同的參數個數,采用二維搜索,都會得到類似圖6的結果,此處不再一一展示,選取圖像最低點處作為各自網絡模型的最優超參數取值,如表1所示。

表1 神經網絡最優隱藏層數和Dropout值選擇

3 仿真分析

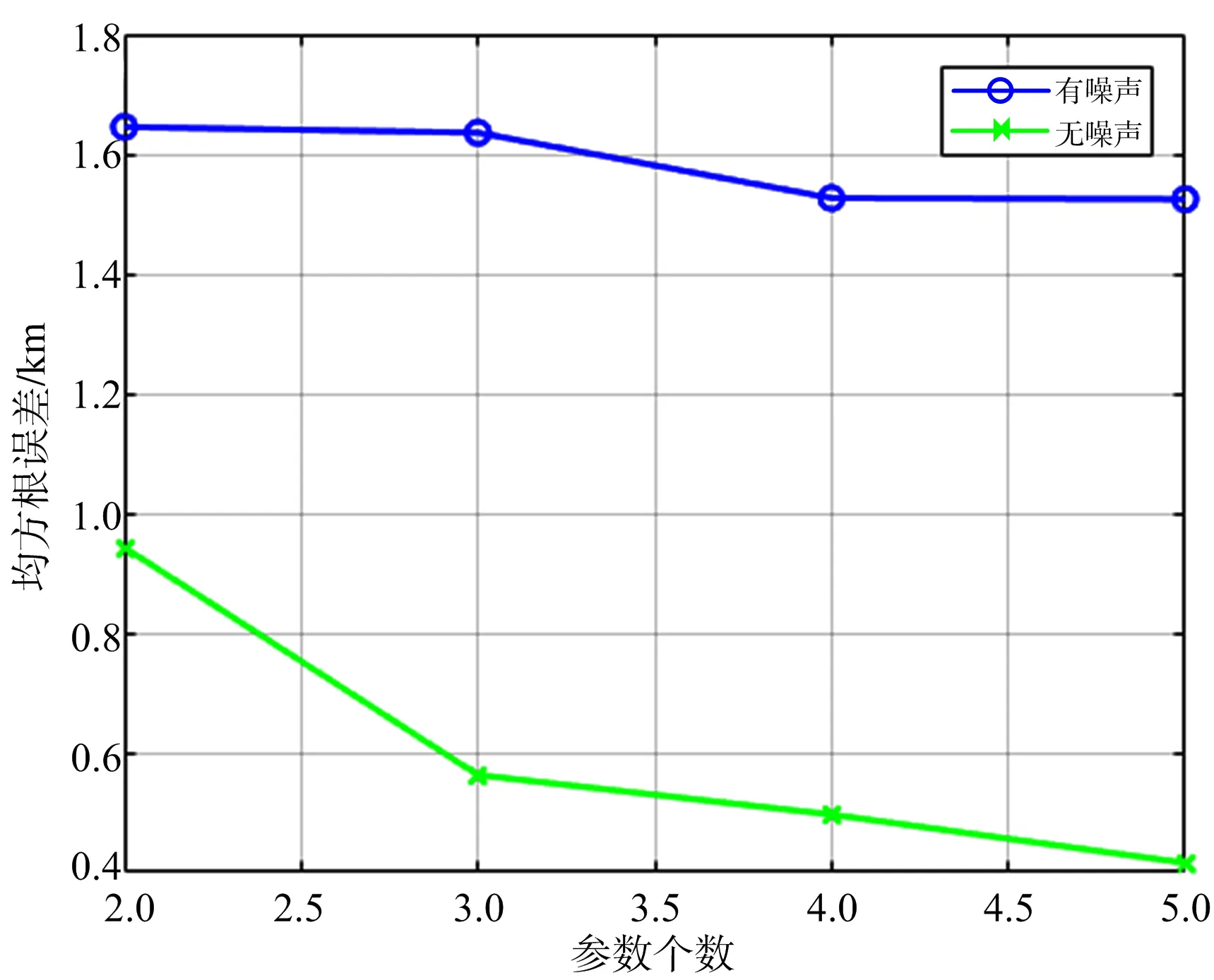

3.1 測試組仿真分析

從表1中得到神經網絡的最優超參數取值,將有噪聲和無噪聲測試組的200個樣本點分別輸入到對應的神經網絡中,得到圖7中測試組的RMSE圖像。從圖中可以看出,不管是有噪聲組還是無噪聲組,隨著測量參數個數的增多RMSE值都在降低,證明了神經網絡對于多源信息的綜合利用。

另外可以計算出在有噪聲情況下,測試組的樣本點利用1.1節中的方程方法得到的RMSE值為62.03 km。圖7顯示有噪聲測試組中誤差的最小和最大值分別為1.52 km和1.65 km,分別對應5個和2個測量參數。

得到結論:使用特定場景下的定位數據訓練得到的深度神經網絡定位模型,相比于超短基線(如1.2節中雷達間距為1 km)無源雷達定位系統,在此場景下其定位精度可以提高37.70~40.69倍。

圖7 測試組RMSE與參數個數的關系

3.2 對比仿真

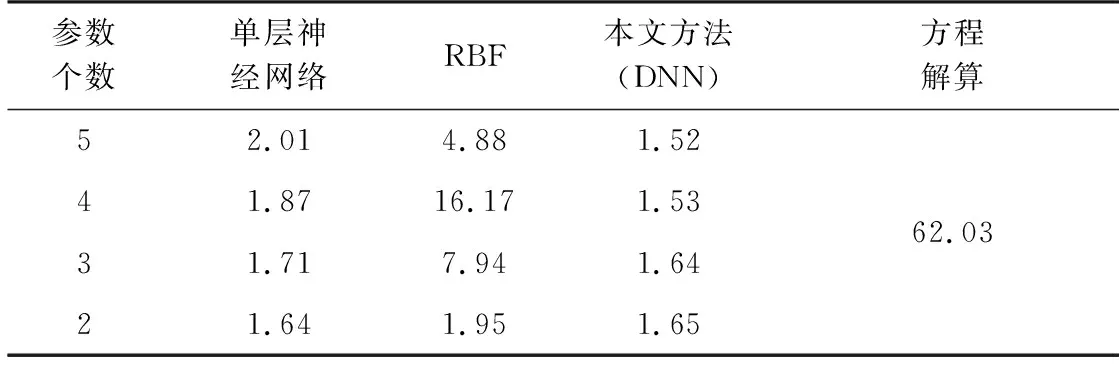

分別使用單隱層的全連接神經網絡和RBF神經網絡對有噪聲組樣本進行建模,并用測試組樣本算出每種方法的RMSE值,最終得到如表2所示的對比結果。

表2 不同方法的RMSE值對比 km

從表2可以看出,淺層的網絡結構建模能力有限,在處理大量有噪聲的信號樣本時,本文提出的深度神經網絡模型具有更好的定位精度和多源信息融合能力。

3.3 模型擴展仿真分析

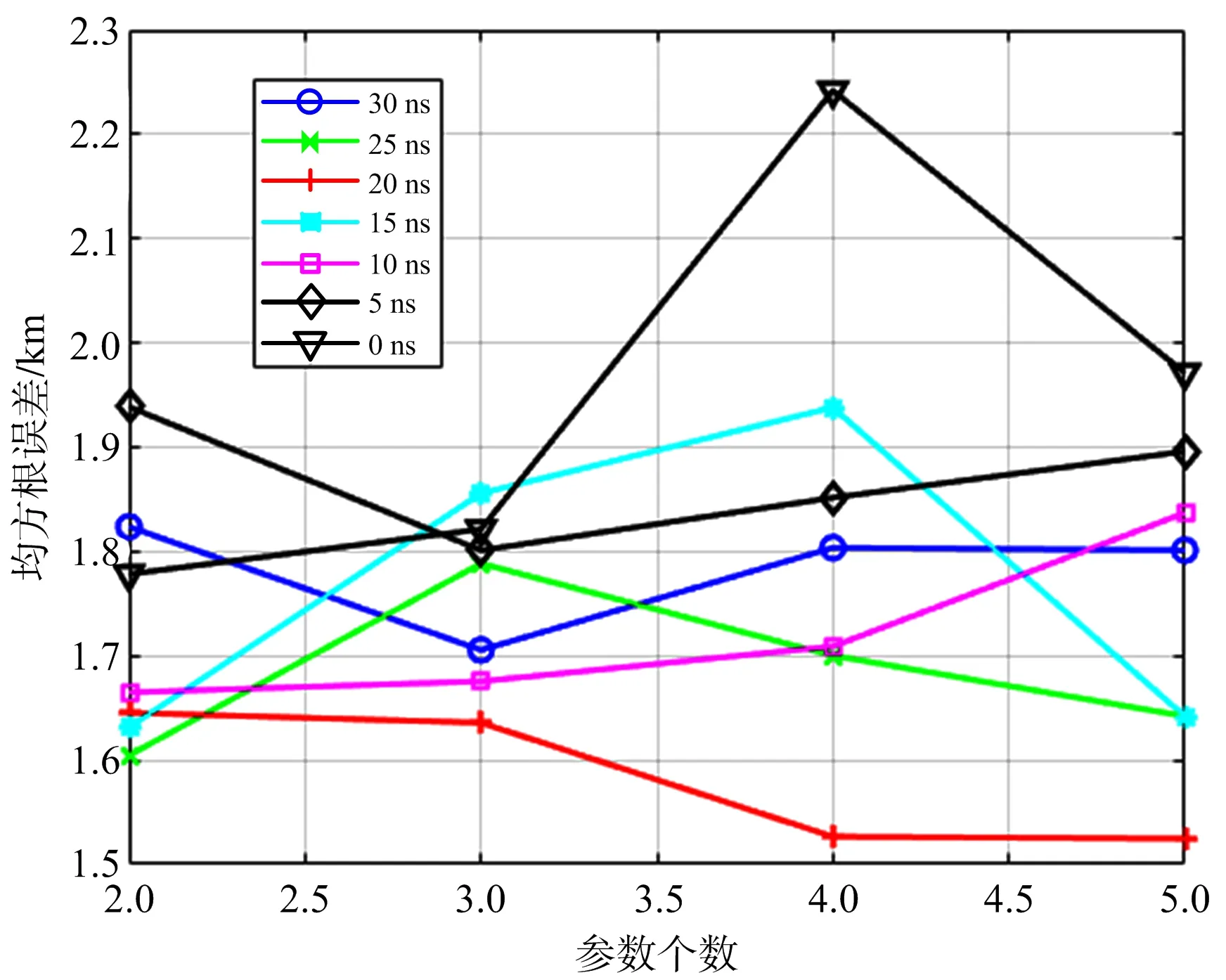

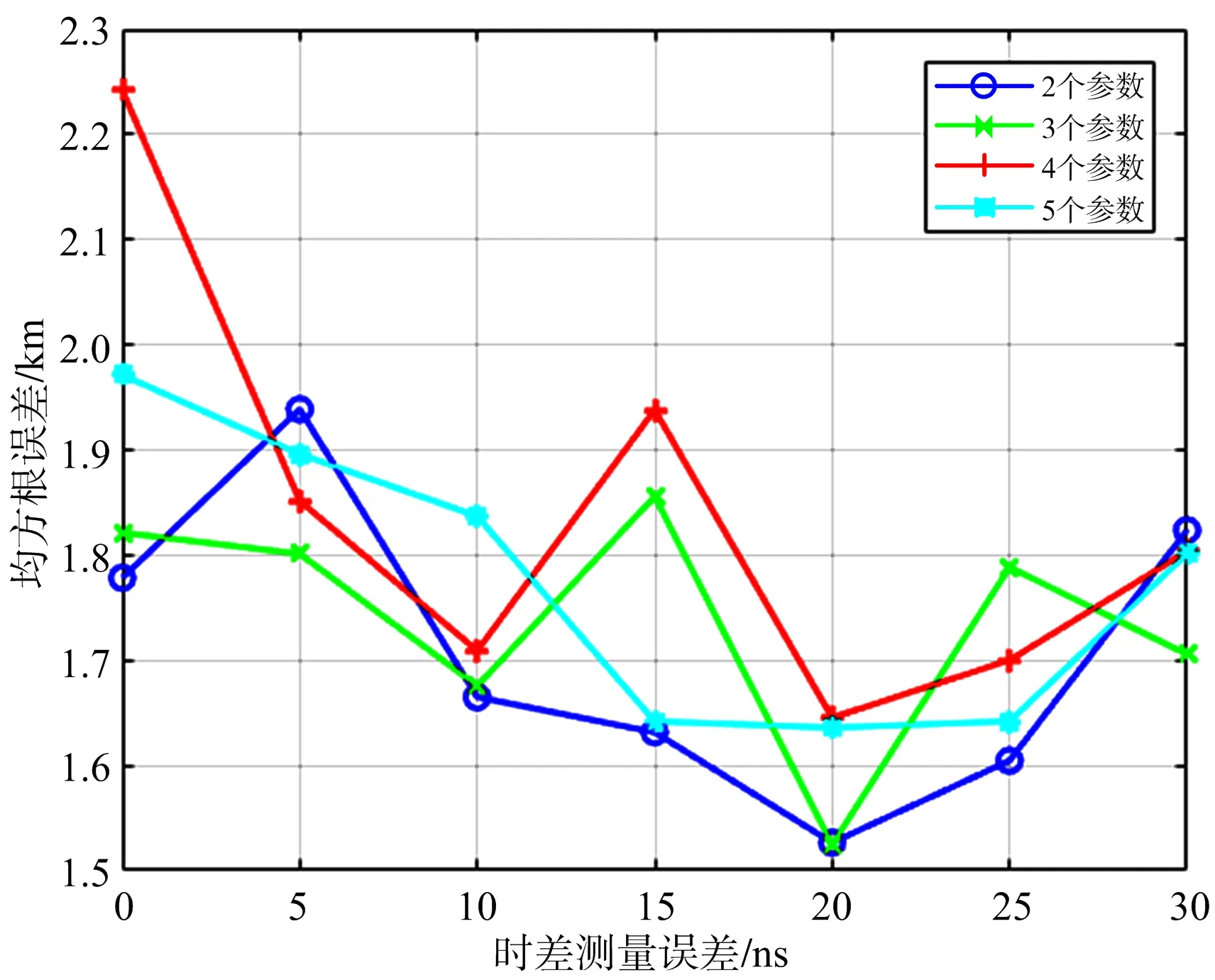

表1中有噪聲一欄的超參數組合是用時差噪聲均方根為20 ns的樣本訓練出來的,將這些樣本的時差噪聲均方根改變,然后輸入到此時已經確定超參數的神經網絡中,得到如圖8和圖9所示的結果。

圖8 在不同時差噪聲均方根取值的情況下RMSE與參數個數的關系

從圖8可以看出,雖然神經網絡是用噪聲均方根為20 ns的樣本訓練出來的,但也基本適用于不同噪聲均方根取值的樣本,其RMSE值不超過2.3 km,說明神經網絡學習到的不僅是具體的數值,更是對噪聲分布的修正。

圖9 在不同參數個數的情況下RMSE與不同時差噪聲均方根取值的關系

從圖9可以看出,對于每條曲線,其趨勢基本上是從20 ns最低處向兩側進行延伸升高,說明訓練數據與測試數據的噪聲參數取值越接近,其定位精度越高。

4 結束語

本文提出一種基于深度神經網絡的無源定位方法,采用大量樣本數據進行經驗式學習,以此來替代方程解算這一規則式的定位方法。在離線階段,通過訓練數據和交叉驗證數據得到深度神經網絡的模型參數。在定位階段,使用帶噪聲的不同數量的測量信息進行定位。仿真實驗結果表明,該算法可以對多源信息進行綜合利用,在噪聲統計特性未知的情況下得到更好的定位精度,對特定場景下的超短基線無源雷達定位情況尤其適用。

該方法的主要缺點是需要大量的數據進行訓練,誤差分布隨機性較大,需要和方程定位方法綜合使用。