基于PNP的多尺度目標視覺智能輔助降落系統

夏路 王琳 梁穎茜

摘要:小型無人機系統一般有氣壓計、陀螺儀、加速度計、光流計和GPS等機載傳感器,由于飛行過程中機體結構產生的振動、建筑物遮擋和電磁干擾等因素,無人機的姿態和位置信息測量包含嚴重的測量噪聲,無法滿足精確降落要求,為保證無人機自主降落精度、實時性和安全性,利用計算機視覺技術和深度學習框架設計多尺度目標視覺智能輔助降落系統,針對GPS定位系統受到嚴重干擾情況,通過多尺度合作目標和PNP算法進行精確姿態和位置解算,從而向無人機系統提供精確的降落導航信息,在50Hz仿真條件下,視覺智能輔助降落系統在距目標20cm處能提供0.7cm/1.2°的定位精度,距目標15m處能夠提供12cm/3°的定位精度,平均精度約為3cm/2°,能夠滿足無人機自主降落要求。

關鍵詞:計算機視覺;深度學習;合作目標;自主降落

中圖分類號:TP391.9文獻標識碼:ADOI:10.19452/j.issn1007-5453.2020.10.004

美國空軍新版《科技戰略》中為了提供有韌性的信息共享確立了基于視覺、天文和磁的替代導航的關鍵技術[1]。由于無人機駕駛員處于地面環境中,無法及時從飛行環境中獲得多項直接的感覺輸入,包括無人機周圍環境的視覺信息、運動感覺等,所以需要無人機自主進行視覺導航[2]。無人機視覺導航技術是指無人機通過機載攝像機獲取周圍環境與目標的圖像信息,然后通過分析處理圖像來獲取運動目標的信息,最后將視覺反饋信息作為無人機控制回路的輸入,從而實現無人機的自主飛行。

國外科研機構和大學對無人機光學視覺輔助降落的研究較早。1991年,美國南加州大學研究人員利用機載相機和處理平臺實現了無人機在預知環境條件下的自主降落[3]。2016年,德國航空航天中心的研究人員實現了固定翼無人機在75km/h汽車車頂的自主降落[4]。Tsai等[5]設計了T形的黑白圖標合作目標輔助無人機著陸,用Hu不變矩識別T形目標,利用canny邊緣檢測以及hough變換提取T形中的特征。

國內對光學視覺輔助無人機降落的研究起步較晚。南京航空航天大學通過檢測地平線和跑道線進行無人機位姿估算的方法,對固定翼無人機視覺輔助自主降落進行了研究[6];浙江大學基于雙目立體視覺的信息,估算無人機的飛行參數,對無人機視覺輔助自主降落階段的導航技術進行了研究[7]。南京航空航天大學徐貴力課題組[8-9]考慮到夜間著陸問題,選擇波段為8~14mm的高發率粉體,制成黑色紅外涂料,噴涂于T形合作目標表面,利用不變矩算法實現目標和特征的檢測[10]。2016年,國內部分大學和研究機構逐漸由模型算法轉向實體試驗,如南京航空航天大學的無人機紅外視覺自動降落引導系統和哈爾濱工業大學的無人機自主計算視覺定位方法等[11-12]。

圖像處理技術以及攝像機硬件的發展使計算機視覺技術與無人機的導航問題相互關聯。首先,依靠視覺所提供的實時信息可以與慣性導航和全球衛星定位系統信息進行融合,彌補后兩者的缺陷,提高導航精度[13]。其次,攝像機相對傳統傳感器而言更善于捕捉運動信息,從應用的角度來看,視覺信號的抗干擾性能較強,而無線電和GPS信號則易受阻塞[14]。最后,攝像機屬于被動傳感器,利用的是可見光或者紅外線這種自然信息,這在軍事隱蔽偵察上尤為重要[15]。

目前無人機視覺導航主要有兩種形式:一種是將機載攝像頭拍攝的圖像通過遠距離圖像傳輸模塊發送回地面站,將數字圖像處理與導航解算的工作放在地面站上運行,將解算得到的導航信息通過數據傳輸模塊發送回無人機。這種方法的優點在于容易實現,且計算能力強大,缺點在于圖像傳輸過程中會受到較大干擾造成圖像失真,同時存在一定的時延,無法滿足實時性要求。另一種方法則是采用機載運算模塊進行圖像處理,攝像頭獲取的數字圖像直接通過串口傳輸給機載的圖像處理模塊,地面站只負責監視無人機飛行狀態,保證安全。這種方法具有很高的獨立性,能夠脫離地面站獨立工作,數據傳輸基本沒有延時,但受到機載圖像處理模塊的性能限制,運算能力有限,并且增加了無人機的載荷。

近年來,計算機視覺技術飛速發展,目標檢測作為計算機視覺中最基礎和最重要的任務之一,誕生了很多性能良好的算法,如基于運動目標的幀差法與背景建模法、基于區域對準的模板匹配法、基于特征檢測的SIFT算法以及基于深度學習的Yolo和SSD等檢測算法[16]。

1系統總體設計

一般來說,任何降落導引系統都要滿足三個要求:可靠性、完整性和準確性[17]。小型無人機系統視覺降落導航系統整體處理流程圖如圖1所示,攝像機安裝于機腹云臺并保持鏡頭始終豎直向下。相機將采集到的圖像傳輸到機載電腦并由其進行實時處理,得到靶標相對于相機的空間位置及姿態信息。可選結合飛控回傳的飛機GPS信息,輸出降落目標的精確GPS位置,直接作為飛控的導航點使用。

1.1合作目標設計

子目標按照Aruco協議進行設計,采用5×5分辨率25bits二維碼,邊緣留空一位作為識別邊界,按照漢明碼標準進行編制和奇偶校驗,具有一定的容錯能力。每個子目標在漢明碼規則下擁有唯一的十進制編碼,用于存在多個子目標時進行區分,如圖2所示。

導航系統設計工作范圍為15~0.3m,單個目標無法覆蓋全段,因此需要使用多個不同尺寸目標進行引導。最終的合作靶標設計如圖3所示。

1.2硬件設計

硬件平臺選擇NVIDIA Jetson TX2圖形計算核心板,配合OV5640型攝像頭、XCB-Lite-A04型機載底板,能夠滿足在油污、振動等惡劣環境下穩定工作的要求。

通信方面使用串口進行,保證了圖像處理系統的適配性。機載圖像處理系統在保證了處理實時性的同時減少了空地數據傳輸量,節省了機載硬件的功耗,保證了無人機的續航性能不受影響。

1.3軟件總體架構

軟件核心采用C++編寫,使用開源深度學習架構Darknet和基于其構建的YOLOv3tiny;Intel公司的OpenCV開源計算機視覺處理庫進行圖像處理;Nvidia公司的CUDA庫進行Tegra架構下的GPU加速;開源數學庫Eigen進行數學運算加速。軟件通信部分采用Python編寫,單獨創建線程保證通信穩定性。整體算法架構如圖4所示。

2系統總體設計

2.1目標搜索策略

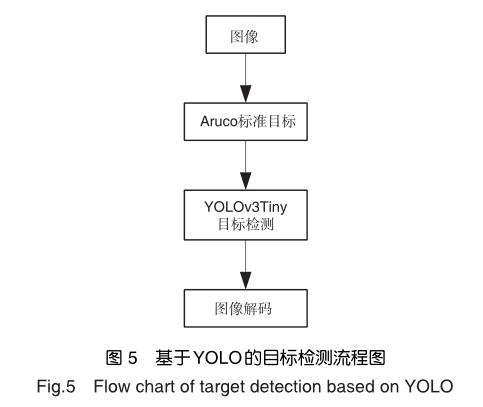

目標搜索策略的任務是在多種復雜視場下,從圖像中搜索合作目標并提取其特征點的方法。由于級聯分類器訓練數據的特點,其對背景的泛化能力較弱,而且當目標在視野中尺寸很小時表現欠佳,需要一個能夠較好處理小目標的檢測機制。此外,無人機飛行環境復雜多變,干擾目標較多,需要一個環境適應性很強的目標檢測算法。針對此要求,決定采用YOLO目標檢測架構,如圖5所示。

YOLO是由Joseph Redmon等于2016年提出的一種基于深度學習的目標檢測算法[18]。該算法在目標分類準確率、運算速度和背景誤檢率上均取得了較大突破,但在目標位置準確度上表現較差。系統利用其高魯棒性來處理復雜背景下的目標大致位置問題,將目標具體位置確定放置于后續步驟進行。作者給出了其基于darknet深度學習架構的開源工程,系統使用了該網絡的小型化加速模型YOLOv3Tiny,并使用CUDA進行GPU加速,使其處理速度達到10ms以內,滿足系統實時性要求。

2.1.1區域生長

由于合作目標主體顏色為白色,在陽光下呈現較高亮度,所以系統選擇亮度最高點進行區域生長,確定白色主體的全部范圍。區域生長具體算法如下:(1)圖片全部標記為背景,選定當前點為生長原點,并將其壓入邊緣棧;(2)遍歷邊緣棧內所有點,將其8鄰域范圍內背景點壓入待處理棧;(3)清空邊緣棧;(4)計算前景區域的平均灰度;(5)遍歷待處理棧,將和平均灰度差在閾值范圍內的點加入前景區域,同時將該點壓入邊緣棧;(6)清空待處理棧;(7)重復步驟(2)直至邊緣棧為空。

該算法優點為能夠完整地保留目標邊界,不受光照條件和陰影的影響;缺點是計算代價大,處理速度較慢。所以在實際過程中,系統會將圖像分辨率壓縮至720×555處理。

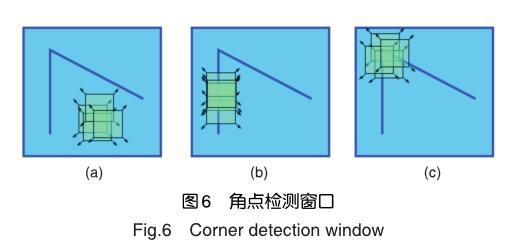

2.1.2像素級角點提取方法

角點提取使用了Shi-Tomasi算子,該算子為Harris算子的改進,具有篩選能力強、計算代價小、適應性強等特點,但精度只能達到像素級別,適合作為初步特征點提取方法使用。當一個檢測窗口在圖像上移動時,對于一個二值邊緣圖像有如下情況。當窗口處于平滑區域(見圖6(a))時,窗口在各個方向上移動時沒有變化;當窗口在邊緣上(見圖6(b))時,窗口在邊緣方向上移動時沒有變化,在垂直邊緣方向上移動時具有變化;當處于角點(見圖6(c))時,窗口在各個方向上移動均有變化。Shi-Tomasi和Harris角點檢測均依據窗口在各個方向上的變化程度決定是否為角點。

2.1.3角點亞像素化

由于像素級角點并不能滿足系統的精度要求,需要對其進行亞像素化處理,利用灰度梯度求得精確角點位置。具體方法為利用二次多項式來逼近角點響應函數R(x,y),找到其亞像素級極值相應位置,得到角點的亞像素級精確位置。

可直接解出角點的亞像素級坐標(x,y)。

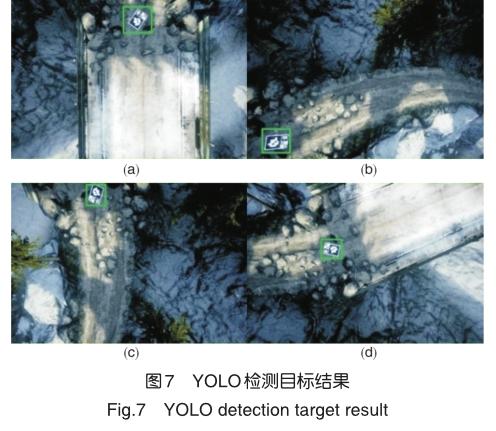

YOLO檢測目標的相關結果如圖7所示。仿真結果表明,該視覺識別策略,可使無人機在復雜環境條件下,實現對目標圖像的檢測與識別,環境適應性較強。

2.2姿態解算

無人機的著陸過程中,如何獲取高精度的無人機的位姿對于控制無人機準確安全著陸至目標點具有十分重要的意義[19]。姿態解算部分是從圖像到空間坐標的映射環節,是保障導航系統精度的核心。其主要由圖像解碼和PNP姿態解算兩步組成。其中圖像解碼部分負責提取圖像特征點并判斷識別有效性,PNP姿態解算負責由特征點像平面位置向空間位姿信息的映射。

由于合作靶標使用Aruco標準編碼,該步驟可以使用開源庫進行實現,簡化了程序設計并減少了姿態解算環節造成的誤差,便于后續濾波。

2.2.1圖像解碼

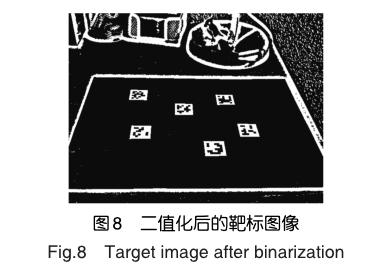

靶標大致位置確定后,對其進行自適應二值化,得到增強后的靶標圖像(見圖8)。檢測圖像中的候選靶標,并以其4個角點為每個靶標的特征參數進行下一步處理。

使用上一步提取到的4個角點,對靶標進行透視變換,轉換為標準大小的正方形圖形,再按照靶標位數劃分正方形網格,統計每個網格內部一定范圍內的白色像素數目,大于一定閾值認為該單元格值為1,否則值為0,如圖9、圖10所示。

接著按照漢明碼規范對圖像中二維碼進行數據分類,奇數列為校驗位,偶數列為數據位,將最終結果轉換為十進制便可得到靶標的id值。

當確定完靶標id后,便開始對矩形靶標的4個角點進行亞像素細化,使用Shi-Tomasi算子進行亞像素迭代,獲得精確的角點坐標。

2.2.2 PNP姿態解算

姿態解算部分的主要問題是根據特征點在像素坐標系下的位置和其在靶標固連坐標系下的位置,求解出相機坐標系和靶標固連坐標系間的姿態轉化矩陣,進而和慣導聯合解算,得到靶標的空間姿態和位置,用于進一步引導。

姿態解算為典型的PNP問題,由4個位于同一平面但不共線的已知坐標點可以解出兩坐標系間唯一的旋轉和平移矩陣。具體解決方案采于Levenberg-Marquardt optimization (LM)方法迭代求解位姿的最大似然估計。該算法最大的優點在于對噪聲不是很敏感,在高斯噪聲影響下也能夠穩定輸出姿態,平均誤差為1.3°,3.4cm,位于可接受范圍內。

算法流程為:(1)從點集中隨機遍歷n組每組4個不同點;(2)對每組運行PNP算法解得n組不同姿態解;(3)對每組解求全局誤差,選擇誤差最小解作為迭代初值;(4)運行LM優化算法,迭代求解姿態最大似然估計直至誤差小于閾值;(5)將姿態旋轉矩陣轉換為四元數和,輸出四元數與平移矢量。

2.3濾波器設計

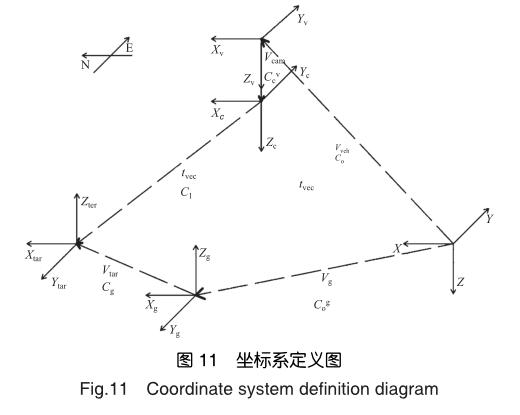

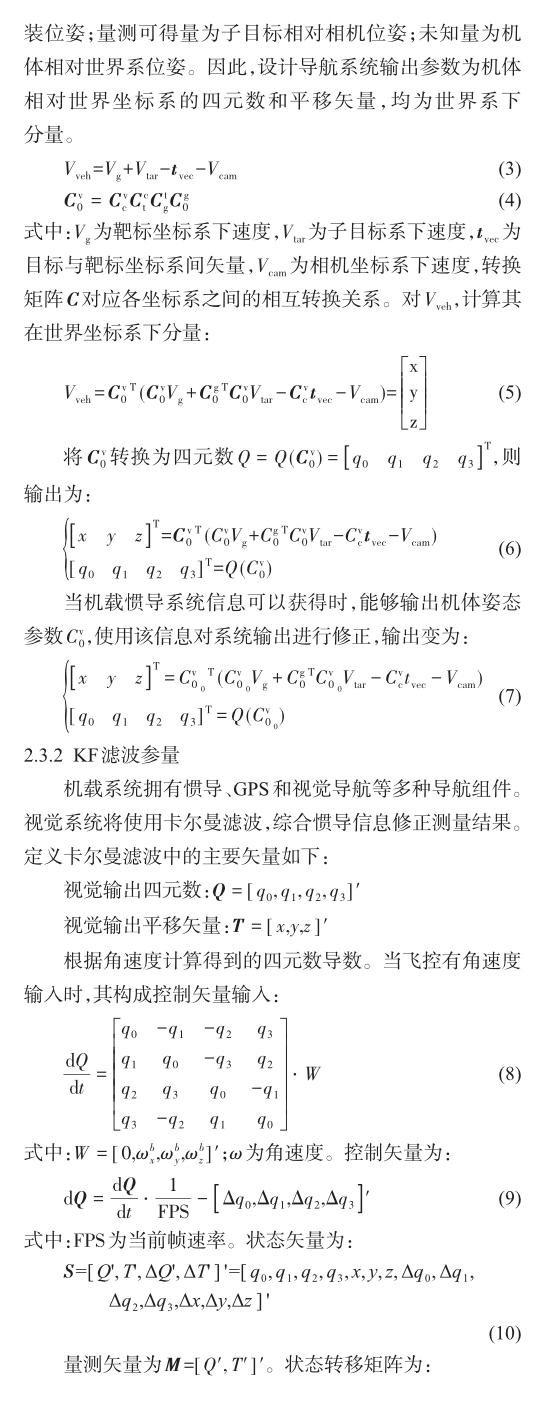

2.3.1坐標系定義

通過訓練的多個強Haar分類器對上一級的有效輸出進行處理,每一級都會輸出有效和無效區域結果,只有通過全部級聯分類的區域才會被作為最終的有效區域輸出。當全部區處理完成后,對各個大小Mask的結果進行融合便可得到全圖像的目標可能性圖像。這種分類手段有效地保證了分類結果的穩定性,但當目標過小時可能會導致可能性圖像中目標被過濾導致無法檢測,因此使用級聯分類器時應保證目標在視場中擁有足夠的尺寸。

3仿真

對于全系統的仿真基于AirSim和Unreal3平臺進行,如圖13所示。AirSim為微軟公司的開源仿真平臺,其內部整合了動力學、導航與控制系統的完整仿真模型[21],基于Unreal3的圖形處理引擎保證了其在進行視覺仿真時的真實性,因此選擇其作為平臺能夠很好地完成仿真任務。本文進行仿真時,分別以無人機的第一和第三視角觀測了無人機對目標識別后執行的自主降落行為。第三視角的無人機飛行狀態如圖14所示。第一視角下,無人機對目標的識別狀態如圖15所示。

仿真動畫結果表明,無人機可在復雜環境條件下準確地對目標進行識別,能在對目標進行識別后實現自主降落。

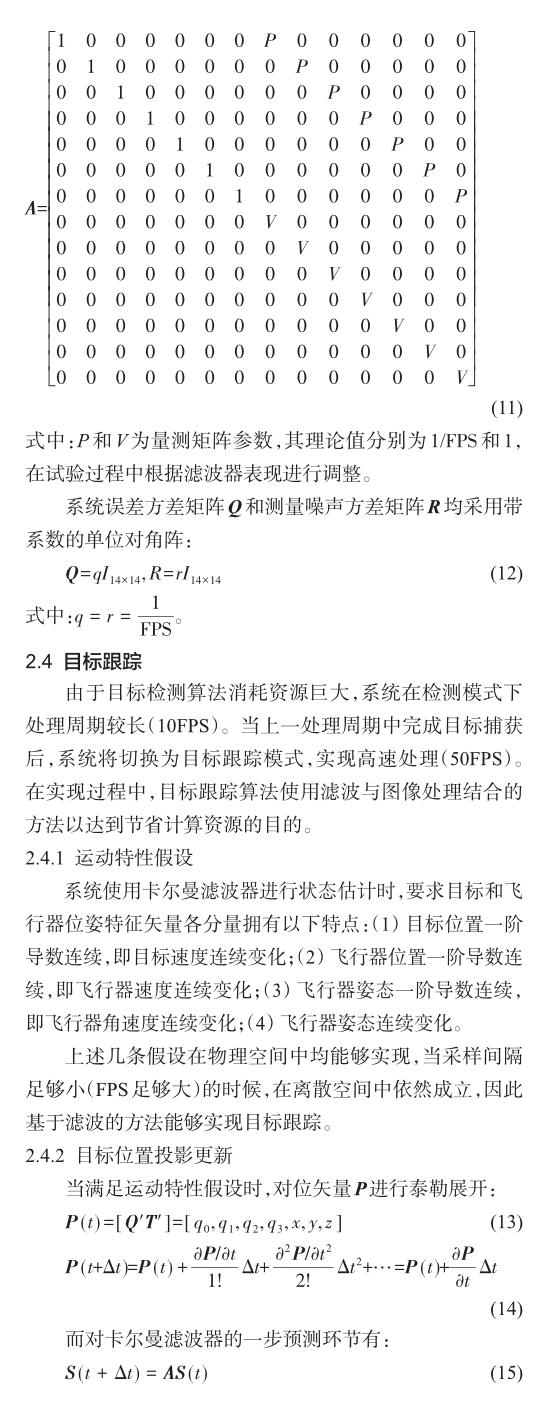

對無人機視覺輔助降落過程進行實際飛行驗證時,以第一視角得到的觀測視頻的部分截圖如圖16所示。

無人機在起飛至一定高度后,標識物進入機載相機視野,無人機開始自主降落。無人機對目標進行識別跟蹤,實時修正自身速度,最終通過識別目標成功降落至目標區域。

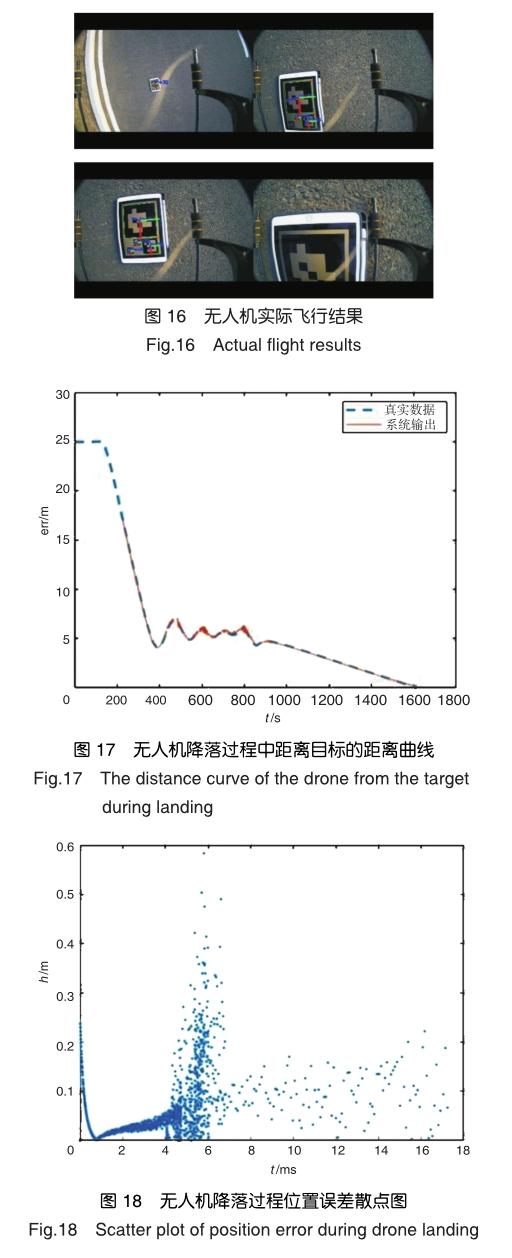

視覺輔助自主降落任務完成后,將飛行日志導出整理,跟蹤與降落過程中機體與地面目標之間相對距離如圖17所示。由圖17可知,無人機在高度25m處識別目標后,開始進行自主降落,在距目標5m處,出現輕微振蕩波動。在此過程中,位置誤差的散點圖如圖18所示。

由位置誤差散點圖可知,無人機在自主降落過程中存在較明顯位置誤差,但是由于誤差較小,故而對最終降落結果影響較小,足以滿足降落需求,但是仍需在后續工作中對其進行優化處理。

4結論

本文設計了一種基于PNP的多尺度目標單目視覺智能輔助降落系統,利用視覺拍攝目標地域實時環境信息,作為基礎數據,經計算機技術和控制傳感器運算處理,作為決策控制依據,引導無人機進行自主降落。針對GPS定位系統受到嚴重干擾情況,利用多尺度合作目標和成熟的PNP算法進行了精確姿態解算。通過算法優化和軟硬件系統的實現,滿足了無人機自主降落時對降落精度、實時性及安全性的要求。

參考文獻

[1]袁成.美國空軍新版《科技戰略》提出新目標和新舉措[J].航空科學技術, 2019,30(7):85-86. Yuan Cheng. The new version of the US Air Force Science and Technology Strategy puts forward new goals and new measures[J]. Aeronautical Science & Technology, 2019,30(7):85-86.(in Chinese)

[2]劉朝君,王亞龍,張立豐.基于飛控響應類型的無人機遙控駕駛技術研究[J].航空科學技術, 2019,30(6):62-67. Liu Chaojun, Wang Yalong, Zhang Lifeng. Research on drone remote control technology based on flight control response type[J]. Aeronautical Science & Technology, 2019,30(6):62-67.(in Chinese)

[3]Sharp C S,Shakernia O,Sastry S S. A vision system for landing an unmanned aerial vehicle[C]// IEEE International Conference on Robotics &Automation,2003.

[4]Jiskra P. Contact modeling and experimental validation for start and landing of VTOL UAVs[C]//DLR-Interner Bericht,2016.

[5]Tsai A C,Gibbens P W,Stone R H. Terminal phase visionbased target recognition and 3d pose estimation for a tailsitter,vertical takeoff and landing unmanned air vehicle[C]// Pacific-Rim Symposium on Image and Video Technology,2006:672-681.

[6]賈配洋.無人機高速移動降落技術研究[D].北京:中國科學院大學,2017. Jia Peiyang. Research on UAV high-speed mobile landing technology [D]. Beijing: University of Chinese Academy of Sciences , 2017.(in Chinese)

[7]張光富.基于合成視覺的3D重建技術研究[D].杭州:浙江大學,2008. Zhang Guangfu. Research on 3D reconstruction technology based on synthetic vision [D]. Hangzhou:Zhejiang University, 2008.(in Chinese)

[8]Xu G,Zhang Y,Ji S,et al. Research on computer visionbased for UAV autonomous landing on a ship[J]. Pattern Recognition Letters,2009,30(6):600-605.

[9]嵇盛育,徐貴力,馮文玲.基于紅外視覺的無人機自主著艦合作目標的研究[J].紅外技術,2007, 29(10): 593-597. Tong Shengyu, Xu Guili, Feng Wenling. Research on cooperative target of autonomous landing of UAV based on infrared vision [J]. Infrared Technology, 2007, 29 (10): 593-597.(in Chinese)

[10]魏祥灰.著陸區域視覺檢測及無人機自主著陸導引研究[D].南京:南京航空航天大學,2019. Wei Xianghui. Research on visual detection of landing area and autonomous landing guidance of UAV [D]. Nanjing: Nanjing University ofAeronautics andAstronautics, 2019.(in Chinese)

[11]吳賽飛,王新華,賈森,等.基于紅外視覺的固定翼無人機自動降落引導系統[J].電子測量技術,2016,39(3):131-135. Wu Saifei, Wang Xinhua, Jia Sen, et al. Automatic landing guidance system of fixed-wing UAV based on infrared vision[J]. Electronic Measurement Technology, 2016,39(3): 131-135.(in Chinese)

[12]樊瓏.多旋翼無人機視覺引導降落研究[D].哈爾濱:哈爾濱工業大學,2016. Fan Long. Research on vision-guided landing of multirotor UAV[D]. Harbin: Harbin Institute of Technology, 2016.(in Chinese)

[13]Allen D W,Eric N J,Alison A P. Vision-aided inertial navigation for flight control [C]// AIAA Guidance,Navigation and Control Conference,2005:348-360.

[14]楊忠,方挺,樊瓊劍,等.基于視覺傳感器的UAV編隊飛行[C]//第27屆中國控制會議, 2008: 592-597. Yang Zhong, Fang Ting, Fan Qiongjian, et al. UAV formation flying based on vision sensor [C]// 27th China Control Conference, 2008: 592-597.(in Chinese)

[15]周立偉,劉玉巖.口標探測與識別[M].北京:北京理工大學出版社, 2002. ZhouLiwei,LiuYuyan.Spokenlabeldetectionand recognition [M]. Beijing: Beijing Institute of Technology Press, 2002.(in Chinese)