基于局部超分辨重建的高精度SAR圖像水域分割方法

李 寧 牛世林

①(河南大學計算機與信息工程學院 開封 475004)

②(河南省智能技術與應用工程技術研究中心 開封 475004)

③(河南省大數據分析與處理重點實驗室 開封 475004)

1 引言

內陸地表水資源是人類賴以生存的重要自然資源,在地球的水文和生物化學循環中起著舉足輕重的作用。實現快速、準確的水資源調查對環境監測、災害預警等具有重要意義[1,2]。合成孔徑雷達(Synthetic Aperture Radar,SAR)是一種主動式微波成像傳感器,不受云、雨、霧以及光照等因素的影響,可以實現全天時、全天候對地觀測。星載SAR裝載于衛星平臺,具有不受空域限制、觀測范圍廣、周期性重訪等特點,已被廣泛應用于地球觀測的各個領域[3]。

發展到目前,多種SAR圖像水域分割方法被相繼提出,主要分為以下幾類:閾值分割法、主動輪廓模型法(Active Contour Mode,ACM)、聚類分割法、深度學習法。(1)閾值分割法通過設置一個或多個閾值,在灰度級上完成對SAR圖像的分割,該方法由于操作簡單、計算效率高,通常被視為最常用的方法之一,其缺點在于難以選擇最優閾值以及易受SAR圖像相干斑噪聲的影響[4];(2)基于ACM的SAR圖像水域分割方法主要通過粗分割與精細分割兩個步驟完成,首先獲取大致的水域邊界,然后根據梯度信息對輪廓線進行迭代演化,最終獲取更準確的水域邊界。該方法的優點在于可獲取連續、平滑的水域邊界,缺點在于運算量大且對初始輪廓的依賴性較強[5,6];(3)聚類分割法基于歐式距離,計算像素與聚類中心之間相似度完成對SAR圖像中相似地物的分類。該方法可無監督的實現SAR圖像地物分類,其缺點在于大尺度圖像運算效率低,且易受相干斑噪聲的干擾[7];(4)基于深度學習的分割方法通過人工制作大量訓練樣本以及手動標定標簽圖,訓練網絡模型,對輸入圖像中的水域進行識別。該方法的優點在于魯棒性強、不易受相干斑噪聲影響,缺點是需要事先制作大量樣本集,人力成本高[8]。

傳統水域分割方法一般在圖像的像素級尺度上開展,可實現像素級精度的水域分割,其分割精度受到分辨率的限制。一般情況下,星載SAR系統受最小天線孔徑積的限制,可用于大型水體觀測的SAR圖像(覆蓋面積一般為萬平方千米量級),其空間分辨率通常在十米量級。上述中低分辨率(Middle-Low Resolution,MLR)SAR圖像的水域分割結果,往往無法滿足實際的應用需求。

針對上述問題,本文提出了一種基于局部超分辨重建(Super-resolution Restoration,SR)的SAR圖像水域分割方法,所提方法在傳統水域分割技術的基礎上,融入了基于卷積神經網絡(Convolutional Neural Network,CNN)的圖像超分辨重建技術,通過對局部圖像進行超分辨重建,突破了傳統方法受SAR圖像分辨率的限制,顯著提升了水域分割結果的精度。本文方法首先對SAR圖像相干斑進行抑制,并基于模糊C均值(Fuzzy C-Means,FCM)聚類算法對水域進行粗分割;然后構建并訓練一種新型的局部圖像超分辨重建網絡模型,利用該模型對包含局部水域邊界的MLR-SAR圖像切片進行圖像超分辨重建,從而獲得更高分辨率的超分辨圖像;最后利用一種改進ACM分割算法在超分辨SAR圖像切片中獲取更精細的水域邊界。為了驗證本文新型圖像超分辨重建網絡模型和高精度水域分割方法的有效性,以南水北調中線工程水源地丹江口水庫作為研究區域,基于國產高分三號(GF-3)衛星和歐空局Sentinel-1衛星獲取的SAR數據集,開展了SAR圖像超分辨重建實驗和水域邊界提取實驗。實驗結果表明,本文所提圖像超分辨重建網絡模型在圖像重建質量上具有較好的效果;同時,本文所提水域分割方法的準確率與虛警率均明顯優于對比算法,輪廓平均偏移均小于對比方法。

2 相關方法與模型

2.1 像素級水域分割方法

2.1.1 基于灰度級的FCM聚類算法

傳統FCM算法通過多次迭代,可無監督的將圖像I的像素劃分為c個類別,其優點為性能穩定,缺點為對大尺度圖像分類時,計算效率較低。為了提高其運算效率,文獻[9]提出一種加強的FCM算法(Enhanced FCM,EnFCM),將計算像素與聚類中心的距離轉移至計算灰度級與聚類中心的距離[9],隨后在灰度級上完成對圖像的分類。其目標函數Jm可表示為

其中,Q是圖像的灰度級總數,γi是具有灰度值i的像素數。vj表示第j個聚類中心。m為模糊指數,通常為2。uji表示第j個聚類中心與第i個灰度值的隸屬度,隸屬度求解方程為

2.1.2 基于混合對數正態分布的ACM分割算法

ACM根據能量函數的不同,可分為基于區域和基于邊緣兩類。基于區域的ACM可利用全局信息對圖像進行分割,基于邊緣的ACM可根據梯度信息和邊緣停止函數對目標進行分割。然而,SAR相干斑噪聲使得圖像灰度分布不均勻,基于傳統模型的ACM算法往往無法獲得理想的分割結果。文獻[10]證明了混合對數正態分布模型對SAR圖像的分布具有較好的擬合效果,并且融合了基于區域和基于邊緣兩類能量函數的優勢,提出了一種基于混合對數正態分布的ACM (Mixed Log-normal Distribution based ACM,MLD-ACM)分割算法。首先假設曲線C將整個圖像域 ?分為 ?1和?2兩部分,分別服從對數正態分布lgp1和lgp2。然后引入水平集函數?,使?1={? >0}且?2={? <0},則輪廓C={?=0}。歸納MLD-ACM的能量函數表達式為

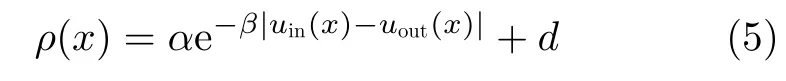

其中,μ,η,α,β,d均為常數參數。ElgNMM和Eb分別為基于區域混合對數正態分布的能量函數和基于邊緣信息的能量函數。H為Heaviside函數,δ為Dirac函數,g(x)為基于梯度信息的邊緣停止函數。ρ(x)為可變區域系數,uin和uout分別代表輪廓內外的均值。

根據變分法原則[10],能量函數E(?(x))對應的水平集函數為

2.2 基于CNN的圖像超分辨率模型

超分辨率重建的難點在于圖像邊緣保持。隨著CNN技術的發展,文獻[11]首次提出了基于CNN的超分辨模型(SR by CNN,SRCNN),該模型首先利用Bicubic插值放大目標圖像,然后利用一種3層的CNN模型(特征提取層、非線性映射層和圖像重建層),重建更清晰的圖像。隨后,文獻[12]提出了一種快速SRCNN模型(Fast SRCNN,FSRCNN),通過加深非線性映射層深度與減小特征尺寸,可在提高邊緣保持性能的同時加快運行速度。文獻[13]提出了一種基于深卷積網絡的超分辨模型(SR by Very Deep convolutional network,VDSR),通過一個20層深度的網絡,增加了網絡的感受野,從而提高了超分辨重建的效果。文獻[14]將生成對抗網絡(Generative Adversarial Network,GAN)應用在超分辨重建問題中,提出了一種基于GAN的超分辨模型(SR by GAN,SRGAN)。該模型利用感知損失和對抗損失,更好地保留了圖像的高頻細節,使重建結果有更好的視覺感。文獻[15]結合殘差網絡提出了一種增強型深度超分辨率網絡(Enhanced Deep network for SR,EDSR),該模型去除了常規殘差網絡中的歸一化處理,并采用L1范數式的損失函數優化網絡,使模型緊湊的同時實現更好的結果,性能得到顯著提升。基于CNN的超分辨模型結合了多層感知機理論的優勢,可更好地訓練各層卷積核的權重,使超分辨重建結果達到最優。目前基于CNN的圖像超分辨重建模型發展較為成熟,在多個公開數據集上均取得了較好的實驗結果。

3 高精度SAR圖像水域分割方法

本文所提高精度SAR圖像水域分割方法結構如圖1所示。對輸入的MLR-SAR圖像先進行水域的粗分割,然后對目標區域進行局部超分辨重建,最后再對水域進行精細分割,提取更高精度的水域邊界。

圖1 基于局部超分辨重建的SAR圖像高精度水域分割方法示意圖Fig.1 The structure of local SR based high-precision water extraction method for SAR image

3.1 水域粗分割

水域粗分割主要包含3個步驟,分別是相干斑濾波、基于EnFCM算法的水域粗分割和感興趣區域(Region Of Interest,ROI)提取。

(1)相干斑濾波:SAR圖像中固有的相干斑噪聲會對圖像分割造成不利影響,在分割之前對相干斑噪聲進行抑制尤為必要。相干斑噪聲是一種乘性噪聲,會導致圖像分布不均,影響圖像的正確解譯。傳統均值濾波在抑制相干斑噪聲的同時,會造成邊緣信息的破壞,導致邊緣模糊。隨著相干斑濾波技術的發展,基于非局域(Non-Local,NL)理論的SAR圖像濾波技術取得了較好的效果,該類算法在保證同質區域均勻的同時,可較好地保留非同質區域間的邊界。本文采用一種基于比值距離的NL-SAR相干斑濾波算法[16]實現SAR圖像的相干斑抑制。

(2)EnFCM聚類:對濾波后的SAR圖像進行水域初步提取,隨機設置3個聚類中心,迭代次數設置為15。完成迭代后,將圖像分為目標水體、背景、過渡區域。

(3)ROI提取:上述結果中,一些雷達陰影與相干斑噪聲會被誤判為目標水體。為了消除這些影響,采用文獻[4]中的ROI提取方法,標記最大區域面積為Smax,定義一個面積閾值T=λ·Smax,只有面積大于T的區域才會被標定為ROI區域,即最終的水域粗分割結果。在本文中,令λ=0.2。

3.2 局部超分辨率重建

局部SAR圖像超分辨重建主要包含兩個步驟。第1步,圖像分塊,即圍繞粗分割獲取的水域邊界信息,獲取一系列部分重疊的圖像切片;第2步,局部圖像超分辨重建,即基于一種輕量級殘差CNN的超分辨重建(Lightweight Resnet based SR,LRSR)網絡模型,對SAR圖像切片進行超分辨率重建。

3.2.1 水域邊界局部圖像分塊方法

經過水域的粗分割處理,實際的目標區域僅為粗分割水域邊界線的鄰域。為了降低后續圖像超分辨重建和水域精分割等步驟的運算量,本文提出一種基于粗分割水域邊界信息的局部圖像分塊方法,如圖2所示。具體操作流程如下:

步驟1 設定帶狀區域 以粗分割水域邊界為中心線,形成一條寬度為E的帶狀區域,如圖2所示。其中,為了保證帶狀區域包含真實水域邊界,E/2應大于粗分割水域邊界與真實邊界對應位置的最大距離。

步驟2 粗分割水域邊界分段直線擬合 如圖2(b)所示,藍色曲線為粗分割水域邊界。以粗分割水域邊界的第1個邊界點為起點,按同一個方向,連續取n1個邊界點的坐標,直到起始點和終止點之間的直線距離范圍在E~1.5E。將這些像素點的坐標記為集合N1,采用最小二乘法,對集合N1進行直線擬合。所得直線如圖2(b)中紅色線段所示,其方程記為fN1(x)。

步驟3 計算分段直線的端點與中點坐標 根據集合N1中起始點和終止點的橫坐標,帶入步驟2獲得的方程fN1(x)中,獲得紅色線段首點①的坐標和尾點③的坐標。然后,根據點①和點③的坐標,利用中點公式,計算中點②的坐標。

步驟4 遍歷粗分割水域邊界 取上一個步驟中集合的終止點為起點,按步驟2擬合直線,如圖2(b)中黑色線段所示。然后按步驟3計算點④、點⑤和點⑥的坐標。循環執行該步驟,直到完全遍歷粗分割水域邊界。

步驟5 計算圖像切片位置 如圖2(b)所示,圖中黑色陰影區域表示局部帶狀區域,紅色、黃色和藍色框表示分塊后的圖像切片。以紅色框為例,將經過點①和點③,且可以截斷帶狀區域的兩條豎直的平行線作為邊界,以包含點①和點③之間所有帶狀區域的另外兩條水平的平行線作為邊界,通過四條邊界確定圖像切片位置。同理,黃色框根據點②、點⑤和帶狀區域確定,藍色框根據點④、點⑥和帶狀區域確定。

3.2.2 基于輕量級殘差CNN的圖像超分辨重建模型

LRSR網絡模型主要包含6個部分,結構如圖3所示,分別是特征提取層、特征壓縮層、特征映射層、特征擴張層、累加層和超分辨率重建層。圖3中Conv(F,I,O)和Deconv(F,I,O)分別表示卷積函數與反卷積函數,F表示卷積核尺寸,I表示輸入特征的維度,O表示輸出特征的維度。LRSR網絡直接對MLR-SAR圖像進行多維特征的提取,并根據特征重建超分辨率圖像,各部分詳細結構如下:

(1)特征提取層:采用64個5×5的卷積進行特征提取。輸入數據為MLR-SAR圖像,經過Conv(5,1,64)函數提取64維的特征圖。

(2)特征壓縮層:Conv(1,64,16)函數將64維的特征圖壓縮至16維,縮小了參與第3部分非線性映射的特征維度,減小了計算量,從而加快了運行效率。

圖2 局部分塊方法示意圖Fig.2 Schematic diagram of local block method

圖3 LRSR網絡結構圖Fig.3 The structure of the LRSR network

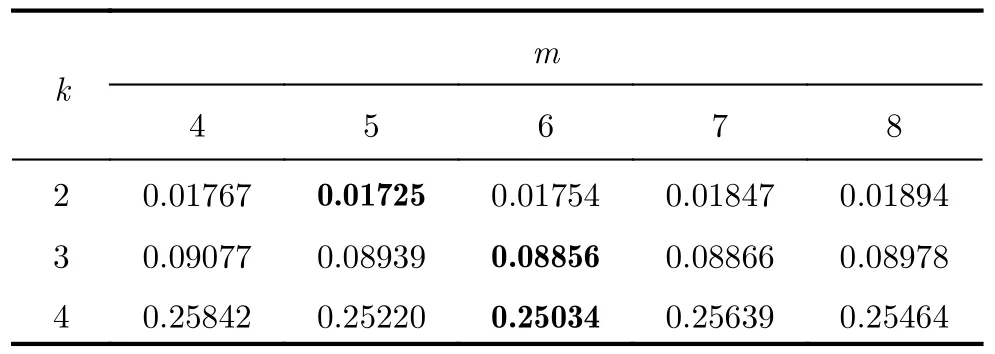

(3)特征映射層:特征的非線性映射是圖像超分辨重建的重要步驟,其中兩個最重要的參數分別是卷積核大小和特征映射層的深度m。文獻[11]驗證了SRCNN模型在單層特征映射的結構下,特征映射層的卷積核大小為5×5時,其SR性能優于卷積核大小為1×1時[11]。隨后,文獻[12]驗證了FSRCNN模型的特征映射層深度為4,且卷積核大小為3×3時,其SR性能最優[12]。因此,本文基于3×3的卷積對特征進行非線性映射。從模型參數量的角度分析,兩個3×3的卷積層串聯的效果相當于一個5×5的卷積層,但前者的參數量只有后者的72%。更重要的是,兩個3×3的卷積層比一個5×5的卷積層可實現更多的非線性映射。第2個重要參數m決定了網絡的復雜度與SR性能,其數值的設定易受網絡結構、超分辨重建倍數等因素的影響,需通過實驗探尋最優值。最終,該層通過m個Conv(3,16,16)函數串聯,實現對特征壓縮層輸出的16維特征圖進行非線性映射。

(4)特征擴張層:將上步非線性映射輸出的16維特征圖輸入Conv(1,16,64)函數,擴張至64維的特征圖。特征擴張層的引入為LRSR網絡的第5部分實現殘差網絡模型提供了基礎。

(5)累加層:通過捷徑通道R,將特征提取層的輸出與特征擴張層的輸出相加,從而構建殘差網絡模型。

(6)超分辨率重建層:Deconv(9,64,1)函數由64個9×9的反卷積核組成,對累加層的輸出進行整合與上采樣,輸出一幅完整的超分辨率圖像。反卷積可視為卷積的逆運算。對于卷積而言,在圖像上以步長(stride)k運算時,將以1/k的頻率輸出。相反的,將輸入和輸出交換位置,那么獲得輸出的結果將是輸入的k倍。因此超分辨率重建倍數由反卷積步長k決定。

LRSR網絡采用PReLU作為激活函數,其表達式為f(x)=max(x,0)+amin(0,x)。相比于傳統ReLU激活函數,PReLU通過增加系數a,保留了特征的負數部分,改進了經ReLU激活函數運算后輸出為0的情況,避免了“dead features”[17]的出現。損失函數采用均方誤差(Mean Square Error,MSE)計算。網絡模型參數的優化采用隨機梯度下降算法與反向傳播機制完成。

LRSR網絡通過增加捷徑通道R實現了殘差結構,有效緩解了傳統CNN模型中梯度消失與梯度爆炸的問題,增加了網絡結構的穩定性[18]。此外,通過特征壓縮與擴張,在保證運算效率的同時,實現了小維度特征的多層非線性映射。最后通過一組經過訓練的反卷積函數,實現圖像的超分辨重建。

3.3 水域精分割

水域精分割主要包含2個步驟,分別是基于MLD-ACM[9]算法的水域精分割和水域邊界切片融合。

基于MLD-ACM算法的水域精分割流程如下:

(1)對MLD-ACM算法的參數進行初始化[9]。在本文中,令μ=0.2,η=1,α=10,β=3,d=0.25;

(2)讀取經過SR后的SR-SAR圖像切片;

(3)根據水域粗分割結果,初始化水平集函數?;

(4)根據式(6)迭代演化輪廓線,直至收斂;

(5)重復步驟(1),直至完成所有SR-SAR圖像切片的水域精分割。

上述處理獲得的水域邊界為一系列子塊圖像(即圖像切片)的分割結果,要獲得完整和連續的水域邊界,需要融合所有圖像切片的分割結果。如圖4所示,在融合過程中,對相鄰圖像切片重疊的水域邊界進行平均處理,形成一個連續的SR水域邊界。最后,通過比例映射,將SR水域邊界映射到原始MLR-SAR圖像中,獲得最終的高精度水域邊界線。

4 實驗結果與分析

4.1 圖像超分辨率重建

4.1.1 數據集與樣本集

首先,制作數據集。以兩景覆蓋丹江口區域的國產GF-3衛星超精細條帶模式圖像(3 m空間分辨率)為數據源,從中截取200幅具有清晰紋理和邊緣(如岸邊、城市群)的子圖像,且尺寸統一為200×200。然后,采用文獻[19]的數據增強方法,對數據集進行擴充。

其次,制作樣本集。對數據集進行k倍的降采樣(k等價于超分辨重建倍數),分別將原始數據集和降采樣數據集均分為5 份,記為SHR1?HR5與SLR1?LR5。取SLR1?LR4和SHR1?HR4作為訓練樣本和訓練標簽,SLR5和SHR5作為測試樣本和測試標簽。

4.1.2 初始化模型與網絡訓練參數

LRSR網絡中卷積與反卷積函數的padding與stride參數設定如表1所示,網絡模型的訓練參數如表2所示。所有卷積核的初始化值采用MSRA[19]函數進行填充,反卷積核的初始化采用均值為0,標準差為10?3的標準高斯分布進行隨機填充。

圖4 精細分割水域邊界融合方法Fig.4 Merging method of the refined water boundaries

表1 LRSR網絡卷積與反卷積參數設置Tab.1 Convolution and deconvolution parameters of the LRSR

表2 LRSR網絡訓練參數Tab.2 Convolution and deconvolution parameters of the LRSR

4.1.3 圖像超分辨重建實驗

以MSE損失為評價指標,訓練網絡模型,訓練結果如表3所示。超分辨重建質量評價指標采用峰值信噪比(Peak Signal-to-Noise-Ratio,PSNR)[12]。

表3 LRSR網絡MSE損失訓練結果Tab.3 LRSR training results of MSE loss

為了驗證LRSR網絡對實測SAR圖像的超分辨重建效果。選取國產GF-3衛星在丹江口地區獲取精細條帶I模式的5 m空間分辨率的SAR圖像進行驗證,結果如圖5所示。第1步對SAR圖像進行相干斑抑制,并獲取局部SAR圖像切片,如圖5中第1列虛線框所示;第2步進行3倍的降采樣以獲得MLRSAR圖像,降采樣結果如圖5中第2列虛線框所示;第3步對MLR圖像進行超分辨重建操作,重建結果如圖5第3列虛線框所示。SAR圖像超分辨重建結果的平均PSNR達到了38.676 dB,與第1列中虛線框中原始圖像對比可發現,LRSR網絡對SAR圖像具有較好的超分辨重建性能。

4.2 水域分割實驗

4.2.1 研究區域及數據

本文以我國南水北調中線工程水源地丹江口水庫作為研究區域,驗證所提方法的有效性,如圖6中黃色虛線框所示。丹江口水庫為南水北調工程沿線4個省市的20多座大中城市提供生活和生產用水,對其覆蓋水域進行持續監測與快速調查具有重要意義。本文以歐空局Sentinel-1衛星和國產GF-3衛星獲取的丹江口水庫SAR圖像為數據源,開展實驗驗證。實驗數據詳細信息如表4所示。

4.2.2 實驗參數與水域分割結果對比

圖5 SAR圖像3倍超分辨重建結果Fig.5 SR result of SAR images with upscaling factor of 3

圖6 研究區域Fig.6 Location of study area

表4 實驗使用的SAR圖像詳細參數Tab.4 Detailed parameters of experimental SAR data

表5 對比試驗方法Tab.5 Comparison test methods

實驗中,設置圖像分塊參數E=100,超分辨率重建網絡模型參數k=3,m=6。本文通過4組對比試驗,驗證了所提方法的有效性,各對比方法的詳細信息如表5所示。其中,對比方法1采用了FCM聚類算法進行水域粗分割,并將粗分割結果作為初始邊界輸入ACM算法,進行水域的精細分割。對比方法2在對比方法1的粗分割流程中,加入了相干斑濾波技術和ROI提取技術。對比方法3在對比方法2的基礎之上,加入了本文所提的水域邊界局部分塊法。最后為本文所提方法,在對比方法3的基礎之上,加入了超分辨重建模型。實驗結果如圖7所示,其中,圖7(a)和圖7(c)分別為圖像1和圖像2的水域提取結果,圖中藍色區域代表提取的水域。從整體效果上看,4種方法都可成功地提取水域,但其它方法受雷達陰影和相干斑噪聲的影響較大。相較之下,本文方法在非水域區域具有更強的穩定性與魯棒性。為了更加清晰地觀察試驗結果,將水域邊界疊加在原始SAR圖像中,分別在圖像1和圖像2中各選取5個典型的子區域進行放大觀察,如圖7(a)與圖7(c)中區域A至區域J所示。放大結果如圖7(b)與圖7(d)所示,黃色曲線代表對比方法1提取到的水域邊界,綠色曲線為對比方法2提取到的水域邊界,藍色曲線為對比方法3提取到的水域邊界,紅色曲線為本文方法提取到的水域邊界。對比發現,本文方法提取的水域較為整齊,輪廓較為平滑,且誤判現象較少。為了獲得更詳細的觀察,在每個子區域中隨機選取一個區域再次放大,結果如每個子區域結果圖中右下角所示。對比發現,本文所提方法魯棒性與穩定性更強,能夠獲取更精確的水域邊界。

4.2.3 水域分割結果魯棒性評估對比

為了定量分析所提方法的精度,本文采用文獻[5]中的評估方法,對上述實驗結果進行精度評估。其中,虛警率與漏檢率用來評估整體水域提取質量,輪廓的平均像素偏移距離用來評估局部水域邊界質量,評估結果如表6所示。從表中方法1和方法2的結果可知,傳統方法的分割結果受雷達陰影與相干斑噪聲影響較大。在傳統方法的粗分割過程中加入相干斑濾波和ROI提取技術,可減少部分雷達陰影和相干斑噪聲的影響。從表中方法3的結果可知,在引入了本文所提水域邊界局部分塊法后,可有效地抑制了目標區域外的雷達陰影與相干斑噪聲影響。并且,ACM算法僅在局部圖像切片中計算水域,在輪廓演化次數相同的情況下,可獲取更高精度的水域輪廓。從表中本文方法的結果可知,在融入了超分辨重建技術后,增加了局部圖像的分辨率,最終的分割精度在方法3的基礎上,得到了進一步的提升。其中,虛警率小于0.04%,準確率大于99%,輪廓平均偏移指標大幅降低,可以實現高精度的水域邊界提取。

相比之下,傳統方法的水域分割精度偏低,且虛警率偏高,其原因可歸結為以下幾點:(1)傳統方法的分割精度受限于圖像的空間分辨率,易受模糊的水域邊界影響;(2)傳統方法在對整幅圖像進行分割時,既增加了運算量,也提高了將相干斑噪聲和雷達陰影誤判為水域的概率;(3)傳統方法基于灰度信息對圖像進行分割,魯棒性較差,雷達陰影、相干斑噪聲和水面風浪造成的局部散射增強等易造成虛警。

5 結束語

本文提出了一種高精度的SAR圖像水域分割方法,并結合實測SAR圖像,進行了精度和魯棒性驗證。結合基于深度學習的圖像超分辨重建模型,本文所提方法的分割精度較傳統方法提升了一個數量級。同時,基于粗分割水域邊界的圖像分塊技術,大幅降低了圖像超分辨重建步驟的計算量,提高了本文方法的整體運算效率。對于中低分辨率星載SAR圖像大型水域分割應用,所提方法具有重要的實用意義。

圖7 SAR圖像水域分割結果Fig.7 Water extraction results of SAR images

表6 定量分析結果Tab.6 Results of quantitative analysis