一種基于Inception結構的神經網絡協同過濾推薦算法

金銘 李俊

摘 要:在商品推薦領域,商品評論信息往往難以得到有效利用。為了充分利用商品評論信息,提高商品推薦系統精度,對NCF神經網絡協同過濾模型進行改進,將NCF模型與Inception結構的卷積神經網絡相結合,提出基于Inception結構的神經網絡協同過濾方法(NCF-i模型),將商品評論信息融入模型進行預測和推薦。首先基于Inception結構的卷積神經網絡對商品評論信息進行分析并提取多元特征模型,然后將多元特征模型添加到NCF模型中,通過多層全連接層獲取用戶、商品及商品評論之間的非線性關系,最后基于此非線性關系對商品進行預測和推薦。通過基于真實數據集的實驗證明,應用NCF-i模型的推薦算法,推薦系統的預測精度和穩定性均優于當前常用的推薦模型。

關鍵詞:協同過濾模型;商品評論;商品推薦;Inception結構;神經網絡

DOI:10. 11907/rjdk. 192226 開放科學(資源服務)標識碼(OSID):

中圖分類號:TP312文獻標識碼:A 文章編號:1672-7800(2020)007-0050-06

An Neural Collaborative Filtering Recommendation Algorithm

Based on Inception Structure

JIN Ming, LI Jun

(School of Computer and Artificial Intelligence, Wenzhou University, Wenzhou 325035, China)

Abstract: In the field of product recommendation, product review information is often difficult to be used effectively. In order to make full use of commodity review information and improve the accuracy of commodity recommendation system, this paper improves the neural network collaborative filtering model of neural collaborative filtering(NCF), combines the NCF model with the convolutional neural network of Inception structure, and proposes a neural network based on Inception structure. The collaborative filtering method (NCF-i model) integrates product review information into the model for prediction and recommendation. The method firstly analyzes the commodity review information based on the convolutional neural network of Inception structure and extracts its multi-feature model. Then, the multi-feature model is added to the NCF model to obtain users, commodities and commodity reviews through multiple layers of all-connected layers. The nonlinear correlation between the two is based on this nonlinear relationship to predict and recommend commodities. Through the experiment based on the real data set, the recommended algorithm of the NCF-i model is applied, and the prediction accuracy and stability of the recommendation system are better than the currently recommended models.

Key Words: collaborative filtering model; commodity review; product recommendation;inception structure; neural network

0 引言

全球每時每刻都產生著海量信息。如何從浩如煙海的信息中獲取滿足用戶需求的信息是計算機領域的研究熱點。為解決信息獲取問題,計算機領域提出了兩種方案,即門戶網站和搜索引擎。前者的代表是雅虎公司,雅虎憑借門戶網站迅速在計算機領域占據一席之地,而像hao123等門戶網站也曾風靡一時,成為中國早期網民的不二之選。但是由于門戶網站只能包含有限個目錄,而互聯網上的信息斑駁復雜,使得門戶網站無法滿足用戶需求,這促使了搜索引擎的崛起。搜索引擎的代表是谷歌和百度,用戶可以自己描述需求,使用搜索引擎服務查找到所需要的信息。但是當用戶無法準確描述需求的時候,搜索引擎便無法有效地提供服務。因此,能根據用戶行為推薦滿足用戶個性化需求的推薦系統應運而生,在電商網站、新聞網站、視頻網站等領域都可以看到推薦系統的影子[1]。

傳統的推薦方法主要有3種:基于內容推薦的方法、基于協同過濾的方法和基于混合推薦的方法。基于內容的推薦方法,是根據用戶的行為歷史,比如用戶已經收藏或購買的項目推薦相似的項目。該方法缺點在于,項目的特征需要人工提取,花費大量成本效果卻不理想;基于協同過濾方法,是基于相似的用戶有相似的興趣假設,根據與該用戶相似的用戶所購買或收藏的項目給用戶推薦項目。該方法缺點是容易產生冷啟動(系統使用初期缺乏數據,無法進行推薦)、數據稀疏(一個用戶所評分過的項目占所有項目的比重很小)和無法學習到深層特征問題。基于混合推薦的方法融合了協同過濾和基于內容推薦兩種方法的結果,提高了推薦精度[2]。

進入21世紀以來,由于算法水平和硬件水平的大幅度提高,深度學習技術得到了里程碑式的發展。由于深度學習具有非線性結構,有強大的特征提取能力,可以很好地克服傳統推薦算法中的冷啟動、數據稀疏和提取特征困難等問題。因此,以深度學習為基礎的推薦系統是未來推薦系統發展方向。

1 相關工作

目前,國內外許多學者已經在該領域做了大量的工作。Ricci[3-4]建議將評論意見用于產品描述和用戶行為研究,他相信商品評論可廣泛應用于推薦系統,并可提供更佳的建議;Aciar S、 Zhang D、Simoff S等[5]在Ricci工作的基礎上,提出了一種排序機制將商品評論應用于推薦系統。Chen L等[6]對于基于評論的推薦系統兩個方面:基于評論的用戶配置文件構建以及基于評論的產品概要構建做了詳細描述,探討了基于評論的推薦系統發展趨勢;Zhang Z等[7]提出一種新的基于內存協同過濾方法,稱為urCF(用戶評論增強協同過濾),可以從網絡評論中提取用戶對單項特征的評價,有效提高了協同過濾效果;Xu J等[8]提出了一種新的個性化推薦模型,即基于主題模型的協同過濾(TMCF),利用擴展的文檔主題模型為每個評審生成主題分配,然后獲得每個用戶的偏好,在很大程度上緩解了稀疏性問題,獲得了良好效果;S Raghavan等[9]探討了在評價中附加權重或質量分數的同時進行協同過濾的可能性。在進行協同過濾時,利用相應的評論數據確定質量分數,對個體評分的重要性進行增權或減權,從而提高預測的準確性。

盡管上述方法取得了一定的成功,但它們都基于傳統的因子分解模型對未知項目(item)的評分進行預測,因此無法捕獲用戶與商品之間復雜的非線性相關信息。 針對這一問題,He等[10]提出了一種神經網絡協同過濾模型(Neural Collaborative Filtering,NCF),該模型使用神經網絡表示用戶和項目之間的非線性關系,提供一種將深度學習應用于推薦系統的新思路。與FM(factorization machine)因子分解機模型相比,NCF模型具有更好的表現能力,能更好地獲取用戶與項目之間隱含的關系。但是,NCF只利用用戶對項目的評分信息,卻沒有考慮對項目評論等文本信息進行處理和利用,而文本評價往往比簡單評分擁有更多的潛在信息,并且更能體現用戶的個性化偏好。本文在NCF基礎上,提出一種基于Inception結構的神經網絡協同過濾方法(NCF-i模型)。該方法首先基于Inception結構的卷積神經網絡對商品評論信息進行分析并提取多元特征模型,然后將該多元特征模型添加到NCF神經網絡協同過濾模型中,通過多層全連接層獲取用戶、商品和商品評論之間的非線性關系,最終基于此非線性關系對商品進行預測和推薦。

2 NCF-i模型

常用的NCF模型需要首先將user的id和item的id進行詞嵌入,之后將user的id嵌入層與item的id嵌入層進行拼接組成特征層,然后再經過多層全連接層讓user的特征和item的特征充分組合,最后輸出評分。由于在全連接層輸出時會使用非線性的激活函數進行激活,因此NCF模型具有更好的表現能力[11]。

本文針對商品評論的文本中包含用戶對于商品的喜好特點,在NCF模型的基礎上構建了添加商品評論的NCF -i模型,NCF -i模型結構如圖1所示。

下面對Inception結構的卷積神經網絡處理商品評論的方法和原理作詳細說明,對NCF -i模型的算法實現細節進行詳細介紹。

2.1 詞嵌入

當對商品評論文本進行處理時,首先應該選擇合適的模型對文本進行表達。傳統的機器學習方法在處理文本數據時,通常使用詞袋模型[12]進行文本表達,但詞袋模型往往具有維度高、數據稀疏等特點,無法作為卷積神經網絡的輸入,因此使用詞嵌入[13]的方法進行文本表達。詞嵌入就是通過將詞語映射到固定的維度獲得一個維度低、數據稠密的詞向量模型。因此,可以通過詞嵌入的方法對文本進行處理,將其轉化為維度大小為句子長度與詞嵌入維度乘積的二維矩陣。例如可以將文本“canned dog food products”(罐裝狗糧商品)進行詞嵌入后轉化為如下矩陣,如圖2所示。

2.2 卷積與池化

有了詞嵌入模型便可以應用卷積神經網絡對商品評論進行文本處理。卷積神經網絡最關鍵的操作就是卷積和池化。卷積操作就是卷積核依次滑過輸入層,與輸入層對應的矩陣做內積,最終將結果映射到輸出層的過程。卷積神經網絡由于卷積核的參數共享,有效減少了需要訓練的參數個數。在進行卷積操作時,設定卷積核的深度等于輸入層的深度,輸出層的深度與卷積核的個數相等。

在使用卷積神經網絡對文本進行分析時,由于每個詞語都由詞嵌入層的一整行數據表示,因此需要讓卷積核的寬度和詞嵌入的維度相等,否則就無法提取到每個單詞的全部信息[15],如圖3所示。

在圖3中使用的卷積核寬度為2,步長為1,卷積操作后映射成一個一維向量。由于進行文本預處理時會將長文本進行截短,對短文本用占位符進行填充,因此在使用卷積神經網絡時無需對輸入矩陣進行0填充。

文本向量在使用卷積核進行卷積操作后得到的文本向量維度為:

文本向量維度 = 句子長度 - 卷積核大小 + 1

為了充分提取到商品文本特征,本文使用Inception結構的卷積神經網絡[16]。Inception結構使用多個大小不同的濾波器對輸入層做卷積和池化操作,之后將得到的映射在深度維度進行拼接。經過這樣并行的卷積和池化操作可以提取到卷積層的不同特征。簡單的卷積神經網絡Inception結構如圖4所示。

在圖4中,分別使用1*1的卷積核、3*3的卷積核和5*5的卷積核對輸入層做卷積,使用3*3的空間窗口對輸入層做池化,將并行操作得到的輸出層在深度維度上進行拼接,作為最終提取到的特征。測試表明,使用了Inception結構的卷積神經網絡在提取特征方面擁有更高的計算效率,效果更好。

具體到將卷積神經網絡的Inception結構應用到文本處理時,卷積神經網絡可以同時提取到語言模型中多種N元模型特征。相比傳統方法,即直接計算文本中的N元模型方法,只能提取到固定的一種N元模型特征[17]。為了獲取到文本的多元模型特征,以期望達到更好的效果,在對評論文本做分析時使用Inception結構的卷積神經網絡。

此處的語言模型指,如果某一詞語出現的概率與前面N個詞相關,則稱其為N元模型。根據條件概率公式可以得到一元模型的公式(2),其中m為句子中單詞的個數,P(wi)為第i個詞語出現的概率:

同理可得二元模型公式為:

三元模型公式為:

本文在文本卷積神經網絡中提取了二元模型、三元模型、四元模型和五元模型特征,即所使用的卷積核寬度分別為{2,3,4,5},而傳統的機器學習方法只能使用一種語言模型[18]。

卷積神經網絡進行文本分析時通常使用最大池化,本文也同樣使用最大池化。

2.3 NCF -i模型算法實現

搭建好模型后對NCF -i模型進行訓練,訓練算法如下:

NCF -i模型訓練代碼

輸入:[Duser,Ditem,Dreview,Nwindows,Nnerual,Nepochs]

輸出:[Mncfr]

1.? For k to [Nepochs]:

2.? 初始化 [Fuser,Fitem,Freview,Frev_layer,Fcov_layer,Fcombine_layer]特征矩陣,[Mncfi]模型權重

3. [Fuser,Fitem,Freview=Embedding(Duser,Ditem,Dreview)]

4. For w to [Nwindows]:

5. [Fwcov_layer=Conv(Freview,w)]

6. [Frev_layer=Frev_layer+Fwcov_layer]

7. [Fcombine_layer=Fuser+Fitem+Frev_layer]

8.? ? For i to [Nnerual]:

9. [Mi+1ncfr=FullConnect(Fcombine_layer,Mincfr)]

10. [Loss=CrossEntropy(M-1ncfr)]

11. [M'ncfr=Min_AdamOptimizer(Loss,Mncfr)]

12. 返回[Mncfi]

算法輸入包括[Duser,Ditem,Dreview,Nwindows,Nnerual,Nepochs]分別為用戶數據向量、物品向量、評價詞向量、卷積核大小向量、全連接層大小向量以及算法運行次數。其中包括Embedding,Conv,FullConnect,CrossEntropy,AdamOptimizer,它們分別是Embedding 為詞嵌入映射函數,把來自數據集的數據D映射到特性空間中F.Conv 為卷積函數,根據卷積核w把數據[Freview]映射到卷積層[Fwcov_layer];FullConnect 為全連接層,把上一層特征[Mincfr]權重輸出到下一層[Mi+1ncfr];CrossEntropy 為交叉熵損失函數,通過[M-1ncfr]神經網絡最后一層的輸出計算交叉熵;Min_AdamOptimizer 為優化函數,通過最小化交叉熵獲取合適的模型權重。最后NCF -i算法返回模型權重矩陣[Mncfi]。

實驗中,為了與提出的NCF -i模型進行比較分析,使用應用了商品評論的推薦模型、FM模型以及一般的NCF模型進行對比。使用的一般NCF模型如圖5所示。

使用已有的應用了商品評論的推薦模型是基于物品的協同過濾方法,根據評論對商品進行聚類,之后根據聚類結果,計算商品最近鄰居的平均得分預測商品得分

3 NCF -i模型實驗設計與結果分析

3.1 NCF -i模型實驗數據

亞馬遜是一家電子商務公司,其對于推薦系統的研究與發展發揮了巨大的推動作用。據亞馬遜前科學家Andreas Weigend在斯坦福講課時提到的數據,亞馬遜有20%-30%的銷售額應該歸功于推薦系統。本文使用亞馬遜的食品評論數據集和亞馬遜嬰幼兒商品數據集對模型進行訓練和測試。兩個數據集格式類似,包括的字段主要內容有:ProductId(產品id)、UserId(用戶Id)、helpfulnessNumberator(覺得該評論有所幫助的用戶數量)、HelpfulnessDenominator(認為該評論有無幫助的用戶數目)、Score(用戶對商品的評分)、Time(評論時間)、Summary(評論摘要)、Text(評論文本)等。

3.2 NCF-i模型訓練與測試

選取數據集中的UserId(用戶Id)作為用戶特征進行處理,選取ProductId(商品Id)作為商品特征進行處理,同時考慮模型在不同數據集下的泛化能力,而不僅僅是在該數據集上的表現。選用Text(評論文本)作為商品評論特征,放棄比如helpfulnessNumberator(覺得該評論有所幫助的用戶數量)這種會有較大幫助卻在其它數據集上很少見的字段。將UserId、ProductId和Text進行數據處理后作為輸入,將Score(用戶對商品的評分)作為標簽,將數據劃分為訓練集和測試集,使用訓練集對NCF –i模型進行訓練,使用測試集對訓練好的模型效果進行測試。

3.3 NCF-i模型測試結果

為了驗證添加了商品評論的NCF模型效果,同時使用一般的NCF模型、傳統的推薦算法FM模型以及應用商品評論的協同過濾模型作為NCF -i模型進行對比,使用精度對模型效果進行衡量(精度為機器學習模型預測的用戶對商品的評分與用戶對商品實際評分相等的數據占總數據的比例)。精度定義為:

其中,I(*)為指示函數,當*為真時,I取1;當*為假時,I取0[19]。

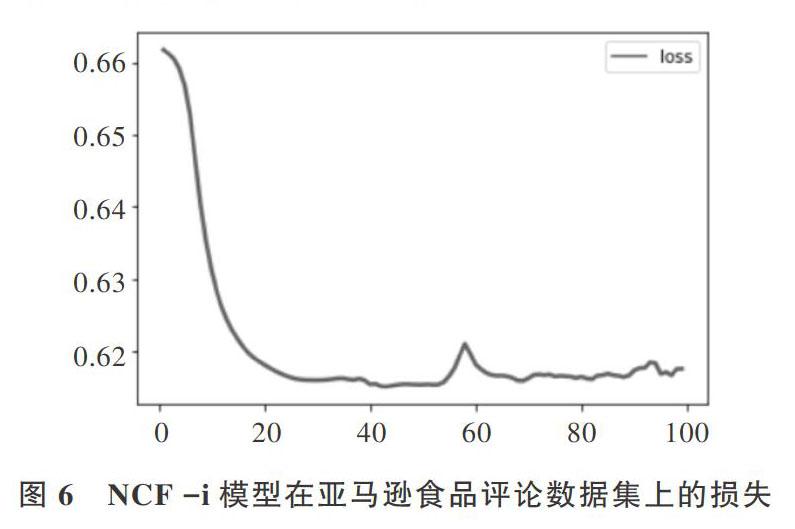

首先對亞馬遜食品評論數據集進行清洗,選取40000條數據,用該數據集對3個模型進行訓練和測試,包括NCF模型、NCF -i模型以及FM模型,觀察NCF -i模型在測試集上的損失率,如圖6所示。橫軸為訓練的輪次,縱橫為損失率。結果發現,損失率在前20輪訓練過程中有大幅度下降,之后損失率趨于平緩。

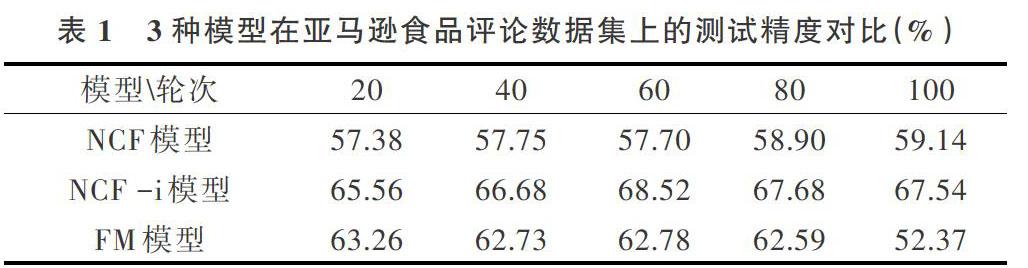

之后查看3種模型經過不同輪次的訓練后在測試集上的精度對比,測試結果如表1所示。

可以觀察到NCF -i模型效果好于FM模型,更好于NCF模型。但是同時也發現FM模型的效果似乎更好于NCF模型,為了更好地對3個模型的精度進行對比,通過折線圖觀察不同模型在測試集上的精度,模型的橫軸為訓練輪次,縱軸為精度,折線圖如圖7所示。

觀察圖7可以發現,雖然FM模型的精度有時優于NCF模型,但FM模型的精度十分不穩定,波動極大。分析出現該現象的原因,是由于FM模型只能獲取user和item之間的線性相關關系,無法獲取非線性關系。同時由于數據集數據比較稀疏,在驗證集測試過程中出現了冷啟動現象,導致FM模型測試的精度波動極大[20]。

將NCF模型與FM模型比較可以看出,NCF模型精度雖然不如FM模型最優預測結果表現好,但是其預測精度波動小,預測精度十分穩定。分析出現該現象的原因,是由于NCF使用神經網絡的方式獲取user和item之間的相互關系,而神經網絡使用激活函數對網絡的隱藏層輸出進行激活,讓NCF模型具有獲取user和item之間非線性關系的能力,從而使其在測試集上的精度十分穩定。

之后對應用商品評論的協同過濾模型在該數據集上進行訓練和測試,模型精度和商品評論數目有關。因此在限制商品擁有的最少評論數目條件下,觀察該模型符合要求的商品數目和模型在測試集上的精度,如表2所示。

從表2可以看到,應用商品評論的協同過濾模型在考慮全部商品時,模型精度很低,而當限制商品擁有的最少評論數時,模型精度有了明顯提高,但是符合要求的商品數目急劇減少。當模型精度達到70%,超過NCF -i模型的穩定精度67%~68%時,符合要求的商品數目僅為91個,為商品總數的22.09%。由此得到結論,應用商品評論的協同過濾模型只對熱門商品的推薦結果優秀,冷啟動問題嚴重。而NCF -i模型對于全部商品推薦的精度高于應用商品評論的協同過濾模型精度,同時NCF -i模型預測精度更穩定。

為了進一步驗證結論,對亞馬遜嬰幼兒商品評論數據集進行同樣操作,用該數據集對3個模型進行訓練和測試,觀察NCF -i模型在測試集上的損失率,如圖8所示,橫軸為訓練輪次,縱橫為損失率。發現損失率在前20輪訓練過程中有大幅度下降,之后損失率雖有波動,但逐步趨于平緩。

之后查看3種模型經過不同輪次的訓練后,在測試集上的精度對比,測試結果如表3所示。

為了進一步觀察結果,通過折線圖來觀察不同模型在測試集上的精度,模型橫軸為訓練輪次,縱軸為精度,折線圖如圖9所示。

通過觀察圖4可以發現,NCF-i模型的精度遠高于NCF模型和FM模型,并且其穩定性也能保持較好水平。分析出現該現象的原因,是由于NCF-i模型既使用神經網絡的方式獲取user和item之間的非線性關系,避免了冷啟動問題,保持精度的穩定性;同時使用Inception結構卷積神經網絡將商品評論信息添加到模型中,進一步提高了預測精度。而FM模型只能獲取user和item的線性相關關系,冷啟動問題嚴重。并且FM模型和NCF模型都未利用商品評論信息,因此精度低于NCF-i模型。

之后對應用商品評論的協同過濾模型在亞馬遜嬰幼兒商品評論集上進行訓練和測試,觀察在限制商品擁有的最少評論數目條件下,該模型符合要求的商品數目和在測試集上的精度,如表4所示。

可以觀察到,即使通過限制商品最少的評論數目,有效提高應用商品評論的協同過濾模型精度,但其精度在不犧牲符合要求的商品數目前提下都低于NCF -i模型。分析出現該現象的原因,是由于協同過濾模型受冷啟動問題困擾,導致其只對熱門商品的推薦有較好效果,而NCF-i模型可以有效克服冷啟動問題。

3.4 NCF-i模型實驗結論

通過將NCF模型、FM模型、應用商品評論的協同過濾模型和NCF-i模型在亞馬遜食品評論數據集和亞馬遜嬰幼兒商品數據集上訓練和測試,可以發現與FM模型和NCF模型相比,NCF-i模型不僅在測試集上的預測精度十分穩定,而且精度高出FM模型和NCF模型。與應用商品評論的協同過濾模型相比,在考慮全部商品的情況下,NCF-i模型精度遠遠高于協同過濾模型,協同過濾模型只對熱門商品的推薦效果良好,但冷啟動問題嚴重。這是因為NCF-i模型既使用神經網絡獲取user和item之間的非線性相關關系,避免了冷啟動問題,提高了預測精度的穩定性,而且將使用Inception結構的卷積神經網絡獲取的商品評論信息添加到模型中,讓模型能夠獲取user、item和商品評論之間非線性相關關系。可以發現,user對item的評論的確包含重要信息,對于推薦算法能起到重要作用[21]。

4 結語

由于商品評論中包含有關用戶對商品喜好程度的重要信息,而傳統的推薦算法很難對商品評論這類文本有效利用,因此本文基于NCF模型,設計了一種能將商品評論充分利用的NCF-i模型。該模型通過使用Inception結構的卷積神經網絡,對商品評論的文本進行分析,提取出文本的二元模型、三元模型、四元模型和五元模型特征,經過最大池化后將這些文本特征與user id的嵌入層、item id的嵌入層進行拼接得到特征層,之后使用全連接層獲取模型中的非線性相關關系,最后輸出模型預測的商品評分。

通過觀察NCF模型、FM模型、應用商品評論的協同過濾模型和NCF-i模型在亞馬遜食品數據集和亞馬遜嬰幼兒商品評論數據集上訓練和測試的結果,得到結論:NCF-i模型精度遠高于NCF模型、FM模型和應用商品評論的協同過濾模型,且能保持良好的穩定性。推薦系統使用NCF-i模型進行離線訓練會得到更優秀的推薦結果。但由于使用神經網絡的計算比較復雜,當用戶和商品規模巨大時,會消耗大量的資源以及時間,因此無法將模型應用于實時在線推薦。所以NCF-i模型的下一步發展方向是減少資源消耗以及減少耗費的時間,將其應用到大規模數據的實時推薦系統中。

參考文獻:

[1] 項亮. 推薦系統實戰[M]. 北京:人民郵電出版社,2012.

[2] RICCI F,ROKACH L,SHAPIRA B. Introduction to recommender systems handbook[M]. Boston:Springer,2011.

[3] WIETSMA R T A,RICCI F. Product reviews in mobile decision aid systems[C]. PERMID,2005: 15-18.

[4] RICCI F, WIETSMA R T A. Product reviews in travel decision making[M]. Information and communication technologies in tourism 2006. Vienna:Springer,2006.

[5] ACIAR S,ZHANG D,SIMOFF S,et al. Recommender system based on consumer product reviews[C]. Proceedings of the 2006 IEEE/WIC/ACM International Conference on Web Intelligence,2006:719-723.

[6] CHEN L, CHEN G, WANG F. Recommender systems based on user reviews: the state of the art[J].? User Modeling and User-Adapted Interaction, 2015, 25(2): 99-154.

[7] ZHANG Z,ZHANG D,LAI J. urCF: user review enhanced collaborative filtering[EB/OL]. https://onlinelibrary.wiley.com/doi/abs/10.1002/int.20495, 2014.

[8] XU J,ZHENG X,DING W. Personalized recommendation based on reviews and ratings alleviating the sparsity problem of collaborative filtering[C]. 2012 IEEE Ninth International Conference on e-Business Engineering. IEEE, 2012: 9-16.

[9] RAGHAVAN S, GUNASEKAR S, GHOSH J. Review quality aware collaborative filtering[C]. Proceedings of the sixth ACM conference on Recommender systems. ACM, 2012: 123-130.

[10] HE X, LIAO L, ZHANG H, et al. Neural collaborative filtering[C]. Proceedings of the 26th International Conference on World Wide Web,2017:173-182.

[11] LEE M,CHOI P,WOO Y. A hybrid recommender system combining collaborative filtering with neural network[C]. International conference on adaptive hypermedia and adaptive web-based systems,2002:531-534.

[12] ZHANG Y, JIN R, ZHOU Z H. Understanding bag-of-words model: a statistical framework[J]. International Journal of Machine Learning and Cybernetics, 2010, 1(1-4): 43-52.

[13] LEVY O, GOLDBERG Y. Neural word embedding as implicit matrix factorization[C]. Advances in neural information processing systems,2014: 2177-2185.

[14] RONG X. Word2vec parameter learning explained[J].? arXiv preprint arXiv,2014(1411): 2738-2751.

[15] KIM Y. Convolutional neural networks for sentence classification[J].? Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing, 2014(1):1746-1751.

[16] TANG P,WANG H,KWONG S. G-MS2F: Googlenet based multi-stage feature fusion of deep CNN for scene recognition[J].? Neurocomputing,2017(225): 188-197.

[17] ZHANG Y,WALLACE B.? A sensitivity analysis of (and practitioners guide to) convolutional neural networks for sentence classification[EB/OL].? http://xueshu.baidu.com/usercenter/paper/show?paperid=b901e951b6b7d7cdf13750b008dd66ad&site=xueshu_seResearchGate

[18] CAVNAR W B,TRENKLE J M. N-gram-based text categorization[C]. The 3rd annual symposium on document analysis and information retrieval,1994:161-175.

[19] 周志華. 機器學習[M]. 北京:清華大學出版社,2016.

[20] HERLOCKER J L,KONSTAN J A,TERVEEN L G,et al. Evaluating collaborative filtering recommender systems[J]. ACM Transactions on Information Systems (TOIS),2004,22(1):5-53.

[21] FENG Z,HUIYOU C. Employing bp neural networks to alleviate the sparsity issue in collaborative filtering recommendation algorithms [J]. Journal of Computer Research and Development,2006(4): 14-21.

(責任編輯:杜能鋼)