基于多層特征增強的實時視覺跟蹤

費大勝,宋慧慧,張開華

(1.江蘇省大數(shù)據(jù)分析技術重點實驗室(南京信息工程大學),南京 210044;2.江蘇省大氣環(huán)境與裝備技術協(xié)同創(chuàng)新中心(南京信息工程大學),南京 210044)

(?通信作者songhuihui@nuist.edu.cn)

0 引言

目標跟蹤一直是計算機視覺中的一個熱點問題,在導彈定位、視頻監(jiān)控和無人機偵察等眾多領域有著豐富的應用,但是在跟蹤過程中仍然存在許多挑戰(zhàn),包括光照變化、角度旋轉、比例變化、目標變形、遮擋和攝像機運動等因素,這些問題仍然在不斷促進著目標跟蹤領域的蓬勃發(fā)展。

目標跟蹤算法主要分為基于相關濾波的跟蹤算法和基于孿生網(wǎng)絡的跟蹤算法兩大類。基于相關濾波的跟蹤算法通過循環(huán)矩陣將目標函數(shù)從頻域內轉到傅里葉域求解獲得濾波器的閉式解,實現(xiàn)許多高速且簡易的跟蹤器[1-3]。隨著卷積神經(jīng)網(wǎng)絡的崛起,基于孿生網(wǎng)絡的目標跟蹤算法[4-5]充分發(fā)揮了卷積神經(jīng)網(wǎng)絡(Convolutional Neural Network,CNN)的作用,將跟蹤當作一個匹配任務,把第一幀目標當作模板匹配其他幀,得到目標區(qū)域。基于此任務,之后工作也對全卷積孿生網(wǎng)絡(Fully-Convolutional Siamese visual tracking network,SiamFC)[5]不斷改進。動態(tài)孿生網(wǎng)絡(Dynamic Siamese network,DSiam)[6]使用一個動態(tài)模板和一個快速轉變模塊更新孿生跟蹤模型。高性能的孿生候選區(qū)域網(wǎng)絡(Siamese with Region Proposal Network,SiamRPN)[7]將目標檢測中的候選特征網(wǎng)絡Faster RCNN[8]引入到視覺跟蹤任務中,解決了SiamFC 多尺度測試消耗計算時間和出框方式過于粗糙的問題。干擾感知孿生網(wǎng)絡(Distractor-aware Siamese network,DaSiam)[9]更進一步提出了一種干擾-感知的孿生網(wǎng)絡用于更精確的長時跟蹤。語義外觀雙分支孿生網(wǎng)絡(Semantic and Appearance Siamese network,SA-Siam)[10]在原有的兩分支上多加了兩個分支分別為語義分支和外觀分支來增加模型的表征能力。

盡管現(xiàn)在的孿生網(wǎng)絡跟蹤算法在精度和性能上都取得了較大的突破,但是仍有兩個問題需要解決:首先,DASiam[4]只是簡單地將原始的特征提取網(wǎng)絡換成了VGG(Visual Geometry Group)[11]網(wǎng)絡,這在一定程度上抽象了目標的表示而忽略了目標的外觀紋理特性,當遇到具有相似語義信息的背景時,目標通常會發(fā)生漂移;其次,大多數(shù)基于孿生網(wǎng)絡的目標跟蹤算法忽略了高層語義特征對于目標在視頻序列中定位的長期依賴性,這限制了目標在遇到相似語義特征干擾時的長期定位能力。

為解決這兩個問題,本文提出一種多層特征增強的孿生網(wǎng)絡跟蹤算法。本文在SiamFC 基礎上,通過數(shù)據(jù)增強技術將淺層特征和高層特征相融合,增強模型魯棒性。為進一步增強網(wǎng)絡模型長時定位能力,提出一種像素感知的全局上下文注意力機制模塊(Pixel-aware global Contextual Attention Module,PCAM),最后為驗證該算法各模塊的有效性,在三個具有挑戰(zhàn)性的目標跟蹤視頻庫中做了大量實驗,與一些經(jīng)典跟蹤算法進行比較,得到了很有說服力的結果。

1 多層特征增強的跟蹤算法

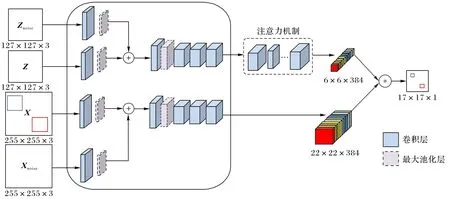

本文提出一種輕量級多層特征增強的跟蹤網(wǎng)絡(Multilevel Feature Enhanced Siamese network for tracking,MFESiam),如圖1 所示。首先本文發(fā)現(xiàn)非語義背景和相似干擾物失衡是提升網(wǎng)絡性能的主要障礙,所以本文通過一種數(shù)據(jù)增強策略來增強淺層的特征;此外本文提出一種像素感知的全局上下文注意力機制模塊來增強高層模板特征的感知定位能力,最后將提取到的模板特征和搜索特征進行卷積得到下一幀目標位置。

圖1 所提算法原理Fig.1 Principle of the proposed algorithm

1.1 基于全卷積孿生網(wǎng)絡目標跟蹤

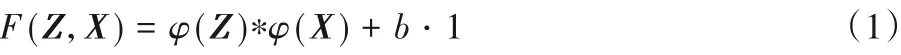

近年來目標跟蹤孿生網(wǎng)絡算法都是基于全卷積孿生網(wǎng)絡跟蹤算法[5]改進,它是目標跟蹤領域的開創(chuàng)性工作。原始孿生網(wǎng)絡有兩個輸入分支:模板分支Z 和搜索分支X,其中Z ∈RW×H×3,X ∈RW×H×3,Z和X分別被裁剪成255×255×3和127×127×3 的圖像對輸入網(wǎng)絡,在搜索圖像的初始幀上采取16 個搜索框隨機滑動。經(jīng)過一個全卷積無填充的AlexNet[12]提取圖像特征。Z 和X 在共享權重的AlexNet 中最后輸出分別為22×22×256和6×6×256,最后經(jīng)過卷積的相關操作得到一個17×17×1的得分圖。得分圖中得分最高的一個點即是下一幀預測點的中心位置。SiamFC 設置了三種固定的尺度{0.974 5,1,1.037 5},通過雙線性插值從而得到下一幀預測的跟蹤框。整個網(wǎng)絡通過一個離線訓練的匹配函數(shù)F(Z,X)獲得最終得分圖的預測分數(shù),網(wǎng)絡的預測函數(shù)公式如下:

其中:Z 和X 分別為模板和搜索分支輸入,φ 為網(wǎng)絡特征的嵌入函數(shù),“*”表示相關運算,b為網(wǎng)絡的偏置項。整個網(wǎng)絡采用二分類的邏輯損失函數(shù),具體表達式(2)如下:

其中:v 表示單個模板-搜索匹配對的真實得分,y ∈{+1,-1}代表這個匹配對的真實標簽值,從而計算出一個模板和多個搜索區(qū)域匹配的相似性。

1.2 多層特征增強網(wǎng)絡框架

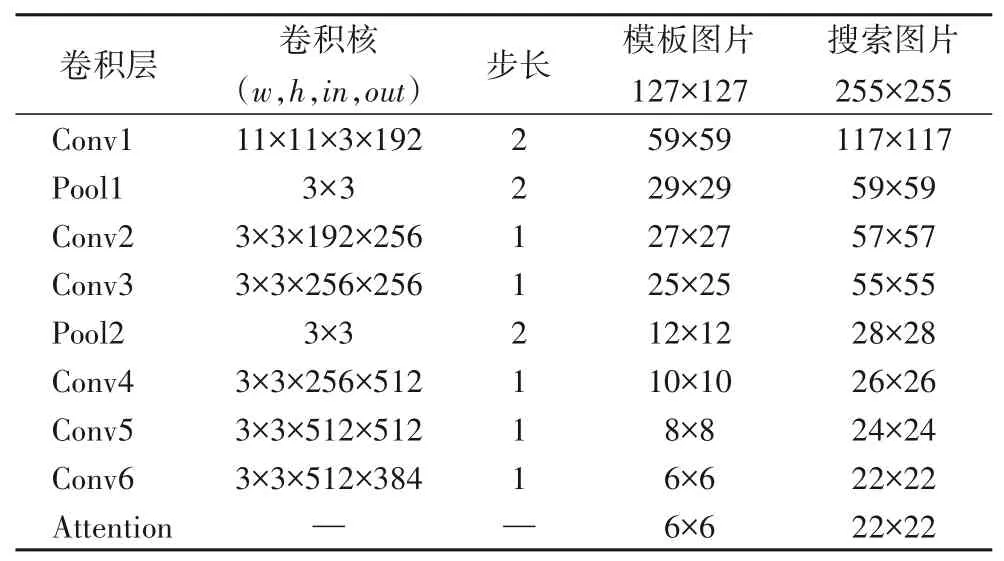

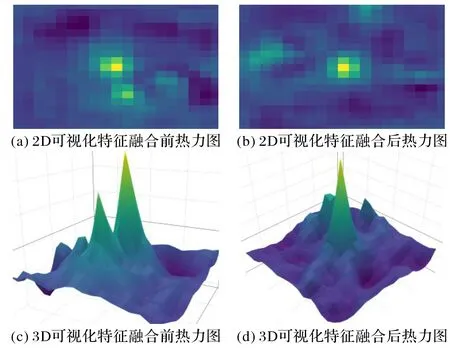

本文方法不同于之前的孿生網(wǎng)絡只有兩支輸入分支:模板分支Z 和搜索分支X,如圖1 所示,MFESiam 增加了兩個輸入分支:噪聲模板分支Znoise和噪聲搜索分支Xnoise。首先,本文的噪聲模板分支和噪聲搜索分支是通過整個訓練數(shù)據(jù)集在輸入若干個模板和搜索匹配對時以5%的概率隨機選取一個匹配對;然后,在這個匹配對中隨機合成5%的像素值為0 的噪聲點和95%的像素值為255的噪聲點;最后,將經(jīng)過數(shù)據(jù)增強的兩個分支:Znoise和Xnoise分別作為孿生網(wǎng)絡另外兩個并行的輸入分支,通過第一個卷積層和第一個最大池化層提取特征后分別與原始模板分支和搜索分支相融合,來模擬一些對目標跟蹤具有挑戰(zhàn)性的因素。將噪聲模板分支和噪聲搜索分支在第一個最大池化層之后融合是因為在最大池化層之后,特征圖通常會在一定程度上失去一些位置信息,所以在第一個最大池化層之后加入一些合成的椒鹽噪聲來增強算法的魯棒性,并且最大池化層由于對局部形變的不變性,所以它對局部的變化是具有魯棒性的。因此,融合后的淺層特征已經(jīng)被增強,并且當目標在經(jīng)歷一些復雜場景挑戰(zhàn)例如快速運動、遮擋以及相似物干擾等時不會輕易丟失目標。從圖2可視化的2D和3D特征中可以看出,在未采用本文數(shù)據(jù)增強方式下的熱力圖中會出現(xiàn)因相似語義信息干擾而導致跟蹤發(fā)生漂移的情況,而在經(jīng)過了數(shù)據(jù)增強后的融合特征則在一定程度上抑制了因為相似物體干擾而漂移的情況,使得跟蹤器能更為魯棒地對特定目標進行跟蹤。此外,本文還對無填充的全卷積AlexNet網(wǎng)絡進行了改進,具體參數(shù)如表1,將原始的大尺寸卷積換成了多個小尺寸卷積,并且增加網(wǎng)絡層的維度,這樣加大網(wǎng)絡的深度和維度來學習到更為魯棒的特征表示。

表1 多層特征增強孿生網(wǎng)絡參數(shù)Tab.1 Multi-level feature enhanced Siamese network parameters

圖2 數(shù)據(jù)增強前后特征可視化圖Fig.2 Visualization of features before and after data enhancement

在淺層特征融合的過程中,本文采用了一種新的正則化方式來訓練網(wǎng)絡,本文在每個訓練過程中設置了5%的比率在模板圖片(Z)上裁剪出一個30×30的隨機掩碼,掩碼的像素值設置為0。通過這種方式來隨機生成一些被遮擋的目標從而提升目標在運動中遭遇遮擋時的魯棒性,不僅讓模型在遇到遮擋的情況下表現(xiàn)得更好,而且使得訓練出的模型能更敏感地去考慮環(huán)境的變化。

1.3 像素感知的全局上下文注意力機制

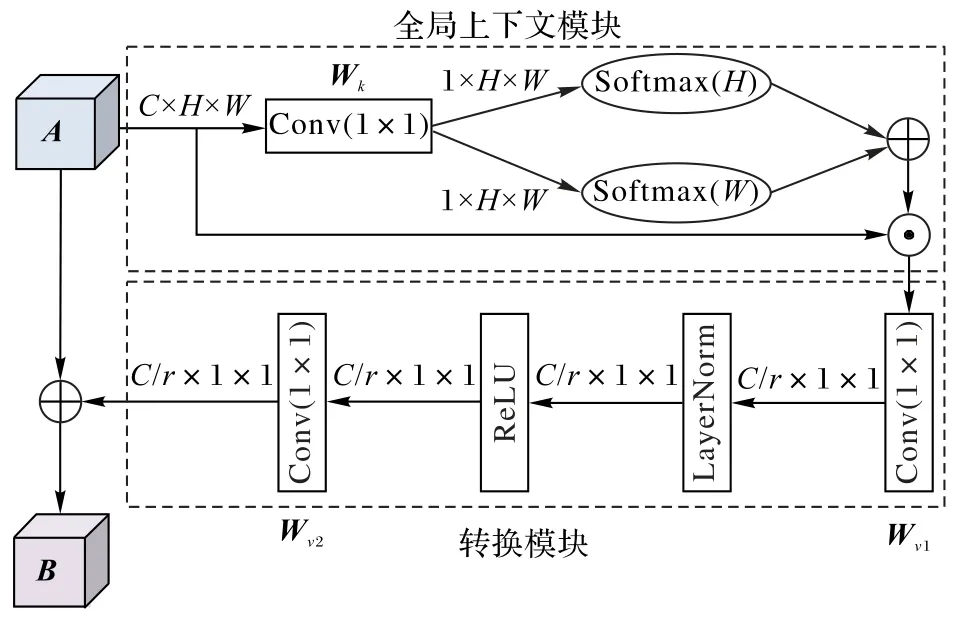

鑒于本文提出的MFESiam 對于目標定位是一個典型的匹配模型,模板圖片Z 的高層語義特征對模型的目標外觀就顯得尤為重要。為了進一步捕獲目標與背景區(qū)域的長時依賴關系,使得跟蹤器在經(jīng)歷明顯的目標位移下還能有優(yōu)異的定位能力,本文設計一個PCAM 模塊來增強高層語義特征從而加強模板分支的目標定位能力。圖3 顯示了PCAM 的結構,A ∈RW×H×C作為輸入的卷積特征圖,H、W 分別代表了特征圖的長和寬,C 代表了通道的維數(shù),B 作為輸出擁有和A 一樣的結構。

圖3 像素感知的全局上下文注意力機制Fig.3 Pixel-aware global contextual attention module

PCAM 由一個全局上下文模塊和一個轉換模塊組成。本文的全局上下文模塊是由非局部(Non-local)模塊[13]化簡而來,不僅極大地降低了原有的計算復雜度,而且可以從全局特征圖的時間域和空間域內捕獲目標可能存在的位置。首先在模板分支最后一個卷積層Conv6 后增加一個全局上下文模塊,將作為整個特征圖的輸入像素。Np為特征圖像素點位置的數(shù)目。整個全局上下文模塊采用一個1×1卷積Wk將H×W×C 的特征維度轉換成一個H×W×1 的特征圖,然后在特征圖的每個像素點xj上,通過一個行和列雙向的Softmax捕獲整個全局上下文的像素感知信息。最后,本文使用一個改良的SENet(Squeeze-and-Excitation Network)[14]改變全局特征圖的維度到C維并且通過自主學習來獲得每個特征通道的重要性。這個轉變模塊在圖中由一個1×1 卷積Wv1、一個歸一化層LayerNorm(LN)、一個ReLU(Rectified Linear Unit)激活函數(shù)和一個1×1 卷積Wv2構成。對特征通道的相關性進行建模使得激活相應目標對指定通道的響應。設置默認的比率r=8,將轉換模塊的參數(shù)量減少到原始SENet 參數(shù)量的1/4,r 指通道的壓縮率,C/r 指隱藏特征表示維度。本文在ReLU 激活層之前增加LayerNorm 來減少優(yōu)化轉換模塊帶來的計算復雜度。是全局上下文池化信息,然后將原始輸出X 與帶權重的特征矩陣δ(?)=Wv2ReLU(LN(Wv1(?)))相加構成一個殘差網(wǎng)絡來提高目標特征的感知能力。像素感知的全局上下文注意力(PCAM)模塊的具體細節(jié)可以用如式(3)表示:

本文的PCAM 由以下三部分組成:1)全局上下文池化為上下文本建模;2)轉換模塊捕獲通道相關性;3)用于特征融合的廣播機制相加。

1.4 網(wǎng)絡訓練細節(jié)

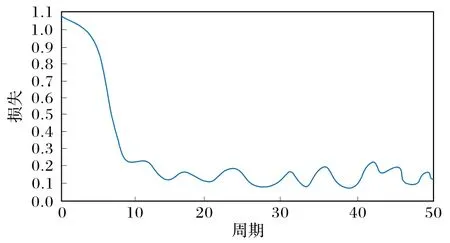

本文隨機從GOT-10K[15]和VID2015[16]數(shù)據(jù)集里提取模板和搜索圖片離線訓練網(wǎng)絡結構,采用隨機梯度下降(Stochastic Gradient Descent,SGD)算法隨機初始化目標函數(shù),采用二分類交叉熵損失對整個網(wǎng)絡進行訓練,訓練50 個周期。學習率從10-2幾何式衰減到10-5。從圖4 中可以看出整個訓練過程損失是最終收斂的,但是最優(yōu)值不一定是在最后一個周期內,從而證明本文算法的穩(wěn)定性。本文的算法是通過PyTorch1.0.1 來實現(xiàn),硬件由一臺配置為英特爾i7-8700k CPU 和一塊GTX2080 Ti 顯卡支持加速。采用基準SiamFC 的方式,用三種固定的尺度{0.974 5,1,1.037 5}來估計目標尺度。此外,尺度的變化通過線性插值的方式來更新,如式(4)所示,更新因子(scale_lr)設為0.59。x0為中間尺度1,x1為懲罰后的尺度,從而通過線性插值的方式更新尺度信息。

圖4 網(wǎng)絡訓練損失曲線Fig.4 Network training loss curve

2 實驗結果分析

為驗證本文算法有效性,在三個本領域公認非常具有挑戰(zhàn)性的目標跟蹤視頻庫OTB2015[17]、VOT2018[18]和GOT-10K[15]上進行實驗,并與多個經(jīng)典算法進行比較,大量實驗顯示了本文算法具有比較有競爭力的表現(xiàn)。

2.1 在OTB2015上的評估

OTB2015[17]是目標跟蹤領域用于評價算法優(yōu)異程度的視頻跟蹤庫,它由100 個人工標注的跟蹤視頻組成。不同的數(shù)據(jù)集具有不同屬性,這些屬性可代表當前目標跟蹤領域的常見難點,例如光照變化、尺度變化、遮擋和形變等。OTB2015主要使用兩個標準評價指標:精確率和成功率。精確率表示為預測目標位置的中心點到真實位置的中心點距離小于給定閾值的視頻幀數(shù)所占總幀數(shù)的百分比。成功率則表示跟蹤框與標注框的重疊率得分,即為超過某個閾值的幀個數(shù)占視頻總幀數(shù)的百分比。首先定義重疊率得分(Overlap Score,OS),跟蹤算法得到的定位框(記為a)與真實標簽給出的框(記為b),重疊率定義如式(5)所示:

其中|a ∩b|表示定位框和真實標簽給出的框相交共有區(qū)域的像素數(shù)目。當某一幀OS大于設定閾值時,則該幀被視為成功,總體成功的幀占所有幀的百分比即為成功率。跟蹤算法估計的目標位置中心與目標實際標簽的中心點,這兩者的距離小于給定閾值視頻幀的百分比即為精確率。首先我們在OTB2015 上可視化了目標運動軌跡,如圖5,本文利用視頻幀中每幀目標框上下左右的坐標點計算出中心坐標(圖中圓點)可視化顯示每幀運動目標軌跡。

圖5 目標運動軌跡Fig.5 Target trajectory

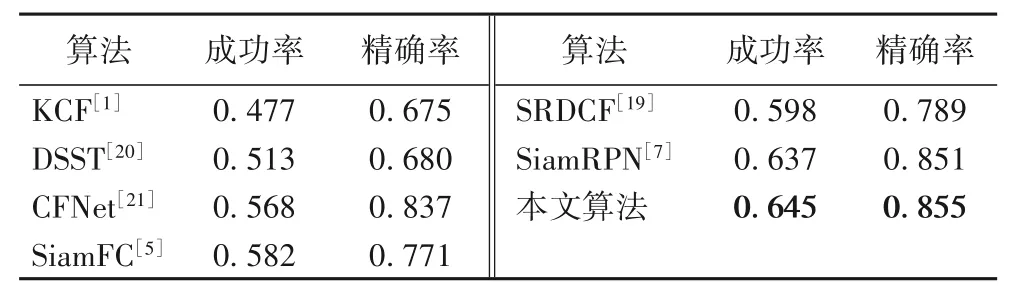

這里將本文算法與六種經(jīng)典算法進行比較:候選區(qū)域孿生跟蹤器(Siamese Region Proposal Network,SiamRPN)[7]、空間正則判別相關濾波器(Spatially Regularized Discriminative Correlation Filter,SRDCF)[19]、核化相關濾波器(Kernelized Correlation Filter,KCF)[1]、全卷積孿生網(wǎng)絡(Fully-Convolutional Siamese network,SiamFC)[5]、判別尺度空間跟蹤器(Discriminative Scale Space Tracker,DSST)[20]和表征學習相關濾波跟蹤器(Representation Learning for Correlation Filter,CFNet)[21]。表2顯示本文MFESiam 在精確率和成功率上都取得最好效果,成功率達到64.5%的得分,精確率達到85.5%,分別優(yōu)于2018 年VOT 冠軍SiamRPN 0.8 個百分點和0.4 個百分點,且本文的MFESiam 算法在成功率和精確率上分別在基線SiamFC 上提升了6.3 個百分點和8.4 個百分點。優(yōu)異的結果證明本文所提算法在跟蹤中面對一些具有挑戰(zhàn)性的因素如快速運動、目標遮擋、相似物干擾等困難情況下是魯棒的。

表2 OTB2015上算法成功率和精確率的對比Tab.2 Comparison of algorithms on success rate and accuracy on OTB2015

圖6 是本文算法MFESiam 與基線SiamFC 算法在OTB2015上可視化對比。從三個比較有代表性的視頻序列中可看出本文算法在快速運動、目標遮擋和相似語義干擾情況下,目標都有優(yōu)異的跟蹤表現(xiàn)。從視頻序列(a)可看出,在模板分支的高層特征后添加PCAM 模塊提高了目標的長時感知定位能力,在同樣的情況下本文基線SiamFC 在第337 幀之后已經(jīng)丟失了目標,而添加了PCAM 模塊后讓目標在經(jīng)歷快速運動時也能精確跟蹤。而從序列(b)中可以看出采用了隨機裁剪的新型正則化訓練方式,跟蹤器能自發(fā)地去思考環(huán)境的變化,從而在遭遇遮擋的情況下也能不丟失目標。從序列(c)中可以看出通過數(shù)據(jù)增強的技術來加強淺層目標的紋理特性,使得跟蹤器在遇到相似語義信息背景干擾時目標不會輕易發(fā)生漂移。

圖6 OTB2015上各算法可視化對比Fig.6 Visualization comparison of different algorithms on OTB2015

對于模板分支的高層特征,本文采用一個像素感知的全局上下文注意力機制模塊來提升目標的感知力。像素點特征對目標的遮擋和快速運動都具有比較強的魯棒性,并且每幀圖像的搜索區(qū)域不受目標初始模板大小的限制。從圖7 仿真實驗可看出,本文通過全局上下文模塊捕捉全圖像素特征,通過轉換模塊激活對應于特定目標的響應通道,可篩選出較為理想的目標像素點,最后根據(jù)強分類器對前景背景像素點進行分類,輸出目標位置。

圖7 目標像素點實驗仿真圖Fig.7 Experimental simulation of target pixels

2.2 在VOT2018上的評估

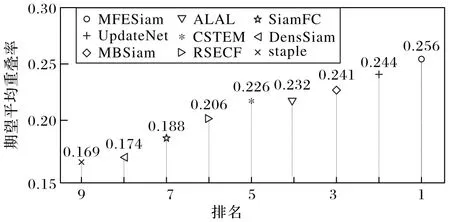

VOT2018 一共有60 個經(jīng)過精細標注的短時跟蹤視頻集,且評價指標更為精細。VOT2018 與OTB2015 的最大差異是OTB2015 由隨機幀開始,而VOT2018 是給定第一幀初始化,每次跟蹤失敗時,5 幀之后重新初始化。VOT2018 在跟蹤序列上目標的變化更為復雜,跟蹤難度更高。VOT 的評價指標主要是期望平均重疊率(Expected Average Overlap,EAO),由精度(Accuracy,A)和魯棒性(Robustness,R)組成。如圖8 所示,在VOT2018 數(shù)據(jù)庫中本文的算法與其他八個算法在基線上進行比較,其EAO 指標排名第一達到了0.256,超越本文基線SiamFC 6.8 個百分點,表明本文所提算法在跟蹤難度較大的小目標上也有非常良好的競爭力。

圖8 VOT2018上的期望平均重疊率排名Fig.8 Expected average overlapping rate ranking on VOT2018

2.3 在GOT-10K上的評估

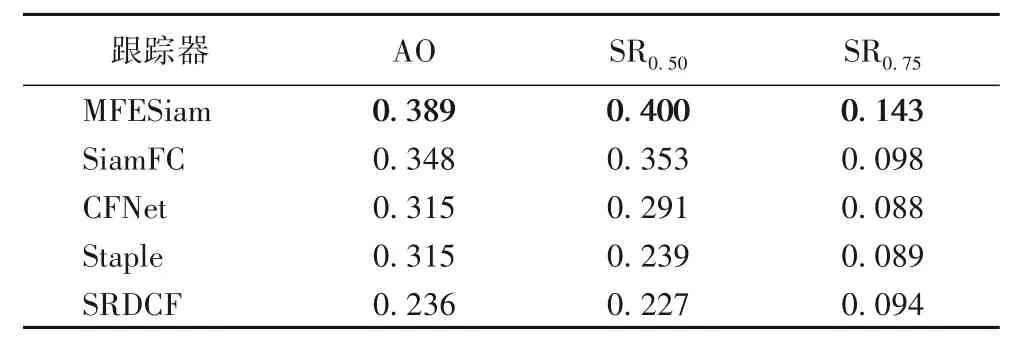

GOT-10K 包含訓練集和測試集兩部分,而且為了訓練出的模型能有更強的泛化能力,訓練集和測試集之間不存在交集。它包含了1 000 個目標跟蹤視頻,包含150 萬個手工標注的邊界框。GOT-10K挑戰(zhàn)集有兩個內部的評價指標,包括:在所有幀中跟蹤結果和真實標簽平均重合率(Average Overlap,AO)和在一個給定閾值下成功跟蹤的視頻幀所占的比率(Success Rate,SR)。數(shù)據(jù)集大部分是戶外拍攝的物體,包含許多尺度變化劇烈的跟蹤目標。從表3 可以看出本文的算法在AO 的指標下超越了基線SiamFC 4.1 個百分點,在SR0.50上超越基線SiamFC 4.7 個百分點,這也證明本文算法在大尺度變化跟蹤序列上有著優(yōu)異的定位與跟蹤能力。

表3 GOT-10K挑戰(zhàn)的指標排名Tab.3 Indicator ranking on GOT-10K

2.4 消融實驗

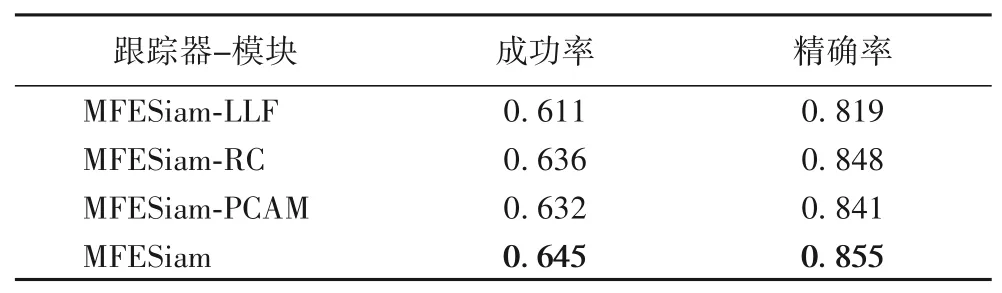

本文也在OTB2015 上進行消融實驗來驗證本算法各個模塊的有效性,如表4所示。

表4 OTB2015上的消融實驗Tab.4 Ablation experiment on OTB2015

首先,本算法在移除了PCAM 后成功率下降了1.3 個百分點,這證明PCAM 模塊可以提升模板分支高層語義特征的感知定位,從而加強對于目標的長時定位能力;然后,從本算法中移除隨機裁剪(Random Cutout,RC)的訓練方式,算法成功率下降了0.9 個百分點,由此可見采用這種新型正則化的訓練方式來模擬目標在遭遇遮擋的情形,可以讓模型能夠更自發(fā)地去思考目標周圍所發(fā)生的變化,以達到更好的跟蹤效果;最后,本文移除了淺層特征融合模塊(Low Level Fusion,LLF),算法成功率下降了3.4個百分點,性能大幅度地降低證明了淺層特征融合模塊對于加強淺層的紋理特征,從而提高目標在跟蹤相似語義信息干擾是有效的。相較于原始基線SiamFC 成功率為58.2%,MFESiam 取得了最好的成功率為64.5%,這也充分證明本算法各模塊的有效性。

3 結語

本文提出一個實時跟蹤方法,通過設計一個有效的淺層特征增強模塊和一個用于模板分支高層語義特征增強的PCAM 模塊。淺層特征增強模塊使用一個簡易且高效的數(shù)據(jù)增強策略來加強網(wǎng)絡的魯棒性;而PCAM 模塊則是一個雙向像素感知的全局上下文注意力模塊,旨在于提升高層語義特征的感知定位能力。整個網(wǎng)絡通過離線訓練,在測試時不需要花費時間用于模型的在線更新。在OTB2015、VOT2018 和GOT-10K上充足的實驗表明本文所提算法在精度和速度上所取得了優(yōu)越性能,并且其實時性能以滿足實際的工業(yè)需求。但是本文方法在目標旋轉角度過大、光照變化明顯等因素出現(xiàn)時,跟蹤結果仍不理想,接下來將對目標旋轉角度過大和光照變化明顯等情況進行下一步的研究。