基于非對稱沙漏網絡結構的目標檢測算法

劉子威,鄧春華,劉 靜*

(1.武漢科技大學計算機科學與技術學院,武漢 430065;2.武漢科技大學大數據科學與工程研究院,武漢 430065;3.智能信息處理與實時工業系統湖北省重點實驗室(武漢科技大學),武漢 430065)

(?通信作者電子郵箱luijing_cs@wust.edu.cn)

0 引言

計算機視覺領域有很多不同的圖像研究任務,包括圖像分類[1]、目標檢測[2]、姿態估計[3]、語義分割[4]等。目標檢測任務需要為圖像中每一個實例預測出一個帶有類別標簽的邊界框,是一項具有挑戰性的任務。經過幾年的長足發展,深度學習模型逐漸取代傳統機器視覺方法成為目標檢測領域的主流算法。現代目標檢測任務按照檢測框架的不同可以分為兩個分支:單階段檢測器[5]與雙階段檢測器[6-7]。單階段檢測器一般通過卷積網絡直接生成特征圖從而計算出框的坐標與類別[8-9];雙階段檢測器首先通過區域候選網絡(Region Proposal Network,RPN)[10]得到區域推薦框,再對推薦框進行更進一步精細的分類與回歸操作[11-12]。絕大多數檢測器的檢測方法都是以多個寬高比例的錨框(Anchor)作為目標定位的參考點,再計算錨框與真實框的交并比(Intersection Over Union,IOU)來選擇其中最準確的錨框。這些檢測器的效果一定程度上依賴于手工預選取錨框的好壞程度,同時繁雜的錨框也為計算帶來了一些不便之處。為了解決上述問題,2019 年以來基于無錨框(anchor-free)的方法[13-19]開始流行。它憑借其簡單直觀的設計與良好的檢測性能受到了工業界的青睞,同時也是目標檢測近年的重要方向之一。

無錨框檢測作為目標檢測最新方向的同時也面臨著一些問題。首先,它在實際應用中速度與精度的平衡方面做得不夠理想。速度快的網絡精度一般,而精度高的網絡又無法達到實時。其次,無錨框檢測廣泛存在不同尺度目標間相互干擾的問題。這種問題在使用沙漏網絡作為主干網絡的無錨框檢測中尤其突出,是單一的特征提取方式與一段式網絡設計所造成的。最后,由于無錨框的檢測方法均生成單一尺度的特征圖,這樣會將尺度差距巨大的目標雜糅到一張特征圖上,難免使兩者間相互產生影響,所以模型在目標尺度差距過大的情況下效果不佳。

本文針對上述不足之處提出了一種在無錨框方法中使用的非對稱沙漏網絡結構。該結構能夠快速、高效抽象網絡的語義信息,在保持準確率的同時提高了檢測速度。本文的主要工作有:

1)提出了在無錨框檢測中使用的非對稱沙漏網絡結構。

2)設計了針對無錨框檢測的多尺度通路用來解決不同尺度目標間特征互相干擾的問題,并精細化網絡的預測結果。

3)在無錨框檢測中使用改進后的非極大值抑制(Non-Maximum Suppression,NMS)算法來保證多尺度輸出的健壯性。

1 相關工作

本章主要介紹近年來該領域相關研究的進展情況,分別闡述了錨框檢測器與無錨框檢測器之間的區別以及無錨框中的代表網絡CenterNet。

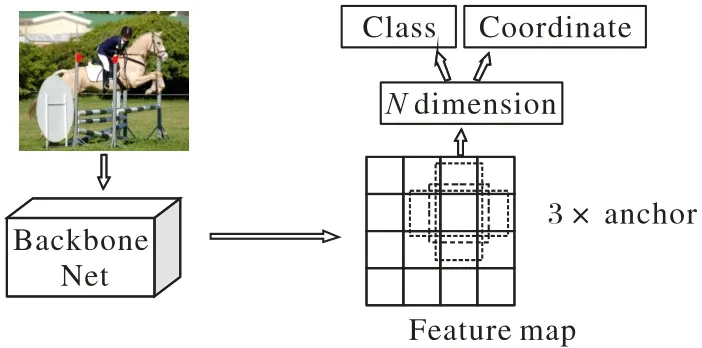

圖1 基于錨框檢測器的檢測流程Fig.1 Detection process of detector based on anchor

1.1 基于錨框的檢測器

基于錨框的檢測器均繼承了傳統的滑窗與區域建議的思想,其中最有名的是Girshick 等[20]在2014 年提出的區域卷積網絡(Region-Convolutional Neural Network,RCNN)系列網絡。它首先選擇性搜索出感興趣區域,然后將其送入后續的卷積神經網絡(Convolutional Neural Network,CNN)進行分類。后來的Fast-RCNN 通過裁剪不同尺度的圖像特征以節省計算量,再將特征送入分類與回歸層計算出最后結果。但是以上兩種方法都存在依賴手工特征提取方法來獲得感興趣區域的缺點。Faster-RCNN 提出了重要的RPN 結構,并將其用來替換傳統感興趣區域生成的部分。RPN 是一個全卷積網絡,使用不同長寬比例的Anchor 在特征圖上滑動并生成對應位置的特征。得益于這種高效的特征提取方式,Faster-RCNN在當時取得了良好的效果,是一項里程碑式的研究。YOLO(You Only Look Once)[21]與SSD(Single Shot MultiBox Detector)等著名的一階段檢測器將圖像劃分為一個個網格,并在每個網格上設置多個Anchor 用來回歸目標的形狀和類別。經過過去幾年大量檢測器的廣泛使用,Anchor的設計逐漸得到了普及,并且已經成為現代目標檢測的標準配置。但是,為了產生各種形狀的Anchor,模型需要預先定義各種不同的長寬比值,同時還要額外定義IOU 閾值來確定Anchor 是正樣本還是負樣本。這會給模型帶來更多額外的參數,這些參數也需要進行啟發式的搜索并且會對最終模型的精度產生較大影響。

1.2 無錨框檢測器

在拋棄錨框的檢測方法中,基于關鍵點的檢測是目前的主流方法。CornerNet 角點網絡通過回歸目標框左上角和右下角的兩個點來得到對象框;Triplets 三元點網絡通過融合雙角點與中心點的優點進一步提高檢測精度;無錨框特征選擇(Feature Selective Anchor-Free,FSAF)網絡可以很方便地嵌入到具有特征金字塔網絡(Feature Pyramid Network,FPN)的檢測器中,它使用非啟發式的在線選擇方法來匹配大小合適的錨框;全卷積單步檢測(Fully Convolutional One-Stage object detection,FCOS)網絡致力于消除那些高度重合的邊界框所產生的不良影響。

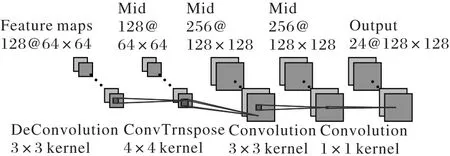

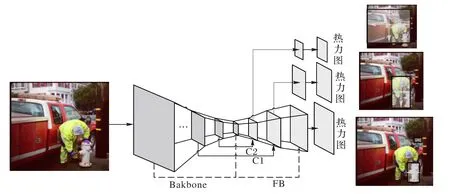

1.3 基于中心點的檢測網絡

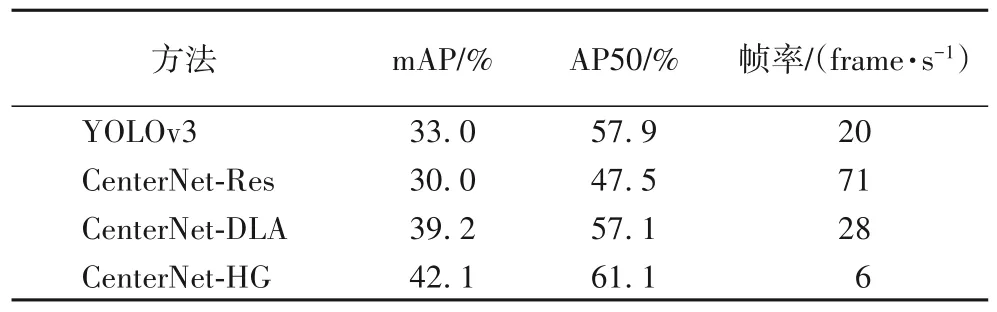

CenterNet 是一種基于中心點的檢測框架,它由CornerNet角點檢測的思想發展而來。它是一個標準的無錨框單階段目標檢測網絡,分為主干網絡部分(特征提取)和檢測頭(后處理與生成結果)兩部分。主干網絡部分可以使用殘差、深層聚合或者沙漏網絡等不同結構。其中沙漏網絡的精度最高,但它的速度卻是最慢的。主干網絡將得到的特征圖送入檢測頭部,特征圖上的每個位置都會密集地回歸出類別、長寬和偏移量。其中,類別得分值以熱力圖的形式產生,峰值即為物體的中心點,如圖2 所示。通過表1 可以看出:雖然使用沙漏網絡的CenterNet 達到42%的平均準確率(mean Average Precision,mAP)值,但是6 frame/s 的幀率對于單階段檢測器來說還是過于緩慢。而改用深層聚合(Deep Layer Aggregation,DLA)主干網絡后,速度達到28 frame/s的同時mAP也大幅降低。

值得一提的是在CenterNet-DLA 中AP50(IOU 為50%以上的平均準確率)指標相較于YOLOv3[22]并沒有提升,反而降低了一些。這說明其精度的提升并不是通過檢測出難檢目標所得來的,而是通過精修已經較準確的檢測框所得。在實際的檢測場景中AP50 某種程度上扮演著比mAP 更重要的角色,主要原因是實際檢測任務中沒有必要去追求AP75 或者AP90 這種高精度指標,反而更傾向于將性能在AP50 這種中等指標上提升。本文所提出的新結構使CenterNet 在保持檢測速度基本不變的情況下同時提升mAP 與AP50 的值,使得CenterNet 成為相同速度下效果最好檢測器之一,可以方便地遷移到各種不同場景。

圖2 最終的熱力圖形式Fig.2 Final heatmap format

表1 不同方法在各個指標上的對比Tab.1 Comparison of different methods on various indexes

2 本文方法

本章主要介紹本文方法的原理與實現細節,包括非對稱沙漏主干網絡、多尺度特征模塊、后處理過程三個部分。

2.1 非對稱沙漏主干網絡

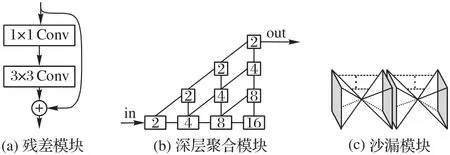

圖3為無錨框目標檢測器中常用的3種主干網絡模塊:殘差模塊[23]、深層聚合模塊[24]與沙漏模塊[25]。沙漏網絡通過捕捉多尺度特征信息與多個中間監督的結構來提高特征的精細度。沙漏塊是其主要組成部分,可以進行堆疊串聯。每一個沙漏塊中包含數個連接通路,這些通路負責將沙漏兩端的特征融合。特征融合的方式是在沙漏塊兩端取出大小與通道完全相同的特征圖,再將它們按位對應相加。這些連接通路所連接的是相對稱的特征圖,所以傳統沙漏網絡在本文也叫作對稱沙漏網絡。這種常規的對稱融合方式實現簡單且順應直覺,但是卻需要使用大量的計算資源,并且會產生不同尺度特征互相干擾的問題,這使沙漏網絡成為強力但臃腫的主干網絡。本文所提出的非對稱沙漏網絡使用了殘差網絡中的殘差跳級結構,解除了對稱沙漏網絡對應連接的限制并減小了整個網絡的體量,加快網絡速度的同時保證了網絡的精度。

圖3 三種不同的主干網絡Fig.3 Three different backbone networks

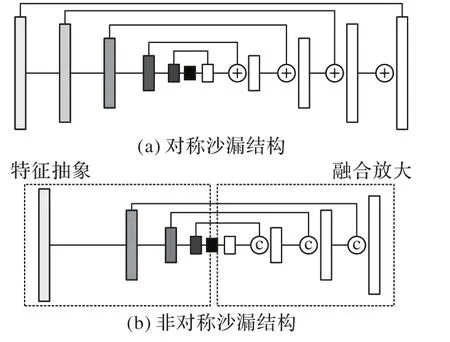

2.1.1 非對稱沙漏結構

在深度學習的領域中,各種不同結構的神經網絡實際上都在做特征抽取的工作,而決定網絡性能的主要因素就是特征的好壞。一般來說,網絡越深,其抽取的特征就越抽象,而抽象特征的表達能力更強,對于分類和檢測任務更有幫助。根據前文的介紹,對稱沙漏網絡受制于自身融合方式的限制,一般使用維度相同的特征進行融合。

如圖4 所示,本文的非對稱沙漏結構沿用了沙漏網絡的基本結構形式,即先將特征圖抽象縮小以增強表達能力,再融合放大以得到物體更精確的坐標信息。通過分析沙漏網絡的結構,本文研究發現它的大部分計算資源消耗來自于疊加定義的沙漏塊與對稱結構設計。為了設計非對稱沙漏結構,本文做了如下工作:首先,相較于原始沙漏網絡多個沙漏塊疊加的設計,本文只使用了一個沙漏塊作為主干網絡,如圖4 所示。其次,為了提高網絡的運行速度,本文方法在網絡前半部分(特征抽象部分)使用了更加輕量化的主干網絡,同時縮小了網絡后半部分(融合放大部分)的尺寸,并且在兩部分之間也相應地減少了連接通路。為了彌補大量減少參數的代價,本文算法選擇融合語義性更強的后層特征來接入上采樣步驟,防止淺層的細節信息破壞后層的抽象特征。這是非對稱結構的第一個特點,特征圖在融合時分辨率是不相同的。

圖4 不同主干網絡對比Fig.4 Comparison of different backbone networks

原始沙漏網絡的融合通過式(1)來實現,m與n分別是融合前的特征層,n+1 為融合后生成的特征圖。式(2)是非對稱沙漏網絡的融合方式。

其中:“up”代表上采樣操作;“+”代表對應位直接相加;“⊕”為通道拼接(concatenate)操作。可以看出,原始融合方式直接在與m相對稱的n層上操作,而本文算法選擇后續的n+1層,即更抽象特征進行融合。

在神經網絡所提取的特征中,不同的通道一般代表不同的信息,比如:有些通道對橫向線條敏感,有些通道對縱向線條敏感,還有些通道對環形比較敏感。沙漏網絡中融合操作是式(1)中的按位相加操作,而相加操作要求對應特征的通道嚴格相同,并且會破壞通道原本的信息。相比之下,式(2)中的拼接無疑是更加科學的融合方法,它不僅沒有通道的限制,也不是簡單的算術操作,每個通道權重大小的取舍均交給卷積核自身學習。這是非對稱結構的第二個特點,不同層的特征在融合時通道數是不相同的。

2.1.2 整體網絡結構細節

本文算法受Darknet53 網絡結構的啟發搭建了非對稱沙漏網絡的主干部分(Backbone)。該主干網絡的基本單元為卷積層、批量歸一化層[26]與leaky relu 函數激活層,其具體流程如下:首先輸入長寬為h×w大小的圖片,經過多個殘差塊結構提取特征,并且穿插步長為2 的卷積進行下采樣操作,同時將通道數加倍,最終得到原圖1/32 大小的特征圖。本文沒有使用常見的池化,轉而使用步長為2 的卷積來進行下采樣操作,這是因為簡單的池化會丟失大量特征信息,而這些信息對于非對稱沙漏結構來說是有用的。在考慮了參數量與特征抽象程度之后,本文最終選取主干網絡中下采樣倍率分別為1/8、1/16 時的特征圖(即圖中C1、C2 的特征圖),并將其輸入到非對稱沙漏網絡的后半部分(特征強化結構)進行上采樣與融合操作。最后,得到輸出熱力圖并將其解碼為最終類別與框坐標等結果。

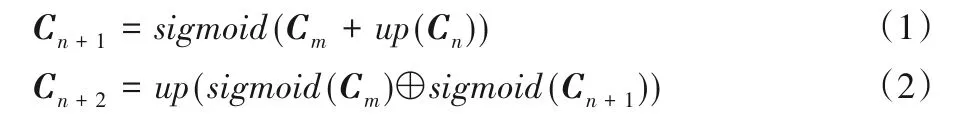

特征強化模塊(Feature Boost)包括兩部分:非對稱融合與檢測頭部。如圖5 所示,非對稱融合部分使用非對稱結構將C1 特征圖與C2 按照2.1.1 節中介紹的方法拼接到一起。實驗結果顯示,雖然本文算法使用非對稱結構提取到了更加抽象的特征,但是這些特征對于檢測極小物體來說分辨率依然較低,直接在該特征上進行目標預測并不能得到充分的效果。為了更好地適配這些特征,本文算法在檢測頭部將特征圖又進行了一次上采樣操作,即使用步長為2 的轉置卷積與可形變卷積(Deformable Convolutional Network,DCN)[27-28],提高特征圖分辨率的同時加強網絡對不同形狀物體的表達能力。最后,在原圖1/4大小的特征圖上得到最終檢測結果。具體細節如圖6所示(以輸入圖片512×512計算)。

圖5 特征強化模塊的非對稱融合部分Fig.5 Asymmetric fusion part of feature boost module

2.2 多尺度特征預測

目標尺度間互相干擾的問題是基于深度學習目標檢測領域的一大挑戰。對于同一張圖片中的同一類別物體來說,大尺寸與小尺寸的目標所呈現的特征在神經網絡看來可能完全不同。檢測圖片不同尺度特征的思想最初是由He 等[29]在空間金字塔池化網絡(Spatial Pyramid Pooling Net,SPPNet)中所提出,通過池化金字塔將特征的每一層都做一次池化操作,這種方法變相地起到了多尺度訓練的作用。將多尺度特征發揚光大的是Lin等[30]提出的FPN網絡。FPN通過其自底向上、自頂向下以及橫向鏈接將不同尺度的特征圖高效地結合起來。它在沒有大量增加網絡參數的情況下大幅提高檢測精度,已經成為大部分現代目標檢測器的常用配置。

圖6 檢測頭部結構Fig.6 Structure of detection head

大多數無錨框目標檢測框架因為其主干網絡選擇的局限并沒有加入多尺度設計,它們只在單一尺度上進行結果的預測。這種做法存在下面兩個問題:首先,單一通路會使網絡中不同尺度的目標互相干擾。其次,由于缺少了Anchor 的限制,每個中心點以及長寬值都要靠一組任意大小的數字來進行回歸。過大的回歸范圍會使模型產生的預測框對于極端目標來說不太準確。本文新建多尺度通路的方法相當于提前分離了大目標的特征,既防止它影響后續的小目標識別,也使其不被小目標特征所影響。這種方法還隱式地限制了預測框的大小,讓不同通路負責預測不同尺度的目標,使極端目標的預測更加準確。

如圖7所示,本文算法從2.1.2節中介紹的特征強化模塊中引出兩個分支。這兩個分支位于主干網絡上融合之后的C1 和C2 通路,再將它們分別送入檢測頭部得到最終熱力圖。當運行到C1、C2 處時,網絡會將當前已經識別出的大中目標送入其對應的檢測頭部,使后續的識別不會受到干擾。相較以前的單分支輸出來說,網絡的每個分支預測與自身相適應大小的目標,讓同一個分支中物體長寬分布在相近范圍內,這種操作使長寬值的回歸更加合理。目標的分配如圖7 所示,最大的特征圖被分配小目標,最小的特征圖被分配大目標。

對于三個不同尺度通路來說,不同的真實框分配也需要合理分配,具體細節在實驗結果分析中討論。

圖7 多尺度結構與目標框的分配Fig.7 Multi-scale structure and object box allocation

2.3 精細化檢測結果

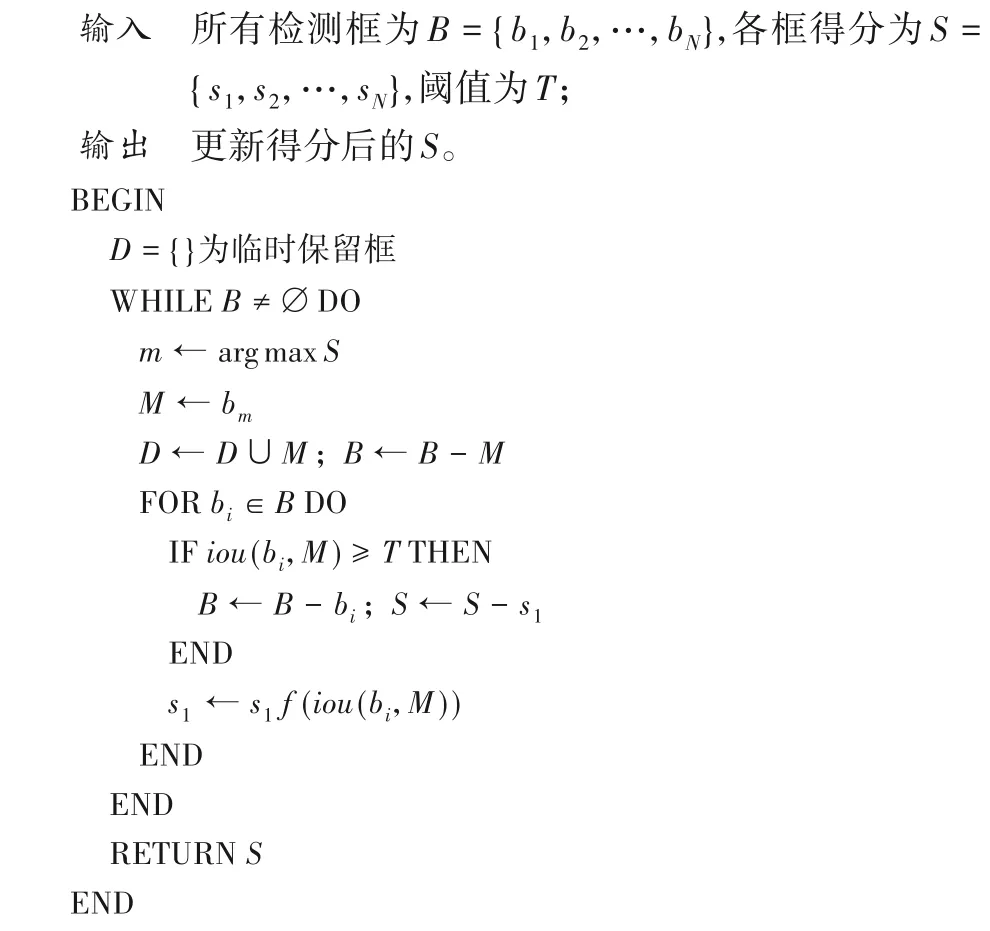

非極大值抑制(NMS)[31]是一種去除非極大值的算法,常用于計算機視覺中的邊緣檢測、目標檢測等任務。無錨框目標檢測雖然沒有顯式地使用這一通用后處理方法,但它在生成熱力圖時也有隱式的類NMS 方法:在最終熱力圖上的每類通道取有效點時只取當前點比周圍8 個點的置信度都高的點,這種操作相當于在生成候選框之前就已經去除了冗余的目標。在2.2 節中多尺度通路預測的基礎上,本文方法為了解決同一個目標有可能同時出現在相鄰尺度的預測圖上的問題,在不同尺度生成的結果框之間使用了改進的非極大值抑制算法。原始的非極大值抑制算法存在將相距非常近的兩個同類別目標框中的一個強行刪除的不足,而改進后的算法不會將其強行刪除,僅僅只會降低它的置信度。偽代碼如算法1所示。

算法1 改進后的非極大值抑制算法。

其中函數f采用高斯加權方法,如下所示:

總的來說,多尺度通路在訓練時真實框的分配互有少量重疊。所以為了將相鄰尺度上的相同框抑制,三個尺度上的預測框需要合并后一起執行NMS 操作。這可以進一步提高檢測的精度,具體數值將在實驗結果分析中討論。

3 網絡訓練

本文使用的數據集為VOC 與COCO(Common Objects in COntext)兩種,默認使用翻轉、裁剪、對比度變換等通用的數據增強方法。訓練平臺為Pytorch,在Ubuntu 系統上使用1~2塊GTX-2080TI 顯卡進行訓練。長寬與偏移采用L1 損失函數,類別使用均方差損失函數,采用Adam 優化器,其他超參數的設置與CenterNet中相同。

3.1 數據集介紹

PASCAL VOC[32]是圖像識別和分類方向的一整套標準化優秀的數據集,從2005年到2012年每年都會舉行一場圖像識別競賽。該競賽主要包括三類任務:分類(classification)、檢測(detection)和分割(segmentation)。在檢測挑戰中,這是一個監督學習的問題,訓練集以帶標簽的圖片的形式給出。PASCAL VOC 2007 和2012 數據集一共有20 類,本文使用07+12 訓練方法:在VOC2007 與VOC2012 的train 和val 集(共16 551張)上訓練100個epoch,學習率初始為0.012 5,分別在第60 個和第90 個epoch 將學習率下降為原來的1/10。使用VOC 2007的test(4 952張)進行測試。

MS COCO(Microsoft COCO)起源于微軟于2014 年出資標注的Microsoft COCO 數據集[33],與ImageNet 競賽一樣,被視為計算機視覺領域最受關注和最權威的比賽之一。COCO 數據集是一個大型的、豐富的物體檢測、分割和字幕數據集。這個數據集中的檢測任務包括80 類目標,328 000 張圖片和2 500 000 個label,其中物體的數目超過150 萬個。在ImageNet 競賽停辦后,COCO 競賽也就成為當前目標識別、檢測等領域的一個最權威、最重要的標桿,也是目前該領域在國際上唯一能匯集Google、微軟、Facebook,以及國內外眾多頂尖院校和優秀創新企業共同參與的大賽。本文方法在COCO 2017 的train(110×103)上進行訓練,在minival(5×103)上進行測試。初始學習率設置為0.012 5,訓練120 個epoch,學習率在第60和110個epoch分別下降為原來的1/10。

3.2 制作GroundTruth

在本文的無錨框檢測方案中,標簽不是傳統目標檢測中bbox 的四個值與類別這五元組的形式,而是將目標的中心點使用高斯分布繪制在與輸出熱力圖同樣大小的矩陣中。以本文的方法為例,設真實框左上角點為(x1,y1)、下角點為(x2,y2)。對于某一類C,它的中心點為:

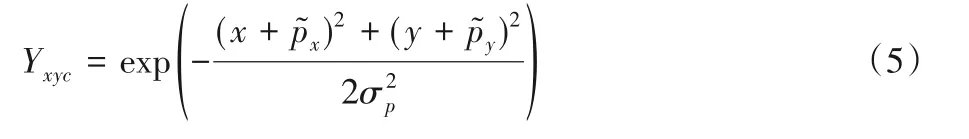

然后利用k∈[0,1]來填入新特征圖中的類別C的通道上,所用方法為一個高斯核的分布的形式:

注意每個類別C單獨使用一個通道,如果同類別中的高斯分布產生了重疊,則取最大值。其中px與py分別是中心p的橫縱坐標,σp是一個與物體長寬相關的標準差。

對于2.2 節中的多尺度特征預測來說,不同尺度的特征圖需要與不同大小的真實框對應,其大小對應如下:

其中:wo、ho分別為輸出特征圖的寬和高;wi、hi為輸入特征圖的寬和高;d為不同層的下采樣倍率,需要設定后調整。對于具體數據來說,具體的操作可能不同。在小尺度中,本文僅僅添加小尺度的真實目標,即(0,1002)像素;在中尺度中,采用(502,2002)適應的目標;最后的大尺度負責最大的部分真實目標(1502,+∞)。

3.3 損失函數

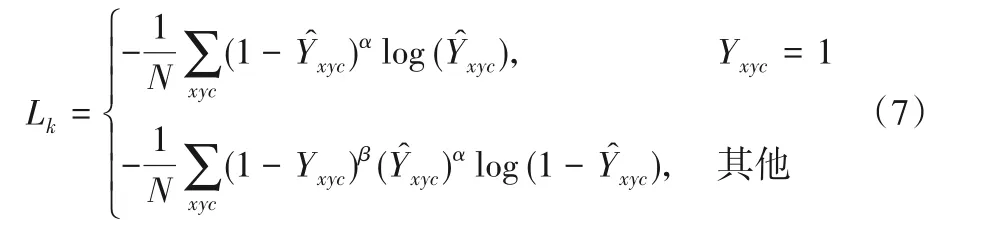

中心點類別預測損失函數使用的是式(7)所示Focal Loss[34]的改版:

其中,α和β都是損失函數Focal Loss 的超參數,均用來平衡正負樣本的重要性,在實驗中本文方法與基準線(Baseline)設置為相同值,分別是2和4。

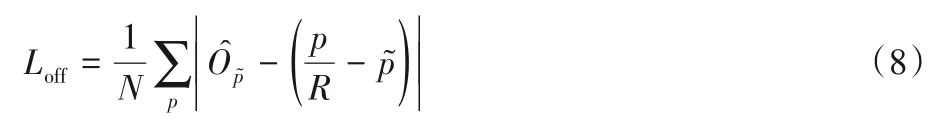

所有類C的中心點共享一個偏置的預測,中心點的偏置損失如下,采用L1 loss形式:

其中:p和分別為真實中心點與預測中心點;R為原圖下采樣倍數,在本文中分別為4、8和16;為預測中心偏置值。

目標長寬損失與偏置損失一樣,采用L1 loss 直接對長寬的原始像素值進行回歸。

長寬損失所得的損失值相較類別與偏置過大,最后將3類損失值相加時給予其較低的權重以平衡最后的總損失值。

4 實驗與結果分析

本文在各表中給出VOC 數據集平均準確度(mean Average Precision,mAP)結果,COCO 數據集mAP,AP50(IOU在50%以上的AP 值),AP75(IOU 在75%以上的AP 值),還有APs(Average Precision small)、APm(Average Precision medium)、APl(Average Precision large),分別為小目標、中目標、大目標的AP值,以及運行速度(幀率)等實驗結果。

4.1 感知尺度訓練方法

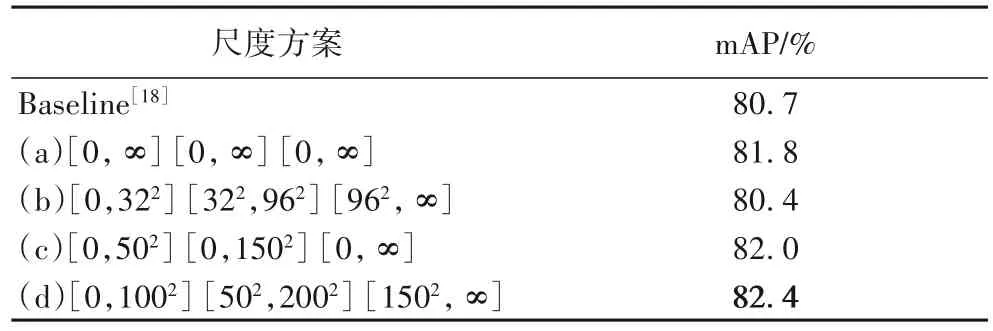

本文在VOC 數據集中嘗試了多尺度檢測下不同的真實框分配方案,分別是:1)三個尺度均訓練所有真實框;2)按照COCO 對大中小物體標準劃分;3)向下兼容式劃分;4)按照不同數據集自身比例重疊劃分。如表2 所示,本文對比了這幾種劃分方式下的準確率,其中達到最好效果的是4)重疊劃分尺度范圍的方法,其原因是各分支不能單獨只學習當前大小范圍的目標,其他目標也有一般性的抽象特征,但是也不能完全學習所有大小的目標特征,這會使網絡區分不出其中的區別,所以折中的方案具有較好的效果。

表2 不同目標尺度方案的對比Tab.2 Comparison of different object scale schemes

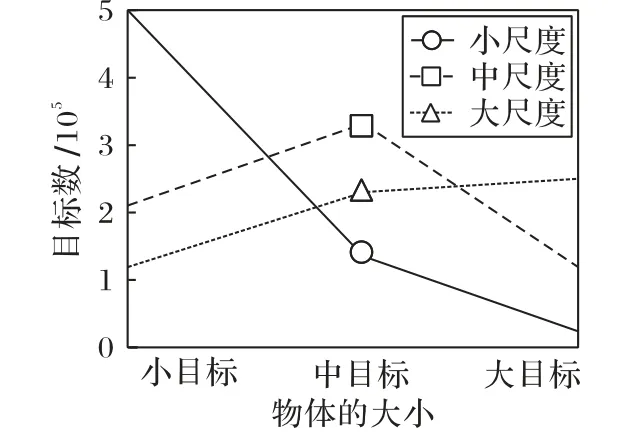

本文還在測試集上統計了各個尺度分別負責的目標數量,結果如圖8 所示。可以看到,小尺度分支主要檢測的是小目標,中尺度和大尺度也與所檢測目標基本相符,這與本文不同分支負責各自尺度目標的想法相一致。

圖8 各個尺度檢測出的目標分布Fig.8 Object distribution detected at different scales

4.2 消融實驗

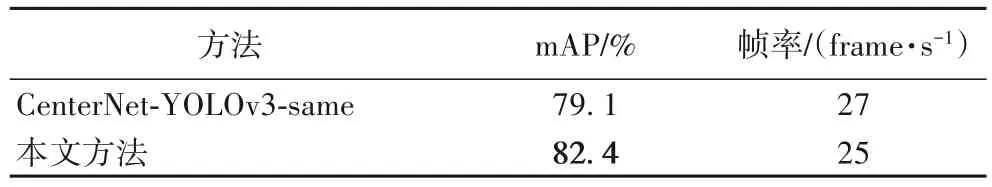

為了驗證本文方法在相同條件下仍然具有優勢,表3 給出了采用與YOLOv3同輸出尺度情況下的實驗結果,即3個輸出分別為8、16、32 倍下采樣時在VOC 數據集上的詳細結果。本文方法的最終輸出為4、8、16倍下采樣的結果。表3結果表明本文方法增大了最終特征圖大小并保持最大特征圖與中心點網絡相同的操作是有作用的。

表3 所提方法與YOLOv3對比Tab.3 Comparison of proposed method with YOLOv3

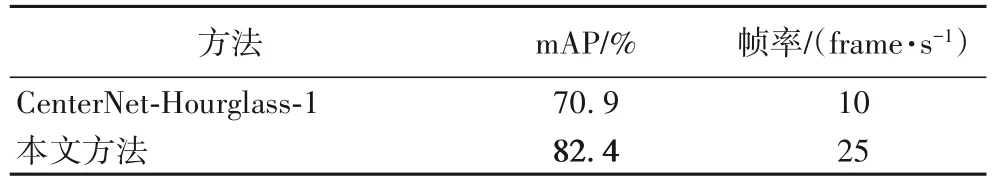

表4 給出了所提方法與原始沙漏網絡的結果對比。表4結果表明了本文的非對稱沙漏網絡的性能優于原始的沙漏網絡。本文實驗將CenterNet 原文中的沙漏網絡改為與本文方法相似的單階形態,在VOC 數據集上驗證其結果。這表明即使沙漏網絡在速度較快的單階設置下,依然與本文方法存在差距,驗證了本文方法在速度與精度平衡上的效果。

表4 所提方法與原始沙漏網絡對比Tab.4 Comparison of proposed method with original hourglass network

4.3 各部分模塊貢獻度

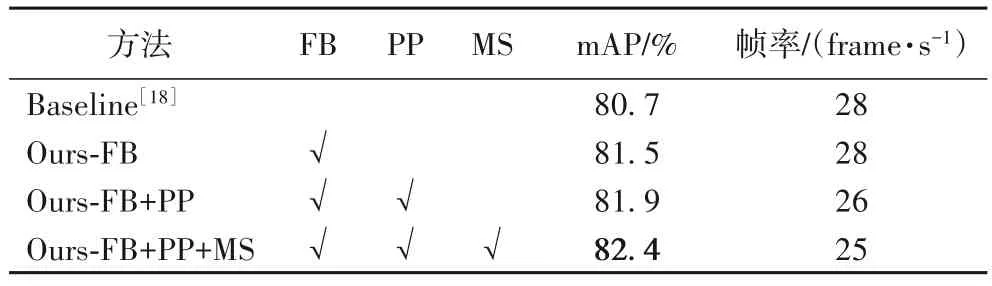

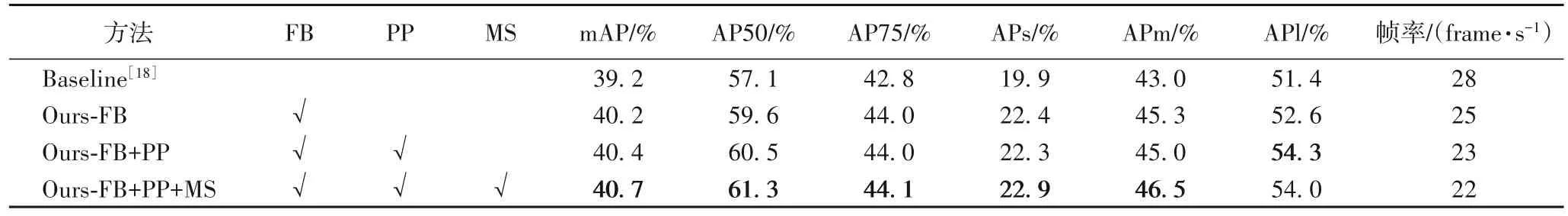

表5 詳細列出了無錨框檢測Baseline 與本文方法在PASCAL VOC 數據集上的性能與速度對比。幀率值取在當前平臺(Xeno-E5+GTX-2080Ti)上的數據。可以看到,在保持速度基本不變的情況下,本文所提出的非對稱沙漏模塊(FB)、更精細后處理(PP)、多尺度感知(MS)三個部分均是有效的,其中非對稱沙漏部分為主要貢獻。各結果均不同程度超越原始方法。

表5 VOC數據集上各部分貢獻度對比Tab.5 Comparison of contribution of different parts on VOC dataset

表6 為VOC 數據集上不同方法的性能,本文方法不僅在速度方面大幅提升,而且總體精確度相較CenterNet-DLA提高了1.7個百分點。

表6 VOC數據集上不同方法的性能Tab.6 Performance of different methods on VOC dataset

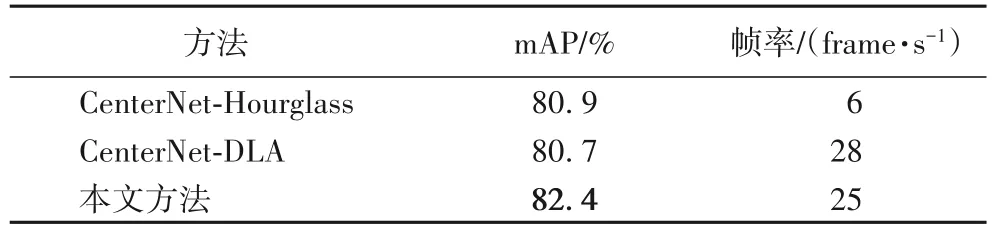

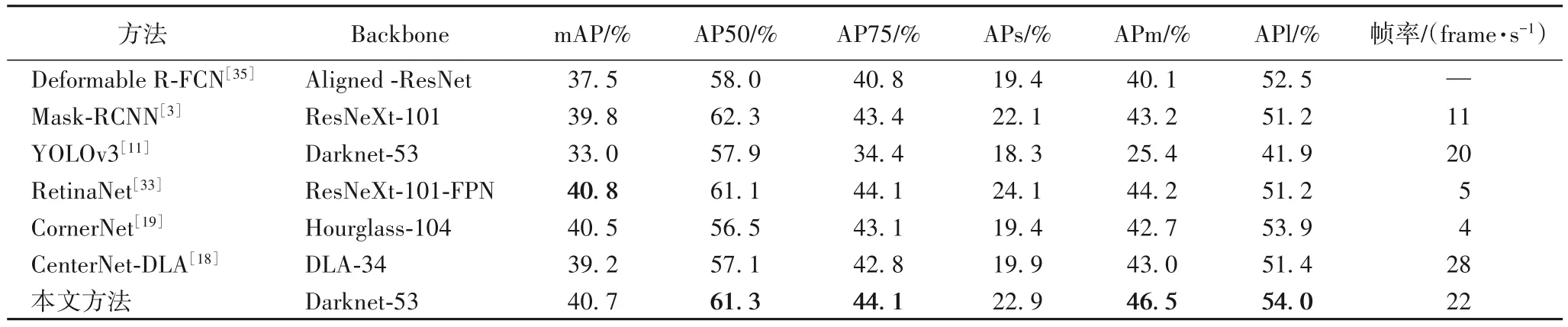

表7給出了在COCO數據集中各詳細的實驗數據。其中,mAP 是關注的主要指標,代表從AP50 到AP95 每隔5 所取的AP 值的平均數。AP50 與AP75 代表預測框與真實框的IOU在50%與75%以上的AP 值。APs、APm、APl分別代表物體尺寸比322小、在322與962之間、比962大這三種不同區間的AP值。可以看到,本文方法在幾乎沒有犧牲大量速度的情況下將mAP 提高了1.5 個百分點,同時將AP50 提高了4.2 個百分點,使實時的單階段檢測器AP50 值邁入60%大關,這對于實際工程應用來說無疑是一個好消息。

表8 給出了與當前主流方法對比的結果,其中幀率已經等比例歸一化到相同硬件環境。值得注意的是,在與RetinaNet 的對比中,本文研究對準確率的主要貢獻集中在大中目標上。這也與本文將大中目標解耦到其他分支使其不被干擾的思想相符合,這種分離操作大大提高了對應目標的準確率。總的來說,可以看出本文的方法在相似速度的單階段檢測器中達到了較優的結果。

表7 COCO數據集上各部分貢獻度對比Tab.7 Comparison of contribution of different parts on COCO dataset

表8 COCO數據集上所提方法與當前主流方法的對比Tab.8 Comparison of proposed method with existing mainstream methods

5 結語

本文在常規無錨框單階段目標檢測器的基礎上,提出了非對稱沙漏模塊以增強主干網絡所提取特征的表達能力,使用尺度感知的多尺度訓練方式將不同大小的目標解耦在不同的特征層,最后使用改進的非極大值抑制融合三個尺度的檢測結果。在目標檢測最常用的兩個數據集VOC與COCO上的實驗結果顯示,相較無錨框檢測Baseline,本文方法將mAP 提高了1.5 個百分點,特別是在對工業實時檢測最看重的AP50結果上提高了4.2 個百分點,驗證了本文方法的有效性。但是由于不同大小目標分布的多樣性以及融合方法的限制,本文方法的結果仍有提高的空間,可以考慮在尺度感知模塊中針對不同尺度專門設計與尺度相適應的卷積核等網絡結構,以及在特征強化過程中選用更加適合的特征融合方式等方法。未來將會在以上兩個方面進行更深入的探索。