微表情識別研究綜述

張 人,何 寧

1.北京聯合大學 北京市信息服務工程重點實驗室,北京100101

2.北京聯合大學 智慧城市學院,北京100101

面部表情作為人表現情感的主要方式之一,在過去的幾十年里,關于各種表情識別的研究已經取得重要的進展[1-6]。這幾年,關于自發式的表情(spontaneous expression)的識別成為了新的研究熱點[7-8],而微表情往往是在人想壓抑自己感情時產生的,這既無法偽造也無法抑制[9]。完整的面部表情通常持續0.5~4 s[10],比較容易被人識別。然而,心理學認為,當一個人試圖隱藏自己真實情感時,偶爾會有情感泄露出來。微表情首次發現于1966年[11]。三年后,Ekman等人[12]在分析一段試圖自殺的病人的采訪視頻時使用了微表情這個詞。微表情通常在1/25~1/2 s[13]之間不受控制地變化,并且出現頻率較低,未經過訓練的個體對其識別能力并不高[14]。而不同的研究者報告的結果也存在著較大的差異[15-16]。在這之后,Ekman和Friesen于1979年提出了短暫表情識別測驗(Brief Affect Recognition Test,BART)[17]。在后續的實驗中他們發現了被試者的微表情識別能力與謊言識別能力成正相關[18]。之后,進行了日本人與高加索人短暫表情識別測驗(Japanese and Caucasian Brief Affect Recognition Test,JACBART)[19-20],該實驗也驗證了被試者的微表情識別能力與謊言識別能力成正相關[21],可以證明微表情能有效的幫助人們識別謊言。

人臉的微表情識別涉及圖像處理和分析、計算機視覺、人工智能、心理學、生物學等方向。Ekman等人[15]在2002 年開發出微表情識別的工具——METT(Micro Expression Training Tool)。研究表明,METT工具平均可以提高個體對于微表情識別能力的30%~40%。此外,還設計了面部動作編碼系統(Facial Action Coding System,FACS)[22],根據人臉的解剖學特點,將其劃分成若干既相互獨立又相互聯系的運動單元(Action Unit,AU),并分析了這些運動單元的運動特征及其所控制的主要區域以及與之相關的表情,并給出了大量的照片說明。盡管人類的情緒復雜多樣,但仍可分成6個基本情緒類別[23-24],因此研究人員將不同的運動單元組合編碼形成FACS碼來對應不同的表情,主要分為開心、憤怒、恐懼、悲傷、驚訝和其他。當人們在表達內心狀態和心理需求時,就會產生大量面部表情[25],但由于微表情存在的時間過短,不容易被人眼所察覺,因此可使用計算機來解決這個問題。

1 微表情識別相關技術

微表情是人面部微小的動作變化,其中包括紋理變化。微表情的動作太過微小且持續時間短,不容易被人眼所捕捉,因此可以借助機器視覺的方法對面部的微表情進行研究。根據以上的特點,微表情識別的幾種主流的方法有,卷積神經網絡(Convolutional Neural Networks,CNN)[26]、光流(Optical Flow)法、以及局部二值模式(Local Binary Pattern,LBP)[27]。

1.1 卷積神經網絡

卷積神經網絡(Convolutional Neural Networks,CNN)[26]自誕生以來在機器視覺、語音識別等各個領域廣泛應用。通常CNN被用作對圖像類輸入的特征提取和深度特征提取,在對提取的特征進行分析后可以得到所需的輸出結果。微表情的特點是面部運動比較微小,若使用卷積神經網絡通常需要使用其他輔助方法更改網絡的輸入,或更改優化網絡結構,使網絡能提取到更有用的特征,從而提高對微表情識別的準確率。

1.2 光流法

光流(Optical Flow)是空間運動物體在觀察成像平面上的像素運動的瞬時速度。光流法有幾個假設條件:首先要亮度恒定,一個像素點隨著時間的變化,其亮度值(像素灰度值)是恒定不變的。其次是小幅度運動,時間的變化不會引起位置的劇烈變化。這樣才能利用相鄰幀之間的位置變化引起的灰度值變化進行光流特征提取。光流法是利用圖像序列中像素在時間域上的變化以及相鄰幀之間的相關性來找到上一幀跟當前幀之間存在的對應關系,從而計算出相鄰幀之間物體的運動信息的一種方法。微表情具有面部動作較為微小,不易察覺的特點,因此光流法作為檢測微小運動的常用方法,對微表情的面部動作識別有很大優勢。在檢測到面部微表情的運動信息后,配合其他方法可對微表情進行有效的識別。

1.3 局部二值模式及其改進方法

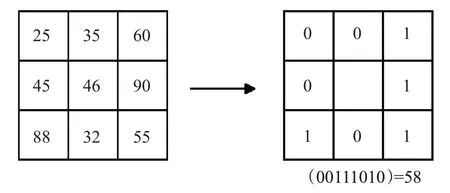

局部二值模式(Local Binary Pattern,LBP)[27]可以有效地處理光照變化,在紋理分析、紋理識別等方面被廣泛應用,具有灰度不變性和旋轉不變性等顯著優點。中心像素的LBP值反映了該像素周圍區域的紋理信息,如圖1所示。由于該特征具有簡單易算性,因此得到了廣泛的使用。

圖1 LBP算法描述

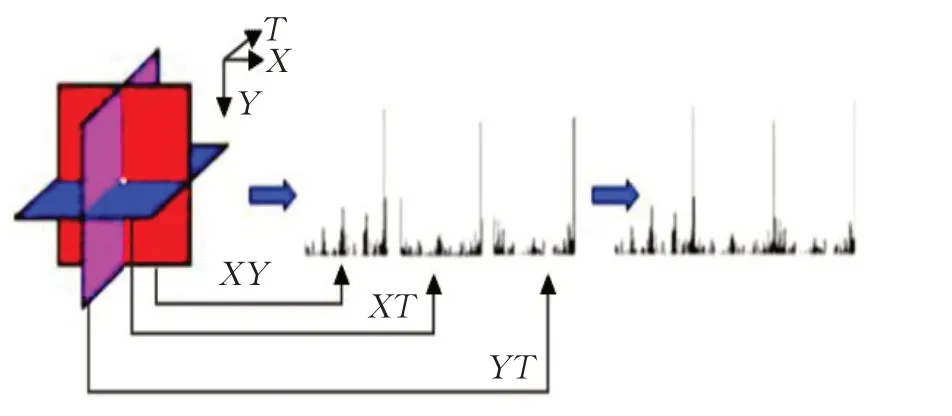

對于視頻圖像來說,傳統的LBP算法無法應用于視頻信號,因此,需要對LBP 算法進行一些改進。其中Zhao 等[28]提出了一種魯棒的動態紋理描述子,對3 個正交平面進行局部二進制模式(Local Binary Patterns from Three Orthogonal Planes,LBP-TOP),已廣泛應用于面部表情。為了同時考慮視頻的空間和時間信息,LBP-TOP擴展了LBP。相比LBP,此方法考慮了3種類型的平面(XY、XT、YT)而不是一個平面(空間XY)。給定一個視頻序列,可以將其分別看作沿時間T軸、空間Y軸和空間X軸的XY、XT和YT平面的堆棧。分別從三種類型的平面導出3個直方圖,并連接成一個直方圖作為動態視頻紋理描述符,如圖2所示[28]。

圖2 LBP-TOP特征提取

LBP-TOP 將LBP 算法的應用擴展到更高維度,可識別時序上的面部紋理,通過此方法關聯前后幀之間的信息,使LBP 算法應用的更加廣泛。LBP-TOP 包含LBP的性質,如在像素值集體增大或減小相同數值時對LBP-TOP 沒有影響,對于自然平行光的環境對圖像產生的干擾可以忽略,因此這種方法應用到現實生活中的時候魯棒性較高。但這種方法是基于像素的,因此會增加提取特征的維度。 LBP最初的應用是中心點像素與半徑為R的鄰域的P個像素點進行對比,所產生的維度是2P,因此R為1時中心像素點和鄰域8個像素點所產生的維度是28=256。而在隨后的發展中,鄰域半徑R的不再是1,維度也呈指數增長,為了解決這一問題,Ojala等[27]提出了采用一種“等價模式”(Uniform Pattern)來對LBP 算子的模式種類進行降維。Ojala 等認為,在實際圖像中,絕大多數LBP模式最多只包含兩次從1到0或從0到1的跳變。因此,將“等價模式”定義為:當某個LBP 所對應的循環二進制數從0 到1 或從1 到0 最多有兩次跳變時,該LBP所對應的二進制就稱為一個等價模式類。這種方法使原始的256種減少為58種,即它把值分為59 類,58 個uniform pattern 為一類,其他的所有值為第59類。因此,這種方法將維度由原來的2P變為P(P-1)+2,直方圖從原來的256維變成59維。這使得特征向量的維數更少,并且可以減少高頻噪聲帶來的影響。而LBP-TOP 是LBP 在時間維度的應用,因此維度為3×59,而在計算時,通常會將一幅圖像分為4×4 的blocks,每個block都會生成一個59×3的數組,最后生成的特征的維數是4×4×59×3=2 832,由此可見,LBP-TOP是一種高維特征,這對計算速度有著嚴重的影響,并且影響準確率。

2 微表情識別方法

2.1 基于CNN對微表情識別的方法

CNN 是在處理圖像信號時常用的方法,但由于微表情變化較為微小,僅使用CNN效果并不是很好,因此一些文獻選擇對輸入的圖像進行處理。傳統的微表情特征提取既需要考慮空間上的圖像特征,也需要考慮時間上的時序序列,一般都會對微表情從開始到結束的所有幀進行特征提取,而Liong 等[29]提出了微表情階段分類器。首先利用時間信息將微表情分為起始、高峰、偏移三個階段,之后利用空間信息檢測強度變化。對比傳統的微表情特征提取方法,此方法僅用一段微表情的峰值(Apex)幀與初始(Onset)幀提取特征,增加了有效幀的數量,減少了計算量,并且效果超過了其他傳統方法。除此之外,劉汝涵等[30]提出一種基于眼部干擾消除的視頻放大方法,并利用卷積神經網絡實現微表情識別任務。首先將數據放大,提取其中的眼部位置坐標。之后將使用原始眼部視頻替換到放大視頻中進行圖像融合,以實現對眼部干擾的消除。最后使用VGG16 的思想設計卷積神經網絡模型網絡,實現對情緒的識別。文中所應用的局部放大技術在減少噪聲干擾后可以將微表情動作放大,使肉眼都可看出運動的趨勢,可增加CNN網絡對微表情識別的準確率。這兩種方法從不同的角度對輸入的圖像進行處理,使CNN 網絡能夠更好的提取特征,提高識別的準確率。

而另一些文獻則選擇改變網絡結構,從而提高網絡對微表情識別的準確率。Peng 等[31]提出雙時間尺度卷積神經網絡(Dual Temporal Scale Convolutional Neural Network,DTSCNN)。DTSCNN 是一個雙流網絡,采用不同的DTSCNN流來適應不同幀速率的微表情視頻片段。他們將Slow Fusion 模型和C3D 工具結合在一起以進行微表情識別。DTSCNN是由DTSCNN64和DTSCNN128組成的兩流卷積網絡。在這個網絡中每一個流都由獨立的淺層網絡組成,可以有效避免過擬合問題。網絡的不同流的設計可以適應不同的幀速率,這可以使整個網絡對輸入數據的幀速率具有魯棒性。而賴振意等[32]提出了結合空洞卷積對微表情進行識別。結合空洞卷積核及人臉自動校正算法,完善CNN 網絡特征提取過程,通過自動人臉矯正適應實際應用中的實時識別分類。文中空洞卷積的優勢在于彌補了池化過程當中丟失信息的缺陷,可以提升網絡精度。目前微表情識別的網絡結構多為維卷積神經網絡,而梁正友等[33]提出了一種用于微表情識別的三維卷積神經網絡進化(Three-Dimensional Convolutional Neural Network Evolution,C3DEvol)的方法。這種方法能有效提取微表情在時間域和空間域上的特征,其采用的全局搜索和優化能力的遺傳算法對C3D的網絡結構進行優化,獲取最好的C3D 網絡結構和避免局部優化。以上方法在對網絡結構進行更改優化后,可提高網絡對微表情識別的準確率。

目前基于CNN對微表情特征提取大多都與光流方法提取相結合,這也是CNN 框架的優點之一。但若使用CNN 進行深度學習,對于目前的數據集來說仍然無法實現,在現存的幾個數據集中所擁有的數據量無法滿足深度學習網絡的需求,容易造成過擬合,這導致CNN的巨大優勢無法發揮。

2.2 基于光流法對微表情識別的方法

光流可檢測微小的動作變化,Li等[34]提出了一種基于深度多任務學習的微表情檢測方法,研究了一種深度多任務學習方法來進行面部地標定位,并將面部區域分割成感興趣區域(ROIS)。面部肌肉的運動會產生微表情,因此,將穩健的光流方法與HOOF(Histograms of Oriented Optical Flow)[35]特征相結合來評估面部肌肉的運動方向。最后,采用支持向量機(SVM)作為微表情檢測的分類器。FACS 作為識別微表情的重要工具,需要眉毛、嘴角等各個面部位置的運動記錄。這種方法將ROIS 與HOOF 特征共同使用,所得出的結果與AU所對應,可對微表情較為精確的做出識別。

對于微表情檢測往往是獨立的,而Shreve等[36]提出了一種由宏、微表情組成的長視頻人臉表情自動識別(時間分割)方法。該方法利用表情過程中非剛性運動對面部皮膚產生的應力,用中心差分法計算每個受試者面部幾個區域(下巴、嘴、臉頰、前額)觀測到的強而密的光流場的應變量級。這種方法能夠成功地檢測和區分宏表情和快速局部的微表情,對運用在復雜場景下的微表情檢測提供了巨大的幫助。

現有的識別方法在處理細微的面部位移方面往往是無效的,因為被觀察的個體會不斷移動。為了解決這一問題,Xu 等[37]提出了一種新的面部動力學映射方法來描述微表情在不同粒度下的運動。這種算法解決了在識別目標移動的情況下如何對微表情進行識別,這對之后微表情識別的應用有著很大的作用。

隨著科技的發展和社會的需要,對于微表情識別應用于社會生活中的需求也越發迫切。光流法提取的特征主要為幾何特征,因此特征維度并不算高,可以作為實時微表情檢測的重要方法。其本身對于亮度較為敏感,當亮度變化較大時,此方法就會失效,但在復雜場景中這種現象無法避免,對于光流法來說,除了提高微表情識別準確度,還要增強其泛化能力,使其能更好的應用于社會生活中。

2.3 基于局部二值模式改進方法對微表情識別的方法

LBP-TOP算法對X、Y、T三平面進行特征提取,之后引用LBP算法進行紋理分析,因此可以對視頻進行識別。但LBP-TOP 存在兩個關鍵問題,會導致微表情分析的性能下降。首先,它通常從兩個像素之間基于符號的差異中提取外觀和運動特征,但沒有考慮其他有用的信息。此外,LBP-TOP通常使用經典模式類型,但在某些應用中,這些模式類型對于局部結構可能不是最優的。因此,Huang 等[38]提出了一種用于面部微表情分析的時空完整局部量化模式(STCLQP)。首先,STCLQP提取包含符號、幅度和方向分量的3 個興趣信息。其次,在外觀域和時間域對每個分量進行有效的矢量量化和碼本選擇,以學習用于推廣經典模式類型的緊湊和有區別的碼本。最后,基于區分碼本,提取并融合符號、幅度和方向分量的時空特征,基于特征子空間將3個分量的特征連接成一個特征。STCLQP 根據LBP-TOP 所存在的問題,增加了幅度和方向分量等信息,提取了更多有用的信息,并且最終能將提取的信息融合成一個特征向量,提高了對于圖像特征的利用率。相對比LBPTOP,STCLQP 方法提取了更多的信息,因此會造成更高的維度。而文中使用了LQP[39]技術,對比隨著鄰域半徑R 增大,維度呈指數型增加的LBP,LQP 采用將提取后的特征映射到查找表,當R增大時,維度不再呈現指數型增長。因此這種方法對R數值需要增加時較為適用,也因為LQP技術,緩和了一些之前提取更多維度信息所導致的高維特征。而Wang等[40]則提出了一種基于中心點上三條相交線的六交點局部二值模式(LBP-SIP)描述子,將高斯多分辨率金字塔合并到提出的方法中,并把所有金字塔層次上的模式串聯起來。LBP-SIP 減少了LBP-TOP 模式中的冗余,提供了更緊湊和輕量級的表示,并且提高了準確性,降低了計算復雜度。與LBP-TOP不同,此方法僅采用了t時刻某一像素點的上下左右4 個像素點和t-1 與t+1 時刻同位置的6 個像素點,因其所提取的特征少,所以當圖像較多、時間較長時較為適用,且運算較LBP-TOP 更快。其速度是LBPTOP 的2.8 倍[40]。此方法提取特征用時15.88 s,比LBPTOP方法約快2.4 s,識別時間為0.208 s,比LBP-TOP方法快0.3 s。相比LBP-TOP方法,LBP-SIP減少了可觀的時間,但對于之后實際的應用,這個時間仍然太過漫長,無法做到實時檢測。但提供了一種思路減少處理的時間。除此之外,盧官明等[41]提出了一種對LBP-TOP 提取的特征進行降維,之后使用SVM 進行分類的方法。這種方法首先采用LBP-TOP 算子來提取微表情特征,然后提出一種基于ReliefF 與局部線性嵌入(Locally Linear Embedding,LLE)流形學習算法相結合的特征選擇算法,可有效地降低提取后的特征維度。最后使用徑向基函數(Radial Basis Function,RBF)核的SVM 分類器進行分類,得到了較好的結果。這種方法是基于LBP-TOP 方法進行特征向量提取,因此所適用的環境與LBP-TOP一致。分別用過濾式(Filter)的方法排除無關的特征,之后用封裝式(Wrapper)的方法篩選出影響較大的特征,避免了維度災難,計算量也相應減少,這種方法給予未來發展方向一種啟示,對于LBP-TOP 這種逐像素進行特征提取的方法,可以對提取后的特征進行篩選,提高分類時識別的精確度。

對于LBP-TOP 冗余的特征,以上幾種方法分別采用了不同的思路進行降維,但對于實際應用到現實生活中還遠遠不夠,逐像素提取特征的方法容易造成維度災難,因此在識別之前對于特征和特征提取方式的選取尤為重要。只有當處理速度減少,才有機會將這類方法應用于社會生活當中。

3 微表情識別方法性能分析與比較

3.1 基于CNN的微表情識別方法分析比較

使用CNN 進行微表情識別時,需要關注的是表情變化的狀態,其中Kim等[42]提出了一種與微表情階段分類器[29]的想法較為相似的方法,這種方法將微表情階段分類器和LSTM相結合。首先利用卷積神經網絡(CNN)對微表情在不同表情狀態(起始、起始到頂點、頂點、頂點到偏移和偏移)下的空間特征進行編碼。在目標函數中考慮表達狀態,提高學習特征表示的表達類可分性。然后,將學習到的具有表情狀態約束的空間特征轉化為學習微表情的時間特征。時間特征學習利用長-短期記憶(LSTM)遞歸神經網絡對微表情不同狀態的時間特征進行編碼。

除此之外,Khor等[43]提出了一種豐富的長期遞歸卷積網絡(Enriched Long-term Recurrent Convolutional Network,ELRCN),該網絡首先通過CNN模塊將每個微表情幀編碼成一個特征向量,然后通過將特征向量通過長短期記憶模塊(LSTM)進行預測。長短期記憶模塊對于視頻檢測有較好的優勢,利用門控制可以保留較長時間前的信息,結合之前對于面部信息的檢測,可以更好地檢測出表情變化。

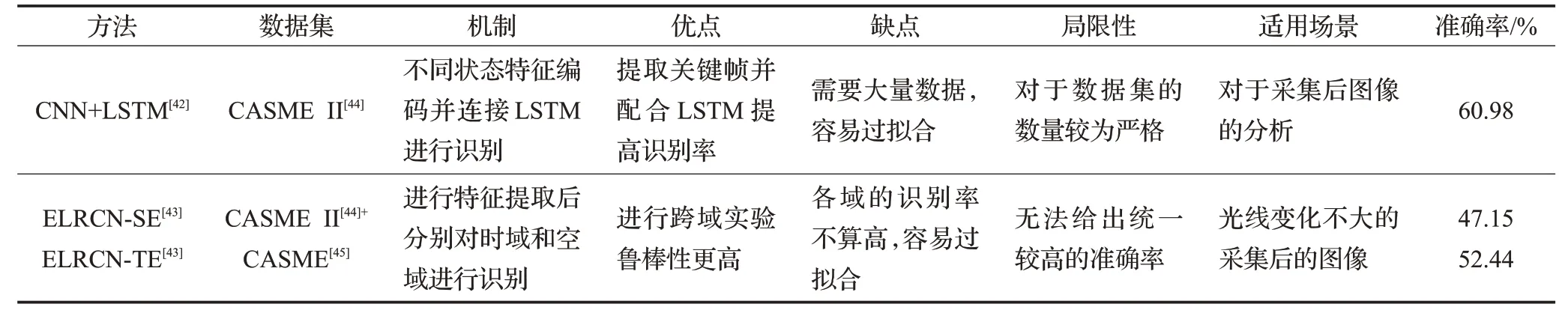

這兩種方法都想到利用LTSM 網絡。實驗結果證明,將LSTM網絡和卷積神經網絡結合對視頻類的微表情識別有較好的效果,如表1所示[44-45]。

表1 CNN方法性能比較

表2 局部二值模式改進方法性能比較

3.2 基于光流法的微表情識別方法分析比較

光流法配合ROI方法可以對應FACS系統檢測出表情的動作變化,因此Li等[34]提出了一種與基于深度多任務學習的微表情檢測方法相似的算法,這種新的微表情自動識別算法結合了用于檢測面部標志點的多任務卷積網絡和用于估計微表情光流特征的融合深卷積網絡[46]。首先,利用深度多任務卷積網路來偵測具有多重相關作業的人臉地標,并利用這些地標來分割人臉區域。之后,利用融合卷積網絡從包含肌肉變化的面部區域提取微表情時的光流特征。最后利用增強光流對特征信息進行細化,并利用支持向量機分類器(SVM)對細化后的光流特征進行分類識別。基于深度多任務學習的微表情檢測方法[34]使用光流法和HOOF[35]特征結合來評估面部肌肉變化,HOOF 是一種基于光流的特征,該特征表示每個時刻的動作輪廓,并且與運動的尺度和方向無關。HOOF 將視頻中每一幀的光流與橫軸夾角進行分檔,并且根據其大小進行加權,每一檔就是一個bin,bin的數量是可選參數,HOOF對光流方向進行加權統計,得到光流方向信息直方圖。與基于深度多任務學習的微表情檢測方法[34]不同的是,檢測面部標志點的多任務卷積網絡和用于估計微表情光流特征的融合深卷積網絡[46]在之前的檢測方法的基礎上進行改進,由于HOOF[35]中不同bin 內的特征缺少主方向光流的比例信息,于是添加了比例P作為Bmax區域內的特征,其中Bmax是bin內最大數量的光流特征。這種方法中的光流矢量最大幅度和方向代表每個區域中肌肉變化的主要部分,并且比例P補償了變化強度的信息。

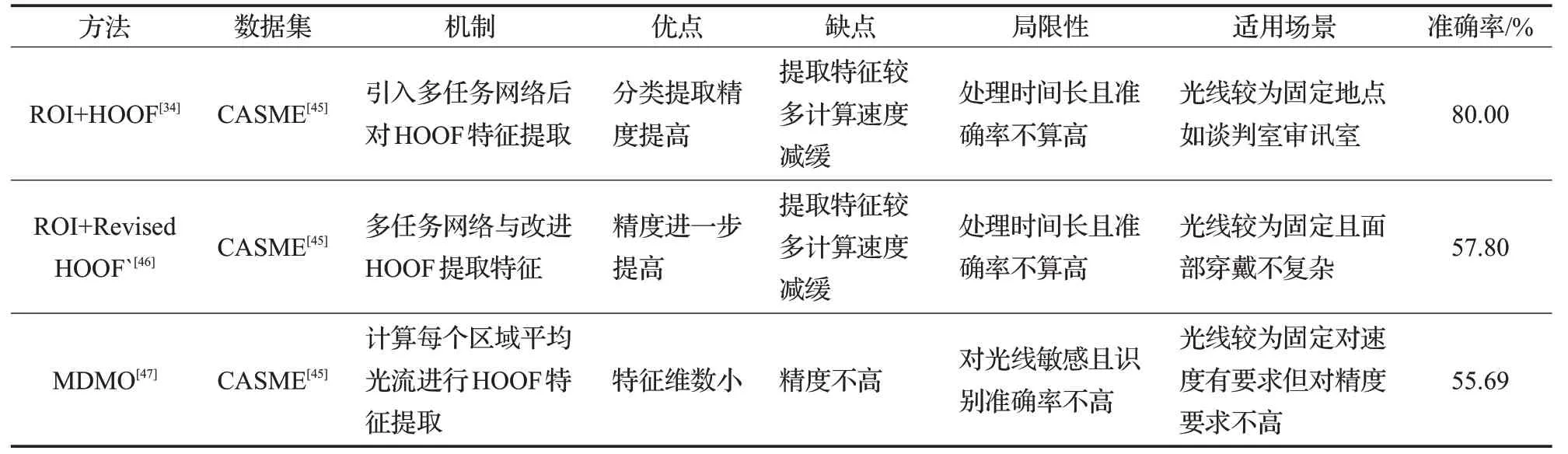

Liu 等[47]提出了一種簡單有效的主方向平均光流(MDMO)特征用于微表情識別,將穩健的光流方法應用于微表情視頻片段,并基于部分動作單元將面部區域劃分為感興趣區域(ROI)。MDMO 是一種基于ROI 的歸一化統計特征,它同時考慮了局部統計運動信息和空間位置。此外,為了減少由頭部運動引起的噪聲影響,還提出了一種光流驅動的方法來對齊微表情視頻剪輯的所有幀。最后,采用具有MDMO 特征的支持向量機分類器進行微表情識別。MDMO的一個顯著特點是其特征維數小。總的來說以上幾種方法采取的策略基本一致,需要從先將面部劃分感興趣區域(ROI),之后使用光流的方法分辨面部為小動作,最后使用支持向量機對所得到的特征進行分類。將面部分成不同區域,更容易使用FACS 系統,讓機器使用FACS 進行對微表情進行判別,而光流則負責檢測每一個區域內的微小動作變化,對于每部分的變化對應一個動作單元,不同運動單元的變化即可判別出表情的變化。對HOOF 進行修改可以使準確率相應提高,見表2(ROI+HOOF[34]方法使用留一法(Leave-One-Subject-Out,LOSO)對數據集進行準確率測試,因此準確率會較高)。但光流法對于環境的要求較為苛刻,需要在此基礎上進行修改才可以應用到數據庫之外部分。

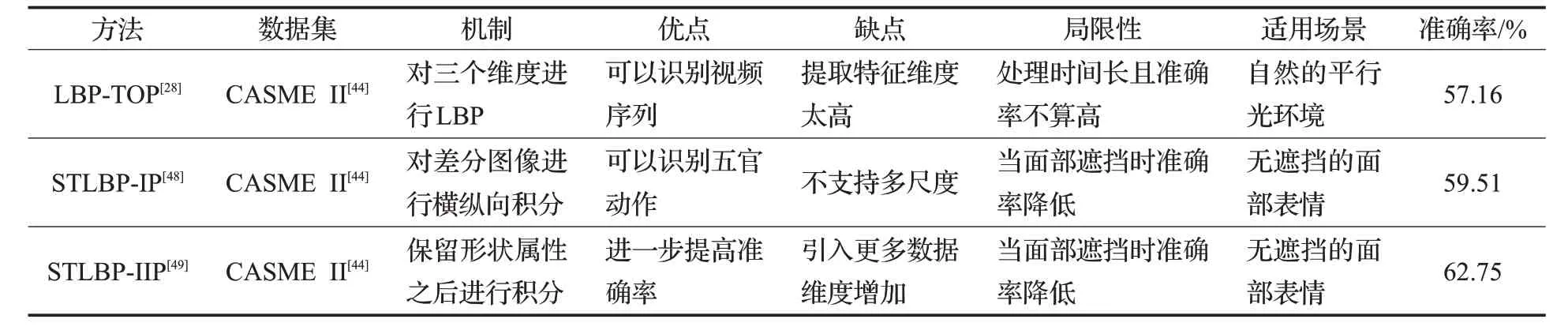

3.3 基于改進局部二值模式的微表情識別方法分析比較

面部圖像積分圖(integral projection)可以對面部不同部位進行識別,是圖像識別的常用技術,由Huang 等人[48]提出的一種新的基于時空表情的微表情分析框架。首先,采用基于差分圖像的積分投影方法獲得水平和垂直投影,既保留了人臉圖像的形狀屬性,又提高了對微表情的識別率,并證明原始的積分投影(STLBPOIP)不能保留微表情的判別信息。有必要對積分投影法進行改進,以獲得微表情的類信息。因此提出了一種新的基于積分投影的時空局部二值模式,即帶積分投影的時空局部二值模式(STLBP-IP)[48]。此外,還利用局部二值模式算子來提取水平和垂直投影的外觀和運動特征。非常適合于提取微表情紋理。

而Huang 等[48]則指出常用的時空局部二值化模式考慮了動態紋理信息來表示人臉圖像,而忽略了人臉圖像的形狀屬性。另一方面,從全局人臉區域提取時空特征,忽略了兩個微表情類之間的區別信息。上述問題嚴重限制了時空局部二值模式在微表情識別中的應用,因此Huang等[49]在STLBP-IP的基礎上提出了一種基于改進的積分投影的判別性時空局部二值模式(STLBPIIP)。首先,提出了一種改進的積分投影法來保持微表情的形狀屬性,然后提高對微表情識別特征的識別能力。此外,改進的積分投影與跨時空的局部二值模式算子相結合。具體來說,將形狀屬性融入到時空紋理特征中,提取新的時空特征,其中還將STLBP-IIP 與LBPTOP 和STCLQP[38]進行了比較。研究發現,STLBP-IIP在識別驚訝類和緊張類方面表現較好,而在識別厭惡類和壓抑類方面表現不如STCLQP。最后為了提高微表情的識別率,提出了一種基于拉普拉斯方法的特征選擇方法,在拉普拉斯方法的基礎上,研究了STLBP-IIP 的判別群特征,進一步提高了STLBP-IIP 的判別能力,如表2所示。

3.4 CNN、光流法和局部二值模式改進方法對微表情識別的分析比較

3.4.1 局部二值模式改進方法與光流法對微表情識別的分析比較

局部二值模式可以根據某像素點的數值與周圍的數值進行對比,從而進行編碼。這類方法是基于表觀特征(appearance based)的方法,也就是基于像素值的方法。優點是損失的信息量較少,以此為代價的是它的特征維度通常較高。

光流法有較好的識別物體運動趨勢的能力,根據某些特征點或特征區域的位移作為結果。這類方法是基于幾何特征(geometric based)的方法,不考慮像素點而轉為考慮特征區域的位移。因此,所得出的結果通常是維度較小的物體運動趨勢。

兩種方法各有優劣,在對微表情的識別中都有著不錯的效果。如之前提到的MDMO[46]方法進行特征提取,使用LBP-TOP[28]方法對視頻進行3個維度的局部二值模式從而提取特征的方法,使用留一法(LOSO)對微表情進行識別都取得了不錯的成果,見表1、表2。

3.4.2 CNN 與光流法、局部二值模式改進方法對微表情識別的分析比較

CNN 是一種優秀的對圖像問題進行處理的方法,但對于不同的問題需要對網絡結構進行調整。使用CNN 通常要先進行特征提取,在提取特征后再進行進一步處理。而無論是光流法還是局部二值模式改進方法,都是使用不同的方法對特征進行提取。而對特征圖可以使用CNN繼續提取深層特征,因此CNN與光流法和局部二值模式改進方法的使用本身并不沖突。

對于視頻類型的文件,通常在使用CNN 時可以選擇與循環神經網絡的一種流行形式,稱為長短期記憶(Long Short-Term Memory,LSTM)[50]模塊搭配使用,LSTM 對于視頻類型的輸入有較好的效果。比起單獨使用CNN,將CNN 作為一種框架更為合適,CNN 可以和各種方法相結合,使改進的網絡識別的效果更好。如Khor 等[43]在使用CNN+LSTM 方法的同時,在輸入端使用TV-L1[51]方法提取光流圖像與原始圖像疊加作為輸入,之后將提取后的特征送入LSTM 網絡,進行微表情識別。而文獻[52]則使用ROI方法后,配合FlowNet 2.0光流法進行特定區域的光流識別,最終使ROI+Revised HOOF[46]配合FACS識別出不同的表情。這兩種方法使用了不同的光流方法,但TVL1+LSTM方法[43]的主體是CNN,光流法只是作為與原始圖像共同的輸入,增加識別的準確率,見表2、表3。由此可見CNN 作為一個框架,包容性很強,可以與多種方法共同結合使用,是解決圖像問題的良好工具。

3.5 CNN、光流法和局部二值模式改進方法的適用場景分析

目前已存在的微表情識別方法都是基于數據集的識別方法,對于現實中的微表情識別泛化能力并不高,無法應用于現實環境,但可以根據已有方法的特點對所需環境和適用場景等進行預估。

就目前的發展來看,CNN 無疑是在使用的網絡中發展門類較多,且較為細化的一類網絡,因此現有對于多目標、多尺度、多任務等檢測的網絡已經較為成熟。若將現有多種網絡融合入微表情識別的檢測當中可以對復雜場景進行檢測,如商場、地段較為重要的街道、監獄等。現有的微表情識別方法在結合其他網絡后可以自動地對人群中行人進行多種特征檢測,保證精度提高。

表3 光流方法性能比較

基于光流法的灰度不變假設,光流法無法對亮度有變化的場景或物體進行檢測,對環境有著較為嚴格的要求,且攝像頭旋轉不能過快。因此可在審訊室、談判室等亮度相對固定且目標無需移動的區域進行微表情識別。微表情是目標以壓抑自己表情為前提的,但在面對特定場景時,目標可能會存在宏表情和微表情相結合的問題。而Shreve 等[36]提出的工作用光流法為這類問題提出了一個解決方案,讓微表情識別更適合審訊室、光流室等更為嚴格的場所。光流法相對其他方法的提取的特征維度較小,是目前最有可能用于實時檢測的方法,對于審訊室、談判室這種對目標表情分析速度需求較高的場景較為適合。

對于局部二值模式改進方法,如LBP-TOP 等逐像素分析的方法,環境整體的亮度變化對其影響并不大,因此可以作為光流法的互補,但其明顯的缺點是提取的特征維數太高,計算負擔較大,無法進行實時檢測,因此可以將其作為幕后的微表情校準和識別的工具。隨著目前的研究,對此類方法提取的特征維度減少到可實時后,可能需要對目標的面部特定部位進行提取,需要盡量減少目標的重點需檢測部位的遮擋,因此,將此類方法用于管理較為嚴格的看守所或者軍隊等對目標的行為以及穿搭進行嚴格管理的地區,可能較為適用。

4 結束語

4.1 評價

本文對微表情識別采用的主要方法:卷積神經網絡及其改進、光流法及其改進、局部二值模式及其改進進行了分析和介紹。關于卷積神經網絡本身的改進也可優化對于微表情信息的識別。在對圖像進行特征提取后,對網絡結構或輸入進行優化,卷積神經網絡對于微表情識別也可以發揮很好效果。

目前對微表情識別的方法中,光流法是一種主流的方法,其特性是檢測微小運動的目標,很適合用于微表情的檢測。但存在的問題也很明顯,要求被檢測目標的亮度恒定,而這點在實際應用中往往很難做到,因此需要對算法進行改進和優化。但不可否認的是,光流仍是一種很好的對面部微表情進行識別的方法。

LBP-TOP結合了3個平面,可以很好地對視頻進行識別。其中關于LBP-TOP的修改,減少了冗余的參數,能有效識別面部紋理特征,并提高識別準確度。LBP及其改進對紋理識別有很好的作用,因此將LBP的改進方法用于微表情識別是個好方法。

4.2 展望

微表情識別目前已經有了一定的發展,但技術方面仍有很大的進步空間,下面對微表情不同方法存在的問題進行分析和展望:

(1)卷積神經網絡作為處理圖像的傳統方法被廣泛應用,目前主流的思想還是配合光流法作為輸入,與LSTM相結合,可以達到較好的效果。但使用卷積神經網路進行深度學習存在著致命的問題,目前使用的數據集的樣本數量不高,對于卷積神經網絡來說,屬于小樣本問題,因此在計算時需要數據增強,或進行跨域實驗,同時可以提高魯棒性。在之后的過程中可嘗試使用遷移學習,可以一定程度緩和過擬合問題,除此之外還可以使用如對抗神經網絡等方法生成一些樣本再去訓練,可以一定緩和樣本數據量小的問題。

(2)光流法很適合識別微表情這種微小動作的行為,但光流對基于灰度不變假設,容易受外界光照的影響,并且在相機無法大尺度移動,轉動角度不能過快,這些都會導致提取的特征對識別造成影響,目前的微表情數據集內的數據都是滿足以上的要求。但對于自然場景來說,這點是不能保證的,因此在算法中需要對這點進行優化,保證在實際中的應用。使用光配合ROI方法對感興趣的區域進行識別是目前常用的方法,配合FACS 系統可以對表情進行識別,但對于臉部對齊等問題,在實踐中無法輕易達成,而注意力機制對于微表情識別來說也是一種方式達到ROI的效果,因此可以嘗試將注意力機制和光流法進行融合,使其魯棒性更高。

(3)局部二值模式作為經典的紋理分析算法,以算法簡單為特點被廣泛應用,LBP-TOP 將LBP 算法擴展到視頻。但目前逐像素提取特征所得到的特征太多,在浪費計算量的同時降低準確率。在圖像中面部區域的特征并不是全部都有用的,如在表情變化中與上一幀變化不明顯的圖像。針對這個問題,可以采取提取關鍵幀后進行特征提取的方法,提高識別率。而在STLBPIP[48]中采用圖像積分的方法可以對臉的五官進行區分,若關注其中重要部分的紋理變化,配合FACS 系統,可以對微表情進行有效的識別。根據FACS 系統,眼睛、嘴巴、鼻子等周圍會顯示出紋理的變化,因此其他位置的紋理變化檢測也可以適當精簡。除了以上幾種方法,在未來的改進過程中還可以對提取后的特征進行篩選。特征篩選的方法主要分3 種:過濾式(filter)、封裝式(wrapper)和嵌入式(embedded)。過濾式特征選擇方法對每個維度的特征賦予權重,然后依據權重將特征進行排序;封裝式特征選擇方法將子集選擇看作為一個優化問題,生成不同的組合,對組合進行評價,再與其他組合進行比較;嵌入式特征選擇方法則在模型既定的情況下挑選出那些對模型的訓練有重要意義的特征。這3種主流篩選方法分別針對不同的情況,過濾式特征選擇方法直接利用所有訓練樣本的統計性能來評價各個特征的重要性,與后續分類算法無關,并不保證選擇出的特征子集對分類性能是最優的,但其優勢在于可排除大量無關性能,通用性好,可用于特征的預篩選。封裝式特征選擇方法需要與后續分類算法結合,依據分類器的準確率評價每個特征的重要性,篩選出對于特定的分類算法最優的特征子集。嵌入式特征篩選方法類似過濾法,但它是通過機器學習訓練來確定特征的優劣,而不是直接從特征的統計學指標來確定特征的優劣。和包裝法相比,嵌入法也是用機器學習的方法來選擇特征,區別是不通過不停地篩掉特征來進行訓練,每次迭代使用的都是特征全集。嵌入式特征選擇方法是將特征選擇過程與學習器訓練過程融為一體,兩者在同一個優化過程中完成,即在學習器訓練過程中自動完成了特征選擇。3 種方法各有優劣,因此可以相互結合使用。利用好預處理方法并針對分類器方法的各自的優點,篩選出最優的特征子集,從而提高對微表情識別的準確率。

4.3 結論

對于微表情識別還有一些方法,這里就不一一列舉,總的來說是根據面部的紋理以及微小的動作變化對提取特征的方法進行調整。微表情的應用范圍很廣泛,如婚姻關系預測[53]、交流談判[54]、教學評估[55-56]等,尤其對于國家安保工作[57],通過分析人的微表情可以發現他的真實意圖,及時制止危險分子的不法行為,對于犯人是否說謊、是否有暴力行為等都可以有很好的預測,從而保護國家長治久安。