基于聯(lián)合特征和遷移學(xué)習(xí)的跨域圖像分類方法

孟欠欠,伏明蘭,沈龍鳳,李夢(mèng)雯

(淮北師范大學(xué) 計(jì)算機(jī)科學(xué)與技術(shù)學(xué)院,安徽 淮北 235000)

圖像領(lǐng)域中,基于稀疏編碼的特征表示方法仍被廣泛應(yīng)用,Sha L等[1]人將稀疏編碼與拉普拉斯正則化相結(jié)合,用于圖像復(fù)原;錢沖等[2]人提出圖拉普拉斯正則化稀疏變換的圖像去噪學(xué)習(xí)方法;劉明等[3]人提出核稀疏編碼方法,用于陣發(fā)性房顫?rùn)z測(cè);Zhang H等[4]提出低秩分解與卷積稀疏編碼相結(jié)合的圖像分解算法。以上編碼學(xué)習(xí)方法常需要足量的源域(帶標(biāo)記)樣本,源域(帶標(biāo)記)與目標(biāo)域(無標(biāo)記)樣本服從同一特征分布,訓(xùn)練的分類模型可取得較好效果。但是在實(shí)際應(yīng)用中,各種因素的存在往往導(dǎo)致源域與目標(biāo)域樣本處于不同分布中,諸如分辨率、表情、動(dòng)作等差異均會(huì)造成特征的分布發(fā)生改變。此外,從互聯(lián)網(wǎng)下載的用于訓(xùn)練的圖像與來自真實(shí)場(chǎng)景中不同光照或角度的圖像之間的分布也不同。這種情況通常要求對(duì)源域數(shù)據(jù)重新標(biāo)注,會(huì)耗費(fèi)大量資源,如何有效充分利用這些不同分布的源域數(shù)據(jù),是當(dāng)前階段亟需考慮的重要問題,許多專業(yè)學(xué)者也提出了解決方案:遷移學(xué)習(xí)[5-7]。

遷移學(xué)習(xí)的核心是找到源域與目標(biāo)域的相似性,而通過MMD計(jì)算源域與目標(biāo)域之間的距離常作為評(píng)價(jià)相似性的重要指標(biāo)。Zhang J等[8]人在低維空間中進(jìn)一步減少源域與目標(biāo)域的幾何移位與分布移位。姚明海等[9]人提出一種多層校正的無監(jiān)督領(lǐng)域自適應(yīng)方法,采用多層權(quán)值最大均值差異適應(yīng)目標(biāo)域。Wang J等[10]人在邊緣分布差異的基礎(chǔ)上進(jìn)一步結(jié)合兩域的條件分布。Li S等[11]人綜合考慮類內(nèi)距離與類間距離,降低兩域的分布差異。趙鵬等[12]人提出基于聯(lián)合特征分布和實(shí)例的遷移學(xué)習(xí)方法,引入權(quán)值調(diào)節(jié)系數(shù)權(quán)衡兩者的重要度。Han N等[13]人提出利用低秩重構(gòu)的方法減少源域與目標(biāo)域的分布差異。Chen D等[14]人提出雙圖正則化判別轉(zhuǎn)移稀疏編碼算法,將域內(nèi)與域間相似性構(gòu)造對(duì)偶圖來度量不同數(shù)據(jù)集的距離。李萍等[15]人提出聯(lián)合類間及域間分布適配的遷移學(xué)習(xí)方法,進(jìn)一步最大化源域的類內(nèi)分布距離。

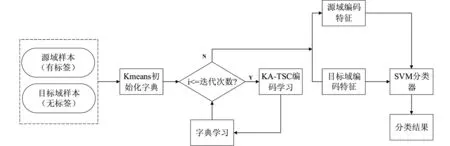

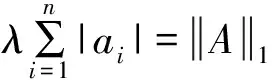

根據(jù)上述情況,發(fā)現(xiàn)基于編碼的遷移學(xué)習(xí)方法存在以下兩個(gè)問題:(1)隨機(jī)初始化字典,學(xué)習(xí)的初始基向量隨機(jī)性強(qiáng),不利于后序字典學(xué)習(xí);(2)在子空間中單一考慮了域間的邊緣分布,忽略了域間的條件分布和源域的類間分布。基于此種情況,本文首先提出基于聯(lián)合特征和遷移學(xué)習(xí)的跨域圖像分類方法,利用Kmeans初始化字典,學(xué)習(xí)更具代表性的字典基;其次使用MMD度量分布距離,進(jìn)一步考慮邊緣分布、條件分布和類間分布,并在通用的遷移數(shù)據(jù)集上進(jìn)行相關(guān)跨域?qū)嶒?yàn)驗(yàn)證所提方法的有效性和可行性。其算法流程圖如圖1所示。

圖1 KA-TSC算法流程

1 問題定義與符號(hào)說明

P(Xs)≠P(Xt),Q(Ys|Xs)≠Q(mào)(Yt|Xt)

(1)

使用MMD經(jīng)驗(yàn)估計(jì)度量任意兩個(gè)樣本集Xs,Xt對(duì)應(yīng)的不同分布Ps,Pt之間的距離,如式(2)所示。

(2)

其中ns,nt分別為Xs,Xt的樣本數(shù),Xsi,Xtj分別為Xs,Xt中的樣本,φ(·)為映射函數(shù)。

2 KA-TSC方法

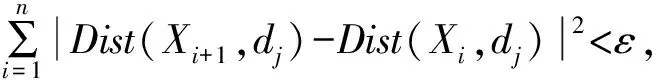

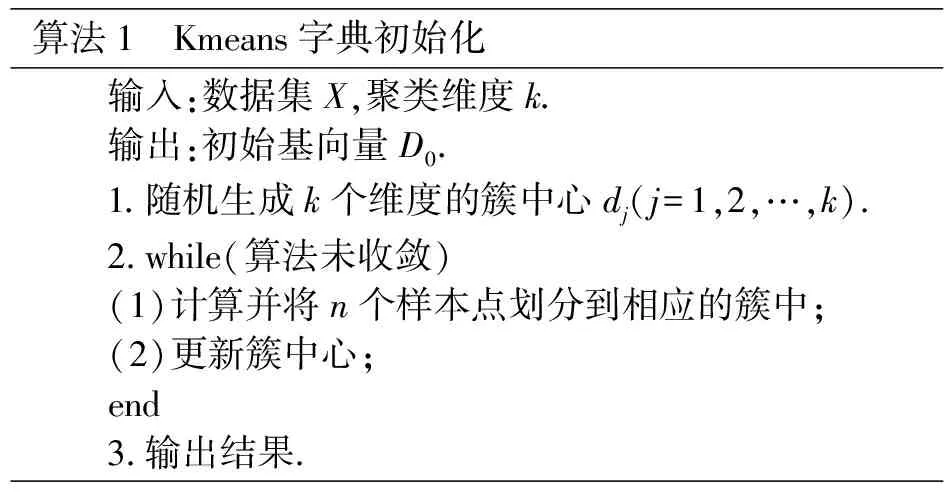

2.1 Kmeans字典優(yōu)化

圖題與表題的寫作要求為學(xué)習(xí)更具代表性的字典基,采用Kmeans聚類方法初始化字典,主要學(xué)習(xí)目標(biāo)是將給定的數(shù)據(jù)集X劃分為k個(gè)簇,并給出每個(gè)樣本數(shù)據(jù)對(duì)應(yīng)的中心點(diǎn),且收斂速度快。其算法步驟如下:

(4)重復(fù)執(zhí)行(2)—(3),直到簇中心不在發(fā)生變化;

算法偽代碼如表1所示。

表1 Kmeans字典初始化算法

2.2 類間及域間差異項(xiàng)

遷移學(xué)習(xí)的關(guān)鍵是盡可能縮小源域與目標(biāo)域的分布差異,其中數(shù)據(jù)域的邊緣分布體現(xiàn)了目標(biāo)域的聚類情況,而領(lǐng)域的條件分布體現(xiàn)了帶標(biāo)記數(shù)據(jù)的判別結(jié)構(gòu),源域中不同類別樣本間分布體現(xiàn)了帶標(biāo)記樣本的差異性。文中用MMD度量源域與目標(biāo)域的分布距離,旨在減少域間的邊緣和條件分布差異,并優(yōu)化源域不同類別樣本分布差異。接下來將依次計(jì)算三種分布距離。

首先,計(jì)算源域與目標(biāo)域的邊緣分布,計(jì)算公式如式(3)所示。

(3)

(4)

其次,對(duì)于兩域的同類樣本條件分布,MMD距離計(jì)算公式如式(5)所示。

(5)

其中c=1,2,…,C,Mc是MMD矩陣,如式(6)所示。

(6)

最后,源域中不同類樣本間的MMD距離計(jì)算如式(7)所示。

(7)

(8)

mintr(AMfAT)=mintr(AM0AT)+

(9)

2.3 圖拉普拉斯正則項(xiàng)

(10)

2.4 目標(biāo)模型

綜合稀疏編碼項(xiàng)、域間和類間分布差異項(xiàng)、圖拉普拉斯正則項(xiàng)以及稀疏保持項(xiàng),建立數(shù)學(xué)模型如式(11)所示。

(11)

3 模型求解

由于模型(11)存在兩個(gè)自變量D和A,在求解的過程可以分為編碼學(xué)習(xí)與字典學(xué)習(xí)兩部分。因此,目標(biāo)函數(shù)可分解為兩個(gè)子函數(shù),并分別交替迭代尋優(yōu),最終使目標(biāo)函數(shù)收斂。

3.1 編碼優(yōu)化

為更新編碼系數(shù),需要固定字典D,如式(12)所示。

(12)

(13)

3.2 字典優(yōu)化

首先,利用Kmeans方法初始字典基向量;其次,為更新字典,需固定A,字典優(yōu)化模型如式(14)所示。

(14)

對(duì)于帶二次約束的最小平方凸優(yōu)化問題,可先將式(14)轉(zhuǎn)化為拉格朗日對(duì)偶(Lagrange dual)問題,如式(15)所示。

L(D,Λ)=Tr((X-DA)T(X-DA))+

(15)

L(D,Λ)=tr(XTX-2AXTD+

DAATDT+AΛAT-cΛ)

(16)

接下來對(duì)式(16)求導(dǎo),結(jié)果如式(17)所示。

(17)

求解結(jié)果如式(18)所示。

D=(XAT)(AAT+Λ)-1

(18)

將式(18)帶入式(16),在利用拉格朗日對(duì)偶,可求取Λ,在反帶入公式(18)求字典D。

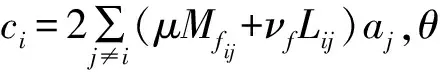

3.3 本文算法

KA-TSC偽代碼如表2所示。

表2 KA-TSC算法

4 實(shí)驗(yàn)及結(jié)果分析

4.1 數(shù)據(jù)集和評(píng)價(jià)標(biāo)準(zhǔn)

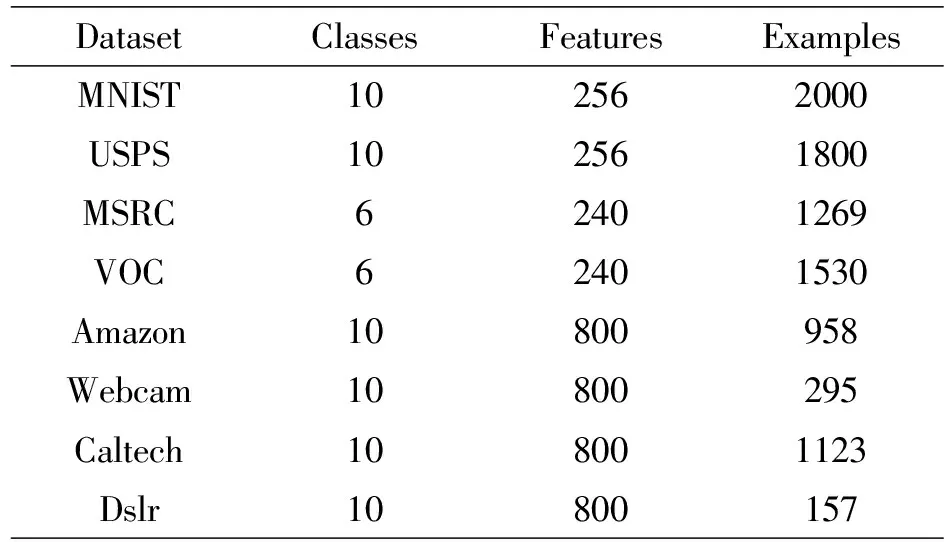

文中實(shí)驗(yàn)分別在字符數(shù)據(jù)集MNIST和USPS,人臉識(shí)別數(shù)據(jù)集PIE和對(duì)象識(shí)別數(shù)據(jù)集Office通用的遷移數(shù)據(jù)集上進(jìn)行。其中MNIST和USPS數(shù)據(jù)集各提取2000幅和1800幅字符圖像,兩者分別作為源域和目標(biāo)域,形成兩對(duì)遷移學(xué)習(xí)任務(wù)MNIST_vs_USPS和USPS_vs_MNIST,圖像大小為28×28,類別數(shù)為10。Office包含三個(gè)子數(shù)據(jù)集Amazon、Webcam和Dslr,將三個(gè)子集分別與Caltech數(shù)據(jù)集結(jié)合,從中隨機(jī)選取兩個(gè)分為作為源域和目標(biāo)域,形成六個(gè)不同的學(xué)習(xí)任務(wù),圖像大小32×32,類別數(shù)為10。共設(shè)計(jì)16組遷移學(xué)習(xí)任務(wù),每組任務(wù)屬于同一類別,但服從不同分布,所用數(shù)據(jù)集的統(tǒng)計(jì)信息如表3所示。

表3 實(shí)驗(yàn)數(shù)據(jù)集

本文通過對(duì)目標(biāo)域上的樣本計(jì)算平均分類準(zhǔn)確率(Accuracy)作為算法效果的評(píng)價(jià)標(biāo)準(zhǔn),公式如式(19)所示。

(19)

其中,Dt表示目標(biāo)域,f(x)為測(cè)試集x的真實(shí)標(biāo)簽,y(x)為測(cè)試集x的預(yù)測(cè)標(biāo)簽。

4.2 對(duì)比方法和參數(shù)設(shè)置

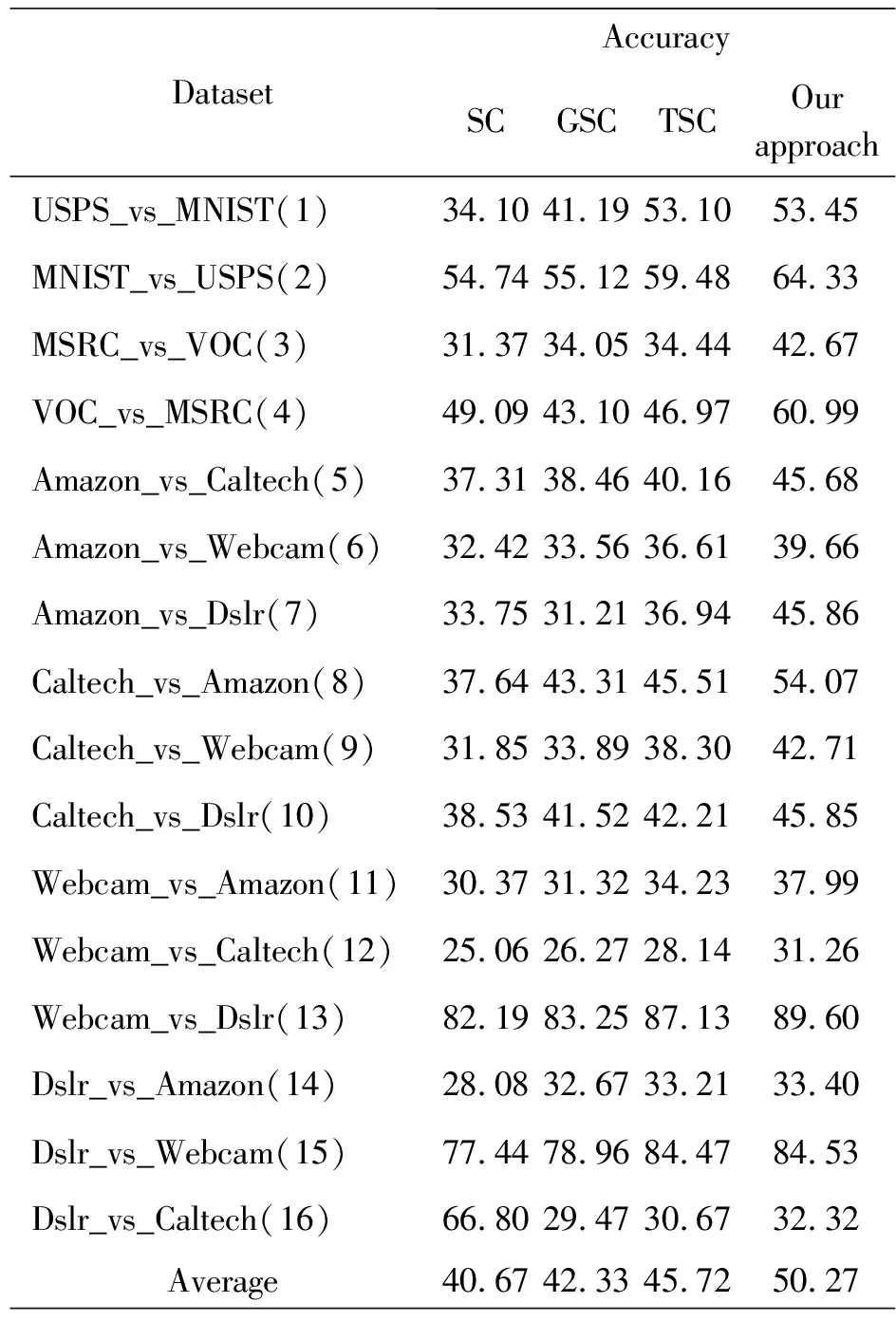

文中對(duì)比方法為稀疏編碼(SC)、圖正則化稀疏編碼(GSC)和遷移稀疏編碼(TSC)。各參數(shù)設(shè)置如下:稀疏編碼中k-128,λ=0.2;圖正則化稀疏編碼中k=128,γ=1,λ=0.1;遷移稀疏編碼中k=128,γ=1,λ=0.1,μ=1e5。所提方法參數(shù)設(shè)置如下:圖正則化參數(shù)設(shè)為1,權(quán)重調(diào)節(jié)因子β取0.1,聚類維度取128,迭代次數(shù)設(shè)置為10,對(duì)于MMD正則化參數(shù)和稀疏懲罰因子,在MNIST+USPS、Office+Caltech數(shù)據(jù)集上分別取1e5和0.01,在MSRC與VOC數(shù)據(jù)集上分別取1e6和0.1。實(shí)驗(yàn)結(jié)果如表4所示,為方便比較,對(duì)比直方圖如圖2所示。

表4 4種方法在16個(gè)跨領(lǐng)域分類任務(wù)上的性能對(duì)比

圖2 分類精度柱狀圖

從表4可以看出,相比SC、GSC和TSC算法,本文方法的分類準(zhǔn)確率有一定程度的提升,分別提高了9.6%、7.94%和4.55%,實(shí)驗(yàn)結(jié)果體現(xiàn)了與傳統(tǒng)方法相比,KC-TSC方法可更有效解決遷移學(xué)習(xí)問題,驗(yàn)證了本文方法的有效性,即初始化基向量和考慮域間及類間分布差異的重要性。

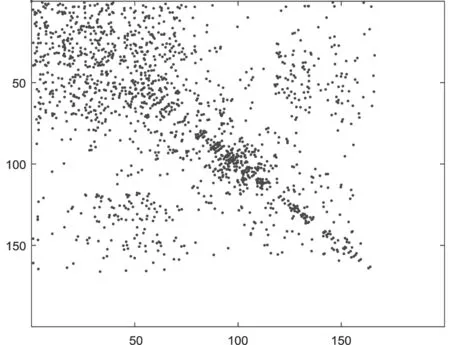

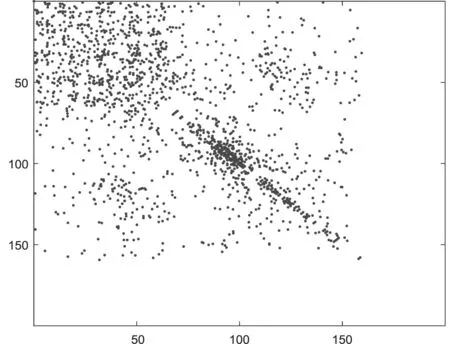

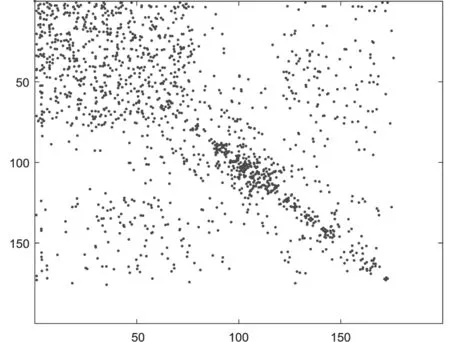

為表明本文方法的有效性,從跨域數(shù)據(jù)集A_D中源域Caltech選取100幅圖像,從Dslr數(shù)據(jù)集中選取100幅圖像,構(gòu)建基于其稀疏編碼的權(quán)值矩陣,并根據(jù)權(quán)值矩陣畫出了四種稀疏編碼方法的編碼散點(diǎn)圖,如圖3所示。

(a)SC權(quán)值矩陣

(b)GSC權(quán)值矩陣

(c)TSC權(quán)值矩陣

(d)KA-TSC權(quán)值矩陣

從圖3中可以看出,左上和右下表示同域的分布差異,而左下和右上角為跨域的分布差異,可以看到SC、GSC方法中跨域分布較為稀疏,表明源域與目標(biāo)域分布差異較大;而TSC和KA-TSC因?yàn)榭紤]了域間分布差異,散點(diǎn)面積更廣,表明了縮小域間分布差異的重要性;而KA-TSC比TSC分布更為豐富,表明了本文方法進(jìn)一步考慮類間差異的有效性。

4.3 參數(shù)分析

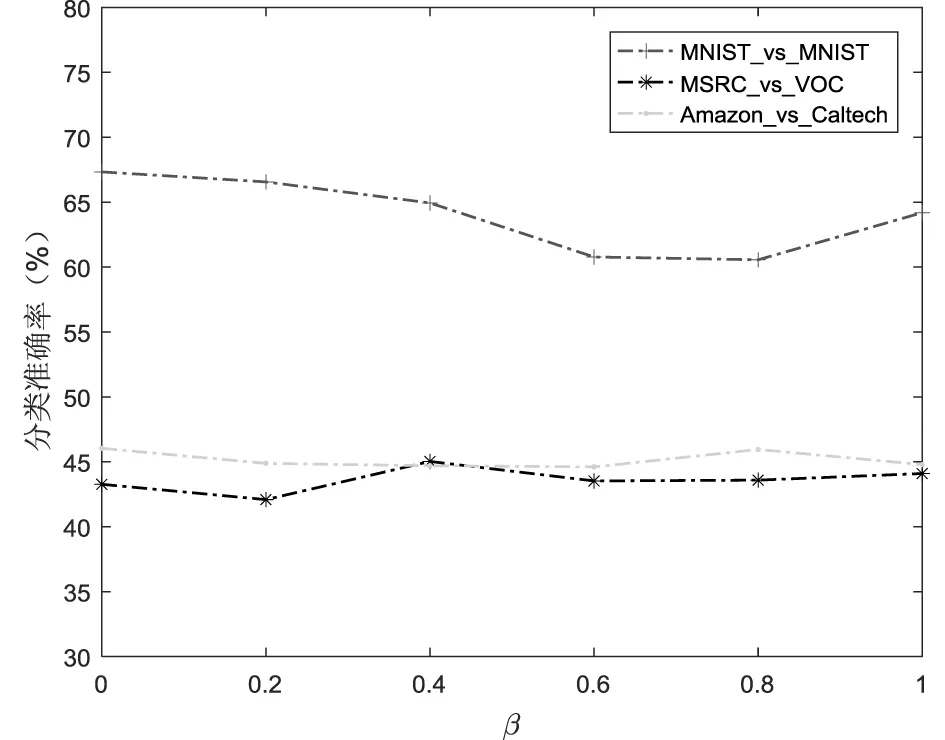

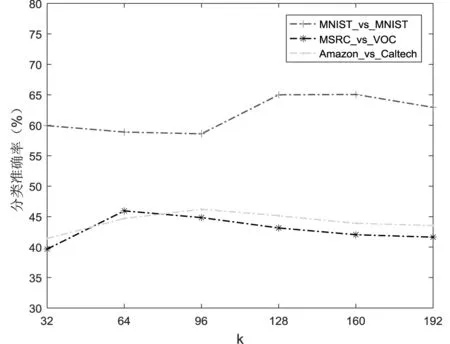

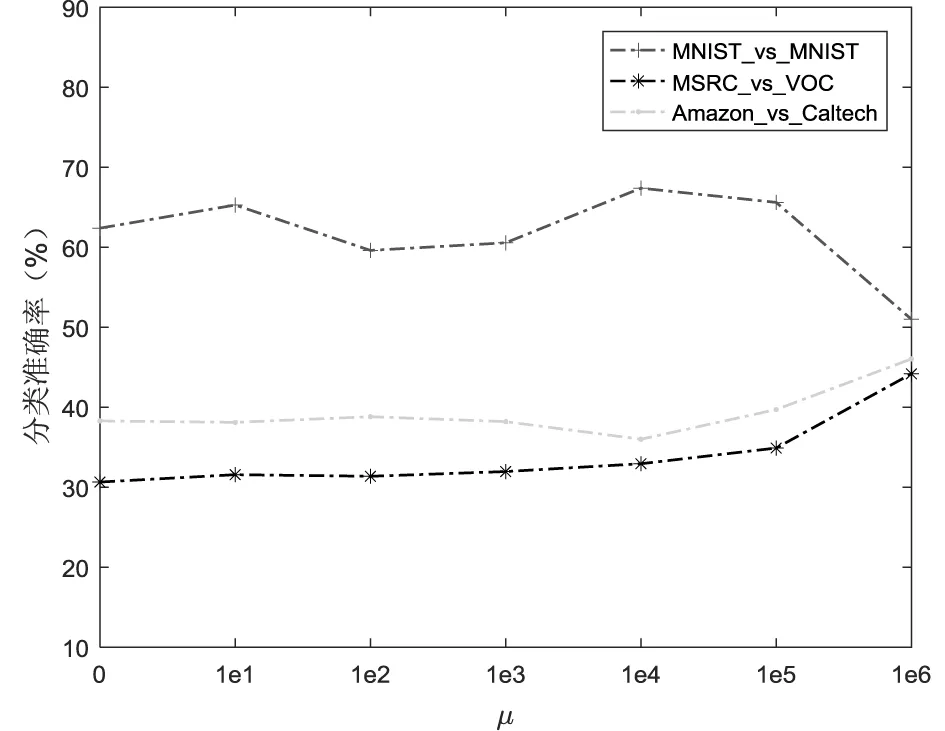

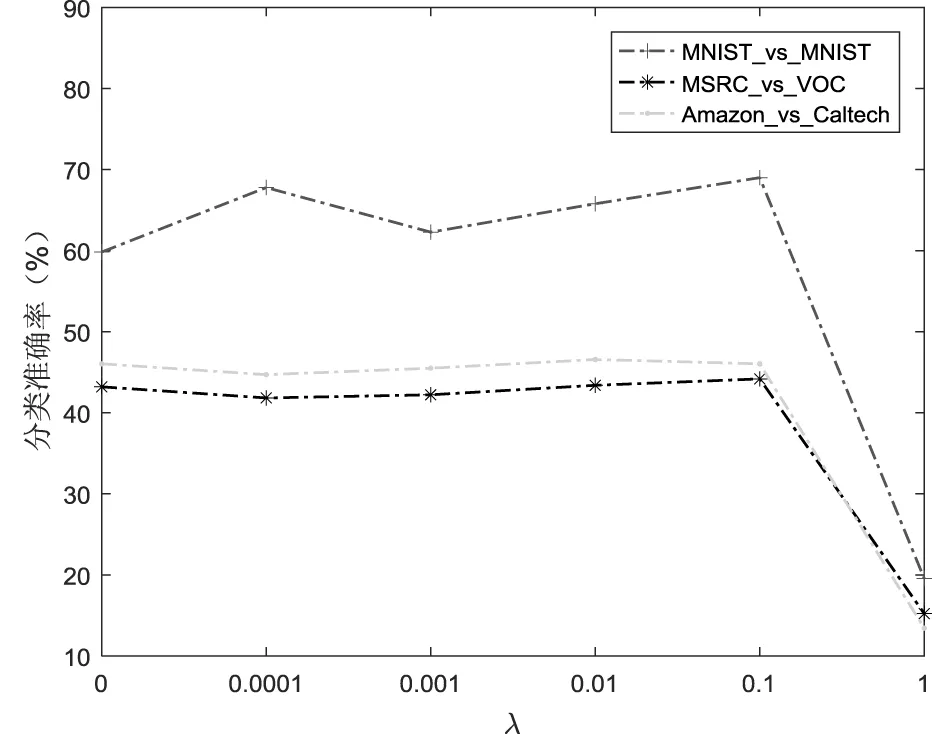

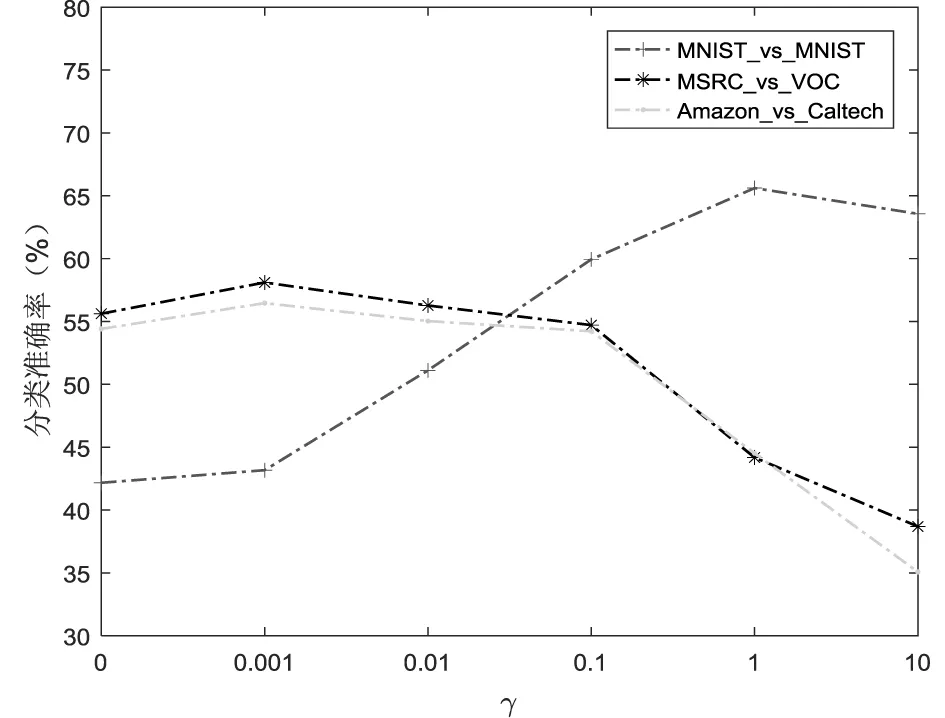

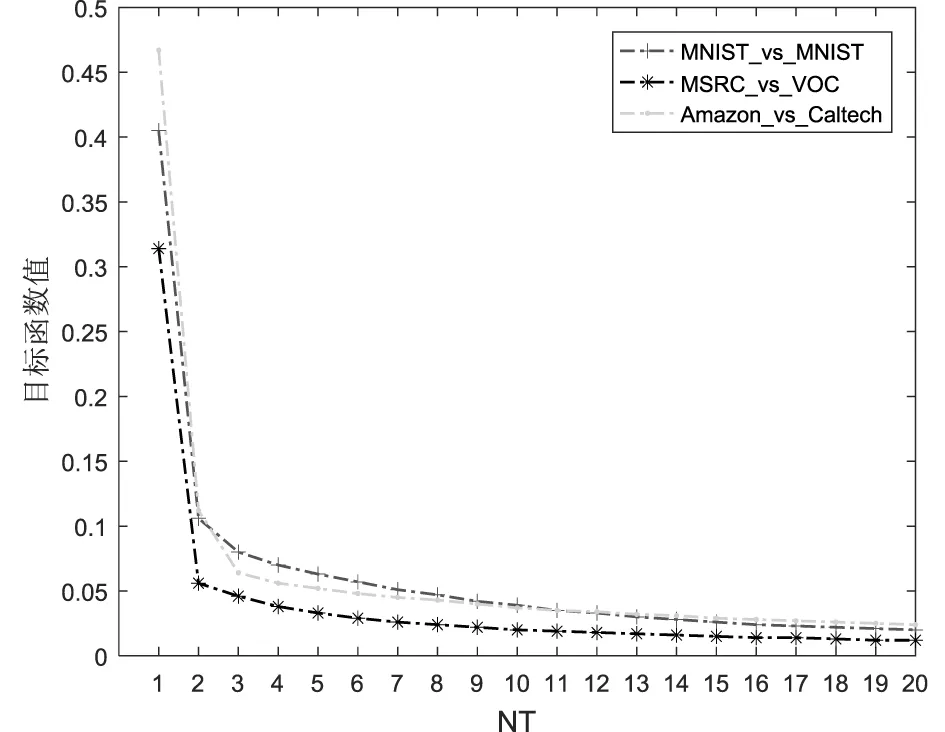

為了分析各個(gè)參數(shù)對(duì)分類性能的影響,本文選擇部分跨域領(lǐng)域任務(wù)USPS_vs_MNIST,MSRC_vs_VOC,Amazon_vs_Caltech進(jìn)行測(cè)試,分別測(cè)試β、κ、μ、λ、γ和迭代次數(shù)NT對(duì)分類精度的影響。采用的方法是控制變量法,通過固定其中3個(gè)參數(shù),設(shè)置另一個(gè)參數(shù)進(jìn)行實(shí)驗(yàn)。實(shí)驗(yàn)結(jié)果如圖4所示。

(a)權(quán)值調(diào)節(jié)因子β

(b)聚類維數(shù)k

(c)最大均值差參數(shù)μ

(d)稀疏懲罰參數(shù)λ

(e)圖正則化參數(shù)γ

(f)迭代次數(shù)NT

首先,分析權(quán)值參數(shù)的影響,如圖4(a)所示,可以看出,在β∈[0.05,0.45]時(shí),在這個(gè)較寬的范圍內(nèi)分類效果較好,而當(dāng)β∈[0.45,1]時(shí),僅有個(gè)別數(shù)據(jù)集的分類性能有所提高。其次,對(duì)于聚類數(shù)k,實(shí)驗(yàn)效果如圖4(b)所示,觀察得出,當(dāng)κ∈[128,160]時(shí)分類性能最穩(wěn)定。均值差參數(shù)μ對(duì)分類性能的影響如圖4(c),當(dāng)μ∈[1e4,1e5]時(shí)分類效果較穩(wěn)定,當(dāng)μ=1e6,部分?jǐn)?shù)據(jù)集分類性能有所提高。稀疏參數(shù)λ和圖正則化參數(shù)γ的影響如圖4(d)和圖4(e)所示,當(dāng)λ∈[0.01,0.1]和γ∈[0.1,1]時(shí)效果穩(wěn)定。圖4(f)為迭代次數(shù)對(duì)目標(biāo)函數(shù)收斂度的影響,明顯可以看出,目標(biāo)函數(shù)是逐漸收斂的。可見,本文方法可在有效范圍內(nèi)實(shí)現(xiàn)源域到目標(biāo)域的有效遷移,一定程度提高跨域分類準(zhǔn)確率。

結(jié)語

本文提出的基于聯(lián)合特征和遷移學(xué)習(xí)的跨域圖像分類方法(KC-TSC),在遷移稀疏編碼的基礎(chǔ)上,首先在字典學(xué)習(xí)上通過Kmeans聚類初始化字典基,學(xué)習(xí)更具代表性的初始字典;其次在編碼學(xué)習(xí)中進(jìn)一步考慮域間和類間分布差異,在目標(biāo)函數(shù)中最小化源域與目標(biāo)域的條件分布并最大化源域中類間分布,并借助平衡因子調(diào)節(jié)分布權(quán)重。在目標(biāo)函數(shù)的求解中,利用拉格朗日對(duì)偶法和特征符號(hào)搜索法優(yōu)化字典和編碼,通過迭代求解,學(xué)習(xí)特征表示。最終,在MNIST和USPS、Office和Caltech等多個(gè)通用遷移數(shù)據(jù)集上進(jìn)行對(duì)比實(shí)驗(yàn)和參數(shù)分析,主要發(fā)現(xiàn)如下:(1)利用Kmeans初始化字典是字典優(yōu)化的有效方法;(2)充分考慮域間與類間分布差異,可有效提高源域到目標(biāo)域的遷移性能。