基于深度信念網絡的文本分類研究綜述

石媛媛,裴志利,姜明洋,3

(1.內蒙古民族大學數理學院,內蒙古通遼028043;2.內蒙古民族大學計算機科學與技術學院,內蒙古通遼028043;3.吉林大學計算機科學與技術學院,吉林長春130012)

在互聯網信息時代的高速發展下,信息數據陡然增長,而信息的承載途徑最主要的就是文本,于是文本分類成為近些年的研究熱點.文本分類(text categorization,TC)技術的任務是預先給定文本集的類標,根據文本的內容自動確定該文本所屬類別的過程.文本分類主要用于信息檢索、文本審核、情感分析和廣告過濾等領域.傳統的機器分類模型有樸素貝葉斯算法(Naive Bayesian Classifier,NBC)[1]、支持向量機算法(Support Vector Machine,SVM)[2]、決策樹算法(Decision Tree,DT)[3]、BP 神經網絡算法(Back Propagation,BP)[4]、K-最近鄰算法(K-Nearest Neighbor,KNN)[5]等,這些模型容易出現維數災難和局部最優,而且有些聚類算法并不完全適合實際情況中的深度問題[6],在實際復雜的分類需求下建模能力仍很有限.針對上述問題,Hinton 在2006 年提出深度學習(Deep Learning)[7],其包含的深度信念網絡(Deep Belief Network,DBN)[8]具備突出的特征學習優勢,且可以通過“逐層初始化”克服訓練難度,使訓練時間大大縮短,從而實現高效分類.深度信念網絡已于手寫體識別、圖像識別以及語音識別等領域被廣泛使用.目前,喬俊飛等[9]提出一種基于自適應學習率的DBN 算法,縮短了訓練時間,且明顯優于固定學習率對網絡的影響;徐毅等[10]將懲罰正則項引入到DBN 中,通過控制隱層節點不同的稀疏水平,使整個網絡有更好的稀疏性能,提高分類的準確率;李蘭英等[11]將DBN 和CNN 相結合,提出一種應用于脫機手寫漢字識別的算法,大大提高了傳統DBN 算法的識別效果.本文將簡述深度信念網絡以及幾種基于深度信念網絡的文本分類模型.

1 深度學習

深度學習是深層的機器學習方法,算法自身會挖掘出蘊藏在數據中復雜隱喻的特征,從而實現高準確度分類.深度學習依賴于無監督特征學習和大量訓練數據,利用構建多隱層模型的方式,逐步學習到更有價值的特征.而DBN算法作為深度學習的方法之一,通過貪婪逐層訓練的方式,避免針對多隱層訓練時梯度下降算法效果不佳,有效地優化深度學習的問題.

2 深度信念網絡文本分類模型

2.1 深度信念網絡結構

DBN是一種概率生成模型,各層網絡之間的權重與偏置是在網絡運行的過程中不斷被訓練的,根據最大概率讓網絡擬合訓練樣本[12].DBN 的網絡結構相對簡單,其基礎是受限玻爾茲曼機(Restricted boltzmann machine,RBM)[13],由若干個串聯堆疊的受限玻爾茲曼機RBM和一個反向傳播BP網絡構成,其結構如圖1所示.

圖1 深度信念網絡結構Fig.1 Deep belief network structure

DBN的網絡學習過程分為兩個階段,首先對RBM進行無監督自底向上的逐層預訓練,再利用有監督的BP網絡對整個網絡進行調優.

2.1.1 受限玻爾茲曼機 受限玻爾茲曼機(Restricted boltzmann machine,RBM)[14]是由一個可視層v和一個隱含層h組成的隨機神經網絡,這兩層神經元之間的連接特點是層內無連接,層間全連接.其結構為圖2.

圖2 受限玻爾茲曼機結構Fig.2 Restricted Boltzmann machine(RBM)structure

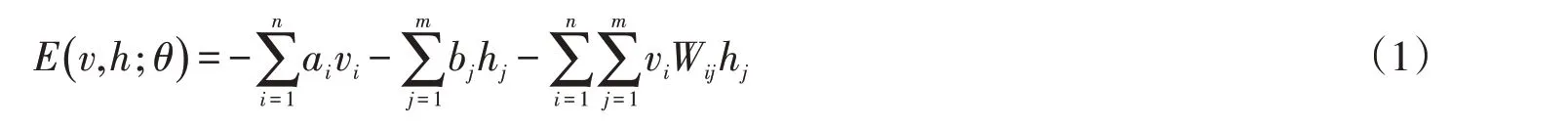

RBM是一種能量函數,對于給定的狀態(v,h),定義能量函數為

其中,θ=(Wij,ai,bj)表示RBM的參數.

根據能量函數,給出狀態(v,h)的聯合概率分布

根據RBM的結構特點可知,在給定可見層(隱含層)節點狀態的情況下,隱含層(可見層)節點的激活概率是條件獨立的.由貝葉斯公式可推導可見層節點和隱含層節點的激活狀態:

其中σ(x)為sigmoid激活函數.

RBM在訓練過程中最重要的任務就是不斷調整參數θ,使網絡的概率分布最大程度地擬合樣本.根據最大似然學習法,通過最大化對數似然函數求得參數θ.

而求解Z(θ)的運算難度較大,于是為了能快速訓練RBM,Hinton提出對比散度算法(Contrastive Divergence,CD)[15],其中只需執行k=1步的Gibbs采樣,即可得到更新的各項權值.

2.1.2 BP神經網絡 DBN完成預訓練的同時也完成了初始化整個網絡的參數,此時BP網絡的輸入就是最后一層RBM的輸出,算法將利用預訓練得到的輸出與標簽之間的誤差,微調網絡的權值與偏置,使誤差達到最小,分類效果最佳[16].更新后的DBN各層權值為

其中,為第l個隱層第i個節點的輸出值,η為學習率.

2.2 深度信念網絡文本分類模型

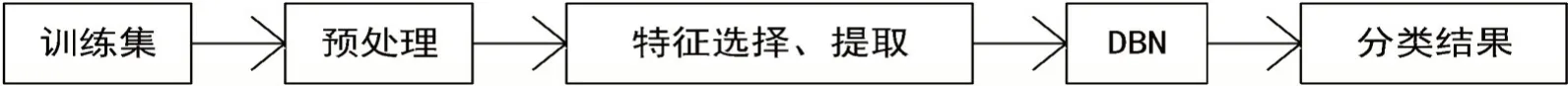

根據DBN和文本分類流程,給出DBN的文本分類模型如圖3所示.主要經過三個階段,首先,進行文本預處理;其次,進行特征選擇與特征提取;最后,將文本輸入到DBN文本分類模型中分類.

圖3 深度信念網絡文本分類模型Fig.3 Deep belief network text classification model

3 基于深度信念網絡的兩種文本分類問題

3.1 稀疏深度信念網絡分類問題

由于DBN網絡的相對復雜性,一旦出現特征同質化的問題,網絡將影響分類的效果.為了防止過擬合和分布中的不變形問題的發生,在網絡中加入稀疏項進行約束是非常有效的辦法之一.

文獻[17]采用的是無均值高斯函數的稀疏正則項,利用無均值高斯函數趨于l0范數所達到的稀疏效果,表達式為:

其中,σ為方差因子,用來調整與l0范數的近似度.實驗中,在分類效果上G-DBN分別于NS-DBN與SP-DBN作對比,G-DBN網絡在實驗過程中有穩定且更高的稀疏性.

文獻[10]則在RBM的訓練過程中引入拉普拉斯函數稀疏正則項,利用位置參數來調整稀疏力度,調節隱藏單元的稀疏性.給定一個訓練集,稀疏優化模型如下:

于是網絡的目標函數為:

拉普拉斯分布是與正態分布相類似的連續分布,但比正態分布的尾部更加平坦,通過改變位置參數來產生不同的分布曲線,從而控制隱藏節點的稀疏性.在與相同條件下的自動編碼器、ANN 算法進行比較:文中提出的基于稀疏性的DBN 分類模型有更好的挖掘文本中隱藏的深層特征能力,有穩定的魯棒性,分類準確性也有所提高.

DBN網絡引入適當的稀疏項雖然有比無稀疏正則的DBN網絡更具優勢,且能夠對網絡進行有利壓縮,但過當的稀疏性也會給網絡造成影響,如降低網絡的穩定性,使模型的泛化能力下降.引入稀疏項后依然能保證網絡的穩定性和解決有效信息的丟失等問題仍舊是學者們需要研究的.

稀疏DBN作為一種預訓練技術,可對權值進行快速初始化以及對特征向量進行快速獲取.文獻[18]提出了一種新的非監督學習算法——基于模糊神經網絡的稀疏深度置信網絡(SDBFNN),網絡將SDBN的預訓練技術和FNN的高效監督學習進行了結合.文獻中加入兩個稀疏項R1和R2,來懲罰隱層神經元的平均激活概率,對數似然函數進行更新如下:

其中,

FNN中的BP算法不是連續且逐層進行的,這樣可以消除DBN微調中BP算法造成的梯度擴散問題,從而實現高效的監督學習和建模.實驗結果發現,SDBFNN算法比DBN算法有更高的精度,在使用稀疏表示的情況下,準確率并不總是和訓練時間成反比,它強調了利用稀疏表示進行快速有效的訓練,避免了復雜的密集表示,達到了較高的精度.

雖然,SDBFNN在一些工程應用中有著很好的應用前景,但是它的性能還有進一步提高的空間.

3.2 深度信念網絡結合其他網絡進行文本分類問題

為了提高分類問題的準確率,多數學者的研究不僅僅只限于單獨使用DBN網絡,而是將其他網絡與DBN網絡進行融合,將不同網絡的優勢結合起來,改掉各自的缺點,從而更加高效地解決實際問題.

文獻[19]將DBN 和DBM 結合起來,提出混合深度信念網絡(HDBN).實驗在網絡的底層設置兩層DBM,進行降維的同時盡可能多地保留數據的原始信息;根據DBN網絡的特點,可以在原始的淺層特征中學習到更加復雜且具體可分的深層文本特征,于是結合了DBN,同時進行又一次的降維.

由于RBM是能量函數,而求能量函數的過程就是最小化能量值的過程,文獻[17]提出自由能量函數:

于是似然函數的表達式為:

HDBN 網絡與DBN 網絡的結構有相似之處,DBN 在網絡的訓練初期易于出現過擬合的現象,所以HDBN先利用DBM給原始數據進行特征提取,也進行降維、降噪;然而DBN卻可以在高層的網絡結構保持穩定的性能,再利用DBN 進行微調,進行高精度的分類.實驗證明HDBN 網絡的分類效果優于DBN 網絡,HDBN網絡中的低維表示比DBN網絡中的更詳細,對于網絡參數的調整更具輕松性.

文獻[20]則對DBN初始值進行優化,將改進的和聲搜索(IHS)融合在DBN中,提出一種IHS-DBN模型.HS算法是現代較新穎的優化算法,通過不斷調整解向量,進行迭代與收斂直至找到函數最優解.它的優點在于:網絡思路易懂、網絡的參數相對較少、實現對最優解的搜索等,于是將HS算法結合到DBN中,利用自身的優勢,使得更加高效地優化整個網絡的參數以及加快對分類的收斂過程.

IHS算法選定DBN算法中的重構誤差函數作為優化目標函數,在網絡訓練中,IHS算法會盡可能增加解向量的最優性,得到DBN網絡的最優初始值.IHS-DBN算法中優化目標函數公式為:

其中,為顯示層節點的真實值,為RBM 的重構值.通過IHS 算法不斷迭代,最終得到全局最優解,并由此初始化DBN 網絡中的第一個RBM 的各項參數與權值,最后利用梯度下降法對整個網絡進行調優.

實驗結果表明,IHS-DBN算法的分類精度高于傳統的DBN網絡.DBN網絡通過設定較小的隨機值確定網絡初始值,并不適合的網絡參數可能會致使出現局部最優的情況,通過IHS算法對此的優化,不僅避免了傳統DBN初始值的問題,還能縮短整個網絡訓練時間,加快得到全局最優解和收斂速度.

文獻[21]為了使DBN模型的輸入更加低維且有效,將變分自編碼(VAE)與DBN相結合,提出VAEDBN模型.由于VAE的結構,被看做是特征提取的模型,在實驗中完成對數據的重構,通過重構誤差結束初始特征學習,無監督的特征提取來得到低維優良的特征,將其輸入到DBN 網絡中再次分類亦更適合DBN網絡的工作機制,可大大降低錯誤分類的情況發生.VAE-DBN算法的目標函數為:

VAE 的學習目的就是使輸出數據在誤差盡可能小的情況下與輸入數據表示相同,由于算法增加了噪音,使輸出數據與輸入數據在保持相同分布的情況下產生了多樣性.實驗證明,經過VAE處理后,數據增強了穩定性,DBN有較強的數據挖掘能力進行數據的二次處理,改進后的目標函數也提高了得出全局最優分類結果的概率,比單獨使用DBN網絡有更好的分類結果.

文獻[18]將模糊學習框架與DBN網絡的預訓練階段相結合,在最后一個隱層中保留訓練得到的有效特征向量,最后利用誤差函數進行調優.傳統DBN網絡的監督階段效果有限,于是選擇FNN算法來代替逐層BP算法.這種結合方式的優越處在于DBN的預訓練技術可以得到一個更有效的數據表示,將其作為模糊神經網絡的輸入,稀疏表示可以增強SDBN對外界波動的容忍度,提高其魯棒性.

4 深度信念網絡在情感分類問題中處理復雜特征的優勢

文本情感的分類工作具有非常高的實際意義,DBN對于此類任務也有良好的結果.同時,選擇不同的特征也影響著分類結果.

文獻[22]中在對文本進行預處理之后,選取一、二元詞,依存關系等特征輸入到DBN網絡中,實驗結果證明,當輸入特征選定為三元組依存關系時,網絡有更好的分類結果.三元組依存關系特征可以看作是一條“主—謂—賓”構成的記錄,相較于一元詞、二元詞有更高的客觀情感色彩和依存關系,且具有復雜充分的文本信息.所以文本情感的分類工作選擇在DBN網絡中運行更具有優越性,且復雜的特征更能提高分類準確度.

針對文獻[22]實驗所用網絡單一的問題,文獻[23]分別將一元詞、二元詞和LDA提取到的淺層特征輸入到DBN 網絡與SVM 網絡中,基于DBN 無監督的預訓練階段是特征提取的過程,可以學習到更加復雜且具象可分的深層特征,更有利于文本的分類,實驗結果證明DBN不僅能提取出深層特征,而且能利用深層特征參與分類,且比在同等條件下的SVM網絡分類結果更優.并且將LDA選擇出來的特征輸入到DBN網絡與SVM網絡中,分類結果都優于將一元詞、二元詞作為特征進行輸入得到的分類結果.這是由于LDA 是由三層結構組成的生成模型,即“詞—主題—文檔”,能夠表達出深刻的文本信息,而后輸入到DBN網絡中將繼續挖掘更加復雜的信息,更優地完成分類任務.

文獻[24]則將特征選擇和DBN相結合,提出一種新的文本分類算法,即FSDBNF.文獻將文本進行四種方法的特征選擇后的數據分別輸入到FSDBN、DBN、HDBN等分類器中,對比實驗結果得出結論:改進的FSDBN相較于DBN不僅略提高了分類準確率,還明顯縮減了訓練時間.因此,FSDBN在情感分類任務上有著較其他分類器良好的優越性.這是因為將原始數據分別按照上述四種特征選擇的方法約減剔除一些無用的特征進行降維,通過實驗結果可以說明處理后的數據集留下更加有意義的特征,特征與特征之間的關聯性更大,這些優秀的特征能使DBN網絡得出更加優異的分類結果.

文獻[25]考慮到情感分類問題對標簽的依賴程度采用弱監督學習的方式,提出IGEF-DBN 網絡.文獻從信息幾何角度指導模糊模型從特征分布中吸收信息,將改進的模糊c均值(FCM)聚類算法中的模糊規則嵌入到IGEF-DBN中以提高模糊深度信念網絡的性能,最后IGEF-DBN網絡應用于情感分類任務中.實驗將IGEF-DBN與TSVM和FDBN的分類性能進行了比較.IGEF-DBN在5個數據集的測試精度與性能都優于其他網絡.然而FCM聚類算法在某類樣本基數很大,當出現新樣本時,該樣本中K個鄰點在樣本基數大的類別中權重類型占大多數,說明這類樣本與目標樣本距離較遠,會導致樣本的不平衡,而且其計算量也較大.

5 結束語

DBN的訓練過程既包括無監督訓練階段也包括有監督訓練階段,它有著穩定的網絡性能,克服傳統的文本分類方法出現維數災難、局部最優等問題.DBN對復雜問題具有良好的特征挖掘能力和普適性,對經過處理而保留有用特征的數據集有非常優秀的分類能力.但是網絡中參數的選取多數是通過大量的實驗得到,同時網絡的函數較為復雜且需要迭代的次數較多,進而訓練時間則較長.希望在未來的發展中,能進一步優化DBN使其解決上述問題.