異構多分支網絡超聲圖像自動診斷方法

李昕昕,師 恩

(1. 四川大學錦城學院計算機與軟件學院 成都 611731;2. 西南交通大學信息科學與技術學院 成都 610031)

乳腺癌是目前女性發病率最高的惡性腫瘤,盡早發現可以提供更好的治療機會[1]。當前常用的乳腺癌篩查手段包括:粗針穿刺、乳腺X 線攝影、乳腺磁共振檢查和超聲影像。而超聲影像因其無創傷、便捷、價廉,對致密性乳腺診斷敏感性和準確性高,成為首選的乳腺檢查方法。但由于超聲影像中良惡性結節的圖像表現存在重疊,嚴重依賴醫生經驗,不同資歷的醫生誤診率達到10%~30%[2]。因此,如何借助計算機視覺和大數據技術輔助臨床醫生提高對超聲影像進行良惡性腫瘤判斷的準確率,逐漸成為目前的研究熱點。

針對上述問題,本文提出了一種端到端的自動結節分類方法。該方法主要采用基于乳腺超聲圖像的良性和惡性分類的異構多分支網絡 (heterogeneous multi-brach network, HMBN)。包括如下4 個模塊:

1)圖像預處理:為提高超聲圖片的質量,本文采用基于mean shift 聚類算法[3]對原始視頻進行關鍵幀選取。然后對超聲及造影圖像進行基于增強的Wiener 濾波[4]去噪和基于多重分形和對比度自適應的直方圖均衡技術[5]的增強處理。

2)超聲病理特征信息提取:病理信息包括原始超聲圖像提取的病理信息和包括年齡以及其他6 個與乳腺良惡性相關度最高的乳腺病理特征在內的非圖像信息。通過將病理信息做歸一化處理后融合到分類的神經網絡中。

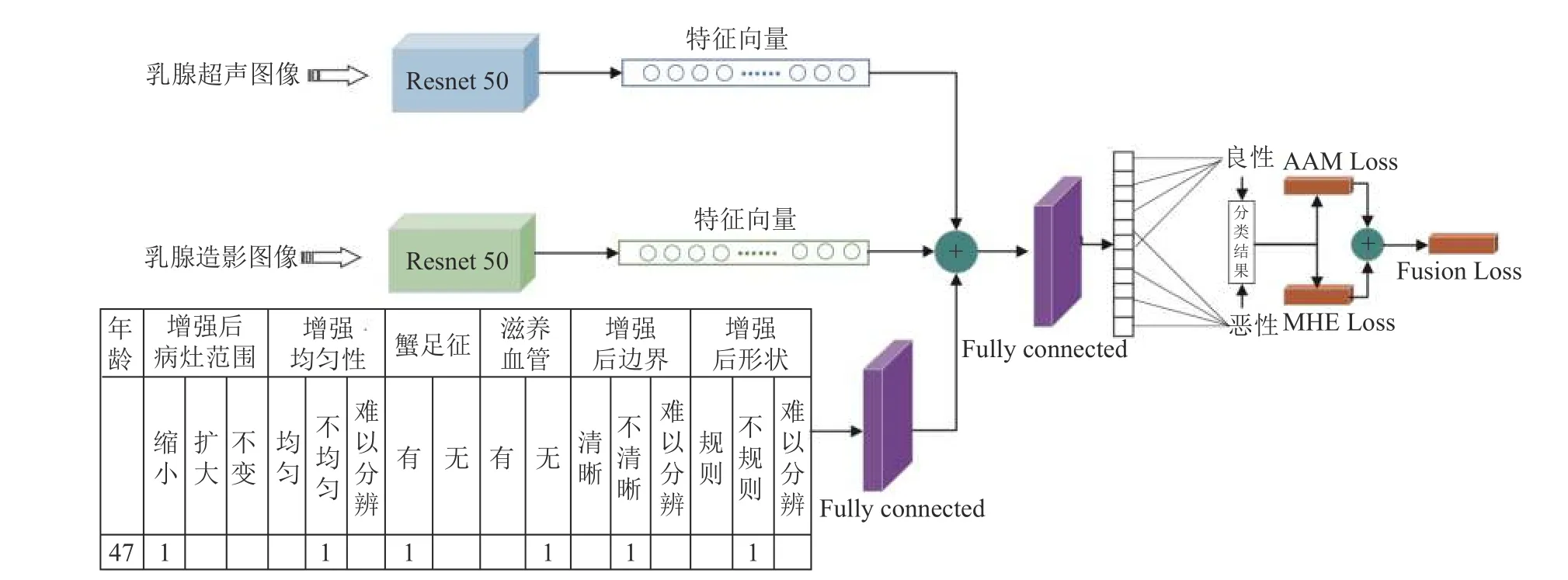

3)異構多分支網絡模型:該模型的輸入數據包括圖像信息和非圖像信息。對于圖像信息,使用了由ImageNet 數據集遷移的Resnet50 網絡進行特征提取,對于非圖像信息,使用了一個全連接層將非圖像的信息向量與其他分支結果融合進行分類。

4)優化的損失函數:在附加角邊距損失(additive angular margin loss, AAM loss)[6]的基礎上應用了最小超球面能量(minimum hyperspherical energy, MHE)[7]來改善分類效果。

1 相關工作

在乳腺超聲的自動診斷分類任務中,文獻[8]在針對乳腺病灶區進行篩選和分類的任務中,將自適應的去卷積網絡模型作為一種產生式的無監督分層深度學習框架,用于診斷乳腺腫瘤的超聲圖像特征學習以及特征圖譜生成,從而實現乳腺良惡性腫瘤的分類。實驗結果表明該卷積網絡的性能已達到傳統手工特征的CADx 系統的水平。文獻[9]研究了一種將從預先訓練的CNN 中提取的低級和中級特征與從傳統計算機輔助系統中獲得的手工設計特征相結合的方法,并得到了顯著的性能改善。文獻[10]設計了3 種能夠分別接受橫向平面圖像,冠狀面圖像和圖像注釋信息的網絡模型。實驗結果表明,文中設計的模型可以同時處理圖像和注釋,且與單輸入模型相比,多種信息融合模型將分類準確率提高了2.91%,達到了75.11%。

本文結合臨床醫學知識,將傳統卷積神經網絡擴展為異構的多分支網絡進行乳腺超聲的良惡性分類識別,最終獲得了較好的結果。

2 本文算法

2.1 數據預處理

超聲圖像對于乳腺癌等疾病的診斷有著很大的優勢。但是超聲圖像中可能包含大量噪聲,尤其是斑點偽影和高斯噪聲,因此需要大量的圖像預處理工作來提升圖像質量。

1)超聲圖像去噪

為了探索針對乳腺超聲圖像數據集最佳的去噪方法,本文選擇基于散斑統計的記憶各向異性擴散去噪方法(anisotropic diffusion with memory based on speckle statistics, ADMSS)[11]、小波閾值算法、以及基于增強的Wiener 濾波的超聲圖像去噪算法在團隊自建的乳腺超聲數據集上進行定量和定性評估。實驗結果如表1 所示。

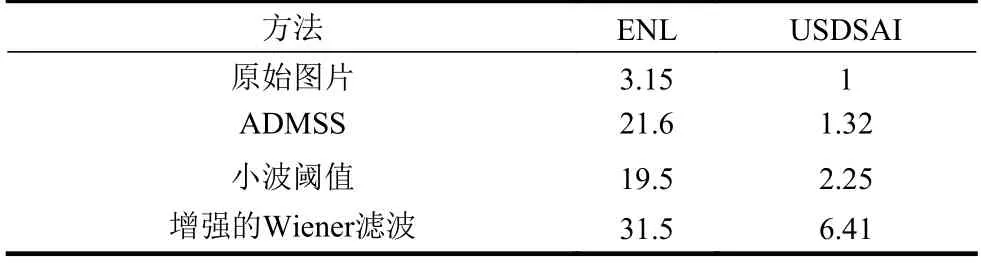

表1 不同算法的去噪效果對比

實驗中采用了兩個應用最普遍的去噪效果評價指標:等效外觀指數(equivalent number of looks,ENL)和超聲去斑評估指數(ultrasound despeckling assessment index, USDSAI)。其中,ENL 用于測量降噪效果,USDSAI 則用于測量去噪后圖像中不同類別(均質區域)的可分離性,值越大表示該算法的性能越好。基于上述實驗結果,本文選擇了增強的Wiener 濾波算法對乳腺超聲圖像進行去噪,基于增強的Wiener 濾波方法實現過程如下。

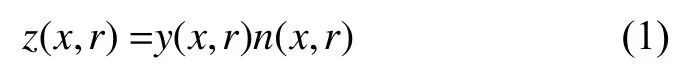

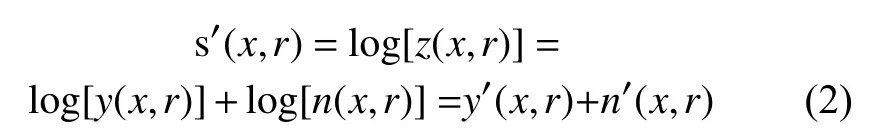

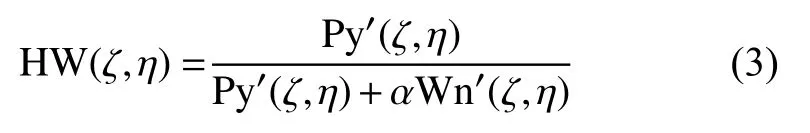

首先考慮以下采集模型:

式中,z()是采集的數據;y()是無噪聲信號;n()是斑點噪聲;(x,r)是根據采集幾何定義的空間索引。然后通過應用對數變換,將乘法模型轉換為加法模型,從而得到:

最后在新的獲取模型上,應用Wiener 濾波器(wiener filter, WF)。WF 是線性不變濾波器,其二維頻率響應函數定義為:

式中,Py′(ζ,η)=|Y′(ζ,η)|2是無噪聲信號y′(x,r)的功率譜;(ζ,η)為二維頻譜中的空間頻率。根據超聲圖片采集系統的不同,噪聲隨機過程表現出特定的自相關函數,其特征在于功率密度函數Wn′(ζ,η);參數 α用于調整濾波器強度的標量值,在標準WF下,將其設置為單位值1。為了提高濾波效果,采用馬爾科夫隨機場(Markov random field, MRF)理論對圖像進行建模。

2)超聲圖像增強

為了更好地提升圖像質量,還需要對乳腺超聲圖像進行數據增強。通過對多峰廣義直方圖均衡化算法(multi-peak generalized histogram equalization,Multi-peak GHE)[12],基于多重分形和對比度自適應直方圖均衡的圖像增強算法(Clahe+Mfrac)[5]以及一種基于模糊邏輯的增強算法[13]進行對比實驗,最終選擇基于多重分形和對比度自適應直方圖均衡的圖像增強算法進行超聲影像數據集的增強。

多重分形技術是增強醫學圖像和提取紋理特征的有效工具。多重分形技術中,最常用的4 種強度度量分別是:求和度量、最大度量、逆最小度量和iso度量。與其他3 個度量相比,逆最小度量在對斑點濾波過后的超聲圖片進行增強操作時,其處理后的圖片在紋理特征等方面表現更好,因此本文在多重分形中使用逆最小度量。

將多重分形度量表示為μw(ρ),其中ρ是大小為w的方形窗口內的中心像素。令g(k,l)表示窗口內(k,l)處像素的強度值,且 Ω表示窗口的中心像素ρ的所有鄰近像素的集合。

計算多重分形特征的第一步是Holder 指數α的估計。最小強度度量遵循逆冪定律,并給出α的負值。然后將計算出的最小值相對于最大強度值求反,以獲得具有所需縮放屬性的最小逆度量值:

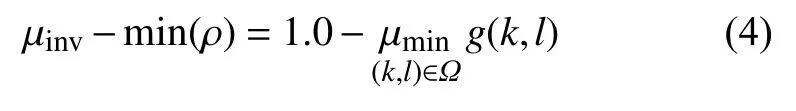

令圖像中每個像素點的強度代表原始圖像中相應點的Holder 指數,得到與原始圖像大小相同的α圖像。為了生成α切片,選擇圖像中屬于α值特定范圍(αmin,αmax)的像素,并縮放其強度值。通過多重分形獲得的輸出特征增強圖像在乳腺超聲掃描圖像中得到了改善。從圖1 為多重分形圖像增強效果比較圖。圖1a 為斑點濾波過后的乳腺超聲圖像,圖1b 為多重分形(中心)的α圖像,圖1c 為使用多重分形測量值的增強型乳腺超聲圖像。圖1b 可以看出,將圖像多重分解為α圖像可用于表征超聲圖像中的解剖結構及各種形狀和紋理特征。

圖1 多重分形圖像增強效果圖

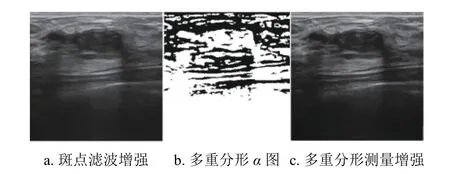

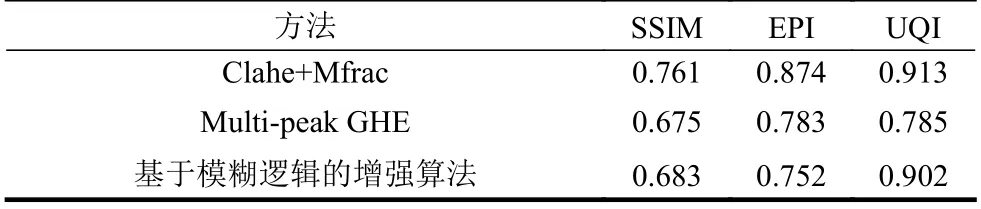

表2 為定量增強效果評價表。從表2 可以看出,本文采用的基于多重分形和對比度自適應直方圖均衡的圖像增強算法(Clahe+Mfrac),在結構相似性指標(structural similarity index metric, SSIM)、邊緣保持系數(edge preservation index, EPI)和通用質量指標(universal quality index, UQI)這3 個指標上較其他兩種方法效果更好。圖2 為應用多重分形和對比度自適應直方圖均衡增強算法后的超聲造影效果圖。

表2 定量增強效果評價表

圖2 多重分形和對比度自適應直方圖均衡增強效果圖

3)圖像關鍵幀提取

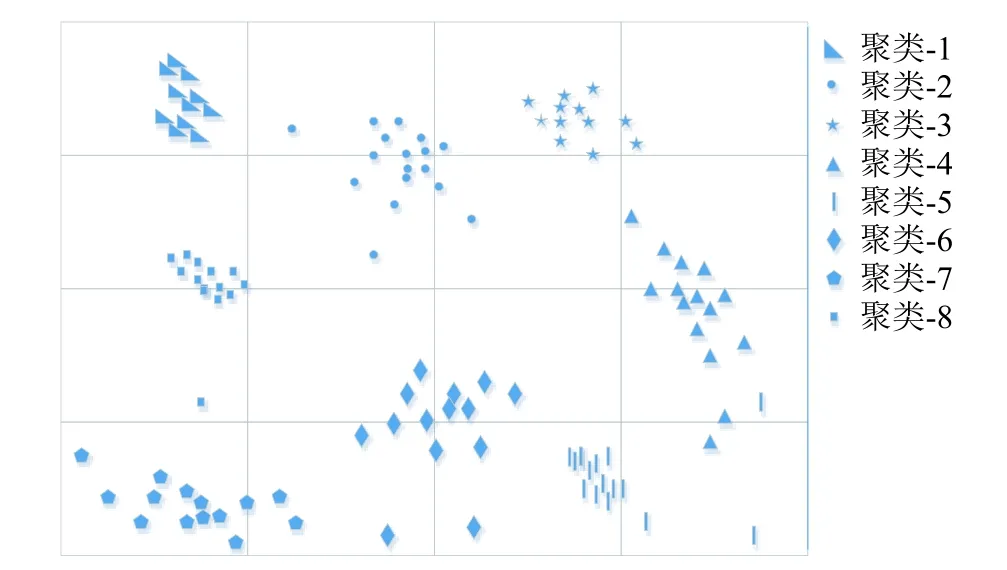

本文采用mean shift 聚類算法對原始視頻進行關鍵幀選取。將包含良性(150 例)和惡性(150 例)的多張乳腺超聲視頻進行均值化處理后,對每5 幀圖片進行距離可視化,得到圖3 所示的結果。

圖3 乳腺超聲圖像關鍵幀提取算法聚類結果

算法步驟:

1)從視頻幀序列中選取中間一幀作為起始關鍵幀;

2)計算出當前關鍵幀與其前面所有圖像和后面所有圖像的相似度,得到前后平均相似度的值;

3)將當前關鍵幀沿著平均相似度值大的方向移動,移動的距離為移動方向所有圖像數量的一半,修改當前關鍵幀;

4)重復步驟2)和步驟3),直到當前關鍵幀與其前后圖像平均相似度值差距很小,即目前的關鍵幀為最后算法選取的關鍵幀。

為了量化評價mean shift 聚類算法對乳腺超聲視頻關鍵幀提取的有效性,引入兩個量化指標:視頻保真度和視頻壓縮率。其中,保真度是提取的關鍵幀中所能表達的視頻包含的有效信息。壓縮率則是提取的關鍵幀總數與原始視頻總幀數之比。將所有視頻分類送入該算法并計算結果的平均值,得到mean shift 聚類算法的關鍵幀提取結果,如表3所示。

表3 乳腺超聲圖像關鍵幀提取算法聚類結果

2.2 損失函數設計

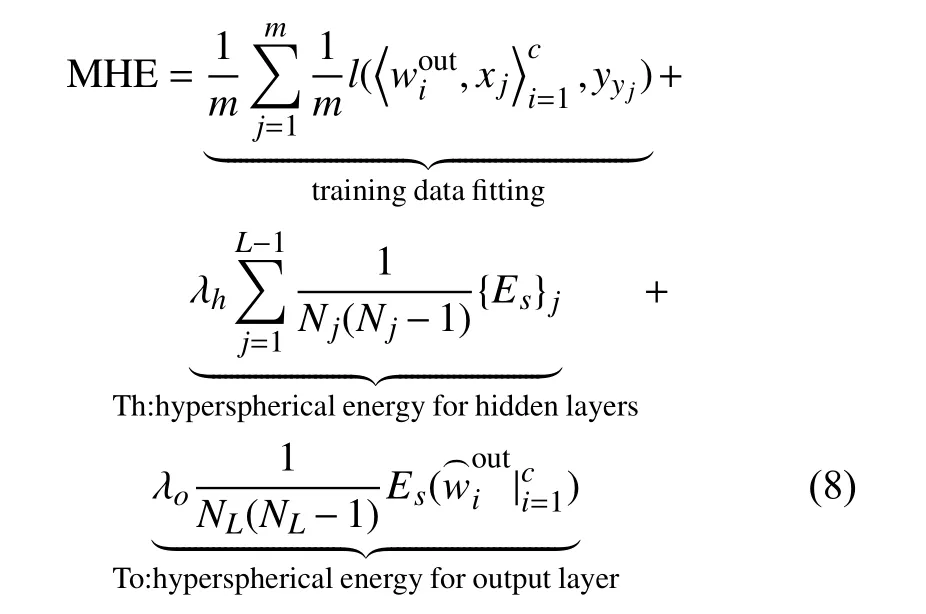

本文通過將最小超球形能量MHE[7]與AAM loss[6]相結合,提出一種新的混合損失函數。下面分別介紹附加角邊距損失、MHE 與混合損失。

1)附加角邊距損失

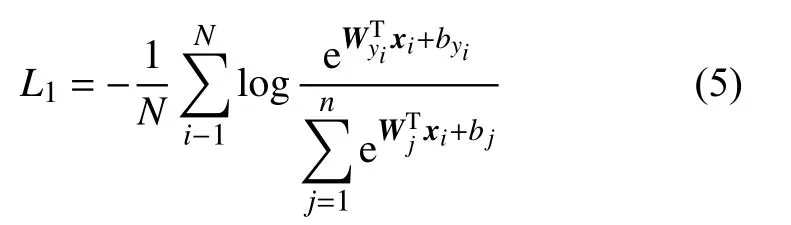

附加角邊距損失AAM 函數是在傳統softmax損失函數[14]的基礎上改進得到的。傳統的softmax損失函數可表示為:

式中,xi∈Rd表示第i 個樣本的深度特征;Wj∈Rd表示權重W ∈Rd×n的第j 列;bj∈Rn是偏置項。

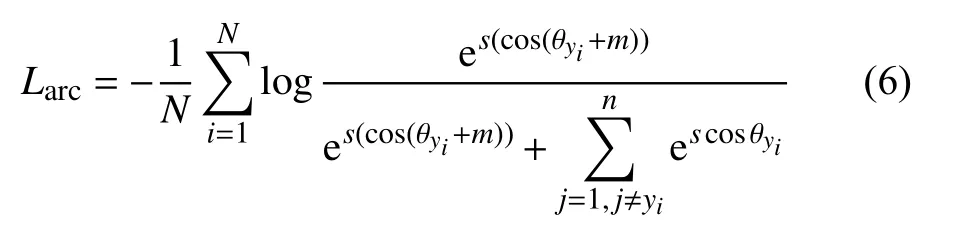

但是,Softmax 損失函數由于缺少明確的優化嵌入式特征,無法為類內樣本提供更高的相似度,為類間樣本提供更高的多樣性,導致當類內樣本的外觀差距較大時,圖像識別的性能降低。而AAM函數在 xi和 Wyi之間增加了附加的角度損失m,可以同時增強類內部的緊湊性和類間的差異:

2) MHE

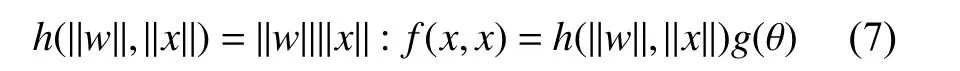

分類器神經元是每個類特征簇的近似中心。輸出層的全空間MHE 使得分類器神經元在超球體上分布更均勻,可以有效地改善類間特征的可分離性。MHE 將原始卷積視為角函數g(θ)=cos(θ)和幅度函數的乘積:

式中, θ是輸入x 和核w 之間的角度。可以看出,核的方向和核的范數對內積相似性有著不同的影響。通常,可以通過最小化l2范數來規范化權重衰減,但是內核的方向并沒有被規范化。因此,使用MHE 來規范化內核角度:

式中,xi是進入輸出層的第i 個樣本的特征;wiout是輸出全連接層中第i 個類的分類器神經元,且

式中,m 是最小batch 的大小;c 是類別數目;M是分類器神經元的數量;xi表示第i 個圖片的深度特征(是其真實的標簽);wiout是第i 個分類器的神經元。

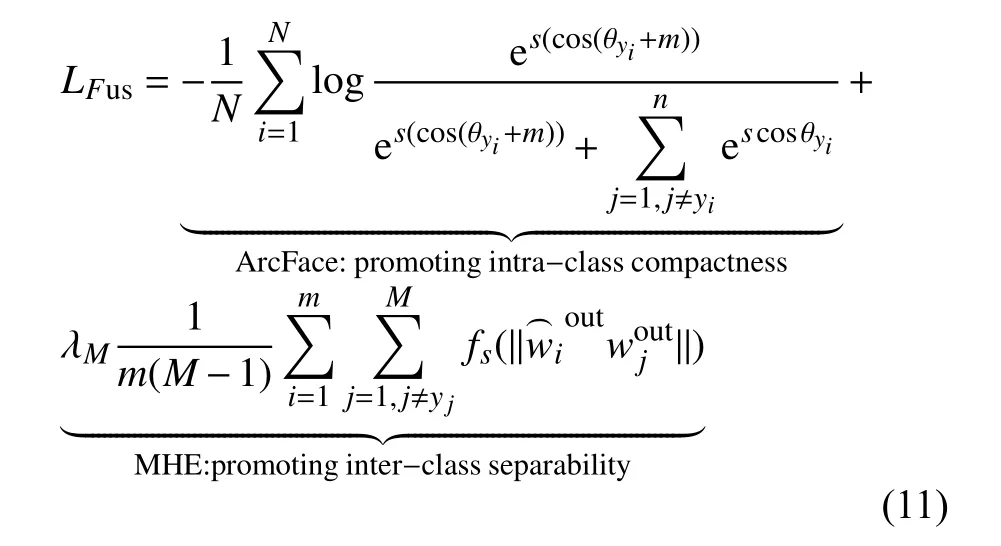

3)融合損失函數

通過以上分析和大量實驗驗證,AAM loss 的主要作用是減小類內距離,而MHE 可以顯著增加類間的間距。因此,本文將MHE 和AAM 進行融合,形成新的損失函數。

正則化項定義為:

式(10)展開可表示為:

上述融合損失函數可以進一步增加學習特征的角余量,減少類內距離,分類效果顯著改善。

2.3 病理信息提取

從超聲及造影圖片或視頻中提取結節病理信息,對于醫學診斷具有重要意義。并且在本文所研究的乳腺超聲自動診斷課題中,結節病理信息可以作為乳腺超聲圖片良惡性判斷的依據。有時原始數據中的病理信息可能存在缺失的情況,且很多目前公開的醫學超聲圖像數據集中基本都未包含與其相應的病理信息。因此,探究對乳腺超聲診斷有意義的病理信息并從超聲圖片中將其提取出來對乳腺超聲圖片的診斷具有重要的意義。

對于從圖片中提取的病理信息如表4 所示,包括3 個方面的工作。

表4 病理信息提取技術表

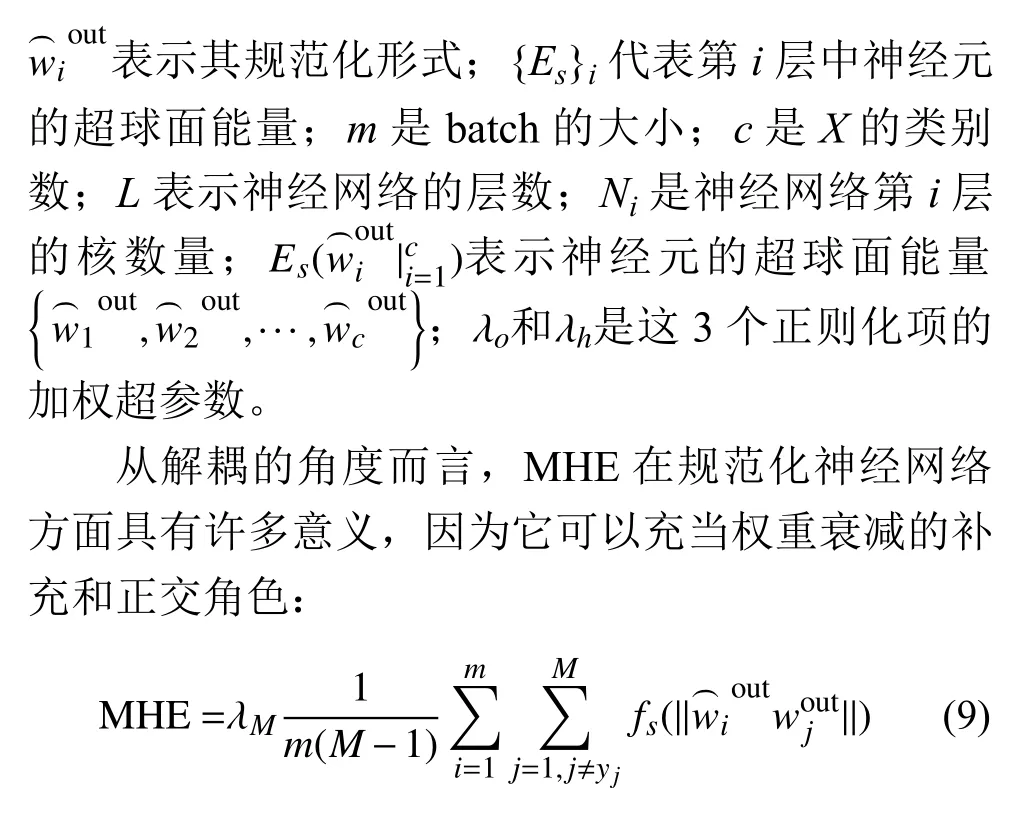

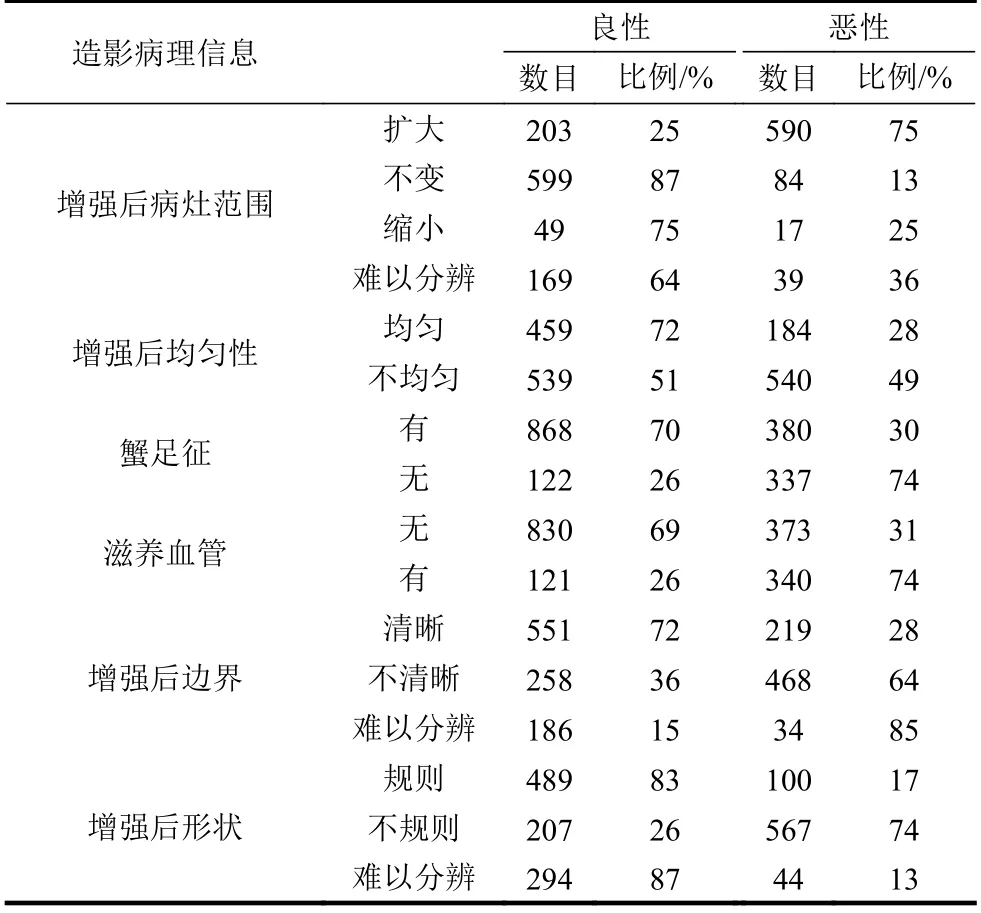

1)基于多標簽分類的病理提取

基于多標簽的乳腺造影圖片病理信息的提取主要包含以下內容:增強均勻性(類別:均勻、不均勻)、蟹足征(類型:有、無)、滋養血管(類型:無、有)、增強后邊界(清楚、不清楚、難以分辨)和增強后形態(規則、不規則、難以分辨)。這些基于乳腺造影圖片的病理信息被認為是對良惡性判斷非常有幫助的病理信息[15]。首先通過已有的文本格式的病理信息對數據集進行多標簽標記,然后將訓練數據集作為多標簽分類的訓練數據集進行分類并用測試數據集對分類結果進行定量分析,分析結果如表5所示。

表5 良性和惡性乳腺病變形態特征的比較

2)增強后病灶范圍提取

由于增強后病灶范圍的特征描述的是通過造影(超聲增強)后的圖像病灶范圍的大小相比于普通超聲圖像中的病灶范圍的變化情況。因此單獨使用超聲圖像或造影圖像都不能得出針對該病理特征的正確結論。同時,有相關研究發現,增強后病灶范圍擴大特征與惡性病灶的相關性更高[15]。因此,本文同時使用到了病灶定位和病灶區分割技術。病灶區分割技術采用Mask-RCNN[16]。首先分別輸入超聲圖片和其對應的造影圖片,使用病灶區定位及分割技術,確定病灶范圍;然后分別通過分割結果(結節形狀掩碼)進行計算;最后對計算出的超聲病灶范圍和其對應的造影病灶范圍進行判斷,確定病灶區范圍(擴大/縮小/不變)。

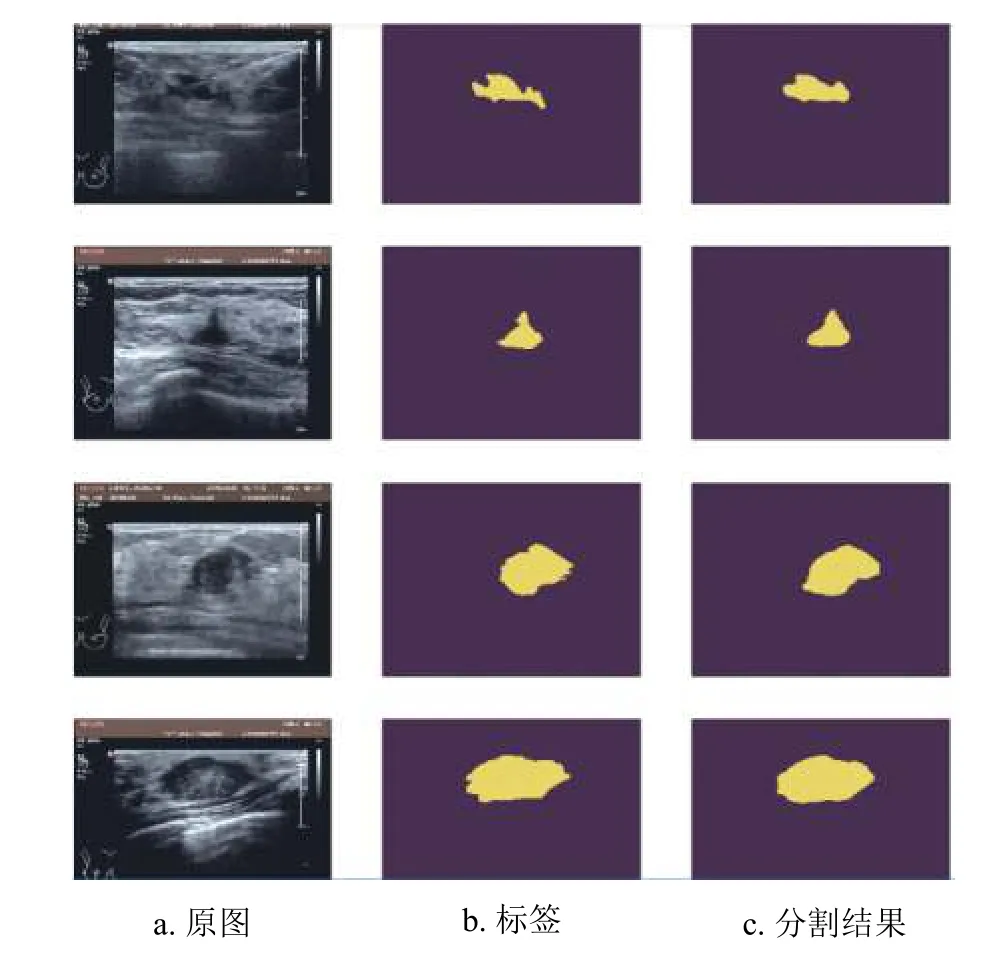

病灶區分割結果如圖4 所示,其中第一列為原始圖像,第二列為實際病灶區掩碼,即標簽,第三列為分割結果。

圖4 病灶區分割結果示例

3)增強強度及增強時相后的病理特征提取

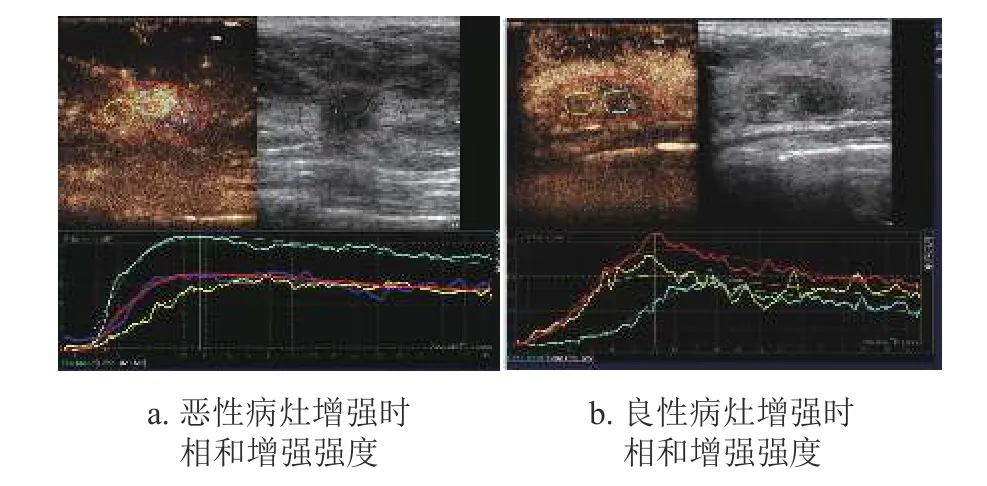

增強強度和增強時相這兩個病灶特征是通過分析造影視頻得出的。增強強度是指病灶區相對于其他正常區域達到最亮的峰值高低,而增強時相則表征病灶區相對于其他正常區域增強的快慢。如圖5 所示,該圖為某醫院的設備中,將造影視頻的亮暗信息進行分析后所繪制的波形圖。其中圖5a 中的惡性病灶顯示出增強時相快進、高增強的特征,而圖5b 中的良性病灶顯示出增強時相慢進、低增強的特征。

針對這兩個病灶特征的提取流程為:首先,分析整個視頻的病灶區域并記錄下病灶區平均亮度的最大值p 和到達該值時的時間值t,然后通過斜率k 和峰值p 的經驗閾值對其進行判斷分析。

k 值的計算方式為:

圖5 增強時相和增強強度示例圖

圖5a 中的病灶區的平均亮度最大值為15.63,到達該值的時間為12.33 s,通過式(12)得到k值為1.27[17]。由于不同的醫生可能存在不同的經驗閾值,針對本文實驗的數據,設定經驗閾值為0.74。

對于增強強度及增強時相后的病理特征,采用醫生的經驗值作為算法的經驗閾值。該經驗值即為:將病灶區域與病灶周圍的其他正常區域(兩個區域的組織結構盡可能保持一致,且區域范圍由醫生標注)相比較。根據良惡性腫瘤的一般特性,如果病灶區域的增強時相比正常區域更快,且其增強強度更高則其病灶為惡性的概率則更大,反之亦然。另外,為了盡量減少非相關變量對結果的影響,算法還對該區域進行了歸一化操作(結果除以該區域的面積)。根據該經驗閾值進行計算后的準確率結果分析顯示在表5 中。

2.4 異構多分支超聲圖像識別網絡

調研發現,目前已有的針對超聲圖片良惡性診斷的研究仍然存在以下局限性:

1)現有的大多數研究僅基于乳腺超聲圖像,因此獲得的結果很大程度上依賴于輸入圖像的質量。本文提出的方法將超聲圖像與相應的造影圖像相結合,增加了乳腺病變的信息量,為神經網絡的特征提取提供了更豐富的信息。

2)目前所做研究大多數都沒有使用醫生的經驗信息,例如病人或病灶的描述信息等。本文提出的方法以醫學專業知識為基礎,將臨床上針對良惡性判別最有效的病理特征提取到網絡中,進一步提高了分類的準確性。

針對目前研究工作的不足,本文提出了一種端到端的乳腺超聲自動結節分類模型。該模型用于乳腺超聲圖像的良性和惡性分類的異構多分支網絡。該網絡通過將醫學知識作為非圖像信息,和經過數據預處理的超聲圖像信息一起輸入異構多分支網絡,提高了乳腺超聲診斷的準確率。

本文實驗所采取的技術路線如圖6 所示。

圖6 異構多分支超聲良惡性分類實驗技術路線圖

分類步驟分為3 步:1) HMBN 網絡采用ResNet作為主干網,其中,兩個分支采用Rsenet50 用于提取超聲圖像和造影圖像的特征。即將大小為224×224 的超聲圖片和造影圖片通過網絡中步長為2、大小為3×3 的卷積核和全局平均池化層操作,得到7×7 的特征圖以及具有Softmax 的全連接的分類層。為了避免瓶頸,當特征圖的空間大小變化時,特征的數量將增加一倍。每次卷積后,應用batch 歸一化和ReLU 函數。

2) 對于單獨的用于處理非圖像信息的分支,使用一個全連接層將非圖像信息(包含患者的年齡和病灶的病理特征(如表5 中6 項造影病理信息所示))所構成的特征矢量的長度從7 轉換到2 048。對于用于提取圖像特征的分支,使用在ImageNet數據集上預訓練得到的模型,在模型輸出時去掉最后一個卷積層,得到長度為2 048 的特征向量。

3) 通過相加運算和一個全連接層對3 個異構網絡的分支結果進行融合,使用本文提出的MHE 和AMM 的融合損失函數得到最終的診斷分類結果。

3 實驗結果分析

3.1 數據集介紹

本文實驗所用的數據集來源于四川省的若干個醫療機構,由各醫療機構的超聲科采集的乳腺超聲科室提供。原始的乳腺超聲數據集中包含3 種不同格式的視頻文件,其中每個視頻文件分別包含超聲圖像和相應的造影文件,以及與超聲造影視頻文件相對應的乳腺詳細病理報告。不同醫院所用設備不同,因此所采集的圖像的分辨率和噪聲情況等都略有不同。

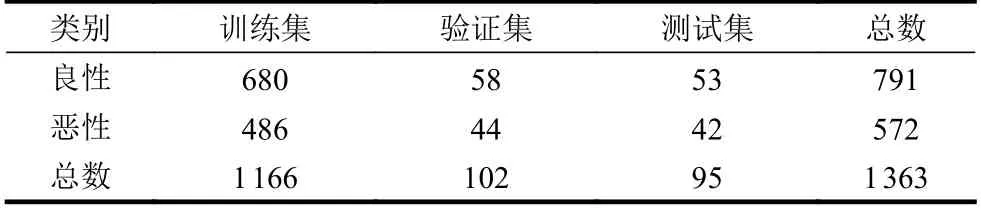

綜上所述,本實驗所用乳腺超聲數據集包含791 例良性病例和572 例惡性病例,每個病例通過視頻關鍵幀提取技術抽取了包含100~200 張超聲圖像和相應的造影圖像和與其對應的病理報告。然后將數據集分為3 個獨立的數據集,分別是包含1 166個樣本集的訓練集、包含102 個樣本集的驗證集和包含95 個樣本集的測試集。其分配比例基本按照10∶1∶1 的關系進行隨機抽取。表6 中顯示了該數據集的詳細信息。

表6 乳腺超聲病例數據集

其中,該數據集的病理報告組成有:研究中心基本情況、病灶基本資料(如為多發病灶等)——灰階超聲、患者基本資料(包含患者年齡、性別、民族、身高及體重等)、CEUS、超聲造影增強模式定性數據、乳腺鉬靶、MRI、穿刺活檢病理、術后病理、隨訪內容、其他情況。

3.2 病理信息提取結果

為選取最適合乳腺超聲數據病理信息提取的多標簽分類的網絡模型,本文基于乳腺超聲數據集分別對CNN-RNN 多標簽分類技術[18]、GCN 多標簽分類技術[19]及VGG16 多標簽分類技術[20]進行多標簽提取的實驗。為了驗證本文所設計的基于造影視頻的增強強度和增強時相特征的提取,以及基于乳腺超聲圖片和其對應的造影圖片的增強后病灶范圍特征提取的有效性,分別做了準確率的驗證實驗。本將主要針對基于多標簽分類的病理提取技術的實驗結果和其他病理信息的提取實驗結果進行比較和分析。

1)基于多標簽分類的病理提取技術實驗

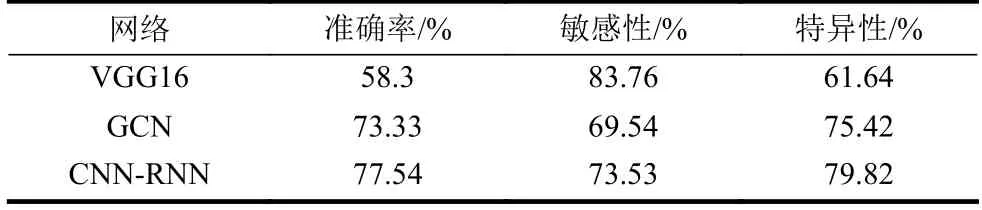

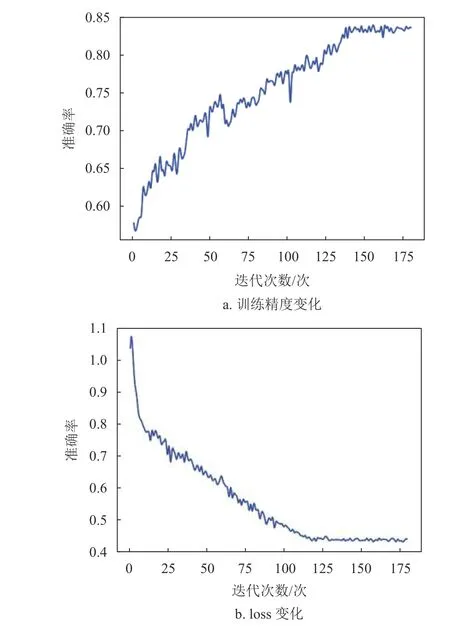

為了提取乳腺超聲圖片中的病理特征(增強均勻性、蟹足征、滋養血管、增強后邊界和增強后形態),綜合考慮算法時間復雜度、準確率、發表時間等因素分別篩選出3 個網絡進行多標簽分類的訓練和測試實驗:CNN-RNN 網絡,GCN 網絡和VGG16網絡。這3 種網絡下的分類實驗結果如表7 所示。表中顯示了多個標簽累計分類結果的準確率、敏感性及特異性。

表7 多標簽分類網絡病理信息提取實驗結果

由表7 可知,CNN-RNN 網絡、基于GCN 的網絡及VGG16 這3 種網絡的準確率都有待提高,其中表現最佳的是CNN-RNN 網絡。為了驗證從超聲圖片中提取的病理信息可以有效提升分類的準確率,將通過上述3 種網絡提取的結果輸入到只包含超聲圖片和造影圖片的HMBN 二分支網絡中,進行分類結果的對比,其實驗結果如表8所示。

表8 不同多標簽分類網絡結果對HMBN 良惡性分類結果的影響

由表8 可知,由于VGG16 網絡所提取的病理特征在良惡性分類時的準確率較低,無法對分類效果進行改善,甚至對網絡有反向的抑制作用。而基于GCN 的網絡和基于CNN-RNN 的方法在加入HMBN 的二分支網絡后,準確率有了明顯提升,而CNN-RNN+二分支網絡的分類準確率最高,達到83.24%。因此,本文后續實驗選用CNN-RNN網絡對超聲圖片內的病灶特征進行提取。

2)其他病理信息提取技術實驗

其他病理信息提取涉及增強后病灶范圍(enhanced lesion range, ELR)、增強時相(enhanced phase, EP)及增強強度(enhanced strength, ES)這3個病理特征的提取。考慮到在醫院的數據分析儀器中,增強強度和增強時相的定義與造影圖片亮度值變化曲線的峰值和斜率相關,因此本文認為利用該定義進行特征提取可以獲得很好的效果,如表9所示。

表9 其他病理信息提取結果

為了驗證該方法提取到的增強后病灶范圍、增強時相及增強強度這3 個特征對多分支網絡進行乳腺良惡性分類結果的影響,分別在訓練集和測試集上做了訓練和測試,其中包含兩個方面的實驗:1) 提取得到的增強后病灶范圍、增強時相及增強強度這3 個特征相對于二分支網絡的作用;2) 結合CNNRNN 網絡所提取的其他病理特征和這3 個特征共同作用下相對于二分支網絡的分類作用,實驗結果如表10 所示。

表10 提取的病理特征對二分支網絡良惡性分類的影響

從表10 可以看出,利用本文設計的其他病理信息提取技術提取的增強后病灶范圍、增強時相及增強強度這3 個特征對網絡具有積極改善的作用,且將其與利用CNN-RNN 網絡所提取的超聲圖片中的特征相結合后,對異構多分支網絡中良惡性腫瘤的的識別性能有明顯改善。但是其84.7%的分類準確率相較于表1 中采用HMBN 網絡得到的92.41%的準確率仍有很大的改進空間。

3.3 實驗分析

3.3.1 HMBN 實驗過程

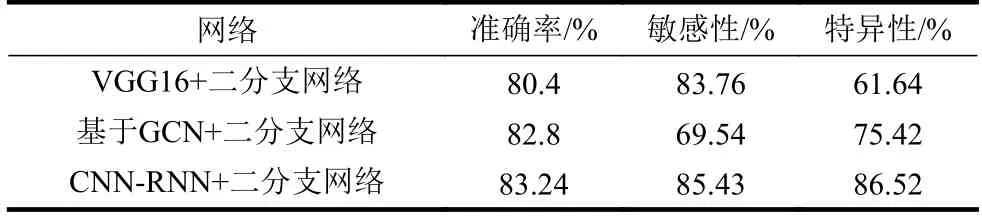

針對超聲圖像分支,輸入圖像大小為224×224,當Resnet50 網絡在con2_x 提取圖像特征時,卷積核為3×3,輸入的特征圖大小為56×56×64,輸出的特征圖大小為28×28×128,其過程如圖7 所示。

圖7 超聲分支網絡特征提取圖

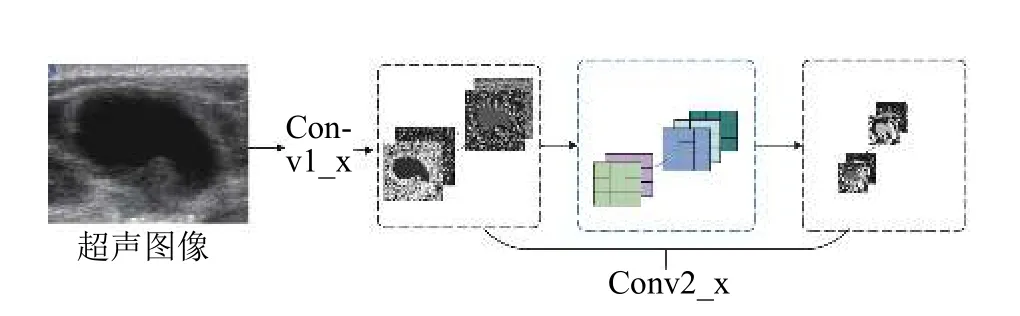

在訓練過程中,每一個epoch 中取出其中3 個階段的精確值和損失函數的值,得到訓練精度變化曲線和loos 變化曲線,如圖8 所示。從圖中可以看出在第125 個epoch 左右收斂。

圖8 訓練精確度和loss 變化情況

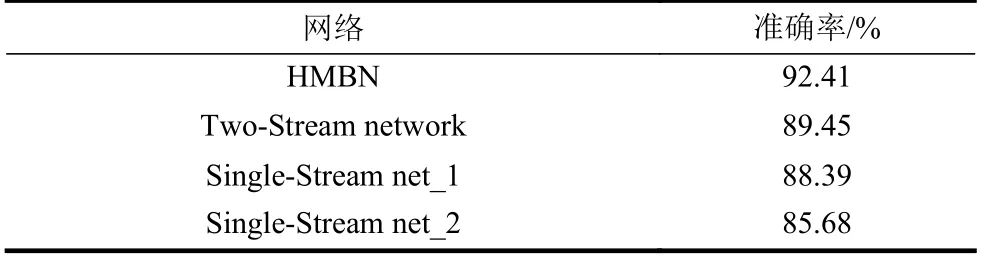

3.3.2 不同數目分支分類效果對比實驗

為了驗證本文提出的異構多分支網絡的有效性,分別對以下4 個不同結構的網絡進行實驗并進行比較和分析:

1) Single-Stream net_1,即僅使用一個ResNet-50 網絡。它的輸入圖像是通過超聲圖像及其對應的對比度增強超聲圖像的拼接形成的;

2) Single-Stream net_2,其主干網絡結構與Single-stream net_1 的網絡相同,但該網絡的輸入圖像僅是超聲圖像;

3) Two-Stream network,該網絡的主干網絡是ResNet50,它是具有兩個單獨的圖片特征提取網絡的雙流網絡,可同時處理超聲圖像和其相應的造影圖像,但是沒有添加處理非圖像的病理特征的分支網絡。

4) HMBN 網絡,即本文提出的網絡,是同時使用圖像特征和非圖像特征的異構多分支網絡。

這4 個網絡的對比實驗結果如表11 所示。

表11 不同網絡結構準確率比較

從實驗結果可以看出,同時使用了超聲圖像、造影圖像和非圖像信息的病理特征的HMBN 網絡的識別準確率最高,達到92.41%。證明造影圖像和非圖像的病理特征對提高乳腺超聲診斷的準確性具有積極的作用。

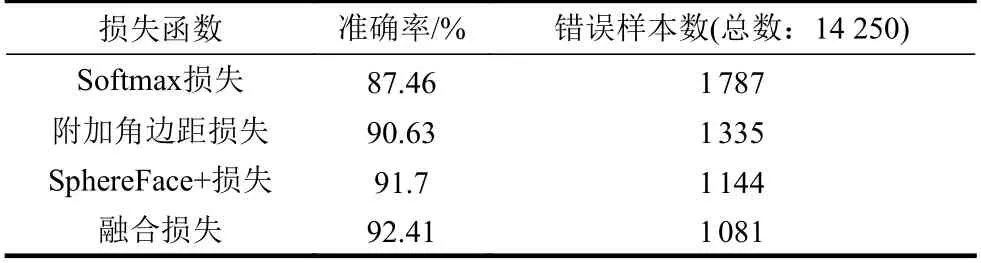

3.3.3 損失函數對比實驗

為了驗證本文設計的融合損失函數對乳腺超聲診斷的異構多分支網絡的有效性,進行了多組比較實驗。首先,將廣泛使用的原始Softmax 損失函數用作參考實驗,然后將附加角邊距損失函數作為第一組對比實驗,將SphereFace +損失函數作為第二組對比實驗,而將本文設計的融合損失函數作為第三組對比實驗。最終的實驗結果如表12 所示。

表12 不同損失函數分類效果比較

從表12 可以看出,本文所提出的融合損失函數具有最佳的表現,其測試集的準確率達到92.41%。

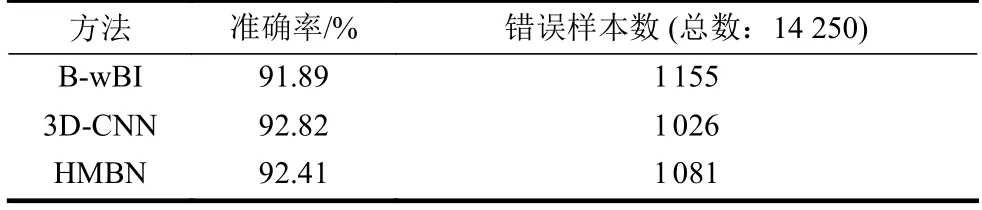

3.3.4 與其他方法的對比實驗

目前針對乳腺超聲圖像良惡性分類效果最好的方法有兩種:1) 基于加權BI-RADS 的B-wBI[21],該方法利用減少病理分級的方法解決分類中常見的分級失衡問題,進而提高診斷性能。其中經過加權訓練的RF 分類器用于對提取的特征進行分類;2)基于3D-CNN 的方法[22]。為了驗證本文提出的HMBN方法與其他方法的對比實驗效果,將上述3 種方法在數據集上進行了實驗,由于B-wBI 和3D-CNN兩種方法均未使用造影圖像、年齡以及病理信息等非圖像信息,因此實驗中僅將超聲圖像構造為以上兩種方法的訓練和測試數據集。實驗結果如表13所示。

表13 HMBN 與最新技術分類準確性的比較

在準確性方面,HMBN 的準確性比B-wBI 方法提高了0.52%,但略低于3D-CNN。原因在于3D-CNN 直接處理視頻,考慮了超聲視頻中時間維度信息,而HMBN 方法在融合病理信息時雖然也引入了與時間相關的增強強度和增強時相等病理特征,但是并不能將時間維度上的信息完全利用,所以導致HMBN 的分類準確率略低于3D-CNN。但是3D-CNN 對圖像質量要求較高,目前符合其要求的醫學超聲圖像并不多,而HMBN 由于采取了前期的數據預處理,更適合現有的數據集,具有更好的普遍適用性。

4 結 束 語

本文的工作主要分為3 點:1) 通過對乳腺超聲圖像去噪和圖像增強操作在一定程度上改善了超聲圖像的質量;2) 提出了一種異構多分支網絡,將3 個針對良惡性診斷相關度較高的信息(即超聲圖像、造影圖像和包括患者年齡的非圖像信息)和其他6 個病理信息結合在一起進行乳腺超聲影像的良惡性分類的網絡模型;3) 基于最小超球面能量和附加角邊距損失的融合提出了一種新的損失函數。實驗結果表明,上述工作對于提升乳腺良惡性分類的性能和準確率都有積極的效果,其最終識別準確率在目前最新的分類算法中名列前茅。