基于深度學(xué)習的圖像去噪方法研究綜述

劉 迪,賈金露,趙玉卿,錢育蓉,3

1.新疆大學(xué) 軟件學(xué)院,烏魯木齊 830046

2.新疆維吾爾自治區(qū)信號檢測與處理重點實驗室,烏魯木齊 830046

3.新疆大學(xué) 軟件工程重點實驗室,烏魯木齊 830046

圖像的去噪研究是計算機視覺領(lǐng)域的重要組成部分。近年來,基于深度學(xué)習(Deep Learning)的去噪方法被成功應(yīng)用于合成噪聲,但對真實噪聲的泛化性能較差[1-4]。

真實噪聲是指由拍照設(shè)備在照明條件差、相機抖動、物體運動、空間像素不對準、顏色亮度不匹配等情況下獲取的圖像中存在的噪聲,具有噪聲水平未知、噪聲類型多樣、噪聲分布復(fù)雜且難以參數(shù)化等特點。而合成噪聲是指噪聲類型符合某種概率分布,且噪聲水平可自主設(shè)定,如高斯噪聲、椒鹽噪聲、斑點噪聲等[5]。目前,圖像去噪方法已廣泛應(yīng)用于遙感圖像處理、醫(yī)學(xué)影像分析、人臉和指紋識別等諸多領(lǐng)域[6]。

圖像去噪方法主要分為:基于人工特征的傳統(tǒng)去噪方法和基于深度學(xué)習的去噪方法[7-8]。基于人工特征的傳統(tǒng)圖像去噪方法使用離散余弦變換[9]、小波變換[10]等修改變換系數(shù),用平均鄰域值[11]計算局部相似性。NLM[12]方法和BM3D[13]方法利用自相似補丁在圖像保真度和視覺質(zhì)量上取得突出效果。基于這兩種方法,許多變體方法如SADCT[14]、SAPCA[15]、NLB[16]等方法被提出,這些方法在不同的變換域中尋找自相似補片來補全更多的邊緣信息。由于傳統(tǒng)去噪方法對圖像特征的編碼依賴于原始圖像的假設(shè),編碼特征在真實圖像中匹配度較低,降低了方法在實際應(yīng)用中的性能和靈活性,且方法的特征提取過程繁瑣、費時、計算量大,不適用于處理具有復(fù)雜分布的真實噪聲。

相對于傳統(tǒng)圖像去噪方法,基于深度學(xué)習的圖像去噪方法具有強大的學(xué)習能力,不僅可以擬合復(fù)雜噪聲分布,還節(jié)省了計算時間。早期深度學(xué)習圖像去噪方法使用強化學(xué)習技術(shù),如政策梯度(Policy Gradients)[17]和Q-學(xué)習(Q-learning)[18]訓(xùn)練遞歸神經(jīng)網(wǎng)絡(luò)。但基于強化學(xué)習的方法計算量大,搜索效率低。深度學(xué)習去噪方法結(jié)合跳躍連接(Skip-connect)、注意力機制(Attention)、多尺度(Multi-scale)特征融合等方式提高網(wǎng)絡(luò)特征表達能力。但這些方法的網(wǎng)絡(luò)結(jié)構(gòu)較深,容易在訓(xùn)練過程中出現(xiàn)梯度爆炸或彌散問題。近年來,一些采用遷移學(xué)習(Transfer Learning)[19]和模型壓縮思想的去噪方法,如AINDNet[20]和MPI_DA_CNN[21]把已經(jīng)訓(xùn)練好的參數(shù)轉(zhuǎn)移到新的輕量模型上,從而加快并優(yōu)化學(xué)習效率,有效避免梯度問題的出現(xiàn)。此外,基于圖神經(jīng)網(wǎng)絡(luò)(GNN)的去噪方法,如GCDN[22]和GRDN[23]等,依據(jù)圖網(wǎng)絡(luò)的拓撲結(jié)構(gòu)在處理非結(jié)構(gòu)化數(shù)據(jù)方面,展現(xiàn)出很好的優(yōu)勢。

本文針對目前基于深度學(xué)習的圖像去噪方法進行總結(jié)和歸納。對圖像的去噪流程進行概述;以深度學(xué)習基礎(chǔ)網(wǎng)絡(luò)為分類標準,對近年來圖像去噪方法進行較為系統(tǒng)、全面的研究和介紹,并對不同方法的優(yōu)點、局限性及適用場景等進行對比和總結(jié);對圖像去噪方法常用的數(shù)據(jù)集、方法性能評價指標進行介紹;對同一數(shù)據(jù)集上不同方法的實驗結(jié)果進行對比分析;最后對圖像去噪方法目前存在的主要問題及未來研究的方向進行討論。

1 圖像去噪概述

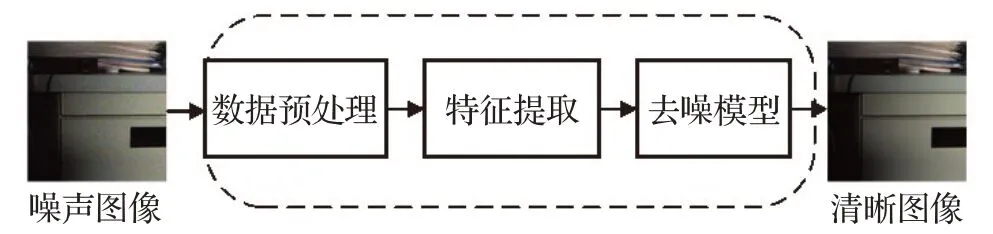

由于受到電子設(shè)備自身的限制和外界環(huán)境的影響,圖像中常存在多種不同類型的噪聲,如高斯噪聲、泊松噪聲、椒鹽噪聲和斑點噪聲等[24],且不同類型噪聲的頻率和空間特性存在差異性。高效的提取和精準的噪聲水平估計是設(shè)計合理去噪網(wǎng)絡(luò)結(jié)構(gòu)的前提。圖像去噪的研究內(nèi)容包括數(shù)據(jù)預(yù)處理、特征提取和去噪三部分,如圖1所示。

圖1 圖像去噪流程圖

(1)數(shù)據(jù)預(yù)處理。在去噪實驗之前,獲取的數(shù)據(jù)集中常包含一些不可用數(shù)據(jù),如圖像格式不符,像素過高、亮度過低以及一些重復(fù)數(shù)據(jù)等。因此,需要采用圖像格式轉(zhuǎn)換、幾何校正、主成分分析等預(yù)處理操作為后續(xù)的去噪模型提供更多可用數(shù)據(jù)。

(2)特征提取。通過卷積池化等方式提取圖像紋理細節(jié)特征,并將噪聲與背景信息分離。常用特征提取方法有尺度不變特征變換(SIFT)[25]、方向梯度直方圖(HOG)[26]和FAST 角點檢測[27]等。通過提取到的噪聲塊兒,可以對噪聲水平的高低做出初步估計,精準的噪聲水平估計是設(shè)計合理去噪網(wǎng)絡(luò)結(jié)構(gòu)的前提。常用方法有遞歸平均[28]、最小值跟蹤[29]和直方圖噪聲估計[30]等。

(3)去噪模型。圖像去噪方法主要聚焦于去噪模型的設(shè)計和選擇。相對于傳統(tǒng)方法,基于深度學(xué)習的圖像去噪方法可以自主快速地提取淺層像素級特征和深層語義級特征,具有強大的表示學(xué)習能力和良好的去噪效果。而傳統(tǒng)基于模型的去噪方法提取的信息量較少,無法準確擬合噪聲分布,去噪效果不甚理想。

2 基于深度學(xué)習的圖像去噪方法

2.1 基于卷積神經(jīng)網(wǎng)絡(luò)的去噪方法

卷積神經(jīng)網(wǎng)絡(luò)(CNN)是深度學(xué)習的基礎(chǔ)網(wǎng)絡(luò),通過不斷優(yōu)化網(wǎng)絡(luò)結(jié)構(gòu)提升特征表達能力。如VGGNet[31]采用多個3×3卷積核堆疊的方式擴大感受野,加快訓(xùn)練收斂速度;GoogLeNet[32]構(gòu)建基于Inception的模塊化網(wǎng)絡(luò),方便添加和修改網(wǎng)絡(luò)結(jié)構(gòu),并使用平均池化代替全連接,在訓(xùn)練速度和網(wǎng)絡(luò)性能上有很大提升。

2.1.1 自監(jiān)督學(xué)習去噪

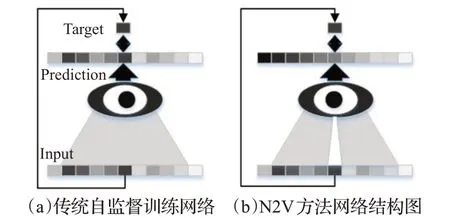

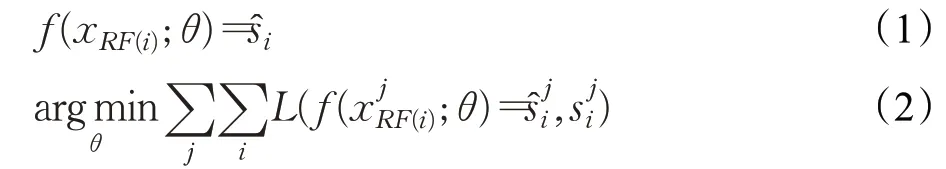

目前,基于CNN的圖像去噪方法主要包括自監(jiān)督學(xué)習和監(jiān)督學(xué)習。如N2N[33]、N2V[34]、N2S[35]、S2S[36]以及VDN[37]等去噪方法利用像素之間的獨立性,以自監(jiān)督訓(xùn)練方式尋找目標像素與輸入像素之間的映射關(guān)系,從而實現(xiàn)去噪任務(wù)。圖2表示的是N2V方法與傳統(tǒng)自監(jiān)督訓(xùn)練模型的網(wǎng)絡(luò)對比圖,其去噪過程可以用公式(1)和(2)來描述。

圖2 自監(jiān)督網(wǎng)絡(luò)結(jié)構(gòu)對比圖

其中,公式(1)表示的是將CNN看作一個函數(shù),以像素i的感受野RF(i)作為輸入,并輸出目標中心域的預(yù)測值;θ 表示CNN 的訓(xùn)練參數(shù)。公式(2)表示的是通過訓(xùn)練調(diào)整參數(shù)θ,以最小化成對訓(xùn)練數(shù)據(jù)(?,sij)之間的損失,L 代表損失函數(shù),表示的是對應(yīng)目標像素的值。

自監(jiān)督方式忽視了空間信息之間的依賴關(guān)系,提取的特征對噪聲的表達能力不足,且網(wǎng)絡(luò)訓(xùn)練參數(shù)的調(diào)整方式缺乏靈活性,不能很好地表示含噪圖像到清晰圖像之間的復(fù)雜映射關(guān)系。

2.1.2 監(jiān)督學(xué)習去噪

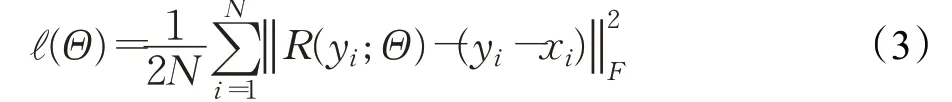

基于監(jiān)督學(xué)習的圖像去噪方法,如DnCNN-B[38]、FFDNet[39]和CBDNet[40]利用高斯混合模型對多種不同噪聲水平的樣本圖像進行訓(xùn)練,并在真實噪聲圖像上驗證以上方法的去噪效果。通常,用x=y ?R(y)表示恢復(fù)出的清晰圖,y 為輸入的噪聲圖,R(y)表示預(yù)測的噪聲,其去噪方法使用的損失函數(shù)如公式(3)所示:

其中,Θ 表示的是網(wǎng)絡(luò)訓(xùn)練的參數(shù),{(yi,xi)}Ni=1 表示的是N 個成對訓(xùn)練樣本。通過網(wǎng)絡(luò)的訓(xùn)練,提取噪聲分布R(y),并與原始輸入的噪聲圖像做差值運算,實現(xiàn)去噪任務(wù)。

上述方法存在一個共同的問題,即對訓(xùn)練域外的噪聲圖像適應(yīng)性差。專家混合法(MoE)[41]對這一問題提供了很好的解決思路,給數(shù)據(jù)集中的每個代表性領(lǐng)域培訓(xùn)一名專家,對數(shù)據(jù)的可用性進行評估和分類,并通過無監(jiān)督的聚類方法最小化MoE 損失,有效解決去噪方法對訓(xùn)練域外的數(shù)據(jù)適應(yīng)性差的難題,大大提高網(wǎng)絡(luò)的魯棒性和泛化能力。

基于CNN的圖像去噪方法主要集中于卷積層對特征信息的提取和對網(wǎng)絡(luò)結(jié)構(gòu)的優(yōu)化,但同時也存在一定的局限性,主要體現(xiàn)在以下兩方面:一方面,單一的卷積神經(jīng)網(wǎng)絡(luò)沒有記憶功能,淺層像素級信息在池化過程中會大量丟失,導(dǎo)致去噪后的圖像仍帶有殘留噪聲;另一方面,增加卷積層數(shù)量來提升特征表達能力的同時也帶來了參數(shù)量增加、計算量加大和時間消耗多等問題,且網(wǎng)絡(luò)更加復(fù)雜,訓(xùn)練難度增加。

2.2 基于殘差網(wǎng)絡(luò)的去噪方法

CNN中淺層網(wǎng)絡(luò)可以獲取像素級特征,深層網(wǎng)絡(luò)獲取的更多是語義特征。語義信息在識別、分類等任務(wù)中非常重要,但對去噪、超分辨率等任務(wù)來說,淺層的像素級特征更為關(guān)鍵。因此,為充分利用淺層特征信息,許多基于殘差網(wǎng)絡(luò)(ResNet)的去噪方法被設(shè)計出來[42-43]。

其去噪思想可以用以下公式描述:如公式(4),f0表示的是卷積層對輸入噪聲圖像提取的初始特征,Me(·)表示的是卷積層的特征提取操作,并進一步對殘差分量上的特征進行學(xué)習;如公式(5),fr是學(xué)習的特征,Mfl(·)表示殘差學(xué)習;公式(6)的Mr(·)表示對學(xué)習到的殘差信息進行重構(gòu)操作,并輸出去噪后的圖像?。

Mei等人[44]通過分層提取方式充分利用淺層像素級特征,同時利用自相似性在像素特征和語義特征之間取得平衡,以保留更多圖像細節(jié)。Kim等人[23]為了增強深層網(wǎng)絡(luò)的訓(xùn)練效果,使用卷積注意力模塊(CBAM)[45]專注于學(xué)習噪聲圖像和清晰圖像之間的差異性,CBAM既考慮不同通道像素的重要性,又考慮了同一通道不同位置像素的重要性,相比于SENet只關(guān)注通道的注意力機制可以取得更好的效果。基于殘差網(wǎng)絡(luò)思想設(shè)計的去噪方法性能較好,但頻繁使用淺層信息也會使網(wǎng)絡(luò)容易出現(xiàn)過擬合現(xiàn)象。Cha等人[46]針對該問題利用數(shù)據(jù)增強和L2-SP(起點)正則化[47]方式自適應(yīng)微調(diào)網(wǎng)絡(luò)參數(shù),從而最大限度防止過擬合。

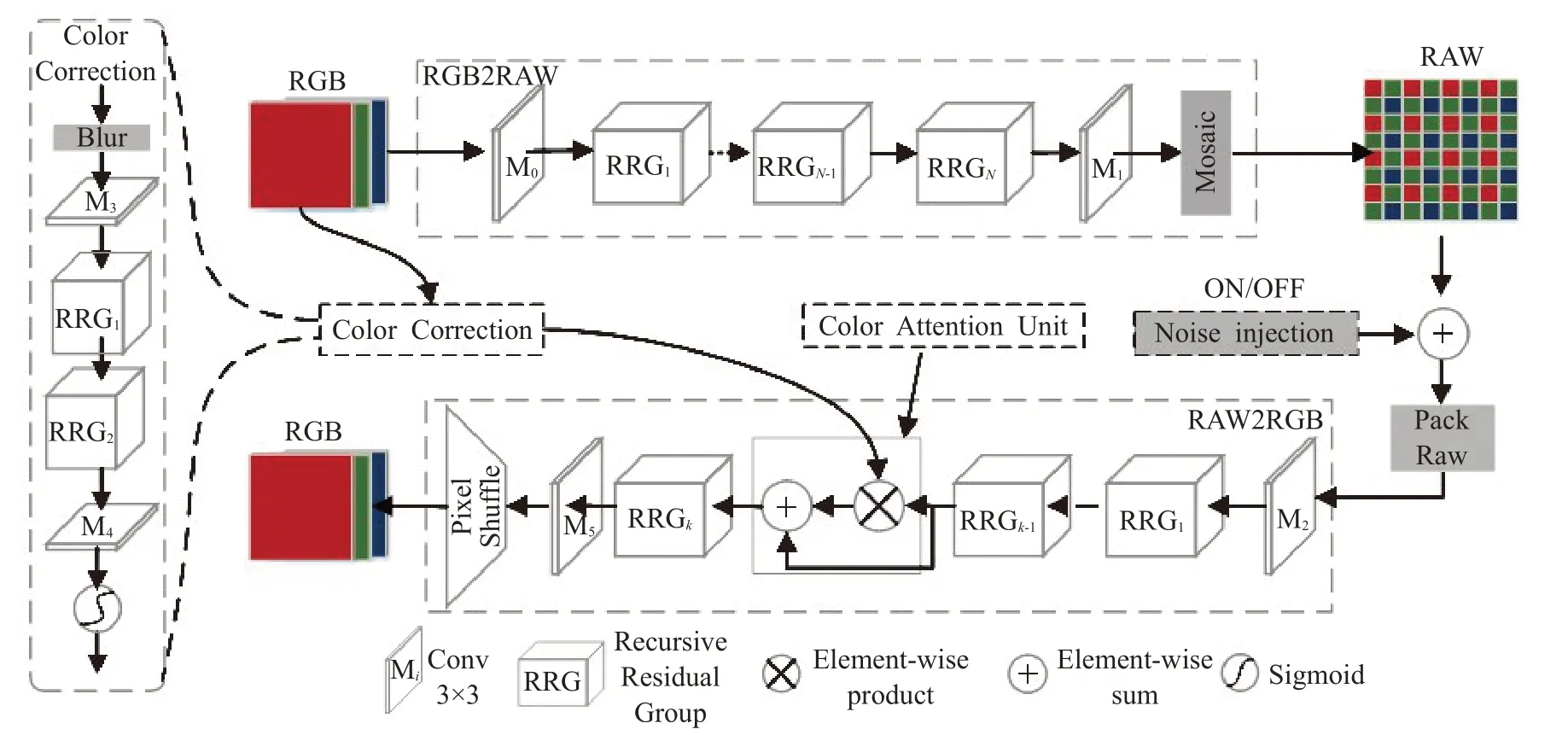

目前,圖像去噪方法常以普通RGB 圖像作為訓(xùn)練樣本,沒有考慮到傳感器設(shè)備自身在圖像信號處理(Image Signal Processor,ISP)過程對圖像質(zhì)量的影響,但RGB 圖像與成像設(shè)備獲取的原始RAW 圖之間始終存在偏差,導(dǎo)致噪聲建模方式不夠合理、準確。因此,Zamir 等人[48]設(shè)計循環(huán)鏡像轉(zhuǎn)換方法CycleISP,該方法包括兩個分支:RGB2RAW 和RAW2RGB,網(wǎng)絡(luò)結(jié)構(gòu)如圖3 所示。RGB2RAW 分支的任務(wù)是將RGB 彩色圖像轉(zhuǎn)換成原始成像設(shè)備拍攝的RAW 圖,Noise injectionk控制器負責給RAW 圖添加噪聲;RAW2RGB 分支的任務(wù)是將帶噪聲的RAW圖轉(zhuǎn)換成普通的RGB圖像,且圖中色彩校正單元(Color Correction)對提高樣本數(shù)據(jù)的真實性提供巨大幫助,該方法可以靈活合成更多真實噪聲成對訓(xùn)練樣本。

基于ResNet 的圖像去噪方法通過最大化信息流,實現(xiàn)長距離空間相關(guān)性的計算,具有相對較好特征表達能力,但這類方法存在的一個主要問題是:殘差連接的多次使用容易導(dǎo)致網(wǎng)絡(luò)出現(xiàn)過擬合的現(xiàn)象。

2.3 基于生成對抗網(wǎng)絡(luò)的去噪方法

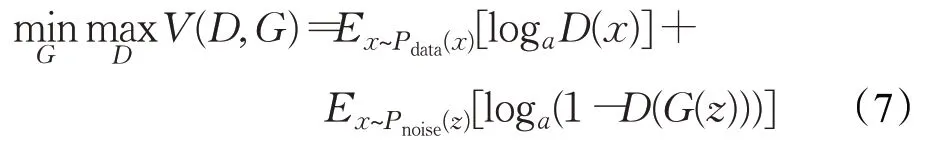

基于CNN和ResNet的去噪方法大多需要無噪聲的清晰圖像和有噪聲圖像作為成對訓(xùn)練樣本進行監(jiān)督學(xué)習。但在實際應(yīng)用中,成對訓(xùn)練樣本的獲取是一項難題。生成對抗網(wǎng)絡(luò)(GAN)因其具有很強的學(xué)習能力[49-50],通過對抗學(xué)習訓(xùn)練策略,可以得到逼真的噪聲圖,在一定程度上緩解了成對訓(xùn)練樣本不足的問題。生成對抗網(wǎng)絡(luò)在訓(xùn)練過程中需要計算生成器(G)和鑒別器(D)兩部分損失,目標函數(shù)如公式(7)所示:

圖3 CycleISP網(wǎng)絡(luò)結(jié)構(gòu)圖

其中,E(·)表示分布函數(shù)的期望值,Pdata(x)代表真實樣本的分布,Pnoise(z)表示低維噪聲分布,對數(shù)log 的底a的取值為大于1的常數(shù),大多數(shù)情況下為e。

Chen 等人[51]利用GAN 對真實噪聲圖像上提取的噪聲信息進行建模,并將生成器隨機產(chǎn)生的噪聲塊與原始清晰圖像一起合成新的噪聲圖像。SRGAN方法[52]和ADGAN 方法[53]也利用相同的思想構(gòu)造成對的訓(xùn)練數(shù)據(jù)。與GCBD不同的是,ADGAN方法在對噪聲建模時引入特征金字塔注意網(wǎng)絡(luò)提高網(wǎng)絡(luò)特征提取能力。與CycleISP 方法考慮的問題一樣,Isola 等人[49]針對傳感器對信號的損害問題提出解決辦法:從傳感器原始數(shù)據(jù)中選擇5 個不同頻率下的特征信息作為去噪網(wǎng)絡(luò)(Denoiser Network)的輸入,并減少對密集型濾波器的使用,降低了計算量,提升了計算效率。此外,該方法使用有監(jiān)督和無監(jiān)督相互結(jié)合的訓(xùn)練方式提升網(wǎng)絡(luò)的穩(wěn)健性和魯棒性。

基于GAN的圖像去噪方法通過生成器與判別器之間的對抗學(xué)習策略擬合數(shù)據(jù)分布,局限性主要體現(xiàn)在:一方面,生成模型的分布沒有顯示表達,可解釋性差;另一方面,生成器和鑒別器需要做到同步更新參數(shù),很難生成離散數(shù)據(jù),而且目前為止,達到納什均衡的方法還沒找到,網(wǎng)絡(luò)訓(xùn)練不夠穩(wěn)定。

2.4 基于圖神經(jīng)網(wǎng)絡(luò)的去噪方法

圖神經(jīng)網(wǎng)絡(luò)(GNN)適合處理非結(jié)構(gòu)化或比較復(fù)雜的數(shù)據(jù)。Valsesia等人[22]利用卷積算子設(shè)計基于圖形卷積(GCN)[54]的去噪方法GCDN,該方法通過引入邊緣注意力機制(Edge Attention)減少邊緣信息的丟失,并采用3×3、5×5 和7×7 大小的濾波器進行多尺度分層提取特征,提高對特征信息的利用率。

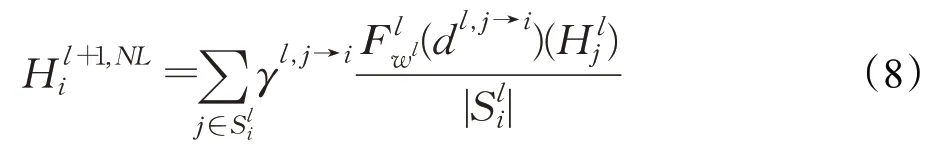

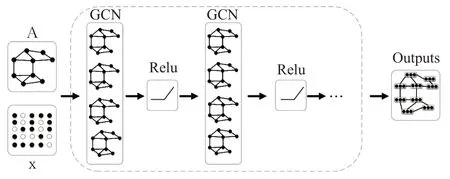

GNN 的圖形卷積(GCN)過程如圖4 所示,GCN 在構(gòu)造特征空間的K 近鄰圖的時候,對于每個像素i,需要計算其特征向量與搜索窗口內(nèi)像素的歐氏距離。在距離像素i 最小K 個像素之間通過邊緣條件卷積(ECC)聚合的方式繪制圖形,其非局部聚合的計算過程如公式(8)所示:

其中,F(xiàn)wll表示的是一個全連接網(wǎng)絡(luò),以邊標簽作為輸入,并輸出相應(yīng)的權(quán)重矩陣,wl表示網(wǎng)絡(luò)Fl的權(quán)重參數(shù),dl,j→i=Hlj-Hli表示邊緣標記函數(shù),常定義為兩個特征向量之間的差,Sli是節(jié)點i 的鄰域集,γl,j→i是邊緣注意項,Hl+1,NLi則表示對于節(jié)點i 的卷積層輸出。

圖4 GCN網(wǎng)絡(luò)結(jié)構(gòu)圖

GCN的網(wǎng)絡(luò)化拓撲結(jié)構(gòu)對密集噪聲分布具有很好的擬合效果,但因其拓撲結(jié)構(gòu)復(fù)雜、節(jié)點順序動態(tài)變化,導(dǎo)致訓(xùn)練結(jié)果不穩(wěn)定,且當數(shù)據(jù)類型單一時,容易過擬合。對圖網(wǎng)絡(luò)中的過擬合問題,Zeng等人[55]將圖拉普拉斯正則化(Graph Laplacian Regularization)集成到深度學(xué)習框架中,實現(xiàn)了去噪方法對訓(xùn)練域外數(shù)據(jù)的高度適應(yīng)性。Behjati 等人[56]則利用高維特征之間的相似不變性動態(tài)構(gòu)建具有復(fù)雜特征層次的鄰域圖去擬合噪聲分布,該方法在激光雷達掃描產(chǎn)生的結(jié)構(gòu)化噪聲上也展現(xiàn)了很好的魯棒性。

對于利用GNN的網(wǎng)絡(luò)化拓撲結(jié)構(gòu)擬合數(shù)據(jù)分布的去噪方法而言,其局限性體現(xiàn)在:不穩(wěn)定的動態(tài)拓撲結(jié)構(gòu)會降低特征的表達能力,對去噪性能產(chǎn)生負面影響;圖網(wǎng)絡(luò)不能像CNN 那樣分層提取局部和全局特征,對鄰域局部信息的利用率會受到拓撲結(jié)構(gòu)不穩(wěn)定性的直接影響。

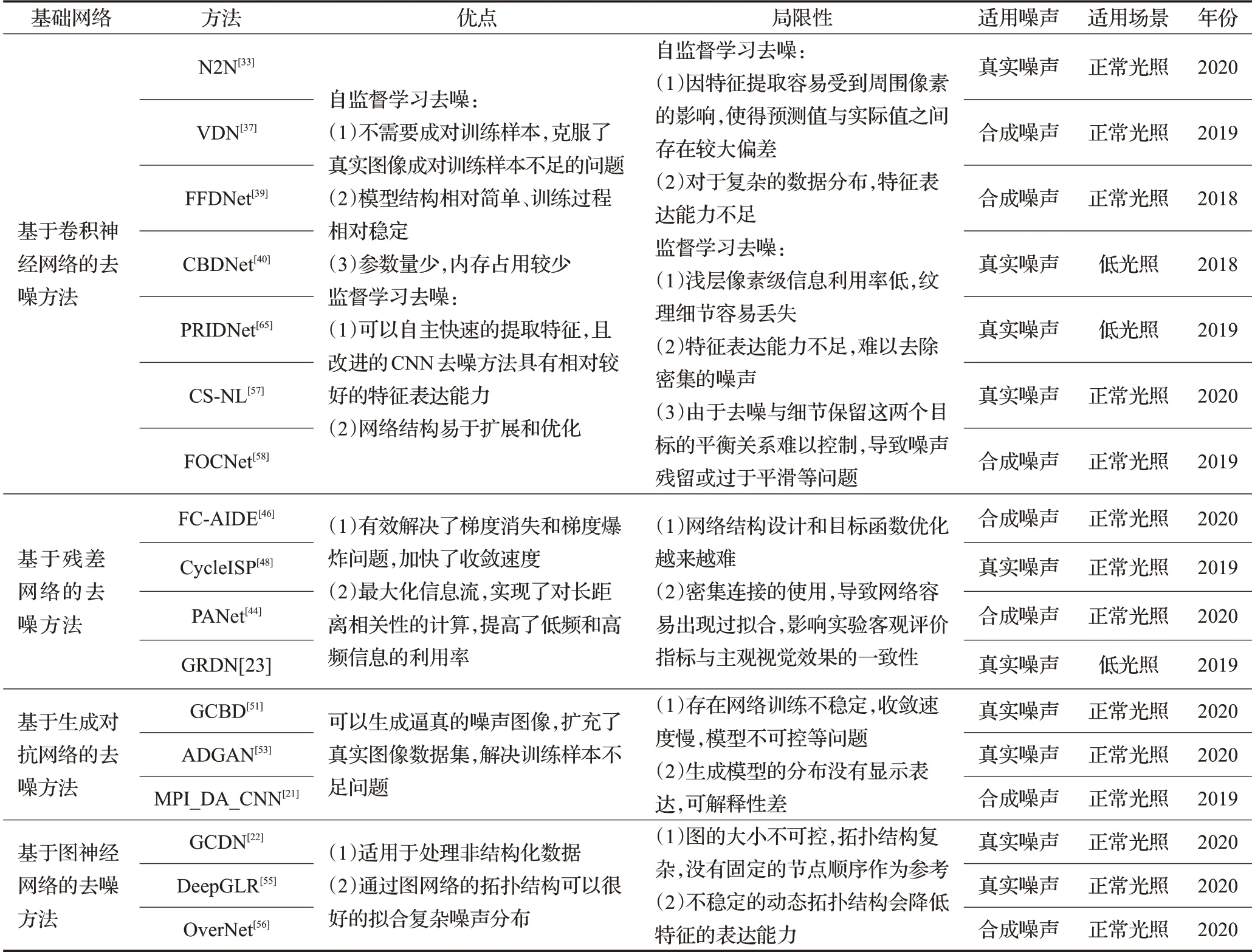

表1 從方法的優(yōu)點、局限性、適用噪聲和適用場景多個角度,對基于深度學(xué)習的圖像去噪方法進行詳細的總結(jié)和概括。

近年來,在CNN、ResNet 和GAN 網(wǎng)絡(luò)的基礎(chǔ)上一系列結(jié)合多尺度特征融合、遷移學(xué)習和雙任務(wù)的改進方法不斷涌現(xiàn)。

(1)結(jié)合多尺度特征融合的去噪方法

單一網(wǎng)絡(luò)結(jié)構(gòu)訓(xùn)練出的模型提取到的特征有限,不同尺度間的特征融合有利于提升噪聲的表達能力,且在特征融合時可以結(jié)合先驗信息,準確把握特征提取對象[57],多尺度融合的方式多種多樣,如Jia等人[58]通過求解分數(shù)最優(yōu)控制問題(FOC)和對分數(shù)階微分方程(FODE)進行顯式離散化構(gòu)造,增強網(wǎng)絡(luò)在前向傳播和反向傳播的過程中的長期記憶力。Liu等人[59]則設(shè)計密集連接的編解碼器將不同尺度的特征連接起來,充分利用上下文信息,且密集連接加深了網(wǎng)絡(luò),減少了梯度消失的問題。在此基礎(chǔ)上,Wang等人[60]引入自注意模塊(Self-Attention)獲取空間和通道間的依賴關(guān)系,既不增加參數(shù)量又不會降低信道維度,增強了特征融合對每個通道的適應(yīng)能力。此外,金字塔模式的去噪網(wǎng)絡(luò)[61],可以通過下采樣操作,實現(xiàn)對原始、局部和全局不同尺度范圍內(nèi)信息的融合。

(2)雙任務(wù)圖像去噪方法

圖像去噪需要平衡兩個互斥的目標,即去除噪聲和保留真實細節(jié)。如Wang 等人[62]提出的GAN 與CNN 相結(jié)合的雙任務(wù)去噪網(wǎng)絡(luò)。其中GAN 用于去除噪聲,CNN用于恢復(fù)原始圖像細節(jié),且兩個子網(wǎng)交替訓(xùn)練,通過自適應(yīng)調(diào)節(jié)參數(shù)保留更多細節(jié)并去除噪聲。不同于上述方法,Tian等人[63]采用重建思想,設(shè)計由4個模塊構(gòu)成的DudeNet,包括特征提取、增強、壓縮和重構(gòu)。數(shù)據(jù)增強提升了特征表達能力,數(shù)據(jù)壓縮有利于減少冗余信息,降低計算成本和減少內(nèi)存消耗。雙任務(wù)圖像去噪這類方法的顯著優(yōu)勢是能夠在互斥目標之間尋找平衡點,在解決平滑、模糊、偽影等問題上提供較大幫助。

表1 基于深度學(xué)習的圖像去噪方法對比總結(jié)

(3)遷移學(xué)習圖像去噪方法

對于圖像去噪問題,一方面因真實圖像數(shù)據(jù)集數(shù)量少、類型單一,不足以訓(xùn)練CNN,而CNN 也容易出現(xiàn)過擬合問題;另一方面,用高斯噪聲訓(xùn)練的CNN,因為過度擬合高斯分布,不能很好地適用真實含噪圖像。而遷移學(xué)習去噪方法不僅能以更快的速度收斂并獲得良好去噪性能,還可以通過自適應(yīng)調(diào)整參數(shù)方式節(jié)省大量內(nèi)存,如Kim 等人[20]提出的去噪網(wǎng)絡(luò)AINDNet,先從合成噪聲圖像中學(xué)習一般不變信息,再從連續(xù)小波域中學(xué)習真實圖像的特定領(lǐng)域信息,從而將去噪任務(wù)從合成噪聲轉(zhuǎn)移到真實噪聲,促進去噪方法性能的提升。

改進的圖像去噪方法在合成噪聲、真實噪聲上都取得了很好的去噪效果,但仍然存在一定的局限性,如網(wǎng)絡(luò)模型對真實噪聲擬合的準確率不足,難以去除密集分布噪聲;對遷移學(xué)習圖像去噪方法,網(wǎng)絡(luò)量化的性能會固有的受到全精度模型的限制;且在卷積特征提取的過程中,由于去噪任務(wù)和細節(jié)保留任務(wù)的平衡關(guān)系難以控制,許多噪聲會被網(wǎng)絡(luò)誤認為是圖像中的細節(jié),導(dǎo)致噪聲殘留、去噪效果不佳等。

綜上所述,基于不同網(wǎng)絡(luò)架構(gòu)設(shè)計的圖像去噪算法在處理去噪問題時側(cè)重點不同。基于CNN和ResNet的圖像去噪方法側(cè)重于通過最大化信息流,實現(xiàn)長距離相關(guān)性的計算,提升對高低頻信息的利用率和對噪聲的表達能力。基于GAN的圖像去噪方法則側(cè)重于擴充圖像數(shù)據(jù)集,通過增加訓(xùn)練樣本數(shù)量提升網(wǎng)絡(luò)去噪性能。這類方法的缺點如表1所示,主要受限性網(wǎng)絡(luò)本身的訓(xùn)練方式。而GNN 主要用于處理非結(jié)構(gòu)化數(shù)據(jù),由于真實噪聲分布復(fù)雜、類型多樣、難以參數(shù)化等特點,導(dǎo)致傳統(tǒng)卷積特征提取方式難以滿足實際應(yīng)用的需求,因而促進了GNN在圖像去噪任務(wù)中的應(yīng)用。但因圖網(wǎng)絡(luò)的拓撲結(jié)構(gòu)較為復(fù)雜、大小不可控等因素使得網(wǎng)絡(luò)訓(xùn)練效果不穩(wěn)定。因此,在研究圖像去噪任務(wù)時,需要根據(jù)當下圖像去噪領(lǐng)域存在的問題以及要解決的問題,有針對性的選擇基礎(chǔ)網(wǎng)絡(luò)。

3 數(shù)據(jù)集及評價指標

3.1 數(shù)據(jù)集

3.1.1 訓(xùn)練數(shù)據(jù)集

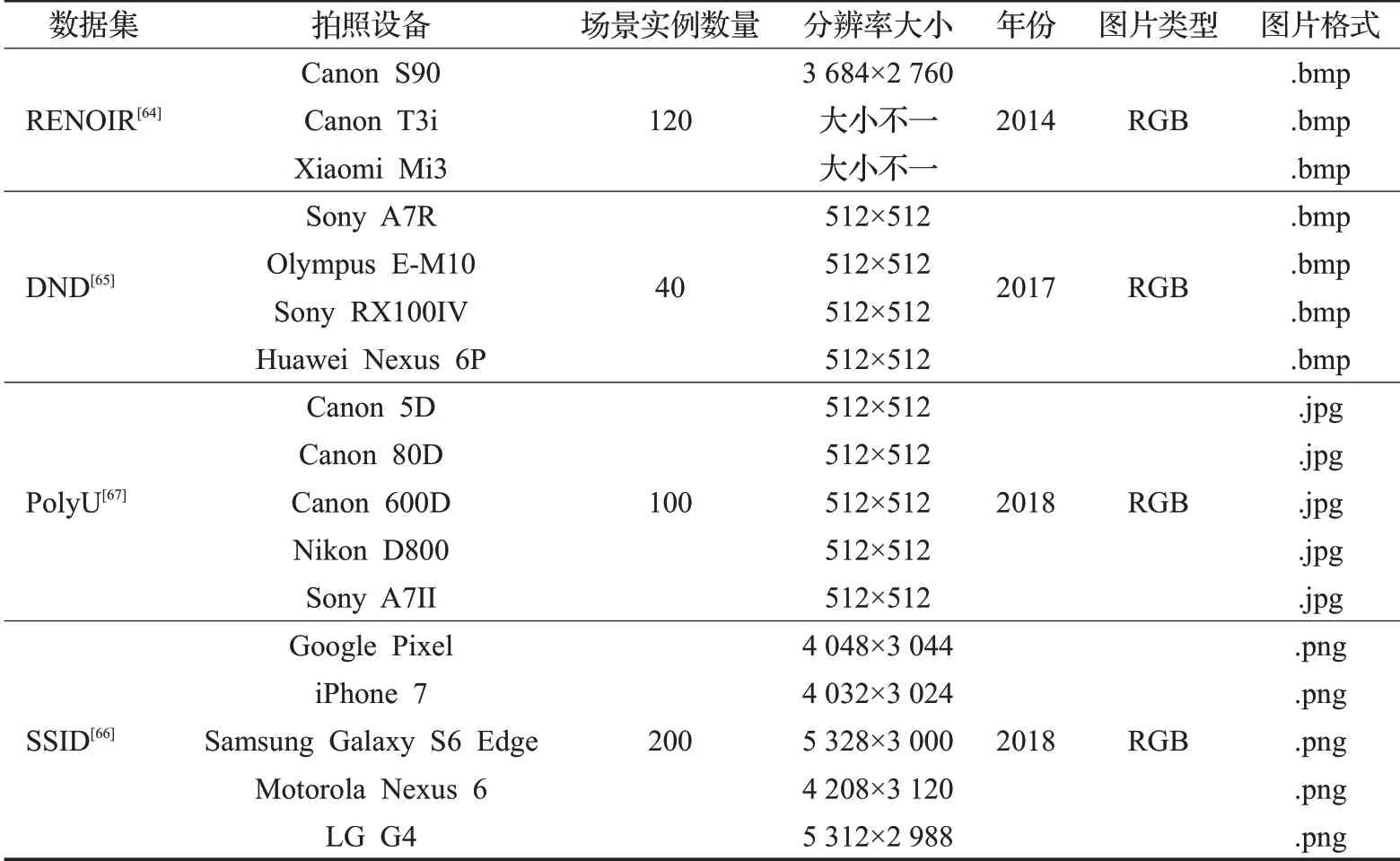

目前,真實圖像數(shù)據(jù)集的獲取方式主要分為三種:(1)在現(xiàn)有圖像數(shù)據(jù)集中選擇高質(zhì)量的清晰圖像,對其處理合成噪聲圖像;(2)針對同一場景,拍攝低ISO 作為清晰圖,拍攝高ISO 作為對應(yīng)噪聲圖;(3)對同一場景連續(xù)拍攝多次,經(jīng)過加權(quán)平均合成噪聲圖像對應(yīng)的Ground Truth 圖像。常用的真實圖像數(shù)據(jù)集主要有RENOIR[64]、DND[65]、SSID[66]和PolyU[67]。數(shù)據(jù)集屬性介紹見表2。

RENOIR數(shù)據(jù)集用3個不同的相機拍攝120個暗光場景,每個場景包括2 張噪聲圖像和2 張Ground Truth圖像,不同的場景圖像分辨率大小不一。DND 數(shù)據(jù)集用4個不同的相機拍攝了50個場景,每個場景包括清晰圖像、噪聲圖像和Ground Truth 圖像,圖像分辨率大小為512×512。SSID 數(shù)據(jù)集用5 個不同的相機拍攝10 個場景,每個場景包括噪聲圖像和Ground Truth 圖像。PolyU數(shù)據(jù)集用5個不同的相機拍攝了40個場景,每個場景包括Ground truth圖像和真實噪聲圖像,圖像分辨率大小為512×512。

表2 圖像去噪常用真實圖像訓(xùn)練數(shù)據(jù)集

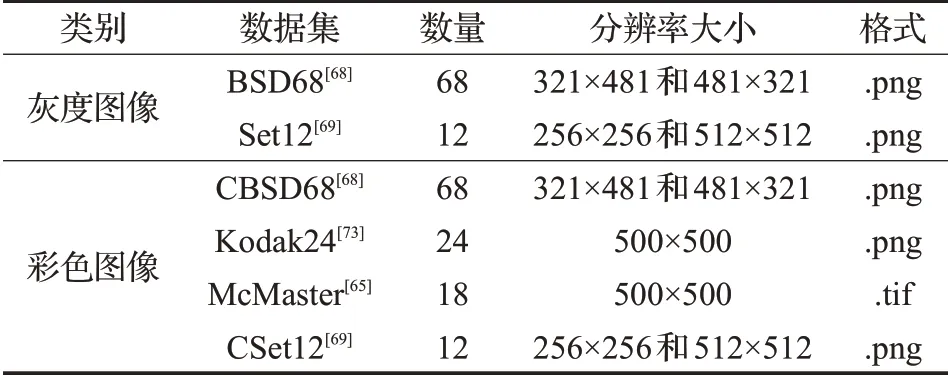

3.1.2 測試數(shù)據(jù)集

圖像去噪領(lǐng)域常用的測試集主要分為灰度圖像和彩色圖像兩大類,如表3所示。灰度圖像數(shù)據(jù)集主要有BSD68[68]、Set12[69];彩色圖像數(shù)據(jù)集主要有CBSD68[68]、Kodak24[70]、McMaster[71]、CSet12[69]。其中BSD68 和Kodak24主要是室外場景圖像,BSD68包括12張建筑物,30張貓、虎、馬、象等動物,11張人物,4張花草植物和11張其他室外場景圖像,Kodak24則多以建筑物、天空、大海為視角。McMaster主要是室內(nèi)場景,包括5張植物花草,5張水果蔬菜和其他如沙發(fā)、墻壁等室內(nèi)場景圖像。CBSD68與BSD68場景圖像相同,是BSD68對應(yīng)的彩色圖像數(shù)據(jù)集。Set12 中有9 張室外場景和3 張室內(nèi)場景圖像,包括5 張人物,3 張動物和其他如房子、輪船等室外場景圖像。CSet12數(shù)據(jù)集是Set12對應(yīng)的彩色圖像。

表3 圖像去噪常用測試數(shù)據(jù)集

3.2 評價指標

去噪方法的性能評價常從PSNR和SSIM兩方面進行定量分析評估[72]。

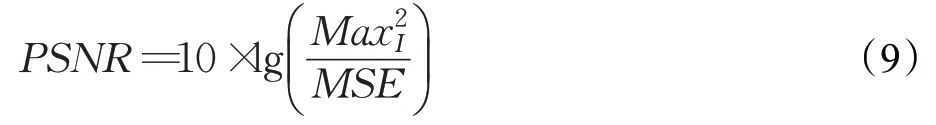

(1)PSNR(Peak Signal-to-Noise Ratio):即峰值信噪比,是最普遍、最廣泛使用的一種評價經(jīng)過壓縮或處理后的圖像與原始圖像相比質(zhì)量好壞的標準。PSNR值越高,處理后的圖像失真越小,質(zhì)量越高。PSNR計算公式為:

其中Max2I為圖像I可能的最大像素值,根據(jù)其二進制的位數(shù)B,將Max2I表示為(2B?1)2。而MSE表示的是大小為M×N的原始圖像I與處理后的圖像K之間的均方誤差,通過均方誤差值大小確定圖像的失真程度。計算公式如下:

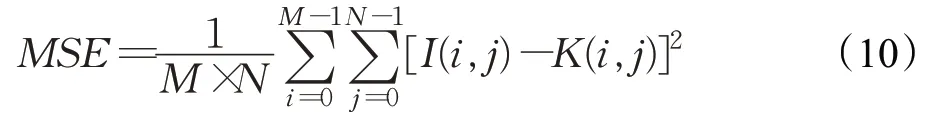

由于PSNR 在評價圖像質(zhì)量時忽略了空間頻率和圖像亮度等因素的影響,導(dǎo)致PSNR的評估結(jié)果和人眼感知的效果不一致。為更合理準確地評價圖像質(zhì)量,對圖像的亮度、對比度和結(jié)構(gòu)信息等屬性進行分析,引入結(jié)構(gòu)相似性理論(SSIM)作為圖像質(zhì)量的另一評價標準。

(2)SSIM(Structural Similarity):即結(jié)構(gòu)相似性。實現(xiàn)了從感知誤差的度量到感知結(jié)構(gòu)失真的度量,直接估計原始圖像和處理后圖像中信號結(jié)構(gòu)的改變。分別用均值、標準差和協(xié)方差作為亮度、對比度和結(jié)構(gòu)相似程度的度量,表示為:

其中,μx是x的均值,μy是y的均值,σ2x是x的方差,σy2是y的方差,σxy是x和y的協(xié)方差,而c1和c2是維持穩(wěn)定的常數(shù)。SSIM的范圍從0~1,值越大表示原始圖像與處理后的圖像誤差越小,圖像質(zhì)量越高。

(3)時間:方法性能的評價標準除了使用PSNR 和SSIM,對方法的效率評估也是必要的。一個優(yōu)秀的方法應(yīng)該在保證良好去噪性能的基礎(chǔ)上盡量縮短運行時間。

4 實驗

4.1 測試環(huán)境

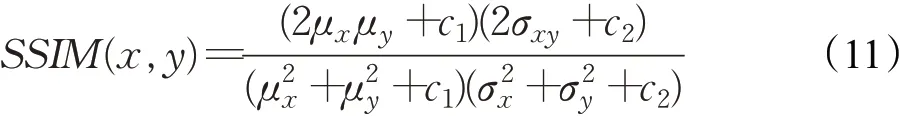

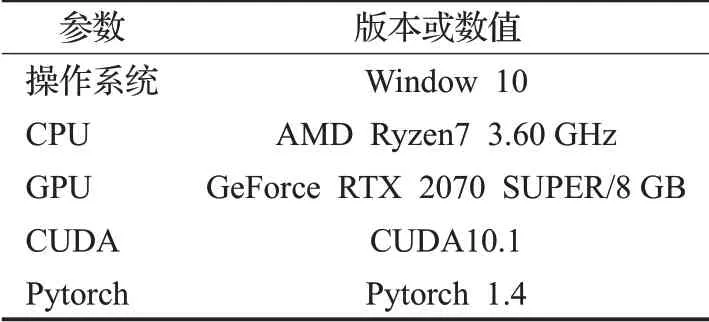

實驗測試環(huán)境是在AMD Ryzen7 3700X CPU 3.60 GHz,16 GB內(nèi)存,Window10系統(tǒng)下搭建Pytorch平臺環(huán)境完成對圖像去噪方法的測試任務(wù)。實驗環(huán)境的配置參數(shù)如表4所示。

表4 測試環(huán)境的配置參數(shù)

4.2 參數(shù)設(shè)置

對比實驗建立在無噪聲圖像訓(xùn)練集Train400[38]上,5 種噪聲水平σ分別為15、25、35、45和50。對比方法的核心參數(shù)如批處理數(shù)量(batch size)設(shè)為64,讀取的圖像補丁塊兒大小(patch size)設(shè)置為40×40,迭代次數(shù)epoch 設(shè)置為100 000。為使網(wǎng)絡(luò)更快的收斂且能夠更穩(wěn)定的學(xué)習,選擇Adam 優(yōu)化器,并將初始學(xué)習率(Learning Rate)設(shè)置為0.001,且隨著迭代次數(shù)的增加,學(xué)習率越來越低。

4.3 實驗結(jié)果分析

為進一步加深對方法的理解,本節(jié)選取一些經(jīng)典去噪方法進行對比實驗。實驗分為兩部分:對合成噪聲的去噪和對真實噪聲的去噪。

4.3.1 對合成噪聲的去噪結(jié)果分析

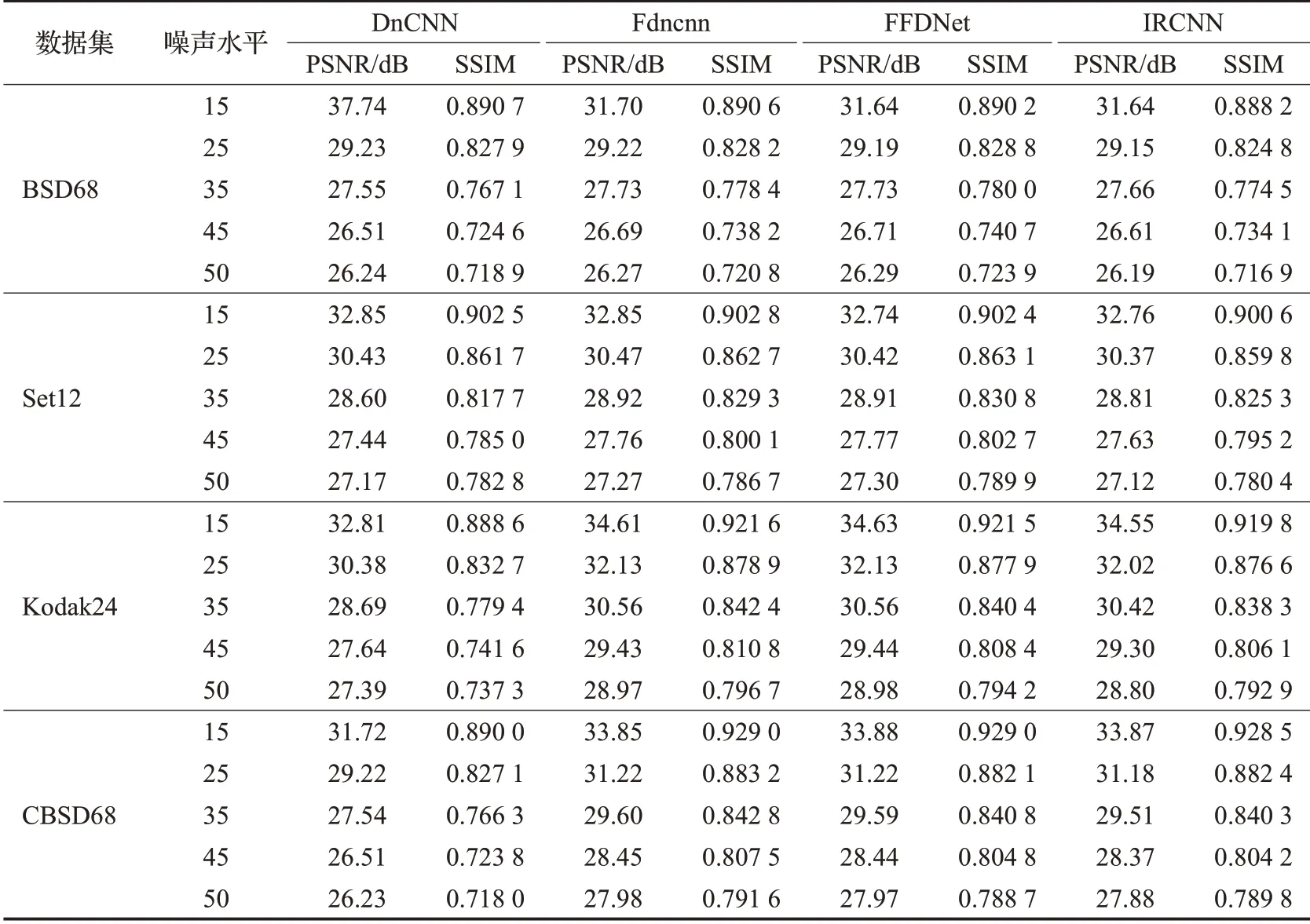

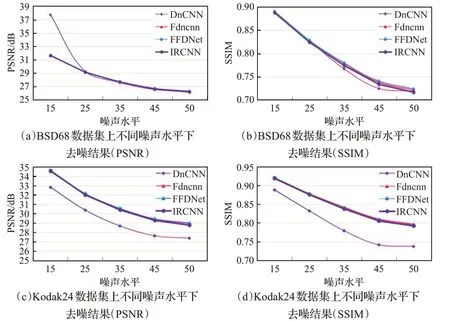

(1)從表5數(shù)據(jù)可以看出,BSD68數(shù)據(jù)集下,當噪聲水平為15 和25 時,DnCNN 方法去噪結(jié)果最好,相比IRCNN 去噪方法其PSNR 值提升了6.1 dB。但當噪聲水平為45 和50 時,去噪結(jié)果最好的方法是FFDNet。FFDNet在Set12和Kodak24數(shù)據(jù)集上,同樣展現(xiàn)了對噪聲水平較高圖像良好的適應(yīng)性。結(jié)合圖5所示,圖(a)、(b)和(c)、(d)分別代表在BSD68 數(shù)據(jù)集和Kodak24 數(shù)據(jù)集上,4種方法的去噪結(jié)果(PSNR和SSIM)隨噪聲水平提高的變化曲線。從圖中看出,隨著噪聲水平的提高,4種方法的去噪性能整體上呈衰減趨勢。以DnCNN方法為例,在BSD68 數(shù)據(jù)集上,噪聲水平為15 時,其PSNR 為37.74 dB,隨著噪聲水平提升到25,PSNR 呈陡峭式變化,直接降低到29.23 dB,噪聲水平較高時去噪性能相對較差。所以,噪聲水平的高低會直接影響到方法的去噪效果。

表5 不同噪聲水平下各方法去噪結(jié)果比較

圖5 去噪方法在BSD68和Kodak24數(shù)據(jù)集上的去噪結(jié)果隨噪聲水平提高的變化曲線

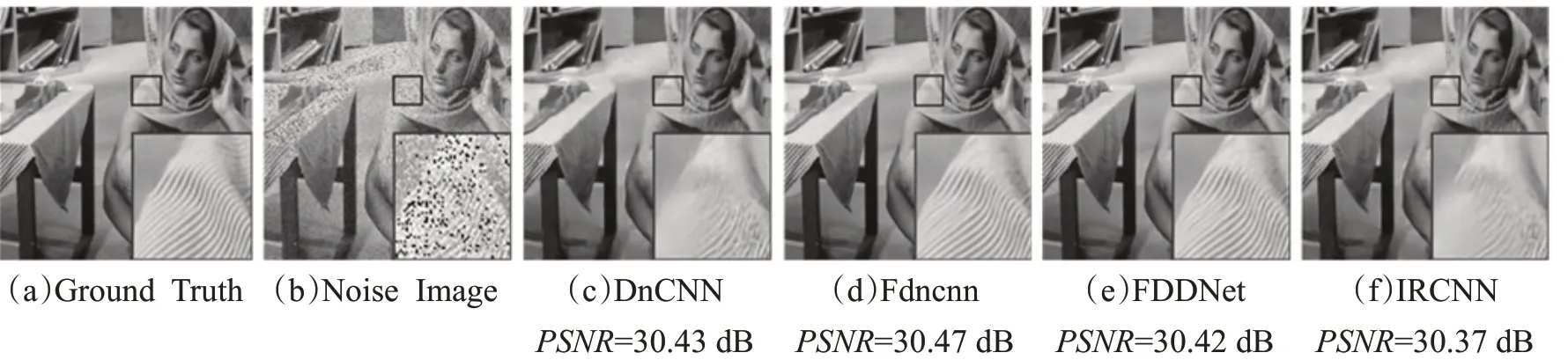

(2)為進一步對比4種方法的可視化效果,圖6和圖7 分別展示了在噪聲水平為25 時,噪聲圖像在Set12 和Kodak24 數(shù)據(jù)集上的去噪效果。圖6 是在Set12 數(shù)據(jù)集上的去噪效果對比圖,觀察圖中所選區(qū)域的去噪效果,F(xiàn)dncnn 方法去噪后的圖像中紋理細節(jié)最為清晰,相對Ground Truth來說,恢復(fù)效果較好。而DnCNN和IRCNN去噪后的圖像則非常模糊,對于局部區(qū)域,不僅丟失了紋理細節(jié)信息,還會出現(xiàn)一些偽影,對圖像的恢復(fù)效果較差。且從圖6的對比效果來看,主觀視覺上的感受與表5客觀評價分析結(jié)果一致。

圖6 噪聲水平σ=25 時不同方法在Set12數(shù)據(jù)集上的去噪效果對比圖

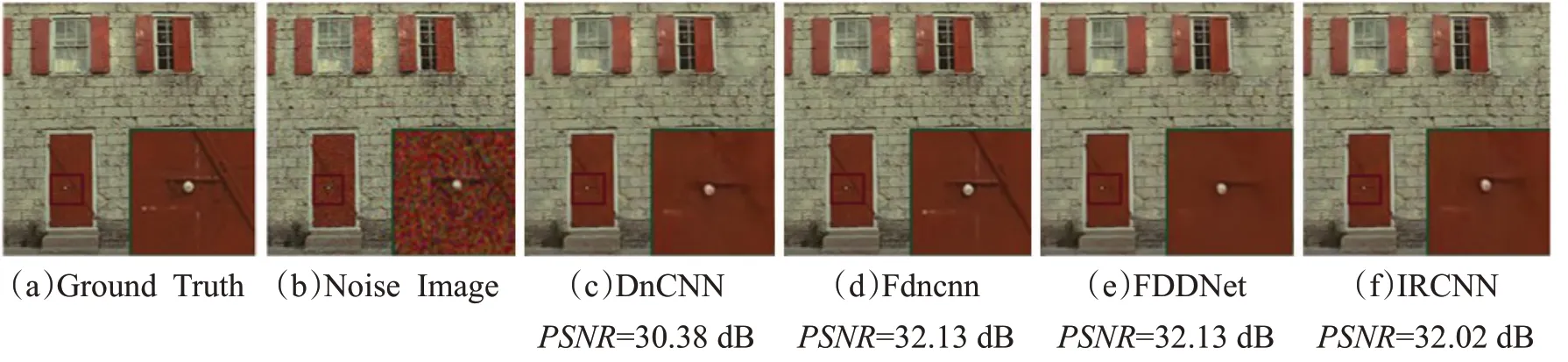

圖7 噪聲水平σ=25 時不同方法在Kodak24數(shù)據(jù)集上的去噪效果對比圖

(3)圖7 是在彩色圖像Kodak24 數(shù)據(jù)集上的去噪效果對比圖,實驗結(jié)果表明4 種方法中,F(xiàn)dncnn 方法對紋理細節(jié)的恢復(fù)相對較好,然而相比Ground Truth仍存在細節(jié)紋理細節(jié)丟失的現(xiàn)象。FFDNet 方法的PSNR 值與Fdncnn 相同,但去噪的效果卻相差很大,PSNR 客觀評價指標預(yù)測值與實際主管視覺效果圖不相符。從圖中所選區(qū)域可以看出FFDNet 去噪后的圖像平滑現(xiàn)象嚴重,看不到紋理細節(jié)。DnCNN方法和IRCNN方法也同樣出現(xiàn)這個問題。

4.3.2 對真實噪聲的去噪結(jié)果分析

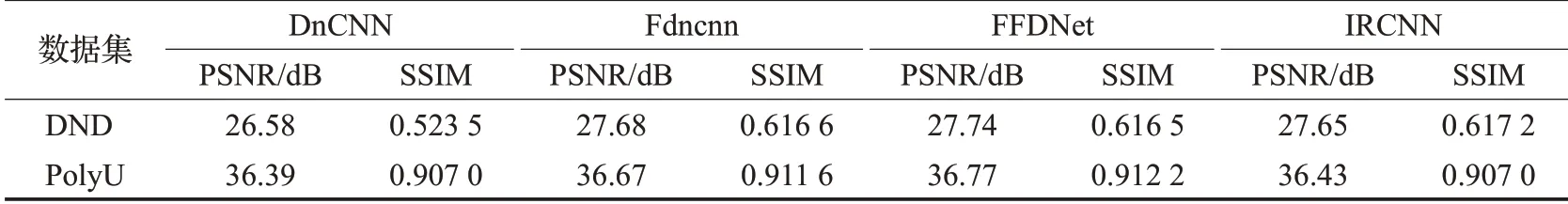

真實噪聲分布比高斯噪聲更為復(fù)雜,本小節(jié)對4種去噪方法在真實噪聲圖像DND和PolyU數(shù)據(jù)集上的適用性做進一步驗證。

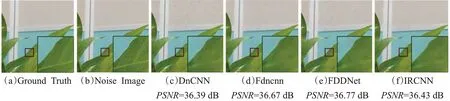

(1)從表6中客觀數(shù)據(jù)看出,F(xiàn)FDNet方法在DND和PolyU 數(shù)據(jù)集上展現(xiàn)出良好的去噪結(jié)果。但對比各方法在BSD68、Set12、Kodak24 和CBSD68 合成噪聲數(shù)據(jù)集上的去噪結(jié)果,其去噪性能在真實圖像數(shù)據(jù)集DND上明顯降低,以DnCNN 方法為例,在DND 數(shù)據(jù)集上其PSNR 值比BSD68 數(shù)據(jù)集上測試的值降低了2.65 dB。且通過對圖8 中DnCNN、Fdncnn、FFDNet 和IRCNN 方法去噪效果對比圖來看,去噪后的圖像仍存在大量噪聲。所以,通過對多種噪聲水平的含噪圖像訓(xùn)練樣本進行訓(xùn)練得到的去噪模型,并未在真實圖像去噪實驗中取得很好的效果。

(2)觀察表6 數(shù)據(jù),可以看出以上4 種方法在PolyU數(shù)據(jù)集上相對其他合成噪聲數(shù)據(jù)集,PSNR 和SSIM 取得了最優(yōu)的去噪結(jié)果。通過分析圖8和圖9中選取的數(shù)據(jù)樣本,發(fā)現(xiàn)圖9所選樣本的噪聲圖像中噪聲水平比較低,與Ground Truth 相比差別不大,而圖8 所選樣本的噪聲圖像中可以明顯看出噪點的分布情況,且很容易區(qū)分出其噪聲圖像與Ground Truth。所以,這里再一次驗證噪聲水平的高低對去噪方法性能的影響。雖然4 種方法在PolyU數(shù)據(jù)集上,其客觀評價指標取得相對較高的結(jié)果,但觀察圖9 樣本數(shù)據(jù)的選框區(qū)域,發(fā)現(xiàn)主觀視覺上的效果并不理想,對于紋理細節(jié)和邊緣區(qū)域的恢復(fù)能力較差。

表6 DND和PolyU數(shù)據(jù)集下各方法去噪結(jié)果比較

圖8 不同方法在DND數(shù)據(jù)集上的去噪效果對比圖

圖9 不同方法在PolyU數(shù)據(jù)集上的去噪效果對比圖

通過對實驗結(jié)果的分析可知,目前去噪方法在圖像恢復(fù)效果上存在的幾個主要問題:客觀的評價指標的預(yù)測值與實際的主觀視覺感受不一致;去噪方法在高等級噪聲水平下去噪效果不理想;特征表達能力不足,導(dǎo)致去噪后圖像仍有噪聲殘留;對圖像中的紋理細節(jié)及邊緣信息恢復(fù)效果不佳。

5 總結(jié)與展望

隨著圖像去噪技術(shù)的不斷更新發(fā)展,越來越多的方法關(guān)注于如何去除真實噪聲。圖像去噪這項預(yù)處理任務(wù)如果完成的好,將會對后續(xù)圖像處理相關(guān)任務(wù)的研究打下堅實基礎(chǔ)。本文對近幾年的圖像去噪方法做了總結(jié)和歸納:

(1)傳統(tǒng)的圖像去噪方法,一方面基于特定設(shè)計模型方法進行去噪,沒有充分考慮噪聲類型的多樣性,且需要先驗知識做基礎(chǔ),只能提取局部特征,忽視了全局信息的影響;另一方面,模型泛化能力差,對于真實含噪圖像去噪效果不佳。

(2)基于深度學(xué)習的圖像去噪方法具有強大的表示學(xué)習能力,模型對大量樣本進行訓(xùn)練學(xué)習,可以獲取更準確的噪聲特征。從近幾年的圖像去噪方法來看,基于GAN的去噪方法以及基于GNN的去噪方法發(fā)展迅速,分別在構(gòu)造成對訓(xùn)練樣本和處理非結(jié)構(gòu)化噪聲分布方面展現(xiàn)出良好優(yōu)勢,另外結(jié)合注意力機制、多尺度特征融合、遷移學(xué)習等策略,很好地彌補了真實噪聲自身類型多樣、分布復(fù)雜、難以參數(shù)化等特性,更好地提升了去噪效果。但是由于去噪網(wǎng)絡(luò)規(guī)模大、參數(shù)多、計算量大、訓(xùn)練不穩(wěn)定,因此以后可以考慮從模型剪枝、知識蒸餾等方面構(gòu)造更輕量的網(wǎng)絡(luò)模型。

雖然基于深度學(xué)習的去噪方法已經(jīng)取得了不錯的進展,去噪效果也在不斷提升,但是仍然還有以下幾個努力的方向:

(1)解決訓(xùn)練樣本不足問題

大多數(shù)深度學(xué)習去噪方法都需要有標簽的數(shù)據(jù)進行監(jiān)督學(xué)習,但在真實環(huán)境下獲取成對的清晰-噪聲圖像較為困難。為解決訓(xùn)練樣本少的問題,對于監(jiān)督學(xué)習的訓(xùn)練方式,可以選用GAN來豐富真實圖像數(shù)據(jù),GAN通過對真實圖像中的噪聲分布進行學(xué)習,生成逼真的新噪聲圖像,擴充了數(shù)據(jù)。而對于無監(jiān)督學(xué)習的訓(xùn)練方式,可以構(gòu)建基于編碼器-解碼器的去噪網(wǎng)絡(luò),無監(jiān)督的方法能夠很好地從根本上解決對大量訓(xùn)練樣本的依賴問題。因此,無監(jiān)督的去噪方法也是后續(xù)值得研究的方向之一。

(2)提升圖像去噪方法對真實噪聲的泛化能力

目前常用的基于深度學(xué)習的圖像去噪方法大多基于合成噪聲進行去噪,雖然這些方法已經(jīng)取得了很好的去噪效果,但對于真實含噪圖像的泛化能力偏弱,去噪效果較差。這些缺陷受限于真實噪聲本身類型多樣、分布復(fù)雜、難以參數(shù)化等特性。因此,針對真實噪聲圖像設(shè)計行之有效的去噪方法,提升方法的泛化能力和模型魯棒性是一項頗具挑戰(zhàn)和值得研究的任務(wù)。

(3)將去噪方法應(yīng)用于實時視頻去噪

近年來對圖像去噪方法的研究主要集中于靜態(tài)圖像,針對視頻的研究很少,如何利用視頻中各幀之間的時序關(guān)系實現(xiàn)實時去噪,是未來的重點研究方向,具有非常實際的應(yīng)用價值。

(4)對單圖像進行去噪

相比基于視頻的去噪方法,單圖像去噪更加困難。因為單幀圖像作為獨立輸入,沒有相鄰時間序列,也學(xué)習不到鄰域色度之間的差異,單圖像去噪是一個具有挑戰(zhàn)性的問題,是后續(xù)可以考慮的研究方向之一。

(5)輕量化網(wǎng)絡(luò)模型

許多依賴傳統(tǒng)卷積方式的圖像去噪方法著重于設(shè)計更寬或更深的網(wǎng)絡(luò)結(jié)構(gòu)以獲得性能的增益,這種方式需要很高的計算成本和大量的內(nèi)存。因此,一些基于網(wǎng)絡(luò)剪枝[73]、參數(shù)量化[74]和知識蒸餾[75]的模型壓縮方法逐漸出現(xiàn)。目前這些輕量化網(wǎng)絡(luò)在超分辨率重建上已有應(yīng)用,但在圖像去噪領(lǐng)域應(yīng)用較少,是后續(xù)可以研究的方向之一。