深度神經網絡在多場景車輛屬性識別中的研究

王 林,柴江云

西安理工大學 自動化與信息工程學院,西安710048

隨著社會經濟的飛速發展,國民的生活水平穩步上升,目前,人們的代步工具已經逐步從自己的雙腳轉換為各種機動車輛,隨之而引發的各類交通問題也越來越復雜。智能交通系統(Intelligent Transportation System,ITS)[1-2]是專門針對目前經濟發展所造成交通問題的理想解決方案。各類機動車輛作為交通的重要組成成員,其屬性的有效識別在智能交通系統中的位置舉足輕重。在一般監控視頻畫面中,普遍存在圖像像素不夠清楚,車牌被阻擋、涂抹、腐蝕等情況,無法準確對車牌號碼做出定位與識別,這時快速準確地識別出車輛的其他屬性信息就顯得尤為重要。比如車輛其他的外觀特征,車輛類型和顏色的準確識別可以彌補車牌識別的不足,并且可以對車牌識別結果進行補充,更全面地增加車輛信息,也可以提高ITS 的可靠性和安全性,大幅度提高車輛交通管理的智能性。快速準確地識別出車輛的類型和顏色并根據識別結果做出準確的分析,可以有效地服務于ITS,并且還可以建立起一個車輛信息數據庫提供車輛的信息檢索,將其應用到交通安全和相關部門中將大幅度提高相關部門的工作效率。因此,車輛屬性的有效識別在交通擁堵、車輛檢索跟蹤和實時檢測管理車輛中具有極其重要的作用,它將成為ITS的重要輔助手段之一。

車輛的顏色識別是計算機視覺研究的一個子領域,它的主要工作是確定一幅圖像中車輛的主要顏色,傳統的顏色識別由于天氣、光照等復雜的外界環境因素還存在許多問題,無法正確識別出各車輛的顏色,此外,還有一些車輛的顏色非常接近,無法準確做出分類,這也是顏色識別的一大挑戰。自然場景中的車輛顏色識別可以在車輛檢測、車輛跟蹤和自動駕駛等系統中提供有用的信息。車輛的類型由于其特定的邊緣特征,相比車輛顏色的識別較為容易,只要樣本足夠多,圖像質量足夠高,就可以準確地識別出車輛類型,并且獲得較高的精度。傳統的車輛屬性識別中,往往是針對單一的屬性進行識別,Zhang 等人[3]提出了一種基于膠囊網絡(Capsule Network)的車輛類型識別模型,該模型包括對不同角度和光照條件的五種不同類型的車輛進行識別,并對膠囊網絡的動態路由算法進行了重新設計,以節省訓練時間和加快收斂速度,最后取得了91.27%的準確度。Chen等人[4]根據紋理特征,將每個汽車面部圖像分為多個子圖像,在不同層中使用卷積神經網絡(Convolutional Neural Network,CNN)提取全局和局部特征,對車型進行識別,取得了較高的準確率,但僅能識別包含車輛前景的圖片,對車輛其他角度的圖片無法做到正確識別。Damitha 等人[5]利用支持向量機(Support Vector Machine,SVM)的方法對車輛的顏色進行了分類識別,他們提取相同的感興趣區域(Region of Interest,ROI),以便從車輛中提取顏色特征,并且使用了幾種不同的特征組合,并根據這些特征組合進行了測試,最后取得了87.52%的平均準確率。Xue等人[6]為了減弱照明因素對顏色識別的影響,對于不同照明條件下的圖像使用不同的處理方法,以提高色彩識別的準確性,但是他們在處理圖像時需要花費大量時間來對圖像進行手動分類。阮航等人[7]首先利用Faster R-CNN 網絡對車輛進行檢測,然后對GoogLeNet 網絡結構進行改進,在全連接層后面連接多個損失層以實現車輛的標識、姿態和顏色屬性的識別,其取得了85%的準確率。

綜上可知,車輛屬性識別領域的研究有很多,也取得了不少成果,但大多數學習任務是基于單個屬性的單任務學習,關于具有多個屬性的復雜學習任務的研究卻很少。僅通過車輛的某一個屬性來定位一個特定車輛往往很難實現,識別過程耗時普遍較長,無法切實應用于現實應用,而且車輛的外在屬性可以確定的信息越多,對定位特定車輛幫助則越大。對于車輛,它也具有多個屬性描述,例如根據汽車類型,它可以描述為car、suv、van 等;根據車輛的顏色,可以將其描述為紅色、白色、黑色等。基于以上分析,本文針對車輛的多屬性特征,通過網絡搜索和實拍數據來構造車輛多屬性數據集,并提出一種基于深度神經網絡的現實場景中車輛屬性識別方法,利用YOLO(You Only Look Once)神經網絡的升級版YOLOv3網路,通過圖像全局區域對車輛數據集進行訓練,同時將車輛類型和顏色兩個屬性任務進行分級訓練,二者之間互不影響,實現車輛類型和顏色屬性的檢測識別工作,從而提高了模型的適用性。

1 車輛屬性識別框架

1.1 YOLOv3網絡

目前深度學習(Deep Learning,DL)[8-9]在目標檢測識別領域應用及其廣泛[10]。近年來,基于DL 的算法在圖像分類[11]、物體檢測[12-13]等方面取得了突破性的成果。在處理視覺任務時,與采用人工特征的傳統方法相比,深度學習架構能夠從原始圖像上學習到更有效的表示,并且比傳統方法的性能更好。其中CNN 在數字識別[14]的工作中首次顯現出其實用性,Krizhevsky 等人[11]是第一個將CNN 應用于大規模圖像分類問題的,并且在ImageNet數據集[15]上獲得較高性能的應用實例,這是迄今為止最大和最具挑戰性的圖像數據集。

本文以YOLOv3 網絡為原型,通過采用殘差網絡(Residual Network,ResNet)[16]的跳層連接方式,在增加網絡深度的同時,使得網絡仍然可以收斂,能夠實現端到端的目標檢測和識別。YOLOv3 神經網絡意在只需要看一次圖像即可預測出圖像中存在的目標對象及其位置信息,該網絡直接從圖像中提取檢測框,并通過整個圖像特征檢測目標對象[17]。在該過程中,首先將輸入圖像劃分成S×S 個網格,然后對每個網格都預測出B個檢測框,每個檢測框都包含5個預測值,分別是x、y、w、h 和confidence。其中x、y 為檢測框的中心坐標,w和h 分別為檢測框的寬和高,confidence 是這個檢測框所屬類別的置信度。每個檢測框的損失函數包含四部分,如式(1)所示:

其中,lossxy是檢測框的中心坐標誤差,losswh是檢測框的高度坐標誤差,lossconf是檢測框的置信度誤差,losscls是檢測框的分類誤差。損失函數分為兩部分:有物體部分和沒有物體部分,其中沒有物體的部分損失增加了權重系數。一幅圖像中大部分內容不包含待檢測物體,這樣會導致沒有物體部分的計算量大于有物體部分的計算量,這會導致網絡傾向于檢測單元網格不含有物體,因此在沒有物體的部分添加權重系數,減少沒有物體部分計算的貢獻權重,本文取值為0.5。

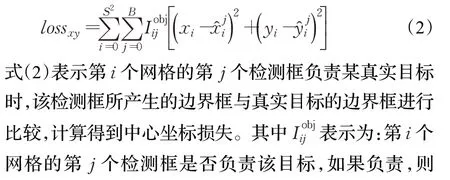

中心坐標損失lossxy定義為式(2):

式(5)表示只有當第i個網格的第j個檢測框負責某一個真實目標時,該檢測框所產生的邊界框才會計算分類損失函數。

1.2 車輛屬性識別網絡

網絡深度越深,目標檢測識別的準確率越高,但相應的檢測時間就會越長,在普通靜態圖片識別中,時間因素的影響還不是很突出,但在視頻應用中,需要考慮到視頻的實時性條件,在一幀視頻的目標檢測識別過程中,時間因素是一個重要的考量標準。在本實驗中,包括車輛類型和車輛顏色兩個屬性類別,考慮到不同類型車輛的顏色分布區域不同,比如卡車的顏色主要分布于車窗周圍,而轎車和越野車的顏色主要分布在車頭的引擎蓋上,因此本文將車輛的整個圖像區域作為車輛顏色的ROI,最大限度地使用車輛信息進行顏色訓練,這樣就會和車輛類型的ROI發生沖突。在本實驗中,采取將車輛類型和車輛顏色屬性進行分級訓練,這樣不僅可以使用不同的網絡結構,還可以避免車型和車輛顏色ROI沖突的問題。在訓練時兩個模塊間采用不同的網絡結構,然后對模型進行整合調用,可以大幅度提高車輛屬性識別的準確率和檢測時間。

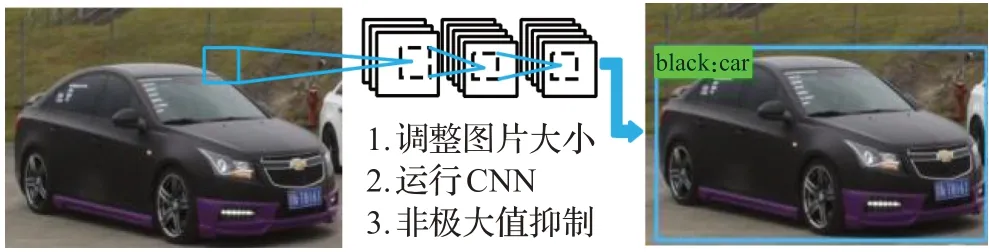

圖1是本實驗的車輛屬性識別算法,在圖1中,首先將輸入圖像調整為416×416 大小,然后在圖像上運行CNN 進行特征提取,最后通過模型的置信度對檢測結果設置閾值進行檢測框的篩選。

圖1 車輛屬性識別算法

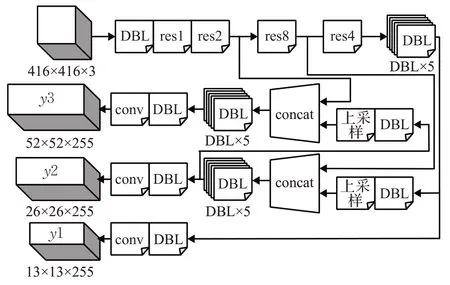

在本實驗中使用YOLOv3 神經網絡來建立車輛屬性識別的模型。圖2為車輛類型識別網絡的結構圖。

圖2 車輛類型識別網絡結構圖

圖2中DBL、resn、concat具體內容如下:

DBL:是該網絡結構的基本組件。即為卷積+Batch Normalization+Leaky relu的組合。

resn:n代表數字,有res1,res2,…,res8 等,表示一個res_block里包含n個res_unit。

concat:張量拼接,將中間層和后面某一層的上采樣進行拼接,讓網絡同時學習深層和淺層特征,使得表達效果更好。

該網絡通過若干個DBL 組件和res 殘差單元進行特征提取,然后通過concat對中間層和后面某一層的上采樣進行張量拼接融合學習各層特征,最后創建3個尺度的輸出,即圖2 中的[y1,y2,y3],其中底層信息含有全局特征,中間層信息含有局部特征,這樣拼接,可以使得兩者兼顧。此外,還借鑒了特征金字塔網絡(Feature Pyramid Networks,FPN)[18]的思想,采用多尺度來對不同尺寸的目標進行檢測,越精細的網格單元可以檢測出越精細的物體。

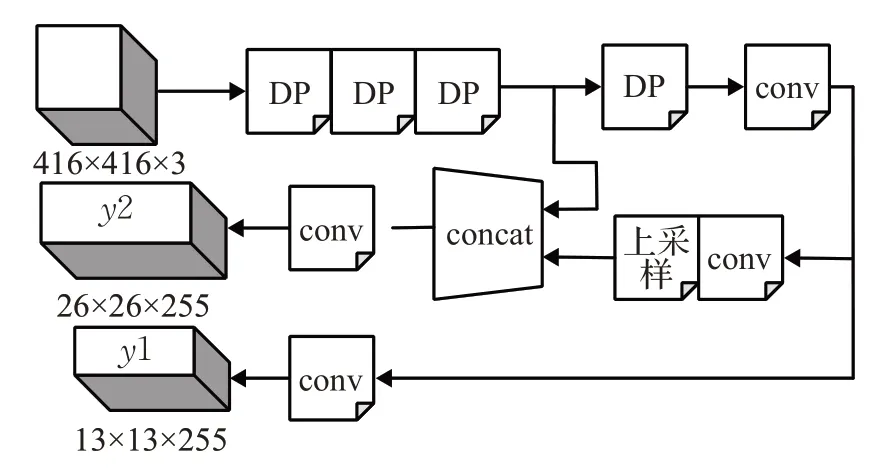

在車輛類型識別模塊中,因需要采集的特征點較多,特征采樣網絡越深,采集到的車型特征點越多,分類準確度越高,在車輛顏色識別模塊中,車輛顏色分布比較均勻,其特征點較少,只需計算出每個ROI 中的顏色像素值,特征采樣網絡僅需簡單的一些層就可實現。在YOLOv3神經網絡的基礎上進行改進,保留其部分的卷積層,在每個卷積層后加入一個池化層,然后進行張量拼接,重新組合成一個23層的新的網絡結構,對車輛顏色樣本進行訓練,以提高車輛屬性識別的整體時間。圖3為改進后的車輛顏色識別網絡結構圖。其中,DP為卷積層和池化層的組合。在該網絡中,通過多個DP 組件和若干個卷積層進行特征提取,然后同樣通過concat進行張量拼接融合學習屬性特征,最后創建2個尺度的輸出,即圖3中的[y1,y2]。

圖3 車輛顏色識別網絡結構圖

采用DP 組合的方式在不影響識別準確率的前提下,精簡了網絡結構,降低了網絡深度,大幅度縮短了模型檢測識別所占用的時間,與車型識別模型相結合,在網絡檢測出車型的同時調用車輛顏色模型進行顏色識別,可以提高車輛屬性識別的準確率,并且縮短車輛整體識別時間。

1.3 模型訓練

在進行模型訓練前,需要準備好模型訓練所需的車輛圖片樣本數據集,以便網絡進行特征學習。除原始的圖片樣本數據集外,還需準備好網絡訓練所需的樣本感興趣區域,即樣本的標簽數據集。該標簽數據集需要將訓練用的數據進行手動標記好感興趣區域和類別名稱,這樣不僅可以提高感興趣區域的準確性,還可以減弱噪聲的干擾,提高特征提取的有效性。在本文中,將車輛按照類型分為bus、car、coach、truck、suv、van 6 種類型;按照顏色分為黑色、藍色、灰色、綠色、橙色、紫色、紅色、白色、香檳色、黃色以及銀灰色11種顏色。

本實驗在GTX 1080Ti GPU 上進行訓練,在訓練前,還需對部分參數進行調整,將訓練數據集分為64批,每批的數量設置為4,這樣可以減輕GPU 負擔的同時最快速度的進行迭代,迭代次數設置為500 000 次,充分學習車輛各屬性的特征。訓練過程中學習率(learning_rate)參數值設置得越高則所得模型的識別準確率越高,但該參數不能隨意設置,過高的learning_rate會導致網絡僅學習數據集而發生學習偏差,因此在本實驗中將learning_rate設置為0.001。在訓練過程中,模型的訓練損失和模型學習率的曲線變化如圖4 所示。其中圖4(a)是模型訓練過程中平均損失的曲線圖,在訓練過程中平均損失降得越低則模型的學習效果越好,圖4(b)是模型訓練過程中學習率的曲線圖,該曲線反映了訓練過程中模型學習到各屬性特征的能力大小,期望值趨于訓練前的設定值,即0.001。由圖4 可以看出,模型的訓練損失值最后降低在0.02附近,已經可以滿足訓練要求,但是learning_rate 在400 000 次迭代之后發生銳減,說明訓練模型在此時出現了過擬合現象,故而結合平均損失曲線圖,最佳迭代次數應截止在400 000 次之前,此時平均損失仍然在最低處,同時學習率達到最高。適時的停止訓練,降低訓練過程中過擬合帶來的影響,可以提高模型的識別準確率。

圖4 訓練損失與學習率結果

2 實驗分析

2.1 數據集

由于要實現車輛的類型和顏色兩類屬性的識別問題,因此需要數據集有充足的訓練數據和豐富的種類。為滿足實驗需求,其中應包括不同環境、不同角度、不同類型和不同顏色的車輛。但是目前公開的車輛數據集中,車輛類型普遍比較陳舊,顏色和現在的車輛顏色相差較大,無法滿足本實驗的數據要求。因此,為滿足本實驗的數據要求,自建了一個包含車輛多種屬性的AttributesCars數據集,其中包含各類型及各類顏色的車輛,共計20 000 張車輛圖像,可以完成對車輛類型和顏色屬性的訓練準備。其中50%來自網絡上公開的車輛數據集Stanford Cars,該數據集中車輛的類型和現在的車輛相差不大,但車輛的類型比較固定,以car和suv 居多,故而另外50%采集自網絡上公開的各類型車輛的數據和手動采集的多種場景下的各類型車輛數據。為了擴充數據集以及增強訓練模型的魯棒性,分別對這些數據進行了縮放、模糊處理,其中80%進行逐個篩選后做標簽處理,用于訓練,剩下的20%用于測試。

2.2 實驗結果與分析

在車輛屬性識別過程中,需在滿足識別準確率的前提下,最大限度地滿足視頻實時性的要求。在本實驗中,顏色識別模塊采用簡化改進版的網絡結構,訓練所得模型大幅縮減了檢測識別所用時間,并且識別準確率沒有受到影響,在車型識別模塊雖然識別時間較長,但結合顏色模塊可以彌補車型模塊識別時間較長的缺陷,使得整體車輛識別時間可以滿足視頻實時性的要求。

在車輛行駛中,道路場景變化多樣,監控視頻中的車輛圖像隨道路場景的變化而不同,在一個監控畫面中,車輛出現位置與攝像頭位置距離的遠近直接影響到是否能正確有效地識別車輛屬性。為了評估車輛屬性識別模型的適用性,特在近景監控和交通監控兩種不同場景下進行了測試與驗證。在近景監控場景中,攝像頭距離車輛目標位置較近,采集到的圖像比較清晰,對監控畫面中的車輛進行檢測與識別的準確率比較高;在交通監控場景中,攝像頭一般位于較高位置,距離車輛比較遠,采集到的車輛圖像相較近景中像素偏差較大,目標偏小,準確率相對比較低。圖5是本實驗訓練模型的識別效果圖,圖中目標車輛頂部顯示的是該車輛顏色和類型屬性的識別結果。其中圖5(a)是在近景監控場景中的部分車輛屬性識別結果,圖中車輛圖像較大,顏色清晰,識別結果正確無誤;圖5(b)是在交通監控場景中部分車輛的屬性識別結果,圖中車輛圖像較小,顏色勉強可以看清,識別結果也正確無誤。從圖5 可以看出,無論是在近景監控場景中還是交通監控場景中,均可以正確識別出車輛的類型和顏色,證明了本模型的可行性。

圖5 模型識別結果

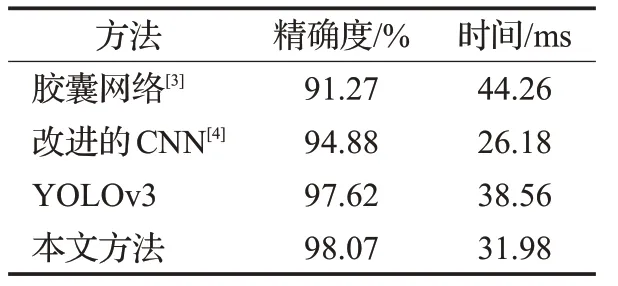

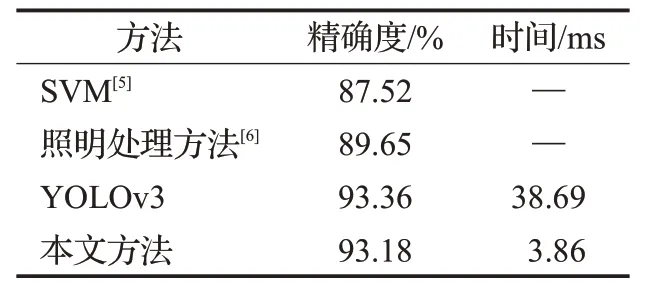

在實驗結果中可以看出本實驗的模型可以正確識別出不同場景下車輛的類型和顏色屬性,為驗證本文方法在車輛屬性識別方面的優越性,將本文方法與其他在車型和車輛顏色識別方面的研究方法進行了比較,因本實驗涉及到車輛類型和顏色兩個屬性,并且是分級進行訓練的,特將車型和顏色屬性分別進行比較。分別在識別準確率和識別所用時間方面進行對比分析,車輛類型和車輛顏色的識別結果對比分析分別如表1 和表2所示。

表1 車輛類型識別結果

表2 車輛顏色識別結果

由表1可以看出,基于膠囊網絡方法在達到91.27%準確率的前提下,車型的識別時間為44.26 ms,基于改進的CNN 方法的準確率為94.88%,其識別時間減少為26.18 ms,原始的YOLOv3 方法的準確率為97.62%,相應識別時間增加為38.56 ms,且其識別車輛類別較少,不夠全面,本文所提出方法準確率達到98.07%,識別時間為31.98 ms,相較原始的YOLOv3方法在準確率提升的前提下識別時間略有降低。

由表2 可以看出,基于SVM 方法的車輛顏色識別的準確率為87.52%,基于照明處理方法的車輛顏色識別準確率為89.65%,這兩種方法的識別時間未知,而YOLOv3方法可以達到93.36%的準確率,38.69 ms的識別時間,時間相較其他方法大幅縮短,本文所提出的方法準確率為93.18%,識別時間僅用3.86 ms,相較YOLOv3方法在不影響識別準確率的前提下,大大縮短了識別時間,對視頻中車輛識別的應用更具實用性。

綜合表1 和表2 的結果可以看出,本文提出的車輛多屬性識別模型可以在識別車輛類型的同時,對車輛顏色進行有效的識別,車型識別時間為31.98 ms,結合車輛顏色的識別時間3.86 ms,整體車輛的識別時間為35.84 ms,可以滿足視頻實時性的要求,此外,車輛的類型和顏色的類別相結合共同識別,使得車輛識別結果更加全面,平均準確率可以達到95.63%,可以更有效地應用于現實交通中車輛屬性的檢測識別。

3 結束語

本文提出了一種基于深度神經網絡的多場景下車輛多屬性識別方法。首先針對真實道路場景下的監控圖像,采集包含各類型與各類顏色的車輛數據集,并進行分類篩選和標簽處理,訓練經過改進后的YOLOv3神經網絡得到車輛多屬性識別模型,該模型可以在縮短識別時間的前提下同時達到識別準確率度高,檢測效果好的要求,適用于各類真實道路場景下的監控圖像。本文將車輛的類型和顏色屬性的樣本數據集進行分級訓練,有效提升了屬性分類的準確率與實時性。利用測試數據集對訓練得到的車輛多屬性識別模型進行了測試,實驗結果表明,本文提出的方法在不同道路場景下均具有較高的檢測精度,滿足了現實使用要求,并且可以有效識別出車輛的類型和顏色信息,具有較高的識別準確率和良好的適用性以及魯棒性。