多尺度高分辨率保持和視角不變的手姿態估計

熊 杰,彭 軍,楊文姬,黃麗芳

1.江西農業大學 計算機與信息工程學院,南昌330045

2.江西農業大學 軟件學院,南昌330045

3.浙江大學CAD&CG國家重點實驗室,杭州310058

4.江鈴控股有限公司,南昌330052

基于視覺的手姿態估計在人機交互、AR(增強現實)、VR(虛擬現實)和機器人操作等方面有著重要的作用。然而在手姿態的估計過程中會因為手的固有特性而存在自遮擋、自相似和高自由度等難題。為解決這些問題,有些研究者從深度圖像[1-6]或多視角相機系統[7]中估計3D 手姿態,但由于其便捷性不足以及普適性不高等種種原因,不能被廣泛推廣到實際應用場景中。因此直接從單張彩色圖像中估計手姿態顯得尤為重要[8-12]。

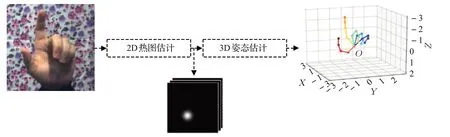

從單張彩色圖像估計3D 手姿態的流程主要有三種,第一種是直接從圖像中估計出3D姿態[11],第二種是先估計2D 熱圖(亦可當作估計2D 手姿態),然后利用CNN 學習2D 熱圖到3D 姿態的映射[8,13-14],最后一種是聯合估計2D姿態和3D姿態[9-10],其中第二種流程如圖1所示,本文也采取該流程進行2D和3D手姿態估計。在該流程中,很多研究者專注于3D姿態估計的創新[8,13]而缺少了對2D姿態估計的重視,然而3D姿態估計的結果依賴于2D姿態,因此提高2D姿態估計的精度對于估計3D姿態是有幫助的。

圖1 手姿態估計流程圖

目前2D 手姿態估計主要是通過估計2D 關鍵點熱圖的方式來實現。現有2D關鍵點熱圖估計大多數采用卷積姿勢機(Convolutional Pose Machine,CPM)[8,13]或沙漏網絡(Hourglass Network,HNet)[10,14]進行。如文獻[10,14]使用了HNet,該網絡由一個串聯的對稱的高到低和低到高分辨率子網絡的結構組成,即先將經過前期卷積處理的特征圖通過高到低分辨率子網絡進行下采樣得到尺度較小的特征圖,然后使用最近鄰上采樣逐步恢復到原始分辨率,并在恢復過程中以跳躍連接的方式與下采樣中的相應尺度特征圖的低層次特征進行融合,以達到多尺度特征融合的目的。然而HNet 不能在整個訓練過程中始終保持高分辨率表示,從而導致得到的高分辨率表示不夠穩定,不利于手關節的精準定位。文獻[8,13]采用CPM 進行2D 關鍵點熱圖估計,其先通過VGG 網絡將輸入下采樣到一定大小的特征圖,然后對該特征圖進行多階段的熱圖估計,具體地將上一階段的輸出作為下一階段的輸入以逐步提高估計精度,并在每個階段中進行中間監督來解決梯度消失問題。該方法在一定程度上能夠維持高分辨率表示,但在多階段學習過程中分辨率唯一,沒有多尺度特征表示和多尺度融合,因此不能很好地描述手姿態不同方面的信息。

針對現有的HNet不能始終保持高分辨率表示以及CPM 沒有進行多尺度特征融合等問題,本文引用一種新的網絡架構——高分辨率網絡(High-Resolution Network,HRNet)[15]用于提升手關節2D熱圖估計的準確性,進而有利于后續的3D 姿態估計。該網絡采用并行結構連接高低分辨率子網絡,并在不同分辨率子網絡間進行反復融合以增強各自分辨率表示的特征。為了融合更多的分辨率子網絡,形成了多個階段,每個階段是在前階段基礎上融入新的低分辨率子網絡并進行并行連接而構成。

該網絡以并行的方式連接多個分辨率子網絡,因此能始終保持高分辨率表示且得到的高分辨率表示也更穩定。此外,在所有分辨率表示下進行反復的融合來增強各分辨率表示特征,使最終輸出的高分辨率表示是豐富的,因此能使熱圖預測得更精準。

為了獲得3D 姿態,在得到2D 熱圖后,使用全局旋轉視角不變的方法[8]將2D 熱圖映射到3D 姿態。最后,在三個公開數據集(RHD、STB、Dexter+Object)上定量或定性地驗證了本文方法在2D 手姿態估計和3D 手姿態估計上的有效性。

1 相關工作

手姿態估計的方法可以分為三類,包括判別方法[16-18]、生成方法[19-22]和混合方法[23-27]。判別方法通過數據驅動方式學習圖像到手姿態的映射,其典型代表是最近熱門的深度學習。后兩類方法都需要一個預定義的手模型,用來尋找被檢測圖像最有可能的姿態,其過程是復雜且耗時的。本章主要對基于深度學習的彩色圖像手姿態估計研究進行簡述。

在彩色圖像的手姿態估計中,很多方法[7-8,10-11,13-14,18,28]使用CPM或HNet進行2D關鍵點熱圖估計或手姿態特征提取,并將得到的特征表示用于后續工作(如3D姿態估計)。Zimmermann 等人[8]是第一個提出利用CNN 的方法完成3D 手姿態估計的任務,設計了一個規范坐標系,讓網絡學習該坐標系下關鍵點位置的隱式鉸接先驗來估計相對的3D 手姿態。Cai 等人[13]只在網絡訓練期間利用額外的深度圖像對3D手姿態回歸起到弱監督作用。Yuan等人[11]將深度圖像當作特權信息,利用配對的深度-彩色圖像分別訓練基于深度圖像的網絡和基于彩色圖像的網絡,并在這兩個網絡的中間層中共享信息。Simon 等人[7]采用多視圖自舉的方法提升2D 熱圖估計網絡的精度,并將多視圖2D 姿態三角化成3D 手姿態。Iqbal等人[10]提出一種包含2D熱圖和深度值熱圖的2.5D熱圖表示,然后從該表示中重構3D 姿態。與估計稀疏的3D手姿態不同[7,8,10-11,13],Baek等人[28]采用密集的參數化3D 手模型估計3D 手網格。Ge 等人[14]提出了一種基于圖卷積神經網絡(Graph CNN)的方法估計3D 手形。Zhang 等人[18]通過多任務設置和幾何約束來估計3D 手形、2D手姿態和3D手姿態。

總之,目前基于彩色圖像的手關節2D 熱圖估計[7-8,10,13-14,18,28]或手姿態特征提取[11]工作大多數采用CPM或HNet進行。由于上述兩種網絡在獲取特征表示方面存在不足之處,本文引用HRNet 來估計2D 關鍵點熱圖,該網絡能形成穩定且豐富的高分辨率表示以進行空間精準的熱圖估計。

2 本文方法

本文方法包含兩個部分,分別為基于多尺度高分辨率保持的2D 手姿態估計和基于視角不變的3D 手姿態估計。

2.1 基于多尺度高分辨率保持的2D手姿態估計

將一張彩色圖像I∈PH×W×(3P表示圖像矩陣,H、W為圖像的高、寬)作為2D熱圖估計網絡的輸入,網絡會為每個關鍵點產生一張熱圖,即K個關節產生K張熱圖。從每張熱圖中選擇置信度(熱值)最大的位置作為關鍵點的位置,K個關節位置jk:jk=(uk,vk),其中u、v表示像素坐標,K在本文中為21。

2D 熱圖估計網絡由三個部分組成,首先是一個包含兩次下采樣的卷積層,將分辨率為256×256的輸入提取到64×64大小的特征圖。緊接著就是HRNet,其輸出的特征圖具有與輸入特征圖相同的分辨率。最后通過回歸網絡(擁有21個卷積核的卷積層)來估計2D熱圖。

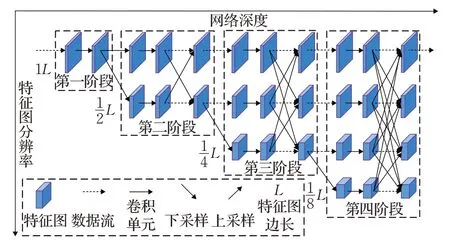

2.1.1 HRNet總體結構

該網絡遵循ResNet[29-30]中各階段的深度分布和各分辨率表示之間通道數成一定倍數關系的設計規則,包含四個階段且相鄰的大小不同的特征圖之間通道數之比為2。對于融合過程,受到文獻[31]中融合多個分支網絡的中間表示方法的啟發,對多個分支進行反復融合以增強各分辨率表示特征。

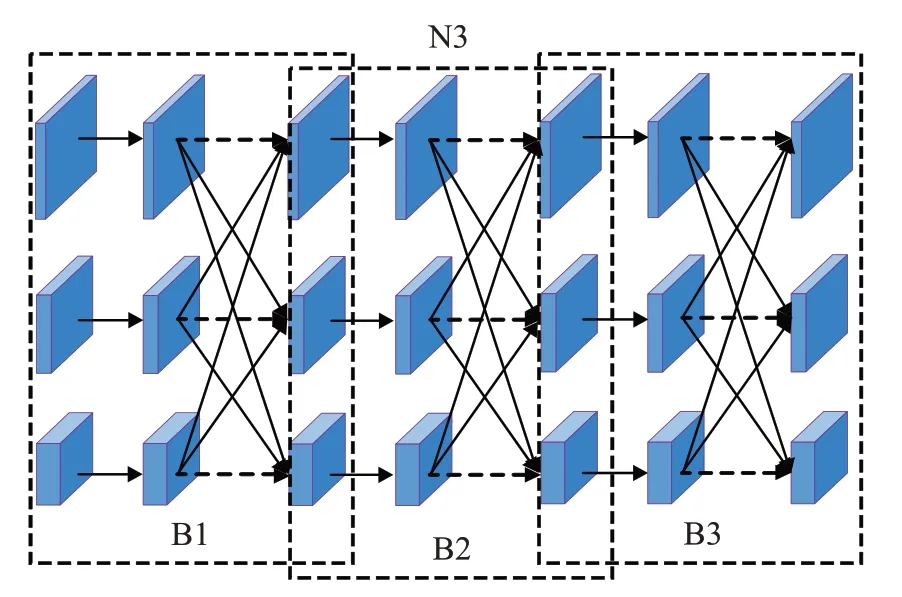

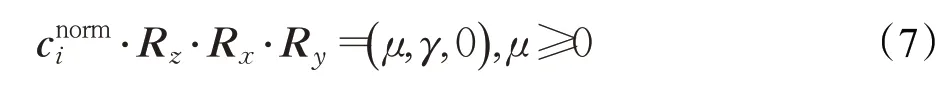

具體的,HRNet由四個并行連接的多個分辨率子網絡和四個階段組成。除第一行子網絡外,其他并行子網絡的第一個輸入由上一行特征圖下采樣而來,邊長是其一半,通道數是其兩倍。除第一階段外,其余各階段由高到低分辨率子網絡構成并通過融合單元(融合單元說明見2.1.2 節)交換多個分辨率子網絡之間的信息。網絡結構如圖2 所示,數據流表示特征圖沒有經過任何處理,水平方向和垂直方向分別表示網絡的深度和特征圖分辨率大小,融合方式為值相加。第一階段包含了4 個殘差單元,每個殘差單元是寬度為64 的瓶頸網絡(bottleneck)。第二、三、四階段分別含有1、3、3 個融合塊,每個融合塊由對應多個分辨率的卷積單元和一個融合單元組成,而每個卷積單元又有四個殘差單元,每個殘差單元包含兩個3×3 卷積核和不進行任何操作的跳轉連接部分。

圖2 HRNet結構簡圖

本次實驗的網絡中,各并行子網絡的卷積通道數分別為32、64、128、256,對應特征圖邊長分別為64、32、16、8。

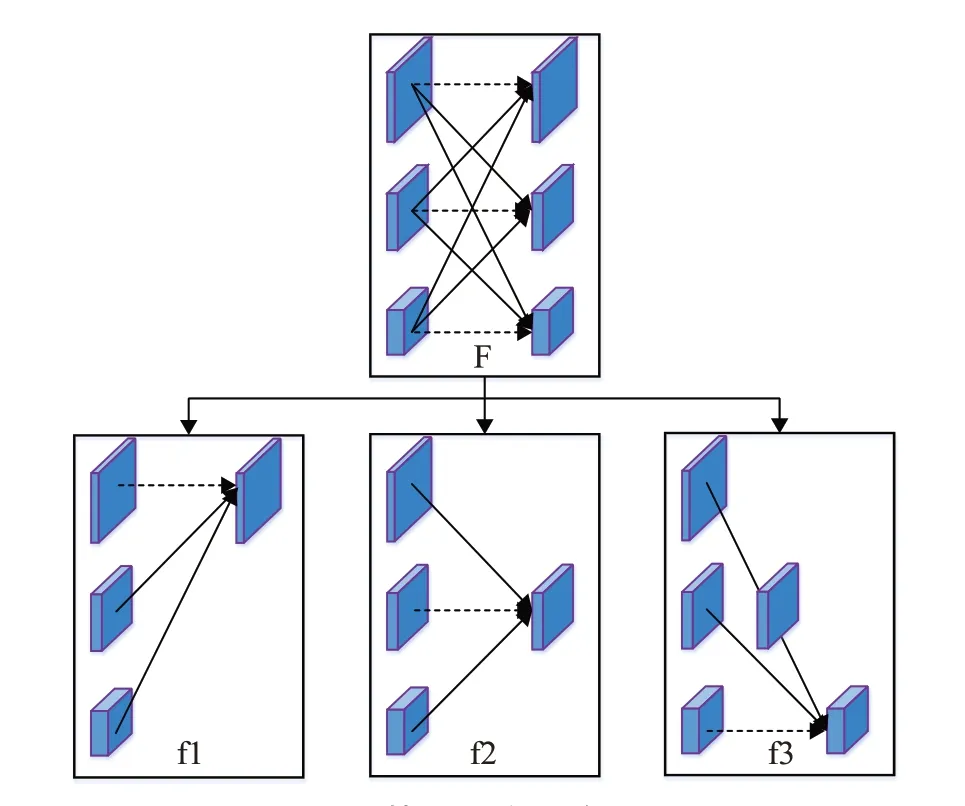

2.1.2 多尺度特征融合

為進行反復的多尺度融合,在網絡的同一階段不同子網絡間引入融合單元,以便于每個子網絡能接收來自其他并行子網絡的信息。融合單元能將多個分辨率子網絡輸出的特征圖多次融合成對應多個分辨率子網絡的輸入。如圖3所示,將第3階段融合單元F分為f1、f2、f3三個部分進行從高到低分辨率特征圖融合,下采樣使用卷積核為3×3,步長為2的卷積層,上采樣采用最近鄰插值方法。對于f3,虛線方塊體表示第一次下采樣的特征圖,然后對此再進行下采樣得到目標特征圖。

圖3 第三階段融合單元

在融合單元中,輸入有n個不同分辨率的特征圖:{X1,X2,…,Xn},輸出也有n個不同分辨率的特征圖:{Y1,Y2,…,Yn},并且輸出的各特征圖的分辨率大小和寬度(寬度為特征圖個數)與輸入一樣,從圖3中可以看出這一點。

輸出Ym=,函數s(Xi,m)包含下采樣或上采樣操作以使處理后的特征圖分辨率大小保持一致。例如,當特征圖邊長為1L,而目標特征圖邊長為時,用一個大小為3×3,步長為2 的卷積核進行下采樣。如果目標特征圖邊長為,則用兩個連續的大小為3×3,步長為2 的卷積核進行兩次下采樣,以此類推。對于上采樣,用最近鄰插值方法放大特征圖。為保證上采樣后的特征圖寬度與目標一致,在上采樣前要先經過1×1大小的卷積核處理。如果i=k,則不需要經過任何操作,如圖3中的虛線箭頭。

為直觀地表示某一階段處理過程,此處以第三階段N3 為例,如圖4 展示了該階段有三個融合塊B1、B2、B3,且每個融合塊包含了三個并行卷積單元和一個融合單元。

圖4 第三階段網絡結構圖

2.1.3 損失函數

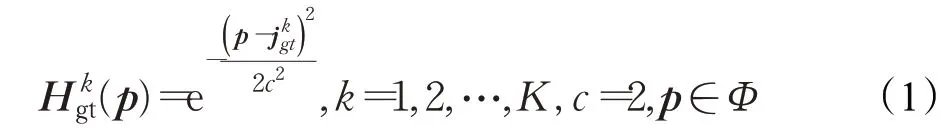

在HRNet后添加一個通道數為K的卷積層來回歸熱圖。損失函數LH定義為預測熱圖Hpred與真值熱圖Hgt的均方誤差,其中真值熱圖使用標準差為2 的高斯函數得到,其中心在每個關節點的位置上。真值熱圖:

Φ為熱圖上的像素點位置。損失函數LH公式如下:

2.2 基于視角不變的3D手姿態估計

2.2.1 3D手姿態坐標的表示

定義相機坐標系內3D 手姿態坐標為ck:ck=(xk,yk,zk)。為解決絕對坐標中手姿態的偏移和尺度模糊問題,采用平移不變(見公式(3))和尺度不變(見公式(4))的方法將絕對坐標標準化,過程如下:

表示相對坐標,cr為手掌關節坐標,此時手掌關節為坐標原點。然后將標準化:

其中,表示標準坐標,s為中指掌指關節(如圖5中的m)與中指近端指間關節(如圖5中的p)之間的歐式距離。

為使網絡學習到全局旋轉視角不變的手姿態,將轉換成規范坐標系[8]內坐標即規范坐標,公式如下:

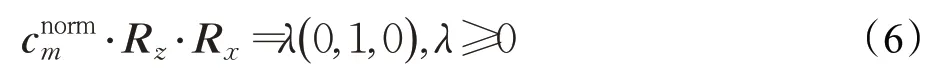

R()是一個3×3 的變換矩陣,其通過兩個步驟計算得到。首先,將中指掌指關節依次繞著z、x軸旋轉使該關節落在y軸上(即讓圖5 中線段加粗部分om與y軸對齊)以計算出Rz,Rx:

然后將經過式(6)變換后的小指掌指關節(如圖5中的i)繞著y軸旋轉使該關節的z值為0計算出Ry:

經過上面兩個變換步驟后,最終的標準坐標到規范坐標的變換矩陣表示如下:

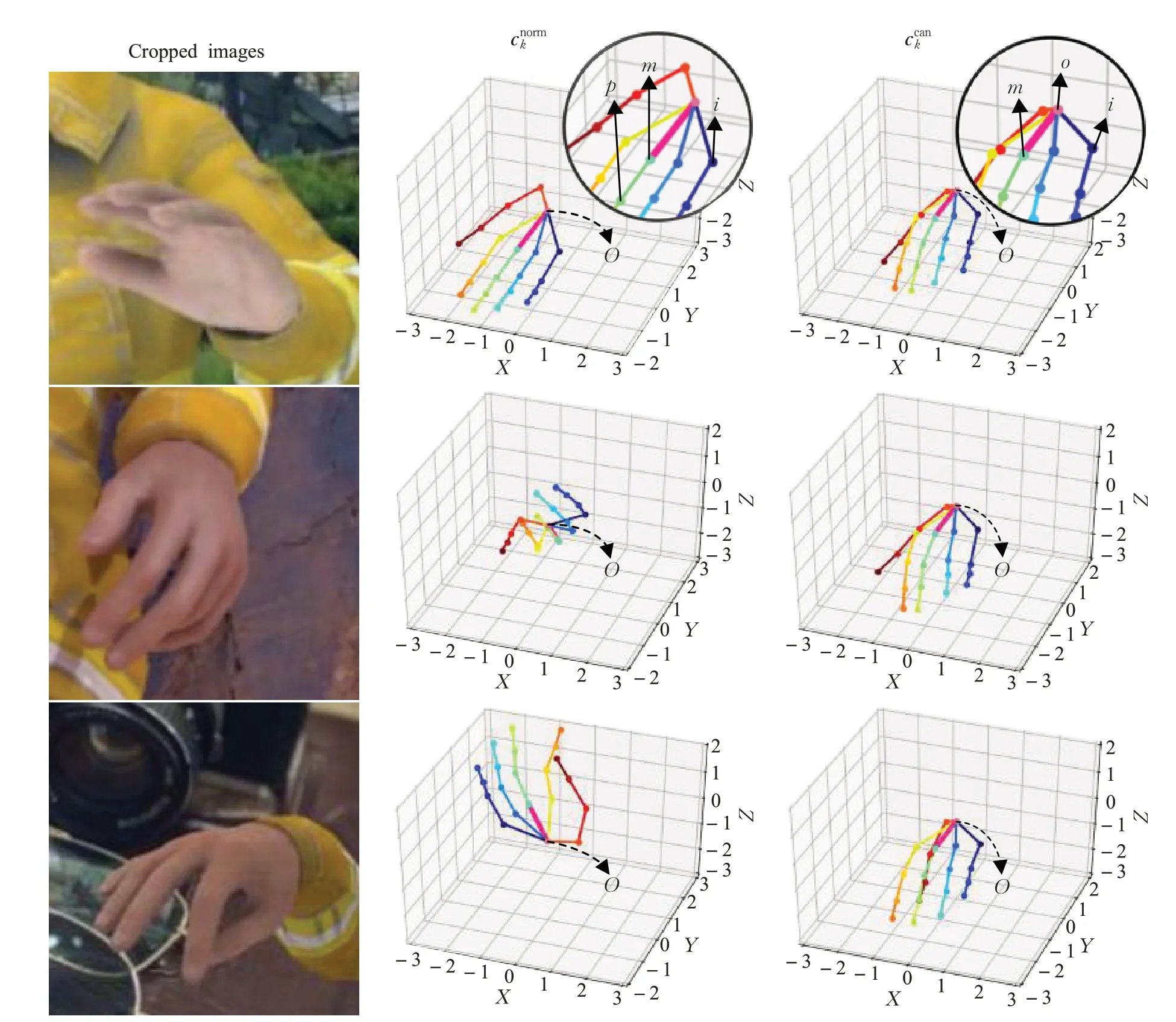

由于左、右手之間存在對稱關系,因此當目標是右手時,可以沿著z軸翻轉右手,左手情況下坐標不變。圖5 給出了標準坐標和規范坐標的幾張示例圖,可以看出標準坐標的手姿態方向變化較大,而規范坐標的手姿態方向基本一致。

圖5 不同坐標表示的手姿態

2.2.2 2D熱圖到3D姿態估計網絡

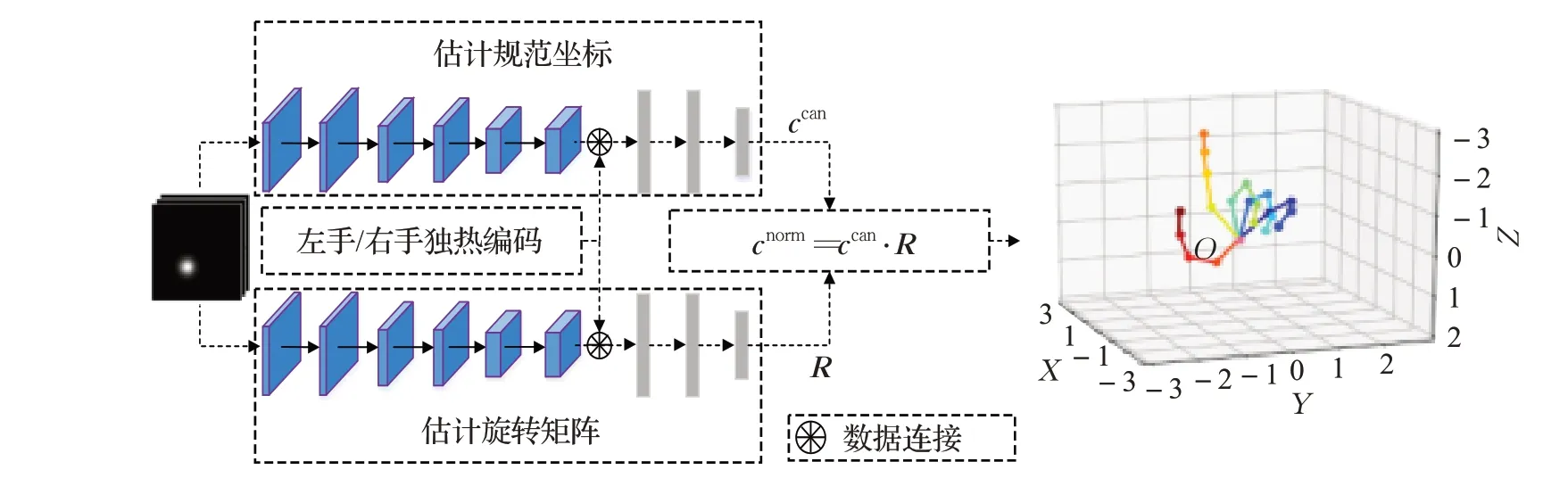

為方便描述,后文將和中的下標k去掉。在第2.1節得到2D熱圖的基礎上,使用文獻[8]中的姿態先驗網絡來估計標準坐標。該網絡有兩個并行的處理流,一個用于估計樣本的規范坐標ccan,另一個估計旋轉矩陣R。R為R(cnorm)-1,可看作樣本從規范坐標轉換回標準坐標的視點。兩個處理流結構一致,只是參數不相同,都先使用六個卷積層得到特征表示,然后與圖像顯示左手或右手的獨熱編碼(One-Hot Encoding)連接起來,再通過三個全連接層分別估計規范坐標ccan和對應視點R。然后標準坐標cnorm可由式(5)推斷得出。網絡結構如圖6 所示,這里實線箭頭表示一個卷積層,長方形條表示一個全連接層。

圖6 3D手姿態估計網絡

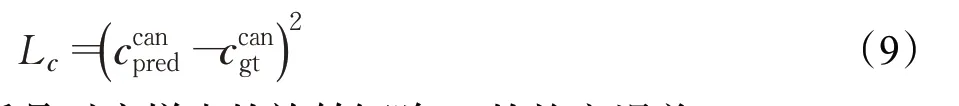

2.2.3 損失函數

該網絡包含兩個損失,首先是規范坐標ccan的均方誤差:

然后是對應樣本的旋轉矩陣R的均方誤差:

總損失為Lc和LR之和。

3 實驗及結果分析

3.1 數據集及預處理

為驗證本文方法的有效性,在RHD、STB和Dexter+Objec(tD+O)數據集上進行了實驗。

RHD數據集[8]是人工渲染合成的數據集,訓練集有41 258張圖像,測試集有2 728張圖像,圖像的分辨率為320×320,每張圖像都擁有2D 和3D 標簽以及對應的手部掩模,本文實驗只用到前兩種標簽。

STB數據集[32]是真實世界中采集的數據集,按六個不同的背景和難易兩類手姿態被分為12 份,每份有1 500張圖像,其中10份當作訓練集,另外2份當作測試集。每張圖像的分辨率為640×480,同樣實驗中用到了2D和3D關節標簽。

D+O數據集[33]是手與物體交互的數據集,其根據手與物體不同的交互動作劃分為6 份,總共有3 145 張圖像,每張圖像的分辨率為640×480。該數據集對手部只提供五根手指的指尖坐標。

RHD和STB數據集的區別:

(1)RHD 數據集21 個關節包括手腕和五個手指各手指的掌指關節、近端指間關節、遠端指間關節、頂端指間關節,而STB數據集其中一個關節點不是手腕而是手掌心。

(2)關節排序不一致。

由于網絡的輸入是以手為中心的裁剪圖像,而且數據集之間存在差異,因此需要對原圖和標簽進行預先處理,以使網絡能順利學習到手的特征。具體處理如下:

(1)以STB手部關節位置為參考,將RHD的手腕坐標與中指掌指關節坐標求均值得到掌心坐標。

(2)調整RHD數據集中手部關節順序,使其與STB數據集關節順序一致。

(3)以中指掌指關節坐標為手的中心位置,找到能包含所有關節點的最小正方形框,并縮放到256×256大小。為使裁剪的圖像能將手完全包含進去,將這個最小正方形框邊長放大了0.25 倍。當然在評估的時候手會被還原到原始大小,以保證數據對比的公平性。

特別的,由于D+O 數據集對手部只提供五根手指的指尖坐標,不能通過手的關節坐標得到以手為中心的裁剪圖片,且無法獲得相對坐標,因此本文不對其進行定量分析,只做定性實驗,從視覺上體現出本文方法對復雜場景下的手姿態估計仍具有一定效果。為了從該數據集中提取手的部分,使用文獻[8]的分割網絡來裁剪出手部圖像并縮放到256×256大小,然后用此圖像作為本文網絡的測試集進行實驗。

3.2 實驗細節

實驗由2D 姿態估計網絡和3D 姿態估計網絡兩部分組成。對于2D姿勢估計網絡,其訓練分為兩次,第一次只使用RHD 數據集初始化該網絡參數,第二次則在第一次基礎上用STB和RHD數據集混合訓練網絡。兩次訓練輪數都為20,學習率前10 輪為10-3,后10 輪為10-4。3D姿態估計網絡的訓練過程與2D姿態估計網絡的類似,但兩次訓練輪數都為25,前15 輪的學習率為10-5,后10輪為10-6。兩部分網絡一次性訓練的樣本數據量都為16。實驗在Pytorch 深度學習框架上實現,GPU型號為NVIDIA RTX 2080 Ti。

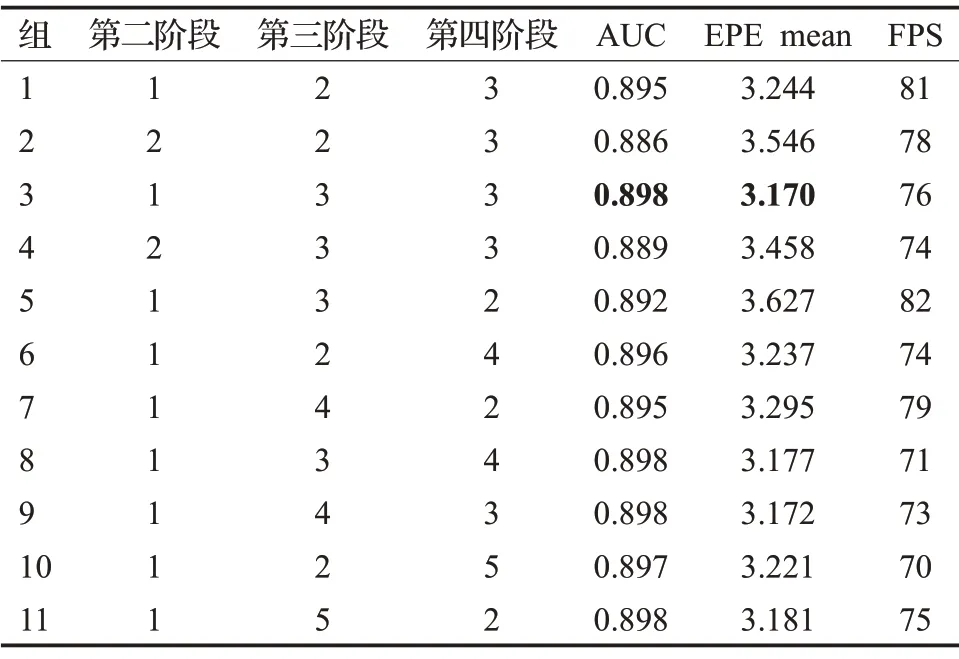

3.2.1 HRNet各階段融合塊數量的確定

網絡包含了多個階段,各階段融合塊數量的合理配比決定了網絡的性能(第一階段不需要多尺度融合,因此沒有融合塊)。在保證網絡的精準度和處理速度的前提下,在RHD數據集上做了11組實驗,如表1。該表中FPS表示測試時每秒評估樣本的速度,AUC和EPE兩個評估指標說明見3.3.1 節。從表1 中第1、2、3、4 等四組實驗結果對比可知當第二階段融合塊數量大于1 時AUC 值有所下降,這可能是由于層次(深度)過深的較高分辨率表示對生成后續階段的低分辨率表示不夠友好導致的,因此第二階段融合塊數量設置為1即可。由表1 中第1、6、10 和5、7、11 等6 組實驗結果可知當第三或第四階段融合塊數量為2,增加第四或第三階段融合塊數量時精度都會持續提升,但從EPE mean值可以預見再繼續增加融合塊數量對網絡性能提升并不大,反而增加了網絡運算量降低了估計速度。此外還可以預見這兩個階段融合塊數量間存在一個平衡以使網絡性能最佳,再結合第3、8、9 等3 組實驗綜合考慮第三和第四階段融合塊數量應皆設置為3,此時網絡綜合性能最優。綜上所述,網絡第二、三、四階段融合塊數量應分別設為1、3、3。

表1 HRNet各階段融合塊不同數量的評估結果

3.2.2 混合數據集訓練

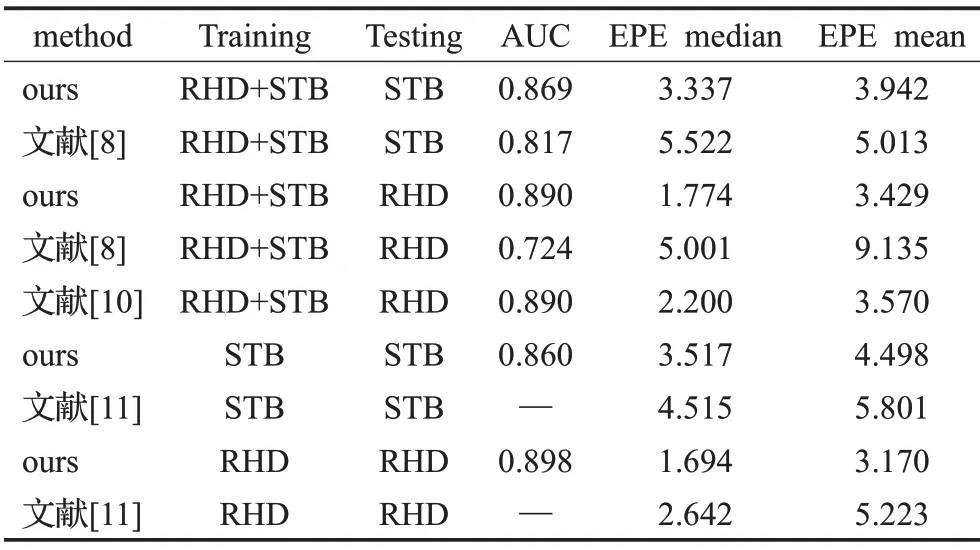

由于STB數據集中真實數據樣本數量有限、視覺多樣性不夠豐富以及標注不完整等方面的問題,加入RHD數據可以充實STB數據集從而提高網絡的泛化能力。本文首先用RHD數據初始化網絡,然后將RHD和STB兩個數據集按照1∶1的比例訓練初始化后的網絡,并用訓練后的網絡進行2D 姿態的估計,實驗結果見表2。由結果可知,混合訓練時在RHD(AUC 為0.890)和STB(AUC 為0.869)數據集上的測試結果都較好,表明該方法能同時學習到兩個數據集的特征分布。文獻[8]在RHD數據集的結果較差的原因可能和數據集訓練的方式有關,其是先用RHD數據初始化網絡,之后再輸入STB 數據微調網絡,這使得網絡在先前RHD 數據上學到的特征被后續在STB數據集的訓練沖淡,因此網絡在RHD數據上的準確性下降,在RHD數據集上的AUC僅為0.724。

表2 不同方法的2D手姿態評估結果

需要注意的是,在3D姿態估計網絡中,由于這兩個數據集的2D 和3D 的轉換關系(相機內置參數)本身存在差異,因此混合訓練時合成數據占比要降低,否則會導致該部分網絡對真實數據預測變差。該部分網絡訓練過程中設置樣本數STB:RHD為6∶1。

3.3 2D手姿態估計

為驗證HRNet 在2D 手姿態估計中的有效性,分別從定量和定性兩個方面進行了實驗。

3.3.1 定量對比

本文與其他文獻[8,10-11]一樣,采用像素上的平均端點誤差(EPE)和在不同錯誤閾值下正確關鍵點百分比下的曲線下面積(AUC)作為評估指標進行數據對比,

其中EPE 值越小表示評估誤差越小,AUC 值越大表示評估精度越高。實驗結果見表2,該表中除本文方法得到的數據外,其他數據來自相應文獻[8,10-11],其中文獻[10]只提供了在RHD 數據集上的測試結果。從表2中看出,在平均端點誤差中位數(EPE median)和均值(EPE mean)上,本文方法均優于獻[8,10-11]。在AUC值上,相比于文獻[8],在STB 數據集上高出約5 個百分點,在RHD數據集上高出約15個百分點。相比文獻[11],在STB數據集上的EPE mean值下降了22.5%,從5.801下降到4.498,在RHD 數據集上的EPE mean 下降了39.3%,從5.223 下降到3.170。與文獻[10]相比,各評估指標數值比較接近,可能是因為該文獻采用了聯合估計的方法,使得2D 與3D 估計能夠相互促進。但即使如此,本文方法仍具有一定優勢。

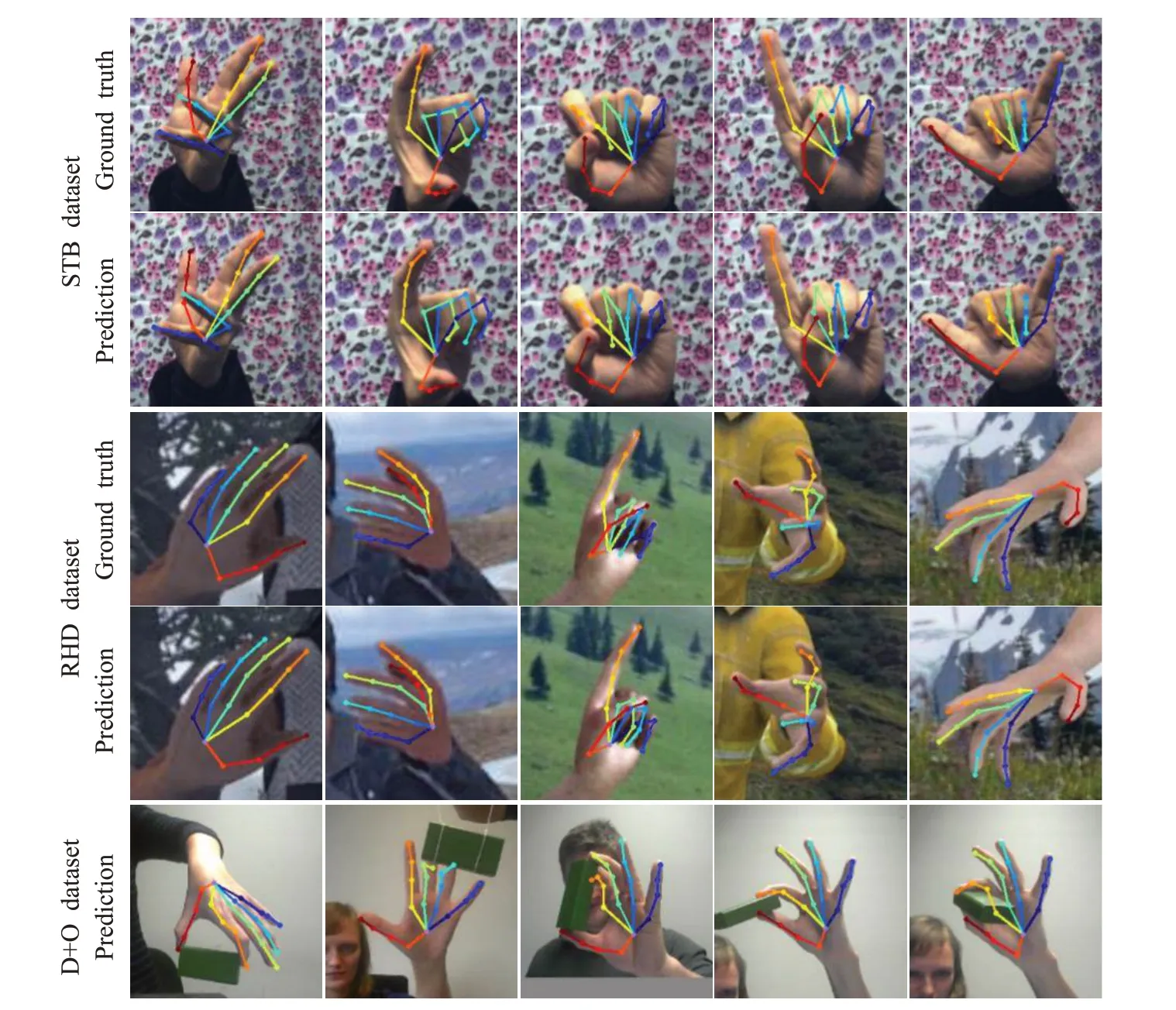

3.3.2 定性結果

為了更直觀地展示2D 關節估計的準確性,將估計結果進行了可視化,如圖7所示。該圖中前兩行是STB數據集,后兩行是RHD 數據集,最后一行為D+O 數據集,其中一、三行為真實標簽,二、四、五行為預測結果。由結果可知,在RHD、STB兩個數據集上的預測均達到了不錯效果。由于訓練集中并沒有類似手與物體交互的圖像,因此對D+O 數據集中被物體遮擋的手關節預測存在一定誤差。

圖7 2D手姿態可視化

3.4 3D手姿態估計

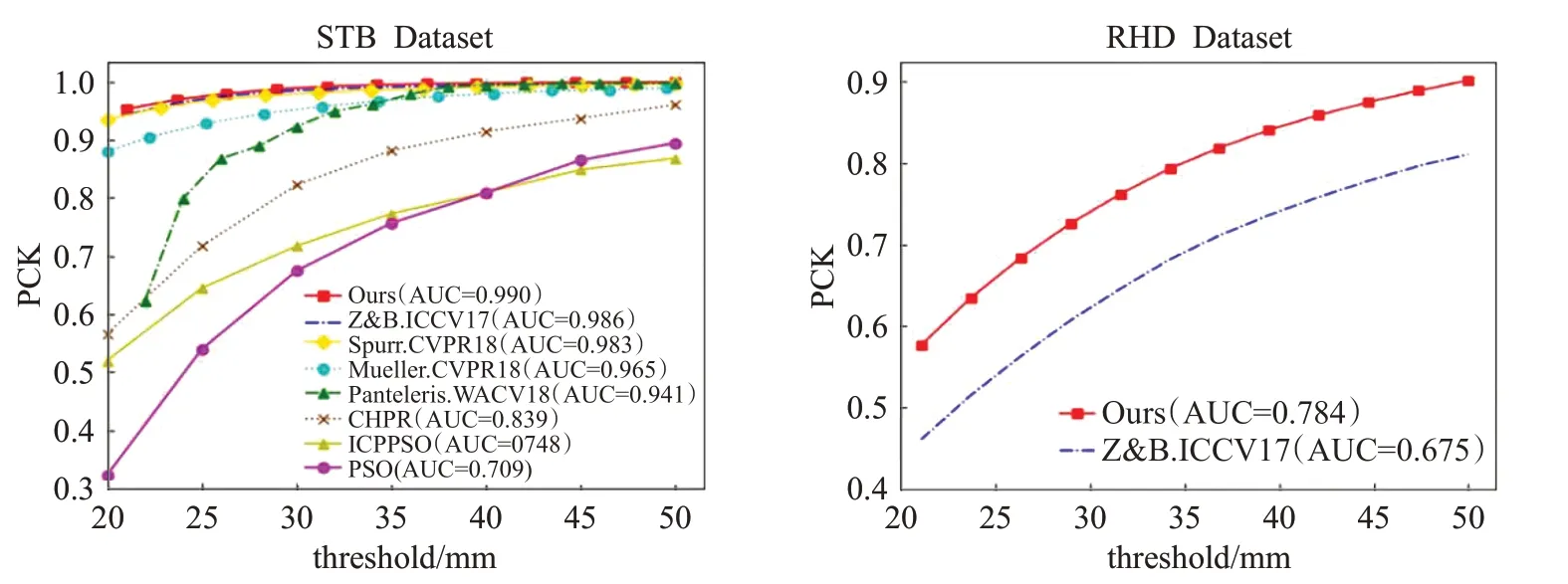

3.4.1 定量對比

本文在STB數據集上和五種先進方法[8-9,27,32,34]得到的3D手姿態效果進行對比,結果見圖8。圖8展示了不同方法在不同錯誤閾值情況下的PCK曲線,左圖為STB數據集上的對比結果,右圖為RHD 數據集上的對比結果,除本文方法得到的數據外,其他實驗數據均來源于文獻[14]。由圖可知,在STB 數據集上,在大多數錯誤閾值上本文方法都優于參與比較的方法。在RHD數據集上,AUC值要比文獻[8]高出0.109。

圖8 不同方法的3D手姿態估計結果對比

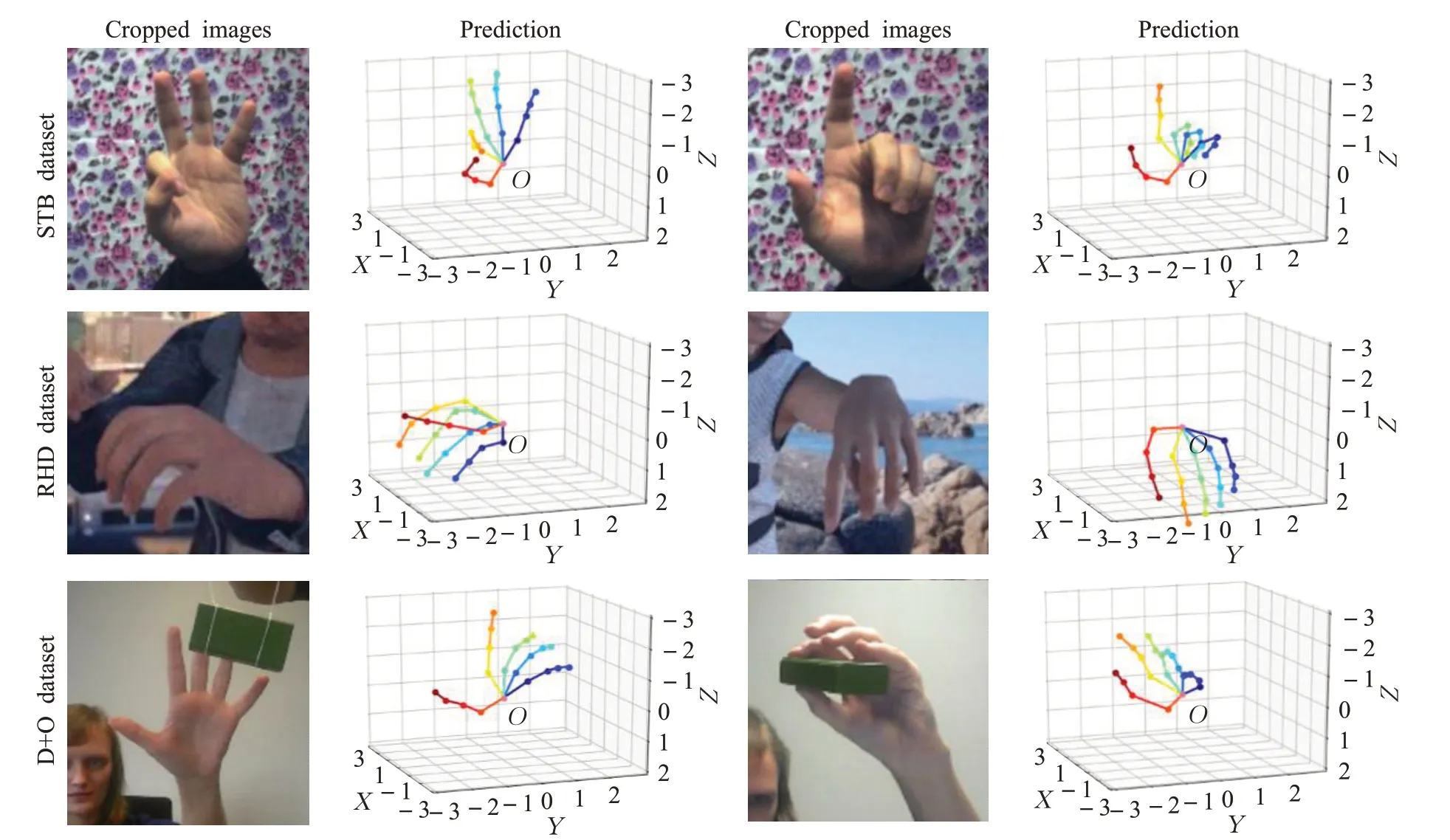

3.4.2 定性結果

同樣的,本文將STB、RHD 和D+O 數據集上的3D手姿態估計的結果以可視化的形式進行了展示,結果如圖9 所示,該圖中一、二、三行分別為STB、RHD 和D+O數據集。與圖5中標準坐標顯示的不同,為了使估計出的姿態效果更明顯,圖9將手姿態的x、y、z坐標順序轉換成z、x、y,并調整了視角到合適的位置,但正面視角與y-z平面垂直。

圖9 3D手姿態可視化

3.5 消融研究

本文在RHD數據集上研究了融合單元和視角不變方法給網絡性能帶來的影響。

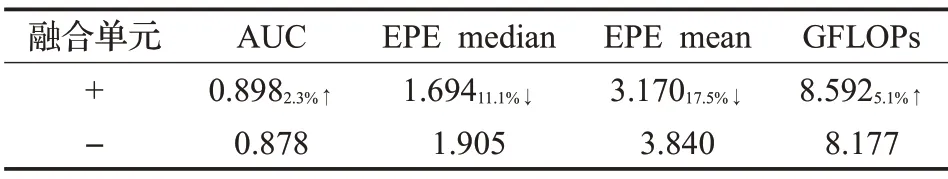

3.5.1 融合單元

對2D 姿態估計網絡中有、無融合單元模塊進行實驗,結果如表3所示。該表中+表示保留所有融合單元,-表示只保留第四階段最后一個融合單元,帶箭頭部分表示相對提升或降低的數值百分比。從該表中可以看出,引入融合單元后網絡性能有所改善,最直觀的表現是AUC 值提升了2.3%。然而,引入融合單元會增加網絡的運算成本,增長比例為5.1%,但在相對其他評估指標改善的前提下,其增加的運算量在可接受的范圍內。

表3 有、無融合單元的結果對比

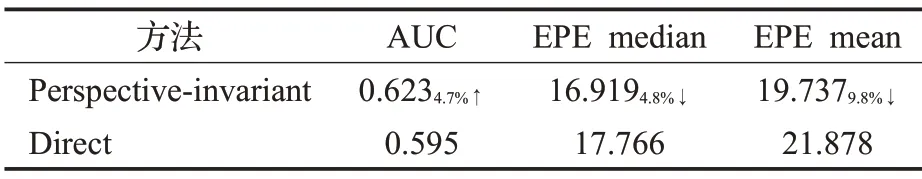

3.5.2 視角不變方法

對視角不變方法與直接估計方法進行3D姿態估計實驗對比,結果如表4 所示。直接估計方法(Direct)表示直接估計標準坐標cnorm而不需要用到規范坐標ccan,其網絡結構與本文估計規范坐標ccan的結構一樣。從表4中可以看出,直接估計方法的精度要低于視角不變方法,表明估計規范坐標和旋轉矩陣R要比直接估計標準坐標更有效。可以理解為把一個相對困難的問題(直接估計標準坐標)劃分成兩個較容易的問題(分別估計規范坐標和旋轉矩陣),從而降低了網絡學習難度。

表4 視角不變和直接估計的結果對比

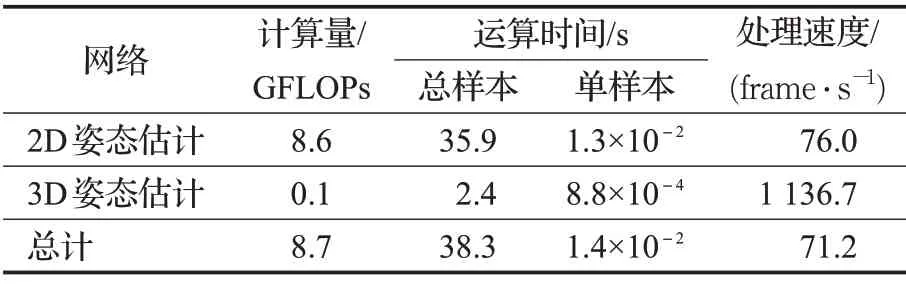

3.6 網絡實時性

本文在RHD測試集上分別對2D和3D姿態估計網絡的運算實時性相關數據進行了統計,各項數據見表5。從該表中可知,在整個估計過程中2D 姿態估計占用了絕大多數的計算量,達到了86億次浮點運算(文獻[8]為258 億次),這與HRNet 本身的并行結構以及多個融合塊的設計有關,而3D 姿態估計網絡由兩個簡單的并行處理流組成,其計算量僅為1億次。本文方法平均處理一張圖像的時間約為0.014 s,處理速度達到了每秒71張,實時性較高。

表5 網絡實時性相關數據統計

4 總結

針對現有手姿態2D關鍵點熱圖估計或手姿態特征提取方法存在的問題,本文引用了一種多尺度高分辨率保持的網絡來估計熱圖,有效地提升了2D 手姿態估計的準確性。之后,使用全局旋轉視角不變的方法將2D熱圖映射到3D 姿態。在上述方法上,使用三個公開數據集數(STB、RHD、Dexter+Object)分別對2D 和3D 姿態估計進行了實驗,結果顯示了本文方法的有效性。考慮到未來手姿態估計可能會向密集的3D 手形發展,如何將HRNet應用到其中成為接下來的研究方向。