用于人體實例分割的卷積神經網絡

鞠成國 王國棟

摘要:針對當前的實例分割算法無法分割兩個高度重疊的人體對象,且量化的Mask實例與其ground truth之間的IoU的Mask質量通常與分類分數相關性不強等問題,利用人體骨骼和姿態來對人體進行分割,增加一個全新的Evaluation模塊,利用預測Mask與ground truth之間的IoU來描述實例分割質量,提出了一種直接學習IoU的網絡,能夠提高實例分割的質量。為了獲得更加豐富的特征信息,采用ResNet和FPN網絡進行特征提取,融合多層特征的信息,使分割結果更加準確。實驗結果表明,提出的網絡框架對人體分割的結果更加準確,具有更加優越的魯棒性。

關鍵詞:卷積神經網絡;FPN;Evaluation模塊

中圖分類號:TP291

文獻標志碼:A

文章編號:1006-1037(2021)01-0034-06

基金項目:國家自然科學基金(批準號:61901240)資助;山東自然科學基金(批準號:ZR2019MF050, ZR2019BF042)資助。

通信作者:王國棟,男,博士,副教授,主要研究方向是人工智能、深度學習。E-mail:doctorwgd@gmail.com

近年來,由于對現實生活中應用的大量需求,計算機視覺領域中有關“人”的研究越來越受到關注,例如:人臉識別[1-6],行人檢測[7-9]和跟蹤,異常行為檢測等。其中許多已經在現實生活中產生了實用價值。在此之前,已經有許多實例分割的算法[10-11],目前比較流行的主流的方法是基于深度學習的分割方法[12-14],例如:ResNet、Fast R-CNN、Faster R-CNN、Mask R-CNN、PANet[15-19]等網絡結構,對實例分割的算法基本類似:首先生成圖像中的多個候選區域,然后在生成的候選區域中,用非極大值抑制算法(NMS)從中刪除不符合要求的候選區域。但是,當圖像中存在兩個高度重疊的對象時,NMS會將其中的一個邊界框視為重復的候選區域并將其刪除,表示這些算法無法區分高度重疊的兩個對象。而人在生活中普遍會出現緊密相連的畫面,所以用上述基于候選框的方法存在某個人不能被分割出來從而造成實驗結果的不準確。除此之外,在當前的網絡框架中,檢測的分數(即假設由分類得分中最大的元素決定)由于背景雜波、遮擋等問題,分類分數可能較高,但Mask質量較低,利用候選框得到的實例Mask的分數通常與box分類置信度有關,使用分類置信度來度量Mask質量是不合適的,因為只用于區分proposal的語義類別,而不知道實例Mask的實際質量和完整性。通過對上述問題的研究,本文發現利用人體骨骼的特殊性能夠更好的把圖片中的人精準的分割出來,從而避免了候選框所帶來的漏檢情況,所以本文利用人體骨骼對人體分割,通過人體的關鍵點將人體骨骼連接起來,利用人體姿態[20-23]對人進行準確的分割;提出了一個全新的模塊Evaluation模塊,該模塊的作用是使IoU在預測的Mask及其ground truth的Mask進行回歸,該模塊解決了Mask得分情況與其Mask質量不匹配的情況。

1 基本原理

本文提出一個全新的模塊,用來計算Mask分支得到的Mask與ground truth對應的Mask之間的像素級別的IoU值(以下簡稱IoU),來衡量分割的精確程度。首先選用ResNet50網絡作為特征提取網絡,ResNet網絡事實上是由多個淺的網絡融合而成,避免了消失的梯度問題,所以能夠加速網絡的收斂。

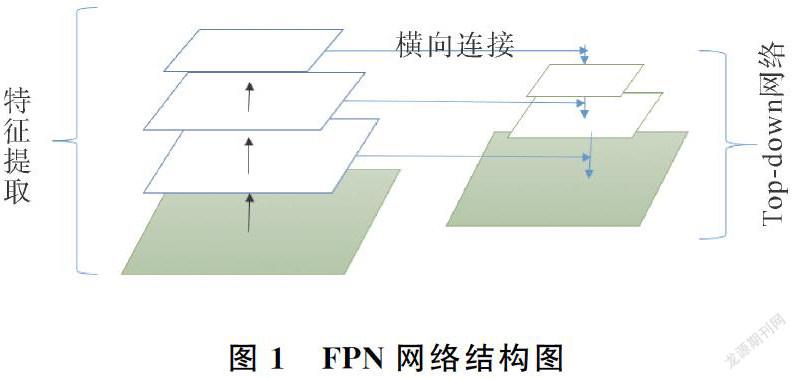

網絡結構采用FPN網絡[24]進行特性提取。把低分辨率、高語義信息的高層特征和高分辨率、低語義信息的低層特征進行自上而下的橫向連接,使得所有尺度下的特征都有豐富的語義信息。FPN網絡可以在增加較少計算量的前提下將處理過的低層特征和高層特征進行累加,因為低層特征可以提供更加準確的位置信息,高層特征能夠提供比較細節的信息,利用深層特征可以將復雜的目標區分開來;利用比較深層次的網絡來構造特征金字塔,可以增加魯棒性[25-26]。FPN的大致內容包括:自底向上、自頂向下和橫向連接。

自底向上(Bottom-top):也就是特征提取網絡,即較低層反映較淺層次的特征圖邊緣信息等;較高的層則反映較深層次的特征圖物體輪廓、乃至類別等。

自頂向下(Top-bottom):上層的特征輸出特征圖比較小,但卻能表示更大維度的圖片信息。此類高層信息對后續的目標檢測、物體分類等任務發揮關鍵作用。因此在處理每一層信息時會參考上一層的高層信息做其輸入,將上層特征圖等比例放大后再與本層的特征圖做橫向連接。

卷積特征與每一級別輸出之間的表達關聯:使用1×1的卷積即可生成較好的輸出特征,可有效降低中間層次的通道數目,使輸出不同維度的各個特征圖有相同的通道數目。網絡結構如圖1所示。

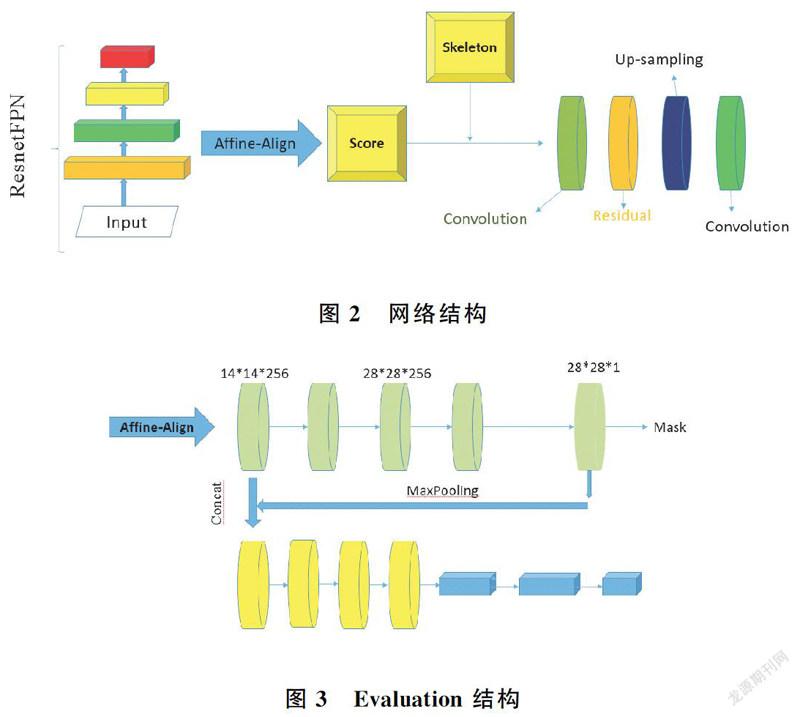

為了解決人體遮擋、重疊等不良因素,利用人體的骨骼特征來對人體進行分割。人類骨架更適合用來區分兩個重合面積很大的人,相比邊界框,可以提供更清晰的個人信息。實例分割中,大多數分割框架都采用實例的置信度作為Mask質量分數。然而,被量化為Mask實例與其ground truth之間的IoU的Mask質量通常與分類分數相關性不強,所以本文提出一個全新的模塊,用來計算Mask分支得到的Mask與ground truth對應的Mask之間的像素級別的IoU值,來衡量分割的精確程度。整體網絡框架如圖2所示。

借鑒AP指標,實例分割利用預測的Mask與ground truth的Mask之間的像素級相交過并(IoU)來描述實例分割質量,提出了一種直接學習IoU的網絡。在本文中,IoU表示為Evaluation。通過將預測的Mask分數來重新評估分割精準程度。

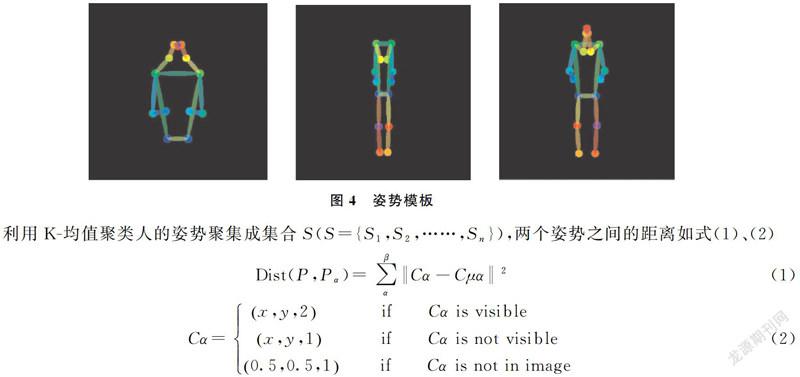

學習Evaluation不同于proposal classification或Mask prediction,需要將預測的Mask與object feature進行比較。本文提出了一個名為Evaluation head的Mask預測網絡,以Mask分支的輸出和由對齊模塊Affine-Align處理的RoI特征作為輸入,使用簡單的回歸損耗進行訓練。大量的實驗結果表明,本文的方法提供了一致和顯著的性能改進,這歸因于Mask質量和Score之間的一致性。網絡結構如圖3所示。

本文提出的利用人體骨骼來進行人體分割的打分機制的卷積神經網絡主要有以下特點:通過FPN網絡采用多尺度融合的方式,各個層級都有豐富的語義信息;提出打分機制, 加入Evaluation分支,直接學習IoU的網絡,通過計算IoU值,來衡量分割的精確程度。

2 實驗過程

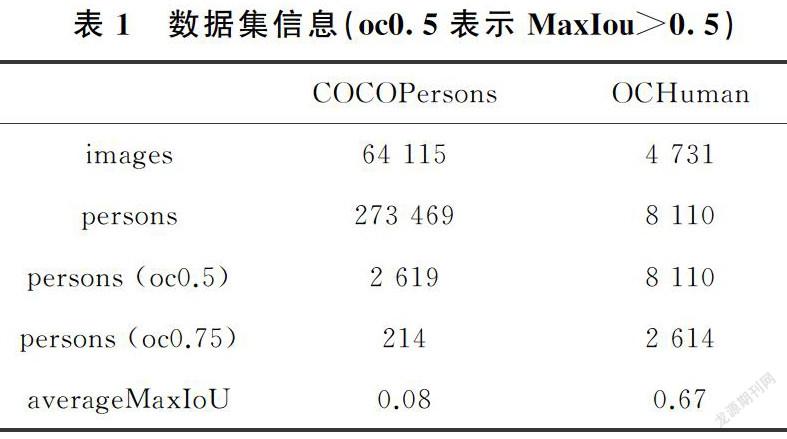

本文利用K-均值聚類生成的人體姿勢模板,生成的姿勢模板符合日常生活最普遍的姿勢,半身和全身,其中全身分為前視圖和后視圖,如圖4所示。

利用K-均值聚類人的姿勢聚集成集合S(S={S1,S2,……,Sn}),兩個姿勢之間的距離如式(1)、(2)

其中,Pu是姿勢集合中Sn的平均值,并將Pu>0.5關鍵點作為有效點,Cα表示人體關鍵點的坐標。用式(1)、(2)定義兩個人之間的距離:(1)首先使用其邊界框裁剪每個實例的正方形RoI,然后將目標及其姿勢坐標放到RoI的中心;(2)將此平方RoI的大小調整為1×1,以便將姿勢坐標都歸一化為(0,1);(3)僅計算數據集中包含8個以上有效點的那些姿勢,以達到姿勢模板的要求。有效點太少的姿勢無法提供有效的信息,并且會在K-均值聚類期間充當離群值舍棄。最普遍的兩個姿勢就是半身姿勢和全身姿勢(全身后視圖和前視圖,如圖4所示),也符合日常生活,其他的姿勢通過放射變換矩陣盡可能的向其轉換。

數據集有兩部分,COCO數據集和OCHuman數據集,COCO數據集是一個大型的、豐富的物體檢測,分割和字幕數據集。但是在本文中COCO數據集使用僅含有人的圖片來進行訓練,由于公共數據集很少同時有人體姿勢和人體實例分割標簽,COCO數據集是同時滿足這兩個要求的最大數據集,因此所有模型都在COCOPersons訓練集中進行,并帶有姿勢關鍵點和分割Mask的注釋;OCHuman數據集包含4 731張圖像中的8 110個人類實例, 每個人類實例都被一個或多個其他實例嚴重阻擋。使用MaxIoU來衡量被遮擋對象的嚴重性,MaxIoU> 0.5的那些實例稱為重度遮擋,并被選擇構成此數據集。OCHuman平均每個人的平均MaxIoU為0.67,是與人類實例相關的最具挑戰性的數據集。見表1。

3 實驗結果

在上述兩個數據集上評估了本文提出的方法:(1)OCHuman是最大的驗證數據集,主要適用于被嚴重遮擋的人;(2)COCOPersons(COCO的人員類別)[28],其中包含日常生活中最常見的情況。實驗中,對OCHuman數據集進行測試,對人的遮擋和重疊進行了測試,而COCO數據集僅訓練“人”這一類別。

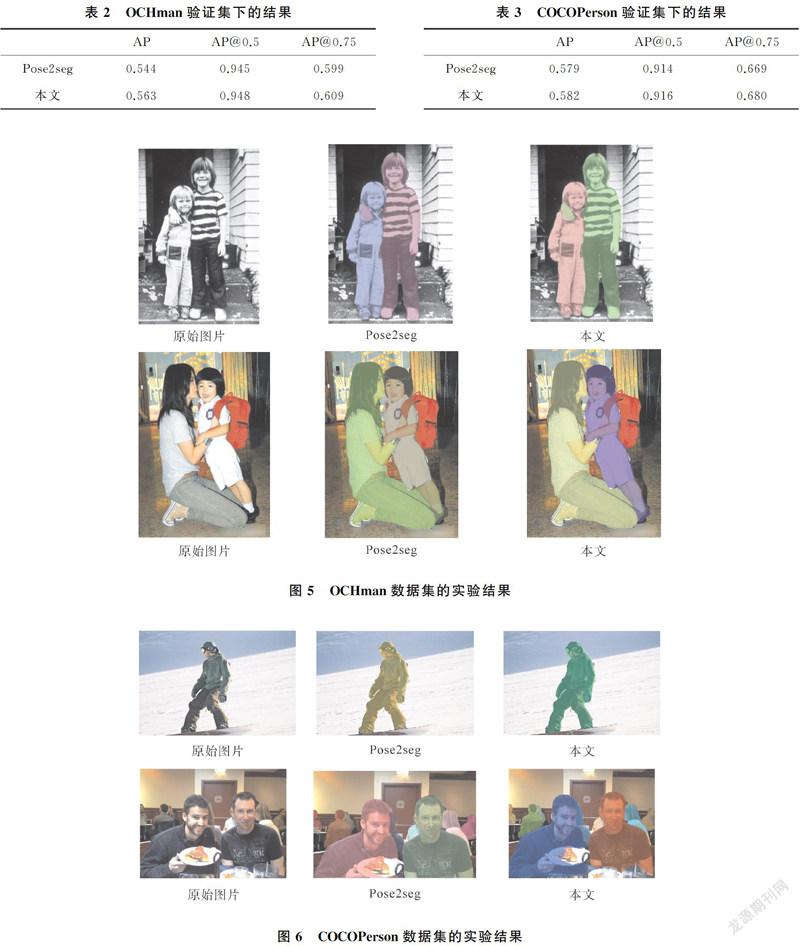

實驗結果如表2、表3、圖 5、圖6所示,本文提出的模型優于Pose2seg模型,具有更好的穩定性。首先,在OCHuman上的實驗結果有比較明顯的提升,比Pose2seg提高了1.9AP,對于AP@0.5和AP@0.75也有不同程度的提升[29]。其次,由COCOPerson數據集中的實驗結果可以看出,在一般情況下,本文提出的算法是可行的,對人體分割的精度有所提升。

4 結論

本文通過人體骨骼和Evaluation模塊(計算Mask分支得到的Mask與ground truth對應的Mask之間的像素級別的IoU值,來衡量分割的精確程度)對人體進行分割,提出的打分機制可以很好地預測Mask的質量,利用FPN網絡很好的能夠融合多層特征圖的語義信息和人體特有的骨骼信息,能夠很好的對人體進行分割。通過測試OCHuman數據集,結果表明,本文提出的Evaluation模塊對人體分割有明顯的提升。

參考文獻

[1]LIU S, ZHANG Y Q, YANG X S, et al. Robust facial landmark detection and tracking across poses and expressions for in-the-wild monocular video[J]. Computational Visual Media, 2017, 3(1):33-47.

[2]MA X, LI Y L. Robust sparse representation based face recognition in an adaptive weighted spatial pyramid structure[J]. 2018, 61(1):101-103.

[3]PENG O Y, YIN S Y, DENG C C, et al. A fast face detection architecture for auto-focus in smart-phones and digital cameras[J]. 2016, 59(12):1-13.

[4]WANG J, ZHANG J Y, LUO C W, et al. Joint head pose and facial landmark regression from depth images[J]. Computational Visual Media, 2017, 2(3):1-13.

[5]ZHANG Z P, LUO P, TANG X O, et al. Facial Landmark Detection by Deep Multi-task Learning[C]// European Conference on Computer Vision. Springer, Cham, 2014:633-647.

[6]BRUNELLI R, POGGIO T. Face recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1993, 15(10): 1042-1052.

[7]MAO J, XIAO T, JING Y N, et al. What can help pedestrian detection? [C]// 30th IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, 2017: 6034-6043.

[8]ZHANG L L, LIN L, LIANG X D, et al. Is faster R-CNN doing well for pedestrian detection?[C]// 14th European Conference on Computer Vision (ECCV). Amsterdam, 2016: 443-457.

[9]ZHANG S, YANG J, SCHIELE B. Occluded pedestrian detection through guided attention in CNNs[C]// 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Salt Lake City, 2018:6995-7003.

[10] CHEN H, SUN K, TIAN Z, et al. BlendMask: Top-down meets bottom-up for instance segmentation[C]// 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). IEEE, 2020:112-126.

[11] LI Y, QI H, DAI J, et al. Fully Convolutional instance-aware semantic segmentation[C]// 30th IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, 2017: 4438-4446.

[12] BOLYA D, ZHOU C, XIAO F Y, et al. YOLACT++: Better real-time instance segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, (99): DOI:10.1109/TPAMI.2020.3014297.

[13] HARIHARAN B, ARBELáEZ P, GIRSHICK R, et al. Hypercolumns for object segmentation and fine-grained localization[C]// IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Boston, 2015: 447-456.

[14] DAI J, HE K, LI Y, et al. Instance-sensitive fully convolutional networks[C]// 14th European Conference on Computer Vision (ECCV). Amsterdam, 2016: 534-549.

[15] HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition[C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Seattle, 2016:770-778.

[16] REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 39(6):1137-1149.

[17] HE K M, GEORGIA G, PIOTR D, et al. Mask R-CNN[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 36(2):1-1.

[18] LIU S, QI L, QIN H F, et al. Path aggregation network for instance segmentation[C]// 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). IEEE, 2018: 536-544.

[19] HUANG Z, HUANG L, GONG Y, et al. Mask scoring R-CNN[C]// 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). IEEE, 2020:127-136.

[20] CHEN Y, WANG Z, PENG Y, et al. Cascaded pyramid network for multi-person pose estimation[C]// Conference on Computer Vision and Pattern recognition(CVPR). 2017:733-747.

[21] FANG H S, XIE S Q, TAI Y M, et al. RMPE: Regional multi-person pose estimation[C]//16th IEEE International Conference on Computer Vision(ICCV).Venice, 2016:2353-2362.

[22] LIFKOOEE M Z, LIU C L, LIANG Y Q, et al. Real-time avatar pose transfer and motion generation using locally encoded laplacian offsets[J]. Journal of Computer Science and Technology, 2019, 34(2):256-271.

[23] XIA S H, GAO L, LAI Y K, et al. A survey on human performance capture and animation[J]. Journal of Computer Science and Technology, 2017(32):536-554.

[24] LIN T, DOLLAR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]// Conference on Computer Vision and Pattern Recognition (CVPR).2017:304-311.

[25] CHEN L C, PAPANDREOU G, KOKKINOS I, et al. Deeplab: Semantic image segmentation with deep convolutional Nets, atrous convolution, and fully connected CRFs[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(4):834-848.

[26] LI M, ZHANG Z, HUANG K, et al. Estimating the number of people in crowded scenes by MID based foreground segmentation and head-shoulder detection[C]// 19th International Conference on Pattern Recognition (ICPR 2008), Tampa, 2009:447-456.

[27] CAO Z, SIMON T, WEI S, et al. Realtime multi-person 2D pose estimation using part affinity fields[C]// 30th IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, 2016: 1302-1310.

[28] LIN T Y, MAIRE M, BELONGIE S, et al. Microsoft COCO: Common objects in Context[C]//Europearn Corcference on Computer Vision. Springer, 2014:740-755.

[29] ZHANG S H, LI R L, DONG X, et al. Pose2Seg: Detection free human instance segmentation[C]// IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach, 2019: 889-898.