基于深度學習的人臉識別方法研究

張愛民

(中共渦陽縣委黨校,安徽 亳州 233600)

0 引言

人臉識別是基于人的臉部特征進行身份識別的方法,人臉識別技術在日常交通運輸、門禁管理、信息安全等領域應用越來越廣。人臉識別算法是目前人臉識別技術熱門的研究領域之一[1-2]。傳統神經網絡算法也用于人臉識別技術,但存在人臉識別率偏低的問題。隨著人工智能的不斷發展,深度學習作為一個新的研究方向被引入機器學習,使其更接近人工智能目標。隨著深度學習的發展,傳統的神經網絡人臉識別方法逐漸被基于卷積神經網絡的方法所替代。總體而言,雖然基于深度學習算法的人臉識別方案得到了科學界的研究,但現階段人臉識別技術依舊需要改進和提升效果[3-5]。

FaceNet是谷歌公司推出的采用深度卷積神經網絡的人臉識別算法。目前,二維FaceNet算法的研究比較廣泛,采用深度卷積神經網絡學習將人臉圖像信息映射到歐式空間。空間距離直接與圖片的相似度相關:當識別的兩張人臉在距離十分接近,即說明兩張圖像上的人相似程度很高,進而算法判斷為同一個人。

在實際的人臉識別過程中,機器首先要采集到待判定的圖像或者視頻信息,此時的圖像或視頻信息往往包含一定量的無用背景信息。為提升準確率,先利用MTCNN網絡完成人臉的快速檢測,并對檢測出來的人臉信息進行裁剪,以達到快速去除無用信息提升人臉識別準確率的作用。然后,將前述處理后的圖像放入訓練好的模型以實現人臉識別功能。人臉識別算法采用FaceNet算法,最終輸出人臉識別結果[6-8]。本文以圖像人臉識別為分析對象,提出了一種改進人臉識別的并行FaceNet框架,以提升模型識別的準確率。

1 MTCNN人臉標定法

人臉標定是人臉識別的重要處理步驟之一,其核心思想是通過檢測照片中的信息,進而對圖像中的人臉進行定位,獲得框坐標信息。人臉框坐標信息可以幫助人臉識別算法進一步獲取重要的數學信息。考慮到每個人獨特的人臉身份特征,可以通過細節對比的方法,識別出圖像中人臉的身份結果[9]。實踐中,人臉識別應用越來越廣泛,人臉檢測技術與識別技術已經從單一場景發展到多場景,從室內的攝像設備發展到室外的儀器,可見,人臉識別的環境條件及設備越來越復雜。與此相對,人臉檢測與識別技術仍有一些問題亟待解決,如人臉的表情信息變化幅度過大,人臉基數過多,強光陰暗等條件的影響,口罩等遮面工具的阻礙,濃妝等的影響甚至連人眼都很難分辨。

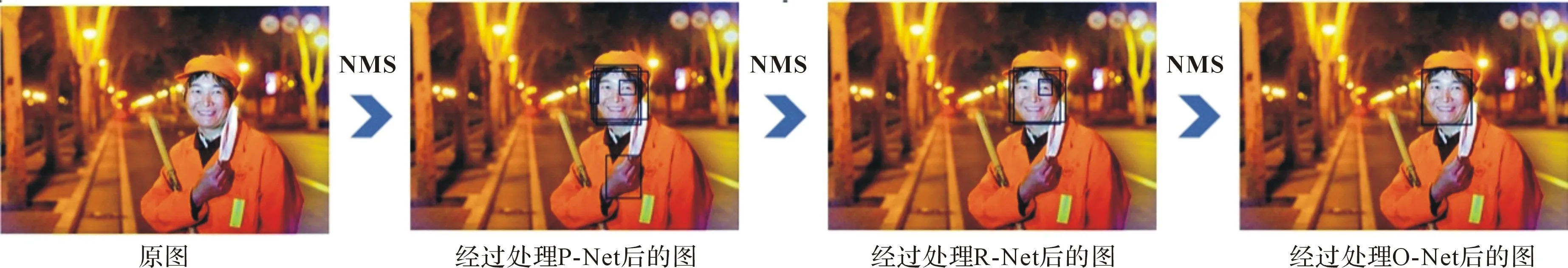

實踐上在人臉檢測和人臉識別中應用比較廣泛的算法是多任務級聯卷積神經網絡(Multi-task Cascaded Convolutional Neural Networks, MTCNN),它是一種基于深度學習的人臉檢測和人臉對齊方法,可同時完成人臉檢測和人臉對齊的任務。和傳統的算法相比較而言,MTCNN具有性能更好,檢測速度更快的特點。MTCNN采用多任務處理,使用3個串行CNN級聯網絡(P-Net、R-Net、O-Net)提取人臉的相關信息,進而實現人臉檢測由繁化簡的過程。考慮到實際應用場景中,機器獲取到的圖像大小并不完全一致,并且人臉大小也不盡相同。為此,需要將圖像進行預處理,即將輸入圖像大小統一尺寸。將處理后的圖像通過P-Net網絡進行處理。P-Net網絡的作用是通過分析圖像生成多種人臉候選框。此后,采用非極大值抑制(Non-Maximum Suppression, NMS)處理后的數據進行計算,并刪除重復的候選框。接下來將經過P-Net網絡截取出來的圖像片段進行尺寸處理并經由R-Net結構進行計算,并再經由NMS算法計算,進而獲得相對準確得人臉框。最后將圖像經過O-Net網絡進行計算,直到最終輸出正確的人臉候選框和人臉特征關鍵點坐標,至此人臉快速檢測算法MTCNN結束。圖1所示為MTCNN的算法訓練流程圖。

圖1 MTCNN算法訓練流程圖

為了訓練好上述的網絡模型,需要保證以下三個任務的損失函數值達到最小。

(1)人臉二元分類任務:考慮到人臉檢測問題的特殊性,可以將人臉檢測問題理解為“需要判斷檢測框內是否存在真實的人臉的信息”,即轉變為二分類問題,以交叉熵作為人臉識別損失函數。其計算公式如下:

Loss1=-(yilogpi+(1-yi)(1-logpi))

(1)

式中:yi為真實標簽,存在人臉為1,不存在人臉為0;pi為經過模型輸出預測為存在人臉的概率(可行性)。

(2)BB回歸任務:針對任意一個候選窗口,均需要計算其到標注框之間的偏離量,其目的是為了更好地實現位置回歸操作,損失函數如下:

(2)

(3)標記定位任務:此項任務需要對人臉的標記點進行位置標記,包括左眼、右眼、左嘴角、右嘴角、鼻子等部位。同平方差損失函數類似,臉部位置標記損失函數如下:

(3)

根據上述任務損失函數設置完成后,考慮到MTCNN模型的三個網絡結構需要完成不同的功能,僅需要設置不同的權重分別乘以三個損失函數并進行加和運算,即可完成MTCNN人臉識別模型的訓練。

2 并行FaceNet人臉識別框架

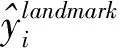

FaceNet的設計理念是驗證所給的圖像中的人臉是否為已經存儲至數據庫的人臉,并且通過人臉識別算法分析并判斷該人臉的姓名信息等[10]。其核心是將人臉圖像映射到一個多維空間,并比較計算所得歐式距離的數值來評判識別人臉的相似與否,最后以矩陣形式顯示出來,給出直觀的識別結果。由于長相差距較小人臉的圖像映射距離短,而不同人臉信息的映射距離長,于是采用算法計算人臉圖像的空間映射即可實現人臉識別功能。圖2所示為FaceNet人臉識別驗證流程圖。

圖2 FaceNet人臉識別驗證流程圖

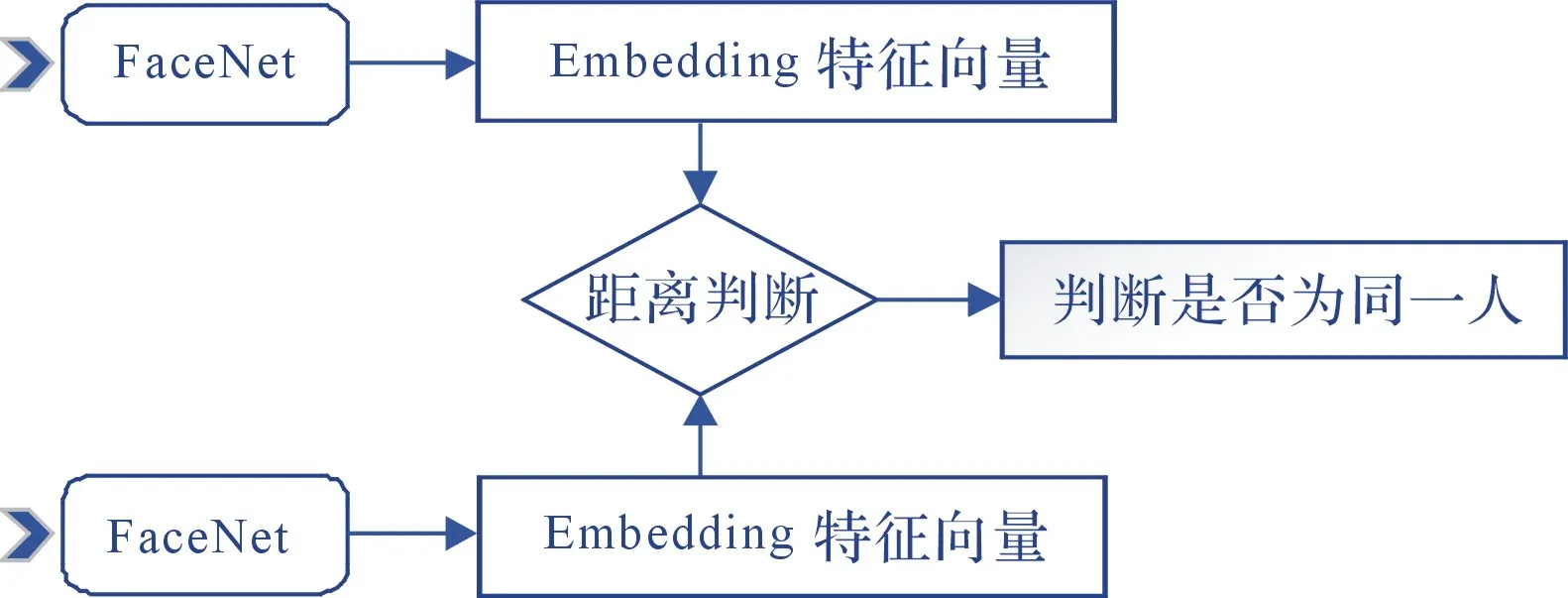

基于傳統串行的卷積神經網絡對于復雜的人臉信息獲取信息不足問題,在前述工作基礎上提出了并行卷積網絡模型架構,其示意圖如圖3所示。

圖3 并行卷積網絡結構示意圖

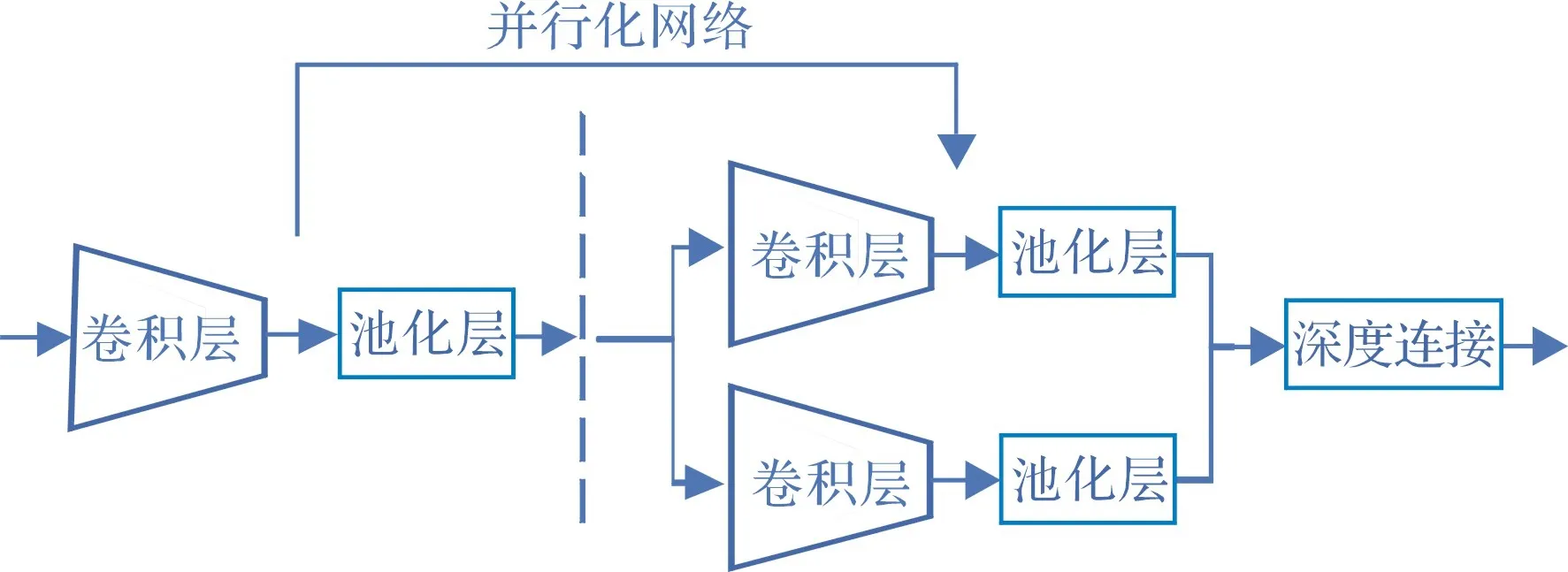

由圖3可知,并行網絡模型架構由m(m≥2)個分支的串行神經網路模型構成,并經由全連接層進行輸出參數合并。通過修改各個分支網絡模型的中的卷積核大小,令不同分支的網絡分別保存不同的特征提取網絡模型參數,進而可以更為精準地獲得輸入圖像更多特征信息。可見,和單分支的網絡模型相比較而言,并行卷積網絡結構具有更好的人臉信息表征能力。為了進一步提升FaceNet人臉識別準確率,基于前述工作,本文在并行卷積神經網絡的基礎上提出了一種并行FaceNet的人臉識別框架模型結構,如圖4所示。

圖4 并行FaceNet模型結構示意圖

根據圖4,并行FaceNet的人臉識別框架模型先采用MTCNN算法所得到的人臉裁剪后的圖片樣本,而后將樣本輸入并行FaceNet網絡模型中,圖像經過并行FaceNet網絡輸出為特征信息,接下來對特征信息進行深度連接(加和求均值)操作。和標準的FaceNet網絡相比較,并行FaceNet網絡可以學習到更多的人臉圖像特征,進而可以更好的進行人臉識別。經深度連接操作后,再經L2特征歸一化生成特征向量,隨后選擇三元組損失函數對模型計算調整。三元損失函數的計算公式如下:

Loss=max(d(a,p)-d(a,n)+argmin,0)

(4)

式中:a為原人臉特征;p為與a同類別的人臉特征;n為與a不同類別的人臉特征;argmin為樣本容量為N的數據集的各種三元組。該損失函數能夠更好學習到人臉的Embedding,即使得相似人臉信息的特征距離盡量趨于無限小,不同人臉信息之間的特征距離趨于無限大。

3 實驗結果與分析

3.1 實驗設置

為了驗證并行FaceNet的人臉識別框架模型的有效性,采用Python3.7進行驗證實驗。采用的數據集為LFW人臉數據集,LFW人臉數據集的人臉圖片如圖5所示,該數據集共有13000多張人臉圖像,總計5700多人。為使實驗結果更加可靠,共選取了20組人臉進行實驗。考慮到實驗數據的真實差異性以及為了方便統計,對人臉數據進行了擴充處理,處理方式包括鏡像復制,旋轉復制以及加噪復制等方法。處理后的人臉圖像總共10000張,每一組人臉圖像為500張,尺寸大小統一轉變為64×64×3(3表示3原色)。人臉數據訓練集與測試集按照9∶1的比例進行劃分,即9000張人臉圖像為訓練集,其余的1000張為測試集。

圖5 LFW人臉數據集部分人臉圖片

3.2 實驗過程與結果

為了更好的進行人臉識別準確率實驗,先利用MTCNN計算方法進行快速人臉檢測,并對檢測出來的人臉圖像信息分切,裁剪過程如圖6所示。由圖6可見,經過MTCNN計算裁剪的圖像樣本可以去除多余的背景信息。

圖6 MTCNN裁剪示例

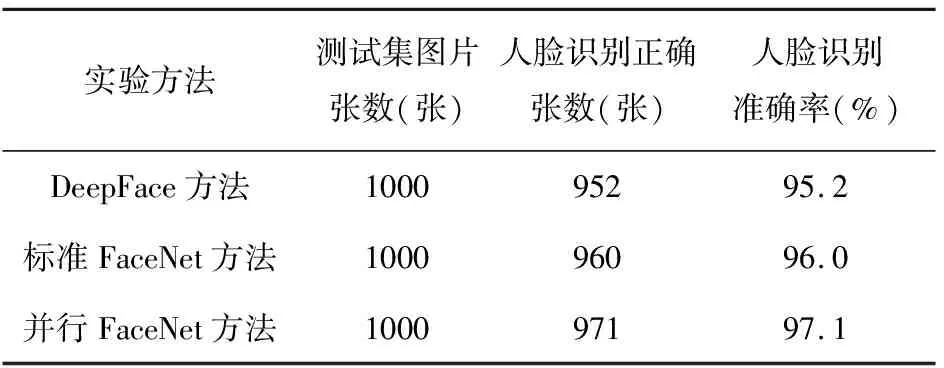

將裁剪后的圖片制作成訓練集去訓練人臉識別模型。為方便比較,除了標準FaceNet人臉識別算法外,也采用了DeepFace人臉識別方法[11]進行了對比實驗,所得實驗結果如表1所示。根據表1的實驗結果可知,目前的人臉識別效果(DeepFace方法)已經達到了較高的水平,識別準確率為95.2%。標準FaceNet人臉識別算法的準確率高于DeepFace算法。而并行FaceNet的人臉識別框架模型算法準確率是最高的:相比于標準的FaceNet方法準確率提高了1.1%;相比于DeepFace算法準確率提高了1.9%。這說明并行FaceNet的人臉識別框架模型可以識別出更多的人臉特征信息,同時也進一步證明了優化后的并行FaceNet模型可以學習到人臉面部的更多表征信息,進而更好提升人臉識別準確率。同時,并行卷積FaceNet方法的普適性很好,同樣可以用于其他網絡模型中。

表1 對比實驗結果

4 結論

人臉識別的目標是依據不同人臉的面部信息特征不同這一差異進行身份識別。通常情況下,人臉采集設備會通過攝像裝置收集含有人臉的視頻信息流。利用對應的識別算法,計算機能夠自動捕獲人臉并對其進行人臉檢測、面部識別等操作。本文對人臉監測算法MTCNN和人臉識別算法FaceNet進行深度分析,并在此基礎上提出了一種能夠有效提升人臉識別準確率的方法。該方法并且在LFW人臉數據庫中識別準確提升幅度達到了1%,與傳統算法相比優化后的算法有助于幫助人臉檢測技術的發展與推廣。但本文所提出的方法仍存在一定的不足,需要進一步進行研究:需要額外占用一定的計算機內存;算法運行速度仍然較慢。因此還需探索新方法來解決上述問題。