融合深度學習與成像模型的水下圖像增強算法

陳學磊,張 品,權令偉,易 超,鹿存躍

(1.上海交通大學電子信息與電氣工程學院,上海 200240;2.陸軍工程大學電磁環境效應與光電工程國家級重點實驗室,南京 210007)

0 概述

水下機器人執行任務時通常需要利用包括視覺傳感器在內的多種傳感器來感知周圍的水體環境,但受環境因素影響,水下圖像的質量通常較低。一方面,圖像整體色彩偏綠、偏藍;另一方面,對比度較低且細節模糊。水下圖像增強技術可以增強圖像的色彩、對比度、清晰度等多個方面,從而改善圖像質量。因此,開展水下圖像增強算法的相關研究具有十分重要的意義。

水下圖像的物理成像模型與霧化圖像的物理成像模型[1]有很多相似之處,其原理均為光線傳輸受到空氣或水中細微顆粒對光線散射的影響,導致進入相機的光線與物體本身反射的光線有所不同,從而使拍攝的照片顏色失真。由于其原理的相似性,學術界曾嘗試直接將霧化圖像的物理成像模型應用到水下圖像上進行色彩校正,所提出的多種水下圖像色彩校正方法[2-4]均取得了一定的圖像增強效果。但由于光線在水下的傳播特點與在大氣中并不完全相同,已有的成像模型大多沒有考慮不同波長的光被水體吸收和發生散射等情況的差異,因而基于這些模型的增強方法處理后的圖像在質量上也很難進一步提升。圖像增強效果的進一步提升有待于成像模型準確度的提高。AKKAYNAK 等[5]利用大量真實水下實驗的結果對已有模型中的衰減系數進行修正,進一步完善了水下圖像的物理成像模型,該研究為水下圖像增強技術提供了新的理論基礎。

自 從ALEXNET[6]取 得ImageNet[7]競賽冠軍 以來,深度學習方法在圖像識別、圖像分割、目標檢測等領域獲得了大量關注,并取得了較好的效果。近年來,深度學習技術作為一種新的技術手段也被嘗試應用于水下圖像增強任務上。如LI 等[8]提出基于CycleGAN 的水下圖像色彩校正方法,SKINNER等[9]提出兩階段神經網絡結構,并分別用于圖像深度估計和色彩校正,FU 等[10]提出一種融合全局和局部信息的神經網絡用于水下圖像增強。

基于近似的霧化圖像成像模型的水下圖像增強方法往往僅對特定圖像有效果,更換圖像后效果就變差,普適性不高。但基于深度學習的方法如果忽略了物理成像模型,將導致神經網絡結構復雜,學習難度也會變大,即便融合了近似的物理成像模型,圖像增強效果往往也不顯著。

為解決上述問 題,本文結合AKKAYNAK 等[4]最新提出的修正后物理成像模型,對現有基于深度學習的圖像增強方法進行改進,提出一種新的水下圖像增強算法。該算法包含基于卷積神經網絡的背景光估計模塊和傳輸圖估計模塊,將這2 個模塊的輸出與輸入圖像進行重建運算后得到增強后的水下圖像。在構建神經網絡時選用帶參數修正線性單元(PReLU)[11]和擴張卷積運算(Dilated Convolution)[12]來提高網絡的擬合能力。此外,在UIEB[13]數據集和URPC2020 數據集上進行實驗,以驗證本文算法的有效性。

1 物理成像模型

1.1 水下環境對光學成像質量的影響

在水下環境拍攝照片時,圖像質量會受到光的吸收、散射和折射等因素的影響[14]。

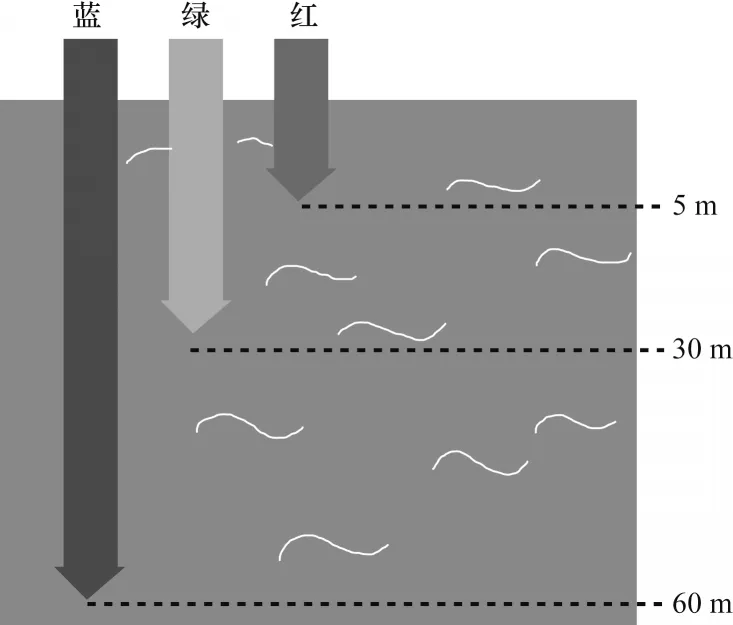

光在穿越水體時會被吸收一部分,不同波長的光被水的吸收程度不同。圖1 展示了水下環境光吸收的過程,海水對紅光的吸收作用更強,紅光在進入水體后強度迅速降低,而波長較短的綠光和藍光則可以穿透到海平面下較深處,從而導致水下拍攝的圖像呈現偏綠偏藍的效果。

圖1 水下光吸收示意圖Fig.1 Schematic diagram of underwater light absorption

同樣,由于水體對光的吸收效應,在更深的海域進行圖像采集時已不僅只是受到波長較長的光線不足這一因素的影響,還會由于各個波長的光線均不足導致圖像整體曝光度低的影響,因此在深海進行圖像采集通常還需進行人為補光,或利用多曝光度圖像序列加權融合等算法進行曝光度增強[15-16]。

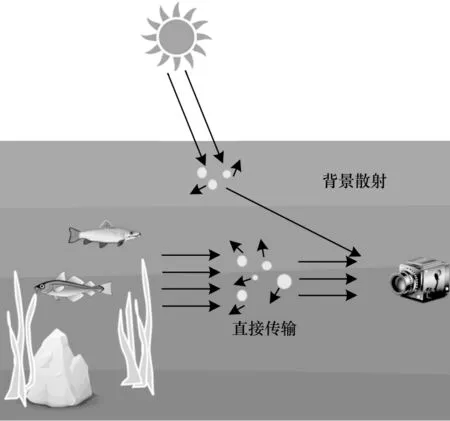

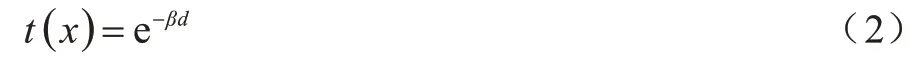

水下圖像的光學成像模型主要包含2 個部分的光源信息:直接傳輸的光和背景散射的光。如圖2 所示,直接傳輸的光來源于被拍攝物體本身,在傳輸路徑上會經歷衰減效應,衰減效應由光的吸收和光的散射導致,會造成水下圖像色彩畸變。背景散射的光并非來源于被拍攝區域物體本身的輻射,而是由周圍環境中的光被水中存在的大量微小顆粒散射得到,背景散射的光是水下圖像對比度降低的主要原因。

圖2 光學成像模型示意圖Fig.2 Schematic diagram of optical imaging model

光線在不均勻介質中不沿直線傳播,會發生折射現象,光的折射會導致圖像中的細節扭曲失真[17]。水中的微粒、海水的波動、水下的氣泡等都會造成光的折射,從而造成水下圖像扭曲。由于圖像扭曲的復原屬于圖像修復領域,本文所提算法屬于圖像增強算法,僅解決光的吸收和光的散射造成的顏色畸變、對比度降低、細節模糊等問題。

1.2 水下圖像成像模型的數學表達

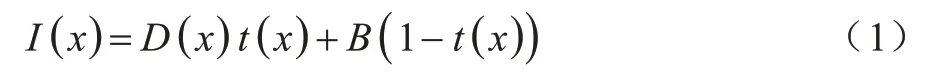

根據霧化圖像的成像模型[1]可以得到近似的水下圖像成像模型[2]:

其中:x表示像素點坐標;I(x)表示水下環境中相機拍攝得到的圖像;D(x)表示物體本身的輻射光,可以理解成消除水下環境因素影響后的水下圖像;t(x)表示直接傳輸映射;B表示環境光。D(x)t(x)對應圖2 中直接傳輸的光;B(1-t(x))對應圖2 中背景散射的光。直接傳輸的光會經歷衰減效應,衰減效應的大小由衰減系數β和傳輸距離d決定,如式(2)所示:

傳統的水下圖像增強方法通常將圖像RGB 的3 個通道的t(x)視為一個映射來簡化計算,但這種方式忽略了t(x)中的衰減系數β在不同通道之間的差異,增強后的圖像依然有偏色現象。AKKAYNAK等[5]進行了大量水下實驗,提出了修正后的模型,如式(3)所示。修正模型主要基于水下環境的光學成像特點,對衰減系數進行了修正。

其中:c∈{R,G,B}表示圖像通道分別表示直接傳輸和背景散射的衰減系數;d表示傳輸距離。直接傳輸和背景散射的衰減系數又分別依賴于[d,ρ,E,Sc,a,b]和其中:d表示傳輸距離;ρ表示反射頻譜;E表示輻照度;Sc表示相機頻譜響應;a和b分別表示吸收和散射系數。

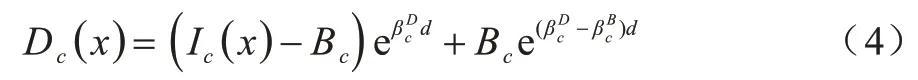

對式(3)進行整理得到式(4)的形式:

本文使用式(5)作為水下圖像的物理成像模型,結合深度學習技術,完成水下圖像增強任務。

2 融合深度學習與成像模型的圖像增強算法

2.1 算法設計思路

本文提出的基于深度學習與成像模型的水下圖像增強算法的核心思想是利用卷積神經網絡對成像模型中的多個組成部分進行擬合。

根據式(5),拍攝得到的圖像Ic(x)為已知信息,環境光Bc和直接傳輸參數為未知信息。已有的暗通道先驗[8]等算法表明環境光Bc作為一個全局信息,可以從拍攝得到的圖像中估計得到,因而在設計算法時可以先構建背景散射模塊來估計Bc的值。直接傳輸參數與環境光Bc的差別在于前者更復雜,不同像素點位置上的直接傳輸參數的值并不完全相同,因此對整張圖像直接傳輸參數的估計實際上是對一個高維矩陣的估計。結合以上2 點,在構建神經網絡時先構建背景散射估計模塊來估計較為簡單的Bc,再構建直接傳輸估計模塊來估計更加復雜的,且背景散射估計模塊的輸出可以作為輔助信息,和輸入圖像一起作為直接傳輸估計模塊的輸入,這樣做的優點是使網絡能結合圖像局部像素信息和全局背景光信息來估計局部像素的直接傳輸參數。

最終設計的算法如圖3 所示,該算法包含3 部分:第1 部分從輸入圖像中估計出背景散射光,即式(5)中的Bc;第2 部分利用估計出的背景散射光和輸入圖像估計出直接傳輸映射,即式(5)中的,此處與大多數已有方法估計t(x)不同,實際上是t(x)的倒數,這樣設定的優勢在于最后的重建運算為乘法,有利于深度學習訓練里的損失函數的反向傳播;第3 部分利用估計出的Bc和,并結合式(5)進行重建運算得到消除水下環境影響因素后的增強圖像。

圖3 本文算法整體框架Fig.3 Framework of algorithm in this paper

2.2 背景散射估計模塊

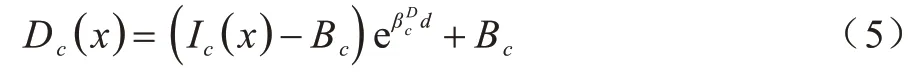

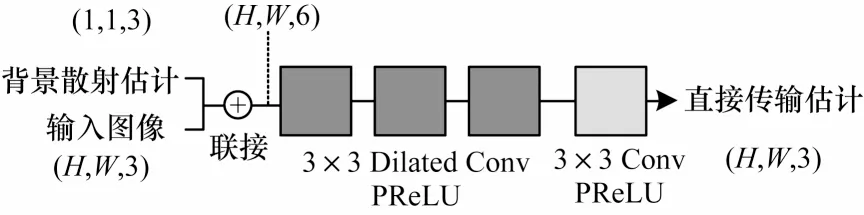

背景散射估計模塊包括了2 組尺寸為3×3 的卷積核,1 個全局均值池化層和2 組尺寸為1×1 的卷積核,每組卷積核的數量均為3,具體結構如圖4 所示。卷積運算的激活函數選擇了帶參數修正線性單元(PReLU)[11]。

圖4 背景散射估計模塊結構Fig.4 Structure of backscatter estimation module

帶參數修正線性單元(PReLU)和常見的修正線性單元(ReLU)的數學表達式如式(6)和式(7)所示:

其中:x是神經網絡特征圖上每一個位置的值;a是可以學習的參數。與常見的修正線性單元(ReLU)相比,使用帶參數修正線性單元的優點是可以避免x為負時梯度為0,導致相應參數無法再被更新的現象發生。

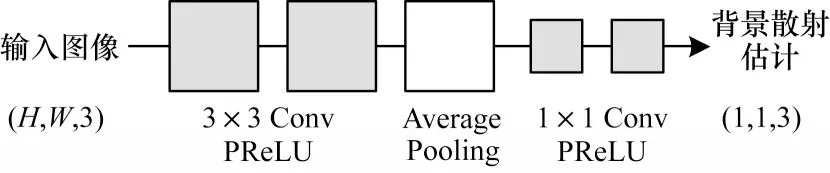

2.3 直接傳輸估計模塊

直接傳輸估計模塊將背景散射估計與輸入圖像進行聯接操作,隨后的運算中包括了3 組3×3 大小的擴張卷積核和1 組3×3 大小的普通卷積核,每組擴張卷積核的數量均為8,最后1 組普通卷積核的數量為3,具體結構如圖5 所示。

圖5 直接傳輸估計模塊結構Fig.5 Structure of direct-transmission estimation module

擴張卷積能在參數量不變的情況下通過在卷積核內填入額外的0 來增大感受野,更大的感受野能幫助網絡利用更多圖像信息來估計直接傳輸參數。為避免擴張卷積帶來的網格效應[12],可以采用混合擴張卷積的設計方式,即對連續的擴張卷積運算選用不同的擴張率,本文算法中的3 組擴張卷積核的擴張率分別選用了1、2、5。

2.4 訓練方式

本文算法的輸出為增強后的圖像。在訓練過程中,每一個輸入圖像均有一個對應的參考圖像作為訓練目標。本文算法使用基于像素值的均方差作為損失函數來計算增強后圖像與目標圖像之間的差異,均方差損失函數如式(8)所示:

其中:H、W和C分別為圖像的高度、寬度和通道數;x、y和z分別表示圖像3 個維度的坐標;D^(I)表示本文算法的輸出;R(I)表示訓練數據集中的參考目標。Adam 優化器[18]被用來進行神經網絡參數的優化。

3 實驗結果與分析

為驗證本文所提水下圖像增強算法的有效性,設計并進行了一系列仿真實驗。實驗在Ubuntu18.04 系統中進行,使用PyTorch 深度學習框架實現所提算法。所使用的計算機配置為Intel i7-10700 CPU、16 GB RAM和NVIDIA RTX 2070 GPU。深度學習訓練中使用的批尺寸為1,學習率為0.001,訓練輪數為3 000。本文的代碼和訓練好的模型開源選擇GitHub 平臺:https://github.com/xueleichen/PyTorch-Underwater-Image-Enhancement。實驗中的圖像來源為UIEB[13]數據集,該數據集采集了大量真實場景中拍攝的水下圖像,包含多種已有算法和志愿者人工評判得到對應的色彩增強圖像。該數據集包含890 張真實水下圖像和890 張供參考的色彩增強圖像,其中700張圖像用來訓練,190張圖像用來測試。此外,在UIEB 數據集上訓練的模型也在URPC2020 數據集上進行了測試,以驗證算法的通用性,并從視覺效果、質量指標和運算速度3 個方面對本文算法進行效果評價,與已有方法進行對比分析。另外,本文還進行了關鍵點匹配的實驗來驗證水下圖像增強對后續視覺任務效果的提升。

3.1 視覺效果分析

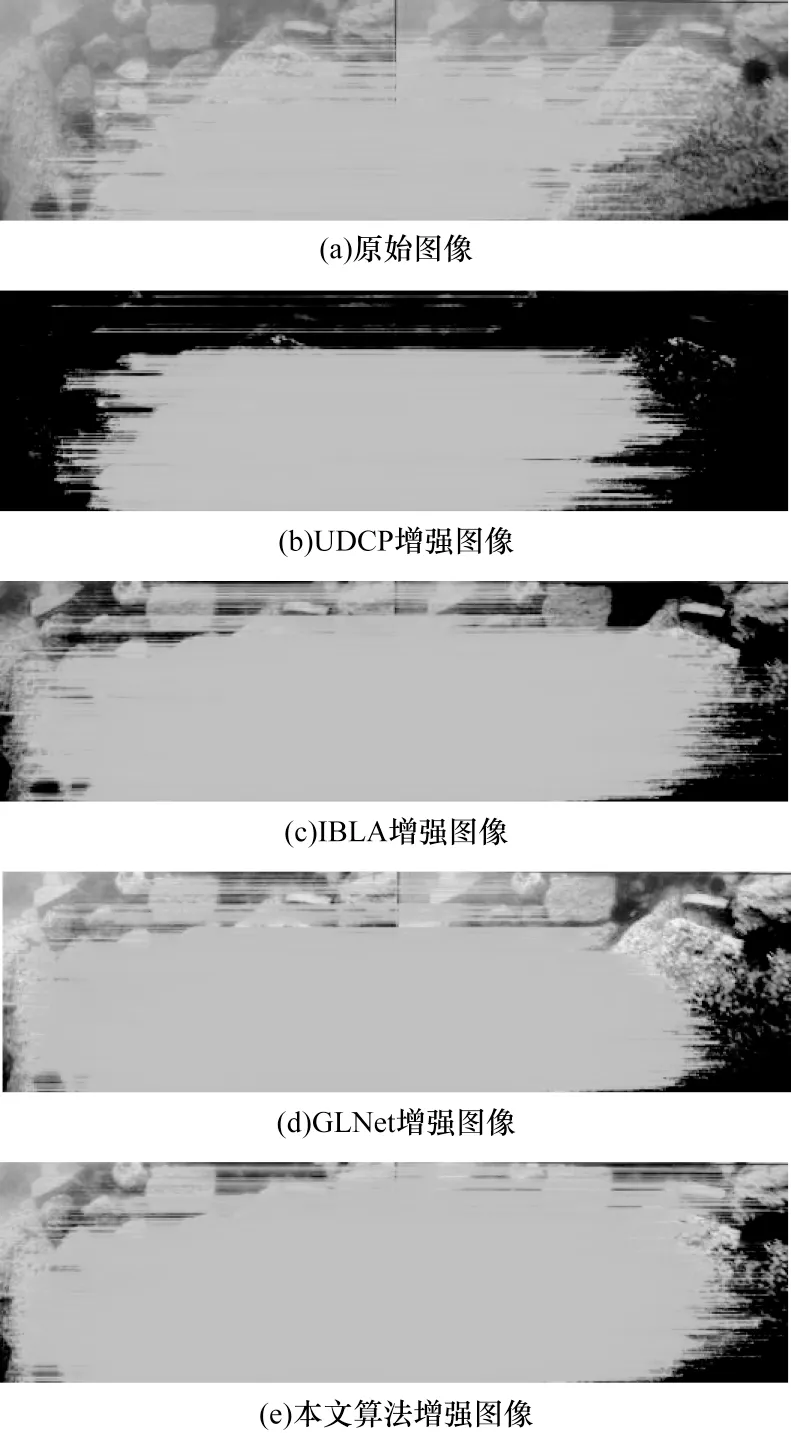

在進行視覺效果分析時,本文算法和UDCP算法[2]、IBLA 算法[3]、GLNet 算法[10]的實驗結果對比如圖6 所示。圖6 中前3 行的圖片來自UIEB 數據集的測試集,后3 行的圖片來自URPC2020 數據集,第1 列為輸入的原始圖像,后4 列分別為使用不同算法得到的結果(彩色效果見《計算機工程》官網HTML 版)。從圖6 可以看出本文算法在進行水下圖像增強時可以取得較好的效果,對水下圖像的偏色情況進行了校正,同時提升了對比度和細節清晰度,提升了整體視覺效果。而UDCP算法和IBLA 算法處理的圖像色彩飽和度過高,背景顏色偏暗。GLNet算法處理的部分圖像存在整體偏藍的現象。

圖6 不同算法進行水下圖像增強的視覺效果對比Fig.6 Comparison of visual effects of underwater image enhancement by different algorithms

3.2 質量指標分析

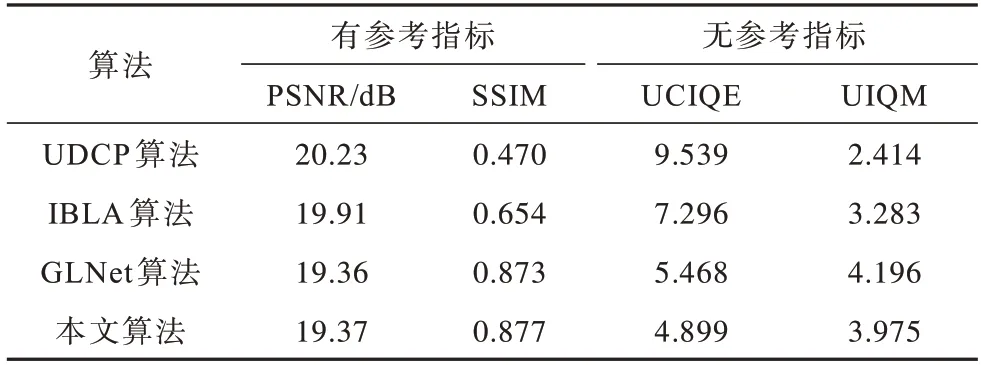

水下圖像增強實驗使用的圖像質量指標可以分為兩類:有參考指標和無參考指標。有參考指標的計算要求算法處理后的圖像有對應的真實參考圖像,能夠計算這2 張圖像間的近似程度。常用的有參考指標包括峰值信噪比(Peak Signeal-to-Noise Ratio,PSNR)和結構相似度(Structural Similarity,SSIM)。無參考指標則直接利用單張處理后圖像的顏色、對比度、飽和度等,并將其整合為一個總體圖像質量指標。常用的無參考指標包括水下彩色圖像質量評價(UCIQE)[19]和水下圖像質量評價(UIQM)[20]。

表1 所示為本文算 法、UDCP算法[2]、IBLA 算法[3]及GLNet 算法[10]在UIEB 測試集上的各項指標數值。與基于深度學習的GLNet 算法相比,本文算法在PSNR 和SSIM 兩項指標上表現更佳,且在有參考指標方面有更好的效果,從而驗證了本文算法在水下圖像增強上的有效性。但本文算法在UCIQE和UIQM 兩項指標上略微差一些,其原因在于GLNet 方法使用直方圖均衡化作為后處理步驟,讓圖像色彩更均衡,因此在指標上取得了更高的數值,但這也導致了圖6 所示GLNet 處理的部分圖像存在偏藍的現象。傳統算法UDCP 和IBLA 處理的圖像視覺效果并不好,卻在UCIQE 取得了最高的分數,這是因為UCIQE 是色彩、對比度、飽和度3 個方面相關統計數據的加權求和,即使圖片在某一方面被進行了過度的增強處理,導致存在色彩偏差或在其他方面增強不足,但仍然可能取得較高的UCIQE 數值。這一點在文獻[13]中也有討論,說明目前的水下圖像質量評價指標有一定局限性。

表1 不同水下圖像增強算法的指標對比Table 1 Index comparison of different underwater image enhancement algorithms

綜上所述,在質量指標分析中,本文算法在有參考指標上較已有基于深度學習的方法得分更高,在無參考指標上效果略差于傳統方法,這是因為現有基于深度學習的方法采用了后處理步驟增強色彩,但這些后處理步驟會帶來諸如偏藍等副作用。非深度學習方法在UCIQE 指標上大幅領先深度學習方法則是因為該指標的局限性。綜上所述,本文算法在質量指標分析方面取得了部分指標更優、其他指標可比的結果。

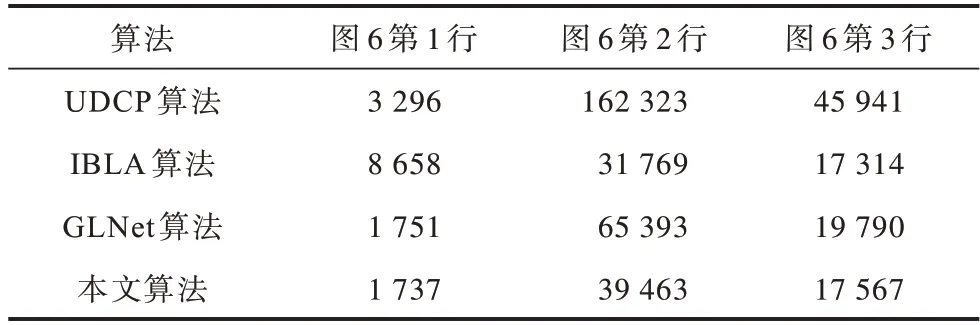

如1.1 節所述,水下圖像具有曝光度較低的特點。本文提出的增強算法并非針對曝光度低這一個特點進行圖形增強,而是從顏色、對比度、清晰度等多方面進行整體增強。本文參考文獻[15-16]對所提算法及相關算法進行了曝光度增強的量化指標分析,此處使用的是亮度次序誤差(LOE)指標,該指標的數值大小與圖像尺寸密切相關。在通常情況下,圖像尺寸越大,此指標越容易有一個較大的值。在同樣的圖像尺寸下,亮度次序誤差(LOE)指標值越小,代表圖像自然度越高。

表2所示為本文算法及UDCP算法[2]、IBLA算法[3]、GLNet算法[10]處理后圖像的亮度次序誤差(LOE)指標值,此處選取圖6 第1 列的前3 張圖像進行計算,這3 張圖像的原始尺寸分別是259 像素×194 像素、909 像素×758 像素和500 像素×375 像素,因此LOE 數值較大。本文算法在圖6 第1 行圖像上取得了最好的LOE 指標,在圖6 第2 行圖像和圖6 第3 行圖像上取得的LOE 指標次之,僅略差于IBLA方法。但IBLA算法處理圖6第1行圖像得到的LOE 指標遠差于其他算法,因此整體來看,本文算法在曝光度增強方面效果最佳。

表2 不同算法處理后圖像亮度次序誤差指標對比Table 2 Comparison of brightness order error indexes of images processed by different algorithms

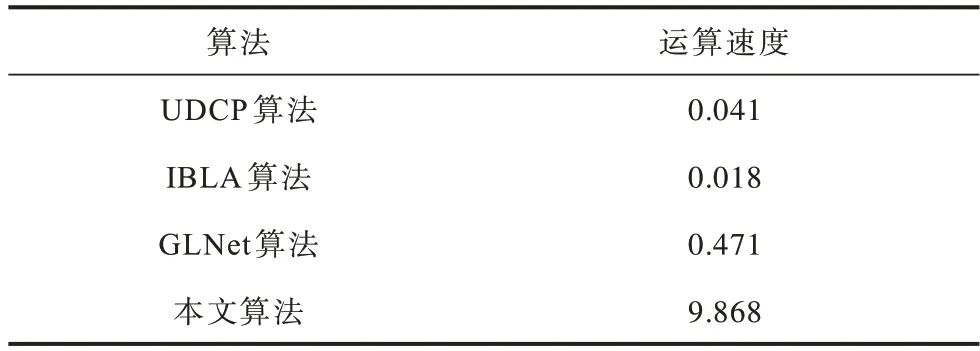

3.3 運算速度分析

當將水下圖像增強算法部署到真實機器人上時,還要考慮算法的實時性。對比本文算法及UDCP 算法[2]、IBLA 算法[3]、GLNet 算法[10]的運算速度,實驗數據如表3 所示。運算速度的評價指標選擇的是幀率,即每秒處理圖片數量,幀率越高,表明算法的運算速度越快。由表3 可以看出本文算法的運算速度最快,原因是本文算法在設計神經網絡時對每組卷積核的數量選擇了較小的值,實現了網絡輕量化。

表3 不同水下圖像增強算法的運算速度比較Table 3 Comparison of computation speed by different underwater image enhancement algorithms (frame·s-1)

3.4 視覺感知任務

水下圖像增強的目的是為了提升水下機器人對周圍環境的視覺感知能力。圖像特征點匹配是一項基本的視覺感知任務,是攝影測量、三維重建和圖像拼接等應用的基礎。

利用不同算法對URPC2020 數據集中編號為000001 和000002 的2 張圖片進行圖像增強操作,再依次對原始圖像和不同算法增強后的圖像進行特征點匹配,匹配時利用SIFT 方法[21]進行特征點提取,使用RANSAC 方法[22]進行特征點匹配和單應性變換。實驗得到的匹配結果如圖7 所示,左側的圖為000001 或其增強后圖像,右側的圖為000002 或其增強后圖像。可以看出不同算法增強后的圖像和原始圖像相比均能檢測到較多匹配點,證明圖像增強算法作為圖像預處理步驟能幫助提升特征點匹配的效果。

圖7 不同算法增強后圖像的特征點匹配結果對比Fig.7 Comparison of feature key-point matching results of images enhanced by different algorithms

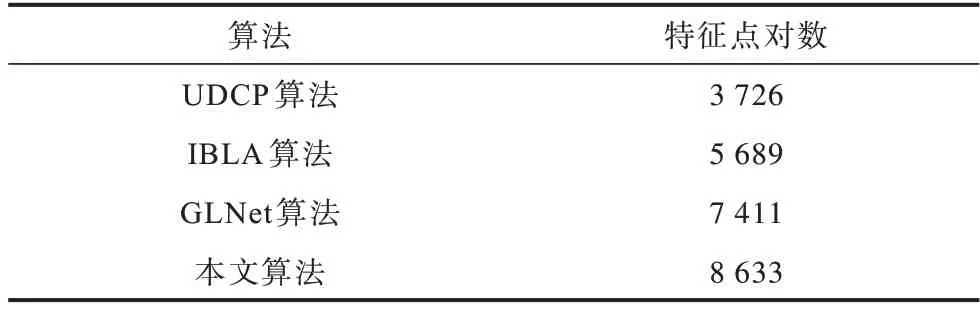

表4 列出了用不同算法對編號為000001 和000002 的2 張圖片進行增強操作后再進行特征點匹配的結果,匹配點對數越多,越利于精確的三維重建或攝影測量。由表4 可知本文算法對特征點匹配效果的提升最大,證實本文提出的水下圖像增強算法能更好地提升水下機器人的視覺感知能力。

表4 不同算法增強后圖像的匹配點對數對比Table 4 Comparison of the number of matching points in images enhanced by different algorithms

4 結束語

本文提出一種融合深度學習和成像模型的水下圖像增強算法,使用帶參數修正線性單元和擴張卷積來增強模型的擬合能力,通過基于最新水下成像模型設計的神經網絡結構、3 個通道分別估計的直接傳輸映射以及輕量化網絡提高運算速度。實驗結果表明,所提算法在多個數據集上取得了較好的圖像增強效果,視覺效果和質量指標較UDCP、IBLA 等已有算法均有提升,且運算速度得到大幅提升,能滿足水下機器人平臺計算實時性的要求。此外,通過實驗還證實了本文算法通過水下圖像增強能輔助完成后續視覺感知任務。但本文僅使用了圖像本身的信息,下一步將融合回聲探測儀、多普勒計程器等多種傳感器的空間感知信息進行更準確的水下圖像色彩校正和圖像增強。同時,針對水中的微粒、海水的波動、水下的氣泡等造成光的折射,導致圖像細節扭曲失真的現象,將進一步改進當前算法以實現水下圖像的扭曲復原,提升水下機器人的視覺感知能力。