煤礦副井礦車裝載物智能識別方法

靳舒凱,魏冠楠,王春明,王統海,吳忠倫,楊克虎,4

(1.中國礦業大學(北京)機電與信息工程學院,北京 100083;2.臨沂礦業集團菏澤煤電有限公司,山東 菏澤 274700;3.臨沂礦業集團菏澤煤電有限公司 郭屯煤礦,山東 菏澤 274700;4.中國礦業大學(北京)煤礦智能化與機器人創新應用應急管理部重點實驗室,北京 100083)

0 引言

煤礦智能化是我國煤炭工業高質量發展的必由之路[1-2],而副井軌道運輸智能化是其中重要環節。煤礦副井主要用來提升人員、設備和生產原材料,部分煤礦副井也用于提升巷道掘進過程中產生的煤和矸石。裝有生產物料、煤或矸石的礦車提升至地面后,再由軌道運輸系統實現礦車分運。目前副井軌道運輸系統主要采用人工操作方式,通過肉眼識別當前礦車的裝載物,然后控制司控道岔改變礦車的前進方向來實現礦車正確歸庫。該工作枯燥重復,容易使工人產生視疲勞或注意力不集中,加上副井口光線變化等環境因素的影響,易導致工人判斷錯誤或未能及時切換道岔,增加后續煤炭洗選成本,或造成礦車堆積,影響生產效率。

為實現副井礦車自動分運,文獻[3]提出采用RFID(Radio Frequency Identification,射頻識別)信標方式實現電機車定位,根據運輸物料不同,操作人員遠程控制道岔,實現電機車牽引礦車歸庫。該方法需對現場進行整體布設,且歸庫的多輛礦車需裝載相同類別的物料,對現場裝車要求較高。隨著計算機視覺技術的發展,基于圖像的礦車裝載物識別方法以其低成本、方便部署等特點逐漸應用于副井礦車自動分運系統中,如文獻[4]提出了一種礦車運輸智能煤矸識別及分運裝置,以工業相機和計算機為核心,基于傳統計算機視覺技術實現自動化礦車運輸。近年來,卷積神經網絡[5-7]在圖像識別與分類領域取得了極大成功,文獻[8]提出了基于卷積神經網絡的煤礦副井礦車裝載物自動分類系統,驗證了卷積神經網絡在礦車裝載物分類中的可行性,且SqueezeNet 在驗證集上的準確率達98.4%。但該系統在實際應用中存在以下問題:①系統觸發條件簡易,礦車經過時存在誤判與漏判情況;② 副井現場除礦車外存在多類物體,當其他物體經過檢測區域時會引起司控道岔誤動作,產生安全隱患。

本文針對現有副井礦車裝載物識別方法存在的不足,提出了基于目標檢測模型的礦車裝載物智能識別方法。在現場采集礦車裝載物圖像數據,構建礦車識別數據集,對Faster R-CNN[9],YOLOv4[10],SSD[11]等主流目標檢測模型的礦車分類識別效果進行綜合評估;考慮到副井礦車目標檢測種類較少,為了降低檢測模型大小,采用輕量級網絡MobileNet[12-14]代替YOLOv4 模型的主干特征提取網絡CSPDarknet53;將檢測模型部署在嵌入式平臺Jetson TX2,為滿足現場實時檢測需求,采用層間融合[15]和模型量化[16]技術對模型進行了優化。

1 礦車裝載物檢測模型訓練與評估

1.1 訓練數據集構建

礦車裝載物圖像數據來源于某煤礦副井現場。采用安裝在副井井口的海康威視DS-2CD3T27DWDL 型全彩攝像機采集圖像。該攝像機攝像頭分辨率為200 萬像素,主碼流幀速率達25 幀/s,支持RTSP(Real Time Streaming Protocol,實時流傳輸協議),采用DC12 V 供電,不間斷采集礦車裝載物圖像數據。共獲得10 萬余張處于不同光照條件下的礦車裝載物(包括煤、矸石、物料3 種類別)圖像,部分如圖1 所示。

圖1 部分礦車裝載物采集圖像Fig.1 Part of collected mine car load images

從采集的礦車裝載物圖像中篩選裝有煤、矸石、物料的各4 000 張圖像進行人工標注,得到VOC(Visual Object Classes,視覺目標分類)數據集。將VOC 數據集按9∶1 分為訓練集與驗證集,分別包含3 600,400 張圖像。

1.2 檢測模型訓練與對比

在實驗室環境下設置對比實驗。服務器配置:Ubuntu18.04 系統,32 GB 內存,512 GB 固態硬盤,NVIDIA GTX1080Ti 顯卡,python_3.7.0,keras_2.2.4深度學習框架。選用常用的Faster R-CNN,YOLOv4,SSD 目標檢測模型進行訓練,最大epoch 設置為100。keras_2.2.4 框架中earlystopping 參數可使模型訓練過程中損失函數值不再下降時停止訓練。3 種目標檢測模型訓練結果對比見表1。

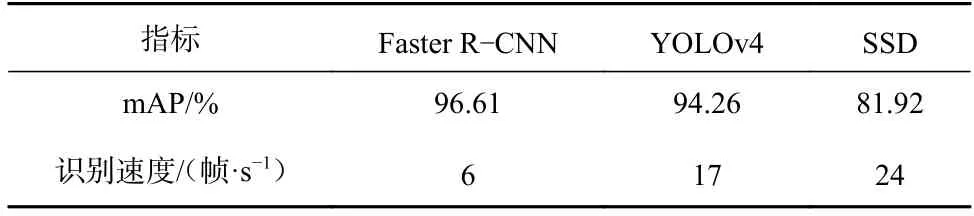

表1 3 種目標檢測模型訓練結果對比Table 1 Comparison of training results of three target detection models

從表1 可看出:Faster R-CNN 模型具有最低的損失函數值,且epoch 為100 時仍未達到最優,訓練周期較長;SSD 模型的epoch 僅為49,具有最短的訓練周期,但損失函數值較高;YOLOv4 模型的epoch為97,具有合理的訓練周期及損失函數值。

為更好地選擇礦車裝載物檢測模型,選用現場視頻圖像對3 種目標檢測模型進行評估,結果見表2。可看出針對礦車裝載物識別任務,Faster R-CNN 模型(大小為108.62 MB)具有最高的mAP(Mean Average Precision,平均精度均值),但識別速度較慢,難以實現實時檢測;SSD 模型(大小為91.74 MB)具有較快的識別速度,但mAP 較低,可行性較差;YOLOv4 模型(大小為244.99 MB)的mAP 為94.26%,具有較高的礦車裝載物識別準確率,識別速度為17 幀/s。綜合比較識別速度與mAP 可知,YOLOv4 模型更適用于礦車裝載物識別任務。

表2 3 種目標檢測模型檢測性能對比Table 2 Comparison of detection performance of three target detection models

2 礦車裝載物檢測模型優化

Faster R-CNN,YOLOv4,SSD 等主流目標檢測模型的主特征提取網絡大多采用體量大的卷積神經網絡。由于副井現場檢測目標種類較少,為了降低模型大小,以YOLOv4 模型為例,采用輕量級網絡MobileNet 替換原有主干特征提取網絡CSPDarknet53,實現模型優化。MobileNet 最鮮明的特點為采用深度可分離卷積核代替普通卷積核,計算量約為普通卷積核的1/3,運行速度得到了極大提升。

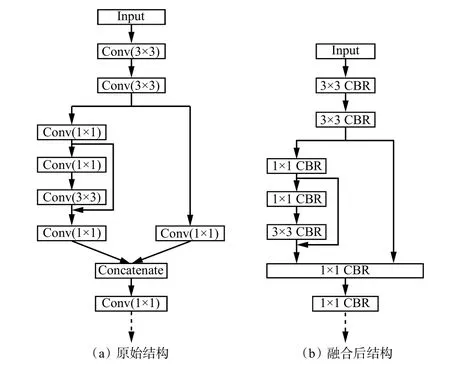

YOLOv4 模型優化過程:①主干特征提取網絡CSPDarknet53 替換為MobileNet,得到3 個初步的有效特征層;② 對初步的有效特征層進行特征融合,獲得3 個更有效的有效特征層;③將原有普通卷積核替換為MobileNet 中的深度可分離卷積核。模型優化過程及結果如圖2 所示。

圖2 YOLOv4 模型優化Fig.2 Optimization of YOLOv4 model

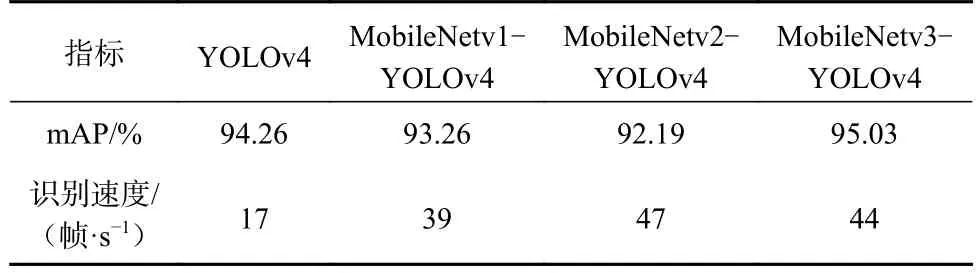

分別選用MobileNetv1,MobileNetv2,MobileNetv3對YOLOv4 模型進行優化,得到MobileNetv1-YOLOv4,MobileNetv2-YOLOv4,MobileNetv3-YOLOv4 模型,大小分別為47.6,40.6,44.8 MB,較優化前分別減小了197.39,204.39,200.19 MB。

采用相同的訓練集訓練模型,基于現場視頻圖像對訓練后的模型進行評估,結果見表3。可看出:MobileNetv1-YOLOv4,MobileNetv2-YOLOv4,Mobile-Netv3-YOLOv4 模型的識別速度較YOLOv4 模型分別提高了22,30,27 幀/s,證明MobileNet 中的深度可分離卷積核可有效提升模型運行速度;MobileNetv3-YOLOv4 模型的mAP 達95.03%,識別速度為44 幀/s。綜合考慮識別速度與mAP,認為MobileNetv3-YOLOv4模型具有最優識別效果,更適用于現場礦車裝載物識別任務。

表3 YOLOv4 模型優化前后檢測性能對比Table 3 Comparison of detection performance of YOLOv4 model before and after optimization

考慮到煤礦現場部署空間限制和成本,傳統基于高性能工作站的部署方式不太適合煤礦現場應用。因此,將礦車裝載物檢測模型部署至嵌入式智能計算平臺Jetson TX2。為滿足實時檢測要求,需對模型進行壓縮和加速。

3 礦車裝載物檢測模型加速

礦車裝載物檢測模型加速表現在2 個方面:①層間融合,即通過融合內核中的節點,優化GPU(Graphics Processing Unit,圖形處理器)顯存和帶寬,以提高運行速度;② 模型量化,即通過調節推理參數精度來提高檢測速度。

3.1 層間融合

在部署神經網絡模型推理時,每一層運算操作需由 GPU 啟動 CUDA(Compute Unified Device Architecture,統一計算設備架構)核心完成。運算過程包括CUDA 核心計算張量、啟動CUDA 核心、讀輸入張量及寫輸出張量操作。其中CUDA 核心計算張量耗時極短,而啟動CUDA 核心、讀輸入張量及寫輸出張量操作會產生不必要的時間及資源浪費。通過層間的橫向或縱向融合能夠減少層數,從而提高模型推理速度。

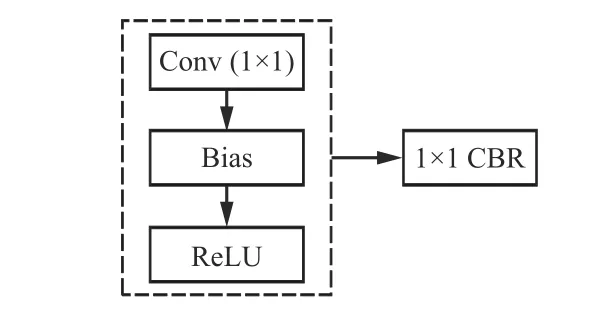

橫向融合可將卷積層、偏置層、激活函數層合并為一個CBR(Convolution+Bias+ReLU)結構,融合過程如圖3 所示。縱向融合可將結構相同但權值不同的層合并,合并后的層只占用1 個CUDA 核心,使得整個模型結構更簡潔、更高效。

圖3 神經網絡模型層間橫向融合過程Fig.3 Horizontal interlamination fusion process of neural network model

推理加速主要表現在3 個方面:①整理零碎數據,減少傳輸次數;② 優化橫向計算圖,減少數據訪問次數;③通過非拷貝方式將層輸出定向到正確的最終地址,以減少橫向時間。

YOLOv4 模型主干特征提取網絡CSPDarknet53具有5 種殘差塊,以第1 種殘差塊為例,其層間融合過程如圖4 所示。

圖4 CSPDarknet53 第1 種殘差塊層間融合過程Fig.4 Interlamination fusion process of the first residual block in CSPDarknet53

3.2 模型量化

大多數基于深度學習的神經網絡模型在訓練時,張量精度均采用32 位浮點數。模型訓練結束后,由于在部署推理的過程中不需要反向傳播,所以可適當降低推理參數精度(如將張量精度降為16 位浮點數或8 位整型數),從而提高運行速度。

推理加速表現在部署推理過程中降低模型張量精度,進而減少數據轉換時間,提高數據吞吐量,減少內存占用,同時可保持高識別準確度。

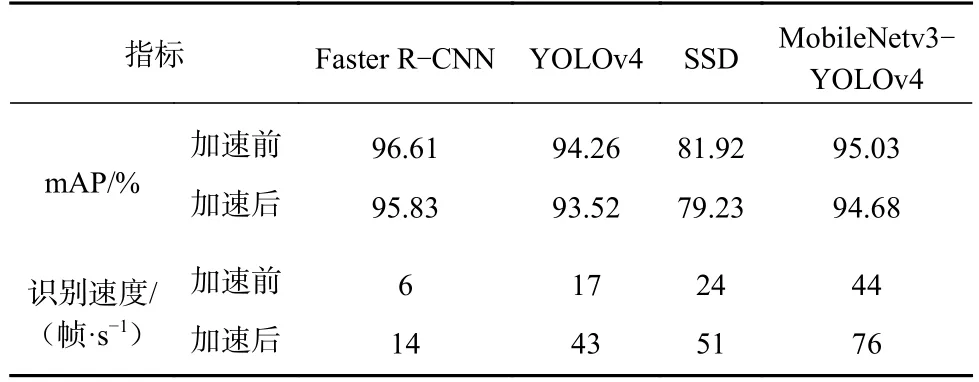

3.3 模型加速前后對比

基于實驗室服務器,采用模型加速方法對Faster R-CNN,YOLOv4,SSD,MobileNetv3-YOLOv4 模型進行加速優化,結果見表4。可看出模型加速方法對多種目標檢測模型均有較好的加速效果,具備泛用性;加速后各模型mAP 略有減小,但仍在可接受范圍內。

表4 目標檢測模型加速前后對比Table 4 Comparison of target detection models before and after acceleration

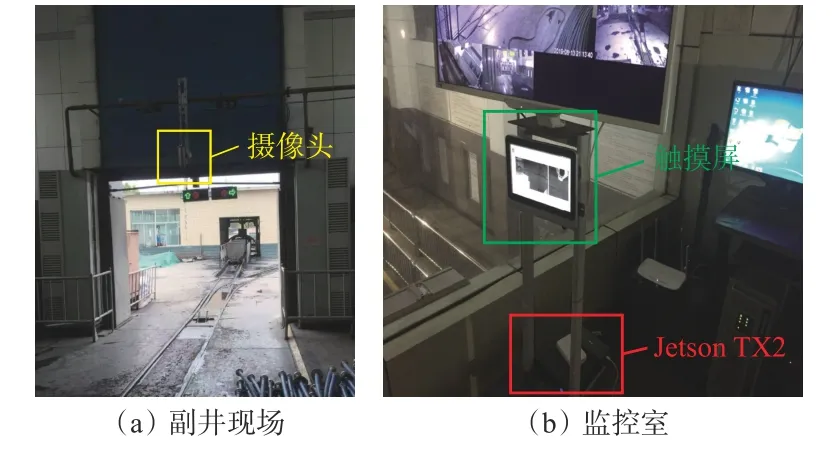

4 現場試驗

將礦車裝載物智能識別方法在某煤礦副井進行現場試驗。以海康威視DS-2CD3T27DWD-L 網絡攝像頭為圖像采集設備,選用Jetson TX2 嵌入式平臺部署礦車裝載物檢測模型,運行環境為Ubuntu18.04系統,深度學習框架采用keras_2.2.4。試驗平臺如圖5 所示。

圖5 礦車裝載物智能識別現場試驗平臺Fig.5 Field test platform for intelligent identification of mine car load

綜合考慮識別速度與mAP,選擇MobileNetv3-YOLOv4 為礦車裝載物檢測模型。將模型移植到Jetson TX2 嵌入式平臺后試驗結果見表5。

表5 Jetson TX2 上MobileNetv3-YOLOv4 模型檢測性能Table 5 Detection performance of MobileNetv3-YOLOv4 model on Jetson TX2

從表5 可看出:受Jetson TX2 計算能力限制,MobileNetv3-YOLOv4 模型識別速度慢,僅為18.3 幀/s;采用模型加速方法對MobileNetv3-YOLOv4 模型加速后,識別速度提升至35.42 幀/s,mAP 為94.68%,滿足現場實時、精確檢測需求。

礦車裝載物智能識別方法在副井現場檢測結果如圖6 所示。其中藍色框代表礦車內裝載物為煤,綠色框代表礦車內裝載物為矸石,紅色框代表礦車內裝載物為物料;框上方顯示裝載物類別名稱及目標物為該類裝載物的概率,且當行人等非礦車類物體經過檢測區域時不啟動檢測任務。可看出本文方法能夠實時、精準地識別礦車裝載物,且僅在礦車經過檢測區域時啟動檢測任務。

圖6 礦車裝載物智能識別現場試驗結果Fig.6 Field test results of intelligent identification of mine car load

5 結論

(1)評估了Faster R-CNN,YOLOv4,SSD 這3 種常用目標檢測模型用于礦車裝載物識別的可行性。經VOC 數據集訓練、現場視頻圖像檢測,Faster R-CNN 模型的mAP 為96.61%,識別速度為6 幀/s,模型大小為108.62 MB;YOLOv4 模型的mAP 為94.26%,識別速度為17 幀/s,模型大小為244.99 MB;SSD 模型的mAP 為81.92%,識別速度為24 幀/s,模型大小為91.74 MB。YOLOv4,Faster R-CNN 模型能滿足mAP 要求,但運行在常用GPU 上均難以滿足實時檢測要求。

(2)采用MobileNet 優化YOLOv4 可有效降低模型大小,提高識別速度。MobileNetv1-YOLOv4,MobileNetv2-YOLOv4,MobileNetv3-YOLOv4 模型大小分別為47.6,40.6,44.8 MB,識別速度分別為39,47,44 幀/s。MobileNetv3-YOLOv4 模型的mAP 為95.03%,較優化前提升了0.77%。

(3)采用基于層間融合和模型量化的模型加速方法對Faster R-CNN,YOLOv4,SSD,MobileNetv3-YOLOv4 模型進行加速優化,加速后4 種模型的識別速度分別提升至14,43,51,76 幀/s。

(4)以MobileNetv3-YOLOv4 為礦車裝載物檢測模型,移植到Jetson TX2 嵌入式平臺進行礦車裝載物識別現場試驗,結果表明:加速后MobileNetv3-YOLOv4 模型的識別速度為35.42 幀/s,mAP 為94.68%;本文方法能夠實時、精準地識別出礦車裝載物類別,且僅在礦車經過檢測區域時啟動檢測任務,避免了非礦車物體進入檢測區域引起的司控道岔誤動作情況。