選擇性集成學習多判別器生成對抗網絡

申瑞彩,翟俊海+,侯瓔真

1.河北大學 數學與信息科學學院,河北 保定 071002

2.河北大學 河北省機器學習與計算智能重點實驗室,河北 保定 071002

近年來,深度學習技術在許多方向取得巨大進展,通過構建類似人腦結構的多層神經元網絡,對輸入信息進行特征抽取與合成等操作,進而形成更加抽象的高維特征,大量實驗數據證明,該算法已經大大超越了傳統機器學習算法。在深度學習的發展過程中,出現了以生成對抗網絡(generative adversarial networks,GAN)為代表的模型,該模型由生成網絡與判別網絡兩部分組成,生成器從潛在空間中采樣,產生數據,判別網絡則對輸入的數據進行鑒別,二者相互競爭,相互促進。

隨著模型應用的廣泛,存在的問題日漸突出,一種提高模型性能的方式是將模型在有監督的環境下進行訓練,但該方式實現較為困難,因此未得到普及。而無監督環境下對模型訓練又會帶來諸多問題,同時現有的許多模型普遍采用單判別網絡的形式,判別網絡在模型中具有重要作用,僅含有單判別網絡的模型易受判別誤差的影響,從而影響生成網絡學習。2016年提出的生成多對抗網絡模型(generative multi-adversarial networks,GMAN)則考慮到了這一問題,作者將生成對抗網絡中的判別網絡采用多判別網絡的形式,這一改進提升了模型性能,但作者并未對判別結果進行篩選,另外判別網絡均采用相似的網絡設置,在訓練中模型會趨近于一種網絡表達。因此,如何優化以及解決上述問題具有一定的研究意義。

本文針對在生成對抗網絡中存在的尚未解決的問題,提出了一種全新的網絡結構。將選擇性集成學習的方式引入到判別網絡中,同時采用依據基判別網絡的判別性能動態調整基判別網絡的投票權重的軟投票策略,充分發揮基判別網絡的優勢抑制基判別網絡劣勢的影響,有效減少了判別誤差。實驗證明文本提出的模型性能上均優于現有的幾種競爭模型。

本文的主要貢獻包括以下三方面:

(1)提出基于選擇性集成學習的生成對抗網絡模型;

(2)在無監督方式下,本文所提模型在生成樣本質量與多樣性上均得到大幅度提升;

(3)提出的基于選擇性集成學習思想的模型在收斂速度方面較傳統模型均有明顯提高。

1 相關工作

生成模型是無監督學習任務中常用的一類方法,其可直接學習樣本數據中的分布。在神經網絡興起之前,生成模型主要對數據的分布進行顯式建模。應用較多的有基于有向圖模型的赫姆霍茲機(Helmholtz machines)、變分自編碼器(variational autoencoder,VAE)、基于無向圖模型的受限玻爾茲曼機(restricted Boltzmann machines,RBM)和深度玻爾茲曼機(deep Boltzmann machines,DBM)等。

當被建模變量為高維時,上述生成模型將面臨指數級計算量,為優化這一問題,生成式對抗網絡(GAN)被提出。該模型至今已有多種變體,并廣泛應用于計算機視覺和圖形應用等領域。而后根據不同的任務,生成對抗網絡架構也有相應的變化。2015 年提出深度卷積神經網絡(unsupervised representation learning with deep convolutional generative adversarial networks,DCGAN),將卷積融入到神經網絡結構中,這一模型在后續研究中得到廣泛應用。

生成式對抗網絡(GAN)理論上可以收斂到最優的納什均衡點,這足以保證生成網絡可以學習到真實數據分布,然而在實際應用中,模型常出現模式崩潰,為解決這一問題,提出了條件式生成對抗網絡(conditional generative adversarial networks,CGAN),但該模型訓練需要大量已標記數據,目前如何獲取已標記數據仍無有效方法。在InfoGAN(interpreter representation learning by information maximizing generative adversarial nets)中作者為強制生成器學習特定于因子的生成,將潛在因子和生成器分布之間的互信息最大化。

2016 年發表的Ensembles of generative adversarial networks中,模型采用多生成器集成的方式來提高生成樣本的多樣性,但此模型并未解決模式單一問題。同年提出的CoGAN(coupled generative adversarial networks)模型,通過訓練具有共享參數的兩個生成器以學習數據的聯合分布,共享參數將兩個生成器引導到相似的子空間,該模型關注在生成網絡中且在不同域上進行訓練。2016年提出的GMAN模型,利用多判別器的集合來引導生成網絡產生更好的樣本,從而穩定生成器的訓練,在這一文章中作者注重從理論方面闡述模型架構。本文主要受這一模型啟發,但作者并未考慮到判別性能較差的判別網絡對模型的收斂帶來的影響而是采用所有網絡的判別結果。

文中提出的基于選擇性集成學習的多判別網絡根據判別網絡在某一類別上的判別精確度動態賦予判別網絡投票權重,從而有效發揮了各判別網絡的優勢。

2 基礎知識

本章介紹將要用到的基礎知識,包括生成對抗網絡和集成學習。

2.1 生成對抗網絡

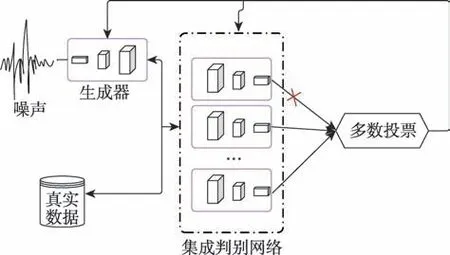

生成對抗網絡(GAN)核心思想源于博弈論中的納什均衡,模型主要包含兩部分,生成圖像的生成網絡,判別圖像真偽的判別網絡,生成網絡與判別網絡均由參數化的神經網絡組成。網絡模型如圖1所示。

圖1 生成對抗網絡模型Fig.1 Model of generative adversarial networks

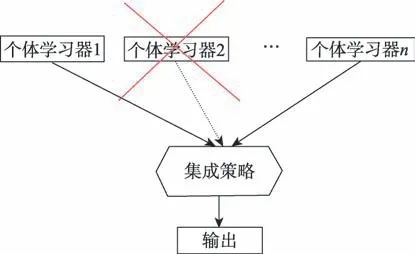

生成器的輸入為服從某一分布p的隨機向量,假設真實數據的分布為,在給定一定量真實數據集的條件下,對生成對抗網絡進行訓練,生成器將學習到近似于真實數據的分布。該網絡的目標為最小化真實數據分布與生成數據分布之間的距離,可用式(1)來表示:

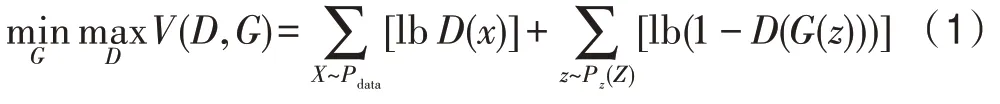

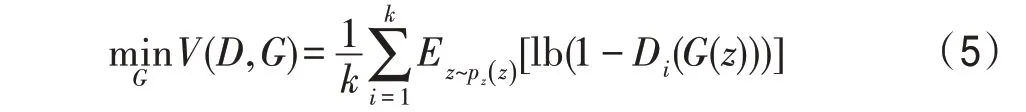

2.2 選擇性集成學習方法

本文采用的選擇性集成學習是集成學習方式的一種,即在集成學習的基礎上增加了對基學習器的選擇階段。傳統集成學習方式得到的是一系列弱學習器,之后并未對弱學習器進行有效處理,在實驗中設置了將全部弱學習器的信息進行采納,結果證明相比于僅使用單判別器的情況,這種方式對網絡性能略有提升,因基判別網絡的判別性能不一,采用這一方式并未使網絡達到最優值,綜上該方式并不可取。而選擇性集成學習通過一定的集成策略,對基學習器進行處理,與本文的思想相吻合。

該方法如圖2 所示,通過弱學習器的選擇性集成,集成策略依問題而定,該集成策略將滿足要求的個體學習器權重增加,降低不滿足要求的個體學習器的權重,從而改善模型的整體性能。

圖2 選擇性集成學習示意圖Fig.2 Diagram of selective ensemble learning

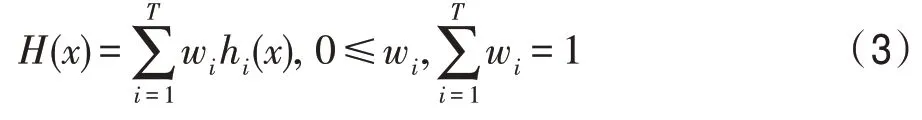

下面介紹集成策略,集成策略一般分為平均法、投票法、學習法三種方法。

(1)平均法分為簡單平均與加權平均。

簡單平均:

加權平均:

其中,w是個體學習器h的權重。

(2)投票法主要分為相對多數投票法、絕對多數投票法和加權投票法。

(3)學習法通過將得到的一系列初級學習器的結果作為次級學習器的輸入,從而進行集成,該方法的典型代表為Stacking 方法。

3 提出模型

傳統生成對抗網絡被定義為min-max 學習框架,模型包含生成網絡與判別網絡,早先證實如果給予足夠的網絡學習能力,判別器會達到理想的全局最優解,此時()=(),即生成器學習到了真實數據分布。若模型僅由單判別網絡進行判別,易受判別網絡性能影響出現誤差。為減少誤差、加速模型收斂,本文引入集成學習機制,模型如圖3 所示。具體地,將生成對抗網絡中的判別網絡改成集成判別系統,同時基判別網絡采用不同的網絡設置,以避免在訓練中所有網絡趨近于一種表達形式,具體的網絡設置將會在實驗部分進行介紹,對于每個判別網絡都將接收來自真實數據集的樣本及生成網絡生成的樣本,并獨立判斷。由于基判別器判別性能不一,將所有判別結果進行采納勢必影響生成網絡學習,有必要對判別結果進行處理,從而發揮基判別網絡的優勢,削弱甚至避免由判別網絡性能不佳產生的影響。由于判別能力不同,設固定權重顯然不妥,應根據判別網絡當前判別能力進行權值分配。綜上,該模型最終決定采用可以動態調整基判別網絡的投票權重的軟投票策略。該投票策略的具體做法是根據不同分類器在同一類別上的精確率做Softmax 運算,其結果為不同分類器在該類別上的預測權重值。權重值如式(4)所示:

圖3 選擇性集成學習多判別器生成對抗網絡模型Fig.3 Selective ensemble learning for multi-discriminator generative adversarial network model

其中,w表示第個基分類器第類的權重,p表示第個基分類器第類別的精確率。

目標函數如下:

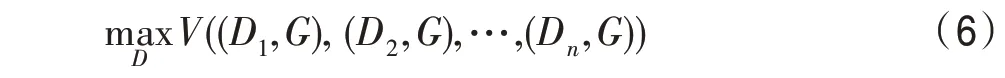

(1)生成網絡

在集成判別模型中,生成網絡的輸入為隨機噪聲,輸出被傳送到集成判別系統中。為了生成網絡得到更有效的訓練,生成網絡目標函數如式(5)所示:

其中,≤,為一次訓練結束后選擇集成判別網絡的數量,為集成判別系統中的集成網絡數量,D表示第個基判別器。

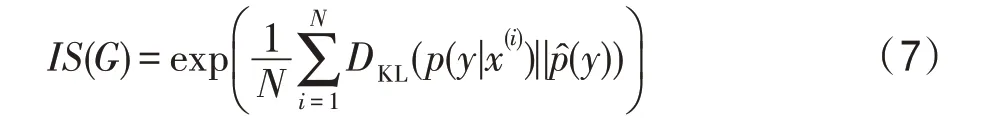

(2)判別網絡

在集成判別網絡中,各基判別器的輸入為來自生成樣本與真實數據集中的樣本,其目標仍是正確區分各樣本。

這與傳統生成對抗網絡中判別器的目標一致,因此在該網絡模型中基判別網絡的目標函數可寫成式(6)的形式:

其中,為集成判別網絡的個數,(D,)表示基判別網絡D的損失函數。max(·)表示集成判別網絡的損失函數。

4 實驗與結果

為驗證模型的有效性,分別在CelebA(RGB 圖)和MNIST(灰度圖)數據集上進行多個對比實驗。其中CelebA 數據集共包含200 000 張彩色圖像,圖像尺寸為178×218,為便于實驗采用了其中的30 000張圖像,并將圖像處理為128×160;使用的MNIST數據集共包含55 000 張灰色圖像,圖像尺寸為28×28。實驗的環境為Tensorflow1.0,Python3.7.3,NVIDIA GFORCE GTX980,Windows10 操作系統。

4.1 度量標準

本文選擇的度量指標主要用來評價模型生成樣本的質量與多樣性。具體地使用:

(1)IS(inception score)評價指標,如式(7)所示:

其中,(|)表示輸入圖像服從的概率分布,()表示全體圖像的概率分布。該評價指標較好地度量了生成樣本與真實樣本的差距,若生成樣本與真實樣本越接近,則值越大。

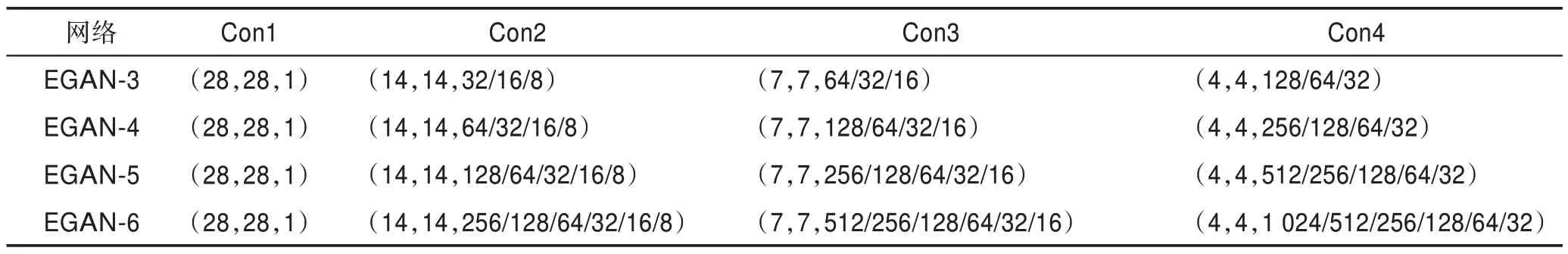

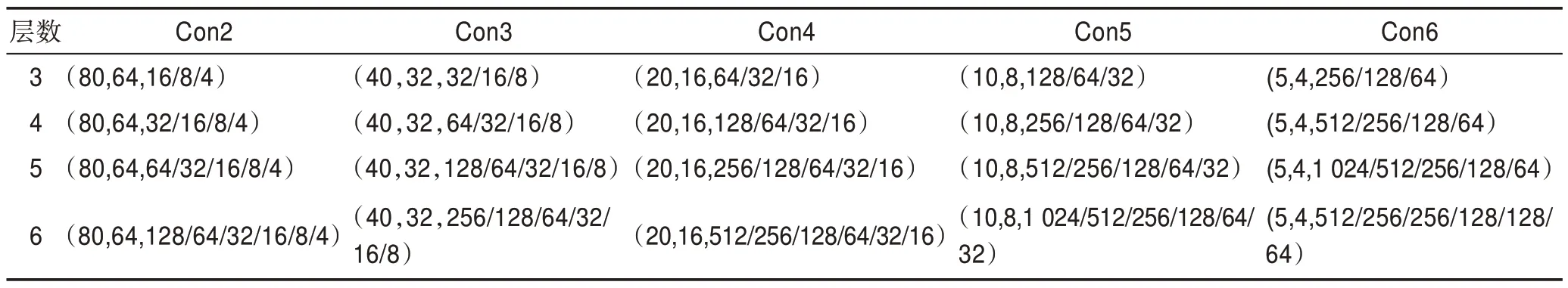

表1 針對MNIST 數據集的各網絡卷積層配置Table 1 Convolution layers configuration of each discriminant network for MNIST dataset

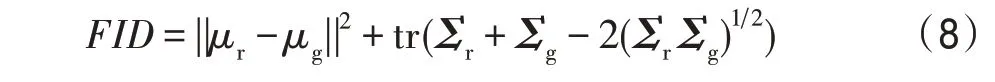

(2)FID(Fréchet inception distance)評價指標

該指標通過計算真實樣本與生成樣本在特征層的距離很好地度量了生成樣本的優劣,其數學表達式如式(8)所示:

其中,表示真實樣本的特征均值;表示生成樣本的特征均值;表示真實樣本特征的協方差矩陣;表示生成樣本特征的協方差矩陣。

該評價指標將生成樣本與真實樣本特征圖的均值與協方差矩陣進行比較,當生成樣本與真實樣本的特征越相近,其值越小。

(3)KID(kernel inception distance)評價指標

若生成樣本與真實樣本之間的差異越小,則其值越小。

4.2 實驗結果

主要從以下方面進行實驗:(1)集成不同判別網絡數量對生成樣本的影響;(2)將模型與同方向工作進行對比;(3)分析模型的時間復雜度。

(1)集成不同數量判別網絡

實驗細節:隨機噪聲服從~(-1,1);網絡訓練采用Adam 優化器(學習率l=2×10,動量參數=0.5);生成網絡的結構為(7,7,32),(7,7,64),(14,14,128),(28,28,64),(28,28,1);因小卷積核在分辨率較低時表現較好,且可減少參數量,所以網絡中與DCGAN 的5×5 的卷積核不同,本文選用了3×3 的卷積核,另外在最后一層采用了1×1 的卷積,基判別網絡間的不同之處在濾波器的數量,即數量上的乘以2 或4,或除以2 或4,具體設置如表1 所示。

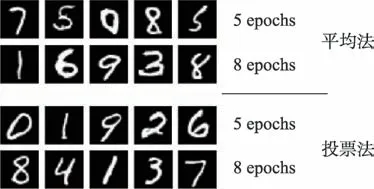

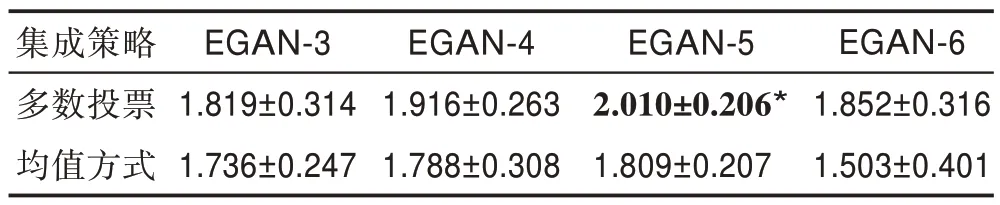

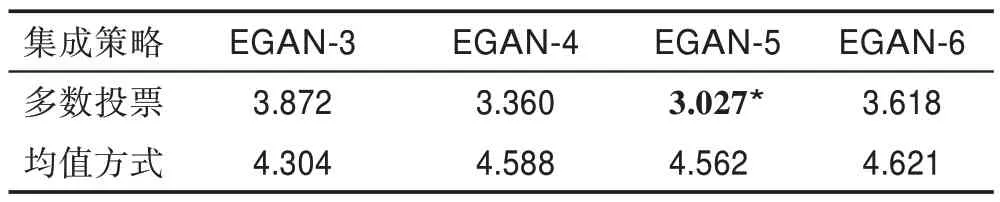

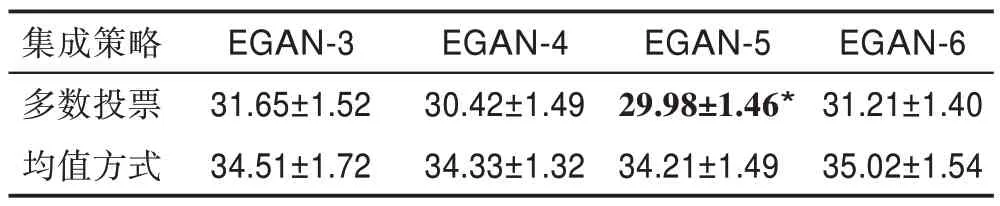

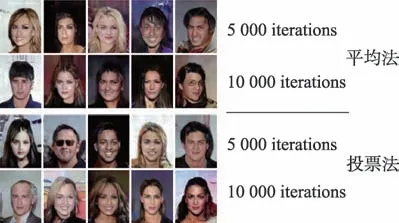

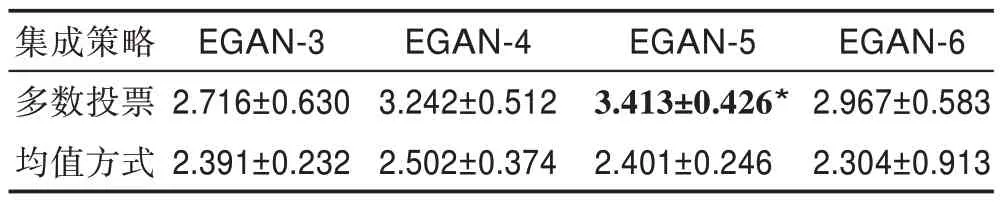

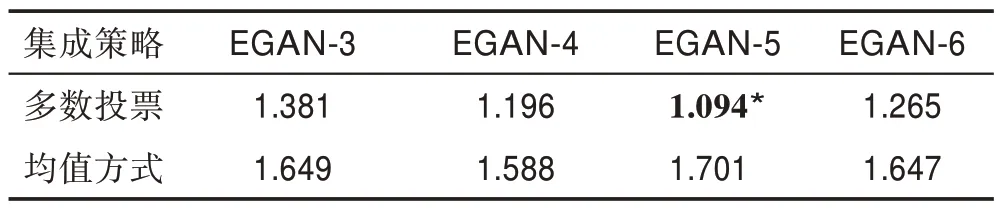

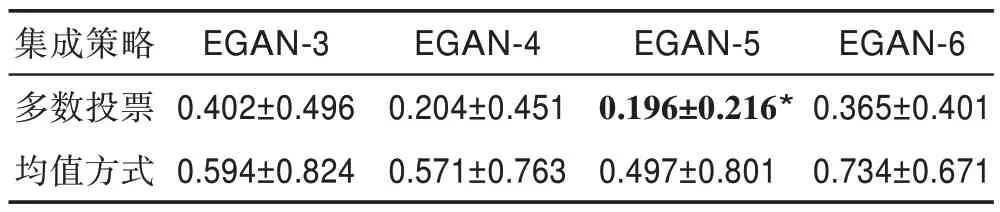

圖4 為分別使用平均法與投票法時模型生成樣本的情況,投票法比平均法生成樣本質量較高。另外,分別使用三種評價指標對兩種集成策略下不同的模型生成的樣本進行評價,結果如表2~表4 所示。通過對比可知采用平均法的模型總體沒有采用投票法的性能高,這是由于平均法中沒有減小性能較差的模型的影響,而采用具有動態調整權值的投票法則最大程度地提高了判別網絡的準確率(*對應的模型為在此指標下的最佳模型)。

圖4 采用不同集成策略生成的樣本對比Fig.4 Network generated samples by different integration strategies

表2 不同集成模型在兩種集成策略下的IS 得分Table 2 IS score of different integration models under two integration strategies

表3 不同集成模型在兩種集成策略下的FID 得分Table 3 FID score of different integration models under two integration strategies

表4 不同集成模型在兩種集成策略下的KID 得分Table 4 KID score of different integration models under two integration strategies

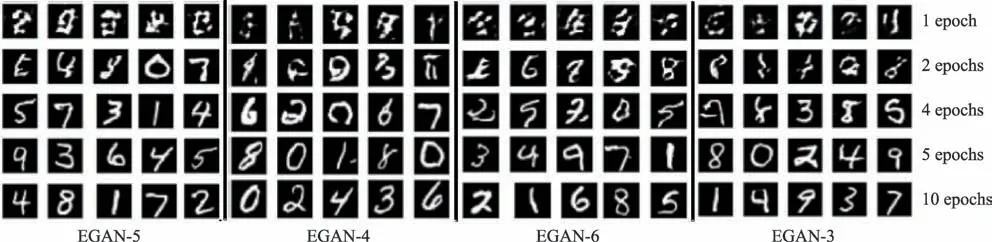

圖5 EGAN-n(n=3,4,5,6)模型生成的手寫體圖像Fig.5 Handwritten images generated by EGAN-n (n=3,4,5,6)

圖6 不同模型生成的手寫體圖像對比Fig.6 Comparison of handwritten images generated by different models

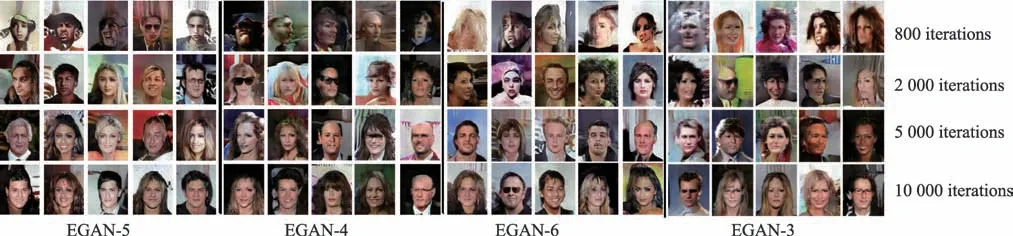

圖5 為EGAN-(=3,4,5,6)模型在迭代次數分別為1、2、4、5、10 epochs 時生成的手寫體圖像,可知當訓練為10 epochs 時,4 種模型均達到收斂狀態,其中EGAN-5 網絡生成樣本最優,其次為EGAN-4、EGAN-6,最后EGAN-3。

另外從結果可看出生成樣本質量與集成數量并非正比關系,而是達到某一閾值后出現性能下降的情況。為驗證這一結論,繼續設置了分別集成8 判別網絡、9 判別網絡以及更多數量的判別網絡,實驗中生成樣本情況并未好轉。由此可見,當網絡集成數量超過一定數量時性能會隨著集成數量的增加而降低。

通過使用不同評價指標對兩種集成策略下設置的不同集成數量的判別網絡模型進行評價,可知多數投票總體比均值集成方法結果較好,同時可知無論是在IS、FID 還是KID 指標下,EGAN-5 網絡模型都是最優的。

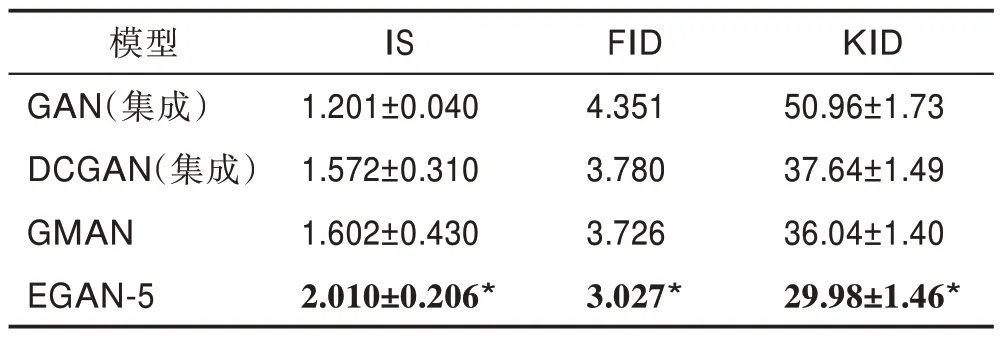

(2)與同方向工作比較

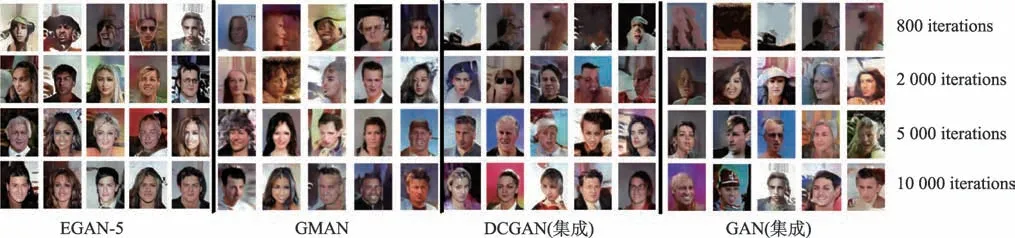

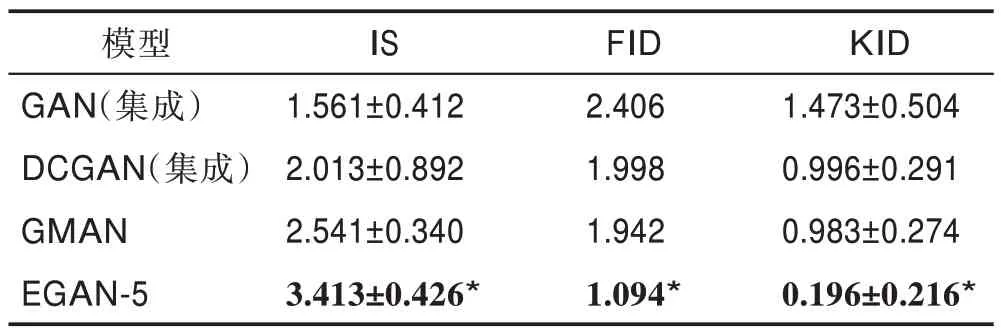

這一部分主要與GMAN 模型以及生成對抗網絡(GAN)、深度卷積生成對抗網絡(DCGAN)模型進行比較。為保持公平一致性,對GAN 以及DCGAN 進行了同等數量的集成,并在相同環境下進行實驗。采用相同的評價指標進行評價,實驗結果如圖6 所示。可知本文所提模型在4 epochs 時生成樣本已達到清晰狀態,另外三種比較模型收斂較慢且最終生成樣本較為粗糙。采用不同評價指標的結果列于表5,從表中可看出文中所提模型在幾種評價指標下均最優。

表5 不同模型在三種評價指標下的得分情況Table 5 Score of different models under three evaluation indices

實驗細節:隨機噪聲服從~(-1,1);網絡訓練采用Adam 優化器(學習率l=2×10,動量參數=0.5);生成網絡的結構為(5,4,1 024),(10,8,512),(20,16,256),(40,32,128),(80,64,64),(160,128,3);由于較大的卷積核在高分辨率下表現更好,同時為了減少參數量,使用1×5 與5×1 的卷積核代替5×5的卷積核,這是由于同時使用1×5 與5×1 的卷積核與單獨使用5×5 的卷積核的感受野相同,在判別網絡中卷積核具體設置為5×5、3×3、1×5、5×1、1×1。基判別網絡間的不同之處在于濾波器的數量,即數量上的乘以2 或4,或除以2 或4,具體設置如表6 所示。

表6 針對CelebA 數據集的各網絡卷積層配置Table 6 Convolution layers configuration of each discriminant network for CelebA dataset

(1)集成不同數量模型的比較

圖7 為采用平均法與多數投票法時模型的生成樣本情況,可知在采用多數投票法時生成樣本質量較好。另外還使用不同評價指標對兩種集成策略下的樣本進行評價,結果如表7~表9 所示。圖8 展示了不同模型在不同迭代次數下生成的人臉圖像,同樣EGAN-5 模型性能最佳,因為其生成樣本的質量與多樣性最優。另外,將本文的模型在不同集成策略下進行了比較,模型中采用多數投票的方式均比采用均值的方式表現較好。表7~表9 展示了在三種評價指標下各種模型的得分情況(*對應的模型為在此指標下最佳的模型)。

圖7 采用不同集成策略生成的樣本對比Fig.7 Network generated samples by different integration strategies

表7 不同集成模型在兩種集成策略下的IS 得分Table 7 IS score of different integration models under two integration strategies

表8 不同集成模型在兩種集成策略下的FID 得分Table 8 FID score of different integration models under two integration strategies

表9 不同集成模型在兩種集成策略下的KID 得分Table 9 KID score of different integration models under two integration strategies

通過設置不同集成數量的判別網絡模型,在兩種集成策略下可以看出選用多數投票的方法總體比選用均值的方法模型性能較高,而無論是在IS、FID還是KID 指標下EGAN-5 模型都是最優的。

圖8 EGAN-n(n=3,4,5,6)模型生成的人臉圖像Fig.8 Face images generated by EGAN-n (n=3,4,5,6) model

圖9 不同模型生成的人臉圖像對比Fig.9 Comparison of face images generated by different models

(2)與同方向工作比較

這一部分主要與GMAN 模型以及生成對抗網絡(GAN)、深度卷積生成對抗網絡(DCGAN)模型進行比較。為保持公平一致性,本文對GAN 以及DCGAN 進行了同等數量的集成,并在相同環境下進行實驗,采用相同的評價指標進行評價,實驗結果如圖9 所示。從圖中可看出本文的模型明顯優于幾種對比模型。另外采用不同評價指標的結果列于表10,從表中可看出本文所提模型在幾種評價指標下均最優。

表10 不同模型在三種評價指標下的得分情況Table 10 Score of different models under three evaluation indices

4.3 模型時間復雜度

卷積神經網絡的時間復雜度如式(9)所示:

其中,表示卷積神經網絡的深度;表示卷積層輸出特征圖的邊長;表示卷積核的邊長;表示神經網絡第個卷積層;C表示神經網絡第層的卷積核個數。

通過實驗可以發現,在MNIST 數據集下,GAN(集成)采用全連接的方式,DCGAN(集成)網絡中卷積核為5×5,GMAN 模型卷積核3×3,本文EGAN-5 模型采用了3×3 的卷積核,同時在最后一層使用了1×1的小卷積核,最終DCGAN(集成)的復雜度約為3.14×10,GMAN 模型的復雜度約為1.206×10,而本文模型約為4.37×10;同樣在CelebA 數據集上,DCGAN(集成)的卷積核為5×5,GMAN 的卷積核為3×3,本文模型不僅引入了3×3 卷積核、1×1 卷積核,還通過使用1×5 和5×1 的卷積核來代替5×5 的卷積核,從而提取更“全面”的信息。具體地DCGAN(集成)的復雜度約為1.044 5×10,GMAN 的復雜度約為5.199×10,而本文模型的復雜度約為3.269×10。因此在不同數據集上,相比GMAN 和DCGAN 模型,本文模型的復雜度都是最低的。

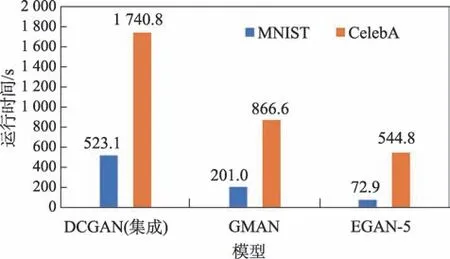

圖10 為運行一個epoch 時各模型花費的時間對比。可知無論是在MNIST 數據集還是在CelebA 數據集上,本文模型所需時間都是最短的,其次為GMAN模型,最后為DCGAN(集成)模型。

圖10 不同模型訓練一個epoch 所需的時間Fig.10 Time required for different models to be trained in an epoch

另外,本文還比較了EGAN-5 模型生成的部分樣本與使用的數據集中的部分樣本,結果如圖11所示。

圖11 生成的部分樣例(左)與數據集的部分樣例(右)Fig.11 Some generated samples(left)and some samples in dataset(right)

5 結束語

本文提出了一種新的模型框架,將選擇性集成學習的思想引入到生成對抗網絡中,并根據判別網絡的判別精確度動態賦予判別網絡投票權重,從而充分發揮各判別網絡的優勢,避免了因判別網絡判別性能不足產生的影響。在本文的工作中,通過大量的實驗以及對比實驗,詳細分析了在不同迭代次數上不同集成數量模型的表現,以及在不同數據集上模型的時間復雜度。本文采用了前人工作中的優點,比如深度卷積神將網絡(DCGAN)中新穎的卷積方式,完全取代了全連接。文中還存在一定的不足,接下來會更加注重模型的設計以及細節,還會把工作的重心放在生成網絡上以及更加關注網絡的質量。