引入獨立融合分支的雙模態語義分割網絡

田 樂,王 歡

(南京理工大學計算機科學與工程學院,南京 210094)

0 概述

在全天時條件下的語義分割任務中,惡劣光照、雨雪等天氣條件會對可見光和熱紅外相機成像造成不同程度的干擾,因此,有很多研究人員聯合可見光和紅外熱圖像的信息[1-2]來設計雙模態語義分割方法。可見光和熱紅外相機具有多種可以互補的優勢,例如,在白天場景下,可見光相機分辨率高,成像清晰;在黑夜環境中,熱紅外不受低光照的影響,并且具有穿透霧霾等遮擋物的能力,在惡劣場景下依然能夠觀測到車輛、行人等與背景有溫度差異的目標。通過互補這2 個傳感器的信息,能夠提升全天時的道路場景語義分割性能。但是,SUN 等[3]指出直接合并可見光、紅外圖像的所有通道信息作為網絡模型的輸入時效果并不好,有些甚至不如單模態網絡,造成該現象的原因主要與雙模態數據的差異性有關。

針對上述問題,主流方法大都采用2 支編碼器來提取雙模態圖像的特征,然后對相同級別的特征圖進行融合,以此來互補雙模態信息。文獻[4-5]中提出的多模態融合網絡均是采用對應元素相加的方式組合每個模態的特征,但是這些研究并沒有在雙模態特征的選擇上表現出傾向性,當遇到雙模態圖像包含的信息量嚴重失衡時,方法的效果將下降,例如,當相機視野內所有物體的溫度差異很小時,熱圖像的信息量就很有限;在光照強烈或嚴重不足時,RGB 相機產生的圖像會出現大面積白色或黑色等無效信息。文獻[6]針對元素相加融合雙模態信息的方法進行改進,在網絡中加入模態加權融合層以加強對融合特征圖的模態選擇,該方法能夠在夜間光照缺乏時檢測出行人目標。根據雙模態圖像所包含信息量的多少來自適應地將更高的權重賦予信息量貢獻更大的模態圖像,有利于更好地完成分割任務。

為了有效融合可見光譜與紅外譜段信息來實現圖像語義分割,本文提出一種雙模態深度神經網絡。在雙流網絡架構的基礎上,增加一支包含自適應圖像融合模塊的獨立融合子網絡,該子網絡能夠通過空間、通道注意力機制對雙模態特征進行空間和通道上的顯著性分析,以自適應地調整特征融合系數,從而完成雙模態圖像特征級和像素級的融合。

1 相關工作

1.1 圖像語義分割

圖像語義分割的目標是對圖像的每一個像素點進行類別預測。為了精細化圖像的分割結果,研究人員提出了眾多應用于深度學習分割系統的網絡結構和方法。BADRINARAYANAN 等[7]提出的SegNet 網絡通過在池化層保留池化索引實現了非線性的上采樣,其能夠在解碼階段融入原始圖像的空間信息。HE 等[8]提出深度殘差學習的方法,該方法解決了梯度彌散問題,使深層網絡的訓練成為可能。Google 團隊提出的GoogleNet 網絡證明了CNN 可以有更多的排列方式,其提出的Xception 模塊[9]不僅通過繼承Inception v3 感知模塊的功能獲得了不同尺度的特征,還利用引入的可分離卷積提高了模型的運行速率。

此外,各種注意力機制也被應用于語義分割領域。MA 等[10]通過在卷積運算后加入自身平方項的注意力機制,增強了深層和淺層特征在解碼器階段的融合效果。HU 等[11]從像素預測和像素分組2 個獨立的維度對語義分割重新進行考量,使用多頭的壓縮注意力模塊增強像素間的密集預測。本文網絡模型同樣引入了注意力機制,包括空間、通道注意力機制,從而在不增加參數量的情況下使得網絡能夠選擇更關鍵的信息。

1.2 多模態的語義分割

多模態圖像能夠提供具有不同成像機理的信息,因此,在醫學領域得到廣泛應用[12],多模態語義分割經常被用于分割病變區域,如ZHOU 等[13]利用多模態圖像完成腫瘤的檢測與分割任務。

多模態圖像語義分割在機器人環境感知中也得到應用,常見的數據源有可見光圖像、紅外圖像以及3D 點云圖像。SUN 等[14]以DenseNet 作為編碼器主干,提出兩階段的融合策略:第一階段在RGB 編碼器中分層添加紅外特征;第二階段將融合的特征圖與對應層級的解碼器特征圖進行連接,以恢復密集下采樣所造成的空間信息損失。HAZIRBAS 等[15]在FuseNet 網絡中設計雙支VGG-16 編碼器同時提取RGB 和Depth 特征,通過密集和稀疏融合策略將深度特征融合到RGB 編碼器中。Lü 等[16]使用Resdiv模塊完成融合特征的解碼工作,其可以有效地融合顏色和紅外特征。本文網絡在編碼階段提出一種新的方法,在雙流網絡架構的基礎上增加一個獨立融合網絡分支,其輸入為可見光和紅外圖像,根據雙模態圖像信息量的貢獻度自適應地調整融合系數以得到融合特征圖。例如,當目標與環境溫度相近時,紅外圖像在特征提取中提供的可用信息量較少,對于學習到的紅外特征,融合網絡在生成融合特征圖時就會賦予其較低的權重。

1.3 圖像融合

在傳統的圖像處理方法中,根據圖像表征層次的不同,圖像融合通常分為像素級融合、特征級融合和決策級融合這3 種層次[17]:像素級圖像融合在輸入數據層面進行融合,最大限度地保留了圖像的細節信息;特征級融合對特征提取后的信息進行合并處理;決策級融合是在每個模態數據單獨完成特征提取和分類后,根據每個決策的可信度做出的綜合處理。此外,基于變換域的分解重構融合算法[18-19]也被用于可見光和紅外圖像的融合任務。

在深度學習網絡中,多模態數據的融合策略有很多。本文以融合可見光、紅外2 種模態數據為例進行介紹,這些策略也可以推廣到更多的模態問題中。用vi、ir 表示可見光、紅外2 種模態,和為它們在神經網絡第l層的特征圖,分別是第l層的變換函數和融合結果。3種融合策略具體如下:

1)Addition。在雙模態特征融合上采用像素級累加的方式得到融合特征,即:

2)Concatenation。這種策略通常會在卷積層之前沿特征圖的深度方向疊加2 種模態的數據,如式(2)所示:

其中:⊕表示張量的合并操作。

3)Mixture of Experts。混合專家網絡[20]的策略能夠通過多個專家網絡隱式地學習每個模態的權重圖,再和原始特征圖加權以得到最終的融合特征圖。VALADA 等[21]采用這種融合策略,根據場景條件自適應地加權專家網絡得到的特征,從而完成全天時和跨季節的道路場景解析。本文以wvi、wir分別代表專家網絡為可見光、紅外模態預測的權重,則最終融合特征的數學表示為:

2 本文雙模態語義分割網絡

2.1 模型整體框架

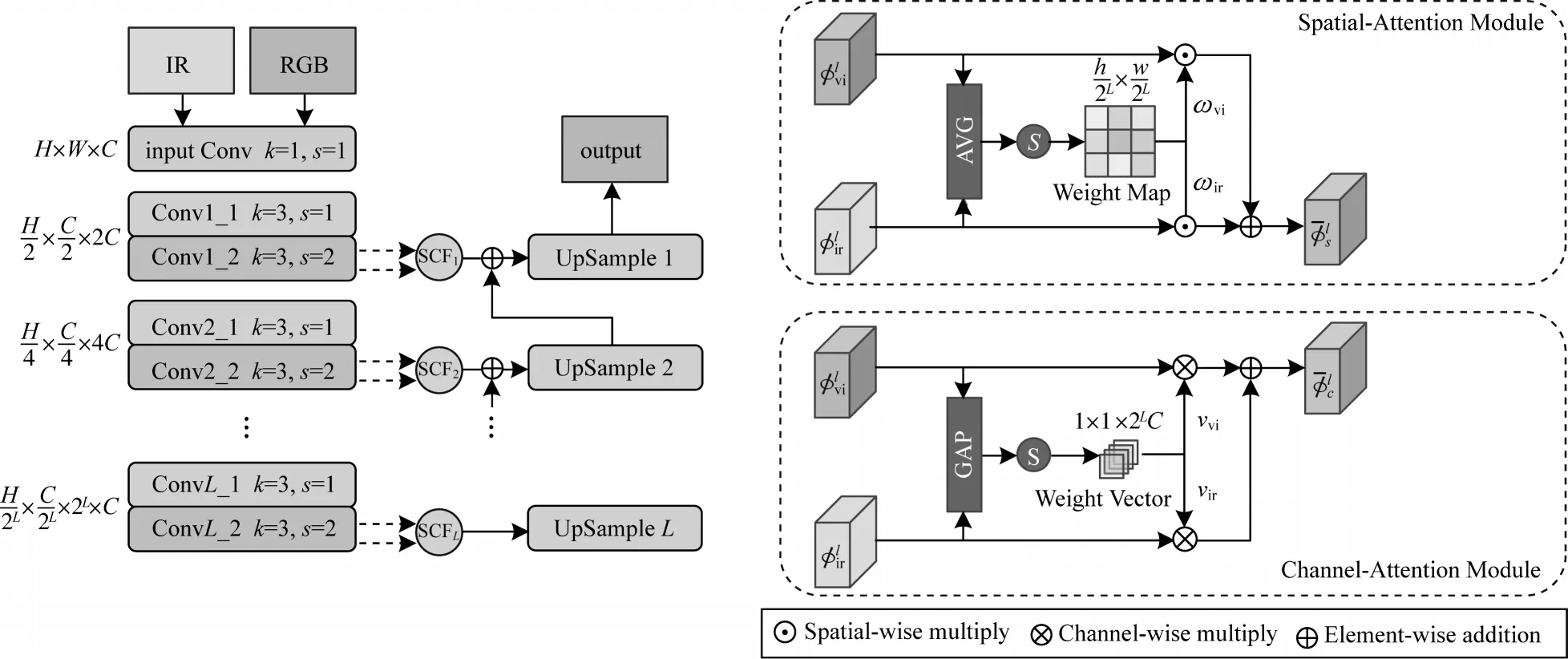

圖1 所示為本文模型的整體結構,其中,左圖是網絡的整體框架,右圖是上采樣塊的詳細結構,k和s分別表示卷積核的大小和步長,默認值分別為3 和1。鑒于Encoder-Decoder 是一種有效的語義分割網絡框架[22],本文采用該框架來搭建所提模型的主干網絡。與主流RGBT 網絡的雙編碼器有所不同,本文在此基礎上增加一支包含融合模塊的編碼器網絡。3 個獨立的編碼網絡分別從RGB 圖像IV、熱紅外圖像IT、融合“圖像”(融合模塊的輸出)中提取特征。本文將所提網絡命名為三支型網絡,三支編碼器分別命名為可見光編碼子網絡EV、紅外編碼子網絡ET、融合編碼子網絡EF。EF的前端是一個融合模塊,通過注意力機制自適應地在像素級別融合雙模態的信息。EF子網絡在下采樣操作后添加可見光和紅外單模態的編碼分支網絡的各級特征,以得到多模態特征。

圖1 本文模型的整體結構Fig.1 The overall structure of the proposed model

2.2 模型細節

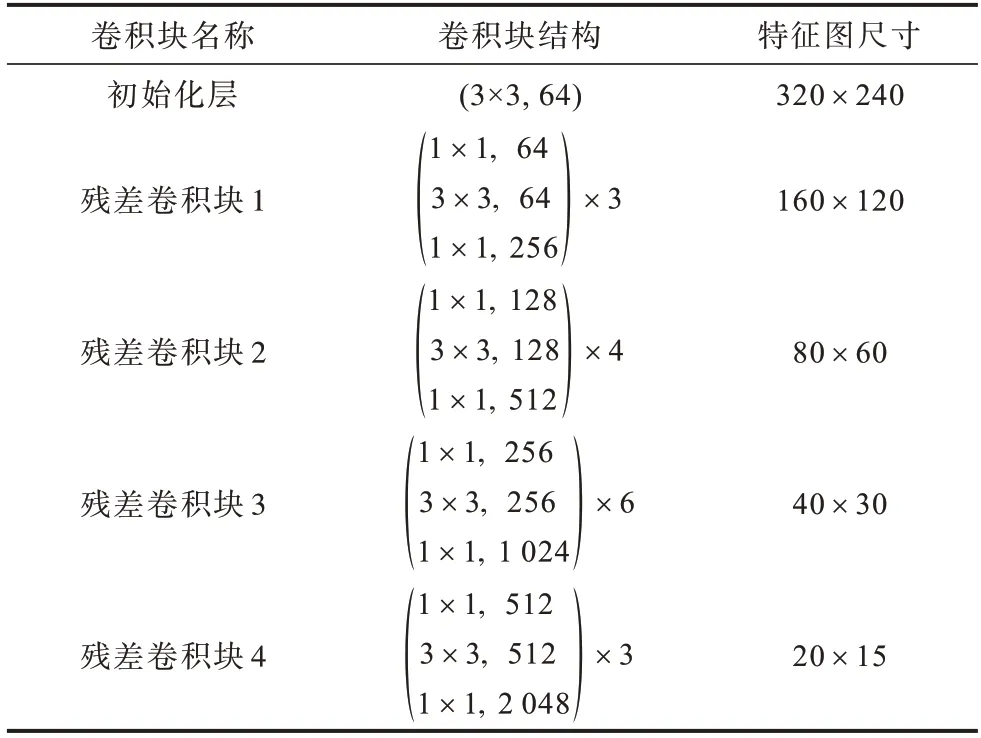

模型編碼(Encoder)部分由3 支包含ResNet 結構的編碼子網絡組成。3 種模態原始圖像的通道數分別為1、3、4,而3 支編碼器EV、ET、EF的輸入數據要求通道數均為64。因此,本文設計了In Conv 卷積層來統一多模態數據的深度(即設置該卷積層輸出通道數均為64),之后采用L個stage 的殘差卷積層(本文中L=4)來進行不同尺度特征的提取。數據流經過每一個stage,寬度和高度各減小1/2,通道數會增加一倍。表1 所示為編碼器子網絡的具體結構,包括每個殘差卷積塊使用的殘差卷積層數量。

表1 編碼器子網絡結構Table 1 Structure of encoder sub network

殘差卷積層主要分為2 種設計方式,如圖2 所示。本文選擇3 層殘差卷積結構,其將2 個3×3 的卷積層替換為1×1、3×3、1×1 的結構,從而有效降低參數量。例如,在一個卷積單元中,2 層的殘差結構參數量為18C2,而3 層殘差結構中第一個1×1 的卷積將通道數降為原始通道數的1/4,然后通過后置的1×1卷積再將通道數恢復,整體上的參數量為比2 層的殘差結構降低了94.1%。

圖2 殘差卷積的2 種結構Fig.2 Two structures of residual convolution

整個編碼器網絡通過像素級別的融合編碼子網絡實現雙模態圖像的特征融合,且該子網絡通過Concat方式添加對應層級的可見光和紅外特征圖,通過該方式使得到的特征圖通道數變為原先的3 倍。為了減輕網絡負載,本文使用一個1×1 的卷積來降低通道數,因此,融合編碼子網絡最終的輸出特征圖為:

Decoder 部分包含4 個上采樣塊,由卷積層、BN層、激活層、反卷積層組成。每個上采樣塊的殘差連接部分首先采用1×1 卷積核的卷積層作為bottleneck層進行通道數降維,以減少訓練的參數量,然后使用核為3 的卷積層和同尺寸的反卷積層來恢復特征圖的尺寸。上采樣塊的短連接部分只做反卷積操作,得到與殘差部分相同尺寸的特征圖。把上述2 個部分的輸出通過像素級對應的方式進行組合,得到新的特征圖并通過ReLU 激活函數層獲得當前塊的輸出,將其作為下一層的輸入。整個模型使用多分類的交叉熵損失函數來訓練,通過計算預測數據與真實標簽的差距來反向傳播梯度從而優化模型。

2.3 像素級特征融合模塊

多數融合策略采用加權平均算子的方式生成加權映射以融合特征,如ASPP 空洞空間金字塔池化模塊使用多個空洞卷積層來提取不同感受野下的特征,從而得到融合特征,然而,這些策略并不適合本文的雙模態特征融合,因為本文的目標是既保留紅外圖像中所提取的輻射特征,也要保留可見光圖像中所提取的細節特征。融合注意力機制能夠解決不能針對性地提取不同模態特征的問題。

本文基于空間和通道注意力機制的融合策略,可以實現像素級的特征融合。空間注意力機制以特征圖的每個像素點作為單位,對每個像素點都分配一個權重值,這個權重值可看作一個矩陣,尺寸與當前特征圖一致;通道注意力以特征圖的每個通道作為單位,得到的權重值是一個向量,其與當前特征圖的深度一致。如圖3 所示,本文像素級特征融合模塊分為3 個階段:下采樣階段分別對可見光、紅外圖像進行特征提取;融合階段對相同層級的雙模態特征圖(虛線部分)采用空間、通道2 種注意力融合(Spatial and Channel Fusion,SCF)機制;上采樣階段在每個層級上添加前一層的特征圖,再通過上采樣操作獲得當前層的融合特征。

圖3 特征融合模塊結構及SCF 機制流程Fig.3 Feature fusion module structure and SCF mechanism procedure

權重圖ω由空間注意力模塊(Spatial-AttentionModule,SAM)的AVG 層和Softmax 操作得到。其中,AVG為通道平均層,能夠在特征圖所有的空間位置(x,y)上對所有通道的值取平均,得到尺寸為h×w×1 的特征圖,再利用Softmax 層計算得到權重圖ω,如式(5)、式(6)所示:

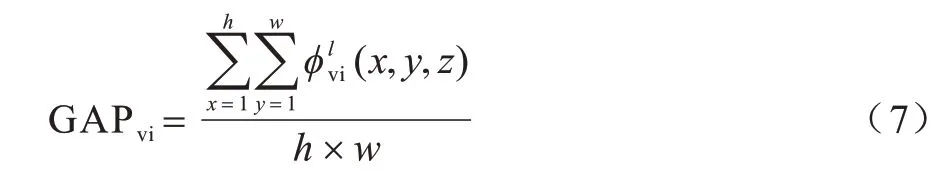

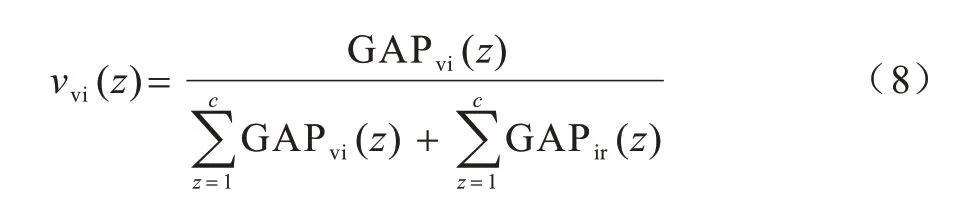

權重向量ν由通道注意力模塊(Channel-Attention Module,CAM)的GAP層和Softmax 操作得到。GAP為全局池化層,在特征圖每個通道上對所有位置上的值取平均,得到c維的特征向量,再通過Softmax 計算得到權重向量v,如式(7)、式(8)所示:

3 實驗結果與分析

3.1 數據集與評價指標

MF 是較早用于城市場景雙模態語義分割的數據集,其包括1 569 個有像素級標注的可見光、紅外圖像對。本文對MF 數據集進行劃分,使訓練集、驗證集、測試集的比例為4∶1∶1,且每部分的白天、夜晚數據比例為1∶1。

FR-T 數據集包含多個白天和夜晚的可見光、紅外圖像序列,并對13 個語義類別進行了標注,但是該數據集沒有提供夜間場景的圖像標注信息,因此,本文僅使用部分白天拍攝的圖像序列,共12 170 個可見光、紅外圖像對。

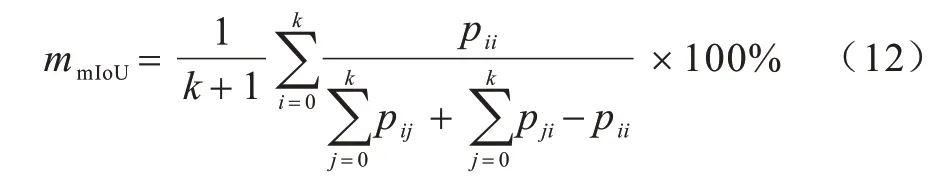

在語義分割領域,一般利用均交并比(mean Intersection over Union,mIoU)作為度量標準,其計算公式為:

其中:k+1 是所有語義類別的個數(包含未標記的類);pxy表示真實值為x而被預測為y的像素數量;pii代表真正例(True Positive,TP);pij、pji分別代表假正例(False Positive,FP)和假負例(False Negative,FN)。

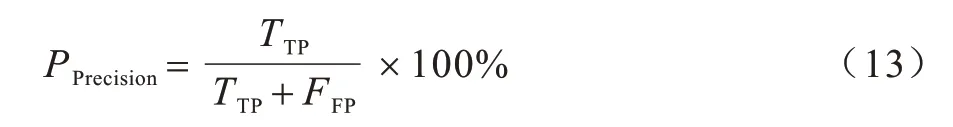

在消融實驗部分,本文還引入精確率Precision指標來衡量模型的查準率,該指標表示在所有正樣本中正確目標所占的比例,計算公式如下:

3.2 實驗環境與參數設置

本文實驗平臺為基于Linux18.04 系統的深度學習服務器,包括4 張Nvidia 3090 顯卡,并使用Pytorch 1.7 深度學習框架。分別在MF 和FR-T 數據集上訓練模型,初始學習率設置為0.03,學習率每次迭代下降2%,訓練批大小為4。使用SGD 和Adam優化器的組合策略共訓練200 個Epoch,通過最小化交叉熵損失函數來優化模型參數。

6.3.3 抽獎規則。抽獎是從已關注了XX圖書館官方微信并參與了現場網上薦購的讀者的微信號中抽取。其中,微信薦書抽獎共分3輪,第一輪抽取三等獎20個,第二輪抽取二等獎10個,第三輪抽取一等獎5個,抽獎只針對微信網上薦購渠道,門戶、APP等渠道,不參與抽獎。

3.3 與主流模型的對比實驗

將本文所提模型與MFNet[1]、PSTNet[4]、HeatNet[23]、RTFNet-50[3]模型進行對比實驗,此外,還設置一組RTFNet-50+NestFuse[24]的組合模型,以驗證 本文像素級融合策略在語義分割任務中的性能優勢。NestFuse[24]是RGB、紅外圖 像的融 合網絡,其 在RTFNet 的基礎上增加一支編碼網絡,輸入為通過NestFuse 輸出的紅外、可見光融合圖像。NestFuse 模型直接采用原始論文中提供的參數。

表2 所示為MF 數據集上的對比實驗結果(mIoU),其中,“—”表示原文實驗未提供,加粗字體表示每列中的最好結果。從表2 可以看出,在8 個語義類別中,本文模型在其中的6 個類別上都達到了最優,另外,在第5、第6 組實驗中,Guardrail 類別的檢測率有大幅提升,而這2 組實驗與其他網絡模型的主要區別是增加了一支融合編碼網絡,這表明在雙模態網絡中增加第三支融合編碼器的策略具有有效性。另外,由于第5 組實驗中網絡的融合模塊是NestFuse,即本文提出的像素級融合模塊在可見光、紅外的雙模態數據融合中更具優勢。

表2 各模型在MF 數據集上的測試結果Table 2 Test results of each model on the MF dataset %

圖4 所示為MF 數據集上定性實驗的部分樣例可視化結果(彩色效果見《計算機工程》官網HTML版),第1 列、第2~第4 列分別顯示白天、夜晚場景下的結果,第2~第4 列代表夜間的照明條件,部分區域甚至完全黑暗。從圖4 可以看出,與其他網絡模型相比,本文網絡模型提取的目標更完整,比如在第3、第4 列中,只有本文模型識別出了完整的車輛、自行車類別的目標。

圖4 MF 數據集上的分割結果可視化效果Fig.4 Visualization of segmentation results on MF dataset

從表3 可以看出,在FR-T 數據集的12 種語義類別中,本文模型在其中的8 種類別上mIoU 達到了最優,總體平均值比RTFNet高0.6個百分點。圖5所示為FR-T數據集上的部分樣例可視化結果(彩色效果見《計算機工程》官網HTML 版),從中可以看出,本文模型對目標的識別更為準確,分割的結果也更為精細。

表3 各模型在FR-T 數據集上的測試結果Table 3 Test results of each model on the FR-T dataset %

圖5 FR-T 數據集上的分割結果可視化效果Fig.5 Visualization of segmentation results on FR-T dataset

為了測試各模型在白天、夜晚不同場景下的穩定性,在MF 測試集的白天、夜間圖像上分別進行評估,表4 所示為白天和夜間場景中模型預測結果的定量比較(mIoU),實驗結果表明,本文模型在2 種場景下均能達到最佳效果,其精確率較2 種場景中次優的模型分別高出4.5 和4.0 個百分點。

表4 白天和夜晚場景下的模型分割結果比較Table 4 Comparison of model segmentation results in day and night scenes %

3.4 消融實驗

3.4.1 網絡參數分析

編碼子網絡中殘差卷積塊的堆疊數量L直接影響網絡的深度,為了探究其對模型學習效果的影響,設置L分別為3、4、5 并進行實驗,結果如表5 所示,從中可以看出,在MF 數據集上使模型效果最優的L值為4,L過大會使模型的參數量增加,訓練難度提高,L過小會導致模型的學習結果欠擬合。

表5 殘差卷積塊數量對模型性能的影響Table 5 Influence of the number of residual convolution blocks on the performance of the model

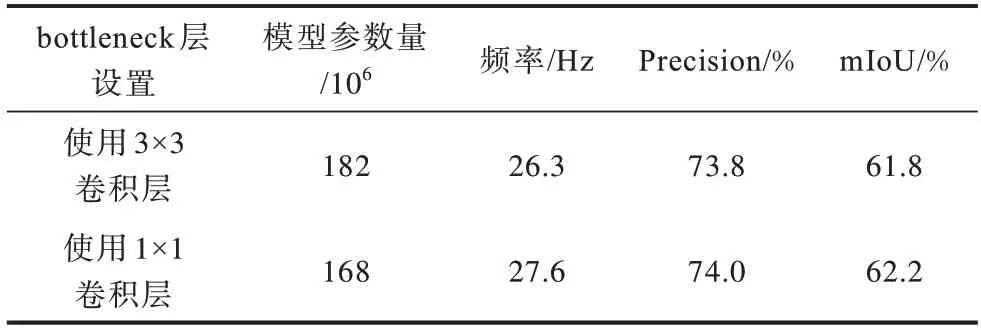

本文在編解碼器中使用1×1 卷積的bottleneck 層,目的是降低特征圖的通道數。通過實驗分析bottleneck層的使用與否對網絡參數量、實時性、準確性產生影響。表6 結果表明,使用1×1 卷積的bottleneck 層策略,不僅能讓整個模型的參數量降低8%,而且在準確率和平均交并比指標上均有略微提升。

表6 bottleneck 層對模型性能的影響Table 6 Influence of the bottleneck layer on model performance

3.4.2 各編碼器分支對網絡的影響測試

為了分析三支型網絡中各編碼器分支的作用,本文嘗試了各分支的其他組合形式:同時去掉紅外和可見光2 支編碼器子網絡(w/o RGBT 實驗組);單獨去掉融合編碼器子網絡(w/o Fusion 實驗組)。實驗結果如表7 所示,從中可以看出,當去除紅外和可見光編碼器分支時,模型的預測準確率下降8.9%,僅缺少融合編碼器子網絡時下降7.6%。因此,通過紅外、可見光編碼器網絡補充的特征級信息以及融合編碼器自身的像素級融合特征,都能使模型性能得到提升。

表7 編碼器分支的組合實驗Table 7 Combined experiment of encoder branch %

3.4.3 像素級融合模塊中注意力機制的有效性測試

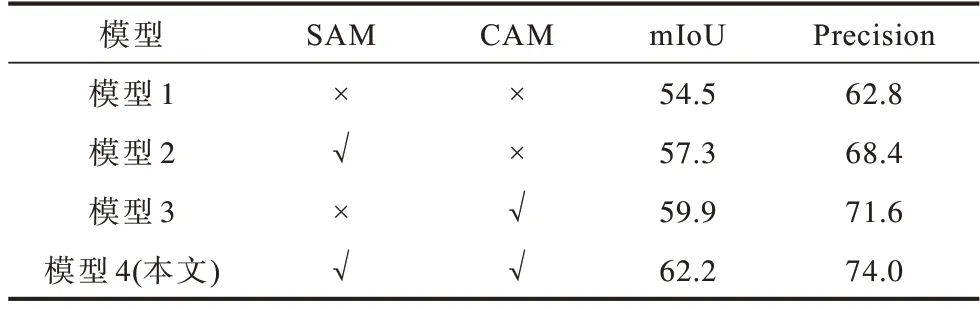

表8 所示為融合模塊中采用不同注意力機制的效果,以不采用注意力機制的網絡模型1 為基準,將其分別與采用空間注意力機制SAM(模型2)、通道注意力機制CAM(模型3)以及空間通道注意力機制SCAM(模型4)進行比較。從表8 可以看出:模型1因為沒有使用注意力機制,其平均交并比和預測精確率均為最低;與通道注意力機制(模型3)相比,空間注意力機制(模型2)對網絡分割效果的提升更明顯,表示空間注意力機制更有效;本文模型在2 個指標上均為最優,說明采用空間和通道注意力機制相結合的方式最有效。

表8 注意力機制的消融實驗結果Table 8 Ablation experimental results of attention mechanism %

3.4.4 融合策略的影響

為了驗證不同融合策略對模型效果的影響,設計早期融合和晚期融合2 種策略進行對比實驗[25]。如圖6 所示,上圖是采用早期融合策略的網絡模型,其以可見光、紅外以及像素級融合模塊的融合結果作為輸入,將3 種圖像逐通道拼接作為新的輸入,然后訓練分割網絡,整個模型從第一層到最后一層都可以利用不同模態的特征信息。早期融合策略可以表示為:

圖6 中的下圖是采用晚期融合策略的網絡模型,每個模態圖像是對應分支網絡的唯一輸入,僅在決策階段才綜合各分支網絡的信息,且以預測概率最大的類別作為最終的分割結果。使用該融合策略的模型旨在從不同模式中獨立學習互補信息。晚期融合策略可以表示為:

圖6 2 種融合策略的模型結構Fig.6 Model structure of two fusion strategies

表9 中的前2 行數據分別對應早期融合、晚期融合策略的網絡模型。本文調整3 組實驗的編碼器、解碼器結構,均減少一個下采樣層和對應的上采樣層以及相關的卷積層。一方面,由于遲融合網絡分別含有3 支編碼器、解碼器網絡,如果采用和第2 節相同的下采樣數量,遲融合模型的參數量會過大從而導致難以訓練;另一方面,對所有組實驗均采用相同的策略能排除模型結構對實驗數據的影響。

表9 不同融合策略的實驗結果Table 9 Experimental results of different fusion strategies

綜合3 組實驗模型的參數量、預測結果的平均交并比以及分割精確率可以看出,雖然采用遲融合策略的網絡取得了最佳表現,但是將融合階段置于網絡的后端,需要更多地參數來執行前置的卷積以及其他操作。本文模型采用的融合策略在準確率和參數量上取得了較好的平衡。

3.4.5 圖像降質和失效情況下的網絡測試

本次實驗測試輸入圖像質量降低甚至失效時對模型性能的影響程度。通過對輸入的可見光、紅外熱圖像附加額外操作來模擬圖像的降質和失效情況,如圖7 所示。對于圖像降質,本文通過改變RGB圖像的亮度和對比度,以模擬可見光相機在過曝、欠曝場景下得到的降質圖像;通過給紅外圖像附加高斯濾波操作,以模擬紅外圖像的降質。對于圖像失效,本文在圖像的每個通道上都增加一個全局平均池化操作。

圖7 降質、失效圖像的合成與實驗結果Fig.7 Synthesis and experimental results of degraded and invalid images

為了定量地說明網絡在上述情況下受影響的程度,本文將處理后的圖像分別輸入RTFNet 網絡和三支型網絡中進行對比。表10 所示為測試網絡在雙模態圖像質量降低或單一模態圖像失效時的性能表現,其中,下降率表示模態失效時模型指標較正常狀態的下降幅度。對輸入圖像的降質操作具體為:將可見光圖像的整體亮度調整為原來的0.2 倍;在紅外圖像上增加一個核尺寸為21 的高斯濾波操作;對雙模態輸入圖像同時采取上述2 種操作。從表10 可以看出:當可見光、紅外圖像單獨降質時,本文模型準確率分別下降3.7%和3.9%,RTFNet 模型準確率分別下降5%和4.3%;當雙模態圖像均降質時,2 種模型準確率分別降低11.1%、12.1%。對于單一模態輸入圖像失效的情況,參與實驗的模型都受到了較大程度的影響,在可見光、紅外圖像分別單獨失效時,RTFNet 模型的測試指標分別下降16.9%、36.5%,本文模型則分別下降22.2%、24.5%。

表10 圖像降質和失效情況下的測試結果Table 10 Test results in case of image degradation and invalidation %

在輸入圖像失效的極端場景中,由于本文模型使用三支編碼子網絡分別進行特征提取,因此能夠保證有正常輸入的一支子網絡能夠繼續工作,此外,像素級特征融合模塊在這種情況下雖然丟失了雙模態特征的選擇功能,但仍然能對正常輸入模態圖像進行特征提取和增強,這也是在任一模態圖像失效時本文模型能得到一個穩定的分割結果且模型指標下降程度較低的原因。

4 結束語

為對城市場景圖像進行語義分割,本文提出一種雙模態深度神經網絡。該網絡通過RGB-T、像素級數據融合模塊以及注意力機制,完成雙模態圖像的特征級和像素級融合。實驗結果表明,在加入獨立融合分支網絡后,模型性能得到一定提升,在公開數據集上,與已有網絡MFNet、PSTNet 等相比,本文所提網絡能取得最優的分割效果。此外,本文還研究了輸入模態圖像降質和失效情況下模型的性能表現,結果表明,無論是單個模態圖像降質還是雙模態圖像均降質甚至單個模態圖像完全失效,本文模型受影響程度均較低,表明其魯棒性較高。

本文所提網絡仍然存在若干問題需要解決:目前整個模型參數量達到億的數量級,推理速度無法滿足實時處理的需求,今后嘗試利用參數剪枝的方法加快網絡的運行速度;模型在白天和夜晚2 種情景下的分割效果存在一定差距,本文認為這和雙模態圖像很難在像素上一一對應有關,可以通過調整深層特征圖映射的感受野大小來嘗試解決該問題;雖然本文網絡中融合了細粒度的特征信息和粗粒度的抽象信息,但是各個類別的上下文信息也同樣值得探究,利用這些信息在物體邊界上獲取更好的分割效果也是下一步的研究方向。