基于全局時空編碼網絡的猴類動物行為識別

孫 崢,張素才,馬喜波

基于全局時空編碼網絡的猴類動物行為識別

孫 崢1,2,張素才3,馬喜波1,2

(1. 中國科學院自動化研究所,北京 100190;2. 中國科學院大學人工智能學院,北京 100049;3. 北京昭衍新藥研究中心股份有限公司,北京 100176)

猴類動物行為的準確量化是臨床前藥物安全評價的一個基本目標。視頻中猴類動物行為分析的一個重要路徑是使用目標的骨架序列信息,然而現有的大部分骨架行為識別方法通常在時間和空間維度分別提取骨架序列的特征,忽略了骨架拓撲結構在時空維度的整體性。針對該問題,提出了一種基于全局時空編碼網絡(GSTEN)的骨架行為識別方法。該方法在時空圖卷積網絡(ST-GCN)的基礎上,并行插入全局標志生成器(GTG)和全局時空編碼器(GSTE)來提取時間和空間維度的全局特征。為了驗證提出的GSTEN性能,在自建的猴類動物行為識別數據集上開展實驗。實驗結果表明,該網絡在基本不增加模型參數量的情況下,準確率指標達到76.54%,相較于基準模型ST-GCN提升6.79%。

行為識別;骨架序列;全局時空編碼網絡;猴類動物;藥物安全評價

在臨床前藥物安全評價中,猴類動物在用藥前后的行為變化是必不可少的觀測指標[1-3]。長時間的人為觀察在成本和隨機性方面均存在不可忽視的缺陷。因此需要研發可行的人工智能方法對猴類動物表現出來的與藥物安全評價相關的行為進行實時、定量分析。目前針對人類的行為識別方法已經得到了廣泛發展,然而在猴類動物上相關方法的研發卻發展緩慢。因此,使用人工智能方法自動識別猴類動物的行為對臨床前藥物安全評價具有重要的現實意義和應用前景。

近些年,一些學者使用人工智能方法進行了動物行為識別任務的研究[4-5],并在各自的動物數據集上達到了較高的性能指標,但在臨床前藥物安全評價場景中,猴類動物行為識別任務仍有一些特有問題亟待解決。如,猴類動物所處的場景單一、背景擾動、光照變化以及目標外觀差異較小,導致連續的視頻幀和光流圖中包含冗余信息。此外,猴類動物的行為識別需要充分考慮動作在時空維度的整體性。針對此,本文使用猴類動物的骨架序列信息進行行為識別,并提出基于全局時空編碼網絡(global spatiotemporal encode network,GSTEN)的骨架行為識別方法。該方法本質是使用訓練好的姿態估計模型對一段視頻中的每一幀進行關鍵點的識別,再基于上述關鍵點形成的骨架序列信息進行行為識別,其中骨架序列信息包括每一幀中目標關鍵點的二維坐標和置信概率。骨架行為識別方法關注目標的肢體動作變化,丟棄了視頻背景和目標外觀中的冗余信息,降低了數據對模型參數量的要求。然而,現有的大部分骨架行為識別方法[6]通常在時間和空間維度分別提取骨架序列的特征,忽略了骨架拓撲結構在時空維度的整體性。本文在時空圖卷積網絡(spatial temporal graph convolutional network,ST-GCN)[6]和Transformer[7]等相關工作的基礎上提出基于GSTEN的猴類動物骨架行為識別方法。該網絡主要包括ST-GCN和全局時空編碼器(global spatiotemporal encoder,GSTE)。其中,ST-GCN負責提取時空維度的局部特征來識別簡單動作;GSTE由少量的線性算子和自注意力計算模塊組成,對時空維度的全局特征進行建模分析進而識別一些困難動作。同時可作為即插即用的輕量級模塊來配合骨架行為識別模型ST-GCN使用,提高模型在時空維度整體性建模分析的能力。實驗結果證明,GSTEN在基本不增加模型參數量的情況下,可以顯著提高基準模型ST-GCN的行為識別準確率,并且優于其他的基于視頻幀和基于骨架序列的行為識別方法。

1 相關工作

1.1 人類行為識別

人類行為識別任務通常是識別一段視頻中包含的行為類別。由于視頻中包含豐富的信息,不同方法利用不同角度的信息對視頻中的行為進行建模分析,如外觀、光流以及骨架等。SIMONYAN和ZISSERMAN[8]提出經典雙流網絡,以模仿人類大腦皮層理解視頻信息的機制,在處理視頻幀圖像空間信息的基礎上,對視頻時序信息也做了建模理解。單獨的視頻幀可作為表述空間信息的載體,包括背景和目標外觀等空間信息,被稱為空間卷積網絡;另光流圖作為時序信息的載體輸入到另一個卷積神經網絡(convolutional neural networks,CNN)中,用來理解行為的動態特征,稱為時間卷積網絡。針對行為識別任務中的長范圍依賴問題,WANG等[9]在經典雙流網絡的基礎上提出了稀疏時間采樣和視頻級監督策略,即從整個視頻段中稀疏采樣一系列片段來促使模型學習行為的全局特征。HARA等[10]在2D CNN ResNet[11]的基礎上拓展了一個時間維度得到3D卷積網絡。ResNet3D在提取時間維度特征的同時還使用了2D網絡中的一系列技巧,如使用殘差結構來緩解梯度消失問題。TRAN等[12]在ResNet3D的基礎上進一步將3D卷積核分解為2個獨立且連續的操作:2D空間卷積和1D時間卷積。卷積分解不僅減少了模型運算參數,同時提高了模型的擬合能力。FEICHTENHOFER等[13]探索了視頻的高低幀率對行為識別的影響,設計了低幀率的慢支路來捕獲空間維度的語義信息以及高幀率的快支路捕獲時間維度的運動信息。

上述方法輸入的模型是視頻幀或視頻幀中的光流圖。由于受背景擾動、光照變化以及目標外觀差異的影響,完整輸入的視頻幀或光流圖中存在一些信息冗余。近些年一些學者開始使用視頻中目標的骨架序列信息來識別目標的行為,其識別方法大致分為4類:基于循環神經網絡(recurrent neural network,RNN)、基于CNN、基于圖卷積網絡(graph convolutional network,GCN)以及基于Transformer的方法。ZHU等[14]將每個關鍵點形成的時間序列輸入到RNN中,同時使用稀疏連接的全連接層來融合不同RNN輸出的特征,最后使用函數對提取的特征進行分類。LI等[15]使用雙流卷積神經網絡提取骨架偽圖像在時間和空間上的局部特征,最后融合時空維度的特征來識別行為。文獻[6]提出了ST-GCN,首次將GCN用于骨架行為識別。ST-GCN模型對幀內骨架拓撲結構進行空間卷積,對幀間關鍵點序列進行時間卷積來提取時空維度的局部特征。SHI等[16]在ST-GCN的基礎上提出了一種雙流自適應圖卷積網絡(two-stream adaptive graph convolutional networks,2s-AGCN),其中自適應指圖的拓撲結構可以由梯度反傳算法進行端到端的學習。這種數據驅動的方法增加了圖構造的靈活性,使模型可以適應各種數據版本。PLIZZARI等[17]提出時空Transformer (spatial temporal transformer,ST-TR),該方法將骨架的拓撲結構和關鍵點形成的時間序列分別輸入Transformer模型以提取時空維度的全局特征。ZHANG等[18]提出STST模型,在空間維度和時間維度上分別使用特定的Transformer模型來捕捉整個骨架的動態變化,同時提出自監督學習模塊提高模型對于殘缺的骨架結構和擾亂的視頻幀序列等情況的魯棒性。

1.2 動物行為識別

動物行為識別任務是識別一段視頻中目標動物的行為類別,其方法可分為單階段和兩階段方法。單階段方法直接使用3D (或2D)卷積核來提取視頻中目標動物行為的局部特征,再使用全連接層輸出對應的行為類別,缺點是很多與行為無關的冗余信息也會輸入到模型當中,增加了模型參數量和運算量,且易導致模型的誤識別。文獻[4]構建了家豬的行為識別數據集PBVD-5,其包含5類行為:喂食、躺臥、運動、抓及攀爬。同時,基于SlowFast[13]的時空卷積網絡對家豬行為進行建模分析。兩階段方法首先從視頻的每一幀提取目標的關鍵點并得到骨架序列,再對目標的骨架信息進行分析得到行為類別,缺點是需耗費大量的時間。文獻[5]提出恒河猴3D姿態估計數據集,需先對3D姿態信息進行降維,再對降維后的特征進行聚類分析得到恒河猴的6類行為:站立、行走、攀爬、顛倒攀爬、坐下和跳躍。

2 方 法

2.1 問題分析

臨床前藥物安全評價場景下,猴類動物行為識別任務有如下特點:

(1) 猴類動物行為識別數據集中的連續視頻幀包含冗余信息。在臨床前藥物安全評價中,猴類動物通常在室內的鐵籠中,導致行為識別數據集中的場景較單一,視頻背景擾動和光照變化小。此外,相同品種不同猴類動物個體的外觀非常相似,如恒河猴的毛發普遍呈棕黃色,食蟹猴的毛發一般為灰白色。如圖1所示,視頻數據中背景擾動、光照變化以及目標外觀差異較小,導致連續的視頻幀中包含冗余信息。特別地,一些運動量較小的行為(如蹲坐、扶立)對應的連續視頻幀序列冗余信息較明顯。

(2) 猴類動物行為識別需要考慮時空維度的全局信息。在臨床前藥物安全評價場景下,一些猴類動作定義需要考慮全局的空間和時間信息。特別地,在時間維度上,攀爬行為初始動作類似于蹲坐或扶立,訓練時提取前幾幀的特征可能會導致模型誤識別,如圖1(c)中向下攀爬行為的前四幀和圖1(a)中蹲坐行為類似。空間維度上,如蹲坐行為的腳踝和臀部對應的關鍵點聯系緊密,然而在ST-GCN中無法建模骨架上非直接連接的關鍵點之間的聯系。此外,一些動作需要考慮骨架上不同關鍵點在不同時刻的聯系,如四肢觸地行走(行走動作可以視為四肢關鍵點的周期性運動)和僅下肢觸地扶立的局部特征相似,但在空間行走時四肢距離更近,且行走動作具有時序信息。現有的一些基于Transformer的骨架行為識別方法[17-18]針對時空維度分別提取全局特征,無法建模骨架不同關鍵點在不同時刻的聯系。

與視頻幀序列不同的是,骨架時序信息只關注目標的肢體動作,丟棄了背景以及外觀中的冗余信息,降低了行為識別任務對模型參數量的要求。因此,本文使用猴類動物的骨架序列信息進行行為識別,并針對行為的時空整體性問題,進一步提出GSTEN對猴類動物的行為進行整體性建模分析。

圖1 猴類動物行為識別數據集中的不同行為樣本((a)蹲坐;(b)扶立;(c)向下攀爬;(d)懸掛)

2.2 骨架序列信息提取

經逐幀的骨架信息提取,可得到每一個視頻樣本的骨架序列表示。假設視頻的幀數為,關鍵點個數為,則每一個視頻樣本的骨架序列信息可表示為一個維度為××的張量,其中=3表示每一個關鍵點的特征維數。考慮到猴類動物的動作普遍較快,需統一設置=150,不足幀的樣本視頻通過從頭回放的方式進行填充,超過幀的樣本視頻直接截取前幀作為輸入。

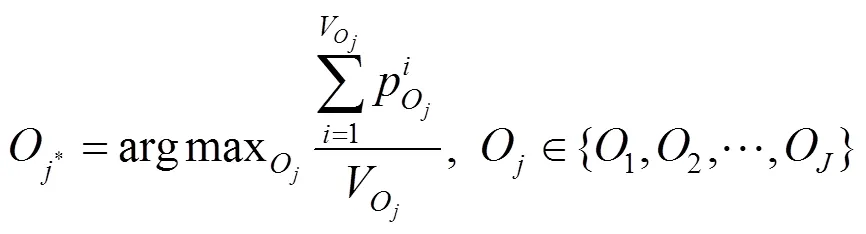

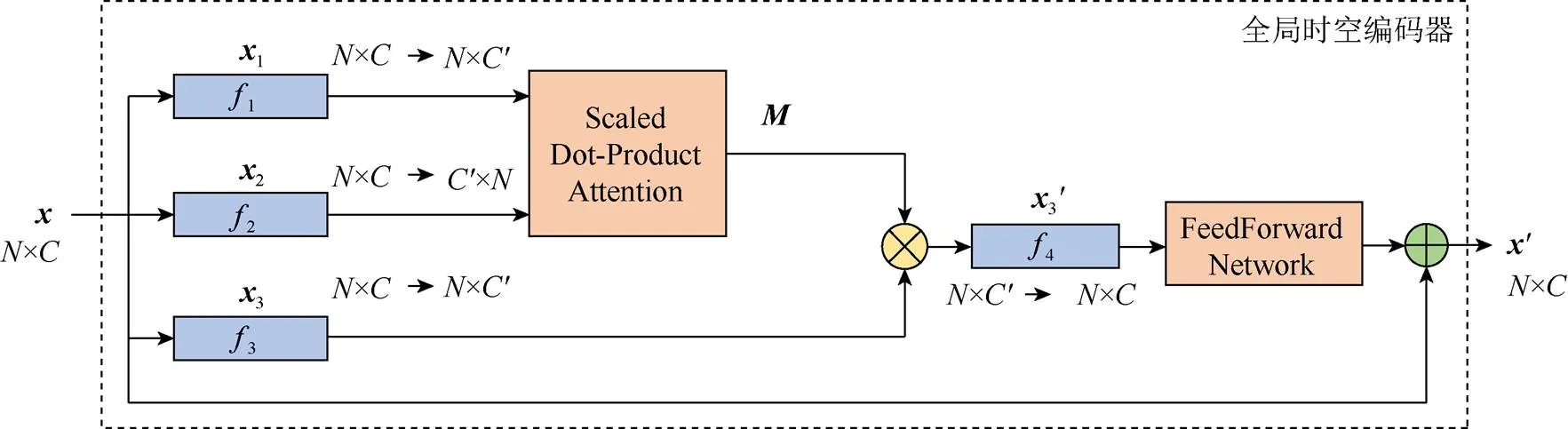

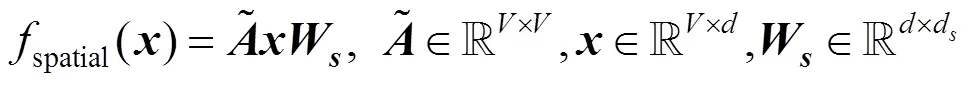

2.3 全局時空編碼器

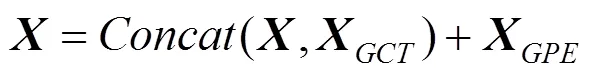

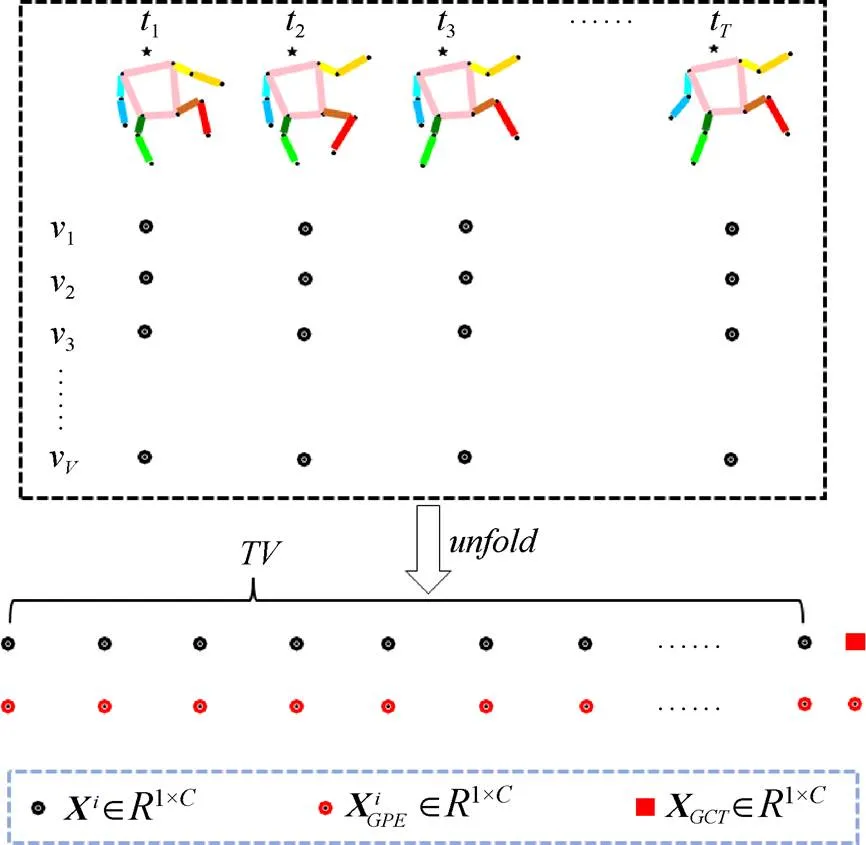

本文利用GSTE來提取猴類動物骨架序列信息的全局特征。與原始的Transformer[7]不同的是,GSTE首先舍棄了Transformer中的解碼器,只使用串聯的編碼器來提取全局時空特征。其次,在每個單獨的編碼器中使用一個線性變換來連接自注意力(self-Attention,SA)模塊和前饋神經網絡(FeedForward network,FFN),該線性變換將SA特征變換為原始輸入特征的維數,變換后的特征在后續的FFN中完成“編碼-解碼”過程。因此,本文提出的GSTE在單個編碼器內部完成“編碼器編碼特征-解碼器解碼推理”的過程。此外,還設計了一個全局標志生成器(global token generator,GTG)來處理骨架序列。與現有的一些基于Transformer的骨架行為識別方法(如ST-TR[17]和STST[18]模型)分別從空間和時間維度提取全局特征不同的是,GTG將骨架序列信息視為一個整體。GTG不僅考慮了同一時刻的不同關鍵點以及同一關鍵點在不同時刻之間的聯系,還對骨架空間拓撲結構處于不同時刻的不同關鍵點之間的聯系做了建模分析。總之,GSTE在單個編碼器中完成了“編碼-解碼”過程,同時使用GTG進一步增強編碼器對骨架序列整體性建模分析的能力。

圖2 全局時空編碼器

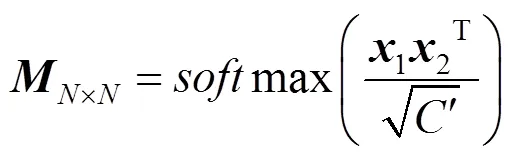

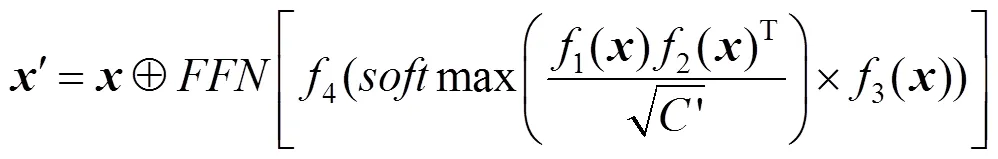

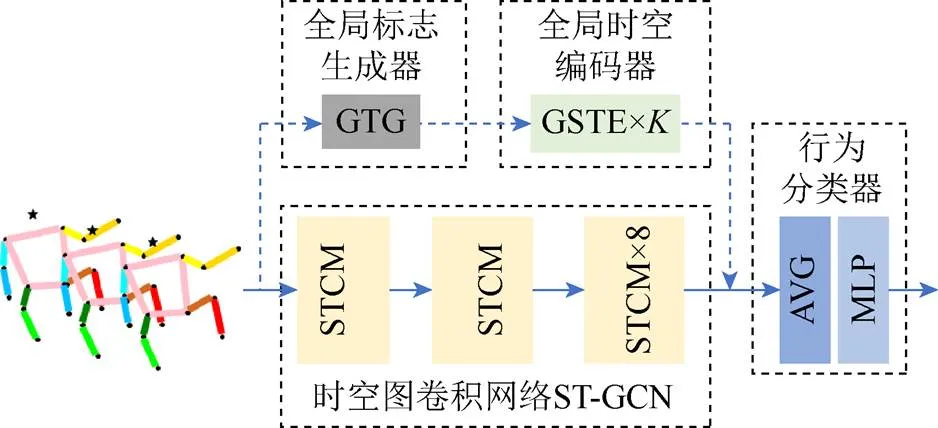

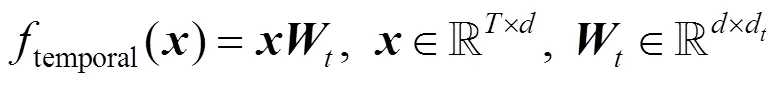

2.4 全局時空編碼網絡

本文在人體骨架行為識別模型ST-GCN[6]的基礎上提出GSTEN。如圖3所示,GSTEN由4部分組成,主網絡為ST-GCN模型,其負責提取骨架序列信息時空維度的局部特征來識別簡單動作;在ST-GCN模型上并行插入全局標志生成器和個串聯的輕量級模塊GSTE,GSTE針對骨架序列信息時空維度的全局特征進行建模分析,進而識別一些困難動作;最后融合提取到的全局特征和局部特征,將其輸入到行為分類器中進行分類。

圖3 全局時空編碼網絡

其中,為序列拼接。

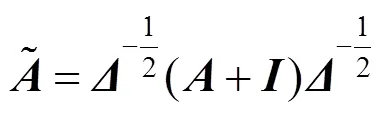

猴類動物骨架序列信息通過ST-GCN支路可以提取時空維度的局部特征,通過GSTE支路提取全局特征,最后對兩類特征加權融合進行行為識別。這種并行連接GSTE的網絡結構在幾乎不增加模型參數量的情況下,可以顯著提高行為識別準確率。具體地,ST-GCN模型由10個串聯連接的時空卷積模塊(spatial temporal convolution module,STCM)組成。每一個STCM包括空間卷積和時間卷積。空間卷積可為

圖4 全局標志生成器

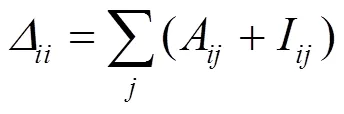

其中,為某一個關鍵點的時序信息;為時間卷積參數矩陣;d為時間卷積變換后的特征維數。在本文的猴類動物場景中,節點相關性矩陣為

2.5 損失函數

3 實 驗

3.1 數據集和評價指標

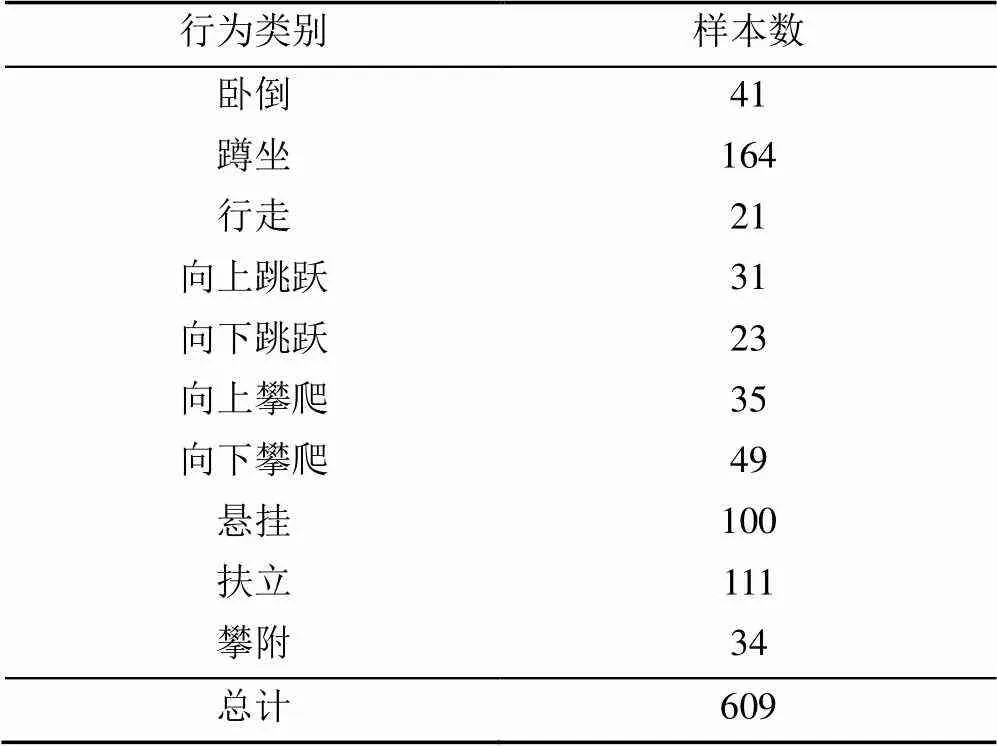

本文建立的猴類動物行為識別數據集見表1,包括臥倒、蹲坐、行走、向上跳躍、向下跳躍、向上攀爬、向下攀爬、懸掛、扶立以及攀附10類行為。將采集的猴類動物行為識別數據集按照3∶1的比例隨機劃分為訓練集和驗證集。評價指標采用準確率=N/×100%,其中為驗證集的總樣本數,N為驗證集中模型預測正確的樣本數。

表1 猴類動物行為識別數據集

3.2 參數設置

實驗在Geforce RTX2080Ti′8的單節點服務器上完成,使用Pytorch v1.8深度學習框架進行訓練。Epoch數設置為100,batch-size為16。初始學習率為0.1,隨后在40個epoch和80個epoch處衰減為原來的0.1倍。在全局時空編碼網絡GSTEN中如果沒有特別說明,則ST-GCN支路特征和GSTE支路特征的加權和系數為0.5,即merge=-GCN+×GSTE,其中-GCN和分別表示ST-GCN分支提取的局部時空特征和GSTE分支提取的全局時空特征。

3.3 對比實驗

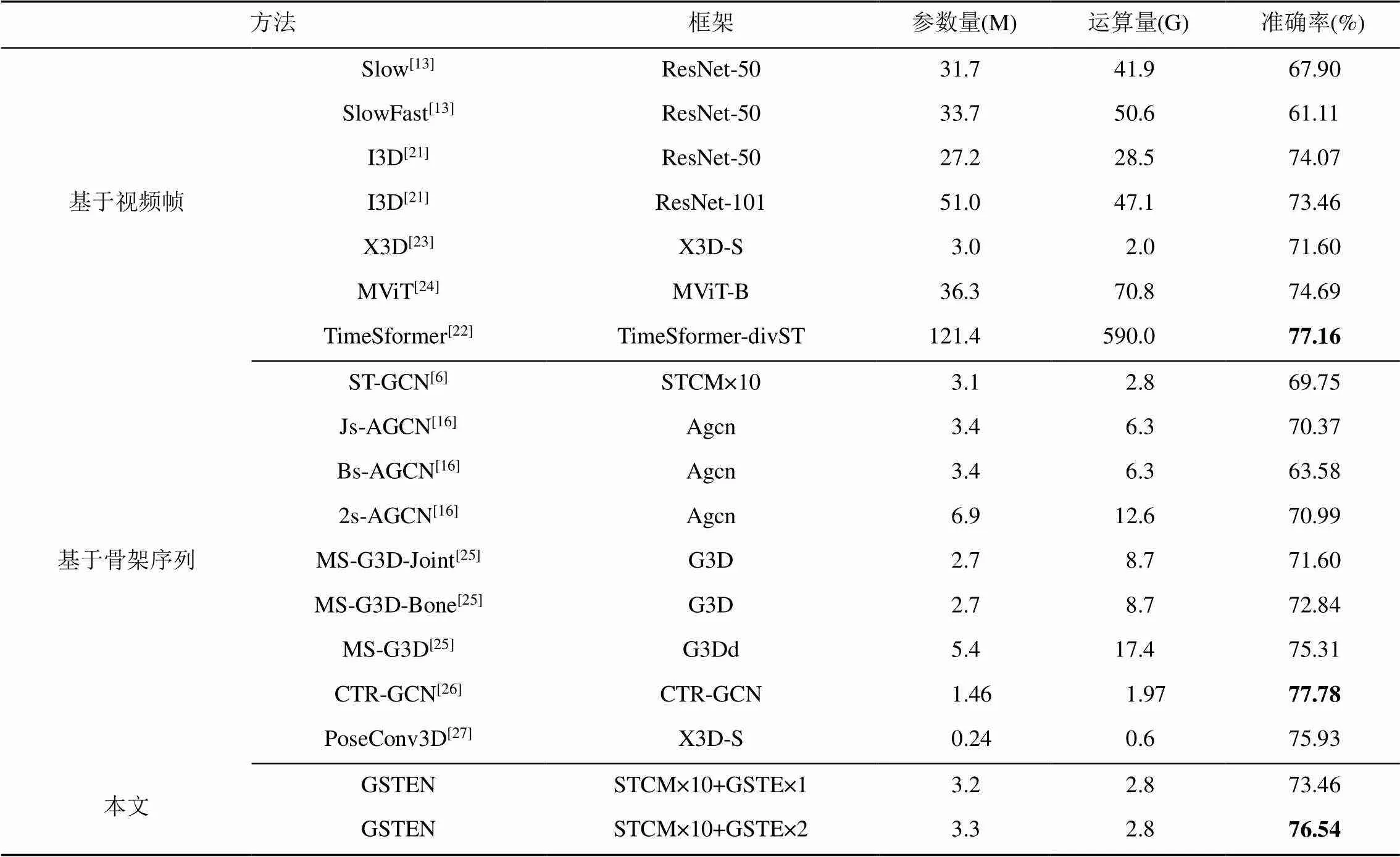

本文在猴類動物行為識別數據集上對比了基于視頻幀的行為識別方法、基于骨架序列的行為識別方法以及GSTEN (表2),一些基于視頻幀的方法如SlowFast[13]等在數據集上的性能指標明顯低于骨架行為識別模型ST-GCN。I3D[21]方法的性能優于ST-GCN,但模型的參數量和運算量更多。特別地,TimeSformer[22]模型的準確率達到最高的77.16%,但該模型的參數量和運算量遠多于其他基于視頻幀以及基于骨架序列的方法。本文提出的GSTEN在ST-GCN模型的基礎上并行添加GSTE。實驗結果表明,GSTEN在基本不增加模型參數量和運算量的同時可以顯著提高基準模型ST-GCN的準確率。此外,當GSTEN搭配2個GSTE時,不僅準確率比ST-GCN高6.79%,且優于大部分基于視頻幀和基于骨架序列的行為識別方法。總之,本文構建的GSTEN在猴類動物行為識別任務上具有準確率高、參數少以及運算量小等優勢。

表2 不同方法在猴類動物行為識別數據集上的實驗結果

注:加粗數據為最優值

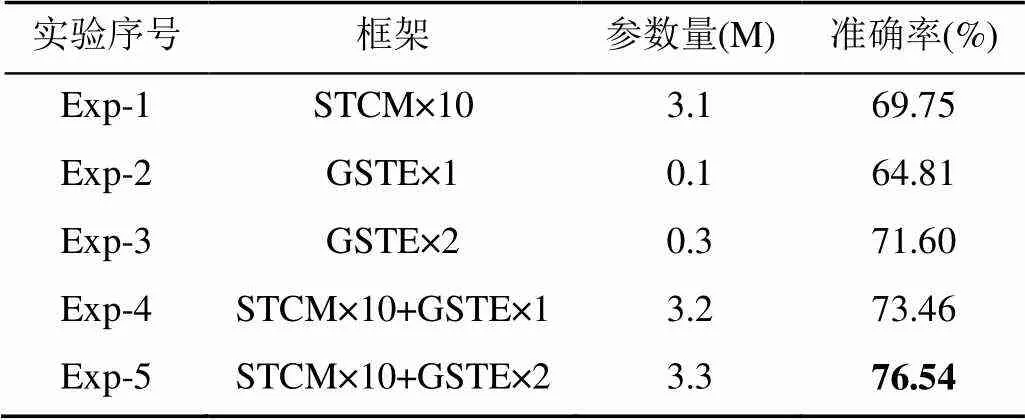

3.4 消融實驗

為了驗證局部特征和全局特征在猴類動物行為識別任務上的適用性,本文對GSTEN的各部分結構進行了消融實驗(表3),并分別對比了與只使用ST-GCN分支提取局部特征、只使用GSTE分支提取全局特征以及使用GSTEN模型融合局部特征和全局特征三者之間的性能差異。實驗結果表明,Exp-2中使用1個GSTE提取全局特征時,模型的準確率低于Exp-1中使用ST-GCN提取局部特征的結果。Exp-3中使用2個GSTE時,模型對猴類動物行為的建模分析能力超過了ST-GCN。當Exp-4和Exp-5中全局特征和局部特征融合時,GSTEN模型超過單一局部特征或全局特征的結果,且性能隨著GSTE數量增加而提升,這表明全局特征和局部特征融合的結果比單一特征更適合猴類動物的行為識別。

表3 GSTEN消融實驗

注:加粗數據為最優值

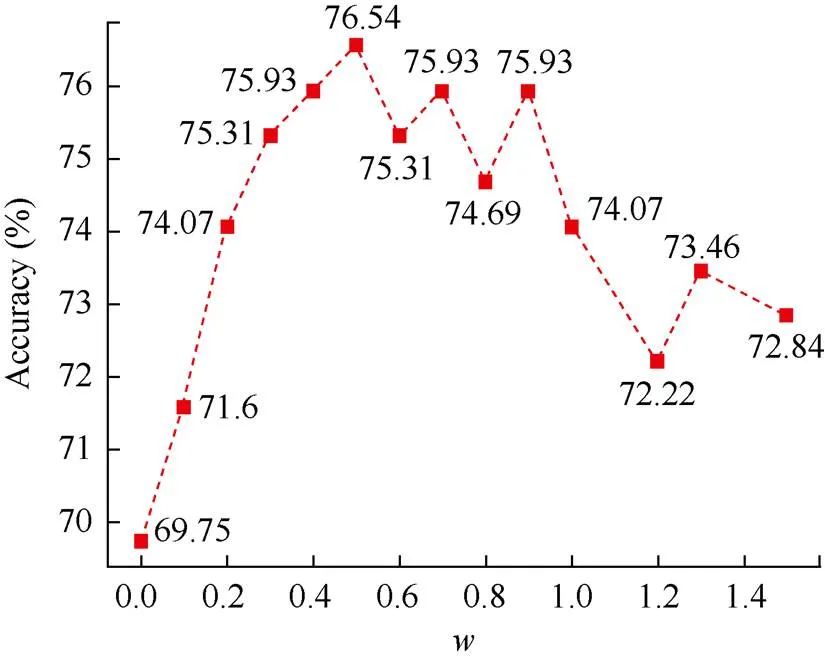

在表3的Exp-5基礎上進一步探索ST-GCN支路和GSTE支路的加權和系數對構建的GSTEN性能的影響。如圖5所示,當<0.5時,ST-GCN分支的特征占比較大,GSTEN模型的準確率隨著增大而提高;當=0.5時,GSTEN模型準確率達到最高的76.54%;當0.5<<1.0時,GSTEN模型準確率接近飽和;當>1.0時,GSTE分支的特征占據主導地位,此時GSTEN模型準確率稍有下降。以上結果說明GSTEN中ST-GCN分支重要性較GSTE高。原因可能是GSTE分支參數較少,在建模骨架序列所有關鍵點之間的聯系時出現欠擬合的情況。

圖5 基于不同系數w的GSTEN準確率

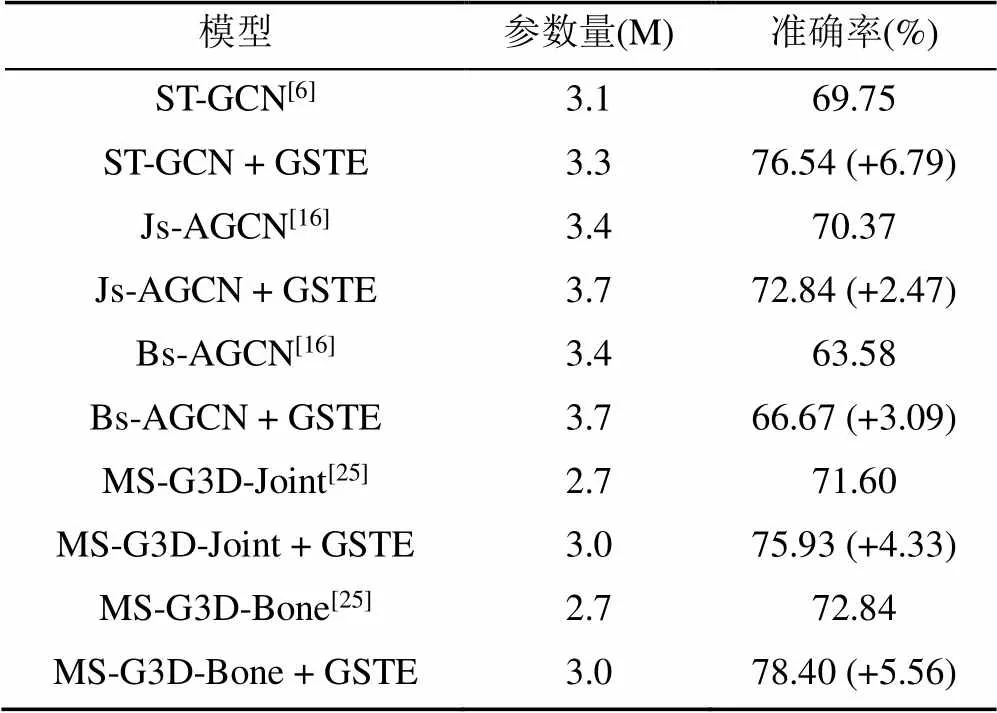

此外,為了驗證本文提出的GSTE具有即插即用的特性,在不同的骨架行為識別模型上并行插入全局標志生成器和2個GSTE (表4),由于ST-GCN模型缺乏時空維度整體性建模分析的能力,GSTE應用在ST-GCN上可以顯著提升模型的行為識別準確率。當GSTE應用在具有全局空間建模能力的AGCN上時,準確率相較于ST-GCN提升幅度略有下降,分別為2.47%和3.09%。特別地,當MS-G3D-Bone添加GSTE之后模型的準確率達到78.40%,超過本文提出的GSTEN和表2中準確率最高的CTR-GCN[26]方法。以上結果表明,GSTE可以作為即插即用的輕量級模塊配合不同的骨架行為識別模型使用,并且構建的新網絡在基本不增加模型參數量的情況下,顯著提高基準模型在猴類動物行為識別的準確率。

表4 GSTE對不同基準模型的影響

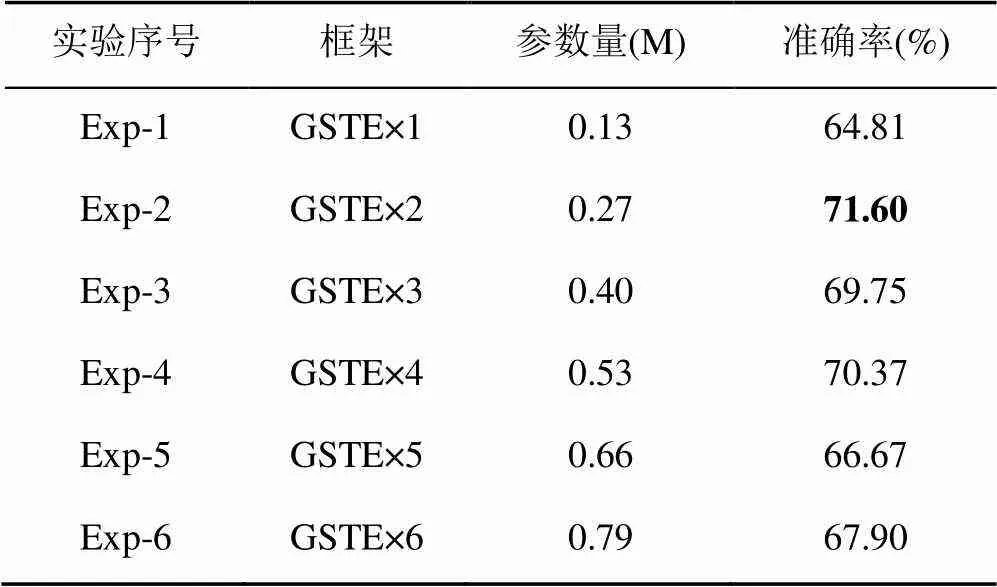

本文進一步對比了不同數量的GSTE對模型的影響。表5中Exp-1,Exp-5和Exp-6中GSTE的數量過少或過多,均會對模型性能產生影響。Exp-2中使用2個GSTE提取全局特征時,模型準確率指標達到最高的71.60%。

表5 GSTE消融實驗

注:加粗數據為最優值

4 結束語

本文從實際臨床前藥物安全評價場景出發,使用深度學習方法對猴類動物行為識別任務進行了研究,對人工智能方法在藥物安全評價中的應用進行了積極地探索。首先分析了臨床前藥物安全評價場景下,現有人類行為識別領域基于視頻幀和基于骨架序列的方法應用到猴類動物的缺陷。并基于這些缺陷,提出了一種基于GSTEN的猴類動物行為識別方法,即插即用的輕量級GSTE可以搭配骨架行為識別模型ST-GCN使用,在不增加模型參數量的同時提高模型在時空維度整體性建模分析的能力。最后在生成的猴類動物行為識別數據集上進行了實驗,對比了基于視頻幀的行為識別方法、基于骨架序列的行為識別方法以及本文提出的GSTEN方法,結果充分驗證了本文方法在臨床前藥物安全評價場景猴類動物行為識別任務上具有準確率高、參數少等優勢。

對于骨架行為識別方法而言,其前提條件是獲取帶有骨架序列標簽的訓練數據。借助于訓練好的姿態估計模型,可以大規模獲取行為視頻中每個猴類動物個體的骨架信息。然而,使用姿態估計模型提取骨架信息再進行行為識別的兩階段過程比較耗時,且對于不同的臨床前藥物安全評價場景,需要訓練魯棒性和泛化性更強的姿態估計模型。因此,未來工作的一個重點方向是探索更有效的骨架信息獲取方法,如使用一些穿戴式設備[28]直接獲取猴類動物的骨架信息。

[1] PLAGENHOEF M R, CALLAHAN P M, BECK W D, et al. Aged rhesus monkeys: cognitive performance categorizations and preclinical drug testing[J]. Neuropharmacology, 2021, 187: 108489.

[2] BANKS M L, HUTSELL B A, BLOUGH B E, et al. Preclinical assessment of lisdexamfetamine as an agonist medication candidate for cocaine addiction: effects in rhesus monkeys trained to discriminate cocaine or to self-administer cocaine in a cocaine versus food choice procedure[J]. International Journal of Neuropsychopharmacology, 2015, 18(8): pyv009.

[3] EBELING M, KüNG E, SEE A, et al. Genome-based analysis of the nonhuman primate Macaca fascicularis as a model for drug safety assessment[J]. Genome Research, 2011, 21(10): 1746-1756.

[4] LI D, ZHANG K F, LI Z B, et al. A spatiotemporal convolutional network for multi-behavior recognition of pigs[J]. Sensors: Basel, Switzerland, 2020, 20(8): 2381.

[5] BALA P C, EISENREICH B R, YOO S B M, et al. Automated markerless pose estimation in freely moving macaques with OpenMonkeyStudio[J]. Nature Communications, 2020, 11: 4560.

[6] YAN S J, XIONG Y J, LIN D H. Spatial temporal graph convolutional networks for skeleton-based action recognition[EB/OL]. [2021-06-10]. https://arxiv.org/pdf/1801. 07455.pdf.

[7] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all You need[C]//The 31st International Conference on Neural Information Processing Systems. New York: ACM Press, 2017: 6000-6010.

[8] SIMONYAN K, ZISSERMAN A. Two-stream convolutional networks for action recognition in videos[C]// The 27th International Conference on Neural Information Processing Systems - Volume 1. New York: ACM Press, 2014: 568-576.

[9] WANG L M, XIONG Y J, WANG Z, et al. Temporal segment networks: towards good practices for deep action recognition[M]//Computer Vision - ECCV 2016. Cham: Springer International Publishing, 2016: 20-36.

[10] HARA K, KATAOKA H, SATOH Y. Learning spatio-temporal features with 3D residual networks for action recognition[C]// 2017 IEEE International Conference on Computer Vision Workshops. New York: IEEE Press, 2017: 3154-3160.

[11] HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2016: 770-778.

[12] TRAN D, WANG H, TORRESANI L, et al. A closer look at spatiotemporal convolutions for action recognition[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2018: 6450-6459.

[13] FEICHTENHOFER C, FAN H Q, MALIK J, et al. SlowFast networks for video recognition[C]//2019 IEEE/CVF International Conference on Computer Vision. New York: IEEE Press, 2019: 6201-6210.

[14] ZHU W T, LAN C L, XING J L, et al. Co-occurrence feature learning for skeleton based action recognition using regularized deep LSTM networks[C]//The 13th AAAI Conference on Artificial Intelligence. New York: ACM Press, 2016: 3697-3703.

[15] LI C, ZHONG Q Y, XIE D, et al. Skeleton-based action recognition with convolutional neural networks[C]//2017 IEEE International Conference on Multimedia & Expo Workshops. New York: IEEE Press, 2017: 597-600.

[16] SHI L, ZHANG Y F, CHENG J, et al. Two-stream adaptive graph convolutional networks for skeleton-based action recognition[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2019: 12018-12027.

[17] PLIZZARI C, CANNICI M, MATTEUCCI M. Spatial temporal transformer network for skeleton-based action recognition[M]//Pattern Recognition. ICPR International Workshops and Challenges. Cham: Springer International Publishing, 2021: 694-701.

[18] ZHANG Y H, WU B, LI W, et al. STST: spatial-temporal specialized transformer for skeleton-based action recognition[C]//MM '21: The 29th ACM International Conference on Multimedia. New York: ACM Press, 2021: 3229-3237.

[19] XIAO B, WU H P, WEI Y C. Simple baselines for human pose estimation and tracking[M]//Computer Vision - ECCV 2018. Cham: Springer International Publishing, 2018: 472-487.

[20] LIN T Y, MAIRE M, BELONGIE S, et al. Microsoft COCO: common objects in context[M]//Computer Vision - ECCV 2014. Cham: Springer International Publishing, 2014: 740-755.

[21] CARREIRA J, ZISSERMAN A. Quo vadis, action recognition? A new model and the kinetics dataset[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2017: 4724-4733.

[22] BERTASIUS G, WANG H, TORRESANI L. Is space-time attention all You need for video understanding? [EB/OL]. [2021-06-09]. https://arxiv.org/abs/2102.05095.

[23] FEICHTENHOFER C. X3D: expanding architectures for efficient video recognition[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press: 200-210.

[24] FAN H Q, XIONG B, MANGALAM K, et al. Multiscale vision transformers[C]//2021 IEEE/CVF International Conference on Computer Vision. New York: IEEE Press, 2021: 6804-6815.

[25] LIU Z Y, ZHANG H W, CHEN Z H, et al. Disentangling and unifying graph convolutions for skeleton-based action recognition[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2020: 140-149.

[26] CHEN Y X, ZHANG Z Q, YUAN C F, et al. Channel-wise topology refinement graph convolution for skeleton-based action recognition[C]//2021 IEEE/CVF International Conference on Computer Vision. New York: IEEE Press, 2021: 13339-13348.

[27] LIU Z Y, ZHANG H W, CHEN Z H, et al. Revisiting skeleton-based action recognition[C]//The IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2022: 2969-2978.

[28] 鄧穎, 吳華瑞, 孫想. 基于機器視覺和穿戴式設備感知的村鎮老年人跌倒監測方法[J]. 西南大學學報: 自然科學版, 2021, 43(11): 186-194.

DENG Y, WU H R, SUN X. Design of a real-time human falling monitoring method for elderly people in villages and towns based on multi-dimensional data analysis[J]. Journal of Southwest University: Natural Science Edition, 2021, 43(11): 186-194 (in Chinese).

Monkey action recognition based on global spatiotemporal encode network

SUN Zheng1,2, ZHANG Su-cai3, MA Xi-bo1,2

(1. CBSR&NLPR, Institute of Automation, Chinese Academy of Sciences, Beijing 100190, China;2. School of Artificial Intelligence, University of Chinese Academy of Sciences, Beijing 100049, China;3. JOINN Laboratories (Beijing) Co., Ltd., Beijing 100176, China)

Accurate quantification of caged monkeys’ behaviors is a primary goal for the preclinical drug safety assessment. Skeleton information is important to the analysis on the behaviors of monkeys. However, most of the current skeleton-based action recognition methods usually extract the features of the skeleton sequence in the spatial and temporal dimensions, ignoring the integrity of the skeleton topology. To address this problem, we proposed a skeleton action recognition method based on the global spatiotemporal encode network (GSTEN). Based on the spatial temporal graph convolutional network (ST-GCN), the proposed method inserted global token generator (GTG) and several global spatiotemporal encoders (GSTE) in parallel to extract the global features in the spatiotemporal dimension. To verify the performance of the proposed method, we conducted experiments on a self-built monkey action recognition dataset. The experimental results show that the proposed GSTEN could achieve an accuracy of 76.54% without increasing the number of model parameters, which was 6.79% higher than the baseline model ST-CGN.

action recognition; skeleton sequence; global spatiotemporal encode network; monkey; drug safety assessment

TP 391

10.11996/JG.j.2095-302X.2022050832

A

2095-302X(2022)05-0832-09

2022-04-15;

2022-06-03

15 April,2022;

3 June,2022

國家自然科學基金項目(82090051,81871442);中國科學院青年創新促進會(Y201930)

The Chinese National Natural Science Foundation Projects (82090051, 81871442);The Youth Innovation Promotion Association CAS (Y201930)

孫 崢(1996-),男,碩士研究生。主要研究方向為姿態估計和行為識別等。E-mail:zheng.sun@nlpr.ia.ac.cn

SUN Zheng (1996-), master student. His main research interests cover pose estimation and action recognition, etc. E-mail:zheng.sun@nlpr.ia.ac.cn

馬喜波(1981-),女,研究員,博士。主要研究方向為多模態融合的醫學成像方法及設備開發等。E-mail:xibo.ma@nlpr.ia.ac.cn

MA Xi-bo (1981?), researcher, Ph.D. Her main research interests cover development of multi-modal fusion medical imaging methods and equipment, etc. E-mail:xibo.ma@nlpr.ia.ac.cn