無人駕駛方程式賽車環境感知技術

王立琦,張汝波

(大連民族大學 機電工程學院,遼寧 大連 116650)

近年來,依附于各類學科的深入研究,汽車產業的智能化轉型,無人駕駛技術受到了各國學者的廣泛關注。2017年,德國大學生無人方程式賽車比賽(FSD)成功舉辦,使得各大高校組建自己的車隊參與投入到無人方程式賽車的研究中來,在全世界范圍內開創了大學生無人駕駛方程式賽車競賽的先河;同年,SAE China成功舉辦中國首屆無人駕駛方程式汽車大賽(FSAC),是中國高校無人方程式汽車競賽的開端。兩大賽事均已無人駕駛技術為主題,旨在由高校學生自行開發制作一輛無人駕駛方程式汽車,為無人駕駛領域培養技術人才,推動無人駕駛技術的發展。

無人駕駛技術可繼續分為環境感知、路徑規劃及跟蹤控制三個技術模塊。其中,環境感知模塊基于車輛部署的傳感器來獲取外界環境信息,返回前進區域內物體的位置、顏色等信息。而在無人方程式汽車大賽背景下,由于場景空曠、障礙物目標較小及比賽要求,對環境感知的準確度與實時性提出了新的要求。

因此,以FSAC賽事為背景,通過對不同感知方案的特點進行分析,重點分析視覺、雷達及傳感器結合三種感知方案的算法內容,總結現階段存在的感知方法,并結合賽事要求提出現階段存在或可能存在的問題和挑戰,最后對無人駕駛方程式賽車環境感知技術未來的發展方向進行展望。

1 FSAC賽事要求及環境特點

FSAC的設計背景是假定參賽車隊在為一家設計公司設計、制造、測試并展示一輛目標市場為未來智能賽車或無人駕駛賽車的原型車或設計理念,并要求賽車具備優秀的加速、制動以及操縱性能,并兼顧安全性和穩定性,從而根據規則評優的賽事。其賽事要求大致如下[1]:

(1)自主駕駛。參賽車輛需要實現自主駕駛,即無需人工干預即可完成任務和挑戰。

(2)傳感器技術。無人駕駛方程式汽車大賽強調參賽車輛的傳感器技術,包括激光雷達、攝像頭等,以提高車輛的感知和識別能力。

(3)高精度地圖。參賽車輛需要具備高精度地圖匹配能力,以實現精準的定位和導航。

(4)多種任務。無人駕駛方程式汽車大賽設置了多種任務和挑戰,如自動駕駛、避障、停車等,參賽車輛需要完成各種任務和挑戰。

(5)創新思維。無人駕駛方程式汽車大賽鼓勵參賽車輛團隊發揮創新思維,采用新的算法和技術,提高自己的競爭力。

由于FSAC賽事在能夠發揮參賽車隊最大的設計靈活性和自由性,充分表達參賽車隊和選手們的創造力和想象力,因此對賽車本身的整體設計給予了很大的自主空間。同時,FSAC賽事主要在封閉場地內進行,在賽事事先規定賽道進行比賽,通過視覺感知三種顏色的錐桶標識實現無人賽車的規劃與決策,進而完成比賽。因此,針對無人駕駛賽車的眼睛——環境感知技術而言,目前各參賽車隊主要討論的問題包括如何選擇傳感器的搭配方案和如何設計基于不同傳感器的感知算法,從而更精準、快速的感知和識別出賽道中的三色錐桶,進而完成比賽。

2 無人駕駛方程式賽車環境感知技術

環境感知系統是實現無人駕駛方程式賽車關鍵環節,該系統一般由激光雷達、相機等傳感器共同構成。環境感知不僅需要識別到各種工況下的不同障礙物,還需要進行高精度定位及獲取物體的語義信息。近年來,無人駕駛車輛對環境感知系統的要求不斷提高,這也使得雷達、相機等傳感器技術得到迅速發展。目前環境感知方案主要以相機和激光雷達傳感器為主,其它傳感器輔助進行檢測,但基于傳感器本身的限制,兩種方案在一些方面上互有優劣。因此,使各傳感器共同作用將是下一步發展的趨勢。本章將針對上述三種方案現狀進行概述分析。

2.1 基于視覺的環境感知技術

以相機傳感器為主進行目標檢測的方法又稱為基于視覺的目標檢測,即通過相機采集圖像從而獲取外界信息,憑借其豐富的語義信息、較高的分辨率等優點優于激光雷達傳感器,是無人車輛及各高校車隊的選擇之一。就FSAC賽事而言,相機傳感器的檢測目標為三色錐桶,因此以下問題需要重點關注:(1)錐桶顏色作為決策標識,需要精準識別語義信息,避免其他干擾;(2)識別的精度問題,三色錐桶個體目標較小,并且可能存在重疊、不完整的情況;(3)檢測效率問題,由于賽車在行駛過程中需要對錐桶進行實時檢測,所以需要確保檢測的實時性問題。

針對上述問題,整理概括國內外專家學者提出的目標檢測算法,針對方程式賽車實用背景,分析傳統目標檢測算法的弊端,并重點分析基于深度學習的目標檢測算法的針對上述問題的適應性。

2.1.1 傳統目標檢測算法

傳統目標檢測方法以人工提取特征信息,針對特征提取與分類方法進行研究。常用的檢測與分類方法包括方向梯度直方圖(HOG)、尺度不變特征轉換(SIFT),K最鄰近法(KNN)、支持向量機(SVM)等。但由于傳統目標檢測實時響應性不高,檢測速度慢,并且傳統特征檢測主要是通過人為設計,因此泛化能力不佳,在檢測特定的目標上需要特殊設計。因此,方程式賽車多采用基于深度學習的卷積神經網絡進行解決。對比傳統的檢測方法,卷積神經網絡的最大優點是提取特征能力優秀,不需要人工設計特征,能夠根據不同數據的特點自適應獲取特征,讓模型學習數據的本質,具有非常強的普適性。另外,基于深度學習的目標檢測算法模型簡單,計算量較小,在實時性上有顯著的優勢。

2.1.2 基于深度學習的目標檢測算法

基于深度學習的目標檢測算法按照模式通常分為兩大類:一類是基于區域的目標檢測算法,又稱為two-stage算法,其將目標檢測的問題劃分為兩個階段,先是通過算法產生候選區域提取特征,然后根據候選區域內的特征進行目標對象的分類和定位。該類算法在無人駕駛方程式賽車目標檢測的應用上,主要需要克服檢測速度帶來的影響。具有代表性的算法包括R-CNN[2]、Fast R-CNN[3]和Faster R-CNN[4]等;另一類是基于回歸的目標檢測算法,又稱為one stage算法,采用回歸的思想實現端到端解決目標檢測的問題,大幅提高了檢測速度。該類算法在無人駕駛方程式賽車目標檢測的應用上,主要需要克服面對小目標物體帶來的檢測精確度以及適用性問題。該類算法典型的代表為SSD[5]和YOLO[6-9]。

2014年,Girshick R等人提出R-CNN算法,第一次實現了深度學習在目標檢測領域的應用。R-CNN將候選區域算法和卷積神經網絡相結合,使得檢測速度和精度得到了大幅提升。但在對原始圖片進行候選區域選擇時,需要不斷對可能包含重復部分進行計算,導致計算量過大,直接影響了計算效率。隨后在2015年和2017年,Girshick R再次提出Fast R-CNN算法和Faster R-CNN算法,分別在上述的基礎上進行改進,提高了檢測性能。但作為two-stage算法 ,其在面對較小物體時的檢測性能仍有待提升,且檢測速率相對較慢。針對檢測物體較小的問題,王忠塬等人[10]提出了一種基于Faster R-CNN的改進方法,設計了基于多卷積核的深度可分離分組卷積Res Net,并使用分組卷積的方式壓縮參數量與計算量, 在保證速度的前提下有效的提高了小目標檢測準確率。

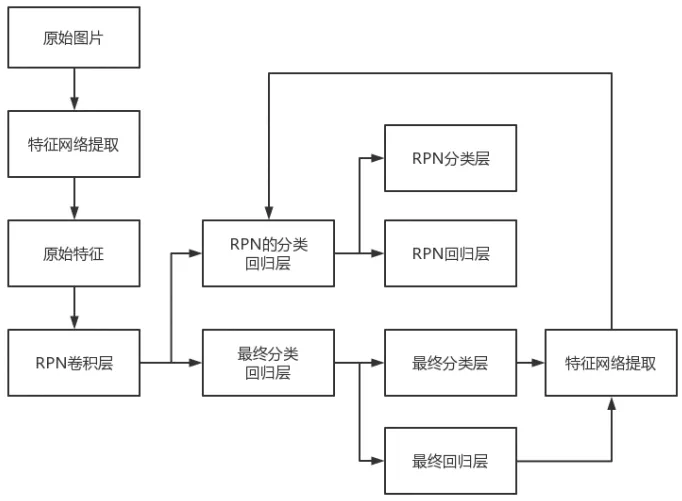

針對檢測速度問題,曹之君等人[11]提出了一種快速目標檢測算法,該算法在Faster R-CNN基礎上改進網絡模型,在RPN網絡中引入了反饋機制,并調整訓練過程中選擇候選區域的數量,減少開銷,提高了檢測速度,在實時性上有了進一步改善,改進后的算法框架如圖1。

圖1 改進Faster-RCNN算法框架[11]

One-stage算法由于其端對端的思想,在實時性上占據著天然的優勢,其主要代表方法包括SSD算法和YOLO算法。2015年Joseph Redmon首次提出YOLO算法,這是YOLO系列算法的開山之作,奠定了之后系列的基礎,其中YOLO歷代算法改進見表1。

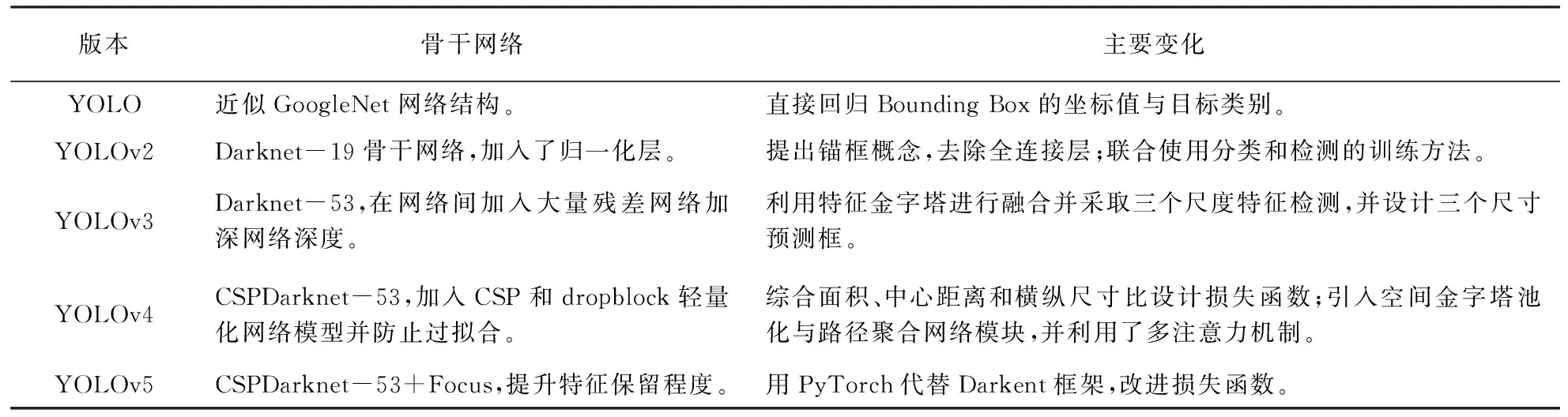

表1 YOLO系列算法的主要變化

在方程式賽車目標檢測中,由于Darknet框架的簡易靈活等特點,經常通過使用YOLO輕量化模型,對錐桶目標進行檢測,一定程度上對性能有所優化。針對小目標檢測精度的問題,Li等[12]改進YOLOv3算法,參照ShuffleNet和通道注意力機制的思想構造BackBone,并借鑒殘差網絡思想實現多尺度目標圖像的預測功能。該方法有效利用和融合目標圖像的多特征信息,但改進后的模型較為復雜,使得檢測速度降低。而Wang等[13]在YOLOv5的基礎上引入 DenseNet,增加 Bottleneck 結構數量,壓縮了模型的參數量,大大提高檢測速度。另外,Ju等人[14]將YOLOv4原始的連續卷積運算被替換為殘差連接,從而生成多個不同尺度的特征圖,使得能夠同時提取待檢測目標圖像的類別和位置信息,對于密集分布和混合分布的目標檢測場景,可以獲得較好的檢測效果。趙梓杉等人[15]針對錐桶檢測設計了YOLOv5錐桶檢測模型,直接以FSAC賽事為背景進行實驗,通過設計數據集進行訓練,調整網絡參數,并與YOLOv3進行對比實驗,大幅度提升了錐桶檢測的速度與準確率。

為了更直觀的觀察各算法優勢,對上述算法在經典測試集進行測試,各算法檢測速度和精度對比見表2[4,9,11,15-17]。

表2 各算法在測試集上的對比

經以上分析介紹,基于視覺的目標檢測應用于無人駕駛方程式賽車主要以深度學習的方法為主。其中,one-stage方法具備高響應、高實時性的優勢,但在小目標檢測方向上存在準確率較低或檢測不完全的缺點,可以針對選擇數據集進行訓練,并在激光雷達的配合下完成檢測任務。two-stage方法具備高準確率的優勢,但同樣沒有針對小目標物體進行訓練的模型,并且相應計算量過大,實時性較低,一定程度上無法滿足方程式賽車的實時性要求。下一步可以繼續在檢測速率上進行研究,并訓練針對性模型,從而完成方程式賽車的感知任務。

2.2 基于激光雷達的環境感知技術

激光雷達是一種非接觸式光學測量儀器,其通過自身旋轉發射激光,當激光觸及目標被反射后,激光雷達接收到物體反射的激光,從而檢測目標。激光雷達擁有高精度的測距能力及高響應特性,并且不受光照影響。較視覺傳感器相比,激光雷達表達環境中障礙物信息更加精準優秀,在無人駕駛方程式賽車環境感知系統中占據很大的比重。無人駕駛方程式賽車中基于激光雷達環境感知任務可以細化為對點云數據進行處理,從而進行物體檢測的任務。

2.2.1 點云分割算法

物體檢測主要用以描述范圍內物體的輪廓及位置。在方程式賽車中,障礙物即錐桶都是垂直于地面的,且錐桶高度受限,所以雷達安裝高度相對較低,地面點云數據將是提取錐桶數據的最大干擾。而點云分割通過將具備同一種屬性的點云聚類,從而將目標點云與冗余的點云數據區分開來,達到獲取目標點云的目的。但在進行地面點云數據分割過程中,以下問題需要重點關注:地面并不都是平坦的,可能存在部分崎嶇不平路段;處理的效率問題,能否滿足方程式賽車的實時響應性;分割準確度與完全度問題,由于錐桶目標較小,可能會影響到分割的準確度,或影響道路平面擬合的完整性。

為解決上述問題,總結歸納國內外學者提出的地面點云分割算法,可分為基于地面估計的方法、基于柵格圖的方法、基于平面擬合的方法與基于學習的分割方法。

(1)地平面估計算法。地平面估計算法主要以確定地面詳細點為主,準確提取地面點云。Byun[18]與Rummelhard[19]等人則采用基于條件隨機場的方法,結合高斯模型和迭代期望最大化方法進行預測,實現了對任意地形下精確地面分割。Chen C等人[20]利用不同尺度的曲率信息來判斷點云中的地面點和非地面點,并通過分層聚合的方式來獲得最終的地面點云。與傳統方法相比,該方法能夠更好地處理地形變化、建筑物和樹木等非地面物體的影響,提高地面點提取的準確性和魯棒性。以上方法在地表平面估計具備很大的優勢,但其劣勢也很明顯,需要大量的計算時間,無法滿足方程式賽車所需的實時響應性。

(2)基于柵格圖的方法。基于柵格圖的方法的思想是將點云數據柵格化,針對柵格內點云特性進行分割。其中魯小偉等[21]提出了一種基于二次柵格化的方法進行地面分割。該方法主要針對地面凹凸不平甚至存在坡度的情況。在第一次柵格化劃分后,對相鄰的柵格內的高度信息設置一定條件進行檢測,第二次柵格化在檢測出的地面點云上進行柵格劃分,劃分后采用滑動窗口的方法將連續的、不屬于地面點云的高架點進行更新。最終,實現在彎道處以及直道處良好的地面分割效果;鄒兵等[22]同樣將點云進行柵格化,并計算柵格單元高度差、平均高度,同時在柵格單元引入點云高度方差信息,綜合三個分割指標實現地面點云準確快速分割,根據設定閾值對地面與非地面點云進行分割。以上方法的效果均決于柵格劃分與閾值設定的優劣,針對于非結構化路面具有良好的效果,閾值設定也更為簡單。應用于方程式賽車中需要進行大量實驗選取合適柵格和閾值,以避免錐桶與地面高度差過低或錐桶點云目標較小引起的分割不準確問題。

(3)基于平面擬合的方法。基于平面擬合的方法的核心思想是將點云數據擬合為不同平面,從而完成地面分割。在二維空間中該思想主要建立在霍夫變換的思想上擬合直線,在三維點云空間中則通過隨機樣本一致性(RANSAC)[23]算法擬合平面。RANSAC算法通過隨機采取數據點擬合平面,設定閾值判斷點云內屬于該平面的點,不斷迭代,從而實現平面擬合與分割。該算法主要針對地面點云在整體點云數據中占比過大的情況,非常適合用于方程式賽車的地面分割中來,但點云數據過多時,會導致迭代次數增加,對滿足實時性產生了挑戰。在迭代次數方面,黃瑤[24]在FSAC賽事環境下做了針對性的實驗,通過實車測試做了最佳的迭代次數。在提升實時性方面,左勇[25]等人提出了一種LP-RANSAC算法,在基于RANSAC的基礎上利用高度最值信息提高了地面點云占比,減少了計算量,并且在分割地面點云的同時仍能保留較好的原始數據特征。

(4)基于深度學習的方法。隨著深度學習在各領域內嶄露頭角,基于學習的點云分割方法也在逐漸被提出。這種分割多為語義分割,即將點云標注不同的語義特征,從而實現分割。文獻[26-27]通過將點云數據轉換為二維圖像,像素與點云相對應,并將圖像輸入至CNN卷積神經網絡中以分割點云中的實例。但該方法需要大量數據集作為支撐,并且針對大規模點云時速率較低。為了解決缺少大量數據集支撐的問題,ZHANG等人[28]提出了一種無監督學習方法,通過使用深度圖卷積神經網絡(GCNN)的部分對比和對象聚類來學習未標記的點云數據集的特征,但同樣存在計算量過大的問題。因此基于學習的點云分割方法仍待進一步研究發展,以輕量化與針對訓練為方向,在保留準確賦予語義特征的前提下,提高實時響應性以應用于方程式賽車當中。

2.2.2 點云聚類算法

在進行地面點云數據分割后,原始點云數據中除了存在錐桶數據還存在離散的噪聲數據等。這時進行檢測仍會由于噪聲、物體堆疊、樁桶信息斷裂等情況造成誤差,因此需要進行聚類分析。其主要思想是選取一個點云,根據距離、密度等特征值設置閾值,通過閾值對其鄰近點云進行判斷是否可以聚為一類。常用方法包括k-means聚類、DBSCAN聚類與歐氏聚類等。

k均值聚類旨在將點云數據依據平均距離分為k個簇,其算法簡單但對初始聚類中心值難以確定。為了解決這個問題,ZHANG 等[29]基于密度選取初始聚類中心的思想對其進行改進,研究結果表明,改進的 K-means 聚類算法具有更高的穩定性和準確性;馬克勤等[30]將距離最遠的兩個樣本點作為初始聚類中心,將剩余樣本點與已知聚類中心距離最小值組成的集合中選取最大值所對應的樣本作為下一個聚類中心,以此達到確定初始樣本中心的目的。而在FSAC賽事中,由于賽道兩旁的錐桶目標不確定,即無法確定k值,因此常使用該算法來對冗余點云進行簡化。

DBSCAN聚類是基于密度的聚類方法,其參數少易于改進,抗干擾能力優秀,并且能夠聚類點云數據中的任意形狀障礙物。但實時性較低,在點云密度不均勻時容易誤檢,并且對參數敏感,在多密度的數據集下使用全局參數,無法確保局部的聚類質量。針對上述問題,Kim JH等[31]人提出了一種基于密度的聚類算法,稱為AA-DBSCAN。該算法是DBSCAN的擴展,能夠更好地識別具有不同密度的簇。AA-DBSCAN通過適應性地調整DBSCAN算法的參數來自適應不同密度的數據集。實驗結果表明,AA-DBSCAN在識別具有不同密度的簇方面表現出色,且具有更高的聚類準確性和更快的運行速度。另外,張長勇[32]等人提出一種自適應的DBSCAN算法,針對分析傳統DBSCAN算法在密度不均與計算量過大等方面存在的局限性,根據不同掃描距離采用不同參數,并提出“核心點”概念,達到了對不同距離障礙物快速準確聚類的目的。

歐氏聚類是通過距離作為限制條件,通過設定距離閾值進行聚類。該方法聚類效果好,但由于需要對近鄰點云比較,帶來的計算量大的問題。同時由于點云具有密度近大遠小的特點,這也使得固定閾值在密度不均勻的點云聚類中容易產生誤差。王凱歌等[33]從改進算法的角度出發,提出給點云賦值來區分目標點云和干擾點云,雖然檢測的準確率有所提升,但是計算過程復雜,耗時多。針對實時性問題,Cao Y等人[34]提出一種快速歐幾里得聚類(FEC)算法,通過采用具有索引的逐點搜索方案,降低了對kd-tree的調用次數,使得聚類速度得到大幅提升。而在無人駕駛方程式賽車的應用上,黃瑞欽等人[35]針對賽道環境提出改進歐氏聚類的方法,找到感興趣區域,并利用隨機采樣算法分離地面和錐桶的點云,最后設計出面向賽道環境的區域劃分方法來改進歐氏聚類算法,利用動態閾值聚類分割出錐桶點云,從而完成聚類任務。

通過以上分析介紹,無人駕駛方程式賽車基于激光雷達的環境感知系統主要任務聚焦于地面點云的分割與非地面點云即錐桶點云的聚類兩部分。目前大多算法主要關注在三維空間內平面分割、多物體目標識別及語義分割等方向,而FSAC賽事場地平坦,障礙物目標單一,主要關注小目標物體檢測的準確性、實時性及地面雜物的干擾問題,后續可以繼續根據以上問題改進創新。

2.3 基于多傳感器融合的環境感知技術

通過對上述方案的分析,結合方程式賽車環境感知背景,車載相機能夠捕捉環境中目標的顏色、紋理、位置等信息,較激光雷達傳感器而言具有檢測語義特征豐富、價格低廉的優點。但其缺點也較為明顯,受到光源影響。此外,單目相機無法提供三維數據信息,而雙目或深度相機價格昂貴且檢測精度、范圍、分辨率等都不如激光雷達傳感器。單一傳感器存在著各自的優勢與劣勢,因此將傳感器進行組合使用,互相彌補不足,克服在某一領域內單一傳感器的局限性,提高感知外界環境信息精度是非常必要的。

2.3.1 多傳感器融合結構

多傳感器融合技術根據輸入融合網絡數據的不同,分為數據級融合、特征級融合和決策級融合三類[36]。其中,數據級融合是最基礎的融合方式,通過將來自多個傳感器的數據進行整理對齊的預處理,直接融合各傳感器的原始數據。數據級融合能夠最大程度的保留原始數據,同時多源數據之間相互補償,避免了單一數據的局限性,例如相機與激光雷達融合就可以補償激光雷達語義信息的不足[37]。但由于原始數據信息類型不同,這要導致了在融合過程中需要大量計算對數據進行時間、空間上的數據對齊。而且融合算法的架構比較固定,不容易在原始架構中增加新的傳感器模塊。其次,多源數據之間存在互補也存在相互沖突的數據,這也導致數據級融合的噪聲過多,抗干擾性較差。這也導致在方程式賽車中,傳統的數據級融合方法已經被淘汰,乃至被各種特征融合方式所替代。

特征級融合為中間層融合方式,其通過對各傳感器節點的原始數據進行特征提取,并以特征向量的方式來表示物體信息,最后傳入特征融合網絡完成融合。該方法在特征提取階段,不同的傳感器數據將提取不同的特征。以圖像和點云為例,圖像數據提取的特征多為檢測目標的輪廓、類別、顏色等;激光雷達數據提取的特征多為檢測目標的表面信息、三維數據及位置距離信息等。大多數基于深度學習的特征提取通過神經網絡來進行,如RoarNet[38]、AVOD[39]、MV3D[40]、F-PointNet[41]等。特征級融合不僅一定程度上保留了原始數據中的重要特征信息,還大大減少了原始數據到融合模塊的帶寬,對數據進行有效的壓縮,提高了系統的實時性。相對數據級融合相比,減少了傳入融合模塊的數據量,故檢測速度大幅提升,但相對會丟失部分細節信息,融合精度不如數據級融合。

決策級融合屬于最高級的融合,其通過對多個傳感器傳入的數據進行決策分析,隨后對每個決策信息進行融合,根據決策之間的相關性得出滿足實際需要的高級決策[42]。決策級融合在方程式賽車環境感知中具備獨特的優勢,其模塊化的傳感器封裝,可以使得最終決策結果不因某一傳感器故障而發生改變,其次由于其不存在中間數據的融合過程,精簡了復雜結構,大大提升了實時性,融合速度更快捷高效。

2.3.2 基于圖像和點云融合的目標檢測算法

對于方程式賽車來講,主要需要將圖像和激光點云數據相融合,融合方式大概分為2D proposal與3Dproposal,2Dproposal通過將目標檢測生成二維的感興趣區域投射到三維空間,包括基于點的融合方式、基于視錐體的融合方式,3Dproposal直接從二維或者三維空間中預測出三維候選區域,包括基于多視角的融合方式、基于體素的融合方式等[43]。

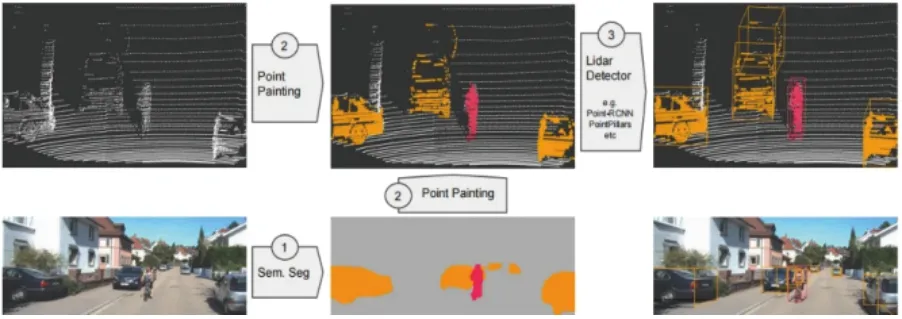

基于點的融合方式通過將點云投影到平面,使得圖像的高語義特征與點云中的點一一對應。基于點云本身語義信息不足,分辨率不高等問題,Point Painting[44]和PI-RCNN[45]模型將圖像分支和原始激光雷達點云中的語義特征融合在一起典型模型。這種模型通過思考圖像本身具備的高語義信息與雷達所具備的精確的檢測范圍互相彌補,提出將RGB圖像與雷達點云相融合,網絡示意圖如圖2。Yang等在該思想的基礎上,針對目標存在遮擋或目標較多的問題,提出基于密集型點的目標檢測模型 IPOD[46]。該方法通過將點云投影到圖像并使用二維語義關聯的方法過濾背景,生成的前景點保留了上下文信息和細粒度的位置信息,在之后的逐點提案生成和包圍框回歸階段,使用兩個基于 PointNet++[47]的網絡進行特征提取和包圍框預測,在密集場景具備更好的檢測性能。

圖2 Point Painting網絡示意圖[44]

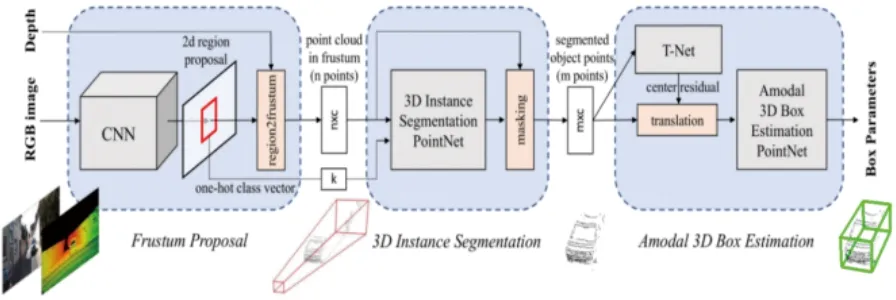

基于視錐體的融合方式通過將二維的感興趣區域邊界框投影到三維空間內,形成視錐體以實現融合。Qi等提出F-PointNet模型將成熟的CNN目標檢測算法和pointnet處理點云方法相結合,通過frustum(視錐體)的方式將二維邊界框映射到三維空間進行處理,最后利用輕量級回歸PointNet(T-Net)網絡預測邊界框中心,通過三維邊界框估計模塊獲取檢測結果,其網絡結構如圖3。隨后WANG等[48]在F-PointNet的基礎上進行改進,為提高檢測效率提出生成視錐體序列的辦法,減少了遍歷點云的數量。

圖3 F-PointNet網絡結構圖[41]

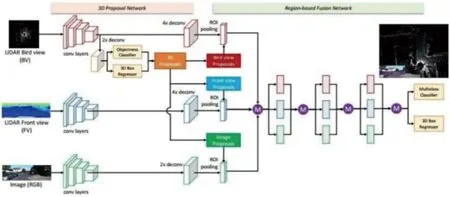

基于多視角的融合方式通過利用鳥瞰圖法生成三維感興趣區域,并回歸三維檢測框。2019年,Gu等[49]將分割結果組合在一起解決道路檢測問題的方法,與Melotti等[50]提出的融合一樣,將三維檢測方案不同分支的權重匯總為一個最終權重,進行候選框的選取。Chen等創新性的提出了一種用多傳感器不同視角相融合的模型MV3D,其輸入為點云的鳥瞰圖、點云的前視圖及二維原始圖像,通過在鳥瞰圖中使用三維區域候選網絡獲得三維候選區域,并將其分別映射到不同視角中以獲得了3個不同的候選區域。隨后融合來自3種形式數據特征,并利用定向三維框回歸實現檢測。但在針對小目標時,點云鳥瞰圖中經過下采樣之后占據像素少,容易產生漏檢的情況MV3D網絡結構圖如圖4。

圖4 MV3D網絡結構圖

基于體素的融合方式將點云看作3D空間,并分成一個個體素塊,將體素與圖像對應融合。Sindagi等人首先提出基于體素進行融合的算法MVX-Net[51],其通過Faster-RCNN算法進行圖像特征提取,并將點云投影至圖像,與其生成的特征圖進行匹配,隨后再對匹配完成的圖像提取特征。另一方面,在上述過程中同時對原始點云進行了體素化處理,并與上述匹配處理后的特征圖進行特征融合操作,逐點進行拼接。最后進行多層的體素特征編碼操作,生成三維候選區域進行3D檢測。

綜上所述,相機與激光雷達組合被用于感知系統具備一定的可靠性與提升,能夠使得自動駕駛汽車更好的理解復雜場景。但該技術并不成熟,由于噪聲的存在,使得融合時點云與像素的對齊不夠準確。其次,現有的大多數方法都以精準為目標,無法達到實時性的要求。在方程式賽車中需要保證以高速度實現高精度感知,因此仍需繼續進行研究。

3 無人駕駛方程式賽車環境感知技術發展趨勢

無人駕駛系統由于其靈活自主和高智能等優點,已經成為了國內外學者研究的熱點問題,目前已經在各種場合進行了實驗與模擬,已經取得了不錯的成果。但針對于方程式賽車而言,針對于目前動態賽成果尚且不足,在面對更加復雜環境背景下,將帶來更多的挑戰。無人駕駛方程式賽車環境感知技術目前面臨的關鍵性難題主要包括:

(1)視覺系統檢測性能的不穩定性。目前FSAC的賽事大多處于結構化的場地,但仍存在道路環境的復雜多變光照特性與天氣狀況帶來的問題。

(2)多傳感器融合。環境感知系統主要通過相機和激光雷達傳感器發揮作用,但二者之間的融合算法仍不完善。同時成本相對較高,在惡劣條件下效果較差。

(3)實時性。FSAC動態項目中,主要針對靜態障礙物進行檢測規劃,對實時性相對要求較低。但在未來賽事中,可能出現更多的動態障礙物,要求方程式賽車更加的靈活多變,對實時性提出了更高的要求。

面對上述難點,無人駕駛系統應具備更高的智能感知能力,甚至可以具備一定的認知能力。在硬件方面,需要對各傳感器特性充分融合,互補互足。可以考慮使用更多的傳感器,如激光雷達、毫米波雷達與相機共同作用。同時,車載計算單元算力有限,應進一步提升算力。在面對無人駕駛系統目標檢測、目標跟蹤、決策與規劃多個任務同時進行時,將進一步壓縮算力,對實時響應產生影響。

在算法方面,面對復雜的非結構化環境,可同時利用多傳感器共同作用帶來的信息,實現更精確、范圍更廣的感知。多傳感器融合算法目前多為基于有監督的方式,需要優秀的數據集進行訓練,但目前針對極端情況的數據集較少,且耗費資源。因此。基于無監督的多傳感器融合算法將更適合方程式賽車。在實時響應性方面,應盡可能降低算法的復雜度,并根據規則在第一圈感知時即可完成先驗工作,為實時計算留出算力空間,以得出更好的檢驗結果。

4 結 語

方程式賽車屬于智能無人駕駛下的一個子集,其具備著智能無人駕駛所具備的自主性、智能性與無人化等特點,同時又有自身所處賽事的背景環境特點,是結合智能感知、自主規劃、智能決策多門學科技術的產物[52]。以FSAC賽事為背景,在自動駕駛領域環境感知技術方面對近些年的研究發展進行闡述,并分析算法在無人駕駛方程式賽車上的適用性。在未來,隨著FSAC大賽的持續發展,專家學者的不斷研究,方程式賽車將成為智能無人駕駛的典型應用實例,也必將推動目標檢測與跟蹤、slam建圖和決策規劃等多項技術的蓬勃發展。