一種用于遙感圖像變化檢測的級聯跨尺度網絡

劉雙澤,薛明亮

(大連民族大學 計算機科學與工程學院,遼寧 大連 116650)

變化檢測[1]作為遙感領域的重要組成部分,是從同一位置不同時刻獲取的兩幅遙感圖像之間,通過一系列的方法提取出自然或人工變化區域的過程。變化檢測在眾多領域都有著重要的應用,例如在城市規劃[2]、土地調查[3]、災害評估[4]和生態環境監測[5]等方面。隨著越來越多的高分衛星發射到太空,使得具有更高分辨率的遙感圖像獲取變得更加容易,因此具有高分辨率遙感圖像數據集。在這種情況下,尋求新的方法以解決上述問題受到了越來越多研究者的關注,并取得了許多令人矚目的成果。由于深度學習模型強大的圖像處理能力,許多學者將深度學習方法引入遙感圖像變化檢測領域。因此,近年來涌現了許多基于深度學習的變化檢測方法。Song等人[6]設計了一種結合3D全卷積網絡和卷積短時長記憶的優點的變化檢測方法,名為循環3D全卷積網絡。Liu等人[7]提出了一個新的損失函數來實現由語義分割數據集到變化檢測數據集之間的遷移學習。這種方法可以緩解變化檢測數據集中帶注釋的訓練樣本不足的問題。Chen等人[8]提出了一種基于transformer的變化檢測模型,它可以通過對時空域內的上下文進行建模,來關聯時空中的遠程概念。該方法可以有效避免因物體外觀相似而導致的誤檢測,并能很好地處理因季節差異或土地覆被變化引起的無關變化。然而,目前在處理變化檢測中偽變化現象仍存在一些問題。一方面,目前的方法大多沒有充分利用不同尺度提取的特征,忽略了不同層特征之間的語義差距,這可能會由于特征的冗余和模糊性而導致偽變化問題。其次,由于成像角度、天氣狀況、季節變化以及外觀非常混亂的物體等原因造成的偽變化仍然難以區分。為此本文設計了一種級聯跨尺度網絡(Cascaded Cross-Scale Network,CCSNet)來提高模型對偽變化的魯棒性。本文設計了一種級聯連接結構來融合不同尺度的特征,縮小了語義差距。本文提出了一種注意力模塊,跨尺度注意模塊,來提高特征的辨別能力。CCSNet通過將多尺度特征融合起來,然后使用注意力機制來增強與變化相關語義信息一致的區域,并抑制各種因素引起的虛假變化和噪聲,從而達到減少由各種因素而導致的偽變化。

1 CCSNet網絡算法

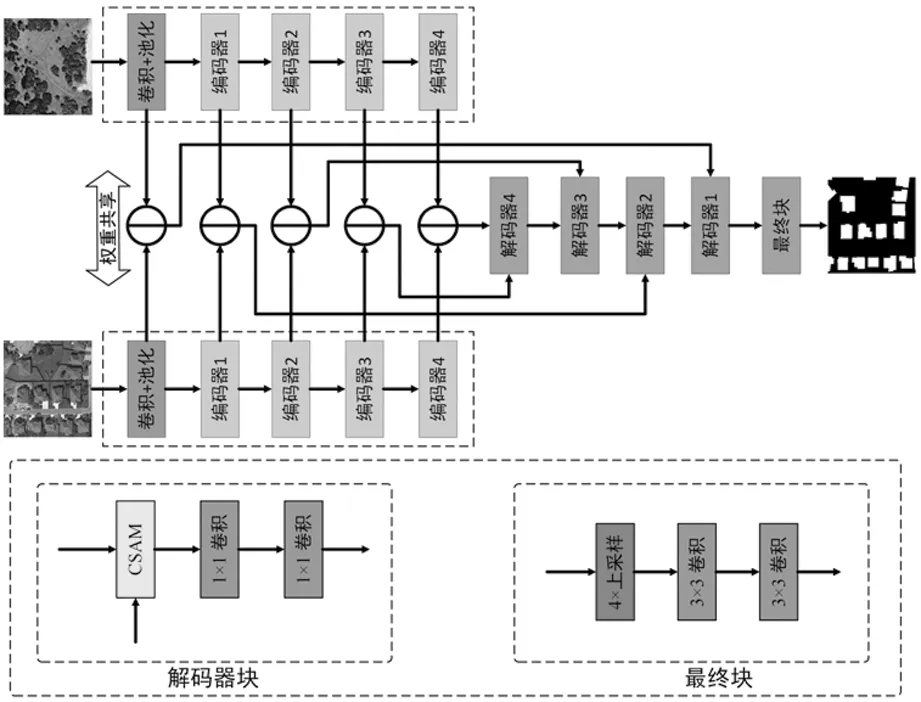

CCSNet網絡使用的是編碼器和解碼器結構,整體流程如圖1。在編碼階段,將雙時態圖像輸入到卷積池化層中,對圖像進行縮放,減少計算內存。然后輸入到4層的編碼器中進行降采樣。通過權值共享的孿生編碼器編碼,得到5個不同階段的輸出特征圖。在解碼階段,首先把同一階段的兩個特征圖進行差分操作來得到差分特征圖。其次把編碼器4的差值特征圖和編碼器3的差值特征圖使用級聯連接一起輸入到解碼器4中進行解碼,之后重復上一步的操作。經過層層解碼,最后把解碼器1的輸出特征圖傳遞給最終塊,得到最終的變化檢測圖。

圖1 CCSNet網絡整體架構

1.1 編碼器

卷積神經網絡因其強大的特征提取能力而被廣泛應用于遙感圖像分析。在編碼階段,使用ResNet-34來構建編碼器網絡。由于變化檢測的輸入通常是雙時相圖像,所以編碼器網絡采用孿生網絡結構。具體來說,編碼器網絡由兩個共享可學習權值的編碼分支組成。由于ResNet最初是為了解決圖像分類問題而提出的,其整體結構可以分為一個卷積池化層、四個降采樣卷積層和一個全連接層。但是,最終的變化映射必須恢復到與原始圖像完全相同的大小。因此,省略了全連接層。

1.2 解碼器

在解碼階段,所提出的結構由四個解碼器和一個最終塊組成,它們對應于四個編碼器和卷積池化層。具體來說,四個解碼器具有相同的結構,如圖2。該解碼器包含一個跨尺度注意模塊(Cross-Scale Attention Module,CSAM)和兩個1×1卷積層。所提出的解碼體系結構有不同的實現方式。具體來說,將兩個不同尺度的連接特征圖使用級聯連接輸入給一個解碼器。例如,將編碼器4(深特征)和編碼器3(淺特征)提取的特征輸入到解碼器4中進行進一步學習。這種方式可以更好地融合淺層特征的空間信息和深度特征的語義信息,以補償特征編碼過程中衰落的幾何信息,這是檢測變化區域的關鍵。此外,還可以縮小語義差異,并關注與變化信息相關的特征映射區域。因此,得到的最終特征圖可以整合不同尺度的特征。解碼階段的最后一部分是最終塊。跨尺度注意力模塊的整體結構如圖2。它由一個4倍的上采樣層和兩個3×3的卷積層組成。它的功能是最終的變化圖恢復到與原圖像完全相同的大小。

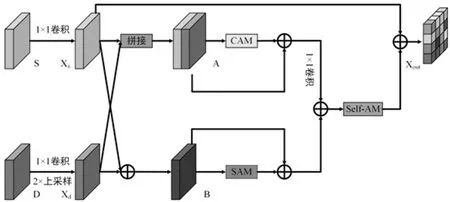

圖2 跨尺度注意力模塊的整體結構

1.3 跨尺度注意力模塊

將不同編碼層獲得的淺層與深層特征圖融合,有助于恢復在級聯特征編碼過程中逐漸消失的空間信息。然而,由于多尺度特征之間存在語義差距,不適當的融合可能會引入冗余信息或噪聲。它可能會導致過度的分割和意外的模糊表示,這可能會分散模型來區分由于成像角度、天氣條件、季節變化和外觀非常混亂的物體而引起的偽變化。為了縮小多尺度特征之間的語義差異,使模型對偽變化更具魯棒性,設計了一個級聯跨尺度注意力模塊(Cross-Scale Attention Module,CSAM)如圖3。CSAM通過通道注意力和空間注意力來融合多尺度特征圖。通道注意力可以有效地學習與不同尺度的特征圖之間的變化相關的通道,而空間注意力則可以幫助學習已經發生變化的區域。由通道和空間注意力模塊學習到的特征圖然后被自注意力模塊融合,以捕獲不同像素之間的依賴關系。CSAM可以更好地融合淺層和深層特征圖與變化信息相關的信息,抑制由各種因素而導致的偽變化信息。

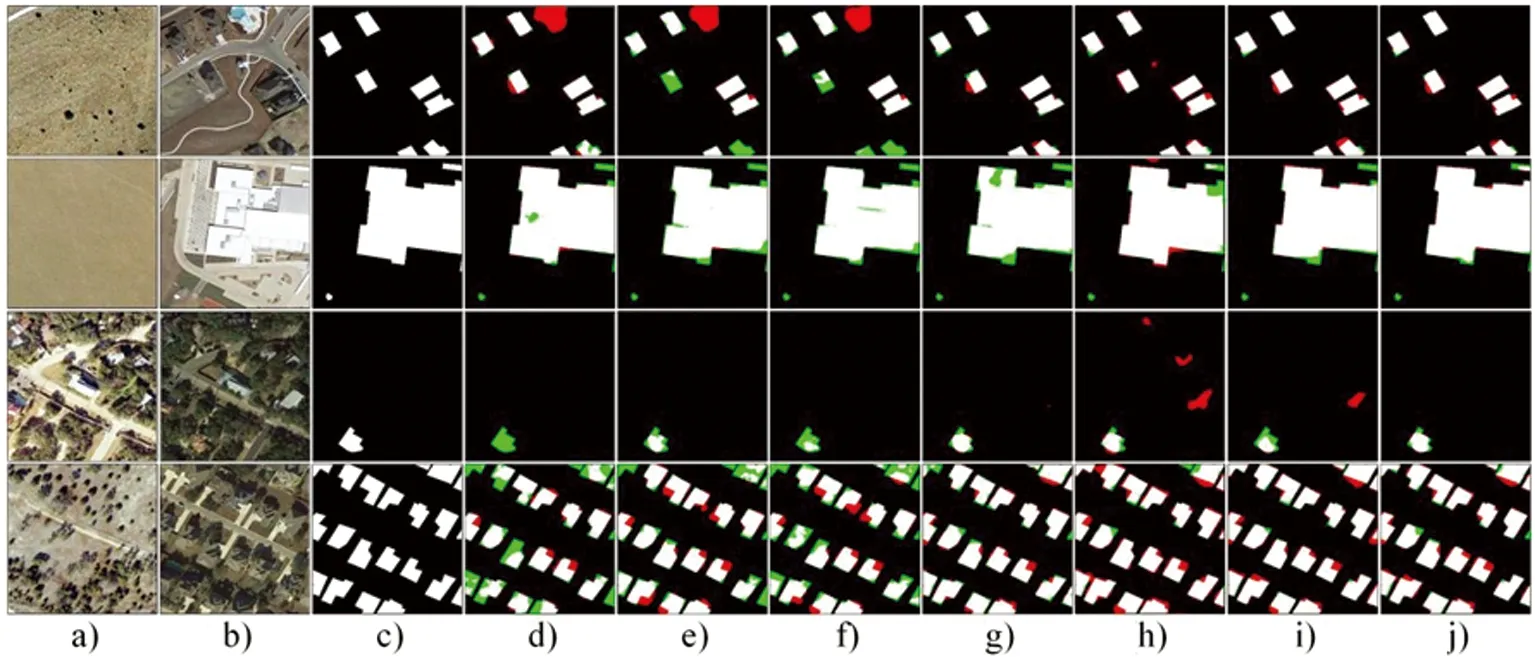

(a)圖像T1;(b)圖像T2;(c)Ground truth; (d) FC-EF; (e) FC-Siam-Diff; (f) FC-Siam-Conc;(g) DTCDSCN;(h) STANet;(i)BIT;(j) CCSNet。圖3 LEVIR-CD數據集上的檢測結果可視化

通常來說,特征圖中的每個通道的重要程度是相同。但是,對于特定任務來說不同通道的重要性是有所不同的,往往需要對每個通道的重要性進行建模來達到增強或抑制一些通道。在本文中,通道注意力模塊(Channel Attention Module,CAM)所采用的是SENet[9]。它首先使用壓縮模塊對特征圖進行全局信息嵌入,然后使用激勵模塊進行通道關系加權。在變化檢測任務中,通道注意力增強與地面特征變化相關的通道,抑制其他不相關的通道。因此,首先使用通道注意力減少淺層特征圖和深層特征圖之間的語義差距,增強它們之間與變化相關的語義信息。

在計算機視覺任務中,圖像像素點的識別需要考慮它所在的空間位置。換句話說,不同的像素位置的重要程度是有所區別的。考慮到遙感圖像中像素位置的重要程度不同,所以引入空間注意力模塊(Spatial Attention Module,SAM)[10]。因為變化檢測的輸入為雙時態圖像,所以為了確認雙時態圖像的那些像素位置與變化相關,那些像素位置與變化無關,這是十分有意義的。而空間注意力可以增加變化像素和不變像素之間的距離差,從而選擇對變化信息更敏感的像素位置。

與通道和空間注意力模塊不同,自注意力模塊(Self-Attention Module,Self-AM)旨在捕獲特征圖任意兩個位置之間的空間依賴關系。它通過對特征圖之間的任意兩點之間的關系進行建模,來選擇性地聚合每個位置的特征。為了更好地識別那兩個像素之間位置關系對變化信息更重要,采納Chen等人提出的位置注意模塊[11]。

2 實 驗

為了評估本模型對偽變化的有效性,本文在LEVIR-CD數據集進行了對比實驗,并使用精度(Precision)、召回率(Recall)、F1值(F1)、交并比(IoU)和總準確率(OA)作為評估模型的指標。本文將所提出的網絡與現有先進的變化檢測進行對比實驗,并進行了可視化比較,從而進一步驗證模型對偽變化的性能。

2.1 數據集及實驗環境

LEVIR-CD[12]是一個被廣泛使用的建筑物變化檢測數據集。總有637對分辨率為0.5 m遙感圖像。其中每張圖像的大小為1 024×1 024像素。該數據集中的雙時間圖像是使用谷歌Earth API在2002年至2018年期間從美國德克薩斯州18個州的20個不同地點收集的。它主要關注小而密集的建筑增加和建筑拆除。考慮到GPU內存有限和模型訓練速度等因素,把1 024×1 024的圖像對裁剪為256×256的沒有重疊圖像對。最終,LEVIR-CD數據集的訓練集、驗證集、測試集大小分別為 7 120、1 024、2 048。

模型搭建和網絡訓練都是用PyTorch實現的,并使用單個 48GB 內存 NVIDIA RTX A6000 GPU 進行訓練。由于原圖像的分辨率太大和顯卡內存有限,將所有輸入圖像對都被裁剪成256×256不重疊的補丁。使用隨機翻轉、隨機旋轉、隨機裁剪和高斯模糊等數據增強方式來豐富數據集和防止模型過擬合。所使用的優化器為動量隨機梯度下降(SGD),并將動量設置為 0.9,權重衰減設置為 0.000 5。初始學習率設置為 0.01,batch size 設置為 8,訓練總輪數設置為 200。

2.2 實驗結果分析

2.2.1 對比實驗

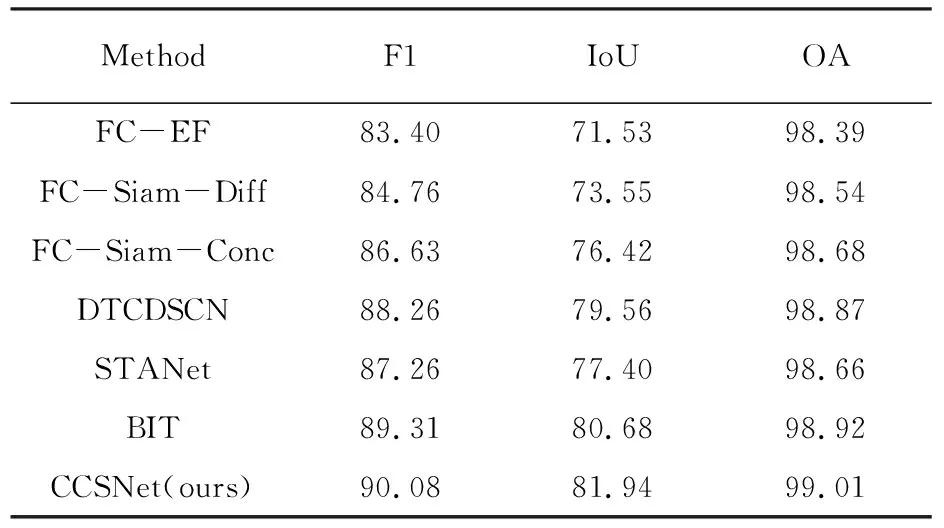

為了評估整體性能,將本文的CCSNet與其他先進的方法,例如FC-EF[13]、FC-Siam-Diff[13]、FC-Siam-Conc[13]、DTCDSCN[14]、STANet[12]和BIT[8],在LEVIR-CD數據集上進行了對比實驗。實驗結果的定性和定量結果見表1和圖3。

表1 LEVIR-CD數據集上的變化檢測性能比較 %

從表1的定量分析表明,根據F1、IoU和OA等指標,CCSNet的表現優于其他CD方法。在LEVIR-CD數據集上,CCSNet在精度、F1、IoU和OA四個指標中都達到了最優的結果。與最新的方法BIT相比,CCSNet的F1值、IoU和OA分別提高了 0.77%、1.26%、0.09%。

圖3展示了CCSNet與其他模型在LECIR-CD數據集上的可視化結果。從圖中可以更加直觀地比較本文的模型與其他模型的性能。為了更好地分析模型的性能,在生成的變化圖中使用白色表示正確預測的變化像素(TP),黑色表示正確預測的不變像素(TN),紅色表示錯誤預測的不變像素(FP),綠色表示真實變化像素的漏檢(FN)。從圖中可以觀察到,CCSNet在LEVIR-CD數據集上都取得了令人滿意的結果。

如圖3的第一行圖像所示,它是不同模型在小而稀疏的建筑情況下所得到的結果。從中可以觀測到,FC系列的模型都將游泳池區域錯誤分類為建筑更改。而CCSNet以及DTCDSCN、STANet和BIT都能正確識別。這是因為所提出的跨尺度注意力模塊可以很好地整合淺層特征圖中與深層特征圖一致的區域,并抑制不必要的特征表達和噪聲。如圖3的第二行圖像所示,它是比較了在大型建筑的情況。從中可以看出其他模型未能很好地檢測出右上角細長的條形建筑物,且主要建筑物的檢測結果存在孔洞或邊界不完整。盡管STANet可以檢測到它們,但它們要么在其他地方進行錯誤檢測(FP),要么漏檢(FN),導致建筑物邊界不完整。本文的模型是唯一一個不僅檢測出了右上角的長條形建筑物,而且獲得了主體建筑物完整邊界的模型。從圖3的第三行圖像看出,是模型在小目標變化的情況。其他模型要么未能檢測到左下角的建筑物,要么錯誤地檢測到樹木的樹冠引起的變化。相反,本文的模型成功地避免了這兩個問題,這說明本文的模型能夠區分由樹木覆蓋引起的偽變化。從圖3的最后一行圖像看出,模型在小而密集的建筑群下的檢測結果。許多模型在處理密集分布的小型建筑物時都出現了不同程度漏檢情況,而本文的模型和BIT的檢測相對完整。

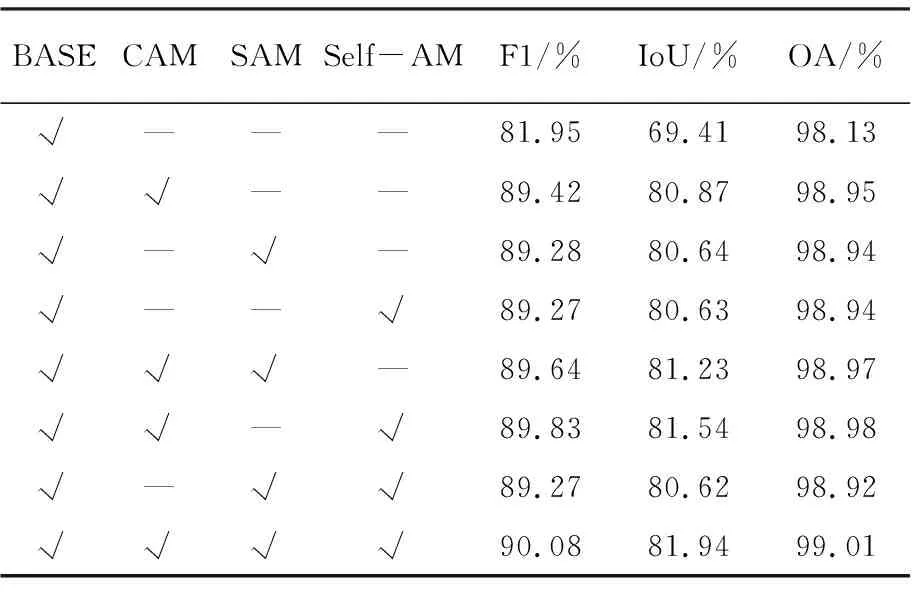

2.2.2 消融實驗

為了驗證CSAM的有效性,在設計的CSAM中對不同組合結構進行了消融實驗,并在LEVIR-CD數據集上進行了對比分析。BASE 模型是 CCSNet的變體,是由一個基于 ResNet的孿生編碼器和一個去掉了 CSAM解碼器組成。消融實驗在LEVIR-CD 數據集上的具體量化結果見表2。從表中可以清楚地觀察到 BASE模型的測試結果是最低的。這是因為 BASE模型是最簡單的,并且沒有包含 CSAM。將CAM、 SAM或Self-AM分別插入到 BASE中,可以顯著提高檢測性能,取得的F1值、 IoU和OA均表明了這一點。其中,“BASE + CAM”模型在F1值、IOU和OA指標上取得了最好的成績,在 LEVIR-CD數據集上分別提升了7.47%、 1.46% 和 0.82%。此外,為了進一步驗證CSAM 中所使用結構的有效性,還對任意兩個注意力模塊的組合情況進行了實驗。從表2可以看出,“BASE +CAM + Self-AM”組合的性能最好,其中F1值、 IOU 和OA分別達到89.83%、 81.54% 和98.98%。“BASE + CAM + SAM”的性能次之。通過將 CAM、SAM和Self-AM與 BASE模型集成,得到的CSAM模型獲得了最好的變化檢測結果,在LEVIR-CD數據集上的F1值提高了8.13%,IOU提高了12.53%,OA提高了0.88%。從表2的量化結果可以看出,CSAM 中CAM、 SAM和Self-AM 的每個注意力模塊都對變化特征學習有貢獻。本文提出的CSAM通過融合他們來處理不同類型的噪聲可能導致的偽變化,進一步提高了檢測性能。

表2 不同注意力模塊組合在LEVIR-CD數據集上的消融結果

3 結 語

提出了一個用于高分辨率遙感圖像的變化檢的級聯跨尺度網絡。設計了一種級聯連接結構,將不同層的淺層和深度特征映射一起輸入解碼器。此外,將編碼器提取的淺層特征圖連續輸入解碼器,以縮小淺層特征和深層特征之間的語義差距。CSAM使網絡能夠在通道維度、空間位置和不同像素之間的依賴性三個角度優化淺層特征,從而增強與深層特征映射的一致性語義信息,抑制其他不必要的特征表達和噪聲。當在LEVIR-CD數據集上進行評估時,所提出的CCSNet優于其他最先進的方法。實驗結果表明:所提出的CSAM可以很好地保持不同尺度下特征映射之間的語義一致性,提高了模型對偽變化的魯棒性。