新時代虛擬數字人技術發展及應用研究

吳 昊

浙江傳媒學院動畫與數字藝術學院,浙江杭州 310018

1 虛擬數字人藝術的背景與現狀

數字人的概念可以追溯到20 世紀60 年代,當時計算機科學家伊凡·蘇澤蘭(Ivan Sutherland)提出了“虛擬現實”的概念,并在此基礎上提出了“數字人”概念。他認為,數字人是一種可以在計算機中創建、操縱和顯示的虛擬人類。這個概念在后來的幾十年中得到了不斷發展和完善,如今已經成為了虛擬現實(VR)和計算機圖形學(CG)領域中一個非常重要的概念。1964 年由波音公司研究員威廉·費特(William Fetter)首次使用電腦圖形技術制作的第一個數字人物形象“波音人”(圖1),用于駕駛員座艙設計及功效學研究。之所以將該“波音人”界定為數字人,“數字”是與計算機技術相關,“波音人”是第一個利用計算機創建的人物形象,標志著數字人技術在工業設計中的首次應用。

圖1 威廉·費特制作的“波音人”

最近,產業界、教育界等多個群體正在關注元宇宙市場,元宇宙概念正以迅雷不及掩耳之勢席卷各個行業,其已逐漸被廣大機構視為數字世界未來發展的形態。元宇宙發展趨勢下,虛擬數字人將是不可或缺的因素[1]。元宇宙中的虛擬數字人不僅是虛擬的商業或藝術形象,也不是對人單純靜態的生理模擬,而是綜合利用各種新技術對人的生理屬性和社會屬性的全方位模擬和系統性仿真,是具備社交功能的社會人[2]。在數字技術的早期階段,數字人主要應用于計算機圖形學、動畫和游戲等領域,用于創建數字人的二維、三維圖像或動畫。到了虛擬人階段,數字技術的應用更加廣泛,虛擬人可以通過數字技術模擬人的外貌、動作和行為等多個方面,并應用于虛擬現實、視頻游戲、影視制作和教育等領域。虛擬人一般具有比數字人更為真實的外觀和行為表現。而到了虛擬數字人階段,數字技術的應用進一步提高,虛擬數字人不僅能夠模擬人的外貌和行為,還能夠生成具有感情和智能化的虛擬人。虛擬數字人的應用范圍更加廣泛,不僅可以用于虛擬現實、游戲、影視制作和教育等領域,還可以用于虛擬購物、虛擬醫療、人機交互、社交媒體和數字營銷等領域。有學者認為,虛擬數字人是數字科技與二次元文化結合的產物,其本身并不以實體形式存在,是建立在后現代消費主義下的文化產物[3]。虛擬數字人的出現標志著數字技術已經進入到一個全新的發展階段。虛擬數字人對于元宇宙的發展和應用具有重要的推動作用。

數字人技術可以制作具有與真人相同的人物形象,這在各種媒體平臺中的使用由來已久。例如,2001 年,維塔工作室的團隊利用動作捕捉技術打造了《指環王》中的經典角色咕嚕姆。但是,直到2012年,科切拉音樂節上,數字王國(Digital Domain Media Group,DDMG)利用全息技術將已故說唱歌手圖帕克·夏庫爾(Tupac Shakur)“復活”,在舞臺上呈現出他的形象并表演了幾首歌曲(圖2)。這項技術引起了廣泛的關注和討論,也表明了虛擬數字人技術在娛樂產業中的潛力和前景。在“虛擬”與“現實”并行的元宇宙中,每個人在不同的平臺上都會出現對應的“虛擬化身”,即“虛擬數字人(MetaHuman)”,這是運用先進技術所構建真人的“數字孿生”。作為人的虛擬化身,這是綜合利用數字技術對人的生理屬性和社會屬性的全方位模擬[2]。最近,以深度學習為基礎的人工智能(AI)技術的發展極大地改進了基于真人動作的數字人生成技術。十多年前,寫實數字人形象創作還需要專業設計師使用3D 動畫軟件完成,因此,除了以3D 動畫片為特色的電影產業外,在現實中很難為公眾提供人體虛擬形象的服務。例如,虛擬數字人羅茜(Rozy)(圖3)是由韓國Sidus Studio X 公司制作的虛擬人,早在2020 年8 月便在社交媒體SNS 上展開活動[4]。近些年,技術環境的改善為虛擬數字人的發展提供了更多機遇。隨著技術的不斷進步,虛擬數字人的形象更加逼真,交互體驗也更加流暢,為各個領域帶來更多創新和應用機會。

圖2 數字虛擬歌手圖帕克·夏庫爾

圖3 虛擬網紅羅茜

虛擬數字人的目標主要是積極利用社交媒體(SNS)來迎合“Z 世代”受眾群體,即在1995~2010 年出生的青年群體,他們伴隨著數字技術的一路成長,對新鮮事物的個性選擇以及對數字化與自身生活的結合表現出超越以往人群的強烈意愿[5]。當前,流通業之所以關注虛擬數字人,是因為通過社交媒體可以與主要消費層“Z 世代”群體進行近距離溝通。根據量子位智庫發布的《虛擬數字人深度產業報告》,2030 年我國虛擬數字人市場規模將達到2700 億元,目前市場仍處于前期培育階段,有著廣闊的發展前景[6]。因此,預計數字人的市場規模也將會逐步擴大。

數字人技術起源于影視領域。隨著游戲行業的發展,數字人領域中已經開始獲得越來越多的技術賦能,包括建模、綁定、動態抓取、渲染、AI 語音識別以及圖像識別等,而這些技術也大大提高了數字人的生成效率[7]。近些年,人工智能技術的發展,虛擬數字人制作技術取得新突破,角色建模方式不再是依賴于專業人員在三維建模軟件里創建出人體的三維模型,而是可以通過幾張人體的掃描照片就能自動生成高精度數字人模型,并且這些模型還可以呈現出不同的藝術風格[8]。例如,可以制作真實虛擬人的MetaHuman、Daz 3D,或可以制作動畫片的Mixamo、可以制作卡通風格2D 角色的VRoid、可以制作各種3D 角色的Character Creator 4 等。下面將具體對數字人創作流程中的各項技術進行研究。

2 虛擬數字人的創作方法

2.1 MetaHuman 數字人建模與面部表情

MetaHuman 應用程序是一種基于人工智能技術的創作軟件,可以生成高度逼真的虛擬人物,并為其賦予各種行為和情感表現能力。這項技術將大量的數據和算法應用于計算機視覺(CV)、自然語言處理(NLP)和運動學等領域,使得虛擬人物能夠以與真實人類相似的方式交互和表現。MetaHuman 可以在游戲、電影、虛擬現實等多個領域應用,成為數字娛樂產業的一個重要組成部分。

MetaHuman 主要特點是可以將動畫實時應用到逼真的角色上,實現不同年齡、體型和種族的多樣性。MetaHuman 為所有創作者提供非常逼真的人類角色制作功能的框架,且具有直觀的界面,即使是新手也可以輕松應用。更改角色細節的方式有三種,第一種是混合模式(Blend Mode)。混合模式用戶可以通過調整數字人物的面部表情和身體動作等關鍵點,實現對角色表情和姿態的微調和改變。這種模式適用于需要對數字人物進行微調的情況。第二種是雕刻模式(Sculpt Mode)。雕刻模式下用戶可以在MetaHuman 編輯器中直接對數字人物的頭部、身體、四肢等部位進行手動編輯和更改,實現角色的重塑和調整。這種模式適用于需要對數字人物進行大范圍改動的情況,同時相對于其他兩種方法,需要更多的時間,但可以進行更精細的調整。第三種是移動模式(Move Mode)。通過調整標記組來調整臉部較大的部分,相對于精細的調整,這種方式可以在較短時間內修改整體外觀,特別適用于修改整體外觀而非精細調整的情況。

MetaHuman 軟件可以實現數字人的自然面部表情動畫的工具。利用這些工具,無需專業知識,可以輕松制作高質量逼真的數字人物,只需掌握應用簡單的照明、姿勢和表情預設即可制作生動的數字人。然而,MetaHuman 提供的身材種類(苗條、普通、豐滿)、性別和身高選擇范圍較窄,只能根據模型庫所提供的角色骨架、發型等類型內部使用,因此其使用范圍較為有限。因此,對于實現所需人物或預設角色的設定方面通用性較低。為了彌補這一點,新引入的技術是“Mesh to MetaHuman”。

2.2 Mesh to MetaHuman 技術擴展了數字人的模型庫

Mesh to MetaHuman 技術是一種使用外部應用程序生成的3D 角色網格(Mesh)來創建MetaHuman 的新方法。該功能允許創作人員將自己或其他藝術家創造的現有模型(如角色、生物、機械等)轉換為MetaHuman 數字人物,從而在更短的時間內創建更多的數字人物。利用該技術,可以克服MetaHuman 創作者的缺點,突破變形限制,更自由地生成網格。Mesh to MetaHuman 通過在虛幻引擎5 中啟用Meta-Human 插件并通過Quixel Bridge 導入MetaHuman 來實現連接。最重要的部分是Mesh Morpher 算法,可以將多邊形信息應用于現有的面部特征網格數據,從而通過該算法給予變化,以便輕松快速地獲得效率更高的面部制作,脫離原有的框架。利用這項技術對面部細節進行微調,以達到更高的逼真度。Morpher 算法在MetaHuman Creator 中被廣泛使用,可以幫助數字人物表現出豐富的情感和表情,使其更加生動。

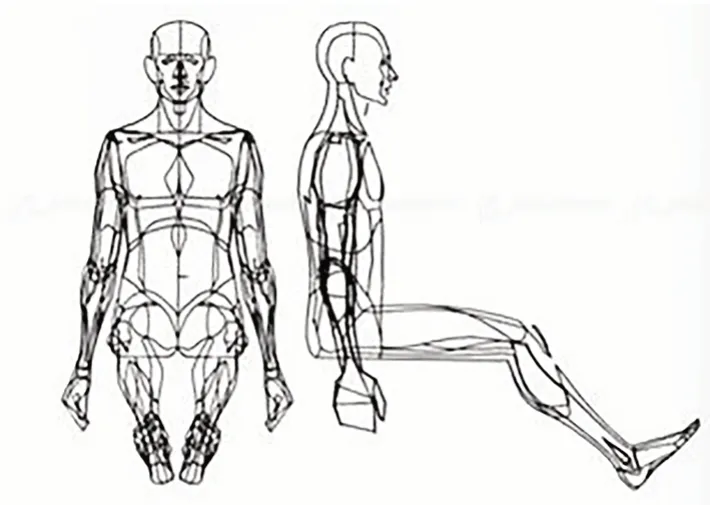

2.3 項目案例中Mesh to MetaHuman 技術應用

在MetaHuman 中,將3D 角色模型網格導入到項目中。模型網格可以是已有的模型素材,也可以是掃描現實中的對象,生成glTF、FBX 或OBJ 等幾種格式為基本模型。筆者在項目實驗應用中結合手機App 寶麗來軟件工具進行現實人的掃描,按照螺旋運動軌跡掃描錄制完整的人物面部,并進行解算。然后生成glTF 格式文件導入到三維軟件中,將掃描過程中錯誤和不需要的多邊形面進行刪除。新建并打開UE5 中的插件MetaHuman 本體,將模型導入,選擇中立姿勢(Neutral Pose),進行提升幀數操作。下一步進行追蹤活動幀,此時將完成對角色模型眼睛、法令紋和嘴部的跟蹤。之后,進行MetaHuman 的本體解算,生成MetaHuman 的網格模型。最后,選擇創建身體部分,并選擇網格體轉為MetaHuman 命令,完成MetaHuman 網格模型的創建,該結果上傳到Bridge中的賬號中(圖4)。

圖4 將掃描完成的模型進行修改調整后進行臉部的模型追蹤活動幀的操作

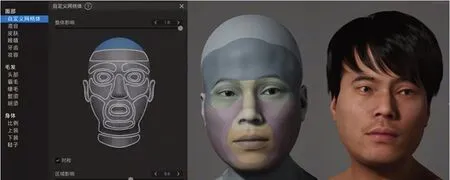

下面通過Bridge 中的MetaHuman,對模型進行導入,在自定義網格體中對面部各結構的區域形體(包括皮膚、牙齒、眼睛、毛發以及身體等部位)進行調節(圖5)。

圖5 自定義網格體和角色模型各部分調節

對角色頭部的局部調節,可以在混合模式下通過添加3~6 個角色模型區進行面部特征細微調整。根據角色面部特征進行調節,即將這幾個添加的預制角色特征去做插值。此外,可以對角色的身體動作和面部表情動畫進行設置,MetaHuman 提供了各種姿勢和動作,包括行走、跑步、跳躍等。在面部表情方面,可以通過選擇設置實現不同的表情動畫(圖6)。

圖6 混合模式下對模型面部的局部調整并添加表情動畫

2.4 虛擬數字人中的動作捕捉技術

動作捕捉技術已經發展了很長時間,自20 世紀70 年代,動作捕捉技術開始應用于醫療和軍事領域;到了80 年代,其應用逐漸蔓延至CGI 產業,開始被人們所熟知,一直活躍至今,目前主要應用于電影,并廣泛用于動畫和游戲中[9]。隨著科技的發展,動作捕捉技術不斷更新,從最初的磁感應式方法發展到基于慣性傳感器和光學式方法等更加先進的技術,實現了更加精確和逼真的動作捕捉。如今,人工智能技術的應用讓動作捕捉技術更加智能化和高效化。比如,基于深度學習和計算機視覺技術的人體姿態估計算法可以通過對攝影場景中的人體姿態和動作進行分析和識別,從而實時估計和預測出未被捕捉到的部分,如手臂、腿部等遮蔽或未被捕捉到的部位,從而實現更加完整和準確的動作捕捉。

主要應用于電影或游戲等領域的光學式動作捕捉技術可以實時拍攝目標的動作,無需受到限制,并且可以應用于非人類生物,具有強大的優勢,但需要額外的空間安裝相機,并且只能在相應空間內進行捕捉。該技術最大的缺點是成本,根據制造商的不同,引進成本不同,對于中小型工作室來說,使用該類設備的成本是很大的負擔。此外,由于相機必須照射標記,因此根據演員的動作,相機陰影區域的產生可能會導致數據丟失。

為了彌補這些缺點,可以使用傳感器式的動作捕捉工具Rokoko。Rokoko 是將傳感器添加到套裝面料之內,內置共19個傳感器,每個傳感器內都有陀螺儀、羅盤儀和加速計。通過套裝將運動數據記錄在本地或者通過Wi-Fi 將數據傳輸到本地網絡。Rokoko 與實時3D 角色動畫軟件Rokoko Studio 相結合使用,最具特色的部分是雖然能夠進行面部捕捉、動作捕捉和手部捕捉,但其價格相對便宜,而且可以實時進行互動和錄制。通常進行動作捕捉時需要寬敞的空間和沒有反射的物體,但Rokoko 通過安裝在套裝上的傳感器進行捕捉,擁有比傳統動畫工作流更直觀的界面,并可以在成本方面大大節省,是一種有效的動作捕捉工具。利用Rokoko 拍攝的動作捕捉數據可以使用虛幻引擎的動畫重定向技術。動畫重定向允許不同比例的角色共享相同的骨架資產,以便重用動畫。加載從動作捕捉中獲得的動畫數據,然后輕松地使用它們而無需進行精細的修改。在重定位之前,不同形狀的角色具有不同的骨骼,因此在應用相同動作時形狀會崩潰。但是通過動畫重定位,動畫以角色的骨盆和關節為中心重新設置以適應骨骼(圖7)。

圖7 通過虛幻引擎5對動畫重新定位

2.5 逼真的面部表情技術:Live Link Face 面部識別技術

面部表情技術的發展讓數字虛擬角色的神情更加生動且充滿活力。傳統的面部表情捕捉設備一般需要佩戴專用頭盔和捕捉套件,便捷性較差[10]。本次測試中面部捕捉思路則是以手機攝像頭拍攝采集為基礎,實現面部數據捕捉。以Live Link Face 應用為例,Live Link Face 軟件可以將用攝像頭捕捉到的人臉動作和表情實時傳輸到三維虛擬角色上,從而實現人臉捕捉和動畫制作。它廣泛用于電影、電視、游戲和虛擬現實等領域。Live Link Face 軟件可以與虛幻引擎和iOS 設備一起使用,用戶可以使用手機的前置攝像頭捕捉面部表情和動作,并將這些數據傳輸到虛幻引擎中,然后應用到虛擬角色上,實現高度逼真的面部動畫效果。此外,Live Link Face 還支持實時流媒體,用戶可以將捕捉到的面部動畫實時傳輸到其他設備或平臺上,以便遠程協作和實時表演。這種技術在電影、電視、游戲和虛擬現實等領域有著廣泛的應用。

隨著虛幻引擎5.0 的發布,Live Link Face 變得更加先進,可以精細和準確地實現面部表情。由于面部跟蹤數據包括頭部和頸部旋轉數據,因此即使沒有運動作捕捉套裝或頭戴式設備,也可以自由地創建數字化角色的動作。由于不需要額外的工具,無論是個人藝術家還是專業公司,都可以在所有拍攝現場捕捉高質量的面部動畫。

在測試應用中,Live Link Face 軟件需要配備具有TrueDepth 原深感前置攝像頭的iPhone 手機和ARKit 技術,可以對表演者的面部進行Z 軸深度檢測和交互追蹤,并通過虛幻引擎內置的Live Link 接收功能直接將該數據從手機發送到電腦端的虛幻引擎中。此外,通過Live Link Face 中打開流送頭像旋轉命令可對頭部轉動進行跟蹤。通過這種方式,用戶可以更加方便地實現高度逼真的面部表情動畫效果,從而提高制作效率和質量(圖8)。

圖8 使用MetaHuman 和Live Link Face 的面部捕捉設置

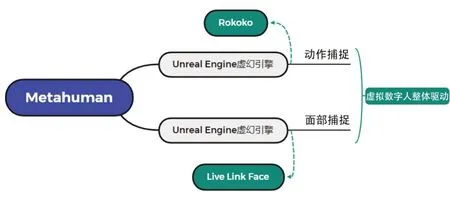

通過以上簡易動作捕捉的其中一種方法的制作流程示例,使用一部手機和相對廉價的傳感器動作捕捉工具Rokoko,能夠實現讓肢體動作捕捉和面部表情跟蹤捕捉同時進行,完成高效率、便捷化的數字虛擬形象整體交互動作驅動(圖9)。

圖9 MetaHuman 虛擬數字人應用整體驅動實現流程示意圖

3 人工智能技術對虛擬數字人未來發展的影響

3.1 人工智能技術將賦予虛擬數字人思維的大腦

人工智能(AI)時代,媒體行業被徹底重構和顛覆。大數據和人工智能技術已經進入媒體行業的每一個環節,并對新聞內容的制作、分發以及觀眾的互動交流等進行了全面重建。隨著ChatGPT 等大語言模型的進步通過未來將強大的自然語言處理(NLP)能力應用于虛擬數字人領域,將為虛擬數字人賦予一定程度具備思維能力的大腦。使其能更加智能地與人類進行交流和互動,并進一步提升了虛擬數字人的逼真性和人性化。ChatGPT 對虛擬人技術發展的潛力在媒體、娛樂和其他領域的應用都有著廣闊的前景。

(1)虛擬數字人與ChatGPT 類大語言模型技術的結合,可以更準確地理解用戶的情感狀態,并以適當方式進行情感和情緒的表達,這將增強用戶與數字虛擬人之間的感情連接,從而提升用戶體驗。此外,ChatGPT 類大語言模型技術可以通過深度學習和大量數據訓練,獲得更豐富的語言知識和理解能力。這也使它能夠生成具有邏輯性和連貫性的回答,從而提供更加真實和流暢的體驗,進一步推動虛擬數字人在其應用領域的拓展。

(2)ChatGPT 類大語言模型技術可用于多種平臺和設備,包括智能手機、智能音響和虛擬現實設備等。虛擬數字人可以脫離物理的軀殼,通過與Chat-GPT 類大語言模型技術的結合,實現虛擬數字人在不同平臺上的統一性和連續性。用戶可以在不同設備上與虛擬數字人進行交互,感受智能化的服務和體驗。例如,總部位于新西蘭的Soul Machines 公司專注于虛擬數字人技術和人工智能交互解決方案。他們的目標是通過創造高度逼真、情感豐富和可交互的虛擬數字人來提供更具人性化和智能化的用戶體驗。他們開發了一種名為“Digital DNA”的技術,該技術結合了虛擬數字人和GPT 的能力,是一種基于人工智能和生物學原理的技術,旨在模擬和復制人的情感和互動方式。通過深度學習和神經網絡算法,將人類的語音、面部表情、身體動作等特征進行模擬仿真,從而創造出逼真的虛擬數字人。該技術的發展有望為各個行業帶來革命性的變革。

3.2 個性化定制和精準推薦

通過對用戶的語言交互和行為數據進行分析,虛擬數字人可以深入了解用戶的喜好和需求。基于這些信息,虛擬數字人可以向用戶提供個性化的推薦內容,如新聞、音樂、電影等,以滿足用戶的個性化興趣和需求。首先,通過對用戶的語言交互進行分析,虛擬數字人可以了解用戶的喜好和習慣。通過分析用戶的提問、回答和表達,從中提取關鍵詞和意圖,進而推斷用戶對不同話題的喜好和偏好,從而為用戶提供個性化的服務。其次,通過對用戶的行為數據分析,虛擬數字人可以了解用戶的使用習慣和消費偏好,根據用戶的行為數據向其推薦類似的內容,以滿足個性化需求。通過與用戶建立長期互動,從而建立起對用戶的個性化認識,并為其量身定制服務,這種個性化定制和精準推薦的能力將進一步提高用戶對虛擬數字人的依賴和信任。同時,也能夠增強用戶與虛擬數字人之間的情感聯結,從而推動虛擬數字人技術在各個領域的應用。

4 結論

虛擬數字人交互體驗是否滿意主要涉及到人物形象設計、肢體動作以及語音交互等方面。首先,人物形象設置至關重要,通過使用先進技術如MetaHuman 可以快速而準確地創建出高度逼真和個性化的角色。其次,動作捕捉技術和面部識別技術可以實現虛擬數字人自然、流暢和逼真的肢體動作和情感表達;通過高度準確的驅動技術可以使虛擬數字人的動作和用戶指令實時同步,并展現出豐富的情感和肢體語言。最后,語音交互也是影響虛擬數字人交互體驗的重要因素。具有個性化人類思想的語音交互技術可以增強虛擬數字人與用戶之間的親切感和溝通效果。預先錄制的傳統語音交互技術往往具有機械和生硬感,難以滿足用戶個性化的需求。隨著人工智能技術發展,個性化語音技術為虛擬數字人的交互體驗帶來許多優勢,為用戶提供更溫暖、個性化的交互體驗。這種情感化的交互使得虛擬數字人在各個領域的應用更具吸引力和實用性。

綜上所述,人工智能技術的發展必將對虛擬數字人技術產生深遠影響。虛擬數字人通過與Chat-GPT 類大語言模型技術等智能技術的結合,實現了思維的賦能、情感識別和表達的增強。這些進步將推動虛擬數字人技術在教育、娛樂、客戶服務領域的廣泛應用,并為用戶提供更加智能、個性化和沉浸式的交互體驗。隨著元宇宙概念的興起和發展,虛擬數字人將在虛擬現實、增強現實和在線社交等場景中發揮重要作用。虛擬數字人的應用潛力是巨大的,它可以是模擬當下現實世界中存在的人物形象,也可以創建歷史上公眾記憶中已故的人物形象,通過結合模擬語音和人工智能思維,將為用戶提供豐富多樣的體驗和服務。然而,我們也應該發現虛擬數字人的應用也面臨著一些挑戰和問題,例如,如何保護虛擬數字人的知識產權和個人隱私,如何處理虛擬數字人與現實人的交互界限等都是需要考慮的問題。總而言之,虛擬數字人在未來有著巨大的發展潛力,我們可以通過逐步建立倫理、法律和社會規范,推動虛擬數字人的可持續發展,使其能在數字藝術、娛樂和其他領域中發揮積極的作用。