基于改進DeepLabv3+的火龍果園視覺導航路徑識別方法

周學成 肖明瑋 梁英凱 商楓楠 陳 橋 羅陳迪

(1.華南農(nóng)業(yè)大學工程學院,廣州 510642; 2.南方農(nóng)業(yè)機械與裝備關鍵技術教育部重點實驗室,廣州 510642)

0 引言

水果產(chǎn)業(yè)已成為我國繼糧食和蔬菜之后的第3大農(nóng)業(yè)種植產(chǎn)業(yè),我國水果種植面積和產(chǎn)量常年穩(wěn)居世界首位[1]。盡管我國水果產(chǎn)業(yè)已經(jīng)逐步實現(xiàn)規(guī)模化種植,但是機械化采摘程度依然較低,大多仍以人工采摘為主,和發(fā)達國家相比存在明顯差距。由于果園環(huán)境多為半結構化環(huán)境,大型機械作業(yè)受限,限制了果園機械智能化的發(fā)展[2]。因此我國迫切需要提高果園機械化、智能化水平,提高生產(chǎn)效率[3]。視覺導航作為果園機械提升智能化水平的關鍵技術之一,具有成本低、信息豐富等特點,適用于不規(guī)則地塊[4]。而且有效彌補了果園因樹葉遮擋、衛(wèi)星信號弱而無法進行導航的情況[5]。能夠實時準確地識別導航路徑是當前國內外學者研究的重點。

目前在果園環(huán)境下的導航路徑識別研究中,研究人員通常將果樹樹干或者作物行作為獲取導航信息的參照物,利用參照物具有的顏色、形態(tài)和紋理特征運用傳統(tǒng)的圖像處理技術提取出導航路徑。目前已有針對蘋果園[6]、黃瓜園[7]、橙園[8]、枸杞園[9]、桃園[10]等環(huán)境的視覺導航研究。但是,在設施農(nóng)業(yè)、果園等復雜環(huán)境中,圖像處理算法易受光照、陰影的影響[11]。而且果園道路屬于非結構化道路,無明顯道路邊界線,傳統(tǒng)圖像處理算法不能完全適用。

近年來隨著深度學習技術的不斷發(fā)展,許多研究人員將深度學習技術應用在導航路徑的識別研究中[12-15],與傳統(tǒng)的語義分割方法相比,基于深度學習的語義分割方法能獲取更多、更高級的語義信息來表達圖像中的信息[16]。SONG等[17]利用全卷積網(wǎng)絡(FCN)對小麥、地面和背景進行語義分割,進而擬合出導航路徑。KIM等[18]提出了一種半結構化環(huán)境自主路徑檢測方法實現(xiàn)路徑區(qū)域分割。YANG等[19]提出了一種基于神經(jīng)網(wǎng)絡和像素掃描的可視化導航路徑提取方法。韓振浩等[20]提出了一種基于U-Net網(wǎng)絡的果園視覺導航路徑識別方法。

以上基于深度學習算法的導航路徑識別研究為本研究提供了借鑒。然而在火龍果園導航路徑檢測識別任務中,果園道路存在的雜草以及掉落的枝條,使得道路的邊界信息模糊,增加了導航路徑的識別難度。而且大多數(shù)研究較少關注模型的部署問題,所提出的網(wǎng)絡結構較為復雜,使得模型的參數(shù)量大,不利于部署至硬件條件有限的果園視覺導航系統(tǒng)。為此,針對視覺導航應用在果園環(huán)境中面臨干擾因素多、圖像背景復雜、復雜模型難以部署等問題,本文以火龍果園的自然環(huán)境為研究對象,提出一種基于改進DeepLabv3+網(wǎng)絡的果園視覺導航路徑識別方法。本研究選擇輕量化的MobileNetV2替換原網(wǎng)絡中的主干特征提取網(wǎng)絡,并將空間金字塔池化模塊(Atrous spatial pyramid pooling,ASPP)中的空洞卷積替換成深度可分離卷積(Depthwise separable convolution,DSC),以降低模型的復雜度。為了提高模型對道路特征的提取能力,考慮在特征提取模塊處引入坐標注意力機制(Coordinate attention,CA);最后利用網(wǎng)絡模型生成的道路掩碼,得到道路的邊界信息并通過最小二乘法擬合道路邊界,再運用角平分線算法擬合出導航路徑。

1 材料與方法

1.1 圖像數(shù)據(jù)獲取

本研究所需的果園圖像數(shù)據(jù)于2022年7月采自廣州市番禺區(qū)火龍果種植園。拍攝設備為英特爾公司生產(chǎn)的D435i深度相機,圖像數(shù)據(jù)通過USB接口傳輸并保存在計算機內,自動曝光;圖像分辨率為1 920像素×1 080像素,以PNG格式存儲,圖像采集幀率為30 f/s。數(shù)據(jù)采集時將深度相機固定在相機支架上,向下傾斜10°,拍攝方向為道路正前方。根據(jù)研究目標,本文只對果園壟間道路進行圖像數(shù)據(jù)采集,不包括果園地頭以及果樹行間。為了提高樣本的多樣性,分別在不同道路條件下共采集原始圖像456幅,如圖1所示。

圖1 火龍果園道路圖像示例

1.2 果園道路數(shù)據(jù)集制作

通過相機直接獲取的原始圖像分辨率較高,在訓練時會占用過多顯存,降低訓練速度,同時圖像沒有語義標簽,需要預先進行標注,才能傳入神經(jīng)網(wǎng)絡進行訓練。為了減少模型訓練時間,將456幅原始圖像尺寸等比例縮放為960像素×540像素,再使用像素級標注工具Lableme進行語義標注,標注后的文件以.json格式存儲。針對現(xiàn)場采集的數(shù)據(jù)樣本量不足,本文通過幾何變換(平移、旋轉)與顏色變換(對比度、亮度)進行數(shù)據(jù)增強。增強后的圖像共1 074幅,按照8∶1∶1比例劃分為訓練集、驗證集和測試集。訓練集用于訓練深度網(wǎng)絡模型參數(shù)權重;驗證集用于訓練過程中對模型參數(shù)進行調優(yōu);測試集用于評估最終模型的泛化能力。

2 果園道路場景語義分割

2.1 改進的DeepLabv3+語義分割算法

DeepLabv3+網(wǎng)絡被稱為語義分割網(wǎng)絡的新高峰,但也存在不足。首先,為了追求分割精度,選擇了網(wǎng)絡層數(shù)較多、參數(shù)量大的Xception作為特征提取網(wǎng)絡,同時ASPP模塊中采用空洞卷積,使得模型參數(shù)量增加,提高了模型的復雜度;另外,這些特點也對硬件提出了更高要求[21]。為了使得移動機器人能夠實時準確地識別果園道路,確保該網(wǎng)絡模型能夠部署在嵌入式設備上,本文針對上述問題對傳統(tǒng)的DeepLabv3+網(wǎng)絡進行了如下改進:首先,為了減小參數(shù)計算量并降低模型的復雜度,將DeepLabv3+模型中原本用于主干特征提取的Xception網(wǎng)絡更換成更為輕量級的MobileNetV2。為了增強模型學習特征的表達能力,在主干提取網(wǎng)絡輸出的高層特征層處添加CA模塊。為了提高模型的檢測速率,減小內存占用量,將ASPP模塊中的空洞卷積替換成深度可分離卷積。改進后的網(wǎng)絡結構如圖2所示。

2.2 輕量化特征提取模塊

傳統(tǒng)的卷積神經(jīng)網(wǎng)絡通過擴充網(wǎng)絡深度和廣度,提高網(wǎng)絡模型準確性,但也存在復雜度高、運行速度慢等問題。MobileNetV2是由谷歌團隊在2018年提出的高性能輕量化的卷積神經(jīng)網(wǎng)絡,相對于MobileNetV1而言準確率更高,模型更小[22]。MobileNetV2采用一種具有線性瓶頸的殘差結構,該模塊將輸入的低維壓縮表示首先擴展到高維并用輕量級深度卷積進行過濾。隨后用線性卷積將特征投影回低維表示。最后采用跨連接層將輸入特征與輸出特征相加,從而增加網(wǎng)絡的實時性和準確性。為了讓MobileNetV2模塊能夠適用于語義分割,本文對該網(wǎng)絡結構做了如下修改:將第1部分用于提取特征的3×3卷積塊以及包含多個深度可分離卷積的中間部分保留,把包含全局平均池化層與特征分類層的第3部分去掉。

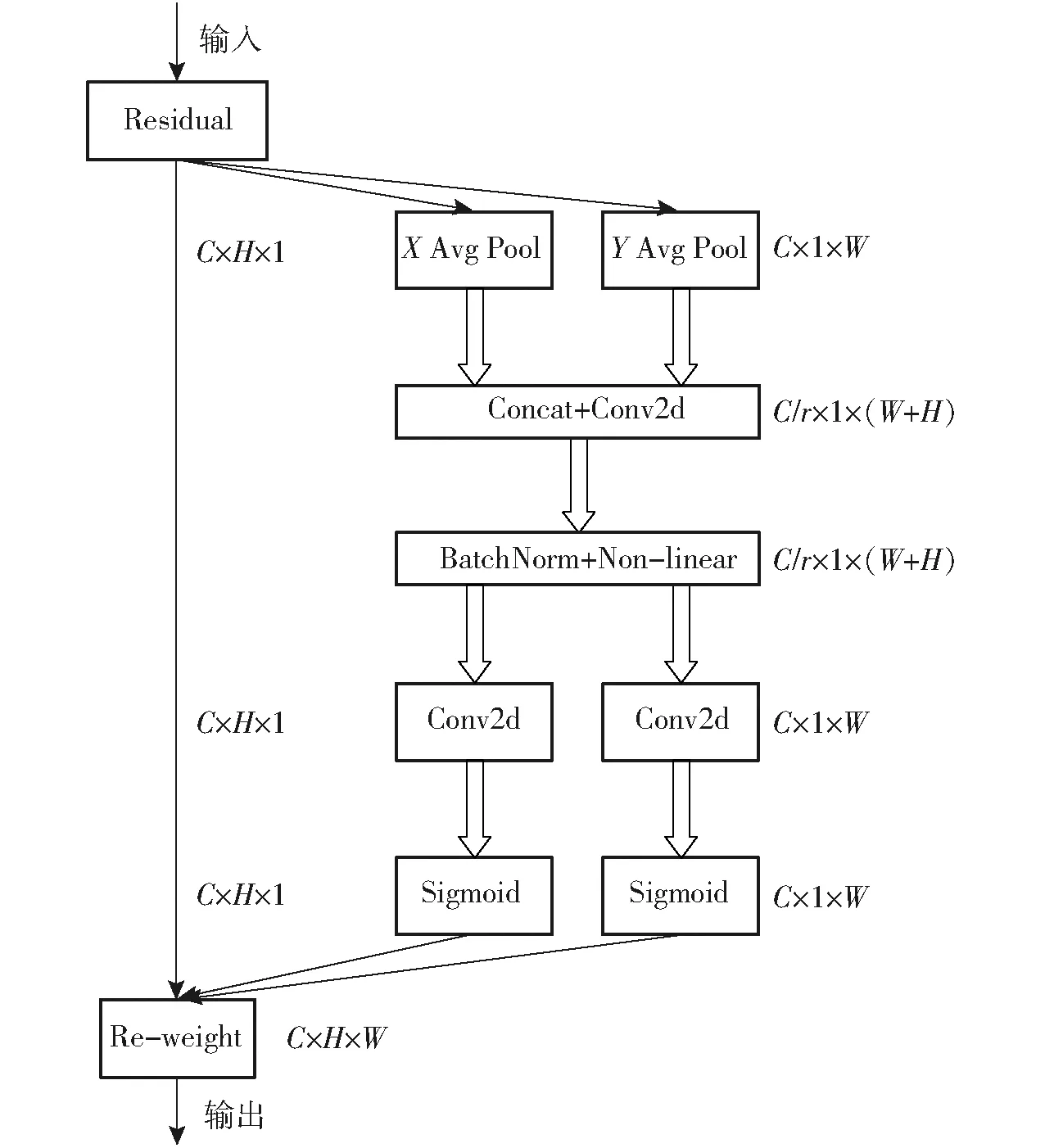

2.3 CA模塊

注意力機制常用來告訴模型需要更關注哪些內容和哪些位置,已經(jīng)被廣泛使用在深度神經(jīng)網(wǎng)絡中來加強模型的性能。HOU等[23]為輕量級網(wǎng)絡設計提出了新的注意力機制,該機制將位置信息嵌入到了通道注意力中,稱為坐標注意力機制(Coordinate attention,CA)。

不同于通道注意力將輸入通過2維全局池化轉化為單個特征向量,CA將通道注意力分解為兩個沿著不同方向聚合特征的1維特征編碼過程。這樣,可以沿一個空間方向捕獲遠程依賴關系,同時可以沿另一空間方向保留精確的位置信息。然后,將生成的特征圖分別編碼,將其互補地應用于輸入特征圖,以增強關注對象的表示。該模塊的結構如圖3所示,圖中C表示通道數(shù),H表示特征圖高度,W表示特征圖寬度。

圖3 坐標注意力機制結構圖

2.4 網(wǎng)絡損失函數(shù)

損失函數(shù)是一種用來度量模型預測值與真實值之間差異程度的函數(shù),損失函數(shù)的值越小,模型的魯棒性就越好。為了解決處理前景和背景體素數(shù)量之間存在嚴重不平衡的問題,MILLETARI等[24]提出了DiceLoss。本文將其作為損失函數(shù),其表達式為

(1)

式中LDice——損失函數(shù)Dice——損失系數(shù)

X——真實分割圖像的像素類別

Y——模型預測分割圖像的像素類別

|X∩Y|——X和Y的點乘結果之和

|X|——X對應圖像中的像素之和

|Y|——Y對應圖像中的像素之和

3 導航路徑擬合

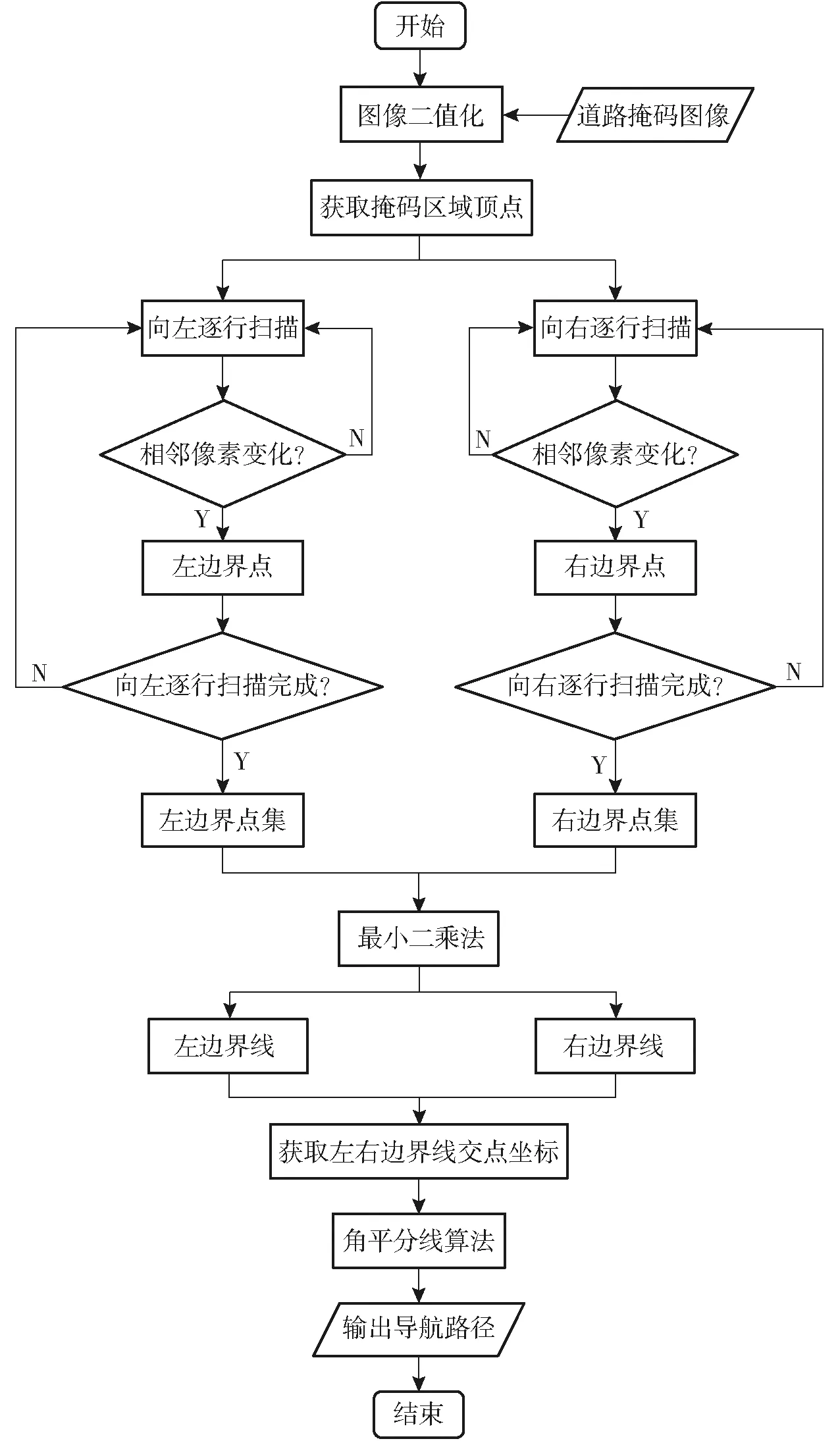

本文研究所涉火龍果園采用較為規(guī)范化的種植模式,果園道路較為平直,采摘機器人可將道路中線作為導航路徑。常用的直線擬合算法包括霍夫變換、隨機采樣一致性、最小二乘法等[25]。果園道路非結構化,道路邊緣信息不規(guī)則,為此本文利用網(wǎng)絡模型生成的道路掩碼,提出一種基于道路邊界擬合的角平分線提取導航路徑算法。通過逐行掃描提取道路左右邊緣信息點,再根據(jù)邊緣信息點用最小二乘法擬合出道路左右邊界線,最后利用角平分線算法擬合導航路徑。具體流程如圖4所示。

圖4 導航路徑擬合流程圖

3.1 道路邊緣信息提取

首先對模型生成的道路掩碼區(qū)域二值化,使得掩碼區(qū)域像素值為255,背景區(qū)域像素為0。道路掩碼區(qū)域可以近似看成上底邊有凸起的梯形區(qū)域,如圖5所示。為了提取道路的邊緣信息,首先需要確定掩碼區(qū)域的頂點。逐行掃描像素,以掩碼區(qū)域圖像的前景首行像素的所有像素的中點位置為頂點,并記錄下此時頂點的坐標(W,H)。其次以頂點的橫坐標W當作逐行掃描的分界線,以分界線為基準,分別向左、向右掃描。如果向左掃描時某個像素點的相鄰兩列像素值不同,則該點記為左邊界點。同理向右掃描時,如果某個像素點的相鄰兩列像素值不同,則記為右邊界點,直到整幅圖像像素遍歷完畢。

圖5 圖像分割結果

3.2 基于角平分線算法擬合導航路徑

根據(jù)得到的道路邊緣信息,用最小二乘法擬合出道路邊界。但根據(jù)果園導航的需求,如果選擇道路邊線當作導航路徑會造成較大的導航偏差,而且也不利于采摘,為了提高導航路徑的精度,本研究將道路左右邊界線的角平分線當成導航路徑。圖像坐標系中道路左右邊界直線分別為mL和mR,假設mL和mR直線方程分別為

yL=kLx+bL

(2)

yR=kRx+bR

(3)

式中yL、yR——道路左邊界和右邊界對應點的縱坐標值

kL、kR——道路左、右邊界直線方程斜率

bL、bR——道路左、右邊界直線方程截距

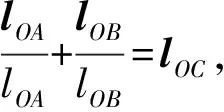

為了得到正確的導航線斜率,本文利用向量來求解。假設左右邊界線的交點記為點O(x0,y0),隨機在左右邊界線上分別取兩個點,記為點A(xa,ya)和B(xb,yb),則有

lOA=(xa-x0,ya-y0)

(4)

lOB=(xb-x0,yb-y0)

(5)

考慮將lOA和lOB歸一化,需要求出2個向量的模長,根據(jù)模長公式則有

(6)

(7)

(8)

(9)

b=y0-k

(10)

從而得到導航基準線方程為

y=k(x-x0)+y0

(11)

3.3 導航路徑精度測試方法

本文通過人工方法來擬合果園實際導航路徑。首先通過卷尺測量同一行左右兩棵果株間的距離,然后在中點位置做好標記,接著利用白色尼龍繩將測得的中點位置依次連接。為了使得實際導航路徑更加精確,用釘子將尼龍繩加以固定。本文從像素誤差、實際距離兩個參數(shù)指標來評價擬合導航路徑的精度。將相機支架放置在道路中間,拍攝角度和采集圖像時一致,從道路盡頭開始,從擬合導航路徑上以70像素為間距等距選取10個關鍵點,利用D435i制造商提供的SDK來計算每幅圖像上10個關鍵點與分別對應具有相同縱坐標的實際導航路徑上10個點之間的像素誤差和實際距離。像素誤差的計算公式為

epix=|Xfit-Xreal|

(12)

式中epix——像素誤差

Xfit——擬合導航路徑上關鍵點的像素橫坐標

Xreal——實際導航路徑上關鍵點的像素橫坐標

為了將圖像中的像素誤差轉換為火龍果園中的實際距離,根據(jù)針孔成像模型分別將擬合導航路徑以及實際導航路徑上關鍵點的像素坐標轉換成相機坐標,通過計算兩點的歐氏距離得到實際距離。相機的內外參數(shù)以及畸變參數(shù)已標定,坐標轉換公式為

(13)

其中

(14)

(15)

式中 (u,v)——像素坐標

fx、fy、u0、v0——相機內參

(xcorrected,ycorrected)——歸一化平面糾正坐標

k1、k2、p1、p2——相機畸變參數(shù)

r——歸一化平面極徑

(X,Y,Z)——相機坐標系坐標

(x,y)——歸一化平面直角坐標

4 結果與分析

為了驗證基于改進DeepLabv3+的火龍果園導航路徑識別算法以及基于角平分線算法擬合導航路徑的準確性、穩(wěn)定性和魯棒性,分別進行了果園道路分割和導航路徑提取實驗。

4.1 果園道路分割

4.1.1實驗平臺

本研究所使用的訓練平臺為配備Windows 10 64位操作系統(tǒng)的臺式圖形工作站,其中CPU為Intel i9 10900X@3.75 GHz,GPU為NVIDIA GeForce GTX3090,RAM為128 GB,軟件環(huán)境為PyTorch 1.7.1,CUDA 11.1,以及CUDNN 8.0.2。

4.1.2訓練參數(shù)設置

訓練前,將數(shù)據(jù)集中的1 074幅圖像按照8∶1∶1隨機劃分為訓練集、驗證集和測試集,訓練集有860幅圖像,驗證集和測試集分別有107幅圖像。DeepLabv3+模型在批量大小為16、初始學習率為0.007時,在Pacal VOC 2012和Cityscapes數(shù)據(jù)集上取得了良好的分割效果[26]。本研究將其作為模型訓練超參數(shù),同時根據(jù)經(jīng)驗,優(yōu)化方法選擇隨機梯度下降優(yōu)化器(SGD),優(yōu)化器動量設置為0.9,權重衰減設置成0.000 1,采用余弦退火的學習率下降方式。為了提高模型精度,使用Pytorch官方提供的MobileNetV2預訓練權重。由于本文需求是分割道路和背景,故將分類個數(shù)設置成2,并訓練300個周期。

4.1.3評價指標

本文采用平均像素準確率(Mean pixel accuracy,MPA)、平均交并比(Mean intersection over union,MIoU)、檢測速率(Frames per second,FPS)、模型內存占用量、參數(shù)量(Params)作為語義分割算法性能評價指標。假設總共有k+1個類,令Pij表示第i類被預測為第j類的像素數(shù)量,則Pii表示預測準確的像素數(shù)量。

4.1.4改進前后網(wǎng)絡模型訓練結果對比

改進前后的DeepLabv3+網(wǎng)絡的訓練過程如圖6所示。根據(jù)圖6可知,隨迭代次數(shù)增加,二者的訓練集損失值呈減少趨勢,而且隨著迭代次數(shù)逐漸增加,MIoU越來越高。當?shù)螖?shù)到達100次時,二者的損失值和精度均趨于穩(wěn)定。但是與傳統(tǒng)DeepLabv3+網(wǎng)絡比較,改進后的DeepLabv3+網(wǎng)絡的收斂速度更快,精度也更高。

圖6 改進前后網(wǎng)絡模型訓練結果

4.1.5模型有效性驗證

為了驗證在傳統(tǒng)DeepLabv3+網(wǎng)絡中添加CA注意力機制模塊的有效性,從測試集中選取了一幅道路條件較為復雜的圖像進行驗證,如圖7所示。原始圖像的右下方區(qū)域包含較多的雜草,同時由于受到光照的影響,路面上存在周邊果株的投影區(qū)域。對比圖中綠色橢圓區(qū)域分割結果發(fā)現(xiàn),傳統(tǒng)DeepLabv3+網(wǎng)絡模型丟失了部分道路邊緣信息,而且未能分割出道路存在雜草覆蓋的區(qū)域。而添加CA模塊后的DeepLabv3+網(wǎng)絡模型對道路邊緣信息提取更完整,能準確分割出覆蓋雜草的道路,說明添加CA模塊后提高了網(wǎng)絡模型的特征提取能力。

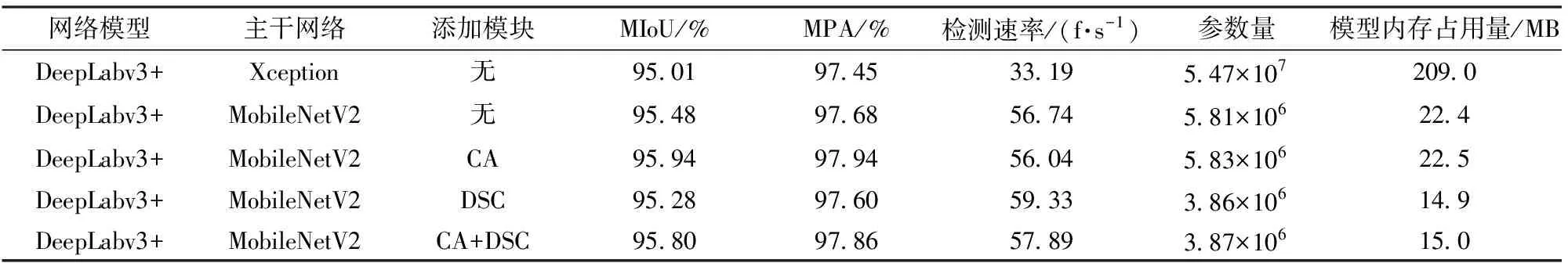

為了驗證將傳統(tǒng)DeepLabv3+網(wǎng)絡中的主干特征提取網(wǎng)絡由Xception更換為輕量級的MobileNetV2的有效性,以及驗證添加注意力機制模塊CA、替換ASPP模塊中的空洞卷積為深度可分離卷積對分割結果的影響,本文根據(jù)語義分割評價指

標,設置4組不同的改進方案進行消融實驗,實驗結果如表1所示。

表1 消融實驗結果

根據(jù)表1可得,將DeepLabv3+的主干網(wǎng)絡由Xception換成MobileNetV2后檢測速率提升23.55 f/s,而且極大減小了參數(shù)量以及模型內存占用量,參數(shù)量和模型內存占用量僅為原來的1/9。其次,主干網(wǎng)絡為MobileNetV2的基礎上添加CA模塊后,MIoU以及MPA分別提升0.46、0.26個百分點,表明CA模塊可以在一定程度上提高模型分割精度。另外,將APSS模塊中的空洞卷積換成DSC時,相比原來的訓練結果MIoU和MPA有略微下降,分別降低0.20、0.08個百分點,但是參數(shù)量和模型內存占用量分別減小33.70%、33.50%,表明DSC可以有效降低模型復雜度。最后,本文提出的改進DeepLabv3+網(wǎng)絡模型的訓練結果和原模型相比,無論是分割精度還是檢測速率都有明顯提升,更重要的是改進后的網(wǎng)絡模型的參數(shù)量和模型內存占用量僅相當于原來的1/14。因此改進DeepLabv3+模型可以更好適用于果園道路的檢測,而且也便于在嵌入式設備和移動設備上部署。圖8為改進網(wǎng)絡在不同環(huán)境條件下果園道路場景分割效果圖。

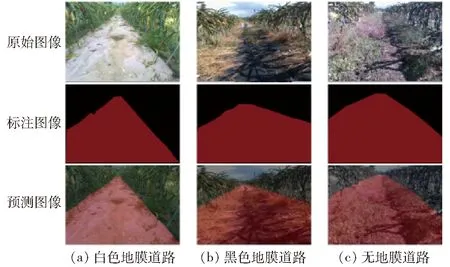

圖8 不同環(huán)境條件下果園道路場景分割結果

從圖8可以看出,白色地膜道路圖像中的道路區(qū)域被有效分割,分割結果沒有受到地面散落枝條的影響;黑色地膜道路圖像中,路面不但覆蓋雜亂無章的雜草,而且由于光照的影響,路面上還存在周邊果株的投影區(qū)域,但分割結果并沒有受到復雜路面環(huán)境的影響,道路分割完整,同時道路盡頭的白色地膜道路沒有被錯誤分割為背景,而是和黑色地膜區(qū)域一塊識別為道路區(qū)域,說明模型具有良好的抗干擾性;在無地膜道路圖像中,道路無明顯邊界,而且無地膜道路的雜草較為密集,同時沙土路面潮濕且不平整,加上光照的影響,這些復雜環(huán)境因素會對分割結果造成干擾,但根據(jù)模型的預測結果,道路邊緣信息完整,道路的左右邊界連續(xù)且對稱分布,分割效果精細,說明模型具有較高的魯棒性。

4.1.6不同模型性能對比

為了進一步分析改進DeepLabv3+模型的分割性能,選擇分割精度較高的Pspnet、U-net與本文模型進行對比,以上網(wǎng)絡模型均利用果園道路數(shù)據(jù)集進行訓練,訓練結果如表2所示。

表2 不同網(wǎng)絡模型性能對比

由表2可以看出,本文模型和Pspnet相比,無論是在分割精度還是檢測速率都優(yōu)于后者,其中MIoU和MPA分別提高0.49、0.25個百分點,另外檢測速率提高11.7 f/s,參數(shù)量和模型內存占用量減小91%。另外本文模型相較于U-net,盡管在分割精度上略低于后者,但是在檢測速率、參數(shù)量和模型內存占用量方面都顯著優(yōu)于U-net,其中檢測速率提升20.58 f/s,參數(shù)量和模型內存占用量分別減小4.003×107和152.0 MB,相比U-net,本文模型更加適合部署至嵌入式設備,而且保證了模型具有較高的分割精度的同時也更加輕量化。

4.2 導航路徑提取

選擇白色地膜道路、黑色地膜道路、無地膜道路3種不同的道路環(huán)境來驗證本文設計的導航路徑提取算法精度。導航路徑識別結果如圖9所示(上圖為原始圖像,下圖為結果圖像)。從圖9中可以看出,本文方法能夠完整提取道路兩側的邊緣信息,而且通過最小二乘法擬合出道路邊界線與兩側的果樹行銜接緊湊,角平分線算法擬合的導航路徑能夠有效減小不規(guī)則道路邊緣對導航路徑提取的干擾。

圖9 不同環(huán)境條件下果園導航路徑識別結果

3種不同道路條件下的導航路徑精度測試結果如表3所示。在白色地膜道路條件下,平均像素誤差和平均距離誤差分別為17像素和7.42 cm。在黑色地膜道路條件下,平均像素誤差和平均距離誤差分別為32像素和10.55 cm。在無地膜道路條件下,平均像素誤差和平均距離誤差分別為17像素和4.76 cm。可得不同道路條件下的平均像素誤差是22像素,平均距離誤差是7.58 cm。已知所在火龍果園的道路寬度為3 m,平均距離誤差占比為2.53%。在當前火龍果園環(huán)境中本文方法具有較高的精度,能夠適應不同的火龍果園道路環(huán)境。

表3 導航路徑精度測試結果

5 結論

(1)提出了一種基于改進DeepLabv3+的火龍果園道路識別方法,通過加入CA模塊提高了模型的特征提取能力;另外將原模型中的主干特征提取網(wǎng)絡更換成MobileNetV2,以及將ASPP模塊中的空洞卷積更換成DSC,極大降低了模型內存占用量,改進模型和原模型、Pspnet以及U-net相比內存占用量分別減小97.00%、91.57%和91.02%。并且檢測速率和平均交并比分別提升至57.89 f/s和95.80%,說明本文模型更加適合部署至嵌入式設備上。

(2)根據(jù)網(wǎng)絡模型分割出的道路掩碼,提出一種基于道路邊界擬合的角平分線提取導航路徑算法,該算法能準確提取出導航路徑。

(3)在火龍果園3種不同道路環(huán)境條件下,進行了導航路徑精度測試實驗。實驗結果表明,平均像素誤差為22像素,平均距離誤差為7.58 cm。已知所在果園道路寬度約為3 m,平均距離誤差占比為2.53%。說明本文提出的導航路徑擬合方法具有較好的適應性。因此本研究可以為火龍果園視覺導航提供有效參考。