基于卷積神經(jīng)網(wǎng)絡(luò)的物品識(shí)別系統(tǒng)設(shè)計(jì)

關(guān)鍵詞:CNN;物品識(shí)別;系統(tǒng)設(shè)計(jì)

0引言

卷積神經(jīng)網(wǎng)絡(luò)(convolutionalneuralnetwork,CNN)作為深度學(xué)習(xí)的重要分支,憑借其強(qiáng)大的特征提取能力而被廣泛應(yīng)用于識(shí)別領(lǐng)域,并取得顯著效果。物品識(shí)別則被廣泛應(yīng)用于智能物流、自動(dòng)化生產(chǎn)、智能安防等多個(gè)領(lǐng)域。然而,面對(duì)復(fù)雜多變的物品形態(tài)與類別,傳統(tǒng)識(shí)別方法常常無法取得理想效果。在這種背景下,本文設(shè)計(jì)了一套高效、實(shí)用的物品識(shí)別系統(tǒng),其具有重要理論價(jià)值與現(xiàn)實(shí)意義,有助于大幅提升物品識(shí)別的準(zhǔn)確率與效率。

1物品識(shí)別系統(tǒng)設(shè)計(jì)與實(shí)現(xiàn)

1.1總體設(shè)計(jì)

本系統(tǒng)由PC瀏覽器客戶端、Android客戶端及后臺(tái)服務(wù)器三大部分構(gòu)成。后臺(tái)服務(wù)器主要負(fù)責(zé)運(yùn)算與處理,其先接收來自不同客戶端的用戶請(qǐng)求,隨后對(duì)上傳的圖片完成接收、預(yù)處理與識(shí)別[1]。該過程又被細(xì)分成圖片接收、識(shí)別及結(jié)果返回等核心流程。

對(duì)于PC瀏覽器客戶端,專門為用戶設(shè)計(jì)了一個(gè)直觀且友好的交互界面。用戶只需在瀏覽器地址欄輸入特定網(wǎng)址,便能輕松訪問系統(tǒng)主界面。在選擇并上傳本地圖片后,系統(tǒng)將迅速進(jìn)行識(shí)別處理,并在頁面中即時(shí)顯示識(shí)別結(jié)果,從而為用戶提供一種流暢、高效的操作體驗(yàn)。

為更好地滿足移動(dòng)端用戶的需求,專門研發(fā)了Android客戶端。本設(shè)計(jì)應(yīng)用Cordova技術(shù),將功能交互、頁面設(shè)計(jì)及樣式等元素巧妙地打包成一個(gè)完整的Android應(yīng)用[2]。用戶可以隨時(shí)使用手機(jī)拍攝照片或選擇本地圖片進(jìn)行識(shí)別,實(shí)現(xiàn)了Android客戶端與后臺(tái)服務(wù)器的完美對(duì)接,大大提高了系統(tǒng)的便捷性與實(shí)用性。

1.2技術(shù)架構(gòu)

在構(gòu)建物品識(shí)別系統(tǒng)過程中,因表述性狀態(tài)轉(zhuǎn)移(representationalstatetransfer,REST)適應(yīng)性強(qiáng)且優(yōu)勢(shì)顯著,將其作為Web架構(gòu)。設(shè)計(jì)系統(tǒng)架構(gòu)時(shí),先將服務(wù)器與客戶端分離,使服務(wù)器端專注于數(shù)據(jù)處理與邏輯運(yùn)算,而客戶端則負(fù)責(zé)與用戶完成交互。為提升系統(tǒng)可靠性與安全性,本設(shè)計(jì)利用REST的無狀態(tài)特性,同時(shí)啟用數(shù)據(jù)緩存,優(yōu)化網(wǎng)絡(luò)效率。此外,為優(yōu)化系統(tǒng)性能,本文還適當(dāng)引入網(wǎng)關(guān)、代理等中間層,從而完成負(fù)載均衡、身份驗(yàn)證等操作。在開發(fā)過程中,通過定義清晰的應(yīng)用程序編程接口(applicationprogramminginterface,API)與數(shù)據(jù)格式,保證了通信的高效與簡潔。最后,考慮到智能手機(jī)的硬件限制,本設(shè)計(jì)將計(jì)算密集型算法全部部署到服務(wù)端,以充分利用服務(wù)端的強(qiáng)大計(jì)算能力[3]。

1.3卷積神經(jīng)網(wǎng)絡(luò)模型構(gòu)建

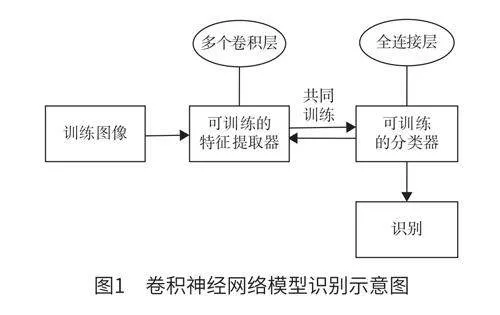

卷積神經(jīng)網(wǎng)絡(luò)模型是物品識(shí)別系統(tǒng)的核心組成部分。本設(shè)計(jì)利用深度CNN算法中的AlexNet模型來構(gòu)建卷積神經(jīng)網(wǎng)絡(luò)模型,借助MXNet輕松地定義卷積層、激活層以及池化層等神經(jīng)網(wǎng)絡(luò)的基本組件。具體構(gòu)建流程為:首先,定義一個(gè)輸入層以接收待識(shí)別的物品圖像;其次,運(yùn)用多個(gè)卷積層對(duì)圖像完成特征提取,且每個(gè)卷積層均配備了激活函數(shù),如修正線性單元(rectifiedlinearunit,ReLU),其可以增加網(wǎng)絡(luò)的非線性表達(dá)能力;再次,利用池化層來降低數(shù)據(jù)的維度,同時(shí)保留最重要的特征;最后,借助連接層與Softmax函數(shù)來調(diào)整輸出層神經(jīng)元產(chǎn)生的誤差值,從而得到最終的識(shí)別結(jié)果[4]。卷積神經(jīng)網(wǎng)絡(luò)模型識(shí)別示意圖如圖1所示。

在基于CNN的物品識(shí)別過程中,首先需要進(jìn)行圖像訓(xùn)練,為充分利用圖像視覺信息,本文設(shè)計(jì)多卷積層作為特征提取器,以深入挖掘輸入訓(xùn)練圖像的內(nèi)在特征。其中,每一個(gè)卷積層均利用卷積運(yùn)算來捕捉圖像的局部特征,如邊緣、紋理等。隨著卷積層的加深,網(wǎng)絡(luò)可以逐步提取出更加抽象與高級(jí)的特征。訓(xùn)練過程中,利用反向傳播算法來實(shí)時(shí)更新卷積層的參數(shù),如卷積核的偏置、權(quán)重等。同時(shí),憑借計(jì)算誤差信號(hào)與反向傳播,持續(xù)調(diào)整與優(yōu)化相關(guān)的參數(shù)。此外,同步調(diào)整分類器的參數(shù),以保證其能夠準(zhǔn)確地根據(jù)提取的特征實(shí)現(xiàn)對(duì)物品圖像的分類或識(shí)別。CNN能夠端到端地學(xué)習(xí)從輸入圖像至最終識(shí)別結(jié)果的映射關(guān)系[5]。

1.4交叉訓(xùn)練優(yōu)化CNN模型性能

為進(jìn)一步提高物品識(shí)別的準(zhǔn)確率,本設(shè)計(jì)還應(yīng)用了交叉訓(xùn)練的方法。在交叉訓(xùn)練過程中,需要持續(xù)調(diào)整網(wǎng)絡(luò)參數(shù),以不斷優(yōu)化模型的性能。具體實(shí)現(xiàn)步驟如下:首先,將原始數(shù)據(jù)集分為訓(xùn)練集與驗(yàn)證集,并利用驗(yàn)證集對(duì)訓(xùn)練結(jié)果完成評(píng)估。通過反復(fù)多次迭代訓(xùn)練,持續(xù)調(diào)整網(wǎng)絡(luò)參數(shù),直到獲得滿意的準(zhǔn)確率。其次,訓(xùn)練過程中還采用隨機(jī)梯度下降算法來進(jìn)一步優(yōu)化網(wǎng)絡(luò)參數(shù)[6]。該算法通過計(jì)算損失函數(shù)的梯度來調(diào)整與更正網(wǎng)絡(luò)參數(shù),以此不斷逼近最優(yōu)解。最后,本設(shè)計(jì)還引入了動(dòng)量、學(xué)習(xí)率衰減等技巧來加速訓(xùn)練過程,以迅速提高模型的泛化能力。

1.5CNN模型保存與物品識(shí)別

在模型訓(xùn)練完成后,需要將訓(xùn)練好的模型保存下來,以供后續(xù)使用。模型的保存包括網(wǎng)絡(luò)結(jié)構(gòu)與網(wǎng)絡(luò)參數(shù)保存,可以使用MXNet提供的函數(shù)model.save()來保留訓(xùn)練后穩(wěn)定的網(wǎng)絡(luò)結(jié)構(gòu)與網(wǎng)絡(luò)參數(shù),且保存的文件占用內(nèi)存很小,便于后續(xù)加載與使用。隨后,便可以使用基于卷積神經(jīng)網(wǎng)絡(luò)模型的物品識(shí)別系統(tǒng)來識(shí)別新的物品圖像。識(shí)別過程中,將待識(shí)別的圖像上傳到已經(jīng)訓(xùn)練好的模型中,并且利用前向傳播計(jì)算得到識(shí)別結(jié)果,該識(shí)別結(jié)果可以是一個(gè)類別、一個(gè)標(biāo)簽或其他形式的信息。在使用時(shí),可利用已保存好的模型文件來加載模型,并使用該模型來識(shí)別新的物品圖像,整體過程簡單高效,且可以滿足實(shí)時(shí)性的要求[7]。

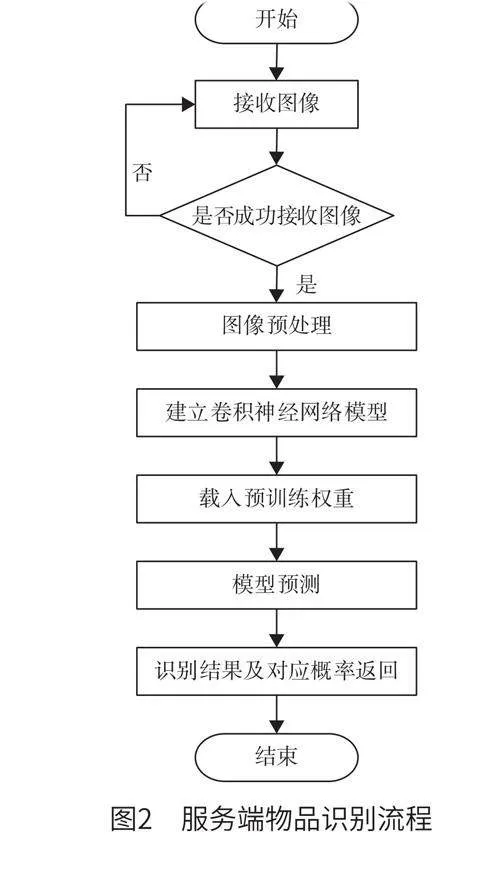

實(shí)際應(yīng)用過程中,由服務(wù)端負(fù)責(zé)接收并處理來自Android端與PC瀏覽器端的識(shí)別請(qǐng)求,并執(zhí)行圖像識(shí)別任務(wù),最終返回精確的識(shí)別結(jié)果。具體來說,當(dāng)用戶啟動(dòng)Android應(yīng)用或在PC瀏覽器中訪問物品識(shí)別系統(tǒng)時(shí),服務(wù)端完成路由分發(fā),根據(jù)請(qǐng)求的地址,智能地調(diào)用不同的接口(首頁接口與圖像識(shí)別接口)。一旦用戶上傳物品圖片,服務(wù)端將立即調(diào)用專門的圖像識(shí)別接口。圖片識(shí)別完成后,服務(wù)端將識(shí)別結(jié)果封裝成標(biāo)準(zhǔn)的數(shù)據(jù)格式,而后借助網(wǎng)絡(luò)將其返回給客戶端。服務(wù)端物品識(shí)別流程如圖2所示。

在實(shí)際處理圖像過程中,首先,服務(wù)端判斷用戶是否成功上傳物品圖像,如果上傳不成功則需重新上傳。其次,當(dāng)服務(wù)端成功接收到物品圖像后,對(duì)其進(jìn)行預(yù)處理,將圖像轉(zhuǎn)化成指定格式,以更好地適應(yīng)后續(xù)的卷積神經(jīng)網(wǎng)絡(luò)模型。最后,構(gòu)建與配置卷積神經(jīng)網(wǎng)絡(luò)模型,并使用該模型推理分析預(yù)處理好的圖像數(shù)據(jù)流。該模型能夠根據(jù)輸入的圖像,計(jì)算出與權(quán)重文件中每個(gè)類別標(biāo)簽的相似度或匹配程度,并將這些相似度評(píng)分或概率值作為輸出結(jié)果。另外,該系統(tǒng)還具備識(shí)別物品類別與表面屬性的功能。本文利用Corel數(shù)據(jù)集與FMD數(shù)據(jù)集訓(xùn)練了CNN模型,在接收來自用戶上傳的物品圖片后,系統(tǒng)使用訓(xùn)練好的卷積神經(jīng)網(wǎng)絡(luò)模型完成分類預(yù)測(cè),從而得出識(shí)別結(jié)果并將其返回給客戶端。

2實(shí)驗(yàn)結(jié)果及分析

2.1數(shù)據(jù)集與實(shí)驗(yàn)設(shè)置

為深入驗(yàn)證CNN模型在物品識(shí)別方面的性能,本文采用多個(gè)標(biāo)準(zhǔn)數(shù)據(jù)集完成實(shí)驗(yàn),涉及Caltech101、FMD等數(shù)據(jù)集[8]。數(shù)據(jù)集涵蓋了廣泛的物品類別,為客觀準(zhǔn)確評(píng)估CNN模型提供了必要基礎(chǔ)。在實(shí)驗(yàn)環(huán)境方面,本文采用Win10系統(tǒng),配備4GB內(nèi)存與Inteli5處理器,同時(shí)選用MATLABR2015b作為主要編程環(huán)境,以保障實(shí)驗(yàn)的可靠性與可重復(fù)性。

2.2實(shí)驗(yàn)結(jié)果與分析

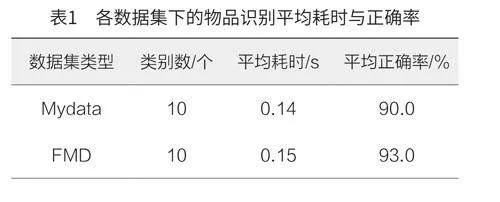

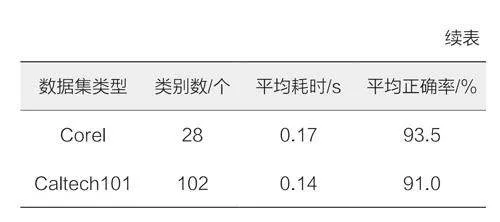

實(shí)驗(yàn)過程中,本文重點(diǎn)關(guān)注CNN在物品識(shí)別任務(wù)中的性能表現(xiàn),尤其是識(shí)別時(shí)間與識(shí)別正確率,各數(shù)據(jù)集下的物品識(shí)別平均耗時(shí)與正確率如表1所示。

結(jié)果顯示,對(duì)于包含10個(gè)類別的Mydata數(shù)據(jù)集,系統(tǒng)平均耗時(shí)0.14s,平均正確率高達(dá)90.0%。在更具挑戰(zhàn)性的Caltech101與Corel數(shù)據(jù)集中,系統(tǒng)同樣表現(xiàn)出了良好的性能,尤其是在Caltech101數(shù)據(jù)集上,盡管類別數(shù)增至102個(gè),但平均正確率仍達(dá)到了91.0%。而在FMD數(shù)據(jù)集上,系統(tǒng)平均正確率達(dá)到93.0%,這證明了卷積神經(jīng)網(wǎng)絡(luò)模型在該特定數(shù)據(jù)集上識(shí)別任務(wù)更具挑戰(zhàn)性。

3結(jié)語

通過深入研究與實(shí)驗(yàn)驗(yàn)證,本文成功地設(shè)計(jì)與實(shí)現(xiàn)了一套基于CNN的物品識(shí)別系統(tǒng)。該系統(tǒng)在各類標(biāo)準(zhǔn)數(shù)據(jù)集上表現(xiàn)出卓越的性能,驗(yàn)證了CNN在物品識(shí)別領(lǐng)域的實(shí)用性與有效性。然而,該物品識(shí)別系統(tǒng)仍存在一定的局限性,如在處理物品遮擋、極端形變等特定場景時(shí)準(zhǔn)確率與效率仍有待提升。未來,將持續(xù)優(yōu)化網(wǎng)絡(luò)結(jié)構(gòu),積極探索更多先進(jìn)的算法技術(shù),如增量學(xué)習(xí)、注意力機(jī)制等,以進(jìn)一步提升物品識(shí)別系統(tǒng)的適應(yīng)性與識(shí)別能力。