基于深度學(xué)習(xí)的無錨框目標(biāo)檢測算法綜述

高海濤,朱超涵,張?zhí)炱澹嘛w,茅新宇

(南京工程學(xué)院機(jī)械工程學(xué)院,江蘇南京 211167)

0 前言

目標(biāo)檢測(Object Detection)是一種通過提取/分析目標(biāo)幾何和統(tǒng)計(jì)特征進(jìn)行圖像分割識別目標(biāo)的技術(shù),其在安防、姿態(tài)估計(jì)、無人駕駛等領(lǐng)域得到廣泛使用。由于檢測對象復(fù)雜多樣,再加上獲取圖像時有光照、遮擋等因素干擾,目標(biāo)檢測一直是計(jì)算機(jī)視覺領(lǐng)域具有挑戰(zhàn)性的研究之一。在深度學(xué)習(xí)算法出現(xiàn)之前,傳統(tǒng)目標(biāo)檢測通常利用滑動窗口對手工特征進(jìn)行提取、匹配,存在檢測目標(biāo)單一、時間和空間復(fù)雜度較高并且魯棒性差等問題。隨著深度學(xué)習(xí)算法的廣泛應(yīng)用,基于深度學(xué)習(xí)的目標(biāo)檢測通過高效的網(wǎng)絡(luò)結(jié)構(gòu)和高算力GPU(Graphics Processing Unit),在檢測精度與效率等方面顯著提高,逐漸成為當(dāng)前的主流算法[1-3]。

基于深度學(xué)習(xí)的目標(biāo)檢測可以總結(jié)為有錨框構(gòu)架和無錨框構(gòu)架兩類。有錨框目標(biāo)檢測算法將目標(biāo)邊界劃分為多個錨框來預(yù)測每個目標(biāo)的偏移量和類別,其進(jìn)一步又可以分為單階段法和雙階段法兩種[4]。其中,單階段方法直接生成回歸物體的類別、位置信息,而雙階段方法則先生成樣本候選框,再對樣本分類,獲得目標(biāo)信息。由于需要獲取的錨框數(shù)量巨大,正負(fù)樣本嚴(yán)重不平衡,訓(xùn)練效率低,使得有錨框檢測算法存在運(yùn)算速度慢的突出問題[5-7]。此外,錨框機(jī)制也引入了更多的超參數(shù),如錨框的數(shù)量、大小和寬高比等,這增加了算法的設(shè)計(jì)難度,使得數(shù)據(jù)集調(diào)優(yōu)困難,通用性較差。

無錨框檢測方法則將目標(biāo)框檢測轉(zhuǎn)變?yōu)閷Χ鄠€關(guān)鍵點(diǎn)/域的檢測,通過獲得關(guān)鍵點(diǎn)/域的位置信息來預(yù)測邊框[8],該方法不需要設(shè)計(jì)錨框,減少了對錨框的各種計(jì)算,節(jié)省了算力和時間,是目標(biāo)檢測領(lǐng)域一個全新的方向。根據(jù)關(guān)鍵點(diǎn)/域選取的不同,無錨框檢測可以歸結(jié)為關(guān)鍵點(diǎn)法和中心域法兩種。關(guān)鍵點(diǎn)法中的關(guān)鍵點(diǎn)主要為角點(diǎn)或者中心點(diǎn)。角點(diǎn)法是通過角點(diǎn)的特征信息匹配生成檢測框,避免了預(yù)設(shè)錨框帶來的計(jì)算冗余問題[9],典型算法如CornerNet、CornerNet-Lite 等。中心點(diǎn)法通過關(guān)鍵點(diǎn)三元組(左上角點(diǎn)、右下角點(diǎn)和中心點(diǎn)),回歸得到目標(biāo)中心點(diǎn)的位置、偏移量等信息,預(yù)測目標(biāo)邊框,典型的算法有CenterNet、CenterNet++等。中心域法則利用全卷積算法,逐像素地直接預(yù)測物體的中心區(qū)域坐標(biāo)和邊界框的尺度信息,在特征提取過程中充分利用了圖像的整體信息,典型的算法如FSAF(Feature Selective Anchor-Free Module for Single-Shot Object Detection)、FCOS(Fully Convolutional One-Stage Object Detection)等[10-13]。

無錨框目標(biāo)檢測算法種類眾多、適用范圍不盡相同,為了進(jìn)一步理清無錨框目標(biāo)檢測關(guān)鍵技術(shù)及網(wǎng)絡(luò)結(jié)構(gòu),本文作者總結(jié)了各代表性無錨框檢測算法的思想、網(wǎng)絡(luò)構(gòu)架及關(guān)鍵技術(shù),著重分析了各算法的特性,并進(jìn)一步通過實(shí)例實(shí)驗(yàn)定量對比了各種檢測算法的性能,對未來的研究進(jìn)行了總結(jié)和展望。

1 基于關(guān)鍵點(diǎn)的無錨框目標(biāo)檢測

1.1 基于角點(diǎn)的無錨框目標(biāo)檢測

1.1.1 ConerNet 算法

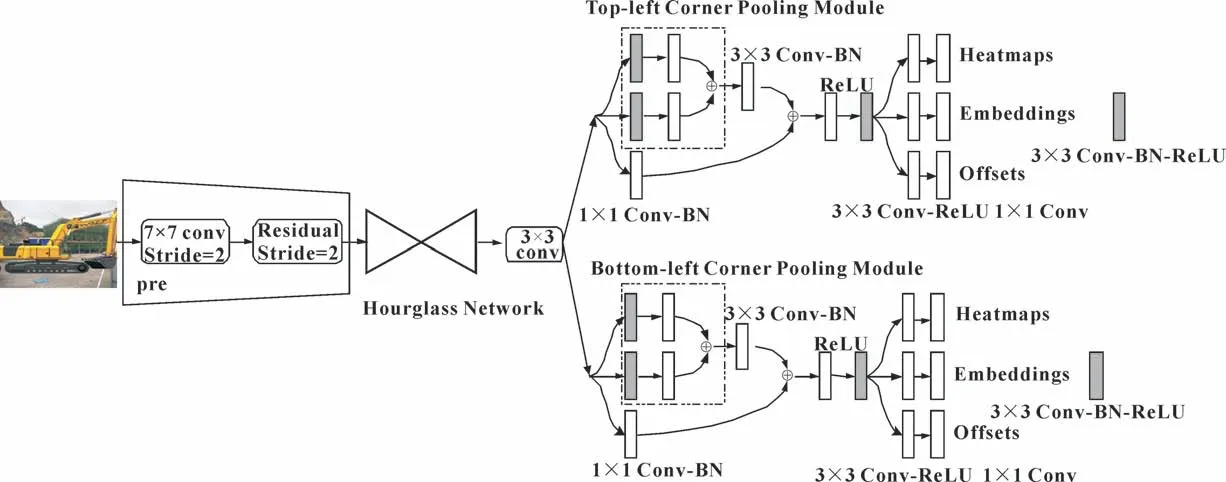

ConerNet 算法是基于關(guān)鍵點(diǎn)檢測中經(jīng)典的架構(gòu)之一,主要包括1 個骨干網(wǎng)絡(luò)和2 個預(yù)測分支,網(wǎng)絡(luò)結(jié)構(gòu)如圖1 所示。骨干網(wǎng)絡(luò)通常是Hourglass-104,兩個預(yù)測分支分別定義為Top-Left 預(yù)測模塊和Bottom-Right 預(yù)測模塊,每個分支均含有1 個角點(diǎn)池化模塊和3 個輸出。3 個輸出分別是熱力圖(Headmaps)、偏移向量(Offset)以及嵌入向量(Embedding)。熱力圖含有角點(diǎn)的位置信息。偏移向量用來修正取整計(jì)算時損失的精度信息。最后通過聯(lián)合2 個分支輸出的嵌入向量,將同一個目標(biāo)的左上角和右下角的兩個角點(diǎn)成組,從而實(shí)現(xiàn)基于角點(diǎn)的無錨框目標(biāo)檢測。

圖1 ConerNet 網(wǎng)絡(luò)結(jié)構(gòu)Fig.1 ConerNet network structure

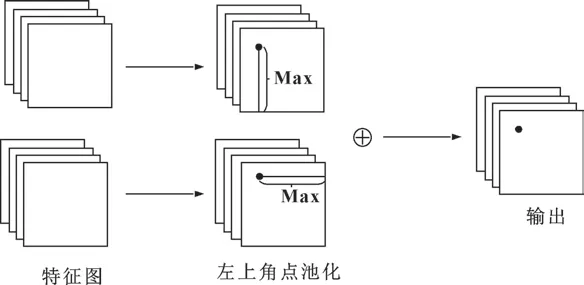

角點(diǎn)池化(Corner Pooling)是ConerNet 算法的最主要創(chuàng)新,其核心是認(rèn)為輸出角點(diǎn)應(yīng)該是最大響應(yīng)點(diǎn)[14]。如圖2 所示,針對圖像中左上角點(diǎn),過當(dāng)前預(yù)測角點(diǎn)作兩條直線,分別與圖像的u軸和v軸平行,當(dāng)兩條直線剛好“觸碰” 到目標(biāo)最邊緣點(diǎn)時,則輸出當(dāng)前預(yù)測結(jié)果。通過利用圖像中額外信息,Corner Pooling 不僅大幅提高了角點(diǎn)預(yù)測的精確度,也大大提升了目標(biāo)的整體檢測效率。ConerNet 算法也存在著一些不足,比如:缺乏對檢測目標(biāo)全局信息的考慮、識別速度慢等。

圖2 Corner pooling 原理Fig.2 Corner pooling principle

1.1.2 CornerNet-Lite 算法

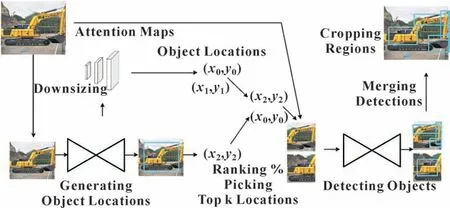

CornerNet-Lite 算法是由LAW 等[15]提出的旨在解決CornerNet 因追求準(zhǔn)確性而出現(xiàn)高昂的網(wǎng)絡(luò)處理代價的問題,網(wǎng)絡(luò)結(jié)構(gòu)如圖3 所示。它是CornerNet兩個變體CornerNet-Saccade 與CornerNet-Squeeze 的組合,其中,前者通過引入注意機(jī)制,變單階段檢測為先裁剪興趣區(qū)域再做精細(xì)檢測的雙階段檢測,從而減少了推理時間,提高了檢測精度。CornerNet-Squeeze 則通過采用輕量化的Hourglass 主干網(wǎng)絡(luò),減少了每個像素的處理量,提高了檢測效率[16]。盡管CornerNet-Lite 在速度和精度兩方面均有提高,但未能從根本上解決CornerNet-Saccade 和CornerNet-Squeeze 兩種變體模塊之間的矛盾沖突,前者需要強(qiáng)大的主干網(wǎng)絡(luò)以生成足夠準(zhǔn)確的特征圖,而后者則要通過減弱主干網(wǎng)絡(luò)的表達(dá)能力以實(shí)現(xiàn)加速,二者的融合仍有改善提高空間。

圖3 CornerNet-Lite 的網(wǎng)絡(luò)結(jié)構(gòu)Fig.3 CornerNet-Lite network structure

1.2 基于中心點(diǎn)的無錨框模型

1.2.1 CenterNet 算法

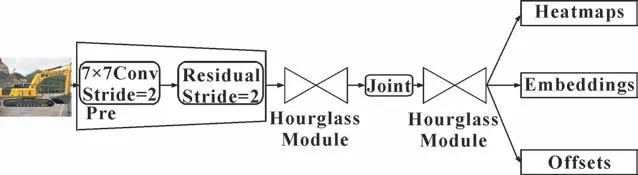

CenterNet 通過關(guān)鍵點(diǎn)三元組(左上角點(diǎn)、中心點(diǎn)、右下角點(diǎn))表示物體實(shí)現(xiàn)目標(biāo)檢測,其原理是通過左上和右下2 個角點(diǎn)生成樣本目標(biāo)框,如果目標(biāo)框準(zhǔn)確,那么在其中心區(qū)域能夠檢測到目標(biāo)中心點(diǎn)的概率就會很高,反之亦然[17-18]。CenterNet 首先通過熱力圖預(yù)測關(guān)鍵點(diǎn),如角點(diǎn)的位置、類別等信息;然后,根據(jù)偏移向量將角點(diǎn)映射到輸入圖像的相應(yīng)位置;接著,通過嵌入向量辨識角點(diǎn),從而利用同一個目標(biāo)的左上和右下角點(diǎn)生成預(yù)測框。針對每個預(yù)測框定義一個中心區(qū)域,根據(jù)左上和右下角點(diǎn)的置信度計(jì)算中心點(diǎn)的置信度,判斷中心區(qū)域是否含有中心點(diǎn),若有則保留預(yù)測框,實(shí)現(xiàn)目標(biāo)的檢測。如圖4 所示,CenterNet 的網(wǎng)絡(luò)結(jié)構(gòu)比較簡單,它不僅可以進(jìn)行二維目標(biāo)的檢測,還可以通過簡單修改進(jìn)行三維目標(biāo)的檢測。與CornerNet 算法相比,盡管CenterNet 在感知目標(biāo)區(qū)域內(nèi)部信息能力有所提升,但是仍然不能夠充分利用目標(biāo)的內(nèi)部信息,以致當(dāng)多個目標(biāo)的中心點(diǎn)混疊在一起時,多個目標(biāo)將會被訓(xùn)練成同一目標(biāo),從而只輸出一個中心點(diǎn),極大地影響了檢測結(jié)果。

圖4 CenterNet 網(wǎng)絡(luò)結(jié)構(gòu)Fig.4 CornerNet network structure

1.2.2 CenterNetV2 算法

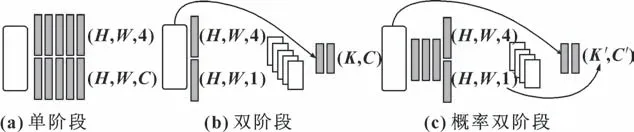

針對誤檢問題,ZHOU 等[19]進(jìn)一步提出了基于概率的雙階段目標(biāo)檢測方法CenterNetV2,其算法結(jié)構(gòu)與單階段和雙階段算法結(jié)構(gòu)對比如圖5 所示。該方法通過其邊界框中心的單個點(diǎn)來表示所檢測的目標(biāo),然后直接從中心位置的圖像特征回歸目標(biāo)大小、尺寸、3D 位置、姿態(tài)等信息。與基于關(guān)鍵點(diǎn)估計(jì)的目標(biāo)檢測相比,該算法的優(yōu)點(diǎn)有:(1)通過一個單階段算法得到預(yù)測框并對其賦予分值,但是該分值與分類無關(guān),只是用以區(qū)分前景或背景。通過單階段算法較好地區(qū)分前景與背景,大大減少了無效的預(yù)測框,提高了推理速度。(2)利用極大似然估計(jì),設(shè)計(jì)了新的損失函數(shù),同時優(yōu)化了第一和第二階段的算法,提高了算法的檢測精度和檢測速度。

圖5 CenterNetV2 算法結(jié)構(gòu)對比Fig.5 Comparison of CenterNetV2 algorithm structures:(a)single-stage;(b)dual-stage;(c)probability dual phase

1.2.3 CenterNet++算法

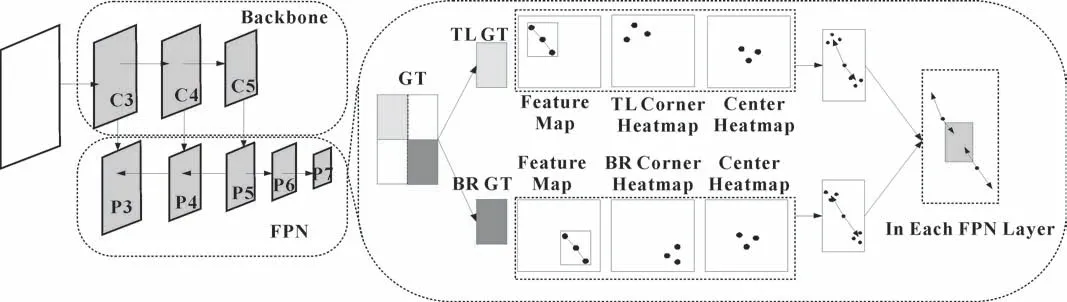

為了改善性能,DONG 等[20]將特征金字塔網(wǎng)絡(luò)(Feature Pyramid Networks,F(xiàn)PN)引入到CenterNet中,提出的CenterNet++算法能夠在多分辨率特征圖中進(jìn)行目標(biāo)檢測,它具有更好的通用性和更豐富的感受視野。如圖6 所示,骨干網(wǎng)絡(luò)處理輸入圖像并輸出特征圖C3-C5,特征圖輸入到FPN 后輸出多分辨率特征圖P3-P7。針對每個分辨率的特征圖,分別用熱力圖和回歸兩種方法預(yù)測關(guān)鍵點(diǎn)。通過熱力圖預(yù)測,生成3 種熱力圖預(yù)測角點(diǎn)和中心關(guān)鍵點(diǎn);通過回歸預(yù)測時,為實(shí)現(xiàn)左上角點(diǎn)和右下角點(diǎn)的解耦,要將Ground-Truth 框分割成4 個完全相同的子框,分別用左上角的和右下角的子框來監(jiān)督回歸。在推理過程中,回歸向量作為線索,在相應(yīng)的熱力圖中找到最近的關(guān)鍵點(diǎn),以細(xì)化關(guān)鍵點(diǎn)的位置。最后利用有效的三元組關(guān)鍵點(diǎn)確定預(yù)測框。

圖6 CenterNet++多分辨網(wǎng)絡(luò)結(jié)構(gòu)Fig.6 CenterNet++multi-resolution network structure

2 基于中心域的無錨框目標(biāo)檢測

2.1 FCOS 算法

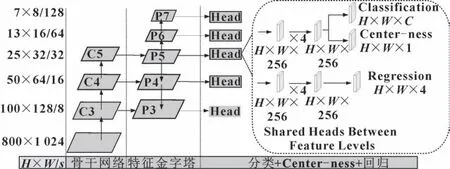

FCOS 是一種像素級目標(biāo)檢測方法,其通過各點(diǎn)像素逐點(diǎn)回歸鋪設(shè)錨點(diǎn)替代錨框來檢測目標(biāo)[21-22]。如圖7 所示,F(xiàn)COS 通常采用ResNet 或ResNeXt 作為基礎(chǔ)網(wǎng)絡(luò),C3-C5 的特征層作為FPN 的輸入,輸出P3-P7 作為檢測層送入后續(xù)檢測子網(wǎng)絡(luò),并在5 個檢測層分別對應(yīng)的理論感受中心鋪設(shè)錨點(diǎn),采用特定規(guī)則劃分錨點(diǎn)的正負(fù)樣本。在FCOS 中,5 個檢測層共享一個檢測子網(wǎng)絡(luò)。FCOS 最突出的特征是通過“中心度” 分支計(jì)算當(dāng)前位置與待預(yù)測目標(biāo)中心點(diǎn)之間的歸一化距離抑制差的檢測框,大幅度提高了總體性能。此外,F(xiàn)COS 是一種基于全卷積神經(jīng)網(wǎng)絡(luò)的目標(biāo)檢測方法,它只需要非常小的修改就可以擴(kuò)展到其他視覺檢測應(yīng)用,比如實(shí)例分割、關(guān)鍵點(diǎn)檢測等。

圖7 FCOS 網(wǎng)絡(luò)結(jié)構(gòu)Fig.7 FCOS network structure

2.2 PointSetNet 算法

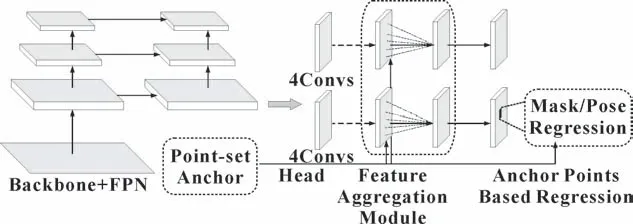

無論是否采用錨框,目標(biāo)檢測算法都需要預(yù)先定義目標(biāo)表示形式,比如矩形框或者中心點(diǎn)等,這實(shí)質(zhì)上是提供一種先驗(yàn)信息。受此啟發(fā),DUAN 等[23-25]提出一種更為泛化的錨點(diǎn),將若干個錨框組建成點(diǎn)集(Pointset Anchor),通過點(diǎn)集的分布,實(shí)現(xiàn)目標(biāo)檢測、實(shí)例分割、位姿估計(jì)等多種檢測任務(wù)。該網(wǎng)絡(luò)稱為PointSetNet,如圖8 所示。該網(wǎng)絡(luò)實(shí)質(zhì)上是RetinaNet的一個擴(kuò)展,也就是根據(jù)不同的檢測任務(wù),用相應(yīng)的點(diǎn)集替換RetinaNet 中的錨框。

圖8 PointSetNet 網(wǎng)絡(luò)結(jié)構(gòu)Fig.8 PointSetNet network structure

3 算法性能比較

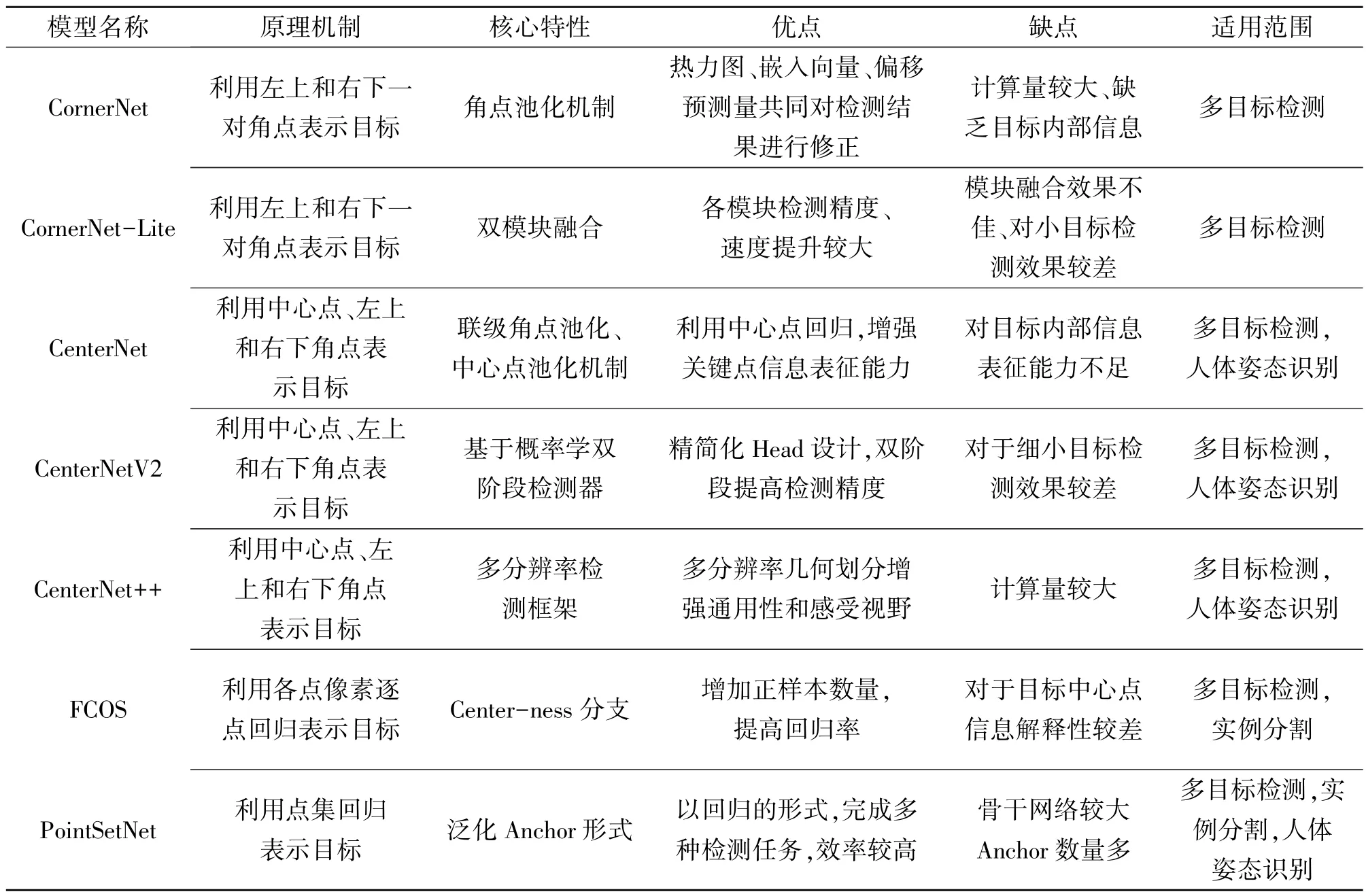

對上述的無錨框目標(biāo)檢測算法從原理機(jī)制、核心特性、優(yōu)缺點(diǎn)以及適用范圍等幾個角度進(jìn)行總結(jié)比較,結(jié)果如表1 所示。

表1 各類無錨框目標(biāo)檢測模型總結(jié)Tab.1 Summary of various anchorless target detection models

(1)從原理機(jī)制看,無錨框目標(biāo)檢測算法的核心就是利用先驗(yàn)點(diǎn)信息,將檢測目標(biāo)轉(zhuǎn)換成點(diǎn)的檢測,化整體為部分,依靠點(diǎn)集特征信息減少超參數(shù)組合優(yōu)化問題[26],均衡訓(xùn)練所需的正負(fù)樣本,進(jìn)而減少了模型訓(xùn)練時參數(shù)的組合、讀取時間和計(jì)算量,提高了模型訓(xùn)練的效率。

(2)從檢測速度看,無錨框目標(biāo)檢測算法大多利用單階段檢測器,經(jīng)過單次檢測即可直接得到最終的檢測結(jié)果,其犧牲了檢測精度,換取了檢測速度的提高[27-29]。采用雙階段檢測器的無錨框目標(biāo)檢測如CenterNetV2,在保證足夠的準(zhǔn)確率和召回率的基礎(chǔ)上,對建議框進(jìn)行分類,尋找更精確的位置,提高了檢測精度,并依靠創(chuàng)新概率算法,彌補(bǔ)了檢測速度較慢的缺點(diǎn),達(dá)到了二者的平衡統(tǒng)一。

(3)從檢測精度看,無錨框目標(biāo)檢測算法在提高了檢測精度的同時也增加了網(wǎng)絡(luò)的復(fù)雜程度[30]。一些算法試圖向輕量化發(fā)展,如FCOS 通過引入中心度分支,抑制低質(zhì)量檢測框,以提高算法的效率和精度;CenternNet++則采用特征圖分塊、向量回歸等,減少內(nèi)存消耗和降低計(jì)算耗時,盡可能地提高精度。

4 實(shí)驗(yàn)與結(jié)果討論

為進(jìn)一步定量對比無錨框目標(biāo)檢測算法的性能,以檢測精度和速度作為主要衡量指標(biāo),利用搭載了2張NVIDIA GTX 2080Ti 顯卡的Dell T7920 圖形工作站進(jìn)行算法實(shí)驗(yàn)。在Linux20.04 系統(tǒng)下,通過Anaconda 配置算法所需虛擬環(huán)境。為保證多種算法數(shù)據(jù)對比的嚴(yán)謹(jǐn),實(shí)驗(yàn)采用相同的深度學(xué)習(xí)Pytorch 框架。

利用常用的微軟MS COCO 數(shù)據(jù)集進(jìn)行算法的訓(xùn)練和測試。為了盡可能衡量模型性能,在MS COCO中隨機(jī)選取包含自然圖片、動物和生活用品等80 種不同類型的目標(biāo)圖片(見圖9)。這些圖片背景復(fù)雜,目標(biāo)數(shù)量較多,目標(biāo)尺寸小,檢測任務(wù)具有一定的難度,其結(jié)果可以作為一個衡量標(biāo)準(zhǔn)。

圖9 MS COCO 數(shù)據(jù)集圖片F(xiàn)ig.9 MS COCO dataset image

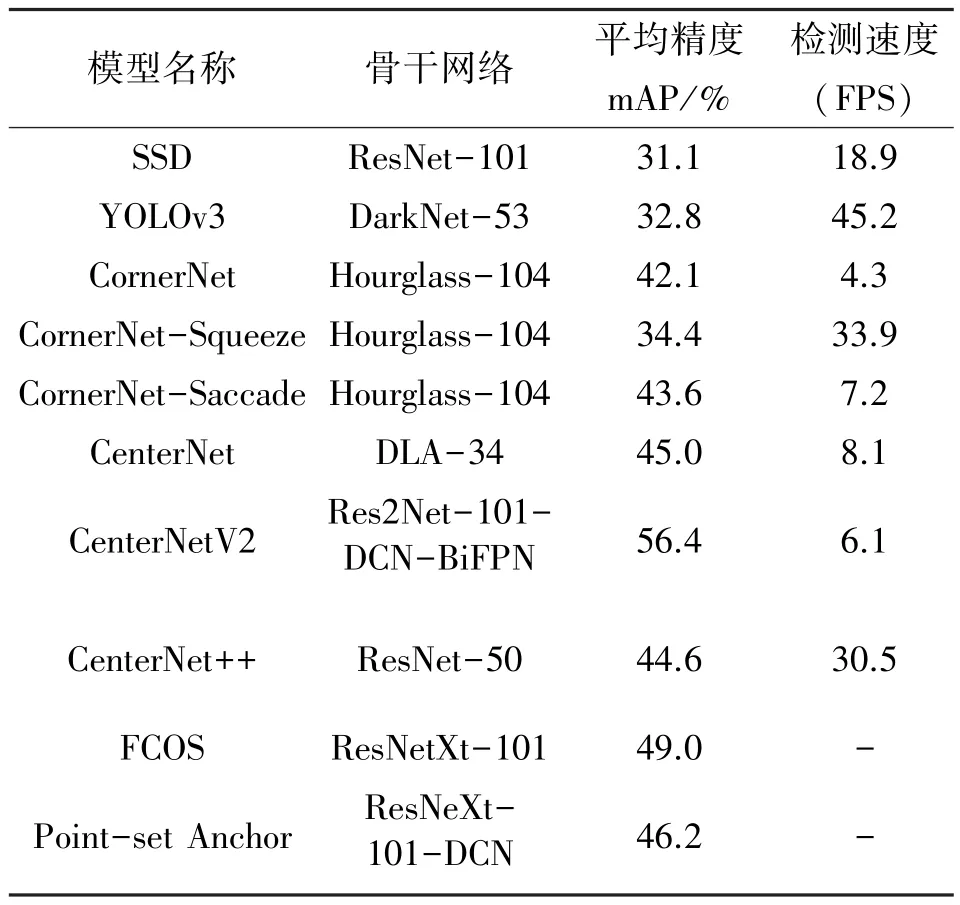

實(shí)驗(yàn)過程中,除算法所需骨干網(wǎng)絡(luò)不同外,采用相同訓(xùn)練參數(shù)。輸入圖像尺寸為512 像素×512 像素;學(xué)習(xí)率(Learning Rate)為1.25×10-4;批次圖片個數(shù)(Batch_Size)為32;訓(xùn)練總輪次(Num_Epochs)為500;加載數(shù)據(jù)集線程數(shù)(Num_Workers)為10。運(yùn)行后獲得每個模型最佳檢測指標(biāo)如表2 所示。

表2 基于MS COCO 數(shù)據(jù)集的多種目標(biāo)檢測模型性能對比Tab.2 Comparison of the performance of multiple object detection models based on MS COCO dataset

CornerNet 是最早期的無錨框目標(biāo)檢測方法之一,通過創(chuàng)新角點(diǎn)池化算法,其精度遠(yuǎn)高于同時期有錨框目標(biāo)檢測方法。相比SSD 和YOLOv3,其mAP(Mean Average Percision)值分別高了35.37%和28.35%,而FPS(Frames Per Second)則又分別低了77.25%和90.49%,說明速度有所降低。為此,CornerNet -Squeeze 通過采用輕量化的Hourglass 主干網(wǎng)絡(luò),減少每個像素的處理量,以提高檢測效率。CornerNet-Squeeze 的mAP 值相比CornerNet 略有下降,降低了18.29%。CornerNet-Squeeze 的FPS 值相比CornerNet則有顯著提高,提高了近7 倍。CornerNet-Saccade 則通過引入注意機(jī)制,變單階段檢測為雙階段檢測[31],減少推理時間,以提高檢測精度。相比CornerNet,CornerNet-Saccade 的mAP 值和FPS 值均有一定程度的提高,分別提高了3.56%和67.44%。盡管Corner-Net-Saccade 和CornerNet-Squeeze 相比CornerNet 在目標(biāo)檢測性能方面有了不同程度的提高,但CornerNet-Saccade 和CornerNet-Squeeze 相結(jié)合的CornerNet-Lite算法卻無法實(shí)現(xiàn)檢測精度與速度的較好平衡,Corner-Net-Lite 的算法融合問題有待進(jìn)一步解決。

CenterNet 也是一種通過關(guān)鍵點(diǎn)進(jìn)行目標(biāo)檢測的方法,在CornerNet 的角點(diǎn)池化算法基礎(chǔ)上,提出了中心點(diǎn)池化和候選角點(diǎn)池化算法,網(wǎng)絡(luò)能夠更加聚焦于中心點(diǎn)特征信息的提取,有利于提高檢測精度[32]。CenterNet、CenterNetV2 以及CenterNet++的mAP 值分別達(dá)到了45.0%、56.4% 和44.6%,平均值為48.67%;而CornerNet、CornerNet-Squeeze 以及CornerNet-Saccade 的平均mAP 值為40.03%;CenterNet及其兩種改進(jìn)方法的mAP 均值相比CornerNet 及其兩種改進(jìn)方法的mAP 均值提高了21.57%。CenterNet及其兩種改進(jìn)方法的mAP 均值比SSD 和YOLOv3 的mAP 值分別提高了56.48%、48.37%。雖然Center-Net 及其改進(jìn)方法在精度上有了一定程度的提高,但是在檢測速度方面,與CornerNet 及其改進(jìn)方法相比,幾乎沒有改變。CenterNet 及其兩種改進(jìn)方法的FPS均值為14.90,而CornerNet 及其兩種改進(jìn)方法的FPS均值為15.13。在CenterNet、CenterNetV2 以及CenterNet++三種算法中,CenterNet++通過采用FPN 和Res2Net,在檢測精度和速度上達(dá)到了較好的平衡[33-34],其mAP 值和FPS 值相比SSD 分別提高了43.41%和61.38%,而相比YOLOv3 在精度方面也提高了35.98%。

通過FPN 結(jié)構(gòu)的多級預(yù)測機(jī)制,F(xiàn)COS 和Point-SetNet 的檢測精度顯著提高。FPN 作為原始主干網(wǎng)絡(luò)的附加項(xiàng),融合在卷積神經(jīng)網(wǎng)絡(luò)之中。通過自下而上的特征提取和自上而下的多層采樣兩個部分,提取不同尺度的特征信息,達(dá)到特征融合的目的,在兼顧速度的同時提高了準(zhǔn)確率。FCOS 和PointSetNet 的mAP值分別為49.0%和46.2%,相比SSD、YOLOv3、CornerNet、CenterNet 分別提高了57.56%、49.39%、16.39%、8.89% 和 48.55%、40.85%、9.74%、2.67%,說明FCOS 具有更優(yōu)的檢測精度。

5 總結(jié)

綜上所述,與有錨框的檢測網(wǎng)絡(luò)相比,無錨框目標(biāo)檢測算法提高了檢測精度,縮短了運(yùn)算時間。本文作者針對7 種具有代表性的無錨框目標(biāo)檢測方法進(jìn)行了綜合分析,根據(jù)網(wǎng)絡(luò)結(jié)構(gòu)的不同,分析其核心特性及優(yōu)缺點(diǎn),最后運(yùn)用數(shù)據(jù)集測試其性能,為算法選用提供借鑒。通過上述算法比較與歸納,總結(jié)出無錨框目標(biāo)檢測算法的未來研究方向:

(1)輕量化。為了易于部署和運(yùn)用,深度學(xué)習(xí)網(wǎng)絡(luò)結(jié)構(gòu)應(yīng)逐步減少模型中所需要的參數(shù)組合,減少計(jì)算量。如CornerNet-Lite 的優(yōu)化角度,基于關(guān)鍵點(diǎn)的檢測方式,需要大量關(guān)鍵點(diǎn)特征信息,在點(diǎn)集信息的處理上需要耗費(fèi)大量算力,優(yōu)化輕量化網(wǎng)絡(luò)結(jié)構(gòu),使其能更快更好地完成檢測任務(wù),輕量化是提升無錨框檢測算法實(shí)用性的重要方向。

(2)雙階段檢測器的運(yùn)用。無錨框檢測網(wǎng)絡(luò)的檢測器大多以單階段檢測器為主,雙階段檢測器相比單階段檢測器,多了一步候選框的預(yù)檢測,這無疑加大了網(wǎng)絡(luò)運(yùn)算所需時間,但同時也很大程度上提高了檢測精度,減少了相似點(diǎn)之間的誤檢測概率。只有少數(shù)的如CenterNet++運(yùn)用了自主優(yōu)化的雙階段檢測器,達(dá)到了速度和精度的相對平衡。在無錨框檢測網(wǎng)絡(luò)中運(yùn)用雙階段檢測器,并對其優(yōu)化,縮小網(wǎng)絡(luò)計(jì)算量,提高特征獲取能力是一大研究方向。

(3)多尺度目標(biāo)的檢測。無錨框的檢測方法大多依賴目標(biāo)的關(guān)鍵點(diǎn)信息對目標(biāo)進(jìn)行定位檢測。圖像的尺寸大小、關(guān)鍵點(diǎn)信息是否清晰都會對整個檢測網(wǎng)絡(luò)產(chǎn)生影響,并且未來檢測方向大多以高分辨率圖片、視頻為主,因此需要讓網(wǎng)絡(luò)結(jié)構(gòu)能適應(yīng)多尺度的對象。可以通過調(diào)整上下采樣次數(shù)、卷積層感受野大小、融合注意力模塊等方法來優(yōu)化無錨框網(wǎng)絡(luò)結(jié)構(gòu),提升其檢測精度及魯棒性。

(4)有/無錨框算法的融合。無錨框的檢測方法實(shí)質(zhì)上并沒有拋開錨框這一概念,只是將整個目標(biāo)的錨框框縮小轉(zhuǎn)移到了目標(biāo)的各個關(guān)鍵點(diǎn)上,并沒有打破錨框的局限性,仍然運(yùn)用了微小矩形框完成檢測流程,所以需要進(jìn)一步研究關(guān)鍵點(diǎn)的檢測機(jī)制,真正融合基于錨框和無錨框兩種檢測方法,提高檢測效率是未來研究的一個方向。