面向武器裝備領(lǐng)域的復(fù)雜三元組抽取方法

游新冬,劉陌村,葛昊杰,肖 剛,呂學(xué)強

1(北京信息科技大學(xué) 網(wǎng)絡(luò)文化與數(shù)字傳播北京市重點實驗室,北京 100101)

2(軍事科學(xué)院 系統(tǒng)工程研究院復(fù)雜系統(tǒng)仿真總體重點實驗室,北京 100101)

0 引 言

武器裝備領(lǐng)域的三元組抽取是構(gòu)建武器裝備領(lǐng)域知識圖譜的重要環(huán)節(jié),是獲取武器裝備領(lǐng)域知識的重要手段[1].例如對非結(jié)構(gòu)化文本“以總統(tǒng)名字命名的杰拉德R福特號航空母艦是美國下一代全新核動力航母,搭載F35C艦載機,耗資130億美元.”而言,三元組抽取任務(wù)是獲取到“<杰拉德R福特號,屬于,美國>、<杰拉德R福特號,搭載,F35C艦載機>”等符合RDF(Resource Description Framework)技術(shù)框架的格式化三元組知識數(shù)據(jù).三元組抽取可以幫助我國專家開展非結(jié)構(gòu)化文本中包含的武器裝備之間的關(guān)系挖掘工作,以提高對裝備信息的掌握水平.

而復(fù)雜三元組抽取是關(guān)系抽取任務(wù)中的一個研究熱點與難點,其抽取質(zhì)量對知識圖譜的知識覆蓋能力有著很重要的作用.復(fù)雜三元組按照頭實體、尾實體和關(guān)系的位置可以分為單實體重疊和實體對重疊.武器裝備領(lǐng)域存在著大量的復(fù)雜三元組知識.

以“杰拉德R福特隸屬于美國,搭載了F35C艦載機.”為例,單實體重疊三元組(Single Entity Overlap Triples)包含的三元組有:“<杰拉德R福特,屬于,美國>、<杰拉德R福特,搭載,F35C艦載機>”,重疊的部分是頭實體(杰拉德R福特”).以“1943年胡蜂號下水服役,并次年開始參與太平洋戰(zhàn)爭.”為例,頭尾實體對完全重疊(Entity Pair Overlap Triples)包含的三元組有:“<胡蜂號,下水時間,1943年>、<胡蜂號,服役時間,1943年>”,重疊的部分是頭實體(“胡蜂號”)和尾實體(“1943年”).

三元組抽取主要有兩大流派方法:第1個是流水線式的抽取,是在命名實體識別與分類任務(wù)完成以后再開展對實體之間的關(guān)系進行抽取;第2個是聯(lián)合式的抽取,是對實體和關(guān)系進行同時識別,源于神經(jīng)網(wǎng)絡(luò)的端到端模型.目前面臨的問題有兩點:1)非結(jié)構(gòu)化信息的利用不足,未能從多個角度挖掘深層領(lǐng)域特征;2)方法對武器裝備領(lǐng)域的樣本標(biāo)注依賴較為嚴(yán)重.為對非結(jié)構(gòu)化信息挖掘更加充分,采用掛載維基百科知識庫對頭實體識別器的正確頭實體進行類型解釋對后續(xù)的抽取過程給予知識獎勵;為緩解模型對樣本標(biāo)注的依賴使用多輪對抗攻擊的方式對樣本的多樣性做了提升,提高了模型的魯棒性.

針對武器裝備領(lǐng)域數(shù)據(jù)特點,本文提出一種掛載武器裝備領(lǐng)域知識結(jié)合多輪對抗攻擊的復(fù)雜三元組抽取方法RDA(Relation extraction in Domain of weaponary combined with multi-round Adversarial),該方法主要為三階段式的聯(lián)合抽取模型:掛載維基百科外部知識庫向模型傳達(dá)武器裝備領(lǐng)域知識,采用多層次的單層指針網(wǎng)絡(luò)進行復(fù)雜三元組的聯(lián)合抽取.在構(gòu)建的5000條武器裝備領(lǐng)域數(shù)據(jù)集上的實驗表明:提出的RDA方法可更加充分地利用武器裝備領(lǐng)域的信息,增加了樣本的多樣性,提升了模型的魯棒性.為解決樣本多樣性缺乏的問題采用在嵌入層發(fā)動多輪對抗攻擊的手段,使用單層指針網(wǎng)絡(luò)對頭實體進行識別,并掛載武器裝備領(lǐng)域知識庫對被正確識別出來的頭實體進行知識獎勵.F1值達(dá)到81.72%,取得了SOTA效果.

1 相關(guān)工作

關(guān)系抽取(Relation Extraction,RE),是知識獲取的一個關(guān)鍵子任務(wù),負(fù)責(zé)從非結(jié)構(gòu)化的自然語言中抽取由本體設(shè)計確認(rèn)的關(guān)系,并據(jù)此對知識圖譜的節(jié)點與節(jié)點之間的線進行構(gòu)建.依據(jù)關(guān)系的類型,可將關(guān)系分為兩類;正常三元組(Normal Triple)、復(fù)雜三元組(Complex Triples),其中復(fù)雜三元組包含頭實體或者尾實體重疊三元組和頭尾實體完全重疊兩個類別[2].

普通關(guān)系抽取的方法主要經(jīng)歷了4個階段,第1個階段是專家制定領(lǐng)域規(guī)則方法[3];第2個階段是基于標(biāo)注數(shù)據(jù)的有監(jiān)督方法[4-6];在2007年,Giuliano等人[5]對SemEval-2007的評測數(shù)據(jù),利用實體的上下文特征和實體之間的距離等特征,使用了支持向量機進行訓(xùn)練取得了71%的F1值.此類方法相對于規(guī)則階段更加靈活,減少了一定的人力參與度.但是仍然存在兩個缺點:第1點是特征選擇工作需要有一定專業(yè)素養(yǎng)的人員來開展,第2點是對非結(jié)構(gòu)化文本的上下文信息利用不足,未能多角度充分挖掘上下文信息.在2009年,莊成龍等人[6]在ACE-2004數(shù)據(jù)集上開展基于樹核函數(shù)的關(guān)系抽取,采用了融入實體語義信息然后再對樹進行剪裁,并去除掉修飾語的冗余信息,達(dá)到了71.9%的F1值.然而,基于標(biāo)注數(shù)據(jù)的有監(jiān)督方法也存在著缺陷,其一是需要大量的數(shù)據(jù)標(biāo)注,這對人力物力的消耗是比較高的;其二是模型對數(shù)據(jù)的依賴性非常高.第3個階段是基于少標(biāo)注數(shù)據(jù)或者零標(biāo)注數(shù)據(jù)的半監(jiān)督或者無監(jiān)督方法[7,8];第四個階段是基于神經(jīng)網(wǎng)絡(luò)的方法[9,10].

針對武器裝備領(lǐng)域的關(guān)系抽取,近年來也得到了關(guān)注.在2019年,李芊芊等人[11]使用句法分析的手段,獲取到文本的謂詞,然后針對謂詞展開了依存分析,在SemEval-2010的基礎(chǔ)上篩選出的數(shù)據(jù)集上取得了80.90%的F1值.在2020年,王乾銘等人[12]提出了一種將序列生成和位置注意力結(jié)合起來的實體關(guān)系聯(lián)合抽取模型,將token的絕對位置和相對位置進行了結(jié)合,在作戰(zhàn)文書上達(dá)到了83.35%的F1值.在2021年,田佳來等人[13]在NLPCC會議上提出采用膨脹卷積技術(shù)擴大感受野,以Word2Vec作向量化模型,使用分層標(biāo)注的方法對軍事領(lǐng)域的關(guān)系進行了識別,在軍事語料上達(dá)到了79.17%的F1值.

基于以上的研究分析,可以發(fā)現(xiàn)在武器裝備領(lǐng)域的復(fù)雜關(guān)系抽取中,目前面臨的問題有兩點:1)對于非結(jié)構(gòu)化信息的利用不足,不能從多個角度挖掘深層領(lǐng)域特征;2)抽取方法對武器裝備領(lǐng)域的樣本標(biāo)注依賴較為嚴(yán)重.為了更加充分地挖掘非結(jié)構(gòu)化信息,本文采用掛載維基百科知識庫對頭實體識別器的正確頭實體進行類型解釋以對后續(xù)的抽取過程給予知識獎勵;為緩解模型對樣本標(biāo)注的依賴,使用多輪對抗攻擊的方式對樣本的多樣性做了提升,提高了模型的魯棒性.據(jù)此,提出了一種掛載武器裝備領(lǐng)域知識庫并結(jié)合多輪對抗攻擊的復(fù)雜三元組抽取方法.該方法為3階段式的抽取方案:第1階段是獲取特征向量;第2階段是使用單層指針網(wǎng)絡(luò)對頭實體進行識別并掛載武器裝備領(lǐng)域知識庫對被正確識別出來的頭實體進行知識獎勵,為解決樣本多樣性缺乏的問題采用在嵌入層發(fā)動多輪對抗攻擊的手段;第3階段是采用分層標(biāo)注的框架以線性化的謂語為基準(zhǔn),采用單層指針網(wǎng)絡(luò)對賓語的開始位置和結(jié)束位置進行判定,最終實現(xiàn)復(fù)雜三元組的抽取.提出的RDA方法將流水線式和聯(lián)合學(xué)習(xí)式的抽取方法進行了一定的交叉融合,通過掛載武器裝備的知識緩解分層標(biāo)注的天然缺陷,實現(xiàn)對武器裝備領(lǐng)域的復(fù)雜關(guān)系以及隱含關(guān)系進行抽取.

2 掛載武器裝備領(lǐng)域知識結(jié)合多輪對抗攻擊的復(fù)雜三元組抽取方法-RDA

提出的RDA方法的模型結(jié)構(gòu)如圖1所示.該模型主要由文本嵌入層模塊、結(jié)合多輪對抗頭實體識別器,武器裝備知識庫模塊、關(guān)系尾實體識別模塊4個部分組成.文本由文本嵌入層模塊進行序列化之后投入結(jié)合多輪對抗攻擊的頭實體識別器將其識別為頭實體或尾實體,再通過武器裝備知識庫模塊,針對不同的頭實體類型,根據(jù)維基百科中定義或者解釋獲取到描述該類型的句子解釋向量.然后以字為最小粒度進行信息融合.最后進入到關(guān)系尾實體識別模塊,同樣是將任務(wù)細(xì)化為兩個子任務(wù):指定關(guān)系對應(yīng)的尾實體頭識別和尾識別.不同的是,本體設(shè)計中涵蓋的所有關(guān)系將會與主語識別器的成果進行運算,挖掘主語與所有可能的關(guān)系.

圖1 掛載武器裝備領(lǐng)域知識結(jié)合多輪對抗攻擊的復(fù)雜三元組模型結(jié)構(gòu)Fig.1 Complex triplet model structure of mounted weapons and equipment domain knowledge combined with multiple rounds of counterattack

RDA方法采用的文本向量化的技術(shù)是BERT模型,通過在海量文本上進行無監(jiān)督預(yù)訓(xùn)練(Pre-training),然后在特定的下游任務(wù)數(shù)據(jù)上進行微調(diào)(Fine-Tuning),BERT在多項自然語言處理任務(wù)中都表現(xiàn)突出.內(nèi)部采用多層Transformer作為其編碼結(jié)構(gòu),相比基于時間序列的循環(huán)神經(jīng)網(wǎng)絡(luò),BERT具有更強的上下文語義信息捕獲能力,蘊含了更為豐富的句法、語義和上下文信息.

2.1 文本嵌入層模塊

如圖1所示首先對token進行嵌入(Embedding),其中包含了3部分:第1部分標(biāo)記嵌入(Token Embedding)是詞向量或者字向量,使用CLS標(biāo)記以更為公平地融合句子中的每個token語義,用于后續(xù)的分類任務(wù);第2部分句段嵌入(Segment Embedding)是因自編碼的語言模型的下一句預(yù)測(Next Sentence Prediction)子任務(wù)需要區(qū)別兩個句子,在RDA方法的模型中默認(rèn)為零;第3部分位置嵌入(Position Embedding)是為保證脫離了RNN時序系列模型的位置約束后,引入位置嵌入信息以適應(yīng)自然語言的時序性.為規(guī)避三角函數(shù)的對偶性無法區(qū)分方向的缺陷,并非采用Transformer的位置嵌入信息方式,而是通過學(xué)習(xí)參數(shù)獲取.然后經(jīng)過12層的Transformer模塊,使用自編碼方式結(jié)合自注意力機制對文本的雙向上下文以獲取向量.

文本嵌入層的字符輸入視為字符向量化,X=(x0,x1,x2,…,xn-1),從輸入token序列到向量序列的過程如公式(1)所示:

(1)

2.2 結(jié)合多輪對抗攻擊的頭實體識別器

提出了將多輪對抗攻擊.融入到頭實體識別器中的方法,可以提高頭識別器投喂在下階段的信息困惑度,以此提高模型的識別能力.

2.2.1 多輪對抗攻擊

RDA的對抗攻擊的生成方式為Fast Gradient Method(FGM)[14],其原理如公式(2)、公式(3)所示:

g=?xL(θ,x,y)

(2)

其中,θ代表模型參數(shù),x代表原始的輸入樣本,y代表gold label,L代表損失函數(shù),?x代表對x求梯度.

FGM:radv=ε*g/‖g‖2

(3)

其中,radv代表攻擊擾動樣本,ε代表對抗攻擊強度系數(shù),g代表梯度.FGM為更加嚴(yán)格地對梯度的方向進行保留,采取使用L2歸一化技術(shù)對梯度進行修正.多輪對抗攻擊流程偽代碼如表1所示.

表1 多輪對抗攻擊算法偽代碼Table 1 Multiple rounds of anti-attack algorithm pseudocode

2.2.2 頭實體識別器

一般的頭實體識別任務(wù)是使用一個線性層分類器獲取到實體的開頭和結(jié)尾,再結(jié)合最近原則進行匹配.如圖1所示,提出的RDA方法采用在嵌入層然后接入由S、E兩個識別層構(gòu)成的頭實體識別器,將其任務(wù)分開:一個只處理當(dāng)前token是實體頭的概率(S識別層);另一個只處理當(dāng)前token是實體尾的概率(E識別層).采用與正態(tài)分布關(guān)聯(lián)密切且計算量較小的Sigmoid激活函數(shù)對每個識別層的概率進行激活,數(shù)值代表該token在S識別層或者E識別層中被判定為實體頭或者實體尾的概率,閾值設(shè)定為0.5.頭實體識別器原理如公式(4)、公式(5)所示:

(4)

(5)

其中,tokenstart和tokenend分別代表了S識別層和E識別層的輸出序列,對應(yīng)了token序列成為實體頭、實體尾的概率,radv代表由嵌入層的多層Transformer Block疊加層運算獲取到的向量并經(jīng)過多輪對抗攻擊后生成的樣本.

2.3 武器裝備知識庫模塊

在本模塊,使用維基百科作為武器裝備類型的外部知識庫.針對不同的頭實體類型,根據(jù)維基百科中定義或者解釋獲取到描述該類型的句子解釋向量.然后以字為最小粒度進行信息融合.Type信息融合模塊工作原理如公式(6)、公式(7)所示:

sent_vecentity=Wiki(Typeentity)

(6)

其中,sent_vecentity代表類別Type對應(yīng)的句子解釋向量,Wiki表示維基百科,entity表示上節(jié)的結(jié)合多輪對抗攻擊的頭實體識別器的成果.

(7)

2.4 關(guān)系尾實體識別模塊

如圖1所示,關(guān)系尾實體識別模塊同時識別尾實體和與其歸屬的本體設(shè)計中包含的關(guān)系.其結(jié)構(gòu)與頭實體識別器類似,同樣是將任務(wù)細(xì)化為兩個子任務(wù):指定關(guān)系對應(yīng)的尾實體頭識別和尾識別.不同的是,本體設(shè)計中涵蓋的所有關(guān)系將會與主語識別器的成果進行運算,以獲取主語與所有可能的關(guān)系的挖掘.本模塊的運作原理如公式(8)和公式(9)所示:

(8)

(9)

3 實 驗

3.1 實驗數(shù)據(jù)

實驗數(shù)據(jù)來源于互聯(lián)網(wǎng)的公開數(shù)據(jù),通過數(shù)據(jù)采集技術(shù)對環(huán)球軍事網(wǎng)的艦船、飛機等信息進行了自動化地采集并持久化至容器.經(jīng)過數(shù)據(jù)篩查、數(shù)據(jù)清洗,最終標(biāo)注數(shù)據(jù)5000條,經(jīng)過署名式交叉方法對數(shù)據(jù)質(zhì)量進行了檢查.對最終的數(shù)據(jù)進行了數(shù)據(jù)劃分,劃分比例為7:2:1,分別作為訓(xùn)練集、驗證集、測試集.關(guān)系分布統(tǒng)計情況如表2所示.實驗數(shù)據(jù)的統(tǒng)計如表3所示.

表2 關(guān)系分布統(tǒng)計表Table 2 Relational distribution statistics

表3 實驗數(shù)據(jù)的統(tǒng)計信息Table 3 Statistical information on experimental data

從表2可以發(fā)現(xiàn),數(shù)據(jù)集中包含關(guān)系最多的是“裝備”和“屬于”,分別占比為29.68%、24.80%;包含關(guān)系最少的是“艦寬”和“吃水”,分被占比0.55%和0.25%.根據(jù)關(guān)系分布的觀察可以發(fā)現(xiàn)此數(shù)據(jù)集具有很強的領(lǐng)域特性.

從表3可以發(fā)現(xiàn),頭實體或者尾實體重疊三元組和頭尾實體完全重疊在數(shù)據(jù)中的比例是有一定比例的,條數(shù)分別是5435條和68條,占比分別為69.26%和0.87%.數(shù)據(jù)標(biāo)注的樣例如表4所示.第1條樣本內(nèi)容包含的是SPO三元組,“杰拉德R福特號”作為共享的頭實體參與3個三元組.第2條樣本內(nèi)容包含的是EPO三元組,“胡蜂號”和“1943年”分別作為頭實體和尾實體參與了兩個三元組.

表4 實驗數(shù)據(jù)的標(biāo)記樣例信息Table 4 Label sample information of experimental data

3.2 評價指標(biāo)

提出RDA方法的評價指標(biāo)和以前的評價方法一致[15].為確保評價的公平,采用忽略掉次序約束的基于片段實體粒度的精確度(P)、召回率(R)和F1值進行計算.基于片段實體粒度的計算方法如公式(10)~公式(12)所示:

(10)

(11)

(12)

其中,TP表示正確被識別出的頭實體、關(guān)系和尾實體的組合個數(shù)(以實體或者關(guān)系片段作為最小粒度),FP表示被錯誤地識別為頭實體、關(guān)系和尾實體的組合個數(shù),FN表示未被識別出的頭實體、關(guān)系和尾實體的組合個數(shù).

3.3 對比實驗設(shè)置

為驗證提出的掛載武器裝備領(lǐng)域知識結(jié)合多輪對抗攻擊的復(fù)雜三元組方法RDA的有效性,實驗采用了目前在三元組抽取任務(wù)中效果最好的4個模型進行比較.第1個模型是2017年Zheng Suncong[16]在ACL會議上提出的NovelTagging;第2個模型是2018年Zeng Xiangrong[17]在ACL會議上提出的CopyR;第3個模型是2019年Fu Tsu-Jui[18]在ACL會議上提出的GraphRel;第4個模型是2019年的蘇劍林[19]提出的百度三元組抽取方法(稱為SJL);第5個是2020年田佳來等人[20]在NLPCC2020會議上提出的HSL方法.對比實驗的設(shè)置與對比實驗所對應(yīng)的特點說明情況如表5所示.

表5 對比實驗信息表Table 5 Comparative experimental information

其中,NovelTagging方法采用端到端模型思想,使用Bi-LSTM進行語義信息捕獲,設(shè)計了全新的數(shù)據(jù)標(biāo)注策略,用阿拉伯?dāng)?shù)字1和2分別代表了頭尾實體的相對位置,將關(guān)系抽取任務(wù)轉(zhuǎn)化為了橫向上的序列標(biāo)注問題.CopyR方法將翻譯領(lǐng)域常用的復(fù)制機制引入了關(guān)系抽取任務(wù),是典型的聯(lián)合學(xué)習(xí)架構(gòu).采用兩種策略解碼,一種是聯(lián)合解碼器,另一種是多個分離解碼器,采用LSTM進行語義捕獲,通過多個分離解碼器開展復(fù)雜三元組的抽取.GraphRel方法在Glove訓(xùn)練詞向量的基礎(chǔ)上使用LSTM網(wǎng)絡(luò)捕獲上下文信息,然后利用Bi-GCN網(wǎng)絡(luò)構(gòu)建了依存結(jié)構(gòu)多跳信息進行捕獲完成兩個階段的任務(wù).第1階段的任務(wù)是對實體對進行所屬關(guān)系的判斷;第2階段的任務(wù)是使用Bi-GCN對入邊和出邊的詞特征進行加強學(xué)習(xí),使GCN具有方向特性更加適應(yīng)關(guān)系的有向性的特點.SJL方法首先開展了對實體的識別工作,然后將主語的信息和采用Bi-LSTM對句子的上下文信息進行捕獲輸入至模型中進行0、1序列標(biāo)注,對復(fù)雜三元組擁有一定的處理能力.HSL方法使用具有殘差連接的膨脹卷積技術(shù),擴大了模型的感受野,對信息的遺漏問題進行了緩解,利用自注意力機制對關(guān)系進行抽取,對復(fù)雜三元組有較好的抽取能力.

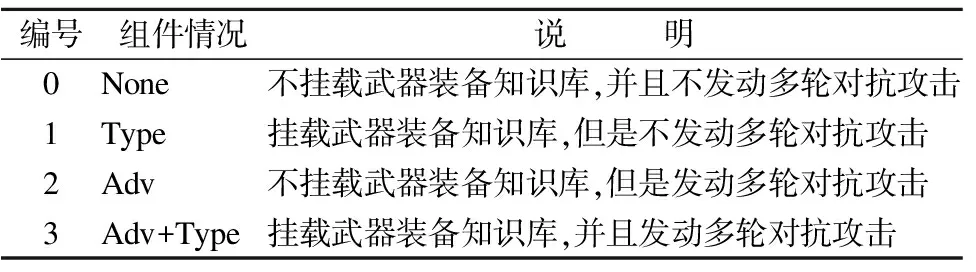

3.4 消融實驗設(shè)置

為驗證提出的RDA方法中模型組件的效果,以分析多輪對抗攻擊和武器裝備領(lǐng)域知識對實驗結(jié)果的貢獻(xiàn)情況,設(shè)定了4組實驗進行消融分析.第1組是去除掉多輪對抗攻擊和武器裝備知識庫;第2組是去除對輪對抗攻擊,保留武器裝備知識庫;第3組是去除武器裝備知識庫,保留多輪對抗攻擊;第4組是都保留多輪對抗攻擊并掛載武器裝備知識庫.消融實驗如表6所示.

表6 消融實驗信息表Table 6 Ablation test information

3.5 實驗參數(shù)設(shè)置

實驗運行在Linux Ubuntu操作系統(tǒng)上,編程語言為Python 3.6.9,使用Pytorch框架搭建神經(jīng)網(wǎng)絡(luò).依據(jù)服務(wù)器的GPU大小設(shè)定Batch_size 設(shè)置為32.本文中的武器裝備知識庫采用Word2Vec模型掛載,向量維度設(shè)置為300,滑動窗口設(shè)置為5,低頻詞閾值設(shè)為1.多輪對抗攻擊的干擾強度系數(shù)為1.0.采用早停法對訓(xùn)練進行控制優(yōu)化,容忍度設(shè)置為20,波動變化的閾值設(shè)置為0.00002.本實驗相關(guān)的參數(shù)如表7所示.

表7 模型參數(shù)設(shè)置信息Table 7 Model parameter setting information

3.6 實驗結(jié)果與分析

3.6.1 對比實驗結(jié)果分析

提出的RDA方法運行在Linux Ubuntu操作系統(tǒng)下,使用GPU進行矩陣化加速.訓(xùn)練過程中對數(shù)據(jù)進行了7:2:1的比例進行劃分.經(jīng)過多輪的調(diào)參訓(xùn)練,對學(xué)習(xí)率、干擾強度系數(shù)、變化閾值、容忍度等參數(shù)進行了多次的嘗試,最后得到模型參數(shù)設(shè)置信息表中的最佳參數(shù)組合.最終對比實驗的表現(xiàn)對比如表8所示.

表8 對比實驗結(jié)果Table 8 Comparative experimental results

經(jīng)過對表8中的數(shù)據(jù)分析,可以看出采用單層序列標(biāo)注的編號為0的NovelTagging與采用分層序列標(biāo)注的編號為3的SJL方法相比F1值表現(xiàn)分別為23.65%和74.24%,原因可能是兩個方面:一個原因是前者的語義捕獲相對欠佳;另一個原因可能是前者單一的橫向序列標(biāo)注任務(wù)無法解決復(fù)雜三元組的存在的標(biāo)簽重疊問題,而后者的縱向分層可以緩解標(biāo)簽堆疊的問題.編號為2的采用單一聯(lián)合解碼器和采用多個分離解碼器的模型實驗結(jié)果取得了18.24%和25.57%的F1值,據(jù)此可看出后者多個分離解碼器可緩解復(fù)雜三元組遇到的兩大問題:SEO和EPO,獲得了7.33%的表現(xiàn)提升.采用兩階段的標(biāo)號為3的SJL方法和采用膨脹卷積技術(shù)的HSL方法在數(shù)據(jù)集上的F1值表現(xiàn)分別為74.24%和79.17%,獲得了4.93%的表現(xiàn)提升,可以看出后者采用的膨脹卷積技術(shù)將感受野擴大是對關(guān)系抽取任務(wù)是有利的.上述方法沒有將知識提示融合到模型抽取中,并且魯棒性因為數(shù)據(jù)有限的原因受到了一定的限制.提出的RDA方法通過掛載武器裝備領(lǐng)域知識,對實體的類型解釋作為新的知識提示融入到模型中,作為第1階段的獎勵,然后結(jié)合多輪對抗攻擊提高了樣本多樣性,在有限度的條件下給與模型最大化的困惑增強了模型的魯棒性,最終獲得了最佳表現(xiàn):81.72%的F1值,與NLPCC2020提出的HSL相比獲得了2.55%的表現(xiàn)提升.

NovelTagging方法的單一的序列標(biāo)注任務(wù)、CopyROneDecoder的單個聯(lián)合解碼器和GraphRel1p方法的無Bi-GCN分支,表現(xiàn)均不佳,原因可能是SEO和EPO導(dǎo)致的標(biāo)簽層次堆疊、分類結(jié)果多樣、共享片段的強關(guān)聯(lián)問題導(dǎo)致的.然后SJL方法采用分層標(biāo)注的思想,較以前的方法得到了顯著地提升,然后HSL方法使用膨脹卷積技術(shù)擴大了感受野,將召回率進行了提升,獲取到了一個更佳的表現(xiàn).RDA一方面在模型訓(xùn)練中通過發(fā)動多輪對抗攻擊,提升困惑度的方法增強了模型的魯棒性;另一方面利用武器裝備領(lǐng)域知識庫擴充了頭實體類型表述的知識提示,獎勵了結(jié)合多輪對抗攻擊的主語識別器的正確樣本,最終獲得了SOTA.

3.6.2 消融實驗結(jié)果分析

為了驗證本文提出的組件對實驗效果的影響.通過剝離掉不同的組件,對實驗進行分析對比,實驗結(jié)果如表9所示.

表9 消融實驗結(jié)果Table 9 Ablation results

從表9可以看出,在不加任何組件,只使用BERT模型作為預(yù)訓(xùn)練模型引入通用領(lǐng)域知識后,表現(xiàn)達(dá)到了80.18%的F1值.將實驗編號0和1進行對比,能夠發(fā)現(xiàn)掛載的武器裝備領(lǐng)域外部知識庫對表現(xiàn)的提高做出較大貢獻(xiàn),F1值提高了0.98%.將實驗標(biāo)號0和2進行對比可以發(fā)現(xiàn),在訓(xùn)練時發(fā)動多輪對抗攻擊是有效的,提高樣本多樣性,在一定程度上增大了模型的困惑度,F1值提升了0.25%.將實驗標(biāo)號0和3進行對比可以發(fā)現(xiàn),在訓(xùn)練時發(fā)動多輪對抗攻擊并掛載武器裝備領(lǐng)域外部知識庫后效果得到顯著提升,二者結(jié)合后F1值提高了1.54%.在不加任何組件的時候,實驗結(jié)果的召回率是最低的,通過增加多輪對抗攻擊組件、武器裝備領(lǐng)域外部知識庫組件召回率都得到一定量的提升;實驗的精準(zhǔn)率在加入武器裝備領(lǐng)域外部知識庫組件后得到了提高,但是在發(fā)動多輪對抗攻擊后卻下滑了,原因可能是多輪對抗攻擊的強度稍微高了,模型的困惑度提高了.在加上多輪對抗攻擊和武器裝備領(lǐng)域外部知識庫以后,實驗結(jié)果的精準(zhǔn)率得到了進一步的提高,召回率略微下滑,最終F1的表現(xiàn)總體提高了.原因可能是在多輪對抗攻擊后,部分頭實體無法獲得正向的武器裝備領(lǐng)域知識庫的知識提示,沒有獲取到知識獎勵.

為更加直觀地說明對比實驗的表現(xiàn)差異,設(shè)定了包含SEO和EPO兩類三元組的例句進行進一步具體的對比分析.例句的實驗結(jié)果如表10所示.

表10 三元組抽取樣例表Table 10 Example of the extracting triple

如表10所示,通過對比實驗的樣例可以看出0號實驗的NovelTagging方法的抽取缺失了三元組,沒有完成復(fù)雜三元組的抽取,可能是因為只是在標(biāo)注層面設(shè)計了全新的標(biāo)注策略,并未針對SEO和EPO三元組的問題進行針對性設(shè)計.1號實驗的CopyR方法將復(fù)制機制應(yīng)用到了關(guān)系抽取的任務(wù)中,通過樣例可以發(fā)現(xiàn)對SEO類型的三元組抽取效果相較于0號實驗的NovelTagging方法有所提高,但是仍然沒有發(fā)現(xiàn)隱含的三元組知識;對EPO三元組的抽取效果仍然不佳,可能是復(fù)制機制對頭尾實體沒有進行有效的復(fù)制并成功匹配導(dǎo)致的;2號實驗的GraphRel方法雖然使用RNN和GCN增強了編碼能力,但是針對武器裝備領(lǐng)域的抽取結(jié)果表現(xiàn)不佳;3號實驗的SJL方法將主語的先驗信息融入了模型,在SEO三元組文本上相較于0號實驗的NovelTagging抽取出更多的三元組,但是還是沒有抽取出隱含的三元組知識;4號實驗的HSL方法使用殘差連接的膨脹卷積技術(shù)對3號實驗的SJL方法進行了改進,相較于0、1、2實驗而言保持了SEO三元組的良好抽取表現(xiàn)外還對EPO三元組的效果進行了提升.RDA對3號實驗和4號實驗所采用的兩階段式抽取框架進行了改進提升,取得了最佳的抽取效果.

4 結(jié) 語

為解決武器裝備領(lǐng)域中存在的大量單實體重疊(SEO)和實體對完全重疊(EPO)問題,提高復(fù)雜三元組的抽取效果,提出了一種掛載武器裝備領(lǐng)域知識結(jié)合多輪對抗攻擊的復(fù)雜三元組抽取方法(RDA).該方法在以BERT模型作為預(yù)訓(xùn)練模型,在引入通用領(lǐng)域知識的基礎(chǔ)上,使用結(jié)合多輪對抗攻擊的頭實體識別器利用指針網(wǎng)絡(luò)實現(xiàn)了頭實體的識別,盡最大可能地將數(shù)據(jù)發(fā)動干擾提高了數(shù)據(jù)的樣本多樣性,增大了模型的困惑度,提高模型的魯棒性.通過掛載武器裝備領(lǐng)域外部知識庫,對類別信息作為知識提示融入模型,進一步地豐富了信息表示.經(jīng)過對比實驗驗證,提出的RDA方法優(yōu)于現(xiàn)有方法,有效解決了武器裝備領(lǐng)域的復(fù)雜三元組的抽取問題.然而,提出的RDA方法在知識提示部分利用武器裝備領(lǐng)域外部知識庫的資源實現(xiàn)對正確地頭實體進行知識獎勵,本質(zhì)上還是以提高非結(jié)構(gòu)化文本底層特征的豐富度為切入點.在以后的研究中,可以考慮對多模態(tài)知識提示,從而進一步地對現(xiàn)有知識進行充分挖掘.