基于多可穿戴傳感器的用戶人體復雜行為主動識別

葉彩仙,胥立軍

1.廣州新華學院 信息與智能工程學院,廣東東莞 523133 2.廣州新華學院 人工智能與數據科學系,廣東東莞 523133

0 引言

一般來說,人體行為識別技術主要利用所設計的采集程序,在不斷變化的背景環境下進行周期的人體行為數據獲取并及時作出分類處理,利用多維算法來完成最終的復雜行為主動識別。針對于特定用戶人體復雜行為的識別是一項十分繁瑣的工作,過程中不僅要對采集獲取的數據進行分類化處理,還需要篩選、剔除不合理信息,以確保后續識別結果的可靠性與真實性。此外,對于復雜行為的主動識別,要根據用戶的特征及習慣來解析,這也是一個十分復雜的過程,較難把控。

當前的用戶人體復雜行為主動識別算法多為目標采集與智能算法結合,參考文獻[1]和文獻[2]的設定傳統改進MobileNet V1 用戶人體復雜行為主動識別方法、傳統Conv-Involution 用戶人體復雜行為主動識別方法,這一類主動識別算法雖然能夠實現預期的識別任務與目標,但是缺乏針對性與具體性,面對不同的識別對象時,難以進行精準特征定位與解析,導致最終的識別結果出現不可控的誤差。文獻[3]提出了一種基于梅爾頻率倒譜系數(Mel-frequency Cepstral Coefficients,MFCC)特征的Wi-Fi 信道狀態信息人體行為識別方法,這種方法過于依賴外部硬件設備,一旦硬件受限,識別的F1-score 數值較低,導致最終識別結果不理想。

為解決以上方法存在的問題,提出對基于多可穿戴式傳感器數據融合的用戶人體復雜行為主動識別方法的設計與驗證研究。多可穿戴式傳感器數據融合主要指的是通過智能手環、陀螺儀、加速度計等傳感裝置進行范圍之內用戶行為數據的采集,例如:心率、多巴胺、眼球追蹤停留時間、位置等,將融合后的數據與主動識別工作相結合,一定程度上能夠強化識別的精準度及可靠性,為后續相關技術的發展與完善奠定基礎[4]。

1 基于多可穿戴式傳感器的用戶指標數據采集

在主動識別用戶人體復雜行為前,需要通過傳感器[5-7]采集用戶人體的指標數據。該步驟采用多個可穿戴式傳感器采集數據,包括心率傳感器、運動傳感器、全球定位系統(Global Positioning System,GPS)傳感器、智能手環、陀螺儀等[8-9],將其佩戴在用戶身上,在傳感器上設置節點,通過部署的節點進行多可穿戴式傳感器的關聯搭接,采集用戶可識別數據。采集的數據包括用戶生理、生化和行為指標數據,后續研究中融合多個傳感器采集的數據,為主動識別用戶人體復雜行為奠定基礎。用戶的生理指標數據是人體本能做出的反應數據;用戶生化指標數據是生理行為的一種延伸,是基于生理反應所形成的指標數據;用戶行為指標數據是用戶最終的外在動機表現。通過多個可穿戴式傳感器采集這些數據,是因為生理-生化-行為實際上是一個循環性的過程,包含了用戶人體在執行行為時的大多數信息,通過多個可穿戴式傳感器采集信息范圍較廣,可以在一定程度上提高行為識別準確性。具體采集過程如下:

首先,在接入系統中布設一定數量的監測傳感節點,這些監測節點均為可穿戴式傳感器,傳感器之間互相關聯,形成全覆蓋性的數據識別結構。基于多個可穿戴式傳感器,設計用戶生理-生化-行為指標數據采集流程,如圖1 所示。

根據圖1,通過多個可穿戴式傳感器完成用戶生理-生化-行為指標數據采集。設定多個可穿戴式傳感器的數量為n,第i個可穿戴式傳感器采集的原始數據為(t),則歸一化處理采集的數據,獲得采集后的用戶生理-生化-行為指標數據,公式為:

式中,(t)max表示可穿戴式傳感器采集的原始數據最大值;(t)min表示原始數據最小值。通過多個可穿戴式傳感器采集了用戶生理-生化-行為指標數據,為后續數據融合的對象。

2 多可穿戴式傳感器數據融合的復雜行為主動識別方法

2.2 多傳感器數據融合的虛擬場景構建

虛擬現實(Virtual Reality,VR)是常見的輔助性技術,該技術應用于用戶復雜行為主動識別工作處理。本文引入該技術,為用戶人體復雜行為主動識別奠定基礎。首先,基于上述章節,通過多個可穿戴式傳感器采集的用戶生理-生化-行為指標數據,設計多維復雜行為主動識別的虛擬現實場景,結合實際的主動識別范圍進行基礎場景控制指標與參數的設置,如表1 所示。

表1 用戶行為主動識別虛擬現實場景指標表

根據表1 完成對用戶行為主動識別虛擬現實場景指標的設定,明確可穿戴式傳感器的實際覆蓋范圍,具體如公式(2)所示:

式中,W表示多可穿戴式傳感器的實際覆蓋范圍;B表示定向傳感次數;N為常數,表示求和上限;o表示轉換比;U表示可控傳感距離;χ表示重復傳感區域;F表示描述范圍。

在明確覆蓋范圍后,需要計算可穿戴式傳感器允許出現的最大傳感差值,具體如公式(3)所示:

式中,E表示最大傳感差值;Ψ表示可識別范圍;?(表示主動識別次數;l表示可控識別均值。

在可穿戴式傳感器覆蓋范圍之內,并且在傳感誤差允許下,結合三維圖形技術和多媒體技術,劃分基礎場景,并進行關聯設定,將區塊性的用戶關聯,進行全覆蓋虛擬轉換控制。結合VR 中的仿真技術和伺服技術,設計虛擬場景的功能執行單元,具體如圖2所示。

根據圖2 完成對虛擬場景功能執行單元的設計與驗證應用。基于VR 虛擬顯示基礎,在各個執行單元中增設監測程序,并與初始部署的節點進行搭接關聯,融合多個可穿戴式傳感器數據采集的用戶生理-生化-行為指標數據,公式為:

式中,wi表示多個可穿戴式傳感器的融合權值;ε表示覆蓋范圍閾值;ε'表示傳感誤差閾值。

通過對各個可穿戴式傳感器采集數據進行加權平均,根據不同傳感器的重要性給予不同權重,得到一個綜合的融合結果。

通過多媒體技術,結合融合處理后的可穿戴式傳感器采集的用戶生理-生化-行為指標數據,輸入CNN 網絡,得到基于虛擬現實的用戶運動行為場景,公式為:

通過公式(5)完成基于虛擬現實的場景構建,為后續的主動識別處理奠定基礎環境。

2.3 復雜行為主動識別方法設計

通過上述章節構建了虛擬現實場景,當用戶的行為在該場景中發生變化后,虛擬識別點會自動將數據傳輸到可穿戴式傳感器,通過融合該傳感器獲取的數據后,獲取用戶行為與預定數據相似度,通過相似度獲取有效數據,剔除部分冗余數據,具體如公式(6)所示:

式中,δ表示單元融合基準值;L表示融合次數;c表示關聯融合均值;d表示主動識別差;e表示錯誤識別次數。

依據得出的用戶復雜行為數據相似度,篩選當前可穿戴式傳感器識別的數據信息,便于使用者隨時查看所屬的數據,這樣的方式會形成一個用戶復雜行為主動識別序列,具體如圖3 所示。

根據圖3 完成主動識別序列參數的設定,計算公式為:

式中,φ表示融合相似度閾值。

依據上述獲取的主動識別序列參數,對用戶復雜行為變化進行追蹤性的識別處理[10-11]:

首先,主動提取用戶復雜行為的可識別特征點,在提取過程中,為了提高識別的準確性,引入自相關系數,公式為:

基于上述自相關系數,主動提取可識別特征點,公式為:

式中,σ表示標準差。

在確定可識別特征點后,引入循環神經網絡,通過該網絡實現用戶人體復雜行為主動識別,隱藏狀態的計算公式為:

式中,W(·)表示權重矩陣;θ表示偏置向量。

在確定循環神經網絡隱藏狀態后,獲取全連接層的計算公式:

式中,W'表示連接全連接層與隱藏狀態的權重矩陣。

使用Softmax 函數主動分類用戶復雜行為,主動識別用戶人體復雜行為,公式為:

至此,通過多個可穿戴式傳感器采集用戶的生理-生化-行為指標數據,融合采集的數據,根據融合后的數據構建了虛擬現實場景,基于構建的場景,結合融合相似度、自相關系數和循環神經網絡算法,主動識別用戶人體復雜行為。

3 實驗分析

分析與驗證基于多可穿戴式傳感器數據融合的用戶人體復雜行為主動識別方法應用效果。考慮到最終測試結果的真實性與可靠性,采用對比的方式展開分析。對比文獻設定為改進MobileNet V1 用戶人體復雜行為主動識別測試組、Conv-Involution 用戶人體復雜行為主動識別測試組,以及此次所設計的多可穿戴式傳感器數據融合用戶人體復雜行為主動識別測試組。根據當前識別需求及標準的變化,對最終得出的識別結果進行比照研究。

3.1 實驗準備

針對用戶人體復雜行為主動識別的測試需求,進行基礎環境的搭建。當前可以先采用Sgdm 優化器進行初始網絡的接入處理,設置最小批的識別處理大小為18,最大迭代次數控制在60,初始學習識別率為3.2,識別丟棄率為12.35%。針對當前測試的系統,隨機選定3 000 名青少年用戶進行測試,并將其劃分為5 個小組,人數分別為200 人、400 人、600 人、800 人和1 000 人。

在當前的程序中設計一個多維動態的數據集,選定可穿戴式的智能手環作為測試的主要輔助工具,在數據集中導入101 個動作類別作為主動識別的參數對象,接下來,基于實際的識別要求,進行測試控制參數的設置,如表2 所示。

表2 人體行為主動識別測試控制參數設定表

結合表2,實現對人體行為主動識別測試控制項目的設定。以此為基礎,利用可穿戴式傳感器采集的數據進行用戶行為特征值的計算。結合當前的測試,將該數值作為實際的限制測試標準,識別測定用戶人體復雜行為。

3.2 實驗過程及結果分析

在上述搭建的測試環境中,結合多可穿戴式傳感器數據融合原理,對選定的30 名用戶的人體復雜行為主動識別方法進行測試與分析。首先,設置6 個基礎的測試周期,每一個周期針對選定的用戶進行一次主動識別,并記錄下獲取的信息,利用智能手環對用戶的身體狀態進行實時監測,獲取對應的數據、信息,匯總整合之后,待后續的應用解析;接下來,在各個周期之內,通過系統下達指令,選擇指定的動作組為參照標準,并進行可控主動識別,智能手環在進行動作主動識別的過程中還會對識別的耗時進行記錄,計算出主動識別的平均耗時,如公式(13)所示:

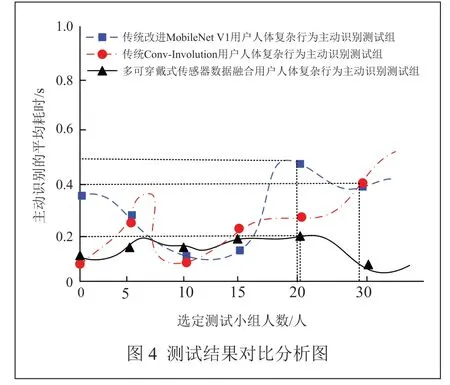

式中,B表示定向范圍;J表示識別均值差;Q表示識別精度。結合當前的測試,完成對結果的分析,具體如圖4 所示。

根據圖4 完成對測試結果的分析。對比于傳統的改進MobileNet V1 方法、Conv-Involution 方法測試組,本文設計的人體復雜行為主動識別測試組最終得出的主動識別的平均耗時被較好地控制在0.2 s 以下,說明在可穿戴式傳感器數據融合原理的輔助下,所設計的針對復雜人體行為的主動識別方法更為高效、精準,誤差可控,具有實際的應用價值。

在上述實驗分析的基礎上,為了進一步分析該方法的識別性能,以F1-score 作為評估指標,其計算公式為:

式中,P0、P1分別表示識別準確率和召回率。

通過公式計算出F1-score 數值,該數值越大越好。實驗結果如表3 所示。

表3 不同方法的F1-score 結果

根據表3 數據可知,3 種方法的F1-score 數據均在0.900 以上。通過對比可知,在測試人數達到30 人時,傳統改進MobileNet V1 識別測試組的F1-score 數值為0.915,傳統Conv-Involution 主動識別測試組的F1-score 數值為0.939,基于多可穿戴式傳感器數據融合的識別組的F1-score 數值為0.986,本文方法的F1-score 數值最高,比對比方法提高了0.040 以上。因此,該方法具備更高的識別準確性。

4 結束語

綜合上述分析,本文設計的基于多可穿戴式傳感器數據融合的用戶人體復雜行為主動識別方法在初始的行為主動識別覆蓋范圍較小,且在各個領域受到一定限制的情況下,面對不同的傳感器數據,利用多可穿戴式傳感器進行數據的采集與融合可進一步擴大主動識別的范圍。與此同時,結合多模態數據融合、概率推理和深度學習等原理,不斷完善、優化當前的主動識別方法。針對人體復雜行為識別的雙向特征,形成與之匹配的識別機制,可進一步提升整體的識別效率和準確性,其識別平均耗時低于0.2 s,并且F1-score 數值達到0.986,驗證了其具備一定的可行性和有效性,為后期關聯技術的發展提供參考依據和理論借鑒。