基于4R危機管理模型的教育人工智能倫理風險防范體系構建

摘要:人工智能技術的快速發展正深刻影響和改變教育教學領域。因其智能化、自主性和交互性特點,教育人工智能應用帶來諸多便利和優勢的同時,也引發了諸多倫理風險和挑戰,需要謹慎應對和積極解決。基于SHEL風控模型,教育人工智能應用的倫理風險可歸納為軟件相關、硬件相關、環境相關和人件相關四類風險,倫理風險防范現存三個短板急需化解;借鑒4R危機管理模型,該文構建了一個多方參與、全程管理、高效協同的倫理風險防范體系,設計四層實踐路徑,并結合實踐闡述了風險防范的實現方式,以創新地應對教育人工智能應用的倫理風險防范問題,助推教育人工智能的可持續健康發展。

關鍵詞:教育人工智能;倫理風險;SHEL風控模型;4R危機管理模型

中圖分類號:G434 文獻標識碼:A

* 本文系國家社會科學基金教育學重大課題“新一代人工智能對教育的影響研究”(課題編號:VGA230012)研究成果。

一、引言

當前,新一代人工智能已廣泛應用于多個領域,在教育領域的應用和成就尤為顯著,特別是以ChatGPT、Gemini、文心一言、訊飛星火為代表的人工智能大模型技術迅猛發展,對教育模式產生深刻影響[1]。2024年2月15日,OpenAI發布了視頻生成模型Sora,以逼真、穩定、持久的視頻生成效果驚艷世界。Sora憑借提供高質量且定制化的視頻內容,將極大地豐富并改進教育領域的教學資源與方法,為學生們打造更為生動的學習體驗,引領教育進入一個全新的紀元。基于人工智能的個性化學習與創新教育,將塑造教育發展新趨勢[2]。

教育人工智能通過促進學生個性化學習、幫助教師處理大量重復性任務等,極大提高了學習效率和教學質量,但同時亦孕育了不少挑戰。例如,人工智能可能無法充分考慮到每個學生的局限性和潛力,影響學生的發展[3];人工智能無法完全模仿人類間的情感和非言語交流,導致教育缺失人文關懷和情感共鳴[4];此外,還存在學生隱私泄露和數據安全等方面的擔憂等問題[5]。這要求教育人工智能在應用過程中,重視倫理規范的建設、防范倫理風險的發生至關重要。若僅憑借傳統的自上而下、被動式防范策略,難以有效應對教育領域人工智能應用所引發的復雜倫理風險問題,故有必要探索新的防范模式。本文旨在探討構建一個多方參與、全程管理、高效協同的教育人工智能倫理風險防范體系,可以更好地識別、評估和緩解這些風險,確保教育人工智能可持續健康應用。

二、教育人工智能倫理風險問題及防范現狀

(一)教育人工智能主要倫理風險問題

人工智能的廣泛應用,變革了原有對教育的解讀、反思及期望,進而引發混亂與焦慮[6]。人工智能在教育領域的應用雖然提高了教學效率和提供了個性化學習體驗,但也引發了隱私泄露、算法偏見、教育不公平等一系列倫理問題。吳永和等將倫理問題歸納為個人倫理、技術倫理、教育生態倫理三個層次[7],王茹俊等從信息、師生關系、算法、學術四個方面對倫理問題進行了總結[8],雷宏振等將倫理問題劃分為隱私暴露與信息安全控制風險、虛假信息派生所帶來的信息傳播風險、算法偏見所帶來的決策和政策風險和責任界定模糊風險等四大類[9],教育人工智能倫理問題正受到學界的廣泛關注和積極研究。

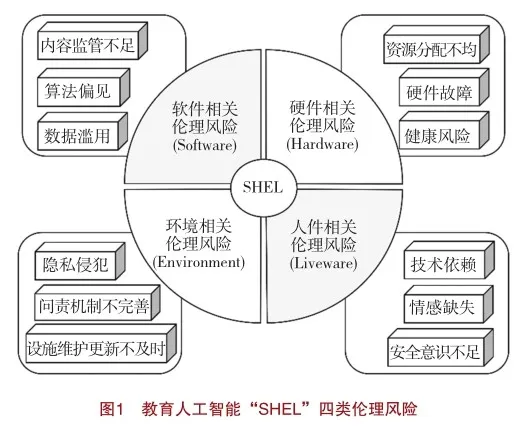

本文使用愛德華(Elwyn Edwards)教授提出的SHEL模型作為教育人工智能倫理風險分析框架,該模型旨在研究環境內其他因素與“人”這一核心要素相互影響,從而導致與人相關風險事故發生的問題[10]。最初用于航空業,用于分析人為因素在安全事故中的作用[11],后又擴展到工業、醫療領域,尤其是在護理安全管理領域中被廣泛運用。根據SHEL模型,將教育人工智能的倫理問題歸納為軟件相關風險、硬件相關風險、環境相關風險和人件相關風險四類,如圖1所示。

1.軟件(Software)相關倫理風險

軟件要素不僅指計算機軟件,還包括程序、規程、規則等。人工智能算法本身是價值無涉的,但算法開發的過程中卻存在著人為價值介入的可能性。例如,人工智能在模型訓練時,是基于人類反饋不斷自我優化,其中存在隱含偏見的可能;人工智能的訓練數據來自全球的語料庫,其中英語語料占比頗高,因而會有政治、經濟、文化歧視的可能,甚至會滲透西方的意識形態。此外,雖然開發者在開發過程中有所限制,但由于缺乏有效的法規監管,人工智能生成的不合理甚至不合法的內容仍可以在互聯網上傳播,污染了學習者的知識來源[12]。另外,人工智能系統,作為一種對教育大數據進行深入分析、精準判斷與科學決策的系統,其核心在于數據驅動與認知計算[13]。教育大數據都是教師、學生、家長等在教育教學活動過程中產生的,本身并無好壞之分,但這些數據產生之后被人工智能企業或學校所控制,存在被不合理使用的風險。

2.硬件(Hardware)相關倫理風險

硬件要素指物理設備和設施,如機械、設備、工具等。人工智能的不合理應用,會造成教育領域的“數字鴻溝”。我國城鄉發展并不均衡,教育資源配置存在顯著差異[14]。城市地區的學生通常能夠獲得先進的教育資源,包括接觸和利用最新的人工智能技術。相比之下,農村地區的學生則面臨較為有限的教育資源,甚至難以接觸到這些先進技術。這種城鄉之間在教育資源獲取方面的鴻溝,加劇了教育不公平現象。此外,硬件設備故障或性能不足可能引發風險事故,進而嚴重干擾教學活動的正常進行。以美國特斯拉自動駕駛技術引發的數起交通事故為例,這些事件表明當前人工智能技術尚處于弱人工智能階段,技術尚未完全成熟。鑒于此,在教育領域引入人工智能技術時,必須以高度審慎的態度對其潛在風險進行全面評估,對教育人工智能可能的故障風險加以防范。教育人工智能的廣泛應用也可能會給學生的身心健康造成潛在威脅。日本文部科學省的一項研究表明,使用ICT授課后,學生反應“眼睛疲勞”的比例較高[15],導致學生過度依賴屏幕,增加視力損害的風險。浙江某小學通過為學生佩戴監控頭環來提高學生的專注度,這種做法可能會給學生帶來不必要的壓力和焦慮感,對其心理健康產生負面影響。

3.環境(Environment)相關倫理風險

環境要素包括客觀的物理環境,如教室的布局、設備的可用性和技術基礎設施的條件;還包括抽象的社會環境,如社會對人工智能技術的接受程度、教育政策、文化背景以及經濟條件等,這些環境因素共同影響人工智能在教育領域的有效應用。學校物理環境的不完善可能成為教育人工智能倫理風險的潛在源頭。例如,若學校缺乏及時維護硬件設備的資金和資源,可能導致教育人工智能系統硬件設備的故障率增加,進而影響正常的教學活動。此外,人工智能在教育領域的應用通常是復雜的黑箱系統,師生、家長等通常不了解其具體的運行規則,造成當人工智能應用出現問題時,存在責任歸屬不清晰的風險,缺乏明確的事故問責機制和事故原因查明程序,難以對可能的事故進行有效預防和及時糾正。另外,人工智能若使用不合理,比如濫用監視工具,將會使師生陷入馬克·波斯特(Mark Poster)所說的“超級全景監獄”之中,所有教育和學習行為都將暴露無遺,隱私的保護將面臨嚴峻挑戰。

4.人件(Liveware)相關倫理風險

人件要素是指與人有關的各種要素,包括教師、學生、家長等在教育人工智能應用中的行為、能力、態度和互動。人工智能的應用在目標對象上具有廣泛性,并沒有類似影視劇的分級限制,這也決定了它會無差別地對待所有使用者。人工智能在教育領域應用時,使用者很大可能是未成年人。因其缺乏對年齡階段的分層設定,會使未成年學生接觸到超出其年齡范圍的信息,可能會對未成年學生的身心發育造成不良影響。人工智能在教育領域的誤用、濫用也可能會導致學術不端甚至影響科研發展與進步。學生在使用的過程中,往往為了追求效率而放棄自己的思考,只想走“學術捷徑”。從個體角度而言,會影響學生高階思維能力和科研能力的發展;從科研角度而言,這種行為的泛濫會導致研究成果質量的下降,阻礙學術的發展與進步。此外,目前人工智能技術在教學中的應用,主要聚焦于協助師生完成“功能性”任務,卻在一定程度上忽視了對情緒方面的關注與處理[16],缺少師生交流中所包含的關懷、尊重、共情等真實的情感流露,不利于學生的情感發展。

(二)教育人工智能倫理風險防范現狀

針對教育人工智能目前存在的倫理風險,國際組織和各國政府紛紛發布政策文件,旨在規范人工智能在教育領域的應用。聯合國教科文組織已發布了包括《人工智能與教育:北京共識》《人工智能與教育:政策制定者指南》《教育與研究領域生成式人工智能》等在內的一系列重要文件。這些文件共同強調了在教育中整合人工智能時必須遵循的核心原則,如促進教育包容性、公平性,提高質量、確保數據隱私和技術的倫理使用等。 中國政府同樣高度重視人工智能發展所帶來的一些問題。習近平總書記曾強調,人工智能技術具有“雙刃劍”的特性,可能會引發法律和社會倫理沖擊、個人隱私侵犯以及國際準則挑戰等問題,因此必須確保人工智能的安全、可靠與可控。2021年,科技部發布《新一代人工智能倫理規范》,要求在人工智能領域,要兼顧隱私、偏見、啟發、公平等道德議題,倡導“善用”,避免“濫用”,推動人工智能健康發展。文獻梳理發現,學界目前對教育人工智能倫理風險的研究主要分為風險識別和風險應對兩類[17],其中風險識別研究劃分依據各異,劃分類型多樣,研究已較為深入;風險應對方面,教育領域主要采用一種“原則方法”,旨在規避倫理風險,為教育人工智能健康發展提供方向指導。

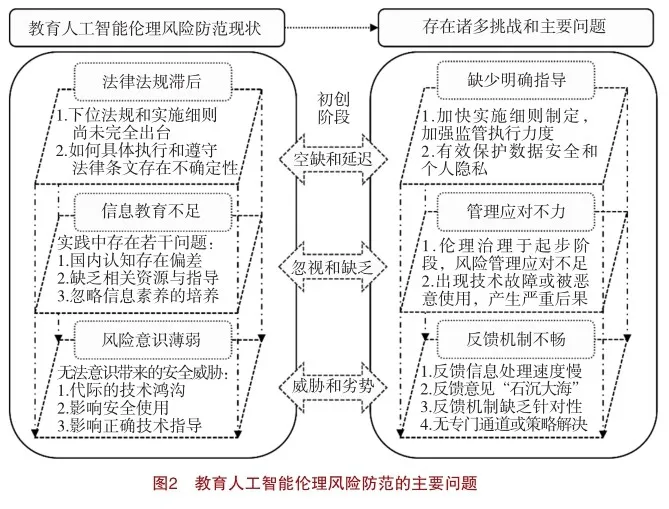

總的來說,在如何科學、有效地防范教育人工智能的倫理風險方面,相關的研究和實踐仍處于起步階段[18]。現階段對于教育人工智能倫理風險的防范仍存在諸多挑戰,傳統的風險防范措施已不能滿足要求,主要問題歸納為幾個方面,如圖2所示。

1.法律法規滯后,缺少明確指導

目前,用以約束教育人工智能開發應用的法律法規尚未完善,教育用戶的合法權益難以得到有效保障。以隱私安全和數據泄露問題為例,2021年,我國頒布了《中華人民共和國數據安全法》,對數據處理活動進行了全面規范,旨在確保數據安全并推動數據的合理開發利用。它與已實施的《中華人民共和國網絡安全法》《中華人民共和國個人信息保護法》等法律法規相互補充,構筑中國數據安全的堅實法律保障體系。這些法律雖然奠定了數據處理活動規范和數據安全保障的基礎,但由于配套的下位法規和實施細則尚未完全出臺,導致在實際操作中如何具體執行和遵守這些法律條文仍存在不確定性。這種法規體系中的空缺和延遲,使得隱私泄露和數據安全問題的解決并不徹底,特別是在迅速發展的教育人工智能領域,如何確保數據安全、避免隱私泄露仍然是一項挑戰。因此,需要加快配套實施細則的制定和推出,以及加強監管執行力度,才能真正實現法律的初衷,有效保護數據安全和個人隱私。

2.信息教育不足,管理應對不力

盡管我國對信息素質教育一直給予高度關注,但面向青少年的信息素質教育,是直到《教育信息化2.0行動計劃》出臺之后,才取得了顯著的進步與發展。《中小學數字校園建設規范(試行)》《中國教育監測與評價統計指標體系(2020年版)》《提升全民數字素養與技能行動綱要》等政策法規的頒布,均強調了重視培養信息與數字素養。除政府外,大中小學、公共圖書館以及社會力量也積極參與學生信息素養教育中[19]。例如廣州市頒布的《廣州市公共圖書館條例》提出公共圖書館需提供信息素養教育;360集團與共青團中央合作開發“團團微課:青少年網絡素養公開課”等。盡管國家致力于推廣信息素養教育,但實踐中仍存在若干問題。例如,中國家長通常缺席于孩子的信息素養培養,究其原因,一是國內對于信息素養的認知存在偏差,不少人認為其并不是一門“有用”的學科。二是家長缺乏相關資源與指導,心有余而力不足。中小學的信息素養教育也存在問題,很多中小學長期以計算機教育為主,而忽略了信息素養的培養[20]。此外,當前教育人工智能倫理治理探索尚處于起步階段,風險管理應對存在不足[21]。當教育人工智能存在技術故障或被惡意使用時,可能導致嚴重后果。例如,印度特倫甘納邦在統考中應用智能計分系統,因系統問題導致部分考生被誤標為“缺考”,引發多人自殺悲劇。

3.風險意識薄弱,反饋機制不暢

現階段,我們面對的學生群體主要屬于Z時代。 這一代人伴隨著人工智能技術的發展成長,通過數字和智能產品認知世界,但缺乏察覺人工智能應用風險的意識與能力[22]。家長作為另一關鍵的參與者,往往對新技術的了解不如他們的子女,這種代際之間的技術鴻溝使得他們在風險防范意識方面同樣處于劣勢。許多家長對于人工智能技術的具體應用、潛在風險及其管理措施缺乏足夠的認識,這不僅影響了他們自身的安全使用,也影響了他們在家庭教育中對孩子正確使用技術的指導。然而,目前尚未采取有效措施來顯著增強學生和家長對教育人工智能倫理風險的防范意識。另外,教育人工智能應用尚處于起步階段,由于經驗尚未積累豐富且管理機制不夠完善,其使用過程中不可避免遇到問題,亟需構建流暢的問題反饋機制。例如河南省各高校建立健全師生意見處理和反饋機制,及時傾聽回應師生意見建議;一些中小學也開設了意見建議反饋渠道,例如廈門一中集美分校通過校長信箱和線上反饋的方式積極采納師生意見。但這種做法并不普遍,且在實踐中存在諸多問題。一方面,反饋信息的處理速度慢,甚至存在反饋意見“石沉大海”的情況。另一方面,現有的反饋機制往往缺乏針對性,特別是對于人工智能在教育領域應用所引發的特定問題,未能提供專門的通道或策略來解決。

三、教育人工智能倫理風險防范體系構建

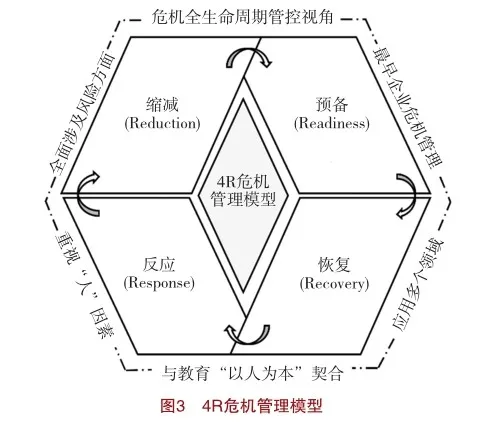

(一)4R危機管理模型

美國危機管理學家羅伯特·希斯(Robrt Heath)在《危機管理》一書中首先提出了包含縮減(Reduction)、預備(Readiness)、反應(Response)和恢復(Recovery)四個階段的4R危機管理模型,如圖3所示。縮減階段是核心環節,從環境、結構、系統和人員等方面入手進行實施,減少危機情境的攻擊力和影響力,規避潛在風險,貫穿于危機管理的全過程;預備階段的核心任務是構建和完善危機預警機制,增強組織成員對危機的預見性和應對能力[23];反應階段指當危機事件發生時,通過高效溝通應對、精準媒體管理、果斷決策執行等手段提升處理危機效果[24];恢復階段指危機管理結束后的形象恢復和經驗總結,避免重蹈覆轍[25]。4R危機管理模型最早用于企業危機管理,后因其科學性和實用性被廣泛用于醫院管理、突發公共衛生事件處理、高校安全防范體系的構建、檔案應急服務保障等多個領域[26]。因其對風險規避、預警機制、危機處理、恢復舉措等過程的全面涉及,以及對“人”這一因素的重視,與教育中“以人為本”的理念高度契合,因此在教育人工智能倫理風險防范中該理論也具有較強的適用性。

(二)教育人工智能倫理風險防范主體的確立

教育人工智能倫理風險防范的研究中,強調“技術與人文并重”的研究視角,從“技術維度、制度框架及人性考量”的核心層面出發,致力于構建全面系統的倫理風險防范體系[27]。教育人工智能倫理風險的防范是一個多層次的任務,涵蓋宏觀層面(政府)、中觀層面(學校,人工智能企業)和微觀層面(學生和家長)等多個防范主體。從宏觀層面上,政府從政策制度、法律法規、科學文化等角度入手,確保教育人工智能的倫理性和合法性,營造良好的倫理風險認知和防范氛圍;從中觀層面上,人工智能企業從源頭上防范倫理風險,考量其產品的設計、開發和部署過程中的倫理風險,基于用戶友好性、系統穩健性、數據安全性等視角強化人工智能產品本身。學校是教育人工智能應用的直接場所,確保教育人工智能的選擇、實施和管理符合教育倫理原則;從微觀層面上,學生作為教育人工智能應用的直接受益者,通過增強自我保護意識并深入了解自身權利,在使用過程中提出問題和擔憂,成為倫理風險防范的重要一環。而家長,作為孩子教育的直接利益相關者,承擔起監督和評估學校人工智能技術使用情況的責任,確保技術的運用真正有助于孩子的全面發展。因此,需要政府、人工智能企業、學校、學生和家長共同參與,形成多方合力,方能對教育人工智能的倫理風險進行切實有效的防范。

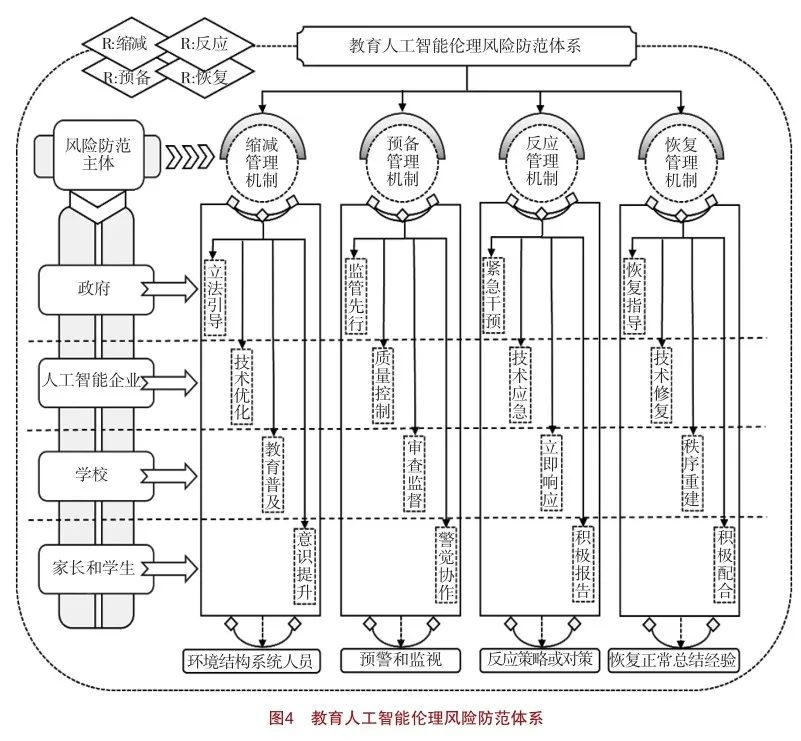

(三)教育人工智能倫理風險防范體系的構建

從危機生命周期角度出發,依據4R危機管理模型構建包含多種機制的教育人工智能倫理風險防范體系,包括縮減管理機制、預備管理機制,反應管理機制和恢復管理機制。再結合上文確定的風險防范主體,包括政府,人工智能企業,學校,家長和學生,構建教育人工智能倫理風險防范體系,如圖4所示。

1.縮減管理機制

縮減管理主要從環境、結構、系統和人員幾個方面去入手,減少風險發生的可能,降低風險發生帶來的不良后果。縮減管理機制是整個風險防范體系的核心,貫穿于整個風險防范的過程[28]。在這一階段,政府需要做到立法引導,以法制約束人工智能的透明化使用。為了保護知識產權或商業競爭,許多人工智能企業會故意制造算法黑箱或其他設備軟硬件上的問題,因而政府需完善相關法律機制,明確責任主體的權利與義務,嚴懲違反法律或道德規范的行為。人工智能企業則需做到技術優化,通過不斷的技術革新和優化,確保教育人工智能產品應用的安全可靠。同時建立一套基本的倫理道德準則,進一步強化和細化人工智能公司的研發與制造責任,確保不侵犯消費者基本權益,保障消費者切身利益,維護消費者整體福祉[29]。學校作為人工智能應用的主戰場,應加強師生的信息素養教育,引導師生對于信息資源獲取和篩選問題的思考,提高對人工智能風險的認識。在引入人工智能技術之前,學校需對自身的切實需求和智能化程度進行合理評估,有針對性地選擇適配度高的智能系統或產品,確保產品經過嚴格測試后方可納入使用;在引入人工智能技術之后,學校要優化配套的管理措施,全面跟蹤人工智能產品的使用情況,適時做出針對性調整。學生和家長應做到意識提升,提高對人工智能倫理風險的認識,合理使用人工智能工具,并在發現問題時及時反饋給學校和相關企業。

2.預備管理機制

預備階段的核心任務是建立預警機制、完善信息傳遞體系,通過訓練與演習,切實提升危機應對能力[30]。政府需要做到監管先行,建立全過程監管機制,對教育人工智能應用進行前瞻性監控和評估。例如歐盟頒布《數字服務法》,規定大型在線平臺不得歧視不同用戶;美國頒布《人工智能應用監管指南》,強調人工智能應用的公平原則[31]。人工智能企業應做到質量控制,從源頭確保產品質量。現有法律規定,產品進入市場流通時的科學水平不能發現缺陷存在時,企業免責。流通后發現缺陷的,企業應及時采取警示等措施,否則企業承擔侵權責任。而人工智能企業相較于其他企業而言,對產品的控制能力更強,對人工智能產品的監督控制可從研發階段持續至使用階段[32]。因此,企業應實施全程監督機制,一旦發現產品存在算法偏見、危害用戶等情況,迅速采取糾正措施。

學校應發揮審查監督作用,構建教育人工智能倫理風險全過程監管體系。在人工智能進入學校前,要求人工智能企業提供算法功能、數據來源和可能風險等詳細數據;人工智能進入學校后,構建暢通的信息反饋渠道,一旦發現使用過程中出現低質或有害內容,及時向相關部門反應并調整;同時,學校也應定期組織教育人工智能倫理風險的訓練演練,增強師生對潛在危機的識別與應對能力。學生和家長則應提高對風險的警覺性,積極參與學校的人工智能政策討論,參與相關的培訓和教育活動,確保人工智能的安全和負責任使用。

3.反應管理機制

反應管理指在危機發生之際,迅速規劃應對策略,有效實施解決措施,以應對或解決危機狀況[33]。政府應做到緊急干預、迅速介入,協調相關部門,制定并執行應急措施。人工智能企業需立即啟動應急預案,使用技術手段盡快控制和修復問題;同時主動配合政府調查,提供必要的技術支持。學校則應立即響應,根據教育部發布的《教育部等五部門關于完善安全事故處理機制維護學校教育教學秩序的意見》,當安全事故發生時,學校必須迅速應對,立即啟動緊急救助流程,并成立由學校高層領導親自負責的應急處置小組。在情況緊急復雜的情況下,學校應主動與當地人民政府、教育主管部門或其他相關機構緊密合作,形成高效的聯合處置機制。為確保信息的及時傳遞與有效反饋,還需建立起一條快速暢通的信息溝通渠道,積極引導所有相關方依法依規行事,確保糾紛得到妥善解決。因此學校在危機發生時應立即采取措施保護學生安全,通知家長,暫停使用有問題的人工智能應用,并協助政府和企業進行問題調查。學生和家長應積極履行報告義務。一旦識別到潛在風險,立即向學校和相關部門報告,并嚴格遵循相關部門的指導意見,以防風險進一步擴大。

4.恢復管理機制

恢復階段是指在危機終止后,迅速復原人員、資金、物資,深刻反思、總結經驗。為此,羅伯特·希斯提出了PICPIC恢復策略,包括計劃(Planning)、信息(Information)、核心(Core)、人(People)、整合(Integration)、持續性(Continuity)。這里計劃指制定教育人工智能倫理風險的防范和恢復計劃,確保在遇到數據泄露、算法偏見、系統故障等風險時,能迅速且有效地采取行動;信息指在風險發生時,及時收集和分析關于教育人工智能系統的準確信息,如故障原因、影響范圍等,以便做出合理的決策并及時向相關利益相關者通報;核心指確定并保護教育人工智能應用中的核心資產和關鍵功能,如學生數據、教學內容和算法模型等;人指注重教育參與者,包括學生、教師和家長的安全和需求,必要時提供心理支持、技術幫助;整合指將風險防范和恢復活動與整體教學策略和運營緊密結合,確保教育目標和質量在恢復過程中不受影響;持續性指在應對即時風險的同時,考慮教育人工智能長期的穩定和發展。

根據PICPIC恢復策略,政府需要進行恢復指導和資源協調,幫助受影響的學校或機構快速恢復正常運作;同時總結經驗教訓,避免同樣的危機再次發生。人工智能企業需迅速響應,利用專業技術團隊對問題進行修復,通過軟件更新、硬件更換或技術咨詢等方式,確保產品和服務恢復到安全狀態。學校則需立即采取措施穩定教學秩序,重新規劃課程和教學活動,確保學生教育進程不受影響。同時,加強與學生和家長的溝通,緩解他們的顧慮。學生和家長應理解并配合學校和政府的恢復措施,共同努力恢復正常教育活動。

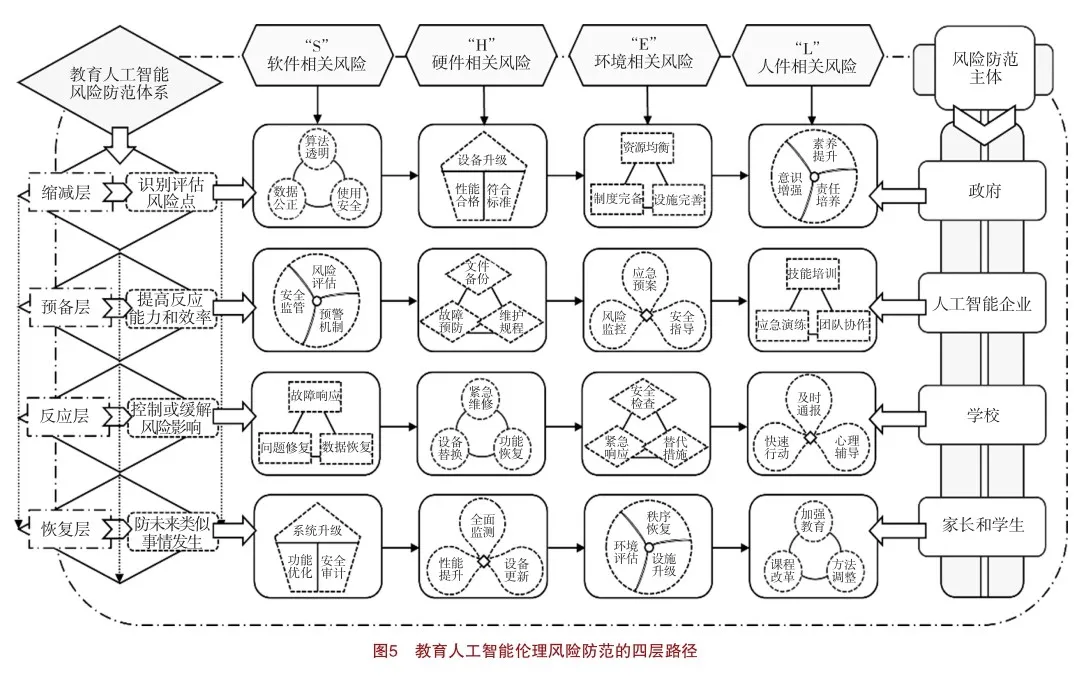

四、教育人工智能風險防范的實踐路徑

前述從教育人工智能應用的四類倫理風險出發,確定了四個防范主體;根據風險管理的全過程,構建教育人工智能倫理風險防范的四層實現路徑:縮減層,預備層,反應層,恢復層。本研究以軟件、硬件、環境和人件四類風險為例,結合上述框架,詳細闡述風險防范的實現路徑,如下頁圖5所示。

在縮減層,通過提前規劃和策略實施來預防軟件、硬件、環境和人件方面的風險。這一階段的核心在于識別和評估潛在的風險點,然后采取措施來減少這些風險發生的可能性。預備層的主要目標是建立和完善應對突發事件和潛在風險的準備措施,重點在于通過培訓和演練,提高教育參與者的應急反應能力和協作效率;同時,加強對軟件、硬件、環境和人員方面的監控和評估,以便及時發現問題并采取措施。在反應層,主要任務包括立即啟動事先準備好的應急響應計劃,利用預警系統提供的信息迅速識別和評估事件的性質和嚴重程度,然后執行相應的行動來控制或緩解風險帶來的影響。恢復層需要評估風險事件造成的損害,實施必要的修復工作,以及更新和優化應急響應計劃以防未來類似事件的發生。

(一)軟件相關倫理風險的防范

在軟件相關風險的防范中,算法偏見是最為突出的情況[34],各方主體應共同努力,確保算法的透明度、數據的公正性以及軟件使用的安全性。

進入縮減管理階段,人工智能企業和學校將對軟件算法進行深入審查,識別糾正潛在的偏見,確保算法的決策過程公開透明;同時強化軟件使用的安全性,采取適當的加密措施、訪問控制和定期的安全審計等措施,保護軟件免受外部攻擊和內部濫用,保證教育大數據的安全性。人工智能企業還將確保數據處理的公正性,對輸入數據進行嚴格的篩選和校驗,避免不公平或有偏見的數據影響算法的輸出結果。

進入預備管理階段,重點是建立風險評估、安全監管和預警機制,政府建立健全的監管體系,對軟件的開發、部署和使用進行持續的監督和檢查,確保符合相關的安全標準和法律法規。學校系統地識別和分析潛在的軟件風險,對風險等級進行評估,以便后續實施針對性的風險防范措施。同時,建立有效的預警機制是及時發現和應對風險事件的重要手段,學校通過實時監控軟件系統的運行狀態和用戶行為,一旦檢測到異常或潛在威脅,立即啟動預警機制,采取必要的應急措施,防止風險事件的發生或擴散。

進入反應管理階段,學校及時聯系相關企業團隊,快速啟動故障響應、問題修復和數據恢復程序,實施事先準備好的應急措施,迅速定位問題的根源,進行有效的故障修復。為了實現這一目標,學校將與人工智能企業緊密合作,共享資源和信息,確保技術支持的及時性和有效性。技術團隊還與教師、學生和家長保持良好的溝通,提供必要的指導和支持。

進入恢復管理階段,不僅修復風險事件引起的損害,還對軟件系統進行全面的升級和優化。這一階段技術團隊會對系統進行細致的審查,識別并解決存在的安全漏洞,同時引入新的技術和功能以增強系統的穩定性和用戶體驗。安全審計也是這一階段的重要組成部分,通過對系統的安全控制和管理流程進行全面評估,確保所有安全措施得到有效執行,并符合最新的安全標準。恢復管理階段還包括對事件處理過程的回顧和總結,從中汲取教訓,更新風險管理策略,預防未來同類事件的發生。

(二)硬件相關倫理風險的防范

在硬件相關風險的防范中,縮減管理階段政府將通過政策制定和資金合理分配,確保硬件資源在各地區均衡配置,縮小城鄉之間的數字鴻溝,實現教育公平和提高教育質量。 學校則與人工智能企業緊密合作,對硬件設備進行定期升級和性能測試,確保硬件設備滿足最新的安全標準,對學生的身心健康不產生負面影響。學生和家長將增強風險意識,積極學習硬件使用和維護知識,定期檢查設備安全,遵循學校的安全指導。

進入預備管理階段,學校建立系統的硬件維護和故障預防機制,例如制定定期的維護計劃,確保硬件設備的性能和安全性得到持續監控;明確緊急故障處理流程,以便在硬件出現問題時能夠迅速采取措施;對重要文件做好備份,以防數據丟失或損壞。學校還將引入故障監測和預警系統,一旦發現異常或潛在故障,立即發出預警,以便及時采取預防措施。

進入反應管理階段,技術團隊迅速診斷問題所在,采取必要的修復措施,同時確保替換的設備符合教育應用的要求。學校會對受影響的教學活動進行調整或臨時替代,幫助學生適應臨時教學安排,并及時通知家長相關情況,以保障教育活動順利進行。

進入恢復管理階段,學校將開展全面檢測,對受影響的硬件系統進行徹底檢查和維修。通過升級硬件設備和引入新技術,提高系統的整體性能和穩定性。

(三)環境相關倫理風險的防范

在環境相關風險的防范中,縮減管理階段政府通過出臺政策法規,推動教學資源在各地區和學校之間的均衡分配,確保以強有力的法律保護個人隱私,同時明確教育人工智能風險責任歸屬,保障教育公平和學生權益。學校則改善教學環境,提供穩定的網絡連接和適宜的學習空間,定期維護和更新服務器、終端設備和軟件系統等設施,確保其性能符合教育需求,使教育人工智能能在良好的環境中運行;同時對師生進行隱私保護和數據安全的教育和培訓,增強其信息保護的意識。

進入預備管理階段,學校針對潛在的環境風險制定明確的響應計劃,涵蓋自然災害、設施故障等情況的預案。對環境也持續進行監控,以便及時發現和響應可能的風險事件。學校還將制定安全指導,教育師生如何在緊急情況下保護自己和他人,確保在發生風險事件時,每個人都能夠安全有效地應對。

進入反應管理階段,學校緊急響應,迅速評估風險事件的影響;同時,與當地應急管理部門密切合作,實施必要的安全措施來保護師生安全,例如啟動緊急疏散計劃、關閉受影響的設施等。若教學場所受損,則提供替代的學習空間或資源,確保教育活動能夠正常進行。學生和家長做到積極配合學校的應急措施,遵循安全指導,確保個人安全,共同應對環境風險事件。

進入恢復管理階段,首要的是恢復正常的教學和學習環境,包括對受損的教育設施進行全面檢查,進行必要的修復或升級。學校也對整個風險事件進行詳細評估,分析事件發生的原因,評估應對措施的有效性,更新和完善風險防范措施。同時,及時與師生和家長溝通,傳達恢復進度和后續安排,減輕他們的擔憂并獲得支持和配合。

(四)人件相關倫理風險的防范

在人件相關風險的防范中,關鍵在于通過教育和培訓加強師生及家長對人工智能技術及其潛在風險的理解。針對學生在使用教育人工智能可能會產生的問題,在縮減管理階段,一是確保他們接觸到適齡內容并防范不良影響,二是鼓勵他們摒棄對人工智能工具的過度依賴,培養獨立思考和深度學習的習慣,三是在教育中增強人際交互和情感教育的內容。政府、人工智能企業、學校、學生及家長將做到各司其職,共同努力,確保教育人工智能應用中人件相關風險得到有效防范。例如,人工智能企業確保產品的適齡性和安全性,開發和提供適合不同年齡段學生的教育應用,并加入相應的內容過濾和父母控制功能,減少不良信息的傳播;學校強化對學生的監督和引導,定期進行信息素養和網絡安全教育,培養學生的獨立思考和批判性分析能力。教師則做到因材施教,重視學生的情感體驗,確保學生之間及師生之間有充足的人際互動時間;學生自身則要增強自我保護意識,培養獨立思考和深度學習的習慣,避免過度依賴人工智能工具;

進入預備管理階段,通過定期的培訓和演練,增強師生和家長面對數據泄露、網絡攻擊等突發事件的應對能力;同時,建立一個支持性的網絡以加強家校社之間的協作溝通,便于風險發生時,所有相關方能夠迅速、有效地聯合行動。

進入反應管理階段,及時通知師生和家長有關風險事件的細節、潛在影響和應對措施,以便他們能夠快速做出反應。對于受事件影響的師生,學校提供必要的心理支持和輔導服務,例如提供專業的心理咨詢、設立心理支持熱線或組織團體輔導活動,幫助其應對可能出現的心理壓力或焦慮。

進入恢復管理階段,學校通過推廣面對面授課和實地體驗學習,平衡教學方法,減少對技術的過度依賴;引入情感智力和社交技能課程,增加師生互動,彌補技術使用中的情感聯系缺失。同時,加強網絡安全和個人信息保護教育,提升學生的安全意識。

五、結語

教育人工智能倫理風險防范已成為社會各領域重點關注的議題。教育人工智能倫理風險可能削弱學生隱私保護、加劇教育不平等,并影響學生的全面發展,對教育系統的公正性和可持續性構成挑戰。智慧教育時代,妥善應對倫理風險,確保產品服務盡責,已成為當務之急。本研究基于SHEL風控模型,教育人工智能應用的倫理風險可歸納為軟件相關、硬件相關、環境相關和人件相關四類風險,倫理風險防范現存三個短板急需化解;借鑒4R危機管理模型,構建了一個多方參與、全程管理、高效協同的倫理風險防范體系,設計四層實踐路徑,并結合實例闡述了風險防范的實現方式,以期應對迅速發展的人工智能技術,更好地促進教育公平與教育包容,實現教育人工智能的健康發展,構筑人機和諧共生的教育生態系統。當然,在智能化時代,教育人工智能的倫理風險防范是一個持續的過程。教育人工智能應用的倫理風險不僅限于本文所提及的四類,未來還可能出現更多目前尚未被充分認識的風險。因此,未來亟需更精細化地對學生群體分類,因材施教,量身定制教育方案;更深入地剖析倫理風險,規避潛在危害,確保教育實踐的道德正當性,完善技術標準在多樣化風險場景中的實踐落地,優化教育與人工智能協同發展的現實路徑。

參考文獻:

[1] 曹培杰,謝陽斌等.教育大模型的發展現狀、創新架構及應用展望[J].現代教育技術,2024,34(2):5-12.

[2] 顧小清.當現實逼近想象:人工智能時代預見未來教育研究[J].開放教育研究,2021,27(1):4-12.

[3] Tao B,Díaz V,Guerra Y.Artificial intelligence and education, challenges and disadvantages for the teacher [J].Arctic Journal,2019,72(12):30-50.

[4] 于秋月,劉堅.“人工智能+教育”的倫理分析及主體重塑[J].學術探索,2024,(1):148-156.

[5] 鄒開亮,劉祖兵.生成式人工智能個人信息安全挑戰及敏捷治理[J].征信,2024,42(1):41-50+57.

[6] 唐漢衛.人工智能時代教育將如何存在[J].教育研究,2018,39(11):18-24.

[7] 吳永和,吳慧娜等.推動人工智能向善發展:教育與人工智能共同的責任[J].中國電化教育,2024,(1):51-58.

[8] 王茹俊,王丹.ChatGPT介入醫學教育的倫理風險及應對策略[J].醫學與哲學,2024,45(2):76-81.

[9] 雷宏振,劉超等.論生成式人工智能的技術創新倫理周期——以ChatGPT為例[J].陜西師范大學學報(哲學社會科學版),2024,53(1):97-107.

[10] 王穎捷.認知癥老年人機構照護環境風險防范設計研究——基于SHEL風險控制理論模型分析[J].南京藝術學院學報,2023,(2):183-187.

[11] Chang Y H,Yang H H,Hsiao Y J.Human risk factors associated with pilots in runway excursions [J].Accident Analysis & Prevention,2016,94:227-237.

[12] 蘭國帥,杜水蓮等.生成式人工智能教育:關鍵爭議、促進方法與未來議題——UNESCO《生成式人工智能教育和研究應用指南》報告要點與思考[J].開放教育研究,2023,29(6):15-26.

[13] 馮銳,孫佳晶等.人工智能在教育應用中的倫理風險與理性抉擇[J].遠程教育雜志,2020,38(3):47-54.

[14] 李曉靜.數字鴻溝的新變:多元使用、內在動機與數字技能——基于豫滬學齡兒童的田野調查[J].現代傳播(中國傳媒大學學報),2019,41(8):12-19.

[15] 高益民,李宗宸.日本預防和減少教育信息化不良影響的基本對策[J].外國教育研究,2022,49(8):3-22.

[16] 孫立會.人工智能之于教育決策的主體性信任危機及其規避[J].電化教育研究,2023,44(3):21-27+43.

[17] 白鈞溢,于偉.教育人工智能倫理原則的有限性及其補正——兼論“原則-美德-法律”框架[J].中國電化教育,2024,(2):23-31.

[18][27] 杜嚴勇.人工智能倫理風險防范研究中的若干基礎性問題探析[J].云南社會科學,2022,(3):12-19.

[19] 羅藝杰.中美未成年人信息素養教育比較研究[J].圖書館,2023,(12):67-76.

[20] 吳建華,郭靜等.我國信息素質教育的主要問題、成因與對策分析——基于中美基礎教育階段課程標準的比較[J].情報科學,2012,30(7):967-973.

[21] 白鈞溢.教育人工智能倫理治理:現實挑戰與實現路徑[J].重慶高教研究,2024,12(2):37-47.

[22] 郭勝男,錢雨等.面向未成年人的AI安全風險:風險澄思、根源透析與治理進路[J].中國遠程教育,2023,43(7):39-46.

[23][26] 張林華,鄒潤霞.基于4R危機管理理論的檔案應急服務保障模式研究[J].檔案與建設,2022,(7):30-33.

[24] 張玉亮,楊英甲.基于4R危機管理理論的政府網絡輿情危機應對手段研究[J].現代情報,2017,37(9):75-80+92.

[25] 余豐民,周衛華等.基于4R模型的高校圖書館文獻服務應急保障策略探討[J].圖書館工作與研究,2020,(11):25-31.

[28] 王娟,柳輝艷.4R危機管理視角下的公立醫院網絡輿情與危機管理對策探析[J].中國醫院,2024,28(2):95-97.

[29][32] 胡元聰,李雨益.企業社會責任視域下人工智能產品風險防范研究[J].當代經濟管理,2020,42(4):19-26.

[30][33] 王曉茜.4R危機管理下高校應對新型肺炎疫情的策略探析——以同濟大學為例[J].中國高校科技,2020,(8):22-25.

[31] 王佑鎂,王旦等.基于風險性監管的AIGC教育應用倫理風險治理研究[J].中國電化教育,2023,(11):83-90.

[34] 王佑鎂,王旦等.敏捷治理:教育人工智能倫理治理新模式[J].電化教育研究,2023,44(7):21-28.

作者簡介:

王佑鎂:教授,博士生導師,研究方向為教育人工智能、智慧教育、數字閱讀。

利朵:在讀碩士,研究方向為教育人工智能。

王旦:在讀博士,研究方向為教育人工智能。

柳晨晨:博士,副教授,研究方向為教育人工智能。

Construction of Ethical Risk Prevention System for Educational Artificial Intelligence Based on 4R Crisis Management Model

Wang Youmei1, Li Duo1, Wang Dan2 , Liu Chenchen1

1.Research Center for Big Data and Smart Education, Wenzhou University, Wenzhou 325035, Zhejiang 2.Department of Educational Information Technology, East China Normal University, Shanghai 200062

Abstract: The rapid development of artificial intelligence technology is profoundly affecting and changing thgL3uqdDzHg2ABrlo2gl3Dy6MTC9nLtKZ5SLoOqMrjIg=e field of education and teaching. Because of its intelligence, autonomy and interactivity, while the application of artificial intelligence in education brings many conveniences and advantages, it also triggers many ethical risks and challenges, which need to be dealt with carefully and actively resolved. Based on the SHEL risk control model, the ethical risks of educational artificial intelligence applications can be summarized into four types of risks: software-related, hardware-related, environment-related and human-ware-related risks. There are three existing shortcomings in ethical risk prevention that need to be resolved; Drawing on the 4R Crisis Management Model, an ethical risk prevention system with multi-party participation, whole process management, and efficient synergy is constructed, a four-layer practice path is designed, and the realization of risk prevention is elaborated in the light of practice, so as to innovatively cope with the issue of ethical risk prevention of the application of AI in education, and to boost the sustainable and healthy development of AI in education.

Keywords: educational AI; ethical risk; SHEL risk control model; 4R crisis management model

收稿日期:2024年5月21日

責任編輯:趙云建