基于圖重構(gòu)的社交知識推薦

摘 要:

現(xiàn)有推薦模型大多聚焦于顯式地構(gòu)建用戶和物品的聯(lián)系,忽視了對圖結(jié)構(gòu)高階全局特性的建模,對用戶隱式興趣的挖掘不足。因此,提出了一種基于圖重構(gòu)的社交知識推薦模型(social knowledge recommendation based on graph reconstruction,SKRGR),引入圖重構(gòu)技術(shù)將用戶-物品知識圖譜劃分為多個子圖,并利用基于關(guān)系的圖注意力網(wǎng)絡和三層圖神經(jīng)網(wǎng)絡對其進行獨立編碼。通過實施鄰域增強策略,深入挖掘用戶的隱式興趣,促進了對鄰域局部特征的建模。為進一步提升節(jié)點表示的質(zhì)量,提出了全局對比學習機制,統(tǒng)一全局交互圖和局部協(xié)作圖的節(jié)點表征,并運用門控融合策略控制全局與局部的信息聚合。在Ciao和Epinions社交數(shù)據(jù)集上的實驗結(jié)果表明,SKRGR模型在recall指標上平均提升了8.77%,在NDCG指標上平均提升了13.40%,相較于DSL、CLDS等基線模型展現(xiàn)出了顯著的性能優(yōu)勢,驗證了其在捕捉用戶隱式興趣和建模全局特征方面的有效性。

關(guān)鍵詞:社交推薦;知識圖譜;對比學習;鄰域增強;圖神經(jīng)網(wǎng)絡

中圖分類號:TP391"" 文獻標志碼:A""" 文章編號:1001-3695(2024)12-011-3607-07

doi: 10.19734/j.issn.1001-3695.2024.05.0145

Social knowledge recommendation based on graph reconstruction

Zhang Xinyue, Gao Hui

(School of Computer Science amp; Engineering, University of Electronic Science amp; Technology of China, Chengdu 611731, China)

Abstract:

Most existing recommendation models focus on explicitly constructing the relationship between users and items, neglecting to model the high-order global features of graph structure and under-mining the implicit interests of users. Therefore, this paper proposed a social knowledge recommendation based on graph reconstruction (SKRGR), which introduced graph reconstruction technology to decompose the user-item knowledge graph into multiple subgraphs, and utilized relationship-based graph attention networks and three-layer graph neural networks to encode them independently. By implementing the neighborhood enhancement strategy, it deeply explored users’ implicit interests and facilitated the modeling of neighborhood local features. To further improve the quality of the node representations, this paper introduced a global contrastive learning mechanism to unify the node representations of the global interaction graph and the local collaboration graph, and used a gate fusion strategy to control the aggregation of global and local information. Experimental results on the Ciao and Epinions social datasets indicate that the SKRGR model achieves an average improvement of 8.77% in recall and 13.40% in NDCG. Compared to baseline models such as DSL and CLDS, SKRGR demonstrates significant performance advantages, validating its effectiveness in capturing users’ implicit interests and modeling global features.

Key words:social recommendation; knowledge graph; contrastive learning; neighborhood enhancement; graph neural network(GNN)

0 引言

隨著智能化時代的興起,人們在享受互聯(lián)網(wǎng)提供的便利的同時,也面臨著信息過載和信息迷航的困境,易被大量無關(guān)和冗余的信息干擾。作為一種高效的信息過濾工具,推薦系統(tǒng)旨在挖掘和分析用戶的歷史行為記錄,為用戶提供個性化推薦服務,現(xiàn)已廣泛應用于自媒體、電商等領(lǐng)域。

傳統(tǒng)基于協(xié)同過濾的推薦算法依賴于對交互矩陣的相似性計算,在二部圖中顯式地構(gòu)建用戶與物品之間的聯(lián)系。社交推薦在二部圖中引入了用戶之間的社交信任關(guān)系,反映了用戶之間的興趣相似性和信任程度。然而,社交網(wǎng)絡的稀疏性使得推薦系統(tǒng)難以精確地捕捉用戶的隱式興趣。社交關(guān)系的復雜性導致用戶與物品之間的高階關(guān)系難以被充分挖掘。隨著社交規(guī)模的不斷擴大,傳統(tǒng)推薦模型難以擴展為大規(guī)模的社交網(wǎng)絡,導致推薦性能下降。

知識圖譜是一種由〈實體,關(guān)系,實體〉的三元組形式組成的圖狀數(shù)據(jù)結(jié)構(gòu),能有效捕捉節(jié)點間的復雜語義與拓撲關(guān)聯(lián),緩解社交推薦的數(shù)據(jù)稀疏性問題。將知識圖譜整合至推薦系統(tǒng)已成為當下的研究熱點,知識圖譜蘊涵豐富的實體信息,為推薦系統(tǒng)提供了多層次的上下文環(huán)境,極大地促進了推薦結(jié)果的多樣性和可解釋性。社交知識推薦是一種融合了社交關(guān)系的知識圖譜推薦方法,它通過構(gòu)建包含了用戶與物品交互信息及社交關(guān)系的知識圖譜,全面刻畫用戶畫像,有助于提升推薦系統(tǒng)的個性化水平。

近年來,圖神經(jīng)網(wǎng)絡(GNN)結(jié)合深度學習[1]高效建模非線性特征,通過迭代傳播和鄰域聚合機制深入挖掘用戶和物品之間的潛在關(guān)聯(lián),在推薦系統(tǒng)領(lǐng)域取得了顯著成果。盡管圖神經(jīng)網(wǎng)絡展現(xiàn)出較大的發(fā)展?jié)摿Γ谏缃煌扑]領(lǐng)域仍存在一定的局限性。首先,現(xiàn)有圖推薦模型聚焦于目標節(jié)點局部特征的處理,忽視了對圖結(jié)構(gòu)整體特性的建模,導致推薦結(jié)果呈現(xiàn)片面性,難以滿足用戶多樣化與個性化的需求;其次,它難以充分捕捉用戶的隱式興趣,依賴于用戶與物品之間交互關(guān)系的顯式建模,忽視了推薦系統(tǒng)中用戶與用戶、物品與物品之間的隱性關(guān)系,限制了個性化推薦的深度與效果。因此,如何準確、高效地利用社交信息,促進全局與局部信息的深度融合,是社交推薦領(lǐng)域面臨的一項重要挑戰(zhàn)。

本文提出了一種基于圖重構(gòu)的社交知識推薦模型 (social knowledge recommendation based on graph reconstruction, SKRGR),運用圖重構(gòu)技術(shù),將用戶-物品知識圖譜劃分為四個子圖,并分別采用基于關(guān)系的圖神經(jīng)網(wǎng)絡和三層GNN對其進行獨立編碼。通過融合全局對比學習機制和鄰域增強策略,促進了對全局與局部特征的深入建模。相較于目前最先進的基線,SKRGR在recall指標上平均提升了8.77%,在NDCG指標上平均提升了13.40%。本文的主要工作如下:

a)引入社交關(guān)系,將用戶-物品知識圖譜解構(gòu)為多個子圖,分別對用戶的交互、協(xié)作和社交關(guān)系獨立編碼,實現(xiàn)了對不同節(jié)點和關(guān)系類型的細致建模。

b)設計鄰域增強模塊來整合局部的上下文信息,通過增強相似用戶和物品的鄰域表征,實現(xiàn)了對用戶興趣和物品吸引力的深度建模。

c)提出了全局對比學習機制,以實現(xiàn)全局交互圖與局部協(xié)作圖節(jié)點表示的統(tǒng)一,并運用門控融合策略聚合二者的表征信息。

1 相關(guān)工作

1.1 社交推薦

根據(jù)社會同質(zhì)性[2]和社會影響力[3]理論,社會關(guān)聯(lián)的用戶易展現(xiàn)出類似的興趣傾向。通過融合用戶的社交信息,深入理解用戶的社交興趣,有助于提升推薦質(zhì)量。文獻[4,5]將用戶的信任關(guān)系融入矩陣分解模型中,以確保相關(guān)聯(lián)的社交用戶的隱向量在特征空間中彼此接近。近年來,基于圖卷積網(wǎng)絡的社交推薦模型受到了廣泛的關(guān)注,文獻[6]利用社會圖的嵌入式傳播和消息傳遞機制來模擬用戶興趣的擴散過程。文獻[7]在推薦框架中注入了全局圖結(jié)構(gòu)感知的互信息,實現(xiàn)了對協(xié)作關(guān)系的進一步建模。文獻[8,9]在圖結(jié)構(gòu)的基礎上引入了注意力機制,以區(qū)分不同社交關(guān)系的重要性,為用戶和物品生成更加精確的嵌入表示。文獻[10,11]將自監(jiān)督信號注入異構(gòu)圖神經(jīng)網(wǎng)絡中,輔助社交監(jiān)督信號的節(jié)點表示學習。

1.2 基于知識圖譜的圖推薦算法

基于知識圖譜的圖推薦算法將實體和關(guān)系嵌入到低維的向量表示空間,運用圖結(jié)構(gòu)來表征節(jié)點間復雜的高階關(guān)系。文獻[12]應用圖注意力機制在協(xié)同知識圖譜上遞歸地傳播高階連通信息。文獻[13]提出了一種異構(gòu)傳播策略,通過結(jié)合協(xié)作信息和知識感知信號來豐富節(jié)點的特征表示。文獻[14]從意圖層面探索了基于關(guān)系感知的路徑聚合機制,通過引入互信息最大化的方式來探究用戶的真實意圖。文獻[15]設計了一種知識引導的對比學習方法,通過增加無偏交互邊的權(quán)重,有效地整合了知識圖譜中的語義關(guān)聯(lián),為推薦領(lǐng)域的進一步研究提供了有力支持。

1.3 對比學習

對比學習最初在計算機視覺領(lǐng)域[16]展現(xiàn)了極大的應用潛力,顯著推動了圖像分類、目標檢測等任務的發(fā)展。隨著研究的不斷推進,對比學習已成功拓展至自然語言處理[17]、推薦系統(tǒng)[18]等領(lǐng)域,旨在將節(jié)點映射至一個高維的語義空間,通過最大化正樣本間的一致性、最小化負樣本間的相似性來學習有效的特征表示。文獻[19]通過丟棄節(jié)點、邊和隨機游走三種操作生成了多個節(jié)點表示視圖,以實現(xiàn)節(jié)點表征的對比學習。文獻[20]從全局和局部角度構(gòu)建對比視圖,以自監(jiān)督的形式探索跨視圖之間的協(xié)作聯(lián)系。文獻[21]提出了一種超圖引導的自監(jiān)督學習范式,通過跨視圖的對比學習架構(gòu)捕獲局部和全局的協(xié)作關(guān)系。為減小社交和語義交互視圖的差距,文獻[22]提出了一種自適應的語義對齊方法,實現(xiàn)了跨視圖的自監(jiān)督增強。受上述文獻的啟發(fā),本文提出了全局對比學習機制,將全局交互表征與局部協(xié)作表征進行對比學習,旨在保持嵌入的一致性,進一步提升表征學習的質(zhì)量。

2 SKRGR模型

2.1 網(wǎng)絡框架設計

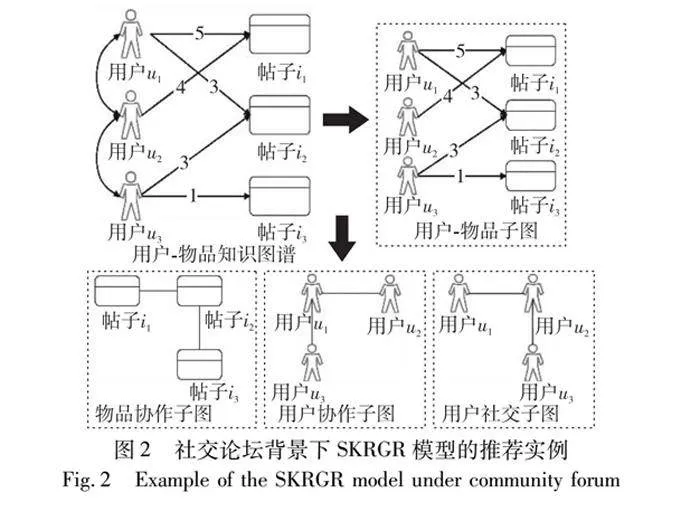

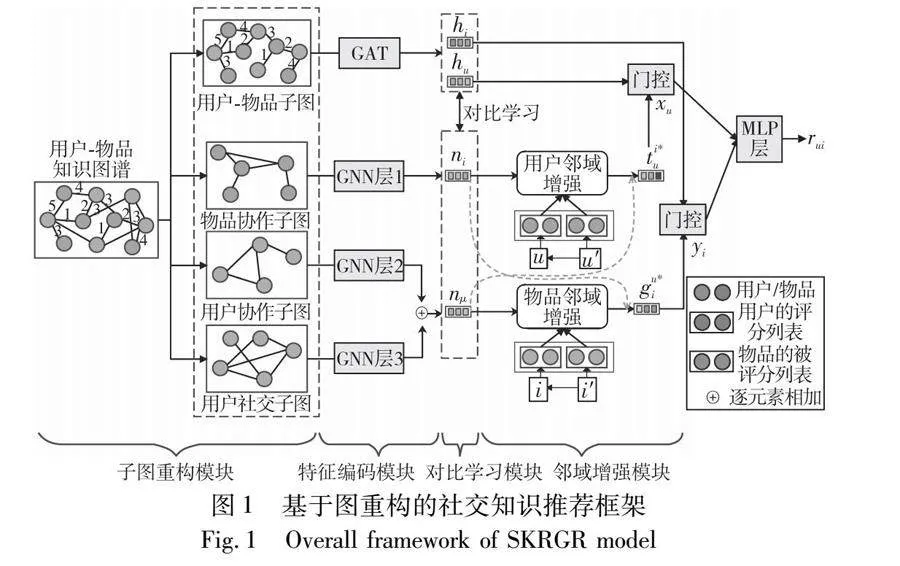

針對現(xiàn)有推薦模型在隱式興趣挖掘及圖結(jié)構(gòu)全局特性建模方面的不足,本文提出一種基于圖重構(gòu)的社交知識推薦模型SKRGR。該模型由子圖重構(gòu)、特征編碼、對比學習和鄰域增強四個部分組成,如圖1所示。在子圖重構(gòu)模塊,本文對整體的用戶-物品知識圖譜進行知識重構(gòu),依據(jù)節(jié)點類型和連邊關(guān)系重構(gòu)為用戶-物品子圖和用戶社交子圖,依據(jù)同類節(jié)點的相似度重構(gòu)為用戶協(xié)作子圖和物品協(xié)作子圖。在特征編碼模塊,為提高鄰域節(jié)點表示的區(qū)分度,提出采用基于關(guān)系的圖注意力網(wǎng)絡編碼用戶-物品子圖,生成用戶和物品的全局嵌入表示hu和hi,采用三層圖神經(jīng)網(wǎng)絡(GNN)編碼剩余子圖的嵌入表示,得到融合社交信息的用戶局部協(xié)作表示nu和物品局部協(xié)作表示ni。在對比學習模塊,將全局嵌入表示hu和hi分別與局部協(xié)作嵌入表示nu和ni作對比學習,在保留原始圖結(jié)構(gòu)的前提下引入自監(jiān)督信號,從全局層面提升節(jié)點表征學習的質(zhì)量。在鄰域增強模塊,通過增強相似用戶與相似物品的鄰域特征來融入上下文信息,細化了對節(jié)點局部表征的建模。為促進全局交互圖與局部增強圖表征的進一步融合,提出了門控融合策略,通過自適應地調(diào)整權(quán)重,控制整體和局部的信息流動。最后,將融合輸出的用戶和物品表征xu和yi經(jīng)過多層感知機(multi-layer perceptrons,MLP)處理,得到用戶u對候選物品i的預測評分rui。

2.2 子圖重構(gòu)

用戶-物品知識圖譜作為一種異構(gòu)圖網(wǎng)絡,涵蓋用戶和物品兩種類型的節(jié)點,融合社交、協(xié)作和交互關(guān)系,冗雜邊較多[23]。為細化對節(jié)點表示的建模,本文依據(jù)尾實體ID的范圍和關(guān)系類型將用戶-物品知識圖譜重構(gòu)為用戶-物品子圖和用戶的社交子圖。用戶-物品子圖中關(guān)系連邊的評分范圍為{1,2,3,4,5},用戶的社交子圖則采用二元值{0,1}來標識用戶間是否存在社交聯(lián)系。

為深入挖掘同類節(jié)點之間的潛在關(guān)聯(lián),本文基于節(jié)點間的相似性將異構(gòu)的用戶-物品知識圖譜重構(gòu)為同構(gòu)的協(xié)作子圖,以探尋同類相似節(jié)點間的協(xié)同聯(lián)系。受協(xié)同過濾原理的啟發(fā),如果節(jié)點A與同類節(jié)點B在鄰域上的重疊程度越高,二者偏好或特征相似的可能性越大。本文利用Jaccard相似度系數(shù)來衡量節(jié)點間的相似性:

sim(x1,x2)=RI(x1)∩RI(x2)RI(x1)∪RI(x2)(1)

其中:x1和x2表示同類的用戶或物品節(jié)點。預先設定一個閾值η,若sim(x1,x2)gt;η,則x1和x2建模為協(xié)作子圖的鄰居。

2.3 特征編碼

協(xié)作子圖和社交子圖聚焦于節(jié)點的相似性和社交關(guān)系,連邊只在節(jié)點間起連接作用,而不承載額外的表示信息,子圖中蘊涵了豐富的深層次特征,且節(jié)點趨向同質(zhì)性。因此,本文采用三層GNN分別對物品協(xié)作子圖、用戶協(xié)作子圖以及用戶社交子圖進行編碼:

nl+1i=σ(∑j∈N(i)(nli+w1(nli⊙nlj)))(2)

el+1u=σ(∑v∈N(u)(elu+w2(elu⊙elv)))(3)

ml+1u=σ(∑f∈F(u)(mlu+w3(mlu⊙mlf)))(4)

其中:w1、w2和w3代表可訓練的權(quán)重矩陣;σ(·)代表LeakyReLU激活函數(shù);經(jīng)過l次迭代傳播后,nl+1i、el+1u和ml+1u分別代表第l+1層物品協(xié)作子圖、用戶協(xié)作子圖和社交子圖的嵌入表示。采用連接操作聚合用戶協(xié)作子圖和社交子圖的嵌入表示,得到用戶的特征向量nl+1u:

nl+1u=el+1u+ml+1u2(5)

本文采用單層的基于關(guān)系的圖注意力網(wǎng)絡對用戶-物品子圖進行編碼,依據(jù)用戶的連邊評分和拼接后節(jié)點的向量表示信息,有效區(qū)分鄰域節(jié)點的重要性,并對用戶嵌入進行層歸一化處理:

au←i=exp[σ(wT(w1vr+w2(vu‖vi)))]∑j∈N(u)exp[σ(wT(w1vr+w2(vu‖vj)))](6)

hu=LN(∑i∈N(u)au←ivi)(7)

其中:vu表示用戶向量;vi表示用戶交互的物品向量;σ(·)表示LeakyReLU激活函數(shù);LN表示層歸一化操作(layer-wise normalization);N(u)表示用戶u直接交互的物品鄰域。在聚合物品的嵌入表示時,本文采用均值歸一化的方法,平等地考慮每位交互用戶的重要性:

ai←u=1num(i)(8)

hi=LN(∑u∈N(i)ai←uvu)(9)

其中:num(i)表示對物品i評分的用戶個數(shù)。基于關(guān)系的圖注意力網(wǎng)絡通過自適應地學習不同連接節(jié)點間的重要性,為每個鄰居節(jié)點分配相應的權(quán)重,充分考慮了節(jié)點間的復雜交互和依賴關(guān)系,提高了推薦的可解釋性。

2.4 對比學習

由于圖結(jié)構(gòu)的鄰域聚合機制聚焦于局部的信息傳播,缺乏對圖結(jié)構(gòu)整體性的全局認識,所以本文提出了全局對比學習機制,旨在全面把握圖數(shù)據(jù)的內(nèi)在規(guī)律和特性。保持全局表征的一致性是非常必要的,在同一語義空間中,對比學習旨在最大化正樣本之間的一致性來優(yōu)化節(jié)點表示,同時最小化負樣本間的一致性來增強模型的辨別能力。

SGL[18]通過隨機丟棄節(jié)點或連邊的方式構(gòu)造對比視圖,以增強節(jié)點的特征表示。然而,隨機丟棄節(jié)點或連邊可能導致圖中關(guān)鍵特征的丟失,而額外視圖的構(gòu)建進一步增加了模型復雜度與計算成本。近期SimGCL[24]的研究表明,圖數(shù)據(jù)的增強并不是必要的,對比學習性能提升的關(guān)鍵點在于優(yōu)化InfoNCE的對比損失函數(shù)。因此,本文維持原始的圖結(jié)構(gòu),將用戶-物品子圖分割為用戶嵌入hu和物品嵌入hi,通過一個MLP層映射至統(tǒng)一的對比損失空間,得到用戶和物品的嵌入表示h*u和h*i。同理,映射用戶和物品的協(xié)作表征,得到n*u和n*i。將同類節(jié)點的嵌入視為正樣本,將隨機選擇的不同類節(jié)點的嵌入視為負樣本,在InfoNCE的框架下優(yōu)化目標損失函數(shù):

3 實驗

3.1 數(shù)據(jù)集

本文SKRGR在Ciao和Epinions兩個公開的社交基準數(shù)據(jù)集上進行對比實驗。Ciao是一個規(guī)模較小的電子商務平臺數(shù)據(jù)集,涵蓋了用戶對已購商品的評分記錄以及相關(guān)的社交信息;Epinions是一個規(guī)模較大的在線平臺,涵蓋了商品評價和社交元素,該平臺以“用戶信任度”為核心,允許網(wǎng)站成員自主決定是否信任其他成員,形成了一個復雜的社交網(wǎng)絡。數(shù)據(jù)集詳細的統(tǒng)計信息如表1所示。

3.2 實驗參數(shù)

本文實驗環(huán)境基于PyTorch框架構(gòu)建,在 NVIDIA RTX 3090 GPU上進行模型訓練。本文采用Adam優(yōu)化器自適應地調(diào)節(jié)學習率并優(yōu)化參數(shù)。在數(shù)據(jù)的預處理階段,本文將社交數(shù)據(jù)集按照 6∶2∶2 的比例劃分為訓練集、驗證集和測試集。在模型訓練的過程中,設定學習率為1E-3,每個批次的樣本數(shù)量為 128,嵌入向量的維度為3,圖神經(jīng)網(wǎng)絡的層數(shù)為3,dropout 丟棄率為 0.1。在驗證階段,從負樣本集合中隨機抽取了100個樣本,與真實樣本一起進行排序,以衡量模型在推薦任務中的性能。

3.3 對比模型

為驗證本文SKRGR的有效性,選取了以下對比模型。

a)BPR[27]:適用于處理隱式反饋數(shù)據(jù),通過最小化貝葉斯個性化排名損失來優(yōu)化物品之間的排序。

b)FM[28]:適用于處理大規(guī)模稀疏數(shù)據(jù),采用向量內(nèi)積的方法建模特征的交互關(guān)系。

c)TrustMF[29]:將矩陣分解與用戶的信任關(guān)系相結(jié)合,融入用戶的社交信任關(guān)系來提升推薦質(zhì)量。

d)NGCF[30]:通過改進圖卷積神經(jīng)網(wǎng)絡(GCN)的結(jié)構(gòu),對高階的節(jié)點和關(guān)系建模,適用于協(xié)同過濾的推薦任務。

e)LightGCN[31]:提出了輕量圖卷積的概念,通過擯棄GCN的特征轉(zhuǎn)換和非線性激活模塊,使得模型輕便而高效。

f)DiffNet++[6]:作用于社交推薦,通過對統(tǒng)一框架下的社交影響力和用戶的興趣擴散建模,挖掘用戶潛在的協(xié)作興趣。

g)ARBRE[32]:提出了一種非對稱的情境感知架構(gòu),將由二部圖拆分的用戶與物品的協(xié)同圖作為聯(lián)合輸入,利用簡化的圖神經(jīng)網(wǎng)絡聚合用戶和物品的語義表征。

h)DSL[22]:提出了一種去噪的自增強范式,設計自監(jiān)督學習任務,實現(xiàn)了用戶交互視圖與社交視圖的自適應對齊。

i)CLDS[33]:提出了一種對比學習和雙階段圖神經(jīng)網(wǎng)絡的社會推薦算法,只保留具有共同偏好的社交關(guān)系,通過自對比學習方案提高節(jié)點表示的魯棒性。

3.4 時間復雜度分析

3.5 性能評估

為驗證SKRGR的有效性,本文設置推薦列表的長度K={5,10,15},在Ciao和Epinions數(shù)據(jù)集上作對比實驗,結(jié)果如表2所示。相較于目前最先進的基線,對于Epinions數(shù)據(jù)集,SKRGR在recall指標上平均提升了6.54%,在NDCG指標上平均提升了11.74%;對于Ciao數(shù)據(jù)集,SKRGR在recall指標上平均提升了11.00%,在NDCG指標上平均提升了15.06%。通過分析實驗數(shù)據(jù),能得到如下結(jié)論:

a)圖神經(jīng)網(wǎng)絡能較好地建模節(jié)點之間復雜的高階關(guān)聯(lián)。淺層的矩陣分解模型BPR和FM獨立編碼用戶和物品的向量表示,未深入挖掘用戶與物品之間的協(xié)作信息,效果略遜于其他基線。而基于圖神經(jīng)網(wǎng)絡的模型(如NGCF、LightGCN)能依據(jù)圖結(jié)構(gòu)復雜的拓撲關(guān)系,精準捕捉節(jié)點間的信息傳遞和交互關(guān)系,有利于生成高質(zhì)量的節(jié)點表示。

b)社交知識的引入有助于捕捉用戶的社會偏好和行為模式。相較于傳統(tǒng)的矩陣分解模型BPR和FM,TrustMF將社交信任關(guān)系納入推薦模型;DiffNet++在協(xié)同過濾的圖推薦模型NGCF和LightGCN的基礎上深入探索了興趣擴散機制和社會影響力建模,有效地捕捉了節(jié)點間復雜的交互作用,實現(xiàn)了性能的顯著提升;CLDS構(gòu)建了一個社交偏好的預訓練模型,結(jié)合自對比學習和用戶的交互信息對社交模型進行微調(diào),進一步提升了社會推薦的效果。

c)全局和局部信號的共同建模能進一步捕獲用戶需求。ARBRE僅將拆分后的協(xié)作圖作為輸入,未融入社交關(guān)系,忽視了對整體協(xié)作關(guān)系的建模;DSL則通過相似度投影函數(shù)實現(xiàn)了交互與社交圖的跨視圖對齊,提升了推薦效果;本文SKRGR基于圖重構(gòu)方案,引入鄰域增強策略以加強對局部特征的建模,并結(jié)合對比學習與門控融合策略,有效促進了全局與局部特征之間的一致性表達,進一步優(yōu)化了模型性能。

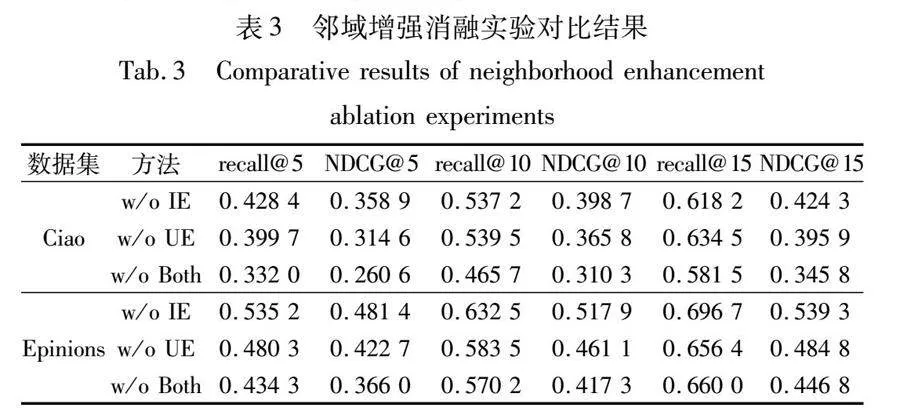

3.7 鄰域增強消融實驗

為驗證鄰域增強模塊的效力,本文設計了三個變體來分別驗證用戶端和物品端的局部建模性能。

a)w/o IE:舍棄物品鄰域增強模塊,將增強的物品特征表示gu*i替換為協(xié)作物品表示ni。

b)w/o UE:舍棄用戶鄰域增強模塊,將增強的用戶特征表示ti*u替換為協(xié)作用戶表示nu。

c)w/o Both:舍棄物品與用戶的鄰域增強模塊,將nu和ni作為用戶和物品的特征表示。

表3探究了各變體的實驗結(jié)果。其中,w/o Both的性能最差,這表明用戶端和物品端的鄰域增強模塊均對模型性能產(chǎn)生了積極的影響。該模塊實現(xiàn)了對局部協(xié)作信號的深入建模,顯著提升了模型的性能。相較于物品端,用戶鄰域增強模塊對模型性能的影響更為顯著。這是由于物品的鄰域信息受限于用戶交互行為的稀疏性,且缺乏對物品屬性特征的細粒度建模。相比之下,用戶的行為模式和語義特征更為復雜,其決策過程受多種因素影響。所以,本文聯(lián)合用戶的協(xié)作子圖和社交子圖采樣用戶鄰域,挖掘用戶的社會偏好與相似性聯(lián)系,根據(jù)用戶的動態(tài)行為和偏好調(diào)整推薦策略。

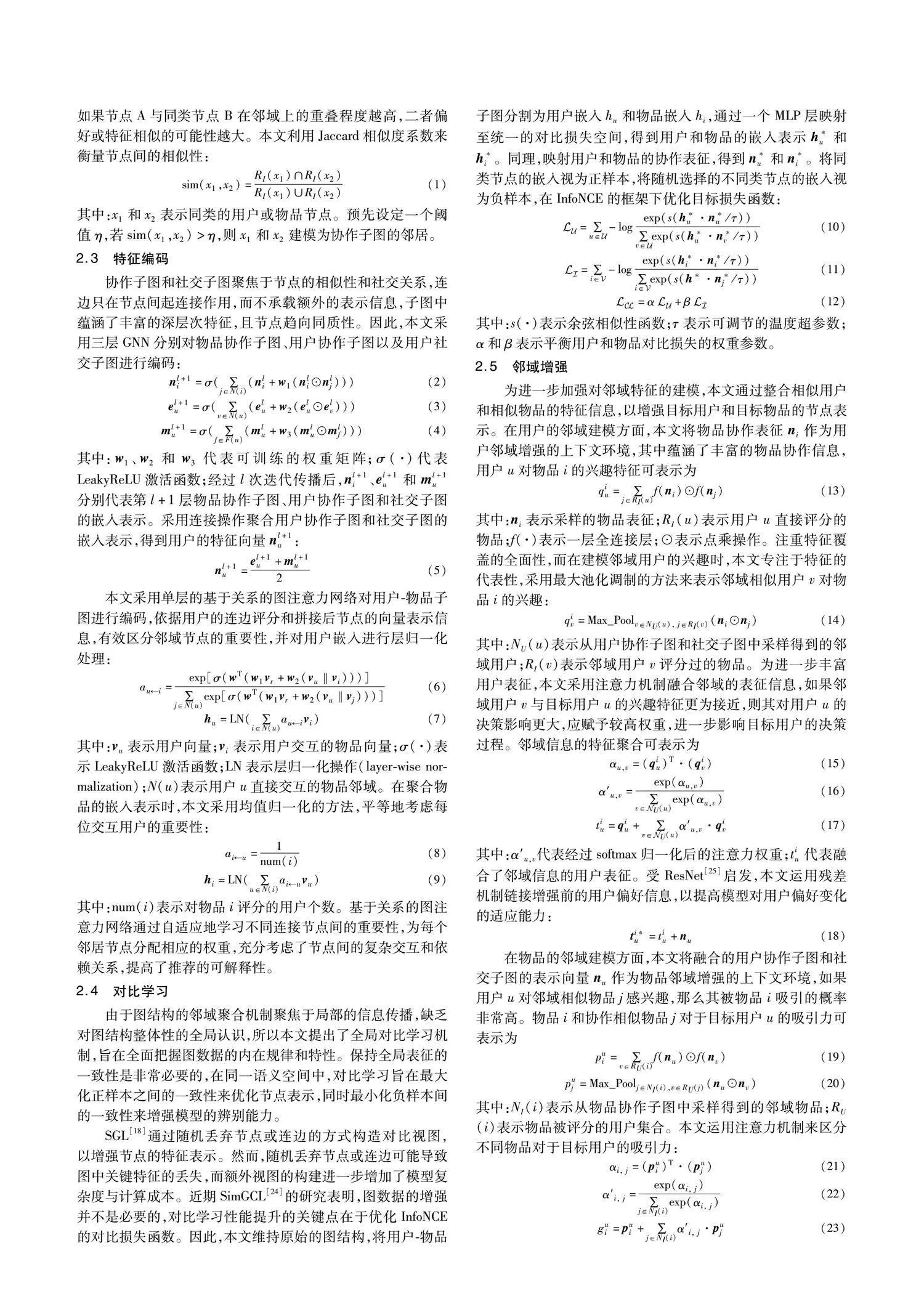

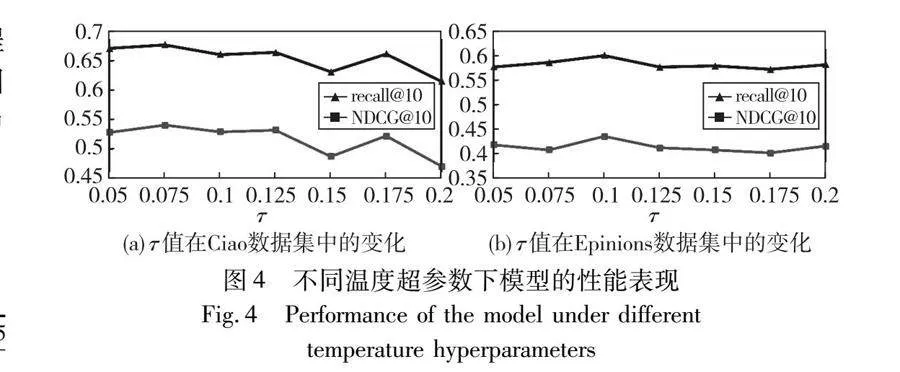

3.8 社交子圖消融實驗

本文探究了移除社交子圖對模型性能的影響。如表4所示,在移除用戶的社交關(guān)系后模型性能出現(xiàn)了顯著下滑,對于Ciao數(shù)據(jù)集,recall指標下降了8.81%,NDCG指標下降了9.6%;而對于Epinions數(shù)據(jù)集,recall指標下降了3.88%,NDCG指標下降了3.19%。這表明引入社交知識能較好地提升模型的推薦性能,而移除社交子圖對Ciao數(shù)據(jù)集的影響更為顯著。盡管Epinions數(shù)據(jù)集中包含更多的社交關(guān)系,其社交密度偏低,社交鏈接較為分散,增加了引入噪聲鏈接的風險。相比之下,Ciao數(shù)據(jù)集的社交密度約為Epinions數(shù)據(jù)集的兩倍,較好地彌補了用戶與物品交互鏈接的稀疏性,取得了較好的推薦效果。

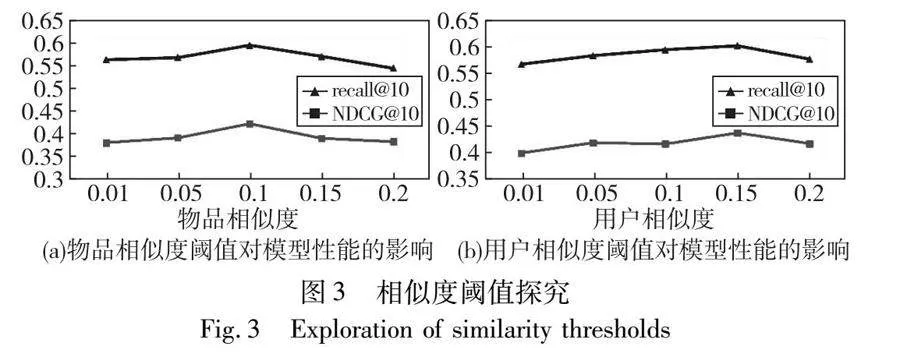

3.9 協(xié)作子圖相似度閾值研究

本文根據(jù)式(1)建模協(xié)作子圖的鄰居,給定閾值η,當sim(x1,x2)gt;η時,將節(jié)點x1和x2通過連邊建模為協(xié)作子圖的鄰居。本文在[0.01,0.2]變化η值,并在圖3中分別展示了物品和用戶相似度閾值對模型性能的影響。在物品協(xié)作子圖中,相似度閾值η為0.1時性能最佳,而在用戶協(xié)作子圖中,相似度閾值為0.15時性能最佳。系統(tǒng)對用戶的相似性要求更為嚴格,避免因用戶的興趣差異過大而導致的推薦偏差,有助于提升推薦精度。

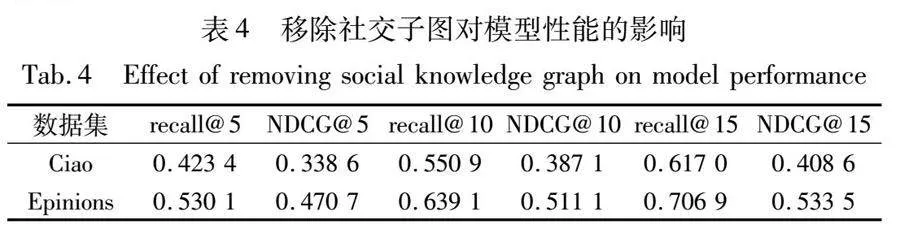

3.10 溫度超參數(shù)研究

在全局對比學習模塊中,本文以recall@10和NDCG@10為參照指標,通過在[0.05,0.2]變換τ值,以評估不同τ值下模型的性能表現(xiàn)。一般而言,τ值分布在[0.05,0.1]更有助于模型發(fā)揮其最佳性能。如圖4所示,對于Ciao數(shù)據(jù)集,當τ=0.075時,模型在recall@10和NDCG@10指標上取得了最優(yōu)性能表現(xiàn);而在Epinions數(shù)據(jù)集中,當τ=0.01時,模型的性能表現(xiàn)最佳。因此,針對不同數(shù)據(jù)集的特性,需相應調(diào)整τ值,以達到預期的推薦效果。

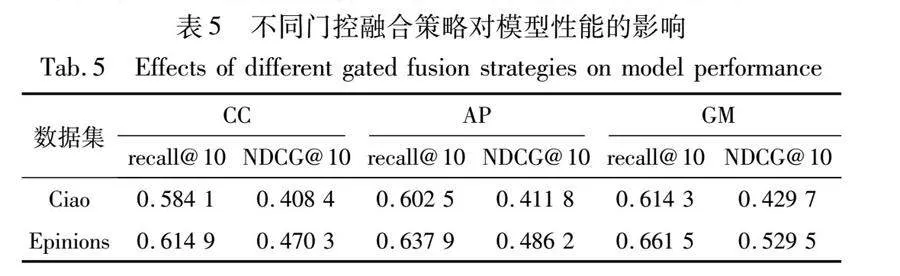

3.11 門控融合策略研究

為驗證門控融合策略(gating mechanism, GM)對模型性能的影響,本文以recall@10和NDCG@10為評價指標,設計了連接(concatenation, CC)和平均池化(average pooling, AP)兩個變體。實驗結(jié)果如表5所示,基于平均池化(AP)的融合策略在Ciao和Epinions數(shù)據(jù)集上的實驗結(jié)果均高于基于連接(CC)的融合策略,這是由于連接操作將作用域不同的兩個向量直接相加,加劇了噪聲和冗余信息的產(chǎn)生;而平均池化操作有效整合了二者的共同信息,對噪聲具有一定的魯棒性。相較于上述兩個變體,本文提出的門控融合策略在實驗中達到了最佳性能,證實了門控融合策略的必要性。通過自適應融合全局交互圖和局部協(xié)作圖的特征表示,深入捕捉整體和局部交互的依賴關(guān)系。在面對噪聲時,也能靈活地調(diào)整輸出流來減輕噪聲對模型性能的負面影響,提升模型的魯棒性與泛化能力。

4 結(jié)束語

針對現(xiàn)有推薦模型在圖結(jié)構(gòu)全局關(guān)系利用和用戶隱式興趣挖掘方面的局限性,本文提出了一種基于圖重構(gòu)的社交知識推薦模型SKRGR,結(jié)合全局對比學習機制與鄰域增強策略來增強社交知識推薦。具體而言,該算法運用圖重構(gòu)技術(shù),將用戶-物品知識圖譜解構(gòu)為四個子圖,實現(xiàn)了對交互、協(xié)作與社交關(guān)系的深入建模。為進一步增強用戶的隱式興趣,提出了鄰域增強策略來豐富節(jié)點的局部表示,從細粒度層面提取用戶的偏好興趣。為進一步捕捉圖結(jié)構(gòu)的全局特性,提出采用全局對比學習機制統(tǒng)一全局交互圖和局部協(xié)作圖的嵌入表征,以提高表示學習的質(zhì)量。同時,運用門控融合策略,實現(xiàn)了全局和局部信息的有機整合。在Ciao和Epinions兩個社交基準數(shù)據(jù)集上的實驗結(jié)果表明,SKRGR相較于其他基線具備顯著的性能優(yōu)勢。但是,在大規(guī)模數(shù)據(jù)的場景下,SKRGR仍面臨著資源消耗增加和模型訓練時間延長等挑戰(zhàn),影響推薦算法的效率和準確性。未來考慮引入分布式計算和子圖合并等技術(shù)來減輕模型的計算負擔,設計合理的采樣策略,保留模型的關(guān)鍵信息,實現(xiàn)效率與精度的雙重提升。

參考文獻:

[1]劉高, 黃沈權(quán), 龍安, 等. 基于超圖網(wǎng)絡的產(chǎn)品設計知識智能推薦方法研究 [J]. 計算機應用研究, 2022, 39(10): 2962-2967. (Liu Gao, Huang Shenquan, Long An, et al. Research on intelligent recommendation method of product design knowledge based on hyper-graph network [J]. Application Research of Computers, 2022, 39(10): 2962-2967.)

[2]McPherson M, Smith-Lovin L, Cook J M. Birds of a feather: homophily in social networks [J]. Annual Review of Sociology, 2001, 27(1): 415-444.

[3]Marsden P V, Friedkin N E. Network studies of social influence [J]. Sociological Methods amp; Research, 1993, 2(1): 127-151.

[4]Jamali M, Ester M. A matrix factorization technique with trust propagation for recommendation in social networks [C]// Proc of the 4th ACM Conference on Recommender Systems. New York: ACM Press, 2010: 135-142.

[5]Guo Guibing, Zhang Jie, Yorke-Smith N. TrustSVD: collaborative filtering with both the explicit and implicit influence of user trust and of item ratings[C]// Proc of the 29th AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2015: 123-129.

[6]Le Wu, Li Junwei, Sun Peijie, et al. DiffNet++: a neural influence and interest diffusion network for social recommendation [J]. IEEE Trans on Knowledge and Data Engineering, 2020, 34(10): 4753-4766.

[7]Huang Chao, Xu Huance, Xu Yong, et al. Knowledge-aware coupled graph neural network for social recommendation [C]// Proc of AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2021: 4115-4122.

[8]Chen Chong, Zhang Min, Liu Yiqun, et al. Social attentional memory network: modeling aspect-and friend-level differences in recommendation[C]// Proc of the 12th ACM International Conference on Web Search and Data Mining. New York: ACM Press, 2019: 177-185.

[9]Fan Wenqi, Ma Yao, Li Qing, et al. Graph neural networks for social recommendation [C]// Proc of the World Wide Web Confe-rence. New York: ACM Press, 2019: 417-426.

[10]Yu Junliang, Yin Hongzhi, Gao Min, et al. Socially-aware self-supervised tri-training for recommendation [C]// Proc of the 27th ACM SIGKDD Conference on Knowledge Discovery amp; Data Mining. New York: ACM Press, 2021: 2084-2092.

[11]Long Xiaoling, Huang Chao, Xu Yong, et al. Social recommendation with self-supervised metagraph informax network[C]// Proc of the 30th ACM International Conference on Information amp; Knowledge Mana-gement. New York: ACM Press, 2021: 1160-1169.

[12]Wang Xiang, He Xiangnan, Cao Yixin, et al. KGAT: knowledge graph attention network for recommendation [C]// Proc of the 25th ACM SIGKDD International Conference on Knowledge Discovery amp; Data Mining. New York: ACM Press, 2019: 950-958.

[13]Wang Ze, Lin Guangyan, Tan Huobin, et al. CKAN: collaborative knowledge-aware attentive network for recommender systems[C]// Proc of the 43rd International ACM SIGIR conference on Research and Development in Information Retrieval. New York: ACM Press, 2020: 219-228.

[14]Wang Xiang, Huang Tinglin, Wang Dingxian, et al. Learning intents behind interactions with knowledge graph for recommendation [C]// Proc of the Web Conference. New York: ACM Press, 2021: 878-887.

[15]Yang Yuhao, Huang Chao, Xia Lianghao, et al. Knowledge graph contrastive learning for recommendation [C]// Proc of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2022: 1434-1443.

[16]Chen Ting, Kornblith S, Norouzi M, et al. A simple framework for contrastive learning of visual representations[C]// Proc of the 37th International Conference on Machine Learning. [S.l.]: JMLR.org, 2020: 1597-1607.

[17]Giorgi J, Nitski O, Wang Bo, et al. DeCLUTR: deep contrastive learning for unsupervised textual representations[C]// Proc of the 59th Annual Meeting of the Association for Computational Linguistics and the 11th International Joint Conference on Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2021: 879-895.

[18]Chen Mengru, Huang Chao, Xia Lianghao, et al. Heterogeneous graph contrastive learning for recommendation[C]// Proc of the 16th ACM International Conference on Web Search and Data Mining. New York: ACM Press, 2023: 544-552.

[19]Wu Jiancan, Wang Xiang, Feng Fuli, et al. Self-supervised graph learning for recommendation[C]// Proc of the 44th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2021: 726-735.

[20]Zou Ding, Wei Wei, Mao Xianling, et al. Multi-level cross-view contrastive learning for knowledge-aware recommender system [C]// Proc of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2022: 1358-1368.

[21]Xia Lianghao, Huang Chao, Xu Yong, et al. Hypergraph contrastive collaborative filtering[C]// Proc of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2022: 70-79.

[22]Wang Tianle, Xia Lianghao, Huang Chao. Denoised self-augmented learning for social recommendation [C]// Proc of the 32nd International Joint Conference on Artificial Intelligence. San Francisco: Morgan Kaufmann, 2023: 2324-2331.

[23]陳燕兵, 張應龍. 圖重構(gòu)下大規(guī)模網(wǎng)絡的社團檢測算法 [J]. 計算機應用研究, 2023, 40(2): 470-475. (Chen Yanbing, Zhang Yinglong. Community detection algorithm for large-scale networks by graph reconstruction [J]. Application Research of Computers, 2023, 40(2): 470-475.)

[24]Yu Junliang, Yin Hongzhi, Xia Xin, et al. Are graph augmentations necessary? Simple graph contrastive learning for recommendation [C]// Proc of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2022: 1294-1303.

[25]He Kaiming, Zhang Xiangyu, Ren Shaoqing, et al. Deep residual learning for image recognition [C]// Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2016: 770-777.

[26]Hochreiter S, Schmidhuber J. Long short-term memory [J]. Neural Computation, 1997, 9(8): 1735-1780.

[27]Rendle S, Freudenthaler C, Gantner Z, et al. BPR: Bayesian personalized ranking from implicit feedback [C]// Proc of the 25th Conference on Uncertainty in Artificial Intelligence. [S.l.]: AUAI Press, 2009: 452-461.

[28]Rendle S. Factorization machines[C]// Proc of the 10th IEEE International Conference on Data Mining. Piscataway, NJ: IEEE Press, 2010: 995-1000.

[29]Yang Bo, Lei Yu, Liu Jiming, et al. Social collaborative filtering by trust [J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2016, 39(8): 1633-1647.

[30]Wang Xiang, He Xiangnan, Wang Meng, et al. Neural graph collabo-rative filtering[C]// Proc of the 42nd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2019: 165-174.

[31]He Xiangnan, Deng Kuan, Wang Xiang, et al. LightGCN: simpli-fying and powering graph convolution network for recommendation [C]// Proc of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2020: 639-648.

[32]Ouyang Yi, Wu Peng, Li Pan. Asymmetrical context-aware modulation for collaborative filtering recommendation [C]// Proc of the 31st ACM International Conference on Information amp; Knowledge Management. New York: ACM Press, 2022: 1595-1604.

[33]Ma Gangfeng, Yang Xuhua, Long Haixia, et al. Robust social reco-mmendation based on contrastive learning and dual-stage graph neural network [J]. Neurocomputing, 2024, 584: 127597.