基于輪廓模板匹配的物體檢測算法

陳 雷

同濟大學軟件學院,上海 201804

基于輪廓模板匹配的物體檢測算法

陳 雷

同濟大學軟件學院,上海 201804

本文提出了一種基于輪廓模板匹配技術(shù)的物體識別檢測算法。物體檢測器使用部分已有的輪廓圖片,通過AdaBoost訓練得出。此算法達到了一般基于紋理檢測器的效果,而且更加簡單且易于實現(xiàn)。

輪廓模板 ;Chamfer;Boost

1 概述

我們的模型訓練方法采用了一種過飽和的模式,即使用冗余的特征集合進行訓練,而這些冗余特征集合恰恰克服了同類物體的不同點(如不同的體型、不同的動作以及不同的面部表情)、圖像場景變化(不同的光照條件、遮擋等)。

2 檢測

整個檢測器是建立在局部的基于輪廓特征匹配基礎(chǔ)上的,匹配算法使用了方向性的Chamfer距離考量,這個距離值通過其權(quán)重求和,并最終作為物體檢測分類器。特征集合F代表了物體的輪廓T的局部片段,每個特征都包括了它自身到物體中心的偏移量p。另外的3個參數(shù)分別是:方向量的權(quán)重λ,檢測閾值θ以及特征權(quán)重量a。

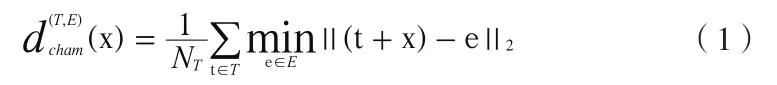

2.1 方向性Chamfer匹配

Chamfer匹配技術(shù)在輪廓匹配應用中非常廣泛。它提供了一種計算兩個輪廓距離量的方法,并且在有大量非對齊的情況下,仍有很高的魯棒性。從最簡單的模型講,Chamfer匹配需要兩個邊緣點集,圖像邊緣點集E={e}和匹配模板點集T={t},下面的公式描述了計算這兩個點集在偏移量為x情況下的Chamfer值:

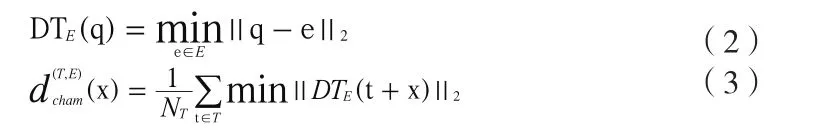

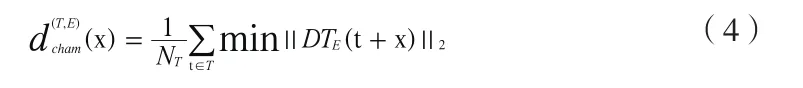

NT為T中點的數(shù)量。這個公式計算了匹配模板中的邊緣點到最近的圖像邊緣點的平均距離。通過預處理,例如距離變換(Distance Transform),計算Chamfer距離的效率會提高很多,公式(1)即可以轉(zhuǎn)化為公式(3):

歐幾里得距離DT的計算可以參照文章[1]。

另外,一個很大的改進,就是引用了輪廓的方向考量。這種考量通過邊緣點的斜率來表達。在圖像點集中,通常有很多地方邊緣非常嘈雜混亂,方向性Chamfer距離可以很好的解決這個問題。其中一種技術(shù)是將圖像和匹配模板中的邊緣點劃分為不同的幾個離散的方向通道,并求出Chamfer值的和。但這種方法的通道數(shù)量并不明確,而且需要格外注意連個通道之間的邊緣曲線。我們使用一種略微不同的方法,精確的計算匹配模板上每個邊緣點斜率與圖像中每個邊緣點斜率的差:

o(·)代表一個邊緣點的斜率,|o1-o2|表示計算兩個點的斜率差,ADTE(t+x)表示在點集E中找出離點(t+x)最近的一個點。

這樣,最終的方向性Chamfer值便可以通過下面的公式計算出來了:

其中,λ為方向考量的權(quán)重值。

2.2 檢測步驟

物體檢測器K(c)可以計算某一點的c的信心值(Confident Value),使用K在整個圖片的所有像素點進行掃描,可以得出一個分類圖。這個分類圖經(jīng)過一定的處理(如降噪、平滑等),通過設(shè)定一個理想的閾值,在這個分類圖中可以找出物體在圖片中的大致位置。

整個檢測器K通過一個參數(shù)組{Fm}進行訓練,每個參數(shù)組表示為Fm=(Tm ,pm ,λm ,θm ,am),K用加性模型表示如下:

δ函數(shù)相當于一個判斷語句,如果括號內(nèi)部表達式為真,則返回1,否則返回0。θm是每個一個閾值,來過濾弱分類器得出的方向性Chamfer值,通過訓練得出。am是每個特征向量的權(quán)重,同樣通過訓練得出。

3 訓練

3.1 建立匹配模板庫

首先,我們要找出大量需要檢測的物體圖片,將其分成兩部分,第一部分則用來提取特征,第二部分則用來用來作為訓練樣本。首先將第一部分的圖片背景信息去除(通常是下載標準數(shù)據(jù)集來解決),然后使用Canny edge算法算出這些圖片相應的邊緣輪廓圖片。隨機指定一些位置,記錄這些位置到物體中心的偏移量,并截取隨機大小的矩形區(qū)域的(不能太大或太小)輪廓片段,將這兩種信息儲存。這樣,庫中的每條信息都包括兩個內(nèi)容:物體的部分輪廓曲線以及它相對于物體中心的位置。

3.2 分類器的學習

Boost是現(xiàn)今機器學習領(lǐng)域中較為簡單且有效的技術(shù)。它由一系列的“弱分類器”構(gòu)成,這些分類器的表現(xiàn)僅僅比隨機猜測要好一點,但是一個帶有權(quán)重的弱分類器的集合,通常可以構(gòu)成一個比較準確的“強分類器”。Boost算法在計算機視覺中的應用非常廣泛,大部分是作為一個特征選擇機制,例如:Viola和Jones利用AdaBoost制作了一個效率很高的級聯(lián)分類器。

我們引入Boost算法主要是為了3點:特征選擇,參數(shù)估計以及檢測器學習。

4 實驗分析

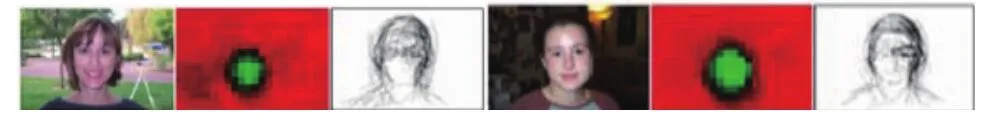

我們使用Caltech人臉數(shù)據(jù)集進行算法的測試驗證。如圖1,左邊一列都是包含檢測物體的圖片,中間是通過訓練好的檢測器算出的分類圖,右邊列則是檢測器K中匹配模板疊加后的效果。可以看出,需要檢測的物體的位置都比較準確。

圖1

5 結(jié)論

本篇文章對基于輪廓模板匹配的物體檢測技術(shù)進行了探討,并且使其達到了一般基于紋理檢測算法的效果。但是此算法所檢測的都是某一確定大小的物體,而通常圖片中的物體大小都不是固定的。如何解決這個問題,則是我們今后要研究的。

[1]P.F.Felzenszwalb and D.P.Huttenlocher.Distance transforms of sampled functions. Technical report,Cornell, 2004.

[2]J.Friedman, T.Hastie, and R.Tibshirani.Additive logistic regression∶ a statistical view of boosting.Annals of Statistics, 2000, 38(2)∶337-374.

TP391

A

1674-6708(2010)30-0158-02