基于二維Gabor濾波器的非織造布疵點檢測

陳 琳,汪 軍,b,李立輕,陳 霞

(東華大學a.紡織學院;b.紡織面料技術教育部重點實驗室,上海 201620)

基于二維Gabor濾波器的非織造布疵點檢測

陳 琳a,汪 軍a,b,李立輕a,陳 霞a

(東華大學a.紡織學院;b.紡織面料技術教育部重點實驗室,上海 201620)

針對非織造布疵點自動檢測問題,提出一種基于二維Gabor濾波器的非織造布疵點檢測方法.該方法采用3個尺度和4個方向的濾波器分別對經過Gamma矯正以及同態濾波處理的正常圖像和疵點圖像進行濾波,進而得到偏差圖像,并做融合處理,經二值化后將疵點從織物背景中提取出來,從而實現非織造布的自動檢測.試驗結果表明,該方法對非織造布各類疵點的檢測,尤其是對隱性疵點是非常有效的.

Gabor濾波器;非織造布;疵點檢測

由于非織造布產業的快速發展,質量控制受到極大的關注,非織造布疵點檢測便是其中的一項.隨著生產速度的加快、布門幅的加寬以及產品質量要求的提高,人工疵點檢測存在檢測速度慢、檢測率低、穩定性差等問題,因此尋求快速、準確地檢測出非織造材料疵點的方法已成為目前急需解決的一個問題[1-4].

非織造布疵點類型主要分為兩類:一類是包括雜質、破洞以及油污等在非織造布表面、視覺明顯可見的疵點,本文將其定義為顯性疵點;另一類則是在生產過程中夾雜在纖網內部的雜質,在非織造布成型后隱于織物內部,此類疵點可見性較差,因此本文將其定義為隱性疵點.目前,針對非織造布疵點檢測的研究比較少,主要集中于對疵點直接二值化后提取特征值[5-6],此方法對顯性疵點檢測能力較好,但對于隱性疵點基本無法檢測出來,所以有必要尋找新的檢測方法對隱性疵點作出有效的檢測.

非織造布隱性疵點檢測算法目前尚無報道,但是在機織物疵點檢測研究和指紋識別等方面的研究[7-8]顯示,在對織物疵點和指紋圖像進行二維Gabor濾波器濾波處理后,能夠明顯增強疵點和指紋的檢測效果.因此,本文采用基于二維Gabor濾波器方法對非織造布隱性疵點進行檢測,并通過與直接二值化方法檢測結果的比較,研究基于二維Gabor濾波器檢測方法對非織造布隱性疵點檢測的有效性,在此基礎上進一步對顯性疵點的檢測進行試驗,研究其對非織造布各類疵點檢測能力的普適性.

1 Gabor濾波器理論

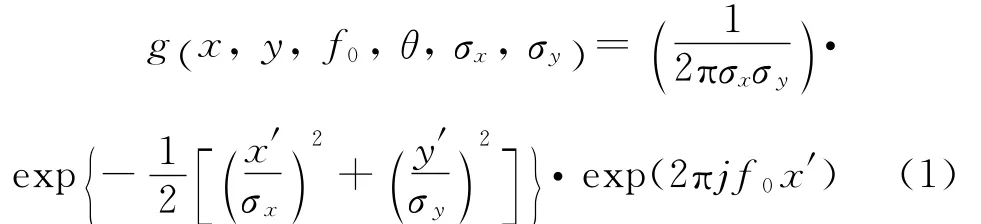

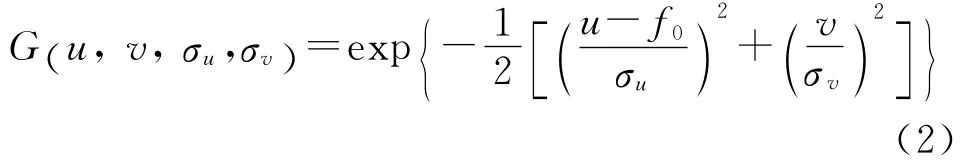

Gabor小波變換是一種Gauss窗的加窗Fourier變換,二維Gabor濾波函數或沖擊響應函數是一個調制過的二維高斯函數.濾波函數經過適當的膨脹和旋轉可生成自相似Gabor小波函數,它的單位沖激響應函數為

其中:σx,σy分別為控制高斯函數在x軸和y軸的伸縮程度;f0為調制頻率或中心頻率;θ為旋轉的角度;x和y為原來的坐標;x′和y′為旋轉后的坐標,x′=xcosθ+ysinθ,y′=-xsinθ+ycosθ.單位沖擊響應函數的傅里葉變換如式(2)所示.

2 Gabor濾波器的設計與優選

Gabor濾波器的設計就是通過確定濾波器參數(f0,σu,σv,θ)得到參數σx和σy.通常的做法是選取多個(f0,σu,σv,θ)參數,使得這組參數下的濾波器組能覆蓋頻域[9].

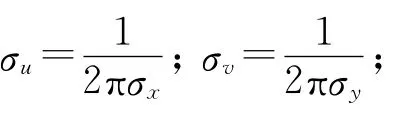

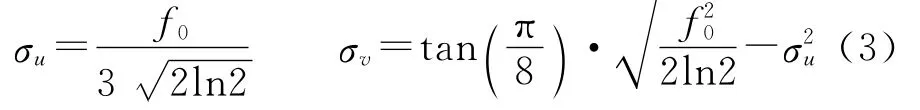

本文首先采用半峰相切法來選擇尺度參數σu和σv,使在頻域振幅的半峰處各個濾波器之間保持相切,從而濾波器組覆蓋區域達到最大,由推導得出Gabor濾波器參數σu與σv如式(3)所示.

其次,對于一個大小為N像素×N像素有紋理圖像,根據文獻[10-12]對頻率的定義,分別對隱性疵點進行了檢測試驗,最終選擇頻率f0的取值為0.11,0.22,0.45.

對于旋轉角度θ的選擇,由于輸入的實信號在角度[π,2π]之間的信號響應是角度[0,π]的復共軛,所以實際計算旋轉角度只考慮[0,π]范圍,同時大多數圖像的能量主要集中在水平、垂直及對角線方向上,其他角度用處并不大,且增加運算量,所以本文采用0,π/4,π/2,3π/4共4個角度,對疵點圖像進行處理.

3 基于二維Gabor濾波器的非織造布疵點檢測流程

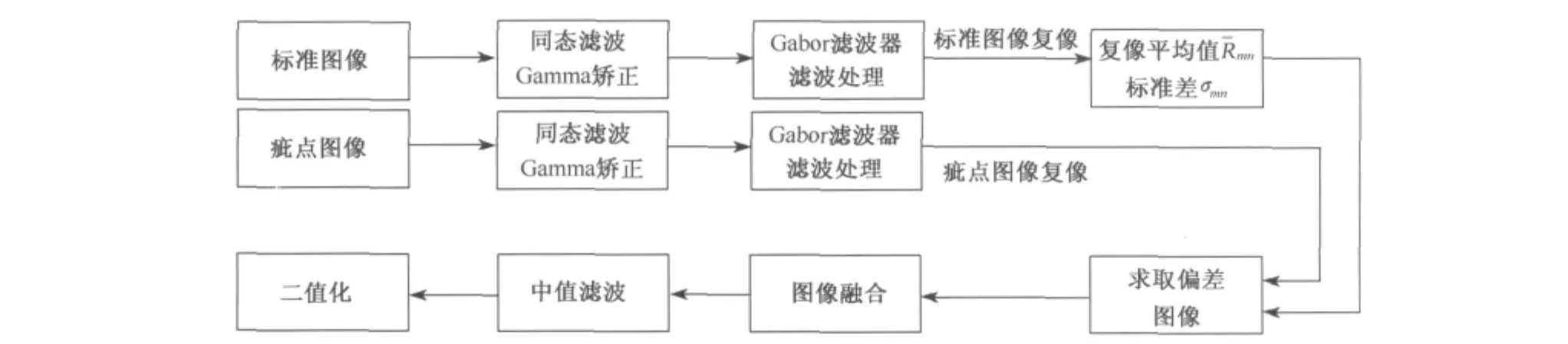

本文采用3個中心頻率(0.11,0.22,0.45)和4個方向(0,π/4,π/2,3π/4)的 Gabor濾波器組(共12個濾波器)來處理非織造布疵點圖像,檢測流程如圖1所示.

圖1 檢測流程Fig.1 The process of detection

具體算法如下所述.

(1)分別獲取大小為512像素×512像素的非織造布的無疵點的標準圖像p(x,y)和含有疵點的圖像q(x,y),為了得到更好的效果,分別對兩幅圖像進行Gamma矯正[13]以及同態濾波消除光照不勻.

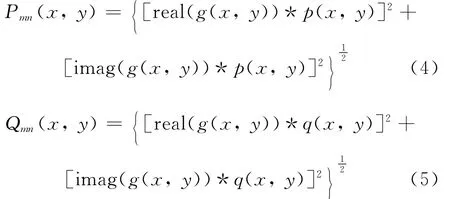

(2)將處理好的無疵點的標準圖像和含有疵點的圖像,與Gabor濾波器的實部和虛部分別卷積,可以分別得到12幅濾波后的復像Pmn(x,y)和Qmn(x,y),m代表尺度數,n表示方向數[14].

其中:real()為取實運算;imag()為取虛運算;‘*’為卷積運算.

(3)求標準圖像復像的Pmn(x,y)的平均值R-mn和標準差σmn.

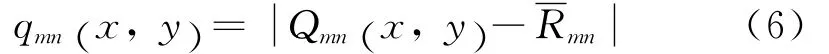

(4)采用式(6)對疵點復像求取偏差圖像.

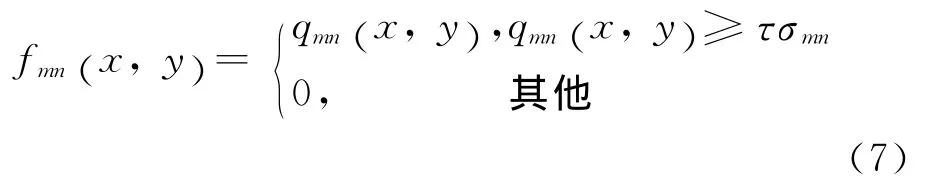

(5)對疵點偏差圖像qmn(x,y)進行閾值化處理,如式(7)所示.

其中:τ為可調參數,用來控制錯誤拒絕的概率,決定了敏感度,很大程度上其由獲取圖像的環境和圖像上雜質的情況決定.根據本文中的環境條件,通過多次試驗,τ取值為1.3.

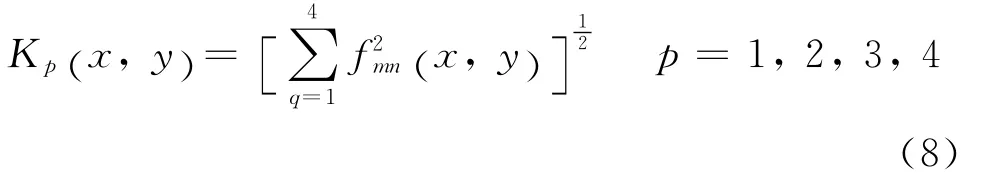

(6)對于得到的圖像,體現了不同頻率不同方向下疵點的結構和形態.為了能夠得到具有綜合信息的圖像,將各個頻率、方向下的疵點偏差圖像,采用以下方法進行融合.

根據式(8)對具有相同尺度不同方向上的圖像進行融合.

處理后得到3幅不同尺度的圖像,每幅圖像集合了不同方向上可能存在的疵點信息.以同樣的方法對不同尺度的圖像再進行圖像融合,最后得到總融合圖像K(x,y).

(7)用中值濾波把各個尺度和各個方向的噪聲從最后的融合圖像K(x,y)中去除,本文選擇大小為3像素×3像素的模板進行中值濾波,經過濾波后的圖像為K′(x,y).

(8)對濾波后的圖像進行二值化處理,二值化后的圖像中的疵點很容易從背景中分割出來.本文采用一維最大熵法,對圖像自動選取閾值并二值化.

4 試驗結果與分析

為了驗證本方法對于隱性疵點的檢測能力,本文選擇蠶絲為原材料,面密度為26.25g/m2的水刺非織造布作為檢測對象.圖像采集系統為JAI公司生產的CV-3200系列CCD攝像頭與EURESYS公司生產的PICOLO2系列圖像采集卡.試驗的硬件環境為Intel Core2 2.26GHz CPU,4GB內存的計算機,軟件環境為Matlab 2010.

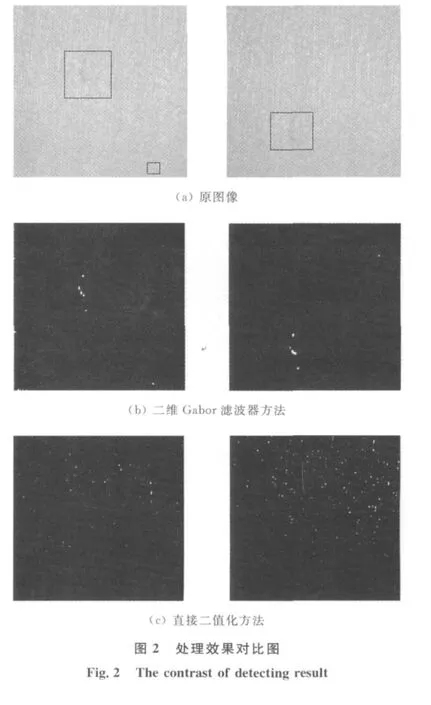

根據第3節的處理方法,對含有隱性疵點的非織造布進行處理.圖2(a)為非織造布疵點的原始灰度圖像,圖中框選的部分為生產過程中埋在織物內部的隱性疵點.圖2(b)和2(c)分別為二維Gabor濾波器處理后的結果和直接二值化方法處理后的結果.

由于目前尚無針對非織造布隱性疵點檢測的研究報道,沒有檢測數據進行比較,因此,采用二維Gabor濾波器檢測方法與直接二值化方法對30幅隱性疵點圖像進行檢測結果對比,兩種檢測方法得到的檢出率分別為80.00%和26.67%,對每幅圖像的平均檢測時間分別為0.845s和0.103s.

從試驗結果不難看出,與直接二值化方法比較,疵點圖像經二維Gabor濾波器處理后,雖然在處理速度上略慢,但是對隱性疵點的檢測能力明顯增強,能夠較好地將隱性疵點檢測出來.

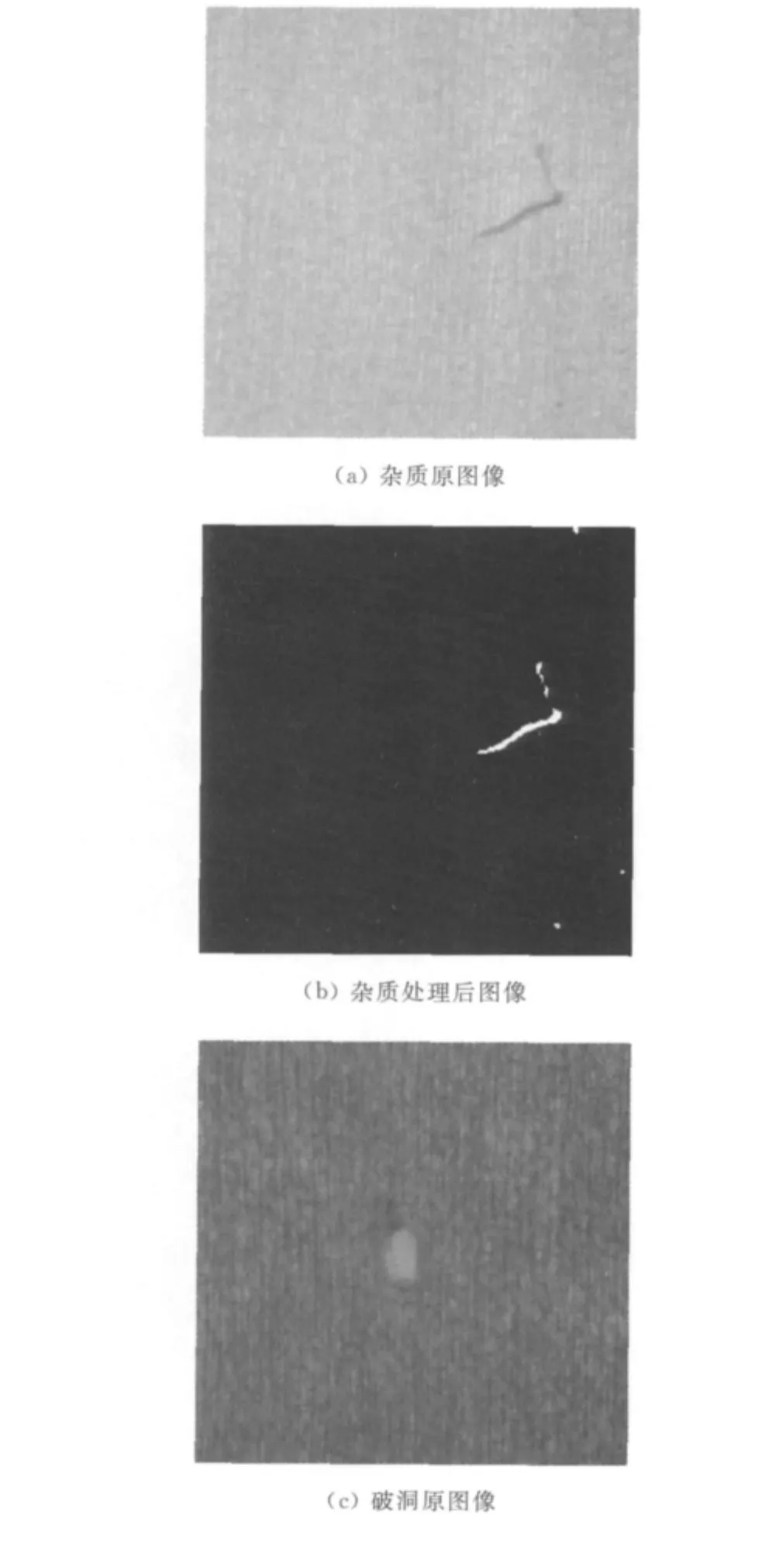

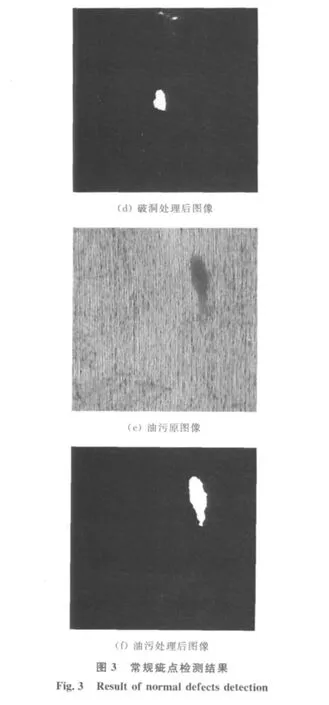

同時,本文采用基于二維Gabor濾波器的處理方法對顯性疵點進行了檢測.在檢測過程中,針對不同類型疵點采用了不同的光照條件進行圖像采集.檢測效果如圖3所示.

從圖3可以看到,基于二維Gabor濾波器的檢測方法對顯性疵點也有良好的檢測效果,顯示出其對各類疵點的檢測具有良好的普適性.

5 結 語

本文采用基于二維Gabor濾波器的檢測方法,對非織造布上隱性疵點以及視覺明顯可見的雜質、破洞以及油污類型的顯性疵點進行了檢測.由于二維Gabor濾波器能夠很好地反映圖像頻率和方向在局部范圍內的強度變化,所以對于隱性疵點有良好的檢測能力,而對顯性疵點同樣能夠有效提取,從而證明此算法對非織造布隱性疵點檢測的有效性以及對各類疵點檢測的普適性.在實際應用中,由于織物類型、環境條件各不相同,濾波器參數可根據實際情況適當調整.同時,可以嘗試增加Gabor濾波器的尺度和方向,以達到更好的檢測效果,但會增加計算量,降低檢測速度,因此,需要根據檢測要求的精度以及速度來選擇適當的濾波器尺度和方向.

參 考 文 獻

[1]黃瀟玲,孫科,李子燊,等.表面疵點在線檢測技術在非織造領域的應用[J].產業用紡織品,2009,27(5):39-43.

[2]王智.非織造布疵點在線檢測裝置[J].非織造布,1998,6(4):13-14.

[3]LIU J L,ZUO B Q,ZENG X Y,et al.Nonwoven uniformity identification using wavelet texture analysis and LVQ neural network[J].Expert Systems with Applications,2010,37(3):2241-2246.

[4]曾躍民,劉麗芳.基于計算機圖像處理的非織造布質量檢測與控制技術[J].非織造布,2001,9(3):37-40.

[5]STOJANOVIC R,MITROPULOS P,KOULAMAS C,et al.Automated detection and neural classification of local defects in textile web[C]//Seventh International Conference on Image Processing-IPA99.Manchester,UK,1999:647-651.

[6]PAYVAND P,YOUSEFZADEH-CHIMACH M,LATIFI M.A note on neurofractal-based defect recognition and classification in nonwoven web images[J].Journal of the Textile Institute,2010,101(1):46-51.

[7]劉元兵,李見為.基于Gabor小波核心算法的指紋圖像預處理[J].自動化與儀器儀表,2004(3):51-53.

[8]韓潤萍,孫蘇榕,姜玲.基于Gabor濾波器組的織物疵點檢測方法[J].計算機工程與應用,2007,43(7):211-214.

[9]KUMAR A,PANG G.Defect detection in textured materials using Gabor filters[J].IEEE Transaction on Industry Application,2002,38(2):425-439.

[10]TAN T N.Geometric transform invariant texture analysis[J].International Society for Optical Engineering,1995,2488:475-485.

[11]CHELLAPPA R,KASHYAP R L,MANJUNATH B S.Handbook of pattern recognition and computer vision [M].New Jersey:World Scientific Publishing Co Inc,1993:277-310.

[12]JAIN A K,FARROKHNIA F. Unsupervised texture segmentation using Gabor filters[J].Pattern Recognition,1991,24(12):1167-1186.

[13]師一華,楊金鋒.圖像處理中改進的Gamma矯正方法[J].安陽工學院學報,2005(6):67-70.

[14]ARIVAZHAGAN S,GANESAN L,BAMA S.Fault segmentation in fabric images using Gabor wavelet transform[J].Machine Vision and Applications,2006,16(6):356-363.

Nonwoven Fabric Defects Detection Based on 2DGabor Filter

CHENLina,WANGJuna,b,LILi-qinga,CHENXiaa

(a.College of Textiles;b.Key Laboratory of Textile Science &Technology,Ministry of Education,Donghua University,Shanghai 201620,China)

Focusing on automatic detection of defects on nonwoven fabric,a method based on 2D Gabor filter was presented.The images of the normal fabric and the fabric with defects which had been proceeded with Gamma correction and homomorphic filtering were proceeded by the Gabor filters of three scales and four directions,and thus the deviation images were obtained.The defects were prominent after integration.And finally,the defects of the nonwoven fabric were detected by threshold processing.The experiment results proved the effectiveness of the method of various defects detection,especially the inapparent defects detection on nonwoven fabric.

Gabor filter;nonwoven fabric;defects detection

TS 941.26

A

1671-0444(2012)06-0695-05

2011-10-10

國家自然科學基金資助項目(61271006)

陳 琳(1986—),男,上海人,碩士,研究方向為非織造布疵點檢測.E-mail:520116859@qq.com

汪 軍(聯系人),男,教授,E-mail:junwang@dhu.deu.cn