基于人類視覺的快速自動調焦法

黃德天,劉雪超,張紅勝,趙晶麗,4

(1.華僑大學 工學院,福建 泉州 362021;2.中國科學院 長春光學精密機械與物理研究所,吉林 長春 130033;3.中國科學院 研究生院,北京 100049;4.中國科學院 光學系統先進制造技術重點實驗室,吉林 長春 130033)

1 引 言

自動調焦是光電成像系統獲取清晰圖像的關鍵過程,已成功應用于空間遙感系統、自動監控系統、顯微分析系統以及各種數碼攝像系統等[1-6]。與基于測距法、像檢測法等傳統的自動調焦法相比,基于圖像處理的自動調焦法具有智能化、高度集成化、低功耗、占用體積小和低成本等優點,隨著數字圖像處理技術和超大規模集成電路的飛速發展,基于圖像處理的自動調焦法成為了調焦技術發展的主流。目前,基于圖像處理的自動調焦法的關鍵在于解決調焦評價函數和調焦搜索算法2個問題。調焦評價函數的主要作用是代替人眼對一幅圖像是否正確聚焦進行判斷;而調焦搜索算法是運用調焦評價函數判斷當前的調焦狀態,從而實現對調焦機構的控制。

小波變換在時間域和頻率域同時具有良好的局部特性,通過多分辨率分析,小波變換可以捕捉到調焦過程中圖像的任意細節,因而,基于小波的調焦評價函數能夠很好地分辨出圖像聚焦和輕微離焦的情況。但由于該類調焦評價函數需要對圖像進行小波分解,計算量較大,以前由于嵌入式處理器速度的限制,在快速自動調焦系統中應用較少。而現在一些DSP芯片擁有超高性能的計算能力,例如TI公司的C667x系列多核DSP,僅單核的處理速度就能達到10000MIPS(每秒百萬條指令),因此,在現有的硬件平臺上采用基于小波的調焦評價函數是完全可行的。此外,研究表明基于小波的調焦評價函數不但滿足實時性的要求,而且具有較強的抗干擾能力和較高的靈敏度[7-10]。

圖像經若干層小波分解后得到一系列的高頻系數,包括水平、垂直和對角方向的細節系數。傳統的方法是以各層高頻系數的平方和作為調焦評價函數,但根據人類視覺系統(HVS)特性的研究成果[11],人眼對不同方向、不同空間頻率的刺激有著不同的敏感度,因此,不同層的高頻系數對視覺效果的貢獻并不相同,即使同一層不同方向的高頻系數對視覺效果的貢獻也有差異。為了使調焦評價函數既客觀準確,又符合人眼的視覺感知特性,本文根據小波變換與HVS多通道特性相匹配的特點,提出了一種基于HVS加權的小波調焦評價函數。

在調焦搜索算法中,最常用的是爬山法,以及研究人員改進的一些爬山法[12-14],但仍然需要較長的搜索時間,調焦速度往往不能滿足需求。為了提高搜索效率,將SOM(Self-organizing Map)神經網絡[15-17]的自動聚類功能應用到爬山法中,提出了一種帶有預測最佳聚焦位置功能的改進爬山搜索法。

2 基于人類視覺系統的調焦評價函數

2.1 人類視覺系統特性

人類視覺系統(human visual system,HVS)是由大量功能形態各異的神經細胞通過一定的方式連接組成的信息處理系統,是現有的最復雜的圖像處理系統。目前,許多實驗已經發現了HVS的一系列特性[11],如視覺多通道特性、視覺非線性特性、視覺敏感度帶通特性和掩蓋效應等。其中,視覺多通道特性是指人類視覺系統類似于一組有方向的帶通濾波器,對不同顏色,不同方向,不同空間頻率的刺激有著不同的敏感度。視覺敏感度帶通特性是指人眼分辨亮度差異的能力,受到很多條件的影響,空間頻率不同時,對比度敏感的響應也不同。視覺敏感度帶通特性可以采用對比敏感度函數(Contrast Sensitivity Function,CSF)來表征,雖然不同實驗得出的CSF函數形式各異,但基本都認為HVS的對比度敏感是空間頻率f的函數,且具有帶通濾波器的性質,為各向異性。目前在圖像處理中常用的CSF函數表達式為[18]:

其中:f表示圖像的空間頻率,A(f)表示人類視覺的帶通特性。

圖1 CSF特性曲線Fig.1 CSF property curve

CSF函數的頻率響應曲線如圖1所示,橫軸為圖像的空間頻率,單位為周/度(cycle/degree);縱軸為CSF的幅值。從圖1可以看出人眼視覺對某一區間內的空間頻率對比度變化最為敏感,而在頻率較低或較高處敏感度降低。

2.2 基于HVS加權的調焦評價函數

小波變換是一種時頻分析方法,具有很好的局部時頻特性,能有效地提取信號的局部信息,享有“數字顯微鏡”的美稱。圖像經n層小波分解后,可得到一系列不同頻率不同方向的子帶:低頻子帶LLn反映了圖像的大體結構,而高頻子帶HLi、LHi和HHi(i∈1,2,…,n)反映了圖像的邊緣、區域輪廓等細節信息。其中,HLi子帶包含了水平方向的高頻信息,LHi子帶包含了垂直方向的高頻信息,HHi包含了對角線方向的高頻信息。

圖像聚焦時,小波分解得到的高頻系數能量最大,隨著圖像離焦程度的加劇,小波分解后的高頻系數能量隨之變小。傳統的小波變換評價函數是將各層小波高頻系數的平方和作為調焦評價函數[19-20],其表達式如下:

式中:n 為小波分解的層數,WHLi、WLHi、WHHi分別為第i層分解所對應的水平、垂直、對角方向的高頻系數;SHLi、SLHi、SHHi分別為第i層分解所對應的水平、垂直、對角方向的高頻窗口。但根據人類視覺系統的特性,不同層的高頻系數對視覺效果的貢獻并不相同,同一層不同方向的高頻系數對視覺效果的影響也并有差異。為了使調焦評價函數既滿足客觀準確的要求,又符合人眼的視覺效果,提出了一種基于HVS加權的小波調焦評價函數:

其中:λi為第i層高頻系數對應的權值(簡稱:空間頻率權值);α、β、γ分別為水平、垂直、對角方向高頻系數對應的權值(簡稱:空間方向權值)。

2.2.1 小波基的選擇

選擇不同的小波基對同一圖像進行分解,得到的分析效果往往差異很大,因此首先應該選擇合適的小波基。由于提出的調焦評價函數是基于小波變換和HVS視覺多通道特性的相似性,所以選用的小波基不僅需要具有緊支集小和消失矩高的特性,同時,還需要具有很好的能量集中特性和精確重構特性。具體的小波基選取標準可以參考文獻[21],本文選用該文獻中的sym8作為小波基。

2.2.2 分解層數的確定

對圖像進行小波分解時,即使在同一小波基下也會因分解層數不同而得到不同的效果,因此還需要確定合適的小波分解層數。采用sym8小波基,對從離焦到正焦再到離焦的圖像序列分別進行1、2、3、4、5層小波分解,對高頻系數能量的統計結果如圖2所示。當進行5層小波分解時,清晰度評價函數出現了拐點,由此可知,對圖像進行5層小波分解時,出現了偽高頻成分,即第5層的高頻成分受到了低頻成分的影響。而只進行1層、2層或3層分解時,評價函數在聚焦圖像兩側出現了較大的飽和區,不利于搜索鏡頭的聚焦位置,因此選擇分解層數n=4比較合適。

圖2 不同分解層分析的性能比較Fig.2 Comparison of performance at different depths

2.2.3 調焦評價函數的權值選取

(1)空間頻率權值

利用CSF的非線性帶通特性,取相應頻帶內CSF幅值的平均值作為不同頻帶的高頻系數的空間頻率權值。對于4級小波分解,整個頻帶按頻率劃分成5部分,帶有權值的CSF特性曲線如圖3所示,各個頻帶[LH1,HL1,HH1],[LH2,HL2,HH2],[LH3,HL3,HH3],[LH4,HL4,HH4],LL4在其對應頻段上的權值分別為0.0872,0.5688,0.9455,0.8583,0.42,對其中的高頻子帶的權值進行歸一化,得到與第i層高頻系數對應的空間頻率權值分別為:λ1=0.0355、λ2=0.2312、λ3=0.3844、λ4=0.3489。

(2)空間方向權值

空間方向權值的確定比較簡單,根據HVS的視覺多通道特性,視覺系統對水平方向(0°)和垂直方向(90°)的刺激最敏感,而往對角方向的敏感性逐漸減弱,對于對角線方向(45°或135°)的刺激最不敏感。因此,在同一層小波分解后的高頻系數中,對表示水平方向和垂直方向的高頻系數賦予較大的權值,對表示對角方向的高頻系數賦予較小的權值,得到各層HL、LH、HH對應的空間方向權值分別為α=0.4、β=0.4、γ=0.2。

圖3 帶有加權值的CSF特性曲線Fig.3 Weighted CSF property curve

3 基于SOM神經網絡的搜索算法

在自動調焦的搜索算法中,最常用的是爬山法及一些改進的爬山法。爬山法在搜索過程中,電機每前進一個步長就需要停下來計算該位置對應圖像的調焦評價值,然后根據評價值的變化情況來確定電機下一步的前進方向,且需要對整個調焦區域進行全局判斷搜索,這樣大大增加了搜索時間。此外,爬山法容易受到評價函數局部峰值的干擾而不能準確聚焦。為了克服爬山法的上述缺點,提出了一種基于SOM神經網絡的搜索算法。

自組織映射(Self-organizing Map,SOM)神經網絡[15-17]是一種良好的無導師學習聚類網絡,能夠自動尋找樣本中的內在規律和本質屬性,自組織、自適應地改變網絡權值和結構。SOM神經網絡的訓練過程是基于競爭學習算法實現的。圖4為二維形式的SOM神經網絡結構圖。

將SOM神經網絡的輸入層和競爭層分別定義如下:

圖4 二維SOM神經網絡結構Fig.4 Two-dimensional SOM neural network structure

其中:n是輸入層神經元的個數;a和b分別是競爭層神經元的行數和列數。

競爭層k的每個神經元k的維數都與輸入層s的維數相同,因此,權向量wi可以表示為:

輸入層各神經元通過權向量wi將外界信息匯集到競爭層的各神經元。本文中,輸入層的訓練樣本為鏡頭在不同位置處對不同距離的景物所采集圖像的調焦評價值。根據自動調焦的原理,聚焦的圖像對應較高的調焦評價值,而離焦的圖像對應較低的調焦評價值。為了便于說明,僅討論3個目標物體O1、O2、O3在3種不同物距L1、L2、L3下的調焦情況,根據提出的小波調焦評價函數計算出在不同鏡頭位置處采集的圖像對應的調焦評價值,如圖5所示,并將這一系列評價值作為SOM神經網絡的輸入樣本,SOM網絡根據輸入樣本的數值自動調節其網絡權值wi,在這種情況下,訓練之后的SOM網絡的輸出層自動分成了9類:第1類對應O1和L1,第2類對應O1和L2,…,第9類對應O3和L3。需要說明的是,權向量wi的初始值可以定義為任意的隨機數。

圖5 不同景物在不同鏡頭位置所對應的調焦評價值Fig.5 Focus measures of different objects with different lens positions

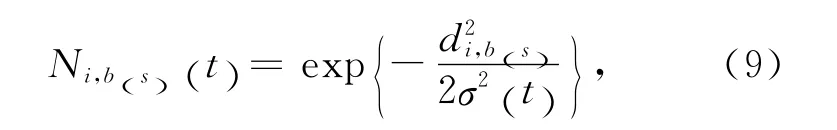

通過計算s與wi的歐氏距離,從中選出距離最小的神經元作為獲勝神經元b (s),其表達式如下:

一旦找到獲勝神經元,權向量wi就可以更新了,與獲勝神經元鄰近的所有神經元的向量權值按照式(8)進行調整:

其中:t為時間參數;η(t)是學習率,為隨時間衰減的函數(t)為以獲勝神經元b(s)為中心的鄰域函數,本文采用高斯鄰域函數,其表達式如下:

SOM神經網絡首先需要通過輸入樣本完成訓練,訓練完成的SOM就可以根據輸入樣本的數據確定其對應的輸出類別,電機就根據定義好的輸出類別將鏡頭移到預先定義的最佳聚焦位置。用矩陣z來表示預先定義的最佳聚焦位置,其對應的表達式如式(10):

其中:z的維數與競爭層k的維數相同。

基于SOM神經網絡的搜索算法的工作流程如圖6所示,在SOM神經網絡完成訓練的前提下,首先將鏡頭移回起始位置,接著通過3個鏡頭位置s0、s1和s2的調焦評價值作為SOM神經網絡的輸入,經過訓練完成的SOM神經網絡預測得到最佳聚焦位置s3,然后將鏡頭快速移動到位置s3,再通過SOM網絡預測得到一個更加精確的最佳聚焦位置,然后由電機帶動鏡頭繼續搜索;如此反復幾次,鏡頭的最佳聚焦位置sw可以輕易找到。

圖6 基于SOM神經網絡的搜索算法Fig.6 Searching algorithm based on SOM neural network

4 實驗結果

為了驗證提出的調焦方法,設計了基于PC機的自動調焦系統實驗平臺,其流程如圖7所示。系統采用XC-EI30CE CCD攝像機和焦距為10~330mm的Raymax鏡頭,在PC機端使用圖像采集卡天敏SDK2000完成對CCD攝像機輸出圖像的采集,然后在VC++中根據提出的調焦算法完成調焦評價值的計算和調焦搜索算法對鏡頭的控制,最后通過RS-232接口發送控制命令到調焦電機控制板,由其控制電機帶動鏡頭以實現自動調焦。

圖7 自動調焦系統流程圖Fig.7 Chart of the auto-focusing system

4.1 調焦評價函數的性能測試

通過連續改變鏡頭的位置采集一系列從離焦到聚焦再到離焦的圖像,一共41幅,其中第21幅為聚焦圖像。分別采用文獻[20]提出的基于各層高頻系數平方和的小波評價函數、文獻[22]提出的小波評價函數、以及本文提出的基于HVS加權的小波評價函數對采集到的圖像進行分析,得到的調焦評價曲線如圖8所示。從圖8可以看出,提出的基于HVS加權的小波評價函數比文獻[20]提出的小波評價函數有更高的靈敏度;而與文獻[22]提出的小波評價函數曲線相比,雖然文獻[22]提出的小波評價函數曲線在聚焦位置附近具有較高的靈敏度,但是該曲線的有效調焦區域過小,過大的調焦飽和區不利于調焦搜索算法尋找最佳聚焦位置;綜上所述,本文提出的小波評價函數的調焦曲線特性優于文獻[20]和文獻[22]提出的小波評價函數。

圖8 三種小波調焦評價函數的曲線Fig.8 Curves of 3kinds of measure function based on wavelet

4.2 調焦搜索算法的性能測試

先通過改變鏡頭位置對不同物距的景物采集一系列圖像,并將這一系列圖像的調焦評價值作為訓練樣本,用以完成SOM神經網絡的訓練。訓練完成的SOM神經網絡就可以用來預測鏡頭的最佳聚焦位置了,實驗中,將SOM網絡的輸出層分成49種類別。

選取不同的場景進行了100次調焦實驗,限于篇幅,僅給出最具代表性的兩組實驗進行分析比較。第1組實驗使用的場景是實驗室對面的大煙囪,如圖9所示,其圖像序列描述了從離焦到聚焦的整個過程,圖像在第6幀時已經聚焦。第2組實驗使用的場景是外場的建筑,如圖10所示,其圖像序列描述了從離焦到聚焦的整個過程,圖像在第8幀時已經聚焦。

圖9 第1組調焦實驗的圖像序列Fig.9 Experiment I:Image sequence in auto-focusing process

圖10 第2組調焦實驗的圖像序列Fig.10 Experiment II:Image sequence in auto-focusing process

自動調焦的時間主要包括采集圖像、評價圖像和電機驅動鏡頭的時間。為了將提出的搜索算法與基于全局搜索的爬山法對比,進行了相應的比較實驗,記錄了100次調焦實驗中需要采集和評價的圖像數目,并做了統計,統計結果如表1所示。由表1可知,采用提出的改進爬山法在搜索最佳聚焦位置的過程中,平均僅需要采集和評價7.3幅圖像,與基于全局搜索的爬山法相比,減少了電機驅動鏡頭的次數,節省了大量時間,提高了自動調焦的速度。

表1 采集和評價圖像的數目統計Tab.1 Statistics of the number of images collected and measured

5 結 論

分析了人類視覺系統特性的研究成果,針對HVS多通道特性和小波變換相匹配的特點,提出了一種基于HVS加權的小波調焦評價函數。根據視覺多通道特性和視覺敏感度帶通特性,分別對不同方向、不同空間頻率的小波高頻系數進行加權運算。由于提出的調焦評價函數模擬了人類視覺系統的特性,獲得的聚焦圖像更接近于人的主觀評價。為了提高自動調焦的搜索速度,利用SOM神經網絡的自動聚類功能,提出了一種帶有預測功能的搜索算法。與基于全局搜索的爬山法相比,提出的搜索算法僅需要采集處理7.3幅圖像就能找到鏡頭的最佳聚焦位置,減少了電機驅動鏡頭的次數,節省了大量的搜索時間。實驗結果表明,本文提出的調焦方法可以得到符合人眼視覺的調焦效果,同時調焦速度也有了較大的提高。

[1]Wang D J,Ding W,Zhang T,et al.A fast auto-focusing technique for the long focal lens TDI CCD camera in remote sensing applications[J].Optics and Laser Technology,2012,7(5):1-8.

[2]盧振華,郭永飛,李云飛,等.利用CCD拼接實現推掃式遙感相機的自動調焦[J].光學 精密工程,2012,20(7):1559-1565.Lu Z H,Guo Y F,Li Y F,et al.Realization of auto-focus on APRC using CCD stitching[J].Optics and Precision Engineering,2012,20(7):1559-1565.(in Chinese)

[3]劉炳強,張帆,李景林,等.空間相機調焦機構運動同步性誤差分析[J].中國光學,2013,6(6):946-951.Liu B Q,Zhang F,Li J L,et al.Analysis of synchronous motion error for focusing mechanism of space camera[J].Chinese Optics,2013,6(6):946-951.(in Chinese)

[4]許志濤,龍科慧,劉金國,等.空間相機調焦機構精度檢測系統設計[J].液晶與顯示,2013,28(6):943-947.Xu Z T,Long K H,Liu J G,et al.Design of focusing mechanism accuracy detection system of space camera[J].Chinese Journal of Liquid Crystals and Displays,2013,28(6):943-947.(in Chinese)

[5]楊會生,張銀鶴,柴方茂,等.離軸三反空間相機調焦機構設計[J].光學 精密工程,2013,21(4):948-954.Yang H S,Zhang Y H,Chai F M,et al.Design of focusing mechanism for off-axis TMA space camera[J].Optics and Precision Engineering,2013,21(4):948-954.(in Chinese)

[6]陳偉,丁亞林,惠守文,等.推掃式航空遙感器像面調焦機構設計[J].中國光學,2012,5(1):30-34.Chen W,Ding Y L,Hui S W,et al.Design of image plane focusing structure for push-scan aerial remote sensing instrument[J].Chinese Optics,2012,5(1):30-34.(in Chinese)

[7]Yin A J,Chen B Q,Zhang Y.Focusing evaluation method based on wavelet transform and adaptive genetic algorithm [J].Optical Engineering,2012,51(2):023201.

[8]王德江,李文明,許永森,等.TDI-CCD全景航空相機快速自動檢調焦方法[J].光電子·激光,2012,23(8):1452-1457.Wang D J,Li W M,Xu Y S,et al.A fast auto-focusing technique for the TDI-CCD panoramic aerial camera[J].Journal of Optoelectronics·Laser,2012,23(8):1452-1457.(in Chinese)

[9]Pertuz S,Puig D,Garcia M A.Analysis of focus measure operators for shape-from-focus[J].Pattern Recognition,2012:1-18.

[10]陳曉彬.基于小波的自動對焦算法研究[J].通信技術,2010,43(6):210-212.Chen X B.Study on auto-focus algorithm based on wavelet transform [J].Communications Technology,2010,43(6):210-212.(in Chinese)

[11]Daubeehies,Swelden W.Factoring wavelet transforms into lifting steps[J].J.Fourier Anal.Appl,1998,4(3):245-267.

[12]黃德天,吳志勇,劉雪超,等.一種適用于任意目標的離焦深度快速自動聚焦技術[J].光電子·激光,2013,24(4):799-804.Huang D T,Wu Z Y,Liu X C,et al.A depth from defocus fast auto-focusing technology for any target[J].Journal of Optoelectronics·Laser,2013,24(4):799-804.(in Chinese)

[13]王代華,周鋒,吳朝明.基于閾值的調焦方向判斷方法[J].儀器儀表學報,2010,31(8):1813-1818.Wang D H,Zhou F,Wu Z M.Direction judgment method for autofocus based on threshold[J].Chinese Journal of Scientific Instrument,2010,31(8):1813-1818.(in Chinese)

[14]Xu D J.A unified approach to autofocus and alignment for pattern localization using hybrid weighted Hausdorff distance[J].Pattern Recognition Letters,2011(32):1747-1755.

[15]Kohonen T.The self-organization maps[J].Proceedings of the IEEE,1990,78(9):1464-1480.

[16]Kohonen T.Self-Organization and Associative Memory [M].2nd Ed.Berlin:Springer-Verlag,1987.

[17]Kohonen T.Essentials of the self-organizing map[J].Neural Networks,2013(37):52-65.

[18]Mannos J L,Sakrison D J.The effect of a visual fidelity criterion on the encoding of images[J].IEEE Transactions on Inform.Theory,1974,20(2):525-536.

[19]張樂,姜威.多分辨力分析在自動聚焦算法抗噪聲性能中的應用[J].光學學報,2007,27(12):2150-2154.Zhang L,Jiang W.Application of multi-resolution analysis in anti-noise capability of auto-focusing algorithm [J].Acta Optica Sinica,2007,27(12):2150-2154.(in Chinese)

[20]菅維樂,姜威,周賢.一種基于小波變換的數字圖像自動聚焦算法[J].山東大學學報:工學版,2004,34(6):38-40,59.Jian W L,Jiang W,Zhou X.Auto-focusing algorithm of digital image based on wavelet transform [J].Journal of Shandong University:Engineering Science,2004,34(6):38-40,59.(in Chinese)

[21]丁藝芳.基于小波變換和視覺系統的圖像質量綜合評價新算法[D].上海:上海大學,2001.Ding Y F.A new algorithm for integrated image quality measurement base on wavelet transform and human visual system [D].Shanghai:Shanghai University,2001.(in Chinese)

[22]王義文,劉獻禮,謝暉.基于小波變換的顯微圖像清晰度評價函數及3-D自動調焦技術[J].光學精密工程,2006,14(6):1063-1069.Wang Y W,Liu X L,Xie H.A wavelet-based focus measure and 3-D autofocusing for microscope images[J].Optics and Precision Engineering,2006,14(6):1063-1069.(in Chinese)