基于Gist和PHOG特征的場景分類

劉 靜,郭 建,賀遵亮

(湘潭大學材料與光電物理學院,湖南湘潭411105)

1 概述

場景分類是計算機圖片分類的重要分支。將場景圖片區(qū)分為自然場景與人造場景可以為后續(xù)不同類別場景分類提供前期分類保證[1],劃分成自然場景和人造場景后可以針對這2類場景再次提取不同的場景描述特征,進行第2次場景精細劃分,因此,首先進行自然場景與人造場景的區(qū)分有著很重要的實際意義。

全局語義建模方法將場景視為一個整體進行描述,用全局特征來進行場景描述。當前使用的最好的全局語義建模方法是文獻[2-3]提出的采用空間包絡模型作為場景全局語義特征的描述算子Gist,將場景圖像通過不同方向和不同尺度的Gabor濾波器組后劃分成4×4的網格,取平均值級聯形成圖像的全局Gist特征。由于全局Gist特征是稀疏網格劃分的,因此同一網格中可能包含不同的場景部分,為此,文獻[4]提出采用局部Gist特征作為場景描述算子,但局部Gist特征在進行特征加權的時候只采用了一次加權,造成了特征維數過高。

梯度方向直方圖(Histograms of Oriented Gradient,HOG)[5]不僅可以描述局部特征,同樣可以用來描述整幅圖像的特征。HOG特征首先統計細胞單元內的局部梯度方向信息,然后在若干個細胞單元組成的區(qū)域內進行歸一化,而Gist特征是對整個圖像濾波后在局部區(qū)域內取各方向、各尺度的均值。兩者都不對圖像進行預分割,利用的都是圖像在空間域里像素值不連續(xù)形成的方向統計信息,將兩者組合起來描述場景圖像能夠提供更豐富的信息,文獻[6]將Gist特征與HOG特征進行組合實現圖像的場景分類。

局部Gist方法提取的特征維數龐大,HOG特征沒有考慮到圖像不同空間尺度劃分對分類性能產生的影響。為此,本文提出一種基于Gist特征和分層梯度方向直方圖(Pyramid Histogram of Oriented Gradient,PHOG)[7]特征組合的場景分類方法。采用改進局部Gist方法替代全局Gist方法,用PHOG特征替代HOG特征,然后進行特征組合實現場景分類。

2 特征提取

2.1 局部Gist特征

圖像的Gist特征提取,在實際的實現中采用的是將圖像與不同方向和不同尺度的Gabor濾波器組進行濾波,將濾波后得到的圖像劃分為網格,在每個網格內部取平均值,最后將濾波后得到的所有圖像的每個網格均值級聯起來,得到圖像的Gist特征。

一幅大小為h×w的灰度圖像f(x,y)用nc個通道的濾波器對圖像進行卷積濾波,其中,nc等于濾波器尺度和方向數的乘積,這樣得到nc個濾波后的圖像。將每幅濾波后的圖像劃分為4×4的網格,每個網格內取平均值得到一個特征。將每個網格塊的特征級聯起來,得到圖像的Gist特征,即:

局部Gist特征是將上述特征提取過程中的網格劃分改為由16×16的網格進行劃分,對于每一個網格再次采用大小為4×4的網格進行劃分,將每一個二級網格采取加權求和,權重矩陣W構建方法為對應像素到各子區(qū)域中心像素歸一化距離的倒數,再將所有的二級子網格特征進行級聯,得到局部Gist特征。該方法細化了場景特征的提取,有效地降低了同一網格中包含不同場景的概率,從而提高了場景分類的正確率,但其還存在一個問題,就是提取的特征維數過高。如一幅大小為256×256像素的圖像,其提取后的特征維數為:16×16×4×4×32=131 072維。如果不采取降維處理等手段,特征維數過于龐大,包含很多冗余信息,同時,給數據處理帶來很大的困難。

2.2 HOG特征提取

HOG特征是一種在計算機視覺中用于目標檢測的常用特征描述符,最早是由法國研究機構在2005年提出來的,是對圖像的局部區(qū)域內梯度方向信息的統計。HOG特征是在一個大小統一的網格密集的細胞單元上計算,且采用重疊部分對比度歸一化的方法來提高特征描述的性能,而光照條件變化和局部幾何變換這2種形變只會出現在更大的空間領域上,所以,HOG方法對它們可以保持一定程度的不變性。

HOG特征的提取過程如下:

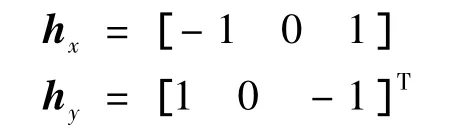

(1)對圖像進行伽馬顏色校正,然后用2個一維的模板:

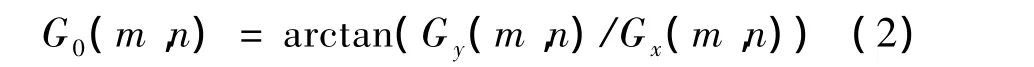

分別對圖像的垂直方向和水平方向做卷積運算。在稱為細胞的單元內,根據每一個像素的梯度方向,在事先定義的方向區(qū)間里,以梯度幅值為權重,統計梯度方向直方圖。像素點的梯度方向定義為:

建設生態(tài)清潔型小流域 服務南京生態(tài)文明建設——訪江蘇省南京市水利局局長張孝科……………………………… 韋鳳年,張瑜洪,吳卿鳳等(20.58)

其中,m,n分別為像素的行號和列號;Gx,Gy分別為圖像在x,y方向的梯度;G0為得到的梯度方向。

(2)在被稱為塊的區(qū)域內對上一步得到的方向直方圖進行正規(guī)化。用式(3)對塊內的直方圖進行正規(guī)化:

其中,i=1,2,…,n,n 為直方圖的區(qū)間數;ε 為小的正常數。

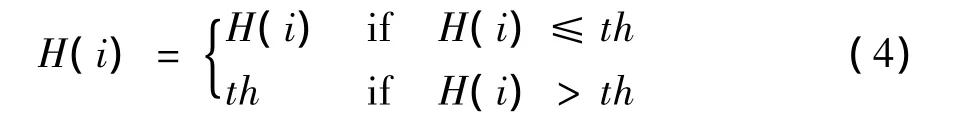

(3)使用截斷閾值th對得到的直方圖進行截斷:

(4)用式(3)對截斷后的直方圖進行正規(guī)化,得到最終的梯度方向直方圖。正規(guī)化后的各細胞直方圖按一般的圖像掃描方式,即從上到下、從左到右的方式連接起來,形成特征向量。

HOG特征考慮了圖像空間位置的分布,是描述圖像形狀信息的一種有效方法,但是沒有考慮到圖像的不同空間尺度劃分對分類性能可能產生的影響。

3 特征組合

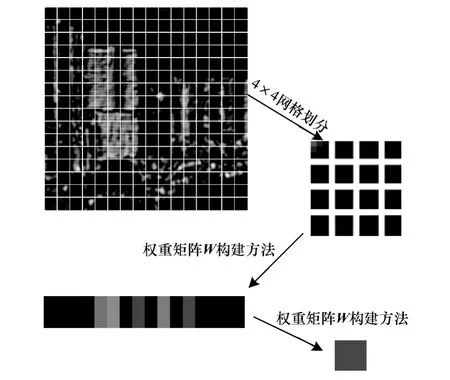

針對全局Gist特征與局部Gist的缺點,本文提出改進的局部Gist特征。在局部Gist特征提取過程中,進行加權以后,每一個二級子塊的特征為16維,顯然特征維數過大。同時,為了突出中心區(qū)域在整個區(qū)域所在的比重,將上述16維的向量從左到右、從上到下重新排列為4×4的矩陣,并再次進行加權,其權重與局部Gist特征中所采用的權重相同。這樣每一個二級子塊就降為一個特征向量,較局部Gist特征的維數有了較大幅度的降低,同時,也突出了每一個二級子塊的中心區(qū)域場景的特征值。具體提取過程如圖1所示。

圖1 改進的局部Gist方法特征提取過程

圖1左上角為經過濾波后的圖片,將圖片采用16×16的網格進行劃分,經過稠密網格劃分后可以發(fā)現每一個網格中基本上只包含了一類場景;右上角為每一個一級子網格經過4×4的子網格劃分后的情況;左下角為第一次采用權重處理后,每一個一級子網格計算出來的特征值;右下角為將一級子網格特征值進行重新排列后再次進行權重處理后得到的特征值。經過這樣處理,每一個一級網格提取出一個特征值,大大降低了特征維數,同時,經過權重處理以后,每一子網格的中心部分得以突出。

本文采用將2種特征進行首尾相連的方式來進行特征組合[9],形成一維特征向量,以此來描述場景圖片。

4 實驗結果及分析

根據上述方法提取圖像改進的局部Gist特征和PHOG特征,并將兩者進行組合,得到圖像的描述特征。采用支持向量機(Support Vector Machine,SVM)[10-11]對特征向量進行學習,使用 LibSVM[12]工具箱,核函數為徑向基函數,采用交叉驗證得到最優(yōu)參數,對場景進行自然場景與人造場景進行2類分類。每組實驗進行10次訓練與測試,取10次的平均值作為測試結果。

本文測試實驗的硬件及軟件環(huán)境:計算機運行內存4 GB,64 Byte Windows7 操作系統,Matlab2013b。

考慮到WS圖像庫樣本數量有限,本文測試只對OT庫進行訓練樣本數量與分類正確率的統計,以及特征提取、分類耗時和內存占用率的統計。

4.1 WS圖像庫分類測試

WS圖像庫是華盛頓大學的場景圖像庫,本文進行實驗測試時選取該庫中的12個類別,從其中選取合適的圖片組合成自然場景與人造場景圖像庫,其中,自然場景193幅,人造場景153幅。由于場景數據庫中圖片數量不多,為充分進行訓練,從每類中隨機選取一半數量圖片進行訓練,余下部分作為測試樣本。

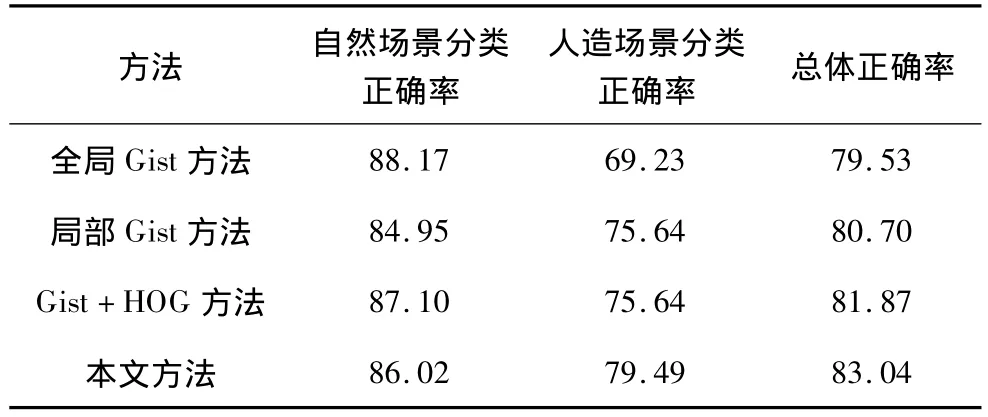

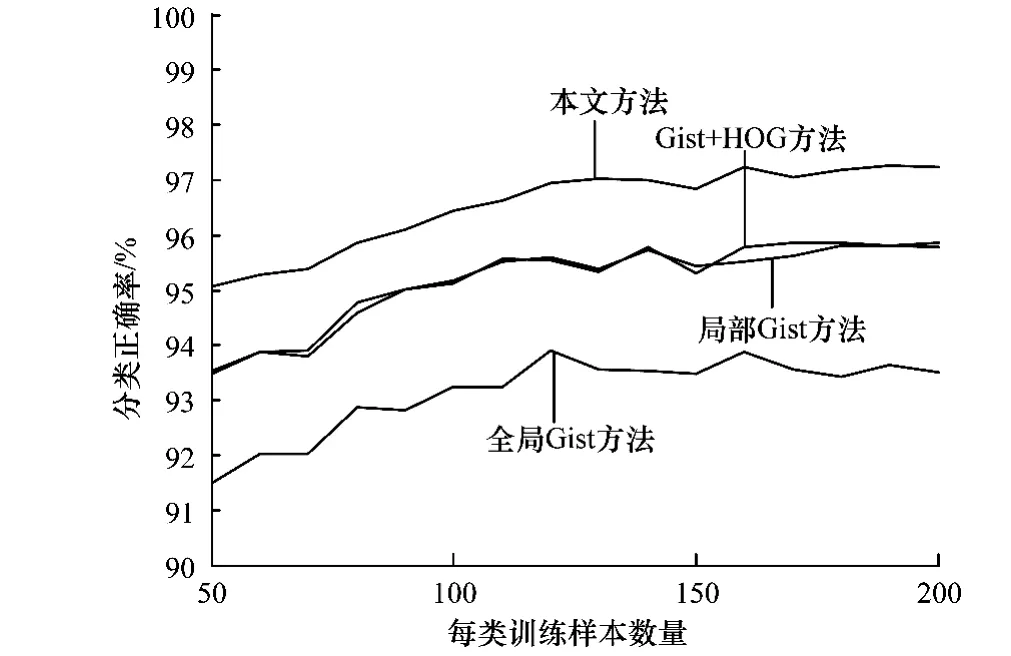

將本文方法與文獻[2]的全局 Gist方法、文獻[4]的局部Gist方法、文獻[6]的Gist+HOG 方法進行對比。在實際測試中,文獻[6]采用全局Gist特征。WS場景庫測試比較結果如表1所示。

表1 WS場景庫下不同方法的分類正確率對比 %

從表1可以看出,在WS場景庫中,雖然全局Gist方法,和Gist+HOG方法的自然場景區(qū)分正確率比本文方法高,但是總體正確率均低于本文方法,其中,全局 Gist方法的人造場景正確率不足70%。

4.2 OT圖像庫分類測試

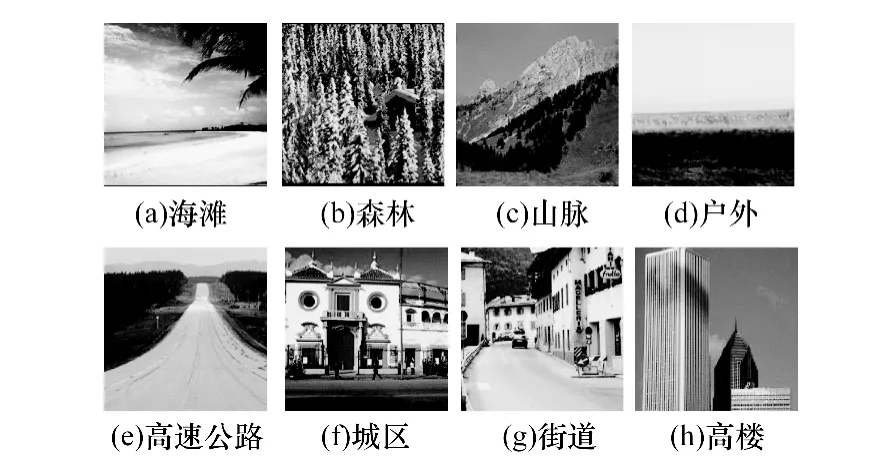

MIT的Oliva&Torralba(OT)場景庫共包含了如圖2所示的8類場景,分別為海灘360幅、森林328幅、山脈374幅、鄉(xiāng)村410幅、高速公路260幅、城區(qū)308幅、街道292幅和高樓356幅,將其中前4類劃歸為自然場景,后4類劃歸為人造場景,每幅圖像大小均為256×256像素,共計2 688幅。

圖2 OT場景圖像數據庫

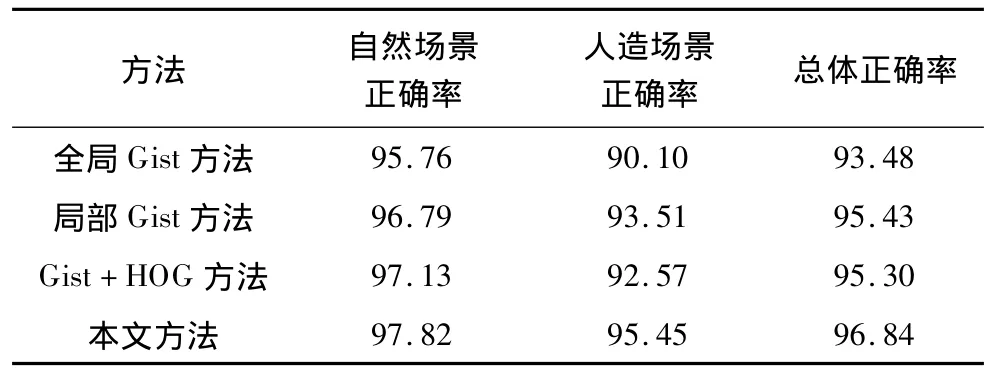

在OT場景庫下,本文首先比較了不同訓練樣本數量下4種方法分類正確率的變化情況,如圖3所示。從圖中可以看出,隨著訓練樣本數的增加,分類正確率逐步提升,在訓練樣本數達到150左右時,分類正確率基本上趨于穩(wěn)定,可以看出,本文方法在不同訓練樣本數量時分類正確率均高于其他3種方法。

圖3 訓練樣本數量與分類正確率的關系

綜合訓練樣本數量和測試樣本數量考慮,采用訓練樣本數為150時來進行4種方法分類正確率的比較。具體比較結果如表2所示。

表2 OT場景庫下不同方法的分類正確率對比 %

從表2可以看出,在OT場景庫中,本文方法能有效提高自然場景與人造場景的區(qū)分正確率,正確率達到96.84%,對于自然場景和人造場景每一類的分類正確率相較與其他方法均有提升。

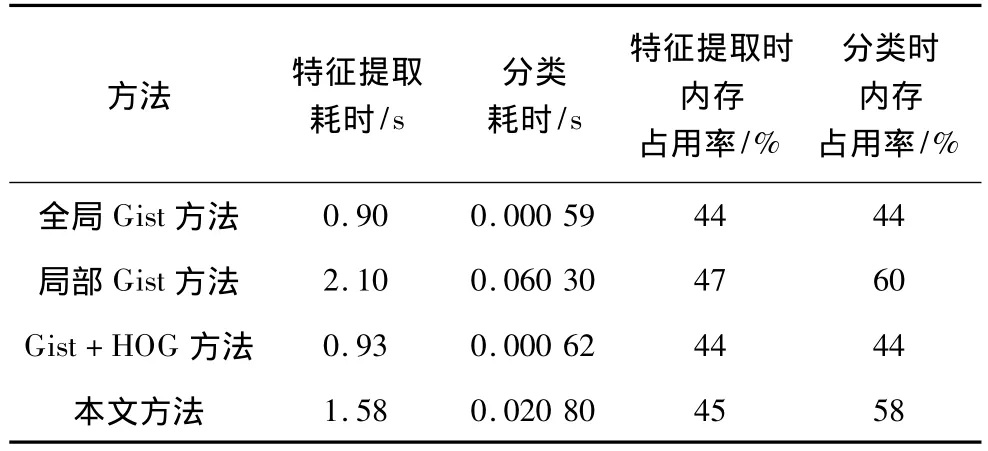

針對本文實驗數據庫,還統計了特征提取及分類所占用的時間,以及內存占用情況,具體為:特征提取是將整個庫中的圖片提取特征后統計每一幅圖像特征提取所占用的平均時間;分類時間為統計一定數量圖片分類耗時取平均值得到單幅圖像分類耗時;內存占用率是計算機在只運行該程序時統計的物理內存占用率。具體比較結果如表3所示。

表3 OT場景庫下不同方法的性能指標

從表3可以看出,對于每一張圖片從特征提取到分類結束本文方法用時為1.6 s,雖然較全局Gist及Gist+HOG 2種方法用時稍長,較速度最快的全局Gist方法延時了0.6 s左右,考慮到場景分類的應用情況,該時間消耗在可接受范圍內。還可以看出,雖然內存占用率在分類時達到了58%,但在計算機快速發(fā)展的今天,相比于本文方法所帶來的分類正確率的提升,該限制因素可以忽略不計。因此,從上述分類測試及耗時和內存占用率情況的比較可以看出,在忽略其他因素影響下,本文方法可以達到提升場景分類正確率的目的。

5 結束語

場景分類中局部Gist特征維數過高,單一特征不能很好地描述場景。為解決該問題,提出一種基于改進的局部Gist特征和PHOG特征進行組合的特征向量,以描述圖像場景,結合支持向量機進行自然場景與人造場景分類。實驗結果表明,該方法的分類正確率高于全局Gist方法、局部Gist方法和Gist+HOG方法。然而,本文只討論了自然場景與人造場景分類,如何實現2類場景中每一類場景的精確區(qū)分是今后的研究重點。

[1] 劉 靜.基于場景 Gist的快速場景分類研究[D].吉林:吉林大學,2013.

[2] Oliva A,Torralba A.Modeling the Shape of the Scene:A Holistic Representation of the Spatial Envelope[J].International Journal of Computer Vision,2001,42(3):145-175.

[3] Oliva A,Torralba A.Building the Gist of a Scene:The Role of Global Image Features in Recognition[J].Progress in Brain Research:Visual Perception,2006,155:23-36.

[4] 楊 昭,高 雋,謝 昭,等.局部Gist特征匹配核的場景分類[J].中國圖象圖形學報,2013,18(3):264-270.

[5] Dalal N,Triggs B.Histograms of Oriented Gradients for Human Detection[C]//Proceedings of IEEE Computer Society Conference on Computer Vision and Pattern Recognition.Washington D.C.,USA:IEEE Press,2005:886-893.

[6] 劉 宏,普杰信.一種改進的自然場景特征提取方法[J].計算機工程,2011,37(21):182-184.

[7] Bosch A,Zisserman A,Munoz X.Representing Shape with a Spatial Pyramid Kernel[C]//Proceedings of the 6th ACM International Conference on Image and Video.New York,USA:ACM Press,2007:401-408.

[8] 趙碧茹.場景特征可分性與協同求解方法[D].合肥:合肥工業(yè)大學,2012.

[9] 黃榮娟,姜佳欣,唐銀鳳,等.基于多特征組合的圖像紋理分類[J].計算機應用與軟件,2011,28(8):12-16.

[10] Burges C J C.A Tutorial on Support Vector Machines for Pattern Recognition[J].Data Mining and Knowledge Discovery,1998,2(2):121-167.

[11] Vapnik V.The Nature of Statistical Learning Theory[M].2nd ed.Berlin,Germany:Springer-Verlag,2000.

[12] Chang Chih-Chung,Lin Chih-Jen.LIBSVM:A Library for Support Vector Machines[J].ACM Transactions on Intelligent Systems and Technology,2011,2(3):1-27.