基于選擇學習機制的深度圖像超分辨率算法

任曉芳,王紅梅,王愛民,楊 杰

(新疆工程學院 計算機工程系,新疆 烏魯木齊 830052)

基于選擇學習機制的深度圖像超分辨率算法

任曉芳,王紅梅,王愛民,楊 杰

(新疆工程學院 計算機工程系,新疆 烏魯木齊 830052)

針對深度圖像傳感器與彩色圖像傳感器的空間分辨率較差的問題,提出一種提高深度圖像分辨率的算法,不同于傳統方法。該算法是基于機器學習的超分辨率選擇機制,選擇均值型、最大值型和中值型三種濾波器方法作為候選方法。首先運用高分辨率深度圖像下采樣和高分辨率彩色圖像選擇最優的濾波器,同時經過特征提取獲得特征集;然后,高分辨率深度圖像直接通過最優濾波器獲得特征集;

深度圖像;超分辨率;機器學習;支持向量機;飛行時間

超分辨率技術從提出到發展已近30年,在安防、醫學、軍事等領域運用廣泛,從2D圖像到3D圖像都有很多經典技術。在3D圖像和視頻應用中,估計或獲取高分辨率深度圖像很關鍵。最近立體匹配技術[1]利用圖形硬件和商業深度傳感器能實時重建高質量深度圖像,例如基于結構光源深度攝像機[2]實時捕捉手勢和身體姿勢估計高質量深度圖像。因為在許多視覺應用中,例如3D重建和多視圖呈現,需要彩色圖像以及深度圖像,因此人們提出了混合相機的結構,它包括立體加深度[3]和顏色加深度[4-5]。其中,顏色加深度由于簡單性所以更容易實現。

顏色加深度的一個關鍵問題是深度傳感器與圖像傳感器相比存在較差的空間分辨率。因此,一種提高深度圖像空間分辨率的技術被提出來,即深度圖像超分辨率技術。為了實現這個目的,文獻[6-9]介紹了各種深度圖像超分辨率算法。文獻[6]提出了一種局部直方圖,該直方圖利用相鄰顏色和深度像素插值每個像素并且作為概率密度函數(pdf),將最大pdf作為目標深度值。然而,本文發現這樣的策略并非總能達到最佳超分辨率性能,因為有時在插值深度邊緣會產生偽影。文獻[7]是對飛行時間相機獲得的深度圖像進行超分辨率重建,結合局部和非局部相似性約束,同場景的高分辨率場景彩色圖像的自適應權重濾波,雖然取得一定效果,但顏色邊緣不一致,而且不具有實時性。文獻[8]提出了一種自適應中值濾波器和雙邊濾波器上采樣深度圖像,這種方法可以產生不存在紋理復制問題的銳化邊緣,但是獲取的深度邊緣與顏色邊緣十分不一致,因為在超分辨率深度圖像中沒有使用彩色信息。文獻[9]討論了飛行時間相機、基于馬爾可夫隨機場(MRF)框架的超分辨率技術、最大后驗概率(MAP)等超分辨率技術、小波在超分辨率技術的應用等,提出將參數模型融入到正則化約束項對深度圖像局部邊緣進行約束,該模型是針對彩色圖像局部結構特征的深度圖像超分辨率。

上述和其他許多深度圖像超分辨技術試圖找到一個有效的濾波器方案或者聯合一些濾波器方法。本文假設沒有一種濾波器性能普遍優于其他濾波器,且啟發式濾波器組合方法總存在改進空間。從這個觀點看,本文超分辨率深度圖像采用機器學習技術。由于存在顏色加深度圖像數據庫[10],因此訓練圖像由低分辨率(LR)深度圖像和與其對應的高分辨率(HR)彩色深度圖像對組成。給定訓練樣本和多個候選濾波器,本文可以觀察到哪些濾波器性能最好,哪些因素影響濾波器性能。為了實現這個目的,采用與文獻[6]相似方法生成直方圖,然后從直方圖提取一種頻域特征向量,特征向量很好地描述了濾波器選擇模式。最終利用訓練樣本和特征向量訓練支持向量機(SVM)分類器。另外本文設計了一種頻域特征向量,該向量能明顯區分不同特點濾波器。

1 濾波器選擇與特征提取

本文假定彩色和深度圖像是一致的。當分別使用彩色和深度傳感器時,傳統解決方案將深度圖像像素坐標系轉換到彩色圖像像素坐標系[6]。因此超分辨率深度圖像的問題轉換為尋找彩色像素坐標系的深度值。

1.1 候選濾波器

設C和DL分別表示HR彩色圖像和與其對應的LR深度圖像。映射DL到彩色圖像坐標系,獲取部分填充深度像素的HR深度圖像,表示為D。超分辨率深度圖像的目標是對D應用空間不同濾波器,使得D中所有像素有精確的深度值。

許多傳統深度上采樣算法[6,11]通過下式尋找D中像素p的深度值d

C(q))GD(d-D(q))

(1)

在傳統的聯合雙邊均值濾波(JBAF)中[12],使用下式獲取深度值

(2)

式中:通過設置σD=0將深度高斯函數變為σ函數。因為JBAF的濾波器系數由像素間的色差決定,因此D的深度邊緣可以很好地結合C的彩色邊緣。然而,由于在式(1)的和中,小權重細微的影響,D中會出現不必要的模糊。

為了解決JBAF的問題,本文提出了權重濾波器(WMF)[6],定義如下

(3)

即WMF選擇最大化權重分布的深度值,因為濾波器中選擇非線性操作,可以減少不必要的模糊。然而,WMF獲取的深度邊緣往往不能準確地與彩色圖像邊緣對齊。文獻[6]發現JBAF和WMF分別在L2范式和L1范式下能有效最小化。

同時,中值濾波器也使用在彩色和深度圖像超分辨率中[13]。對不為整數的權重值,通過下式獲取中值濾波器

(4)

因為在深度圖像濾波器中使用色差,所以本文稱這種濾波器為聯合雙邊中值濾波器(JBMF)。

濾波器的選擇依賴于權重分布的特點,本文采用基于學習的方法,使用大量數據庫訓練分類器。將JBAF、WMF和JBMF作為候選濾波器,因為它們存在比較明顯的特征。基于學習的框架必要時還包括任何額外濾波器。此外,等式(1)的相同權重用作3個濾波器的權重分布。因為深度高斯函數考慮了深度信號的可用性[6],因此本文實驗中JBAF也使用深度高斯函數,其中σD≠0。本文更關心新權重分布的設計。

1.2 特征提取

特征提取在基于學習的算法中扮演很重要的角色。提取的特征要能很容易區分不同特點濾波器。在上小節中,觀察到權重分布的變化與濾波器選擇有關。為了實現這個目的,從權重分布提取特征向量需要考慮2個方面內容:首先,權重分布的絕對位置不能決定濾波器的選擇。例如,從 163~177的非0位置,在這種情況下,JBAF為最佳濾波器,因為無論位置范圍向左偏移還是向右偏移,JBAF都沒有變化;第二,在權重分布中存在多種分離模式影響濾波器的選擇,因此,隔非零值位置對濾波器選擇很重要。

考慮上面的2個方面,2種向量vω和vs定義如下

(5)

(6)

為簡單起見,從H(p,d)式中忽略像素坐標系p。向量vω和vs分別由對應權重分布的非0值位置的權重值和2個連續非零位置的間隔組成。設N和N-1分別為vω和vs的長度。根據定義的向量vω和vs,每個像素的N種變化依賴于權重分布的稀疏性。因此本文定義固定長度L且更改向量為下式

(7)

k

(8)

(9)

(10)

在基于學習的超分辨率深度圖像中使用特征向量V。圖1顯示了本文頻域特征的有效性。紅圈、綠叉和藍點分別表示JBAF、WMF和JBMF的特征向量(原圖為彩圖)。隨機從每個訓練集選擇100個特征向量,通過LDA獲取x軸和y軸組件。根據線性判別分析(LDA)[15],從圖中可以看出頻域特征與空域特征相比有較好的性能。分類準確性根據SVM訓練樣本的10折交叉驗證衡量。空域和頻域特征向量的分類準確率分別為72.4%和80%。

圖1 頻域特征有效性

2 本文整體構架

本文基于學習的算法由訓練階段和測試階段組成。圖2顯示了獲取濾波器分類器的訓練階段。給定的HR彩色圖像和深度圖像對作為訓練集,通過HR深度圖像下采樣獲取LR深度圖像,然后對HR彩色圖像和LR深度圖像的所有像素應用JBAF、WMF和JBMF進行插值。因為本文在訓練階段存在真實HR深度圖像,所以對每個像素,本文可以檢測到哪個濾波器獲取的像素深度值與真實值相同。為了聯合特征向量,首先生成JBAF、WMF和JBMF的3個空集。如果對于一個像素,一種濾波器的性能超過其他濾波器,將它的特征向量V包含在相應的集合中。

圖2 訓練階段流程圖

圖3顯示了獲取HR深度圖像的測試階段。當LR深度圖像和HR彩色圖像作為輸入時,LR深度圖像首先映射到彩色像素坐標系中。對每個將要插值的像素,從等式(1)獲取權重分布。然后從權重分布獲取特征向量,如1.2節所示。濾波器分類器最后決定像素需要那種分類器。對所有沒有深度值的像素應用以上過程,可以構建HR深度圖像。

圖3 測試階段流程圖

3 實驗結果

本文首先在Middlebury 2001 和2003數據庫上測量本文算法性能。然后本文將該算法應用于實際環境且定性評價其性能。等式(1)的標準偏差GS,GC,GD分別選擇7,6和2.9。文獻[6]詳細描述了這些參數。

本文算法與其他5種算法做了比較。前三種算法分別為WMF,JBAF和JBMF。第四種算法為基于WMF,JBAF和JBMF中最佳濾波器的方法。更具體地說,最佳濾波器獲取的深度值最接近真實HR深度值。本文算法的上限通過這種方法衡量,稱之為第四種算法為理想方法。最后,傳統超分辨率深度圖像的性能,稱為廣義總變化各向異性(ATGV)算法[16]。該算法也與上面算法相比較,使用作者提供的軟件獲取實驗結果。

圖4所示為4個廣泛使用的測試圖像,這些圖像沒有包含在訓練圖像中,且被用來評價本文算法性能。圖4c和圖4d所示為真實深度圖像中一些丟失的像素。這些丟失的像素沒有包括在定量評價中[10]。然后對HR深度圖像分別使用采樣因子為4和8的下采樣。此外,噪聲LR深度圖像也作為輸入圖像。為了考慮現實環境,本文模擬ToF深度攝像機的噪聲模型,該攝像機模型的LR問題比基于結構化光源的深度攝像機更嚴重。眾所周知,ToF深度噪聲的標準偏差與圖像像素值返回傳感器的強度成反比(通常,紅外線發射,然后返回)。通過考慮返回光的色度飽和度強度(HIS)顏色空間的彩色圖像的強度組件,將噪聲強度依賴添加到無噪聲深度圖像。更具體地說, 對位置為 (x,y) 的每個像素加入標準

偏差為σN(x,y)的高斯噪聲,其中σN(x,y)定義如下

(11)

式中:CI(x,y)表示彩色圖像中位置為(x,y)的像素在HIS空間的強度值。為了仿真ToF深度攝像機的噪聲,給定的差異值首先轉換為深度值且將噪聲添加到深度空間。然后噪聲深度值返回到噪聲差異值。微調等式(11)的常數k,使得無噪聲和噪聲差異圖像間的RMSE值近似于5(容忍度為0.01)。

圖4 原彩色和深度圖像對

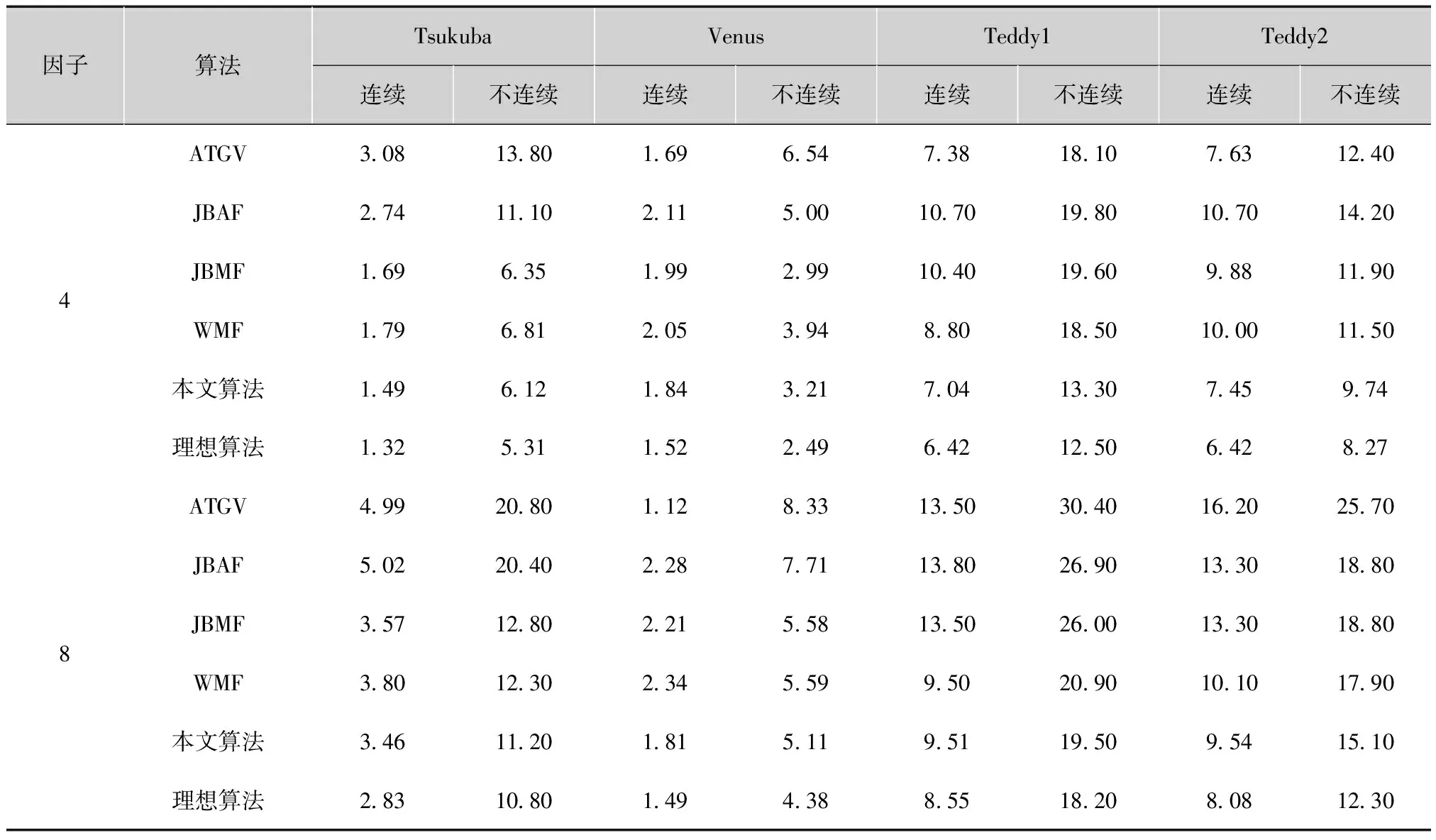

表1和表2給出了算法性能的評價結果。統計沒有正確匹配的像素數所占的百分比,絕對誤差大于一個像素。分別將深度值連續區域和不連續區域的像素作為評價依據。文獻[10]介紹了定量評價的細節。實驗結果顯示本文算法性能優于ATGV和分別使用WMF、JBAF和JBMF算法。特別地,當使用噪聲深度圖像時,該算法的性能仍然優于這些算法,表明本文濾波器分類器對深度噪聲不敏感。然而,仍然存在本文算法和理想算法之間不可忽略的性能差距。本文憑經驗發現實驗中使用的三種濾波器不能完全可分。特別地,JBAF和JBMF輸出的均值和中值常常相似,如圖2所示,因此在訓練階段很難將兩者完全分開。

表1 無噪聲的深度圖像被用作輸入時,各種超分辨率深度圖像算法沒有匹配的像素百分比 %

因子算法TsukubaVenusTeddy1Teddy2連續不連續連續不連續連續不連續連續不連續4ATGV27512900495483971020328681JBAF2341050058584284736302697JBMF114540021205243595183393WMF113535020200338844169353本文算法111532020199239579162335理想算法1064980181821744291493168ATGV486201008879682921878431700JBAF405185005858463816905631340JBMF25011500343685591440374879WMF22310500323405641440331745本文算法2119890323385271380315719理想算法2029460313244541160271—

表2 有噪聲的深度圖像被用作輸入時,各種超分辨率深度圖像算法沒有匹配的像素百分比 %

因子算法TsukubaVenusTeddy1Teddy2連續不連續連續不連續連續不連續連續不連續4ATGV308138016965473818107631240JBAF27411102115001070198010701420JBMF169635199299104019609881190WMF179681205394880185010001150本文算法1496121843217041330745974理想算法13253115224964212506428278ATGV49920801128331350304016202570JBAF50220402287711380269013301880JBMF35712802215581350260013301880WMF3801230234559950209010101790本文算法346112018151195119509541510理想算法283108014943885518208081230

圖5顯示了根據無噪聲的LR深度圖像重建的HR深度圖像。為了可視化,只放大深度不連續區域。從圖中可以看出本文算法重構的HR深度圖像精度較高。JBAF產生了不必要的模糊,而WMF常常導致邊緣附近產生偽影,因為它常常選擇最大化權重分布的深度值。通過JBMF獲取深度圖像的邊緣銳化程度位于WMF和ATGV之間。ATGV算法在深度邊緣附近也表現出了不可忽視的偽影。圖6顯示了根據有噪聲的LR深度圖像重建的HR深度圖像。與有噪聲區域相比較,所有算法都明顯提高了圖像深度質量。特別地,ATGV算法表現Venus數據庫圖像平面更好,但是在Tsukuba和Teddy數據庫圖像上出現不精確的深度邊緣。在總體上,本文算法與其他算法相比產生了比較少的偽影。

圖5 HR深度圖像的放大,對無噪聲深度圖像使用采樣因子為4的下采樣且作為輸入

圖6 HR深度圖像的放大,對有噪聲深度圖像使用采樣因子為4的下采樣且作為輸入

4 總結與展望

本文提出了一種基于學習的深度圖像超分辨率濾波器選擇方法。訓練分類器使得算法能有效選擇每個像素的最佳濾波器。另外本文設計新的頻域特征,該特征提高了算法區分不同濾波器方法的能力。使用合成數據庫、真彩色和深度圖像論證本文算法的有效性,以及對噪聲圖像的魯棒性。

由于本文考慮的是超分辨率深度圖像而不是超分辨率深度視頻。在視頻中,超分辨率深度圖像的時間一致性需要考慮。因此,提高本文算法的時間一致性來處理超分辨率深度視頻將是下一步研究的重點。

[1] KOWALCZUK J, PSOTA E T, PEREZ L C. Real-time stereo matching on CUDA using an iterative refinement method for adaptive support-weight correspondences[J]. IEEE Trans. Circuits and Systems for Video Technology, 2013, 23(1): 94-104.

[2] ZHANG Z. Microsoft kinect sensor and its effect[J].IEEE Multimedia, 2012, 19(2): 4-10.

[3] 趙興朋. 視頻圖像2D轉3D算法研究及硬件實現[D]. 青島:中國海洋大學, 2012.

[4] 楊宇翔, 汪增福. 基于彩色圖像局部結構特征的深度圖超分辨率算法[J]. 模式識別與人工智能, 2013, 21(5) : 245-251.

[5] JUNG S W. Enhancement of image and depth map using adaptive joint trilateral filter[J].IEEE Trans. Circuits and Systems for Video Technology, 2013, 23(2): 258-269.

[6] MIN D, LU J, DO M N. Depth video enhancement based on weighted mode filtering[J]. IEEE Trans. Image Processing, 2012, 21(3): 1176-1190.

[7] 楊宇翔, 曾毓, 何志偉,等. 基于自適應權值濾波的深度圖像超分辨率重建[J]. 中國圖象圖形學報, 2014, 19(8) : 112-118.

[8] OH K J, YEA S, VETRO A, et al. Depth reconstruction filter and down/up sampling for depth coding in 3-D video[J]. IEEE Signal Processing Letters, 2009, 16(9): 747-750.

[9] 楊宇翔. 圖像超分辨率重建算法研究[D].合肥:中國科學技術大學, 2013.

[10] SCHARSTEIN D, SZELISKI R. A taxonomy and evaluation of dense two-frame stereo correspondence algorithms[J]. International Journal of Computer Vision, 2002, 47(1-3): 7-42.

[11] GARCIA F, MIRBACH B, OTTERSTEN B, et al. Pixel weighted average strategy for depth sensor data fusion[C]//Proc. 17th IEEE International Conference on Image Processing (ICIP), 2010. [S.l.]:IEEE Press, 2010, 34(19) : 2805-2808.

[12] KOPH J, COHEN M F, LISCHINSKI D, et al. Joint bilateral upsampling[C]//Proc. ACM Trans. Graphics (TOG). [S.l.]:ACM, 2007, 26(3): 96-102.

[13] OH K J, YEA S, VETRO A, et al. Depth reconstruction filter and down/up sampling for depth coding in 3-D video[J].IEEE Signal Processing Letters, 2009, 16(9): 747-750.

[14] 琚生根, 周激流, 何坤,等. 頻域光照歸一化的人臉識別[J].電子科技大學學報, 2009, 28(6) :1021-1025.

[15] 楊健, 楊靜宇, 葉暉. Fisher線性鑒別分析的理論研究及其應用[J]. 自動化學報, 2003, 21(4) : 124-130.

[16] FERSTL D, REINBACHER C, RANFTL R, et al. Image guided depth upsampling using anisotropic total generalized variation[C]//Proc. 2013 IEEE International Conference on Computer Vision (ICCV).[S.l.]:IEEE Press, 2013, 24(21): 993-1000.

任曉芳(1979— ),女,碩士,講師,主要研究領域為多媒體、圖像處理等;

王紅梅(1982— ),女,碩士,講師,主要研究領域為多媒體、軟件工程;

王愛民(1970— ),女,碩士,副教授,主要研究領域為多媒體、軟件工程等;

楊 杰(1968— ),女,副教授,主要研究領域為計算機應用、軟件工程等。

責任編輯:任健男

Learning-based Filter Selection Scheme for Depth Image Super Resolution

REN Xiaofang, WANG Hongmei, WANG Aimin, YANG Jie

(DepartmentofComputerEngineering,XinjiangInstituteofEngineering,Urumqi830052,China)

Since the resolution of depth image sensors and color image sensors are very low,an algorithm is proposed to improve resolution. Unlike the traditional methods, this algorithm is based on machine learning and super resolution choosing mechanism. Choose from the mean-type, max-type and median-type filtering. Firstly, the down-sampling of high resolution depth images and high resolution color images are used to obtained the best filter and the feature sets are obtained by feature extraction. Then the feature sets are acquired by the high resolution depth images filtered by the best filter. Finally, filter classifier is got from the feature sets trained by support vector machines. In addition, a new frequency-domain feature vector is designed to enhance the discriminability of the methods. The mixed sets are used in this paper to test the algorithm. Experiments on non-noise and noise images show the effectiveness and robustness. Experiments in true color and depth images of time of fight also indicate that this algorithm is better than traditional methods.

depth image; super resolution; machine learning; support vector machines; time of flight

新疆工程學院基金資助項目(2013xgy141412)

TP391

A

10.16280/j.videoe.2015.17.035

2014-12-20

【本文獻信息】任曉芳,王紅梅,王愛民,等.基于選擇學習機制的深度圖像超分辨率算法[J].電視技術,2015,39(17).

最后,這些特征集經過支持向量機(SVM)訓練獲得濾波器分類器。此外,還提出了一種頻域特征向量,用于提高算法識別性能。無噪聲和有噪聲的深度圖像實驗驗證了算法的有效性和魯棒性,在真彩色和飛行時間深度圖像的實驗結果表明,提出算法的性能優于傳統算法。