對角神經網絡陀螺隨機誤差建模研究

楊益興

(海軍駐中國船舶重工集團公司第七〇一研究所軍事代表室,湖北 武漢430064)

0 引 言

陀螺儀作為慣性導航系統的核心器件之一,其精度直接決定慣性導航系統的性能,故對陀螺儀誤差的研究具有非常重要的意義。陀螺儀的誤差可分為系統性和隨機性兩大類。對于系統性誤差,可根據其規律進行相應的標定來補償;而隨機性誤差是由陀螺內部和外部的干擾引起的一種隨機誤差,它受各種不確定因素的影響,不能進行離線的標定,是慣性元件的主要誤差源之一。隨著對隨機誤差理論的研究,產生了多種分析陀螺隨機誤差的方法,如Allan 方差、ARMA、小波理論、神經網絡等方法都被應用到隨機誤差分析中,并取得一定成果[1-7]。

對于陀螺的隨機誤差模型,通常假設其為白噪聲與有色噪聲的組合[8]。這種假設把白噪聲從隨機誤差中分離出來,符合Kalman 濾波器的驅動要求,同時利用微分方程描述有色噪聲,便于實現在線估計與補償,但這種方法的缺陷也非常多[9]。ARMA 方法基于時間序列數據,建立差分方程。利用ARMA 方法對陀螺隨機誤差進行建模可以達到較理想的效果。模型檢驗通過后,接受在置信區間內殘差為白噪聲的假設,便于誤差的濾波補償。但陀螺的隨機誤差呈現一定非線性特性,而ARMA 模型是一種離線的線性模型,其處理的數據須為平穩時序數據,且還需事先判定模型的階次等[10],操作比較復雜。當模型發生變化時,ARMA 又需重復操作上述過程。

神經網絡具有任意非線性映射的能力,可對未知系統進行數學建模。神經網絡的時序建模廣泛采用外遞歸神經網絡,其思想是借鑒ARMA 建模方法,利用神經網絡來代替ARMA 模型。不同于外遞歸網絡,對角遞歸神經網絡(DRNN)[11]是一種局部內遞歸神經網絡。DRNN的內遞歸特性使其具有很好的動態特性,能實現動態的非線性映射,同時DRNN 不必像ARMA和外遞歸神經網絡一樣,必須判定模型的階次;DRNN的局部遞歸特性使其擁有更少的權值,從而減少了它的訓練時間,有更好的實時性。本文應用DRNN 對光纖陀螺的隨機誤差進行建模分析,網絡利用LMBP算法進行訓練,并與ARMA 方法和外遞歸BP 網絡所建模型進行對比。仿真并對隨機誤差進行預測,驗證模型的有效性,并證明了利用DRNN 建模更加有效。

1 對角遞歸神經網絡

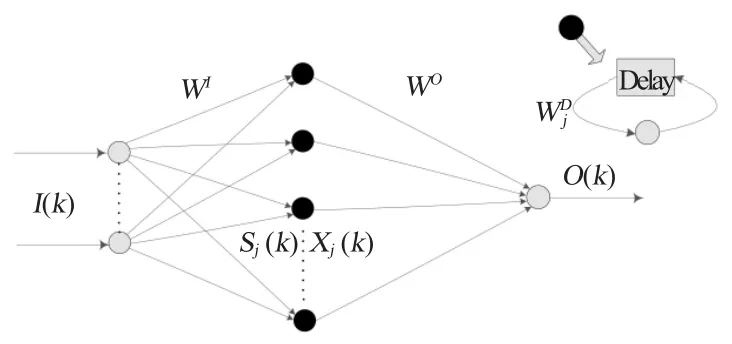

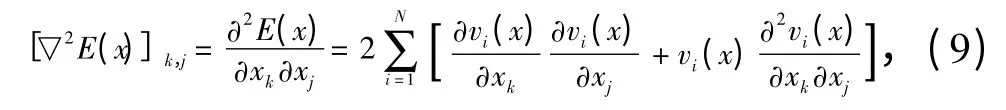

對角遞歸神經網絡(Diagonal Recurrent Neural Network,DRNN)是一種內部遞歸神經網絡,其特點是隱層神經元有自我延遲反饋。DRNN 是Elman 遞歸網絡的一種簡化形式,它隱層的神經元只接收自己的延遲反饋,與其他同層神經元沒有反饋連接。因此,相比Elman 這種全局反饋遞歸網絡,DRNN 具有更簡單的結構,網絡有更好的實時性能與學習速度,且仍能實現動態映射。DRNN的網絡結構如圖1所示。

圖1 DRNN 結構圖Fig.1 The structure of DRNN

DRNN 有3 層網絡,設輸入神經元為n個,隱層神經元為h個,輸出神經元為1個。其數學描述如下:

式中:I(k)為網絡輸入;O(k)為網絡輸出;Sj(k)和Xj(k)分別為隱層第j個神經元的輸入與輸出;下標為0的代表偏置輸入,這里取值為1;WI為輸入層到隱層的權值矩陣與偏置值;WO為隱層到輸出層的權值矩陣與偏置值;為隱層第j個神經元自遞歸的權值與偏置值;隱層神經元激活函數f(x)取S 函數,輸出神經元激活函數取線性函數。

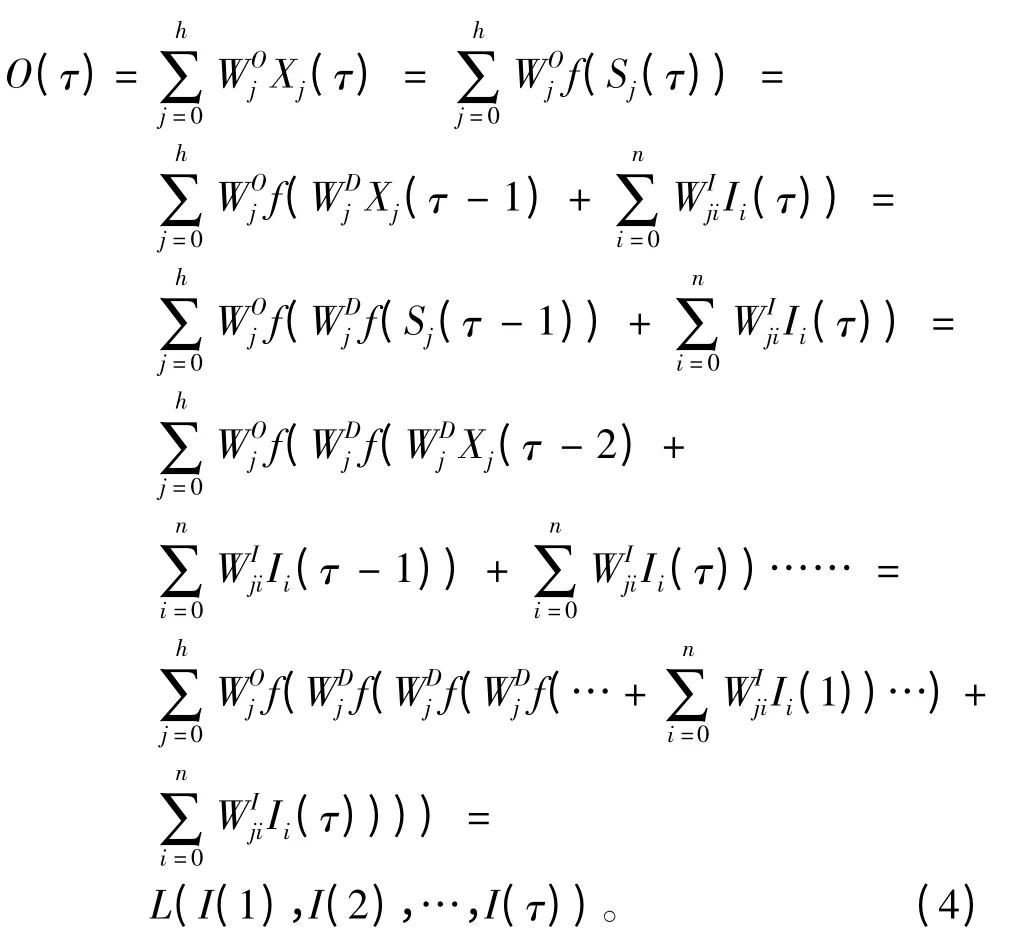

利用神經網絡對時間序列數據進行建模已有應用,其主要思想是仿照ARMA 模型方法進行非線性的建模[12],具有延遲的外部遞歸神經網絡非常好地體現了這一特點。DRNN 作為具有延遲的內遞歸神經網絡,同外遞歸神經網絡一樣可以實現時間序列建模預報[13],并且不需要事先知道模型的階次,其簡要證明如下:

設有時間序列{x(1),x(2),…,x(t)},預測任意τ(τ=1,2…t)時刻,相對應網絡輸出為O(τ),有如下公式

2 DRNN的訓練算法

利用BP算法擴展形成的通過時間的反向傳播(BPTT)算法對遞歸神經網絡進行訓練。同BP算法一樣,BPTT算法基于梯度下降法,具有局部收斂和收斂速度慢等缺陷。為了加速BP算法的收斂,已有許多方法對BP算法進行改進。這方面的研究大致可分為2 類:一類為啟發式信息技術;另一類則集中在數值優化技術上,如LM算法。LM算法為牛頓法的變形,它最小化那些作為其他非線性函數平方和的函數[14]。引入LM算法優化網絡的訓練會比BP算法有更快的收斂速度。本文采用適用于DRNN的LMBP算法為訓練算法。

2.1 LM算法

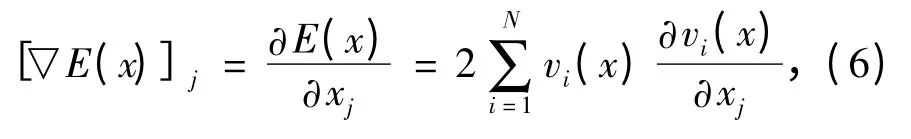

對于性能指數函數

其第j個梯度分量

可以寫成矩陣形式有

其中J(x)s 為雅可比矩陣。如下式:

E(x)的Hessian 矩陣的第(k,j)個元素有如下式

E(x)的Hessian 矩陣可表示為:

優化性能指數的牛頓法如下:

把式(7)、式(10)代入式(11)可得Gauss-Newton 方法:

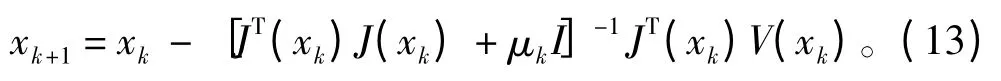

其中,矩陣H=JTJ 不一定可逆,可用G=H+μI代替。只要對于H的任意特征值λi,有λi+ μ >0即可使G 可逆。至此,可以導出LM算法如下:

其特點是:μk下降到0 時,算法變成Gauss-Newton法;當μk增加時,類似與有較小學習速度的最速下降法。

在開始時,μk取小值,若某一步不能使E(x)減小,則將μk乘以一個大于1的數θ,重復操作這一步;如果E(x)減小,則μk在下一步被除以θ,可提高收斂速度。

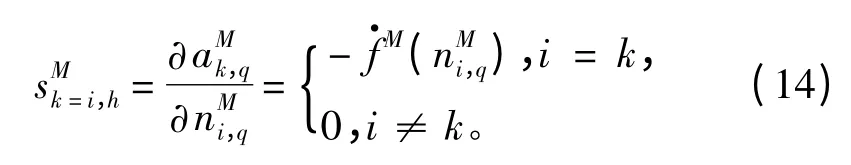

LM算法同BP算法,都利用敏感度進行反響的傳播進行逆推計算來更新權值,所用方法也是相同的。其不同之處在于最后一層的敏感度計算上。對于LM算法,其最后一層的敏感度為

式中:M 為最后輸出層;a 為當前層的神經元輸出;n為當前層神經元的輸入;的定義同BP算法。

所以相對于輸入I(k),其對應的輸出O(k)計算得到后,LMBP算法的反向傳播被初始化為

2.2 DRNN的LMBP算法

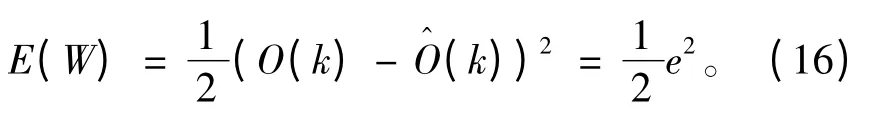

對于DRNN 網絡,其結構如上所述,數學描述如式(1)~式(3)所示。取性能函數為均方誤差之和,即

其中Pj(k)和Qij(k)如下式

式(16)~式(22)可以求得雅可比矩陣,應用到LM算法內,即可得到DRNN 網絡的LMBP算法。其算法步驟如下:

1)初始化DRNN,選擇適當的初始參數,取適當的μk和θ;

2)帶入新樣本到網絡,計算出誤差與性能函數;

3)計算出雅可比矩陣,并按式(15)初始化敏感度,然后遞歸計算敏感度;

4)按式(13)進行權值計算;

5)用步驟4 計算的權值再次求性能函數:如果性能函數減小,則讓μk除以θ,并按計算值更新權值,轉到第2 步接著訓練;如果新計算的性能函數沒有減小,則讓μk乘以θ,轉到第4 步計算,然后按順序執行算法。

當性能函數到達目標值時或者梯度的模小于給定值,算法被認為收斂。

3 基于DRNN的陀螺隨機誤差建模

陀螺的隨機誤差建模有2 種形式:機理分析建模和基于輸入輸出關系的序列數據分析建模。對于序列數據建模,常用方法有ARMA和Allan 方差等,它以實驗實測數據為基礎進行建模分析,然后進行相應補償。ARMA 方法已經有很多的研究應用,但ARMA 有其固有的局限性,在建模前需要平穩化的相關操作,建模時必須定階等,并且一旦模型發生變化,必須重新進行定階計算并驗證。神經網絡具有任意非線性映射的能力,理論上可處理非平穩的時間序列,對角遞歸神經網絡(DRNN)更是不需要假定模型的階次等優點。鑒于這些原因,本文利用DRNN 對陀螺的隨機誤差進行建模。

本文以某型號光纖陀螺的靜態實驗數據為基礎,數據采集頻率為1 Hz,采集7 h數據。取陀螺X 軸處于穩定運行狀態的7 200~21 600 s的零漂數據,如圖2所示。對原始數據進行自相關與互相關分析,如圖3所示。

圖2 預處理后實測數據Fig.2 The measured data with pretreatment

圖3 陀螺隨機誤差自相關、互相關分析Fig.3 Gyro random error autocorrelation and cross-correlation analysis

陀螺輸出數據表現出了較強的自相關特性,有周期性的噪聲干擾;互相關也有明顯的拖尾現象。對數據進行平穩化處理,模型的定階等處理都比較麻煩。

采用本文所討論的DRNN 對陀螺的隨機誤差進行建模,用DRNN的LMBP算法進行訓練。在本DRNN 網絡中,以k 時刻的誤差數據和k-1 時刻的網絡估計值作為網絡輸入,來預測k+1 時刻的輸出。所采用的DRNN 為3 層結構網絡:輸入神經元2個,輸出神經元1個;通過多次訓練,確定隱層的神經元個數,取20個隱層神經元。取前500個數據對網絡進行訓練,然后用其后的2 000 組數據進行模型驗證,訓練后部分跟蹤數據,效果如圖4所示。

對擬合的殘差進行分析,發現殘差均值為1.494 6E-005,殘差方差為0.001 027,對殘差進行白噪聲驗證,在置信區間接受白噪聲假設。利用訓練好的網絡進行預測,取其前150 組預測數據,效果如圖5所示。

為了進行對比,對數據進行平穩化處理等操作,然后利用ARMA 方法對隨機誤差進行建模,采用陀螺ARMA 建模最適用的ARMA (2,1)模型(AIC準則選取),對殘差進行白噪聲檢驗,結果接受白噪聲假設,模型適用并進行數據預測。然后根據ARMA 模型選取的階次,建立外遞歸BP 網絡,同樣進行隨機誤差數據的建模訓練。外遞歸BP 網絡的隱層神經元個數同DRNN。對殘差進行檢驗,結果接受白噪聲假設并用訓練好網絡進行預測。這2組對比實驗采用的建模數據和預測驗證數據與DRNN的完全相同。ARMA (2,1)前150 組預測效果如圖5所示,外遞歸神經網絡效果圖不易直觀得出結論及進行定量分析(見表1)。

圖4 DRNN 預測效果圖Fig.4 The prediction effects of DRNN

圖5 ARMA (2,1)預測效果圖Fig.5 The prediction effects of DRNN ARMA (2,1)

通過均值、方差對這3 種方法進行量化對比,結果如表1所示。從表1 可發現,DRNN 建模效果明顯好于ARMA (2,1)模型;較外遞歸BP 網絡,DRNN 建模效果亦有提升。

表1 三種建模方法效果對比Tab.1 Comparative effects of three modeling methods

4 結 語

本文使用對角遞歸神經網絡(DRNN)對陀螺的隨機誤差進行建模。由于DRNN 作為一種局部內遞歸神經網絡,比全局遞歸神經網絡擁有更少的訓練參數,從而能利用更少的時間完成對網絡的訓練,具有更高的效率;相比常規的外遞歸神經網絡建模,不必假設模型階次,輸入層擁有更少的神經元;相比于ARMA 建模方法,DRNN的優勢明顯:DRNN建模更加簡單直觀;不用像ARMA 那樣假定模型的階次,其內遞歸特性使其可以只用2個輸入神經元即可。MatLab 仿真結果表明,相比ARMA 建模和外遞歸神經網絡建模,DRNN 可以更加精確有效的進行陀螺隨機誤差建模,擁有更好適用性。

[1]NASER E S,HOU Hai-ying,NIU Xiao-ji.Analysis and modeling of inertial sensors using allan variance[J].IEEE Transactions on Instrumentation and Measurement,2008,57(1):140-149.

[2]李穎,陳興林.ARMA 模型辨識及其在光纖陀螺漂移建模中的應用[J].系統工程與電子技術,2008,30(9):1752-1754.

[3]盧海曦,夏敦柱,周百令.基于遺傳小波神經網絡的MEMS 陀螺誤差建模[J].中國慣性技術學報,2008,16(2):216-219.

[4]談振藩,張勤拓.MEMS 陀螺誤差辨識與補償[J].傳感器與微系統,2010,29(3):39-41.

[5]何志昆,王雪梅.激光陀螺隨機誤差的非參數建模與濾波[J].航天控制,2009,27(5):24-27.

[6]梁瑩,談振藩,張慶,等.一種光纖陀螺隨機漂移的高精度建模方法[J].哈爾濱工程大學學報,2009,30(11):1251-1255.

[7]李佳桐,張春熹,張小躍,等.光纖陀螺隨機漂移的建模與濾波[J].現代電子技術,2013,36(2):129-131.

[8]武漢大學測繪學院測量平差學科組.誤差理論與測量平差基礎[M].武漢:武漢大學出版社,2005.

[9]韓松來.GPS和捷聯慣導組合導航新方法及系統誤差補償方案研究[D].長沙:國防科技大學,2010.

[10]王振龍.應用時間序列分析(第二版)[M].北京:中國統計出版社,2010.

[11]KU Chao-chee,KWANG Y L.Diagonal recurrent neural networks for dynamic systems control[J].IEEE Transactions on Neural Networks,1995,6(1):144-156.

[12]CHNG E S,CHEN S,MULGREW B.Gradient radial basis function networks for nonlinear and nonstationary time series prediction [J].IEEE Transactions on Neural Networks,1996,7(1):190-194.

[13]王科俊.神經網絡幾個理論問題的研究及其在船舶橫搖運動建模與預報中應用[D].哈爾濱:哈爾濱工程大學,1995.

[14]戴葵,譯.神經網絡設計[M].北京:機械工業出版社,2002.