基于改進(jìn)LSDA的人體行為識(shí)別算法

謝澤奇,忽曉偉,張會(huì)敏,張善文

(鄭州大學(xué) 西亞斯國(guó)際學(xué)院,河南 鄭州 451150)

?

基于改進(jìn)LSDA的人體行為識(shí)別算法

謝澤奇,忽曉偉,張會(huì)敏,張善文

(鄭州大學(xué)西亞斯國(guó)際學(xué)院,河南鄭州451150)

摘要:提出了一種基于改進(jìn)的局部敏感判別分析(LSDA)的人體行為識(shí)別算法。首先,利用樣本間的距離信息重置類內(nèi)最近鄰點(diǎn)集和類間最近鄰點(diǎn)集的權(quán)值矩陣,保證在最大化目標(biāo)函數(shù)時(shí)盡可能保持局部線性重構(gòu)特性,解決小樣本難題;然后,通過(guò)Gran-Schmidt正交化方法將特征矩陣進(jìn)行正交化,可有效地保留原始空間中的高維空間,解決圖像特征重建難題;最后在Weizmann行為數(shù)據(jù)庫(kù)進(jìn)行實(shí)驗(yàn),平均正確識(shí)別率達(dá)到98.21%。試驗(yàn)結(jié)果表明,該算法具有良好的分類性能,在不同訓(xùn)練樣本個(gè)數(shù)下,該算法均能獲得較高的識(shí)別率。

關(guān)鍵詞:行為識(shí)別;維數(shù)約簡(jiǎn);局部敏感判別分析;正交化

人體行為分析和識(shí)別逐漸成為計(jì)算機(jī)視覺和模式識(shí)別領(lǐng)域中新興的研究熱點(diǎn)[1],在視頻監(jiān)控、運(yùn)動(dòng)分析、人機(jī)交互和虛擬現(xiàn)實(shí)等應(yīng)用領(lǐng)域具有廣闊的應(yīng)用前景[2]。基于動(dòng)態(tài)圖像序列的行為數(shù)據(jù)具有維數(shù)高、小樣本等難點(diǎn),行為數(shù)據(jù)進(jìn)行維數(shù)約簡(jiǎn)顯得十分重要[3]。其中,主成分分析(PCA)、線性判別分析(LDA)等都是典型的線性維數(shù)約簡(jiǎn)算法,但這些算法會(huì)出現(xiàn)樣本點(diǎn)外問(wèn)題,對(duì)于樣本測(cè)試點(diǎn)不能進(jìn)行有效處理[4]。流行學(xué)習(xí)的線性化通過(guò)將每個(gè)樣本的近鄰樣本鄰域作為線性空間來(lái)解決上述問(wèn)題,典型算法有局部保持投影(LPP)、局部敏感判別分析(LSDA)等[5-6]。LSDA算法為能夠發(fā)現(xiàn)數(shù)據(jù)集局部幾何特性的有監(jiān)督算法,可適用于人體行為識(shí)別領(lǐng)域[7]。但LSDA算法通過(guò)求非對(duì)稱特征方程的最大特征值對(duì)應(yīng)的特征向量進(jìn)行投影,不能有效地保證各個(gè)向量間均正交,也就不能很好地保持高維空間。

近年來(lái),國(guó)內(nèi)外專家學(xué)者對(duì)人體行為識(shí)別進(jìn)行了廣泛研究。田國(guó)會(huì)等[8]提出了基于一種新的人體行為表示特征量識(shí)別方法,該方法利用Kinect提供的關(guān)節(jié)點(diǎn)數(shù)據(jù),結(jié)合人體行為的特點(diǎn),通過(guò)人體結(jié)構(gòu)的向量角和向量模比值來(lái)提取人體行為表示特征值,再通過(guò)DTW算法進(jìn)行識(shí)別,取得較好的識(shí)別效果;朱旭東等[9]提出了一種基于主題隱馬爾科夫模型的人體異常行為識(shí)別,該模型克服了己有的馬爾科夫模型和貝葉斯主題模型在精度、魯棒性和計(jì)算效率上的不足;申曉霞等[10]提出了DDMHI-HBM特征、DDMHI-GIST特征和DDMHI-HBM-GIST融合特征的行為描述法,并且使用支持向量機(jī)(SVM)進(jìn)行行為識(shí)別,獲得比較優(yōu)越的性能。

本文針對(duì)LSDA算法存在的小樣本和非正交難題,提出了一種基于改進(jìn)的局部敏感判別分析算法,并應(yīng)用于人體行為識(shí)別中。該算法首先計(jì)算樣本間的距離來(lái)重新設(shè)置權(quán)值矩陣,保證在最大化目標(biāo)函數(shù)時(shí)盡可能保持局部線性重構(gòu)特性,解決小樣本難題;接著通過(guò)Gran-Schmidt正交化方法將特征向量進(jìn)行正交化,可有效地保留原始空間中的高維空間,解決圖像特征重建難題;并在Weizmann行為數(shù)據(jù)庫(kù)進(jìn)行實(shí)驗(yàn)。試驗(yàn)結(jié)果表明,該算法具有良好的分類性能,在不同訓(xùn)練樣本個(gè)數(shù)下,該算法均能獲得較高的識(shí)別率。

1局部敏感判別分析(LSDA)算法

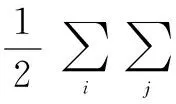

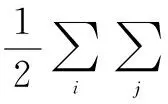

(1)

其中,Sb,ij代表最大化類間鄰域點(diǎn)集Gb(xi)的權(quán)矩陣,Sw,ij表示最小化類內(nèi)鄰域點(diǎn)集Gw(xi)的權(quán)矩陣,分別定義如下

(2)

(3)

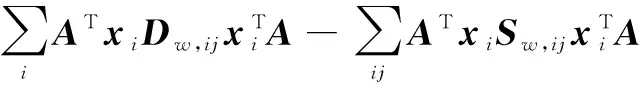

由式(1)簡(jiǎn)化推導(dǎo)如下

ATXDWXTA-ATXSWXTA

同理

argmaxATX(ηLb+(1-η)Sw)XTA

(4)

X(ηLb+(1-η)Sw)XTA=λXDwXTA

(5)

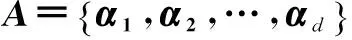

若上述方程(5)對(duì)應(yīng)的解向量分別為α1,α2,…,αd,每個(gè)解向量對(duì)應(yīng)的最大特征值λ1,λ2,…,λd,則對(duì)應(yīng)的映射可表示為

xi→yi=ATxi,A=(α1,α2,…,αd)

(6)

2改進(jìn)的局部敏感判別分析算法

2.1LSDA算法的優(yōu)缺點(diǎn)

基于流行學(xué)習(xí)基本思想的LSDA算法通過(guò)利用緊鄰點(diǎn)集來(lái)實(shí)現(xiàn)識(shí)別圖像的局部幾何特征,主要方法是通過(guò)特征映射,使原始圖像中距離很近的數(shù)據(jù)點(diǎn)集在局部集合特征空間中依然保持很近,從而能保持識(shí)別圖像的局部幾何結(jié)構(gòu);而且LSDA算法屬于有監(jiān)督的特征提取算法,通過(guò)引入類信息和調(diào)整敏感因子η的方法,保證投影后空間中最近鄰?fù)悩颖緮?shù)據(jù)點(diǎn)集與不同類樣本數(shù)據(jù)點(diǎn)集之間的距離差值最大化。因此,LSDA算法在人臉識(shí)別、指紋識(shí)別等模式識(shí)別領(lǐng)域有很好的優(yōu)勢(shì),將LSDA算法針對(duì)行為特征改進(jìn)后用于人體行為識(shí)別是可行的。

dist(yi,yj)=‖yi-yj‖=‖ATxi-ATxj‖=

‖AT(xi-xj)‖=

(7)

如果變換矩陣A為非正交矩陣,則在高維空間中幾何特征無(wú)法保留,即LSDA算法的非正交性會(huì)導(dǎo)致圖像特征數(shù)據(jù)重建困難。本文算法通過(guò)引入二階張量相似度矩陣和Gran-Schmidt正交化方法來(lái)克服上述缺點(diǎn),提出來(lái)基于二階張量的正交局部敏感判別分析算法,并在人體行為識(shí)別數(shù)據(jù)庫(kù)中進(jìn)行驗(yàn)證。

2.2改進(jìn)的LSDA算法

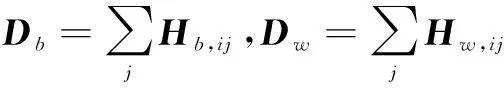

為了彌補(bǔ)LSDA算法未考慮樣本數(shù)據(jù)點(diǎn)之間的距離關(guān)系,即小樣本難題,本文主要通過(guò)構(gòu)造相似度矩陣及其近鄰圖來(lái)解決。其主要方法是對(duì)式(2)、(3)進(jìn)行修改,重新設(shè)置類內(nèi)最近鄰點(diǎn)集和類間最近鄰點(diǎn)集的權(quán)值矩陣,分別用Hb,ij和Hw,ij來(lái)表示,其定義如下

(8)

(9)

其中,β是一個(gè)調(diào)節(jié)因子。將Hb,ij和Hw,ij來(lái)代替Sb,ij和Sw,ij帶入式(1),可以得出

tr(ATXHbXTA)=tr(ATXLbXTA)

(10)

同理

(11)

針對(duì)小樣本難題,可將目標(biāo)函數(shù)表示為

J(A)=AT(Lb-μLw)A

(12)

上式可轉(zhuǎn)化成求解映射矩陣A,在約束條件ATA=1下,使

(13)

令v1=α1,假設(shè)前k個(gè)正交向量v1,v2,…,vk(1≤k≤d)已求出,則使第k+1個(gè)正交向量vk+1為

(14)

綜上所述,基于ST-OLSDA算法進(jìn)行人體行為動(dòng)作識(shí)別的基本步驟如下:

步驟1:對(duì)任意數(shù)據(jù)點(diǎn)xi∈N(xi),通過(guò)式(8)、(9)構(gòu)建類內(nèi)權(quán)重矩陣Hb,ij和Hw,ij。

步驟2:對(duì)式(11)求解出D個(gè)非零特征值所對(duì)應(yīng)的特征向量,其表示為α1,α2,…,αd,αd+1,…,αD,取其中d個(gè)最小非零特征對(duì)應(yīng)的特征向量,令A(yù)=(α1,α2,…,αd)。

步驟3:通過(guò)式(12)將A=(α1,α2,…,αd)中d個(gè)非正交向量α1,α2,…,αd轉(zhuǎn)化成k個(gè)正交向量v1,v2,…,vk。

3仿真實(shí)驗(yàn)及結(jié)果分析

為了驗(yàn)證本文算法的有效性,使用Weizmann人體行為數(shù)據(jù)庫(kù)來(lái)對(duì)算法的性能進(jìn)行驗(yàn)證。實(shí)驗(yàn)測(cè)試是在Microsoft XP系統(tǒng)平臺(tái)上通過(guò)使用MATLAB 7.1軟件編程實(shí)現(xiàn)、CPU是雙核Intel(R)Core(TM)i3-4030CPU@1.90 GHz、內(nèi)存為4G的HP ProBook430上進(jìn)行的。

Weizmann數(shù)據(jù)庫(kù)由以色列魏茨曼科學(xué)院計(jì)算機(jī)視覺實(shí)驗(yàn)室采集提供,如圖1所示。共包含90個(gè)低分辨率的AVI視頻序列(180×144, 50 f/s),所有動(dòng)作分別由9名實(shí)驗(yàn)人員完成,每人完成10個(gè)自然動(dòng)作(單臂揮手、雙臂揮手、單腳跳、側(cè)行、雙腳跳、行走、原地跳、揮手跳、奔跑、彎腰),將視頻中每個(gè)動(dòng)作分解成28幀,共2 520幀行為圖像。對(duì)每人每一種行為(28幀),隨機(jī)選取10幀和15幀行為圖像作為訓(xùn)練樣本,剩余的用作測(cè)試樣本,分別表示為:np=10,15,循環(huán)進(jìn)行10次,用平均識(shí)別率來(lái)表示。為了保證公平,本文在同一實(shí)驗(yàn)環(huán)境下進(jìn)行,每種算法均采用SVM分類器,距離度量都采用歐氏距離。

實(shí)驗(yàn)中將本文算法與流行的主成分分析法(PCA)、局部保持投影算法(LPP)、判別式分析法(LDA)及局部敏感判別分析(LSDA)算法進(jìn)行比較。圖2顯示了每人每種行為隨機(jī)選取10幅和15幅圖像作訓(xùn)練樣本,循環(huán)10次平均識(shí)別率隨特征維數(shù)變化的曲線。根據(jù)圖2顯示結(jié)果,在5種算法中可以看出OLSDA算法的平均識(shí)別率明顯高于LSDA算法,說(shuō)明通過(guò)Gran-Schmidt正交化方法將特征向量正交化,可有效地保留原始空間中的高維空間,解決圖像特征重建難題,進(jìn)而驗(yàn)證正交基約束條件的有效性,表明含有正交基約束條件的算法比無(wú)正交基約束條件的算法具有一定的優(yōu)勢(shì),本文改進(jìn)的局部敏感判別分析算法的平均行為識(shí)別率明顯地高于其他4種算法。

表1顯示了詳細(xì)的試驗(yàn)結(jié)果,其中調(diào)整敏感因子η通過(guò)實(shí)驗(yàn)來(lái)確定。通過(guò)實(shí)驗(yàn)測(cè)試發(fā)現(xiàn),在每人選擇10幅和15幅行為圖像作訓(xùn)練樣本時(shí),η的值取0.45和0.65可達(dá)到最理想的識(shí)別結(jié)果。

從表1中可以看出,OLSDA算法的識(shí)別率高于LSDA算法,說(shuō)明正交基約束條件的有效性;而且本文算法中利用樣本間的距離信息重新設(shè)置類內(nèi)最近鄰點(diǎn)集和類間最近鄰點(diǎn)集的權(quán)值矩陣,其識(shí)別率高于OLSDA和LSDA,可以保證在最大化目標(biāo)函數(shù)時(shí)盡可能保持局部線性重構(gòu)特性,解決小樣本難題,從而提高行為識(shí)別率。

4結(jié)論

本文提出了一種基于改進(jìn)的局部敏感判別分析的人體行為識(shí)別算法。該算法首先利用樣本間的距離信息重新設(shè)置類內(nèi)最近鄰點(diǎn)集和類間最近鄰點(diǎn)集的權(quán)值矩陣,保證在最大化目標(biāo)函數(shù)時(shí)盡可能保持局部線性重構(gòu)特性,解決小樣本難題;接著通過(guò)Gran-Schmidt正交化方法將特征向量進(jìn)行正交化,可有效地保留原始空間中的高維空間,解決圖像特征重建難題;最后在Weizmann行為數(shù)據(jù)庫(kù)進(jìn)行實(shí)驗(yàn),平均識(shí)別率達(dá)到98.21%。試驗(yàn)結(jié)果表明,本文算法具有良好的分類性能,在不同訓(xùn)練樣本個(gè)數(shù)下,該算法均能獲得較高的識(shí)別率和較好的性能,在視頻監(jiān)控、醫(yī)療看護(hù)、人機(jī)交互、安全監(jiān)控等領(lǐng)域有著廣闊的應(yīng)用前景。

表1本文算法與其他方法的最優(yōu)識(shí)別率比較

參考文獻(xiàn):

[1]雷慶,陳鍛生,李紹滋.復(fù)雜場(chǎng)景下的人體行為識(shí)別研究新進(jìn)展[J].計(jì)算機(jī)科學(xué),2014,41(12):1-7.

[2]李瑞峰,王亮亮,王坷.人體動(dòng)作行為識(shí)別研究綜述[J].模式識(shí)別與人工智能,2014,27(1):35-48.

[3]徐勤軍,吳鎮(zhèn)揚(yáng).視頻序列中的行為識(shí)別研究進(jìn)展[J].電子測(cè)量與儀器學(xué)報(bào),2014,28(4):343-350.

[4]秦娜,桑鳳娟.基于自適應(yīng)鄰域選擇的局部判別投影算法[J].計(jì)算機(jī)工程,2013,39(4):194-198.

[5]謝鈞,劉劍.一種新的局部判別投影方法[J].計(jì)算機(jī)學(xué)報(bào),2011,34(11):2243-2249.

[6]文貴華,江麗君,文軍.鄰域參數(shù)動(dòng)態(tài)變化的局部線性嵌入[J].軟件學(xué)報(bào),2008,19(7):1666-1673.

[7]高瑋軍,白萬(wàn)榮,公維軍,等.基于自適應(yīng)鄰域選擇的正交局部敏感判別分析[J].計(jì)算機(jī)工程與設(shè)計(jì),2012,33(5):1968-1972.

[8]朱旭東,劉志鏡.基于主題隱馬爾科夫模型的人體異常行為識(shí)別[J].計(jì)算機(jī)科學(xué),2012,39(3):251-255,275.

[9]田國(guó)會(huì),尹建芹,韓旭,等.一種基于關(guān)節(jié)點(diǎn)信息的人體行為識(shí)別新方法[J].機(jī)器人,2014,36(3):285-292.

[10]申曉霞,張樺,高贊,等.一種魯棒的基于深度數(shù)據(jù)的行為識(shí)別算法[J].光電子激光,2013,24(8):1613-1618.

[11]金一,王移芝,阮秋琦.張量正交局部敏感判別式分析及其在人臉識(shí)別中的應(yīng)用[J].信號(hào)處理,2011,27(6):820-827.

[12]張?jiān)讫垼钇迹瑥埳莆?基于正交判別局部保持映射的步態(tài)識(shí)別方法[J].計(jì)算機(jī)測(cè)量與控制,2014,22(5):1644-1646.

謝澤奇(1981— ),碩士,講師,主要研究方向?yàn)橛?jì)算機(jī)應(yīng)用、圖像處理;

忽曉偉(1980— ),碩士,講師,主要研究方向?yàn)橛?jì)算機(jī)應(yīng)用;

張會(huì)敏(1981— ),女,碩士,講師,本文通信作者,主要研究方向?yàn)閳D像處理、模式識(shí)別;

張善文(1965— ),博士,教授,主要研究方向?yàn)閳D像處理及模式識(shí)別。

責(zé)任編輯:閆雯雯

Method of human behavior recognition algorithm based on modified locality sensitive discriminant analysis

XIE Zeqi,HU Xiaowei,ZHANG Huimin,ZHANG Shanwen

(SIASInternationalUniversity,ZhengzhouUniversity,Zhengzhou451150,China)

Key words:behavior recognition; dimensionality reduction; locality sensitive discriminant analysis;orthogonalization

Abstract:A method of behavior recognition algorithm based on modified locality sensitive discriminant analysis is proposed. Firstly, the parameters of weight matrix of recently adjacent vertex sets in class or out class is resetted by the distance of samples to solve sample size problem. Secondly,the Gram-Schmidt orthogonalization is introduced to preserve higher dimensional space in the original space effectly. Finally,the average recognition rate of the proposed method is 98.21% based on the Weizmann behavior database.The experimental results show that the proposed method is effective and feasible for behavior recognition.

中圖分類號(hào):TP391

文獻(xiàn)標(biāo)志碼:A

DOI:10.16280/j.videoe.2016.01.023

基金項(xiàng)目:國(guó)家自然科學(xué)基金項(xiàng)目(61272333);河南省科技廳基礎(chǔ)與前沿技術(shù)研究計(jì)劃項(xiàng)目(152300410225);河南省教育廳科學(xué)技術(shù)研究重點(diǎn)項(xiàng)目(15A520100);鄭州大學(xué)西亞斯國(guó)際學(xué)院校級(jí)科研項(xiàng)目(2015KYYB07)

作者簡(jiǎn)介:

收稿日期:2015-06-13

文獻(xiàn)引用格式:謝澤奇,忽曉偉,張會(huì)敏,等.基于改進(jìn)LSDA的人體行為識(shí)別算法[J].電視技術(shù),2016,40(1):117-121.

XIE Z Q,HU X W,ZHANG H M,et al.Method of human behavior recognition algorithm based on modified locality sensitive discriminant analysis[J].Video engineering,2016,40(1):117-121.