基于顯著計算與變分法的多尺度圖像融合

崔洪剛,唐 浩,汪永超

(1.廣東工業(yè)大學計算機學院,廣東 廣州 510006;2.河源廣工大協(xié)同創(chuàng)新研究院,廣東 河源 517000)

?

基于顯著計算與變分法的多尺度圖像融合

崔洪剛1,唐 浩2,汪永超2

(1.廣東工業(yè)大學計算機學院,廣東 廣州 510006;2.河源廣工大協(xié)同創(chuàng)新研究院,廣東 河源 517000)

在多尺度圖像融合中,通常將圖像進行多尺度變換,再對變換后的低頻系數(shù)與高頻系數(shù)采用一定的融合規(guī)則進行融合,然而融合規(guī)則的選擇將影響圖像的清晰度與融合質量。將視覺顯著模型與變分法理論應用在多尺度圖像的低頻系數(shù)融合中,獲取最優(yōu)的融合系數(shù)組合,從而增強融合效果,通過對紅外線與可見光圖像、醫(yī)學圖像的融合實驗表明,該方法能克服融合圖像對比度偏低的缺陷,獲取的圖像能較好地保留源圖像的顯著目標信息,如形狀、大小、色調、紋理等,特別是針對異源亮度差異較大的圖像。在主觀視覺感受與客觀評價指標上都有所提升。

多尺度變換;顯著計算;變分法;圖像融合

圖像融合是將同一場景中兩幅或多幅圖像合成為一幅含有更豐富信息圖像的過程。它廣泛應用于計算機視覺領域中,如目標識別、特征提取等[1]。多尺度幾何分析一直以來是圖像融合領域熱門研究方法之一,近年來,相關研究者將變分法理論應用在圖像融合領域中[2-3],使其成為該領域一個新的熱門研究方向。

視覺顯著計算 (Visual Saliency Computation)是神經計算科學的分支,是人類處理視覺場景信息的過程,采用這種方法能快速識別出視覺場景中的有用信息。用計算機模擬人類這種特有視覺特征能快速識別處理信息。顯著計算是以視覺生理學和認知心理學的研究成果為基礎,應用數(shù)學模型來研究類似于人類視覺處理方式的信息處理方法。目前研究者已將顯著計算應用于靜動態(tài)目標識別、遙感目標檢測等方面。將顯著計算用在圖像融合過程中能有效保護源圖像顯著目特征、背景及邊緣信息,從而改善融合效果,因此吸引了相關研究者。

多尺度圖像融合是將兩幅或多幅源圖像進行多尺度變換后的低頻分量與高頻分量采取一定的融合規(guī)則進行融合的過程,低頻分量包含了圖像的大部分細節(jié)信心,因此低頻系數(shù)融合規(guī)則會直接影響到最終融合圖像的質量,特別是對于異源亮度差異較大圖像的融合。最初的簡單加權平均規(guī)則使得融合圖像對比度下降,以往的權值優(yōu)化方法是采用區(qū)域比較方法[4]獲取權值進行系數(shù)組合,文獻[5]采用脈沖耦合神經網絡(PCNN)方法獲取權值函數(shù),這些方法獲取的權值有一定的針對性,并不精準。本文將視覺顯著計算與變分法用在多尺度圖像融合方法中,對不同種類的圖像低頻權值α進行優(yōu)化,得到精準的低頻系數(shù)組合,從而使得融合圖像能更好地保留源圖像中的顯著信息,使圖像更清晰。

1 相關技術

1.1 全變分模型

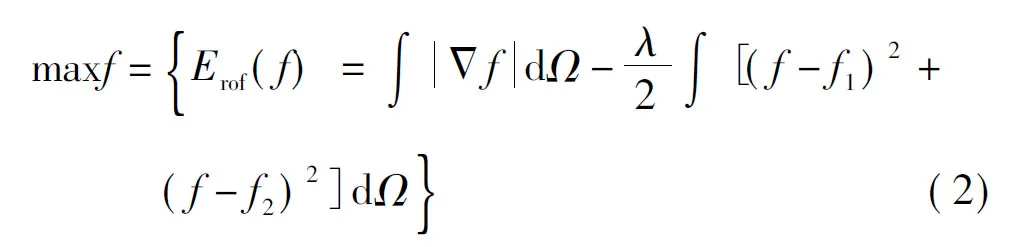

Rudin,Osher和Fatemi等于1992年提出了經典的全變分去噪模型(簡稱ROF模型),該模型可描述如f0=f+n,其中f0表示受噪聲污染的的圖像,f表示希望得到的清晰圖像,n表示加性噪聲,該模型可以表述成求式(1)能量泛函最小值

(1)

(3)

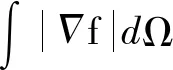

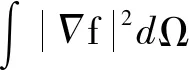

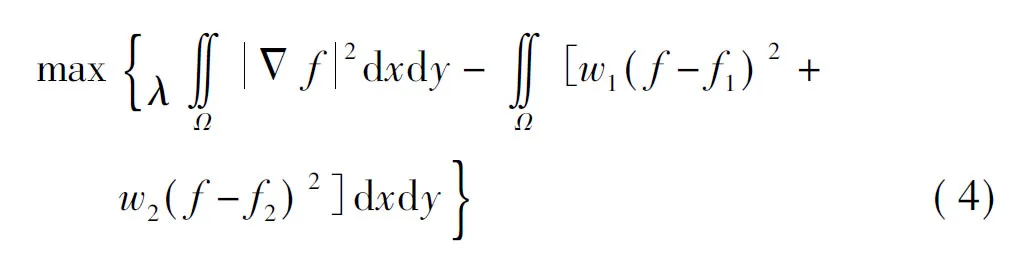

式中:第一項與ROF模型類似,目的是使融合圖像更多保留兩幅源圖像信息;第二項由上文分析可知,使融合圖像梯度最大,從而獲去更清晰的圖像;w1(x,y)與w2(x,y)為源圖像對應像素點處權重函數(shù),且權重滿足表達式w1+w2=1,表示源圖像對融合圖像的貢獻程度;λ為加權系數(shù),與式(2)所示模型類似,用來權衡源圖像與融合圖像的保真度。將以上模型化簡可得

式(4)所示模型也將圖像融合的實際問題轉換成了求解數(shù)學模型泛函極值問題。

1.2 基于非抽樣形態(tài)小波的多尺度變換

本文以非抽樣形態(tài)小波(morphologicalundecidedwavelet,MUDW)[8-9]變換作為多尺度幾何分析工具。這種多尺度變換具有較高的運算效率,且實時性與多尺度分解特性良好,從而融合視覺效果較好。其構造方法如下

(5)

(6)

T(xj)+(id-T)(xj)=id(xj)

(7)

(8)

式中:j代表尺度;(xj,Bj+1)表示用結構元素Bj+1對xj進行形態(tài)學運算;Bj的定義如下

(9)

形態(tài)學濾波器屬于非線性濾波器,將其用于圖像融合中能達到線性濾波器的效果,并且能增強融合的實時性,使得融合效果更佳。

1.3 視覺顯著模型

視覺顯著模型分為自頂向下與自底向上兩種,前者適用于尋找具體目標、動態(tài)圖像,融合中需要處理的圖像為靜態(tài)圖像,且不依賴于具體目標,因此選擇自底向上的視覺顯著模型。文獻[10]提出的模型采用隨機漫步方法去尋找訪問次數(shù)較少的節(jié)點,給出相應的顯著值,計算過程復雜,且不夠精準;文獻[11]提出的模型參考全局顏色平均差異,這并不適合顯著目標不均勻或紋理特征較多的圖像獲取顯著性圖;文獻[12]提出的模型難以確定合適的局部范圍而獲取顯著性圖。綜合考慮模型的計算效率、準確度及適用性等因素的影響,采用文獻[13]提出的模型來計算融合源圖像的顯著性圖。該模型先對源圖像各通道進行離散余弦變換(DiscreteCosineTransform,DCT)得到相應的DCT系數(shù),對系數(shù)取符號函數(shù)后進行DCT逆變換,然后對逆變換后的結果進行Hadamard乘積,對其進行高斯濾波,最后將圖像各通道得到的顯著性圖采用一定的方法加權后得到最終顯著性圖,如式(10)所示

(10)

(11)

為避免融合圖像中出現(xiàn)偽跡,還需對源圖像顯著性圖進行處理,獲取顯著性權重圖,用來決定低頻系數(shù)融合時所選擇的是哪幅源圖像的系數(shù),如

(12)

2 顯著計算與變分法結合

2.1 圖像融合框架

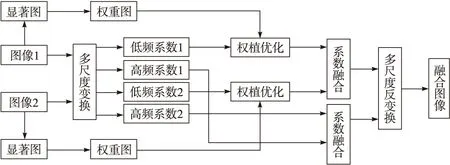

基于多尺度變換圖像融合方法包含3個步驟:圖像分解、系數(shù)融合與圖像重構。因低頻系數(shù)代表圖像的大部分細節(jié)信息,所以對低頻系數(shù)的融合顯得非常關鍵,本文所做的工作是利用視覺顯著模型來指導低頻系數(shù)的融合,獲取更精準的系數(shù)組合來增強融合效果,完整的融合流程如圖1所示。

圖1 融合流程圖

具體的融合過程如下:

1)獲取低頻權重圖,分別對源圖像1和2按照上文選擇的視覺顯著模型獲取顯著性圖S1,S2,將顯著圖采用系數(shù)取大的規(guī)則得到權重圖W1,W2,將該權重圖用于全變分模型去引導低頻系數(shù)融合,從而獲取源圖像相應加權系數(shù)組合。

2)分解圖像,采用上文介紹的多尺度變換MUDW對源圖像1和2進行分解,獲得相應的低頻系數(shù)L1,L2與各個尺度上的高頻系數(shù)。

3)低頻與高頻系數(shù)融合,由變換域全變分模型求得低頻權值函數(shù)α,對低頻系數(shù)加權融合,高頻系數(shù)采用絕對值取大的融合規(guī)則進行融合。

4)多尺度反變換,將融合后的低頻系數(shù)與相應的高頻系數(shù)通過MUDW反變換可獲得最終融合圖像。

2.2 融合模型與求解方法

本文提出的與變換域全變分模型,如式(13)所示

W2(c-(1-α)c2)]2dxdy}=

W2(αc1)]2dxdy}

(13)

式中:c1與c2分別為源圖像多尺度變換后的系數(shù),融合系數(shù)為

c=αc1+(1-α)c2

(14)

式中:W1,W2是低頻顯著性權重圖,用于指導多尺度變換后低頻系數(shù)融合,將該泛函采用梯度下降流進行求解可獲得理想的權值,從而使得更精準的低頻系數(shù)組合。

采用梯度下降流算法進行具體數(shù)值計算,α下一個時刻值為

(15)

(16)

根據(jù)式(13)得到F的表達式為

(17)

由式(14)得到cx與cy表達式如下

cx=α·(c1x-c2x)+αx·[(c1-c2)τ(1,0)]+c2x

(18)

cy=α·(c1y-c2y)+αy·[(c1-c2)τ(0,1)]+c2y

(19)

由式(17)~(19)可推導出

(20)

(21)

2[W1(1-α)c2+W2(αc1)](c2-c1)

(22)

將式(20)~(22)帶入式(15)與(16),采用梯度下降流法利用式(13)~(15)式進行交替迭代運算,可以求出理想權值α和低頻系數(shù)c,再對融合后的低頻與高頻系數(shù)進行多尺度反變換便求得最終融合圖像fF。

3 實驗結果與分析

本文提出的方法是在已有的多尺度變換的基礎上,將視覺顯著計算模型用于其中,并用變分法求解低頻系數(shù)權值,獲得最優(yōu)的低頻系數(shù)組合,從而提升融合效果。具體實現(xiàn)過程可表述為,對兩幅實驗源圖像,先分別采用1.3節(jié)提出的方法提取顯著性圖,再將兩幅顯著性圖對應像素位置進行比較,較大者權重為1,較小者權重為0,從而獲取兩幅顯著性權重圖,在結合變分法與基于非抽樣形態(tài)小波的多尺度變換獲取合適的低頻權值系數(shù),然后針對獲取的低頻系數(shù),進行相應的多尺度反變換得到最終版的融合圖像。實驗目的主要是對低頻系數(shù)融合規(guī)則進行改進,因此需要采用相同的多尺度變換,本文針對常見紅外線與可見光圖像、醫(yī)學圖像進行融合實驗并比較結果。

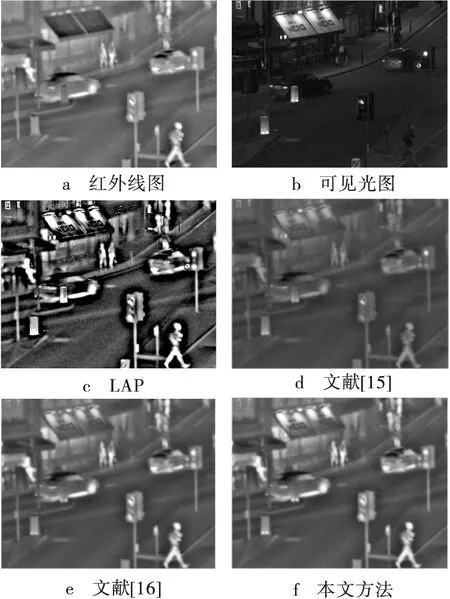

3.1 紅外線與可見光圖像融合實驗

如圖2a和圖2b是實驗的兩幅源圖像,紅外線與可見光圖像,其為城市某街道夜景實拍圖,顯著目標有小汽車、路燈、行人、廣告牌及一些道路基礎設施,大小為632×496。從其中一幅圖像難以顯示出所有顯著目標的細節(jié),如紅外線圖像只能看清顯著目標物體輪廓與位置,可見光圖像能展示目標細節(jié),因光線較暗,也無法直接識別目標的具體情況,這就是圖像融合的意義。分別對源圖像進傳統(tǒng)多尺度變換LAP、變分法[15]、文獻[16]提出的基于非抽樣形態(tài)小波的全變分模型,及本文提出的顯著計算與變分法結合的融合方法進行實驗對比。所采用的模型參數(shù)為:λ=0.2,Δt=5×10-6,低頻系數(shù)初始權值α設定為0.5,為便于對比,將源圖像進行的多尺度變換分解層數(shù)都為3層。實驗結果如圖2c~圖2f所示。

圖2 紅外線與可見光圖像與4種方法融合結果對比圖

由圖2可看出傳統(tǒng)多尺度變化LAP方法得到的融合圖像顯著目標亮度偏大,能識別顯著目標,但僅能看清目標輪廓與位置,并不能辨別目標細節(jié)部分;文獻[15]方法得到結果相反,圖像亮度偏小,對比度較低,圖像顯著不明確,其輪廓與細節(jié)都不清楚;文獻[16]方法與本文方法亮度與對比度無明顯差別,汽車、廣告牌、人物、基礎設施等顯著目標都融合完好,裸眼能分辨清楚,但是本文方法的對比度稍微大,符合人的直觀感受。圖像左上方的廣告牌能明顯展示出來,店鋪內部細節(jié)也能展現(xiàn)出來。為了進一步驗證試驗結果,本文選取了圖像融合領域常用的客觀評價指標,互信息量(MI)、邊緣保持度(QAB/F)[8]、結構相似度(SSIM)[14]、信息熵(Entropy)[4]、平均梯度(AvreageGradient,AVG)對幾種方法的融合結果進行進一步評價對比。結果如表1所示。

表1 紅外線與可見光圖像融合結果客觀評價指標對比

表1實驗結果表明,文獻[16]方法與本文方法在客觀評價指標上明顯優(yōu)于LAP方法與文獻[15]方法,這與上文描述的主觀視覺感受結果類似。然而,本文采用的融合方法在互信息量、信息熵、邊緣保持度、平均結構相似度這4項客觀評價指標較文獻[16]方法有所提高,結構相似度指標值相近,這也與人的視覺感受結果對應。

3.2 CT/MR醫(yī)學圖像融合

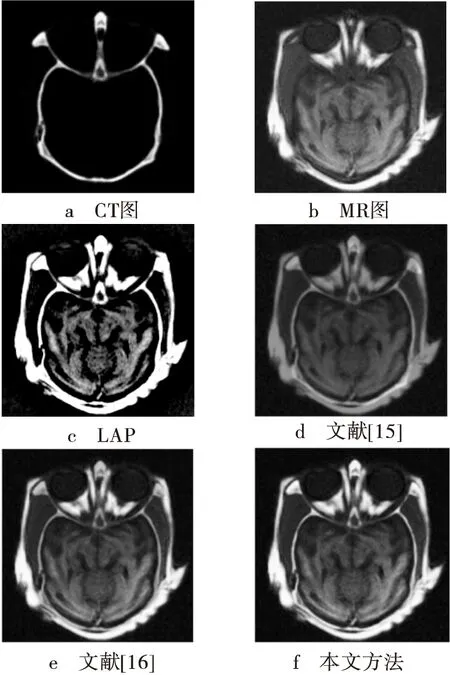

如圖3a和圖3b是醫(yī)學CT(Computed Tomography)與MR(Magnetic Resonance)圖,大小為512×512,圖像為人體結構剖面圖,顯著目標主要是軟組織結構。對其采用相同的方法進行實驗,結果如圖3c~3f所示。

圖3 CT與MR圖像及四種方法融合圖像結果對比

從圖3中可看出,傳統(tǒng)多尺度變換LAP得到的圖像對比度明顯偏高,僅僅只能看清圖像的輪廓信息,其細節(jié)紋理并不能清楚看出;文獻[15]基于圖像域的變分法得到的圖像整體對比度偏低,圖像亮度偏暗,無法識別顯著目標、邊緣與細節(jié);文獻[16]基于非抽樣形態(tài)小波方法與本文方法得到圖像裸眼觀看無明顯區(qū)別,僅能看出圖像左上方本章方法得到的圖像亮度上有些優(yōu)勢,目標更清晰,其他部位無明顯區(qū)分度。由于源圖像所包含的顯著目標過少,并且單一,裸眼無法直接評判各種方法的融合效果。分別采用與上文相同的5種客觀評價指標對融合結果進行評判。圖3的融合結果所對應的5種評價指標對比如表2所示。

表2 醫(yī)學圖像融合五種客觀評價指標對比

由表2的結果可以看出傳統(tǒng)多尺度變換LAP方法與文獻[15]基于圖像域的變分法的四項客觀評價指標都偏低,這與人眼的主觀視覺感受相符合。如上文所述,實驗所用醫(yī)學圖像顯著目標區(qū)域較少,當融合效果比較接近時主觀上無法給出準確評價,文獻[16]方法與本文方法單從視覺效果上并沒有讓人感覺到明顯差異,但是從常見5項客觀評價指標上看,本文方法得出的實驗結果各項評價指標均占優(yōu)勢,從而進一步驗證了本文方法的優(yōu)越性。

4 小結

本文方法是在已有的基于非抽樣形態(tài)小波的多尺度變換MUDW基礎上,將視覺顯著計算方法用于其中,指導低頻系數(shù)融合,采用變分法求解出低頻權值,從而獲得更精準的低頻系數(shù)組合,該方法是對傳統(tǒng)融合規(guī)則的改進,從而能提升圖像融合的效果。該方法的主要優(yōu)勢表現(xiàn)在:1)運用變分法這一強大的工具去求解泛函極值的方法獲取權值系數(shù);2)采用基于非抽樣形態(tài)小波的多尺度變換,能繼承傳統(tǒng)多尺度集合分析的優(yōu)點,更多地保護源圖像細節(jié)與邊緣信息;3)結合了視覺顯著計算模型,使獲得的權值能隨源圖像的類型獲取更精準的權值,適合多種圖像的融合;4)實時性較好,不需要更多的分解層數(shù),運算效率高,迭代次數(shù)少。對于本文方法采用的模型選取的參數(shù)λ是根據(jù)全變分去噪模型對于噪聲和圖像清晰度的平衡效果獲取的,Δt是迭代計算的步長,是通過平衡計算結果的精確度與迭代運算的計算量獲得的,W1與W2則通過迭代計算自動獲取。

致謝:

論文成果要感謝張梅老師的指導,以及汪永超在設計中進行的大量試驗和測試。

[1] RICHA G,DEEPAK A. Wave-packet image fusion technique based on genetic algorithm[C]//Proc. 2014 5th International Conference-Confluence The Next Generation Information Technology Summit (Confluence).Noida,India:[s.n.],2014:280-285.

[2] GEMMA P. Image fusion for enhanced visualization:a variational approach[J]. International journal of computer vision,2009(3):1-11.

[3] MRITYUNJAY K,SARAT D. A total variational-based algorithm for pixel-level image fusion[J].IEEE transactions on image processing, 2009,18(9):1057-1059.

[4] 敬忠良,肖剛,李振華.圖像融合——理論與應用[M].北京:高等教育出版社,2007.

[5] 劉建琴.基于變分偏微分方程的圖像融合算法研究[D].南京:南京理工大學,2011.

[6] 岡薩雷斯.數(shù)字圖像處理[M].2版.北京:電子工業(yè)出版社,2006.

[7] 李鳳霞.基于偏微分方程的圖像配準與圖像融合研究[D].南京:南京理工大學,2012.

[8] ZHANG J F,SMITH J S,WU J S,et al.Morphological undecimated wavelet decomposition for fault location on power transmission lines[J].IEEE transactions on circuits and systems,2006,53(6):1395-1402.

[9] ZHANG W B,SHEN L,LI J S,et al. Morphological undecimated wavelet decomposition for fault feature extraction of rolling element bearing[C]//2nd International Congress on Image and Signal Processing CISP′09.Tianjin,China:IEEE,2009:1-5

[10] HAREL J, KOCH C, PERONA P. Graph-based visual saliency[J]. Advances in neural information processing systems,2007,12(22):545-552.

[11] ACHANTA R, HEMAMI S. Frequency-tuned salient region detection[J]. International conference on computer vision and pattern recognition,2009,1(4):597-604.

[12] CHENG M M, ZHANG G X. Global contrast based salient region detection[J].IEEE transactions on pattern analysis & machine intelligence,2011, 11(13): 409-416.

[13] LUO X Y,ZHANG J,DAI Q H. Saliency-based geometry measurement for image fusion performance[J]. IEEE transactions on instrumentation and measurement,2012,61(4) :1130-1132.

[14] HOU X D,HAREL J, KOCH C. Image signature:highlighting sparse saliency regions[J]. IEEE transactions on pattern analysis and machine intelligence, 2012, 34(1): 194-201.

[15] 曾志峰,馬華山.基于全變分的圖像融合算法的研究[J].計算機應用與軟件,2009,26(5):225-227.

[16] 鄧苗,張基宏.基于形態(tài)非抽樣小波的實時圖像融合方法[J].計算機應用,2012,32(10):1-7.

[17] JIANG B,WANG X Y,ZHANG R,et al. A comparative study of wavelet-based image fusion with a novel fusion rule II[C]//Proc.2015 Fifth International Conference on Instrumentation and Measurement,Computer, Communication and Control. Qinhuangdao,China:[s.n.],2015:1304-1309.

崔洪剛(1976— ),碩士,講師,主要研究方向為智能計算、知識管理;

唐 浩(1989— ),碩士生,主研計算機技術;

汪永超(1991— ),碩士生,主研機械電子技術。

責任編輯:時 雯

Multiscale image fusion based on saliency computation and total variation

CUI Honggang1, TANG Hao2, WANG Yongchao2

(1.SchoolofComputerScienceandTechnologyofGDUT,Guangzhou510006,China;2.SynergyInnovationInstitudeofGDUT,GuangdongHeyuan517000,China)

In the image fusion methods based on multiscale transform, the coefficients of low and high frequency are fused through a weighted sum rule. The choosing of weight function influences definition and quality of fused image. A novel method is proposed for the optimization of low weight function based on total variation and visual saliency to obtain eventual fused image. Image fusion experiments are carried out utilize visible light images and medical images that is registration processed.Result shows that the proposed method can overcome the low image contrast problem, and the reconstructed image protects salient-object information, such as shape, size, color, texture, etc effectively, and it is more effective for processing source images with brightness differences. The subjective visual perception and objective evaluation index has got certain improvement.

multiscale transformation; saliency computation; total variation; image fusion

崔洪剛,唐浩,汪永超.基于顯著計算與變分法的多尺度圖像融合[J].電視技術,2016,40(12):17-22. CUI H G, TANG H, WANG Y C. Multiscale image fusion based on saliency computation and total variation[J].Video engineering,2016,40(12):17-22.

TP391

A

10.16280/j.videoe.2016.12.004

廣東省科技計劃項目(2015A040405007);國家火炬計劃項目(2015GH511343)

2016-03-30