基于GoogLeNet的色織物花型分類

張宏偉,張凌婕,李鵬飛,宋執環

(1.西安工程大學,陜西 西安 710048;2.浙江大學工業控制技術國家重點實驗室,浙江 杭州 310027)

基于GoogLeNet的色織物花型分類

張宏偉1,2,張凌婕1,*,李鵬飛1,宋執環2

(1.西安工程大學,陜西 西安 710048;2.浙江大學工業控制技術國家重點實驗室,浙江 杭州 310027)

針對色織物花型人工視覺分類效率低的問題,提出了一種基于深度卷積神經網絡(CNN)的色織物花型圖像識別分類方法。構建了18種類別的色織物花型圖像樣本數據庫,建立了基于GoogLeNet的色織物花型分類深度卷積神經網絡,并通過實驗分析選擇最優的訓練迭代期與學習率。結果表明利用深度神經網絡分類識別色織物花型是可行、有效的。

深度卷積網絡;色織物;花型分類

隨著色織生產過程圖像采集和存儲技術的發展,色織物花型圖像的分類和管理越來越受到紡織企業的重視。傳統的色織物花型分類主要依賴于人工目測,由技術工人視覺檢測并做不同的標記;但是這種方法受到人的心理、生理、熟練程度和疲勞程度等因素的影響,效率較低,難以適應紡織工業轉型升級的需求。對此,一些聚類算法被相應提出運用于分類中,如人工神經網絡、模糊C-means算法、灰度共生矩陣法和多分辨率及灰度共生矩陣法等[1-2]。目前灰度共生矩陣算法在坯布分類中應用較多,但它局限于只能提取單一尺度下的特征,在識別花型復雜的色織物時效果較差。近幾年深度學習技術被廣泛用于大規模互聯網圖像的分類,效果較好,對具有復雜圖像特性的色織物花型自動分類具有良好的借鑒意義。

因此,本文針對色織物花型人工視覺分類效率低的問題,提出了一種基于深度神經網絡的色織物花型分類模型[3]。利用廣東溢達紡織有限公司提供的18種花型色織物裁片樣本,首先建立規模為3 549幅的色織物花型圖像樣本庫,然后構建基于GoogLeNet的色織物花型分類卷積神經網絡模型,最后給出模型評價準則,并通過實驗對比確定模型的訓練迭代期和學習率。

1 色織物花型樣本和深度學習系統

1.1 色織物花型樣本庫的構建

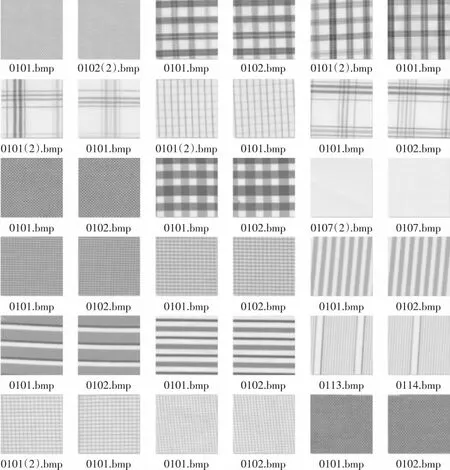

色織物圖像樣本庫由廣東溢達紡織提供的18種色織物裁片采集得到,圖像規模為3 549幅,其中75%用于訓練,15%用于校驗,10%用于測試。為便于建模,每幅色織物花型圖像的分辨率設置為256×256×3。如圖1所示,這18種色織物花型極為復雜,難以用傳統人工構造圖像特征的方法進行區分,更難以使用淺層學習模型的方法進行分類。

圖1 部分色織物花型樣本圖

1.2 色織物花型深度學習系統搭建

色織物花型分類深度卷積網絡模型的訓練涉及參數較多,計算量較大,常規的CPU計算平臺難以勝任。為了提高深度學習模型的建模效率,采用了容天DevtopSCW4750,硬件配置上它采用一個CPUInteli7-i7-5930,四個NVIDIAGeForceTitanX12G,八個8G內存。軟件架構上操作系統為Ubuntu14.04,深度神經網絡參數配置平臺為Digits。

2 基于GoogLeNet卷積神經網絡模型

2.1 卷積神經網絡模型

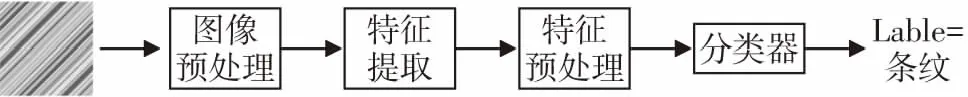

如圖2所示,從傳統的圖像分類視角看,首先要對原始圖像進行預處理,然后人為設計圖像特征并進行特征提取。對于花型復雜的色織物來說,只能依據經驗選擇和設計圖像特征,人為因素對特征的有效性影響很大。針對不同的樣本庫需要重新設計圖像特征,導致傳統特征模型的通用性不強,使用性能差[4]。

圖2 傳統色織物分類模型

如圖3所示,針對傳統神經網絡存在的問題,在圖像分類問題背景下提出了CNN卷積神經網絡模型[5-6]。

圖3 卷積生成網絡(CNN)色織物分類模型

卷積神經網絡由若干卷積層,池化層,全連接層構成。首先在輸入層輸入圖片,接著第一個卷基層對這幅圖像進行了卷積操作,得到三個特征映射。卷基層包含了3個核,也就是三套參數。例如有一個5×5大小的圖像,使用一個3×3的卷積核進行卷積,得到一個3×3的特征映射。卷積的公式為:

(1)

(2)

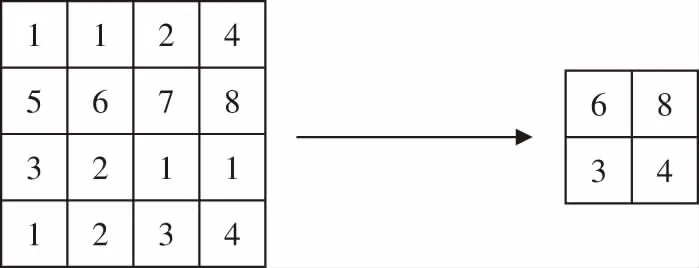

(3)式中,w1是卷積前圖像的寬度;w2是卷積后特征映射的寬度;f是卷積核的寬度p的補零數量。圖像大小、步幅和卷積后的特征映射大小是有關系的,卷積過后池化層對特征映射做了下采樣。CNN中最常用的池化方法是最大池化,如圖4所示為最大池化的過程。

采樣結束后得到了3個更小的特征映射,接著是第二卷積層,它有5個卷積核。每個卷積核把前面下采樣之后的3個特征映射進行卷積,接著就是池化下采樣。圖3中所示的網絡最后兩層是全連接層,第一個全連接層的每個神經元和上一層的5個特征映射中的每個神經元相連,第二個全連接層的每個神經元則和第一個全連接層的每個神經元相連,這樣得到了整個網絡的輸出。目前很多文獻對CNN模型進行了改進[7-8],最常使用的CNN網絡結構分為Zeiler與Inception,其中典型的Zeiler類網絡是AlexNet[9],典型的Inception類網絡是GoogLeNet[10]。

圖4 最大池化

2.2GoogLeNet的卷積神經網絡

在網絡更寬更深的背景下,為了防止過擬合和計算量的增加,以及增加網絡深度和寬度的同時減少參數,GoogLeNet在2014年ILSVRC比賽中被提出。它將Top5的錯誤率降低到6.67%,是一個22層的深度網絡;一般的卷積層只是一味地增加卷積層的深度,而GoogLeNet在單層的卷積層上使用不同尺度的卷積核。GoogLeNet架構的核心是Inception模塊,深度達到27層,Inception架構中存在著濾波器,濾波器組的輸出合并在一起構成了下一層的輸入。具體來說先使用1×1卷積量子來進行降維,再進行3×3,5×5的卷積操作,這樣尺寸不同的卷積核就可以提取不同尺寸的信息,這種Inception模型既能大大提升卷積提取特征的能力,又不會使計算量提升很多,而GoogLeNet就是由這種模型逐步構建出來的。模型的特點是采用了模塊化的結構、使用平均池化代替全連接層及增加了兩個輔助softmax用于前向傳導梯度,避免梯度消失。最為關鍵的是GoogLeNet來自Google團隊并由其維護,其卷積網絡的結構易于工程化實現,適合于色織物裁片花型的分類研究和后期的實用化推廣。

3 實驗結果與討論

為了驗證GoogLeNet深度卷積網絡模型對色織物花型分類的有效性,首先對如圖1所示的3 549幅色織花型裁片進行圖像采集,并逐個進行人工標記,建立色織物花型分類深度學習樣本集(每類花型圖像樣本規模大約200幅,每類隨機挑選出75%用于訓練,15%用于校驗,10%用于測試);然后建立基于GoogLeNet的色織物花型分類模型;最后通過實驗對比,選擇最優的訓練迭代期參數與學習率參數。為了評價不同超參數條件下深度學習模型的優劣,選擇分類準確率和建模時間作為評價基準。分類準確率由準確分類的待測色織物花型樣本數目和待測色織物花型樣本總數之比得出:

(4)

式中,n準和n總分別為正確分類的待測織物花型圖像數和待分類織物花型圖像總數。建模時間由1.2節所述的GPU學習工作站和Digits參數配置平臺計算得到。本實驗的目的是通過設置合適的訓練迭代期和基礎學習率,在較高的分類準確率和較低的建模時間中找到最佳的平衡點。

首先,建立基于GoogLeNet網絡的織物花型分類模型,并通過實驗對比不同訓練迭代期下的分類準確率,選擇合適的訓練迭代期參數。模型基礎學習率固定為0.01的步長,改變訓練迭代期的次數,并且在每經過33.33%的迭代期時學習率逐步設定為0.001和0.000 1的步長,分別測試該模型在訓練迭代期為30,50,70時的準確率和建模時間。然后模型迭代次數固定為50,分別設定模型的基礎學習率為1,0.1,0.05,0.01,0.001的步長,分析對比該模型的分類準確率。

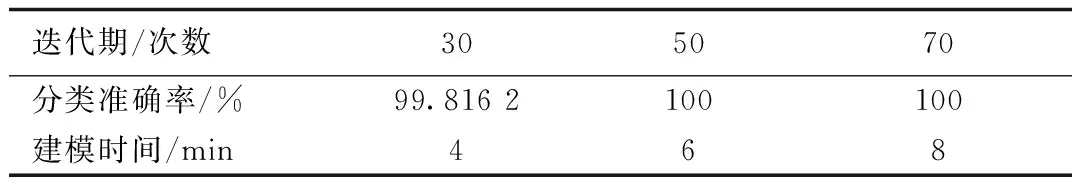

不同訓練迭代期下色織物花型的識別準確率和建模時間如表1所示。GoogLeNet的分類準確率很高,并且隨著訓練迭代期逐漸增大穩定在100%左右。因為GoogLeNet是一個22層的深度網絡,用更多的卷積、更深的層次和規模更大的訓練集會得到較好的效果;所以在對本實驗2 662幅色織物花型圖像的建模中,分類準確率較高。GoogLeNet的建模時間隨著迭代次數的增加逐漸增加。綜合考量識別準確率和建模時間,訓練迭代期選擇為50次時,分類準確率和建模時間可以實現較好的折中,滿足工程化的需求。

表1 不同訓練迭代期下GoogLeNet

另外,在訓練樣本集規模為2 662幅色織物花型圖像的條件下,GoogLeNet最快可以在4min以內訓練完成,且分類準確率可以達到99%以上,證明了基于GoogLeNet的卷積神經網絡模型對于色織物花型分類的建模實時性和準確性較好。

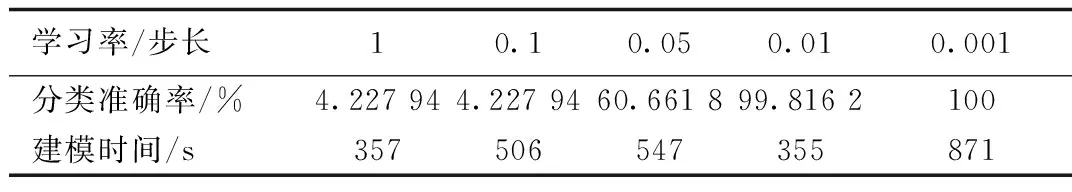

表1固定訓練迭代期為50,分別設定基礎學習率為1,0.1,0.05,0.01和0.001的步長,對應的GoogLeNet模型分類準確率和建模時間分別如表2所示。隨著基礎學習率的降低,準確率逐步上升;但是建模時間在0.01的步長時取得最小值。所以綜合考量分類準確率和建模時間,基礎學習率選為0.01的步長時,既能取得較高的分類準確率,又具有較好的建模實時性。

表2 不同學習率下GoogLeNet的分類準確率和建模時間

4 結論

為解決色織物花型人工視覺分類效率低和人工難以構造色織物花型分類特征的問題,首先構建了一個規模為3 549幅的色織物花型圖像數據庫,然后通過改變GoogLeNet的訓練迭代次數和基礎學習率參數,研究色織物花型分類模型的準確率和建模時間變化,選擇出合適的訓練迭代次數和基礎學習率。其實驗結果表明,基于GoogLeNet的色織物深度學習模型對于色織物花型分類問題是一種有效可行的解決方案,并且選擇合適的訓練迭代期和基礎學習率對色織物分類準確性和建模時間有重要影響。

[1] 朱 昊.圖像處理技術在織物花型結構識別中的應用[J].絲綢,2008,(1):42-44.

[2] 任建峰,郭 雷,李 剛.多類支持向量機的自然圖像分類[J].西北工業大學學報,2005,23(3):295-298.

[3] 余 凱,賈 磊,陳雨強.深度學習的昨天、今天和明天[J].計算機研究與發展,2013,50(9):1 799-1 804.

[4] 趙仲秋,季海峰,高 雋.基于稀疏編碼多尺度空間潛在語義分析的圖像分類[J].計算機學報,2014,377(6):1 251-1 260.

[5] 諶 璐,賀興時.改進的支持向量機算法在人臉識別上的應用[J].紡織高校基礎科學學報,2015,(1):108-115.

[6] 常 亮,鄧小明,周明全,等.圖像理解中的卷積神經網絡[J].自動化學報,2016,42(9):1 300-1 312.

[7]ZEILERMD,FERGUSR.Visualizingandunderstandingconvolutionalnetworks[J].ComputerVision-ECCV, 2014,8 689:818-833.

[8] 常 亮,鄧小明,周明全.圖像理解中的卷積神經網絡[J].自動化學報,2016,42(9):1 300-1 312.

[9]KRIZHEVSKYA,SUTSKEVERI,HINTONGE.Imagenetclassificationwithdeepconvolutionalneuralnetworks[J].AdvancesinNeuralInformationProcessingSystems,2012,25(2):1 097-1 105.

[10]SZEGEDYC,LIUW,JIAY,etal.Goingdeeperwithconvolutions[C].IEEEConferenceonComputerVisionandPatternRecognition,2015:1-9.

Pattern Classification of Yarn-Dyed Fabrics Based on GoogLeNet

ZHANG Hong-wei1, 2, ZHANG Ling-jie1,*, LI Peng-fei1, SONG Zhi-huan2

(1.Xi′an Polytechnic University, Xi′an 710048, China; 2.State Key Laboratory of Industrial Control Technology, Zhejiang University, Hangzhou 310027, China)

Aiming at the low efficiency problem of manual classification for the pattern of yarn-dyed fabric, pattern recognition and classification method for yarn-dyed fabrics based on deep convolution neural network (CNN) was proposed. 18 kinds of sample database of yarn-dyed fabric patterns were established. Deep convolution neural network of yarn-dyed fabric pattern classification models were developed based on GoogLeNet. Optimal training epoch periods and learning rates were selected through experimental analysis based on the model evaluation criterion. Results showed that it was feasible and effective to classify yarn-dyed fabric patterns by deep convolution neural networks.

deep convolution network; yarn-dyed fabric; pattern classification

2017-06-12;

2017-06-19

陜西省自然科學基金(2014JQ2-5029);西安工程大學博士科研啟動基金(BS1411)

張宏偉(1983-),男,講師,安徽淮北人,主要研究方向:機器學習、軟測量,E-mail:zhanghongwei@zju.edu.cn。

*通信作者:張凌婕,E-mail:379530773@qq.cm。

TS

A

1673-0356(2017)07-0033-03