基于視覺注意機制的圖像壓縮感知復(fù)原

趙 帥,曾衛(wèi)明

(上海海事大學(xué) 信息工程學(xué)院,上海 201306)

基于視覺注意機制的圖像壓縮感知復(fù)原

趙 帥,曾衛(wèi)明

(上海海事大學(xué) 信息工程學(xué)院,上海 201306)

對于低采樣、低質(zhì)航運圖像的復(fù)原問題,提出了一種新的圖像壓縮感知復(fù)原算法。首先對圖像進行預(yù)處理,然后由人眼視覺注意機制模型確定注意點位置,并采用自適應(yīng)遺傳算法對注意點像素值進行尋優(yōu),最后復(fù)原獲得復(fù)原圖像。實驗結(jié)果表明,所提出的基于視覺注意機制的圖像壓縮感知復(fù)原算法不僅提高了圖像的復(fù)原質(zhì)量,同時很好地保存了圖像的細節(jié)信息。

采樣;人眼視覺注意機制;自適應(yīng);遺傳算法;壓縮感知

0 引言

所謂的“壓縮感知”,即直接感知壓縮了的信息[1]。壓縮感知(Compressed Sensing, CS)理論[2]由DONOHO D、CANDES、E華裔科學(xué)家TAO T等人提出,其作為新興的方法表現(xiàn)出了強大的生命力和活力。CS理論不同于傳統(tǒng)的“先采樣、后壓縮”,而是采用“邊采樣、邊壓縮”的方式,可以顯著減少采樣資源的浪費。

基于低質(zhì)圖像的復(fù)原狀況研究,目前主流的復(fù)原算法是將其轉(zhuǎn)換為次優(yōu)化問題,如匹配追蹤問題、迭代閾值法等,就是將多峰值問題轉(zhuǎn)換為一個凸優(yōu)化的問題來進行解決,使問題簡單化,但是該類做法使得復(fù)原結(jié)果不夠準(zhǔn)確,其中大部分是將L0范數(shù)問題轉(zhuǎn)換為L1范數(shù)或者L2范數(shù)來進行求解,從數(shù)學(xué)角度來看問題得到了簡化,但是從科學(xué)角度上并沒有實際解決壓縮感知的根本問題[3]。

本文從壓縮感知的根本出發(fā)提出了在L0范數(shù)[4]下的基于視覺注意機制的自適應(yīng)遺傳算法與壓縮感知相結(jié)合的算法(Human visual attention mechanism Genetic algorithm Compressed Sensing, HGCS),并進行了相關(guān)實驗。

1 壓縮感知理論

圖像要進行壓縮感知恢復(fù)首先應(yīng)該滿足圖像是可稀疏的。圖像稀疏就是圖像二維表示的非零元素的個數(shù)遠遠小于零元素的個數(shù)[5-6]。在編碼測試過程中,需要用到滿足RIP[7](約束等距性)條件的兩個矩陣(稀疏矩陣和測量矩陣),測量矩陣由稀疏矩陣和RIP條件共同決定并不唯一。用測量矩陣與圖像矩陣的乘積來得到原始圖像在測量矩陣下的投影值,然后通過投影值和測量矩陣?yán)弥貥?gòu)算法恢復(fù)出原始信號的近似值[2]。

圖像的自然信號一般是不稀疏的,但是通過一些變換(如小波變換等)可以使大多數(shù)的圖像像素值變?yōu)榱悖_到稀疏。

稀疏的數(shù)學(xué)表示[8]:x=Ψs,設(shè)信號x為N維,即x=[x1,x2,…,xN]T,則ψ為N×N維稀疏表達矩陣,s即是將x進行稀疏表示后的Nx1維向量,其中大部分元素值為0。稀疏表示的原理就是通過線性空間映射,將信號在稀疏空間進行表示。

感知測量的數(shù)學(xué)表示:y=Φx,其中x就是稀疏表示中的信號,為M×N維的感知矩陣,y則表示M(M遠小于N才有意義)個傳感器的直接測量,因此維度為M×1。

壓縮感知的原信號恢復(fù)問題描述為:

(1) y=Φψs+e=Θs+e,其中測量值y為已知條件,e為噪聲引入;

(2) s為k-Sparse信號(k未知)。

求解目標(biāo):k盡可能小的稀疏表示信號s及對應(yīng)的 ψ。用數(shù)學(xué)形式描述:

(1)

2 視覺注意機制理論

人眼的生理結(jié)構(gòu)決定人眼成像是一個復(fù)雜的過程,且人類接觸外界的環(huán)境并從中取得的信息有70%以上來源于人眼,理論上人眼攝入的信息遠遠大于人們感知的信息,但是由于如此龐大的信息大腦根本無法承受,因而在人體生理上為克服這一問題視覺系統(tǒng)的視覺選擇注意機制[9]就發(fā)揮了重要的作用,其有強大的數(shù)據(jù)篩選能力,不停地拋棄不重要的信息。

引導(dǎo)視覺注意的初級特征有很多,像亮度、顏色、方向、形狀、運動等[10]都是,而其中顏色、亮度、方向是最主要的三個基本的視覺特征。基本特征的提取[11]如下:

(1)亮度特征提取:若圖像為灰度圖像可以直接得到其亮度信息,若為彩色圖像只需要將其轉(zhuǎn)換為灰度圖像即可。假設(shè)圖r、g、b為圖像中的三原色通道,那么亮度I就可以用I=(r+g+b)/3進行表示。

(2)顏色特征提取:在視覺皮層中存在顏色拮抗現(xiàn)象,入射光進入人眼由人眼錐狀細胞轉(zhuǎn)換為神經(jīng)信號,再將這些神經(jīng)信號傳遞到感受野[10]上,形成3個對立顏色通道,在這3個通道中紅-綠和黃-藍通道對視覺注意模型影響較大是研究的重點。經(jīng)過近年的研究,確立了廣義上的紅、綠、藍和黃4個通道及紅-綠和藍-黃通道的計算公式[12]:

(2)

(3)方向特征提取:本文采用的是將圖像直接帶入Gabor濾波器[13]進行方向特征的提取。

g(x,y,λ,θ,σ,γ)=

(3)

其中,λ為波長;θ為方向;ψ為相位偏移;γ為長寬比;b為帶寬。

3 本文方法

為了解決低質(zhì)圖像的復(fù)原問題本文提出了HGCS方法,主要思想是利用視覺注意機制模型和自適應(yīng)遺傳算法相結(jié)合的方法對注意點進行定位和尋優(yōu),然后將注意點與未注意點進行組合復(fù)原。

3.1 圖像的稀疏

本文采用小波變換[14]的方法對圖像進行稀疏處理,確定本文壓縮感知中的稀疏基為小波基。

3.2 待處理像素點位置確定

本文采用視覺注意機制模型對待處理像素點位置進行確定,選取顏色、亮度、方向3個視覺特征作為核心特征進行操作,用全局加強法[12]將3個特征圖信息進行整合:將各特征圖的特征值歸一化到[1-255],然后查找各圖的全局最大值M,并求出所有值的平均值m,將M與m之差的平方作為該特征值的權(quán)值。

3.3 遺傳算法尋優(yōu)

五六十年代,濟寧林業(yè)遭受很大破壞,森林資源持續(xù)減少。隨后全國迎來了改革開放,濟寧開始大規(guī)模推進國土綠化,通過完善造林綠化政策、簽訂綠化目標(biāo)責(zé)任狀、實施工程造林等多種措施,造林綠化穩(wěn)步推進,森林資源持續(xù)增長,截至目前,全市林木綠化覆蓋率達到32.21%。

為了解決壓縮感知多峰值優(yōu)化問題并構(gòu)造適應(yīng)度函數(shù)引入遺傳算法[15],本文將式(1)變化為[3]:

(4)

為了使自適應(yīng)遺傳算法能夠快速收斂到全局最優(yōu)得到各個像素點的最優(yōu)解[16],并借鑒文獻[17]的算法,將式(4)的倒數(shù)作為適應(yīng)度函數(shù)(定義為式(5)):

(5)

其中λ為調(diào)節(jié)因子用來調(diào)節(jié)前后兩項,使其保持同樣的數(shù)量級。

自適應(yīng)遺傳算法的詳細步驟如下:

(1)初始化進化代數(shù)n為1,初始一個種群大小pop_size為10;

(2)計算種群各個體適應(yīng)度、適應(yīng)度函數(shù)總值、各個體適應(yīng)度比例、個體適應(yīng)度平均值;

(3)選擇操作,選用輪盤賭方式;

(4)交叉操作,交叉概率采用自定義的交叉概率函數(shù)計算:cross_rate(j)表示各個體變異概率值,c(j)表示各個體適應(yīng)度值,x是種群個體適應(yīng)度最大值,當(dāng)種群個體為適應(yīng)度最大個體時其cross_rate賦值為0,達到保留效果,其余個體將其交叉概率定義為:corss_rate(j)=c(j)/x;

(5)變異操作,變異概率采用自定義的交叉概率函數(shù)計算:mutate_rate(j)表示各個體變異概率值,a_sum表示種群個體適應(yīng)度總和,a_every(j)表示種群中各個體適應(yīng)度值在種群個體總適應(yīng)度中的占比,定義自適應(yīng)交叉概率公式:mutate_rate(j)=a_every(j)×0.2,0.2為一般變異概率變換基值;

(6)如果滿足進化結(jié)束條件則進化結(jié)束,否則跳轉(zhuǎn)至第(2)步重復(fù)進行該步驟。

綜上所述,具體實現(xiàn)步驟為:

(1)前期處理:對圖像進行前期處理,近似補齊較明顯的像素點缺失;

(2)圖像稀疏并構(gòu)建觀測矩:圖像小波變換得到高頻部分和低頻部分,低頻部分保留,高頻部分按閾值變化[19]。得到原始圖像高頻部分,并根據(jù)RIP準(zhǔn)則生成高斯測量矩陣Φ;

(3)圖像的復(fù)原:①確定注意點:對于給定采樣率下的小波高頻系數(shù)在測量矩陣下的投影值Y,采用人眼視覺注意機制模型,確定各投影圖像需要處理的像素點位置(即注意點),剩余部分為未注意點;②注意點尋優(yōu):對該步驟中查找到的注意點位置初始化種群,然后運用上面提到的自適應(yīng)遺傳算法,對每個確定的像素點位置處數(shù)據(jù)進行尋優(yōu),生成適應(yīng)該點的最優(yōu)個體,并替換原注意點處的值;將尋優(yōu)的新注意點值與未注意點值組成新的高頻矩陣;將新高頻矩陣與保留的低頻矩陣組合;③復(fù)原圖像:將新高頻矩陣與保留低頻矩陣的組合進行小波逆變換得到復(fù)原圖像。

4 仿真實驗及結(jié)果分析

為了驗證本文所提出的HGCS方法的實用性,對兩組數(shù)據(jù)進行了實驗,一組數(shù)據(jù)是普通圖像數(shù)據(jù),另一組數(shù)據(jù)是航運圖像數(shù)據(jù)。同時為了進行比較,基于自適應(yīng)遺傳算法的壓縮感知復(fù)原方法(Genetic Algorithm Compressed Sensing, GCS)也應(yīng)用于實驗中。為了保證實驗結(jié)果的穩(wěn)定性,分別對上述兩種方法進行了多次運算,并且利用多次運算的PSNR(峰值信噪比)的平均值作為定量化指標(biāo),對實驗結(jié)果進行比較分析。PSNR的數(shù)學(xué)計算公式為:

(6)

MSE是原圖與處理圖像之間的均方誤差。

實驗中使用最大迭代代數(shù)作為自適應(yīng)遺傳算法的終止條件,將終止條件設(shè)置為迭代100代。種群規(guī)模設(shè)置為10。

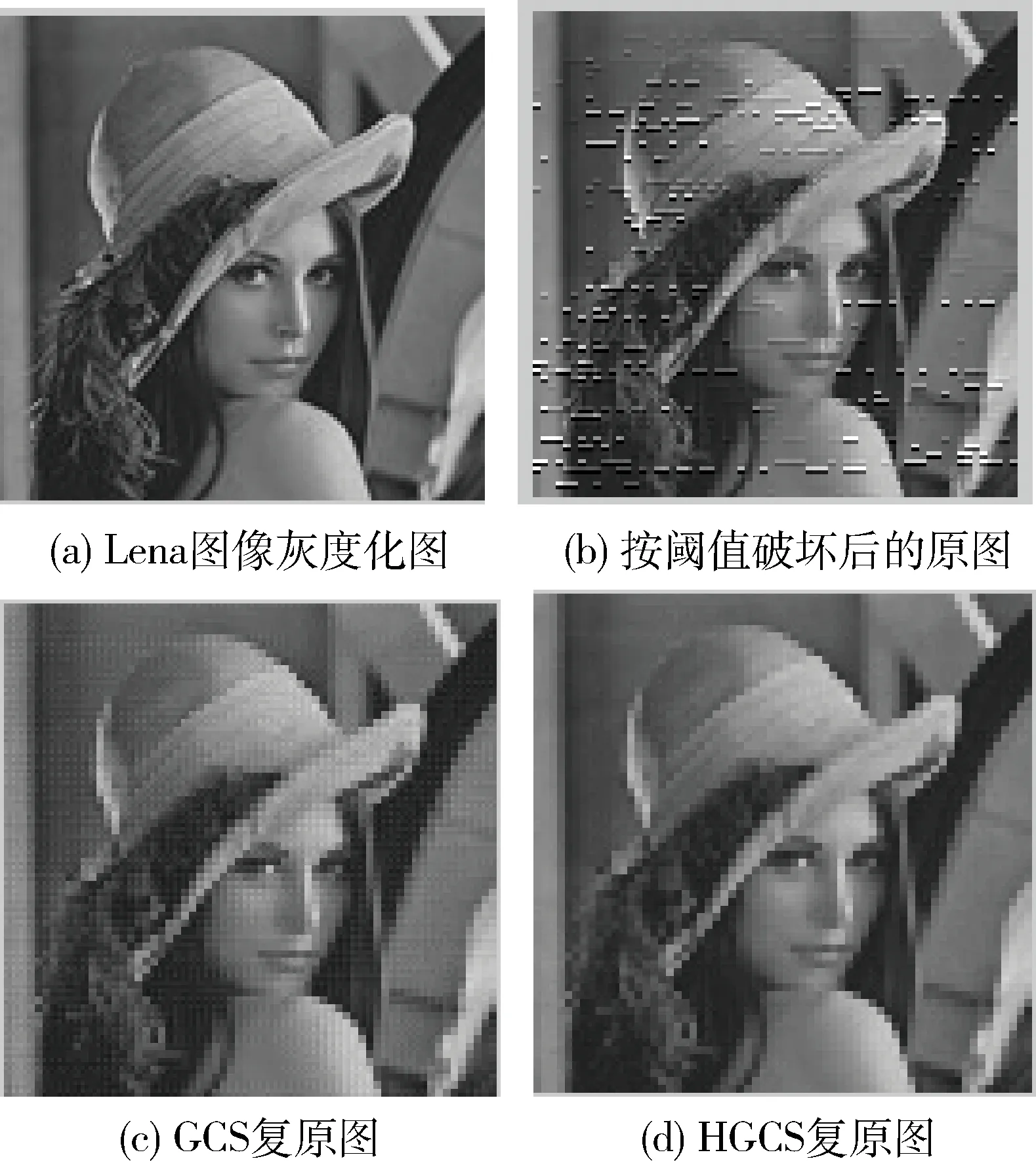

4.1 普通圖像

實驗選取128×128的Lena圖像作為普通圖像,從圖1的實驗數(shù)據(jù)可以看出(c)圖的GCS方法和(d)圖的HGCS方法都可以對圖像進行復(fù)原,但是(d)圖細節(jié)信息恢復(fù)得更好。進一步通過計算可以得到(c)的平均PSNR為32.487,(d)的平均PSNR為34.364,一般PSNR值越大說明圖像質(zhì)量越高,因此上述計算結(jié)果進一步證明了加入視覺注意機制模型的HGCS方法能夠取得更好的圖像復(fù)原效果,并且能夠保留更完整的細節(jié)信息。

圖1 Lena圖像破壞恢復(fù)比較

4.2 海運圖像

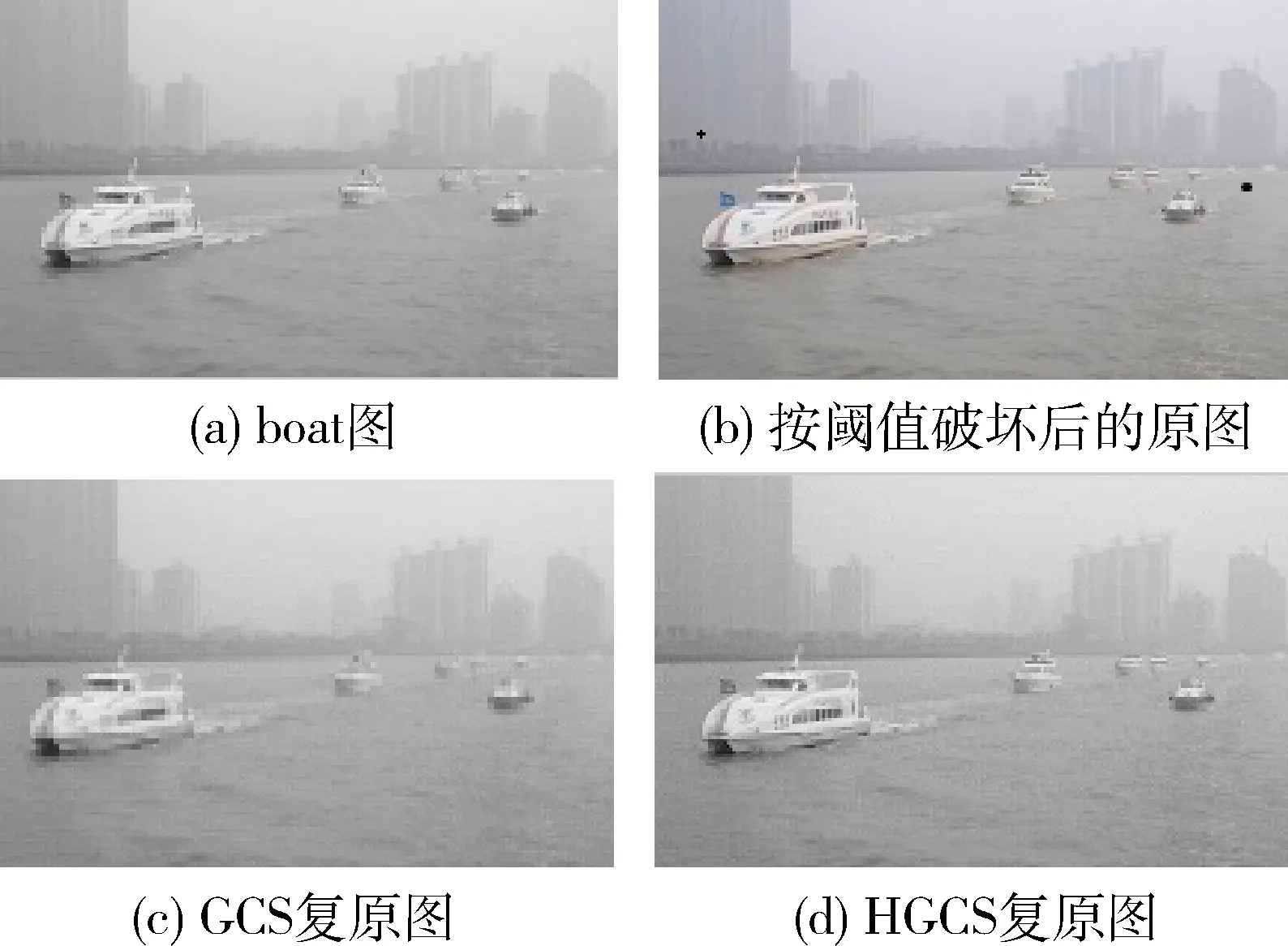

選取216×132的boat圖作為航運圖像進行實驗,從圖2的實驗數(shù)據(jù)可以看出(c)圖GCS方法和(d)圖HGCS方法都可以對圖像進行復(fù)原,但是(d)圖復(fù)原效果明顯優(yōu)于(c)圖,進一步通過計算可以得到(c)的平均PSNR為15.46,(d)的平均PSNR為30.468,因此上述計算結(jié)果進一步驗證了對低質(zhì)航運圖的復(fù)原效果,HGCS方法較之GCS方法有了巨大提升,加入視覺注意機制模型后航船等注意點信息得到明顯提高。

圖2 boat圖像破壞恢復(fù)比較

綜合上述圖1、圖2仿真結(jié)果,證明了HGCS方法在零范數(shù)問題上的有效性和其解決多峰值優(yōu)化問題的實用性。本文的算法在保持圖像細節(jié)信息和紋理上效果明顯,特別是航運圖像因水紋等噪音影響,GCS算法要處理的信息比HGCS方法多出好幾倍,所以HGCS方法在效率上大大優(yōu)于GCS算法。

5 結(jié)論

本文簡要介紹了一種從壓縮感知的根本出發(fā),在視覺注意機制模型輔助下的、自適應(yīng)遺傳算法尋優(yōu)的、基于L0范數(shù)的圖像壓縮感知復(fù)原方法,并通過實驗證明了該方法是一種可靠的、有效的圖像復(fù)原方法。且通過實驗數(shù)據(jù)可以驗證得出HGCS較之普通未加入視覺注意機制模型的自適應(yīng)遺傳尋優(yōu)的壓縮感知算法效果更好,運算時間更短。

[1] 任越美,張艷寧,李映.壓縮感知及其圖像處理應(yīng)用研究進展與展望[J].自動化學(xué)報,2014,40(8):1563-1575.

[3] 徐靜.基于遺傳算法的零范數(shù)壓縮感知圖像重構(gòu)方法研究[J]. 現(xiàn)代電子技術(shù),2011,34(16):52-54

[4] 王愛齊.圖像去模糊的I_0范數(shù)最小化方法[J].信號處理,2012,28(11): 1493-1497.

[5] Liu Dongxin, Wu Zhihao,Wu Fan,et al.Compressive sensing based costefficient indoor white space exploration[D]. Shanghai Key Laboratory of Scalable Computingand Systems, Shanghai Jiao Tong University,2014.

[6] Xu Liwen,Hao Xiaohong,LANE N D,et al.More with less: lowering user burden in mobile crowdsourcing through compressive sensing[D]. Tsinghua University, Bell Lab-s,2014.

[7] 路暢,劉玉紅.壓縮感知理論中的RIP準(zhǔn)則[J].自動化與儀器儀表,2015(8): 211-213.

[8] 周宇. 基于壓縮感知的圖像重構(gòu)方法研究[D].西安:西安電子科技大學(xué),2012.

[9] LI C Y,PEI X,ZHOW Y X,et al.Role of the extensive area outside the X-cell receptive field in brightness information transmission[J]. Vision Research,1991,31(9):1529-1540.

[10] RODIECK R W. Quantitative analysis of cat retinal ganglion cell response to visual stimuli[J]. Vision Research, 1965,5(11):538-601.

[11] 楊雪.基于視覺感知的圖像顯著區(qū)域的提取[J].微型機與應(yīng)用,2015,34(2):47-48.

[12] 王延龍,吳青.視覺注意機制的計算模型及其應(yīng)用研究[D]. 天津:河北工業(yè)大學(xué),2010.

[13] JONES J P,PALMER L A.An evaluation of the two-dimensional Gabor filter model of simple receptive fields in cat striate cortex[J].Journal of Neurophysiology,1987,58(6):1233-1258.

[14] 張健.基于稀疏表示模型的圖像復(fù)原技術(shù)研究[D]. 哈爾濱:哈爾濱工業(yè)大學(xué),2014.

[15] 殷銘,張興華,戴先中.基于MATLAB的遺傳算法實現(xiàn)[J]. 電子技術(shù)應(yīng)用,2000,26(1):9-11.

[16] SIVANANDAM S N, DEEPA S N. Introduction to genetic algorithms[M]. Springer Berlin Heidelberg, 2008.

[17] 李國.改進的自適應(yīng)遺傳算法在圖像模糊增強中的應(yīng)用[J]. 測繪科學(xué),2012,37(3): 77-79.

[18] MA J W. Improved iterative curvelet thresholding for compressed sensing and measurement[J]. IEEE Transactions on Instrumentation and Measurement, 2011, 60(1): 126-136.

Image compression sensing restoration based on visual attention mechanism

Zhao Shuai, Zeng Weiming

(College of Information Engineering, Shanghai Maritime Univeristy, Shanghai 201306, China)

For the low-sampling and low-quality navigation images restoration problem, this paper proposed a new image compression perception recovery algorithm.Firstly,the image is preprocessed. Then the attention point is determined by the human visual attention mechanism model, followed by using the adaptive genetic algorithm(GA) to find the pixel values of the attention point. Finally,a restored image is obtained.The experimental results show that the image compressed sensing recovery algorithm based on visual attention mechanism proposed in this paper,not only can improve the quality of reconstructed image,but also can better preserve the detail information of image.

sampling; human visual attention mechanism; adaptive; genetic algorithm(GA); compressed sensing

TP391

A

10.19358/j.issn.1674- 7720.2017.15.015

趙帥,曾衛(wèi)明.基于視覺注意機制的圖像壓縮感知復(fù)原[J].微型機與應(yīng)用,2017,36(15):53-55,58.

2017-02-15)

趙帥(1990-),通信作者,男,碩士研究生,主要研究方向:圖像處理,機器學(xué)習(xí)。E-mail:363629582@qq.com。

曾衛(wèi)明(1971-),男,博士后,教授,博士生導(dǎo)師,主要研究方向:計算機圖像處理與模式識別, 功能磁共振成像與磁共振波譜信息處理, 腦功能網(wǎng)絡(luò)連通與神經(jīng)認知等。